基于机器学习与眼动追踪的认知风格模型构建

摘要:认知风格反映了学生接近、获取、组织、处理和解释信息的模式,可用来解释和指导学生的行为。将认知风格集成到智能系统中,有助于开发个性化的用户模型,推动智能教育发展。当前有关认知风格自动分类的研究较为匮乏,尚未将机器学习与眼动追踪技术联合起来进行应用。基于机器学习与眼动追踪的认知风格模型,选取注视时长、注视点数量、扫视时长、眼跳次数、眼跳距离与瞳孔直径等6个与认知有着密切关系的眼动指标,归一化处理后借助机器学习算法进行认知风格自动分类。实验结果表明:在进行同样时长的视频学习时,不同场认知风格的学习者表现出不同的视觉行为模式;场依存型学习者注视点较为分散,表现出有较多的扫视行为、较少的注视行为、较长的眼跳距离与较大的瞳孔直径变化,信息搜索效率较低;而场独立型学习者有着较为密集与定向的视觉注意模式,信息搜索效率更高。对5种机器学习算法进行性能对比后发现,逻辑回归算法的分类效果最好,准确率达到89.01%,Kappa值达到0.774。该认知风格自动化分类模型既可用于智能学习系统的课程资源优化设计,也可用于个性化学习路径的推荐。未来可整合更多生理数据,通过不同模态数据之间的信息互补,提升数据分析的准确性以及对学习者认知能力评估的可靠性。

关键词:智能教育;机器学习;眼动追踪技术;场认知风格;自动化分类

中图分类号:G434" "文献标识码:A" " 文章编号:1009-5195(2024)04-0094-10" doi10.3969/j.issn.1009-5195.2024.04.011

——————————————————————————————————————————

基金项目:全国教育科学规划2022年度教育部重点课题“智能教育视角下基于眼动追踪的在线学习认知模型及自适应机制研究”(DCA220453)。

作者简介:薛耀锋,博士,副研究员,硕士生导师,华东师范大学教育信息技术学系,上海数字化教育装备工程技术研究中心(上海 200062);朱芳清,硕士研究生,华东师范大学教育信息技术学系(上海 200062)。

一、引言

目前我国教育正面临着由规模化向个性化、从信息化到智能化的过渡和转变,传统的教育模式和学习方式亟待创新与变革。智能教育作为智能技术与教育领域深度融合的代表,能够服务于教育模式的转变和教育生态的重构(郭绍青等,2022)。《中国教育现代化 2035》从智能校园建设、人才培养、教育治理等不同方面提出了智能教育发展的战略任务(新华网,2019),加快了智能教育以及相关应用的落地。智能教学系统是智能技术赋能教育的重要成果(王靖等,2023)。认知风格数据正被集成到智能系统中,以开发个性化的用户模型,推动智能教育发展(Nisiforou et al.,2013)。一些研究结果表明,认知风格与学习成绩之间存在直接关联,即学习内容和形式与学习者的认知风格越匹配,学习者的学习成绩就越高(Jovanovic et al.,2012)。认知风格是指个体展示的相对稳定的信息处理模式(McKay et al.,2003),反映了学生接近、获取、组织、处理和解释信息的模式,可以用来解释和指导他们的行为。然而传统的认知风格测量往往通过量表来进行,测量结果可能会受到主观因素的影响,同时需要较长的填写时间(Yousef et al,,2021)。因此,亟需开发一种新的、更便捷、更客观的测量方法,来准确评估学生的认知风格,以更好地服务智能时代学生的学习。

随着智能技术及认知科学的发展,基于眼动追踪技术来探究学习者的认知过程已成为教育学与心理学研究的重要方式。这是因为眼球运动是视觉感知活动中不可或缺的重要组成部分(Workman,2004),眼动数据能够追踪反映学习者的信息加工与认知过程,且眼动追踪技术具有非侵入性的优势(薛耀锋等,2021)。越来越多的研究开始探索个体的认知特征与视觉之间的关系。例如,Liu(2018)通过眼动数据研究了场依赖和场独立认知风格在视觉搜索效率和多媒体学习性能方面的差异,证明了眼动指标可用于识别学习者的认知风格类型。然而,目前的眼动追踪数据仅以热图或描述性统计结果的形式区分学习者的类型,具体的分析与验证还需要研究者的进一步解释(Pradnya Sidhawara et al.,2020)。

随着人工智能技术的发展,将眼动追踪技术与机器学习相结合来优化智能系统,已成为智能教育系统开发研究的重要趋势。例如,Eivazi等人(2011)使用眼动追踪和机器学习的方法来探究个人的视觉注意力模式与问题解决行为的关系;Lou等人(2017)使用支持向量机(Support Vector Machine,SVM)算法和眼动追踪技术来评估读者的识字能力,准确率达80.3%。先前研究表明,机器学习算法可用于眼动数据的分析,以实现对学习者认知状态的自动识别。

基于此,本研究拟基于机器学习算法和眼动追踪技术构建认知风格自动识别模型,通过分析学习者眼动模式与认知风格之间的关系,总结不同场认知风格学习者在视频学习过程中的眼动模式及其眼动指标差异,并利用机器学习算法实现在线学习过程中学习者场独立—场依存风格的自动分类,以促进智能学习系统的开发,为学生提供个性化和智能化的反馈。

二、相关研究

1.场认知风格

场认知风格是在关于教学效果的研究中确定的认知风格理论(Al-Saai et al.,1993)。场认知风格分为场独立、场依存两个维度,是最广泛被使用的认知风格分类之一。Witkin(1967)认为,不同人处理学习材料的方式不同,使用不同的方法完成学习任务;场独立型个体在信息加工中对内在参照(主体精神)有较大的依赖倾向,主要依据内在标准或内在参照进行价值判断;而场依存型个体则倾向于以外在参照(外部环境或他人)作为信息加工的依据,处理问题时往往依赖于外在参照对客观事物或事实进行判断。因此,场依存型个体比场独立型个体更容易受到外部线索的影响。在以视觉感知为主的学习活动中,学习者的这种认知偏好对学习的影响更大。已有研究发现,场依存型学习者在识别嵌入到复杂图形中的简单图形时需要更长的时间,或者根本无法找到;场依存型学习者在从视觉教学材料中提取相关信息方面存在困难(Mahvelati,2020);场独立型个体更易受到内部线索而不是外部线索的影响,因此在信息输入方面具有选择性(Riding et al.,1991)。在社交方面,场依存型个体与场独立型个体也表现出明显差异。场独立型个体具备良好的分析能力,但在社交中表现出孤立、冷漠和疏离的状态;而场依存型个体乐于与人互动,表现出对与他人交流的强烈兴趣(Saracho,2003)。

2.眼动追踪技术

眼球运动被认为与大脑的思维活动有关,这种连续的信息流可以作为探究认知过程的重要指标。已有研究发现,人眼的位置仅在 200~300 毫秒时间内保持稳定。眼球稳定的时期被称为注视期,它们覆盖了大约 2° 的可视角度区域,在此期间信息被聚焦和处理(Jacob et al.,2003)。注视的位置和注视点数量、注视的持续时间和眼跳距离是最常见的眼动测量指标。注视的持续时间、注视次数和重新注视次数揭示了用户的注意力是如何被引导到特定区域或视觉位置的。扫视是指眼睛从一个注视点到另一个注视点的运动。两个连续注视点之间的距离定义为眼跳距离。注视和扫视的路径和顺序,显示了注意力随时间的变化情况,可用于深入了解学习者是如何从视觉线索中收集信息的(Carter et al.,2020)。瞳孔直径也是重要的眼动指标,瞳孔大小的变化与认知处理需求的变化相关,且该指标较为敏感,0.1mm的瞳孔直径变化就可以代表认知状态的改变,因此瞳孔直径可以作为高级心理变化的测量指标(Szulewski et al.,2015)。

3.眼动指标在场认知风格测量中的应用

眼动指标有着很强的表意功能,学习者的认知处理模式可以通过眼动状态与视觉路径来识别(詹泽慧,2013)。具有不同场依赖性的个体在处理多媒体信息时可能表现出不同的眼球运动模式。例如,场依存型学习者被认为可能比场独立型学习者需花费更多的时间和精力来从学习环境中搜索必要的信息(Witkin,1967)。此外,插图的视觉丰富性,包括颜色细节、纹理和形式等特征,也可能干扰场依存型学习者对任务相关信息的处理。因此,与场独立型学习者相比,场依存型学习者可能会表现出更分散的视觉场景注视,以及更长的任务达成时间。

眼动指标在场认知风格测量中的应用研究,多为在特定任务情境中,探讨不同场认知风格学习者的眼动行为差异。如Liu(2018)分析了在观看多媒体教学材料时,不同场认知风格学习者的注视与扫视行为差异;Nisiforou等人(2016)分析了在进行隐藏图形测试时,不同场认知风格学习者的任务完成时长及视觉搜索模式差异。还有一些学者通过眼动数据建模,实现了对其他类别认知风格的自动识别。如薛耀锋等(2020)通过图片与文字兴趣域中注视点与注视时长的比值,对言语—表象型学习者进行了自动识别;Pradnya Sidhawara等(2020)通过K临近算法(KNN)等三种机器学习算法,以注视与扫视相关指标为自变量,实现了言语—表象型学习者的自动分类。

总的来说,有关场认知风格自动识别的研究仍较为匮乏,多数研究仅限于描述性统计分析,眼动数据仅用于验证。此外,以往的研究还未将机器学习算法应用于基于眼动追踪数据的场认知风格自动分类中。因此,本研究拟将机器学习算法和眼动追踪技术结合起来,构建认知风格自动分类模型,一方面丰富相关领域的研究,另一方面借助场认知风格的自动分类,进一步完善学习者画像,为设计更加个性化的智能教育系统提供支持。

三、面向智能教育的认知风格模型构建

本研究将机器学习算法和眼动追踪技术结合在一起,构建了认知风格自动分类模型(如图1所示)。整个模型集成在一个智能学习系统当中,主要分为三大部分:数据采集模块、数据处理模块与数据应用模块。数据采集模块的功能是在学习者观看在线课程视频的过程中通过外部的眼动仪设备来收集眼动数据。数据处理模块的功能是实现眼动数据处理以及认知风格自动识别。该模块是整个模型的核心。首先,对收集到的原始眼动数据进行特征提取,提取出注视时长、注视点数量、扫视时长、眼跳次数、眼跳距离以及瞳孔直径6个原始指标;然后对原始指标进行归一化处理,将其作为自变量数据,同时将认知风格类型作为标签,输入到机器学习算法当中,得到最终的分类结果。数据应用模块的功能是将学习者认知风格的识别结果储存在学习者画像库当中,为之后的智能课程推荐、智能教学规划等提供支持。眼动指标与机器学习算法的选择,决定了认知风格模型分类的效果,是整个模型最为关键的两个环节。

1.眼动指标选择

由于本研究的目的是准确识别学习者的认知风格,因此在选择眼动指标时,研究选择了与学习认知密切相关的注视类、扫视类以及瞳孔直径类指标。

常用的注视类指标包括注视时长与注视点数量。注视时长是指在一个区域内进行的所有注视行为的时间总和。注视时长越长,学习者的认知资源投入越多,对学习内容的认知加工程度也就越深。注视点数量是指在一个区域内进行的注视行为的总次数。在某个区域内的注视点越多,学习者在此处的注意力及认知资源分配就越多(闫志明等,2018)。

常用的扫视类指标包括扫视时长、眼跳次数及眼跳距离。扫视指的是眼睛从一个注视点到另一个注视点的行为。眼跳过程中会产生视觉抑制现象,使学习者知觉信息的能力减弱,因此扫视过程中是不进行深度认知处理的(闫志明等,2018)。扫视时长指的是在一个区域内进行的所有扫视行为的时间总和。扫视时间越长,说明注意力越不集中。眼跳次数指的是眼睛在注视点之间转换的总次数。一般来说,学习内容区域或难度越大,眼跳次数越多。眼跳距离指两个注视点之间的距离,是反映知觉广度的指标。越长的眼跳距离代表在一次注视中提取的信息量越大(王雪,2015)。

瞳孔直径即瞳孔的大小,反映了广泛的认知过程。在亮度与头部动作恒定的情况下,脑力劳动的增加会导致瞳孔直径的增大(Mathôt et al.,2023)。研究表明,在学习过程中,瞳孔越大说明提取信息越难、心理负荷越大,需要投入更多的认知资源来理解知识(曹卫真等,2012)。

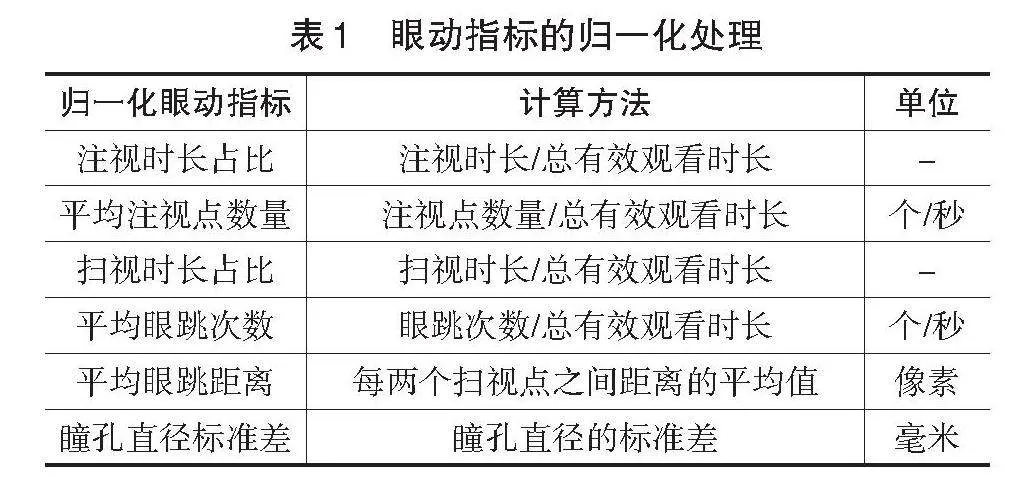

由于坐姿等客观因素的影响,不同被试的眼动数据收集率会有差别。研究选取数据收集率在50%以上的眼动数据作为有效数据。为了使后续建模输入的数据及建模结果不受数据收集率的影响,研究将眼动指标进行归一化处理,处理后的指标将作为最终的建模指标,具体见表 1。

2.机器学习算法选择

为了实现学习者场认知风格的自动识别,本研究选择5种常用的机器学习算法进行分类性能测试与比较,目的是选取性能最好的机器学习算法来构建最终模型。5种机器学习算法分别是支持向量机(Support Vector Machine,SVM)、随机森林(Random Forest,RF)、朴素贝叶斯(Naive Bayes,NB)、K临近算法(K-Nearest Neighbor,KNN)以及逻辑回归(Logistic Regression,LR)。

支持向量机是一种监督分类算法,旨在找到线性可分特征向量的优化超平面,以最大化分类间隔来增强泛化能力,同时最小化误分类误差。支持向量机可以在被称为核函数的非线性映射函数的帮助下有效地执行非线性分类。因此,通过将主输入空间映射到高维点积空间,可以增强线性可分离性(Ghazizadeh et al.,2019)。然而其对缺失数据较为敏感,且在多分类问题中容易陷入过拟合。本研究使用线性核作为支持向量机的内核函数。

随机森林是一种基于识别的、监督式的机器学习算法。它由许多决策树组成,是一种使用复数决策树的集成学习算法,减少了数据集的过度拟合并提高了精度,克服了决策树算法的局限性。随机森林对噪声具有鲁棒性,并且可以通过减少泛化误差来产生高精度的结果(Breiman,2001)。但是,当遇到取值划分比较多的特征时,会对其整体判断产生较大影响。本研究将树的数量设置为100,将单个树的深度限制为5。

贝叶斯网络由一个结构模型和一组条件概率组成。结构模型是一个有向无环图,其中节点表示属性,弧表示属性依赖关系。属性依赖关系通过给定其父节点的每个节点的条件概率进行量化。朴素贝叶斯分类器是最简单的贝叶斯网络分类器,它假定实例的所有属性在给定类的上下文的情况下彼此独立,在大样本处理时有很大优势(Jiang et al.,2013)。不过,当样本属性有关联时,会影响模型的准确度。

K临近算法是一种非参数分类方法。它是基于监督学习技术,用于模式识别和分类的最简单的机器学习算法之一。与其他分类器不同,KNN 算法本身不需要训练阶段,因为它只存储预测阶段的训练数据。KNN 算法假定新数据与已有数据之间具有相似性,并将新数据放入与可用类别最相似的类别中(Kharbech et al.,2016)。但其计算量较大、计算速度慢,不易确定K值,且数据不均衡时会影响准确性。本研究以 K=5 运行算法。

逻辑回归是广义线性回归模型的特定情况,是一种为了解决二分类问题提出的算法。该算法在假设数据服从伯努利分布的基础上,给定条件概率分布,并用极大似然估计求解最优参数。逻辑回归本质上是一个线性分类器,所得到的模型清晰,可解释性强,并且实施简单,计算高效,可以在大数据场景中使用(Bewick et al.,2005)。然而其不能解决非线性问题,也难以处理数据不平衡问题。

四、实验设计

1.实验材料

在线课程视频。本研究选取2段时长为3分钟、主题为“机器学习”的在线课程视频作为实验材料。每段课程视频均以“文本+图片+声音”的形式呈现。课程视频的亮度恒定,防止由于亮度变化而引起瞳孔直径的变化。

认知风格量表。本研究采用镶嵌图形测验(Group Embedded Figure Test,GEFT)作为认知风格的识别量表(张雁凌,2003)。该测验共分为三个部分,共有简单图形9个与复杂图形29个。每个部分测试时间为5分钟,要求被试在规定时间内从各个复杂图形中找到规定的简单图形并用笔标注出来。第一部分的9道题目较为简单,主要用于让被试熟悉题目,不计入总分。第二、三部分的题目每答对一道题记1分,答错不得分。能够快速排除干扰信息并找到简单图形的被试为场独立型学习者,反之则为场依存型学习者。在本研究中,得分在0~10分的被试为场依存型学习者,得分在11~20分的为场独立型学习者。

2.实验对象

本研究选取H大学68名在读大学生为实验被试,年龄在18~24岁之间。为保证眼动数据的有效性及采集率,被试的裸眼纠正视力均不低于1.0,不配戴眼镜或佩戴眼镜的度数低于400度。同时,为保证学习认知过程顺利,要求被试均具有一定的机器学习基础。被试在申请参与时,需填写机器学习测试问卷,合格者才能被选取。根据镶嵌图形测试的结果,共有39名被试为场独立型学习者,29名为场依存型学习者。

3.实验设备与环境

首先,研究使用Tobii T120眼动仪收集每个被试的眼动数据。该仪器的数据采集频率为60 Hz,精度为0.5°。眼动仪集成在17 英寸的LCD屏幕中,通过在屏幕下方安装光学系统以实现眼球运动追踪。教学材料显示在LCD屏幕上,当被试观看材料时,眼动仪会记录眼球运动。其次,研究使用与眼动追踪同步的Tobii Studio软件收集数据。实验选择在一间安静、恒温且光照适宜的实验室中进行,以减少无关因素对被试的影响。被试坐在软椅上观看材料,同时桌面上放有头部支架,减少被试的头部移动,以确保眼动数据的收集率以及有效性。

4.实验流程

在实验开始之前,被试填写机器学习先验知识问卷,通过者成为正式被试。进入实验室后,被试通过纸笔测验的方式进行镶嵌图形测验题目作答,主试计时并控制每部分答题时长。眼动实验正式开始前,由主试向被试介绍实验流程以及注意事项,并帮助被试进行眼动仪校验。被试通过校验后方可正式观看学习视频。被试观看第一个实验视频后,黑屏3分钟供被试休息,之后再观看第二个实验视频。在此期间,研究者一直使用眼动仪记录数据。被试观看完毕后离开实验室,实验结束。

5.数据分析

实验结束后,研究人员利用Tobii Studio软件进行眼动数据导出、预处理与特征提取等工作;使用SPSS 23.0软件对眼动指标进行单因素方差分析,以此来确定场认知风格对学习者眼动行为的影响;使用RapidMiner Studio 9.10软件进行场认知风格分类算法模型的构建,并采用准确率(Accuracy)以及Kappa值来评价算法性能。

五、结果与讨论

1.机器学习算法的分类性能比较

本实验共收集到73万余条眼动样本数据,将数据进行特征提取,总共得到136组特征向量。研究首先利用眼动数据实现对场认知风格学习者的分类。方法是:将归一化后的注视时长占比、平均注视点数量、扫视时长占比、平均眼跳次数、平均眼跳距离、瞳孔直径标准差6个指标作为变量输入,以场认知风格类型为标签进行分类,分别使用支持向量机(SVM)、随机森林(RF)、朴素贝叶斯(NB)、K临近算法(KNN)以及逻辑回归(LR)等机器学习算法,通过十折交叉验证法检验算法的准确率和Kappa值,得到如表 2所示的结果。

准确率指的是所有分类正确的样本数与总样本数的比值,即分类正确的概率,范围在0~1之间,值越大说明采用该方法进行的分类越准确。Kappa系数是用在统计学中评估一致性的一种方法,考查的是预测结果和实际分类结果是否一致,范围在-1~1之间,通常大于0,值越大说明该方法的分类性能越强。

由表2可以看出,在5种机器学习算法中,逻辑回归(LR)算法具有最高的分类准确率,达到89.01%;同时具有最高的Kappa值,为0.774。说明在这5种算法之中,逻辑回归算法在进行场认知风格分类时性能最强,是构建模型的最优方法。

2.不同认知风格学习者眼动热力图及眼动路径比较

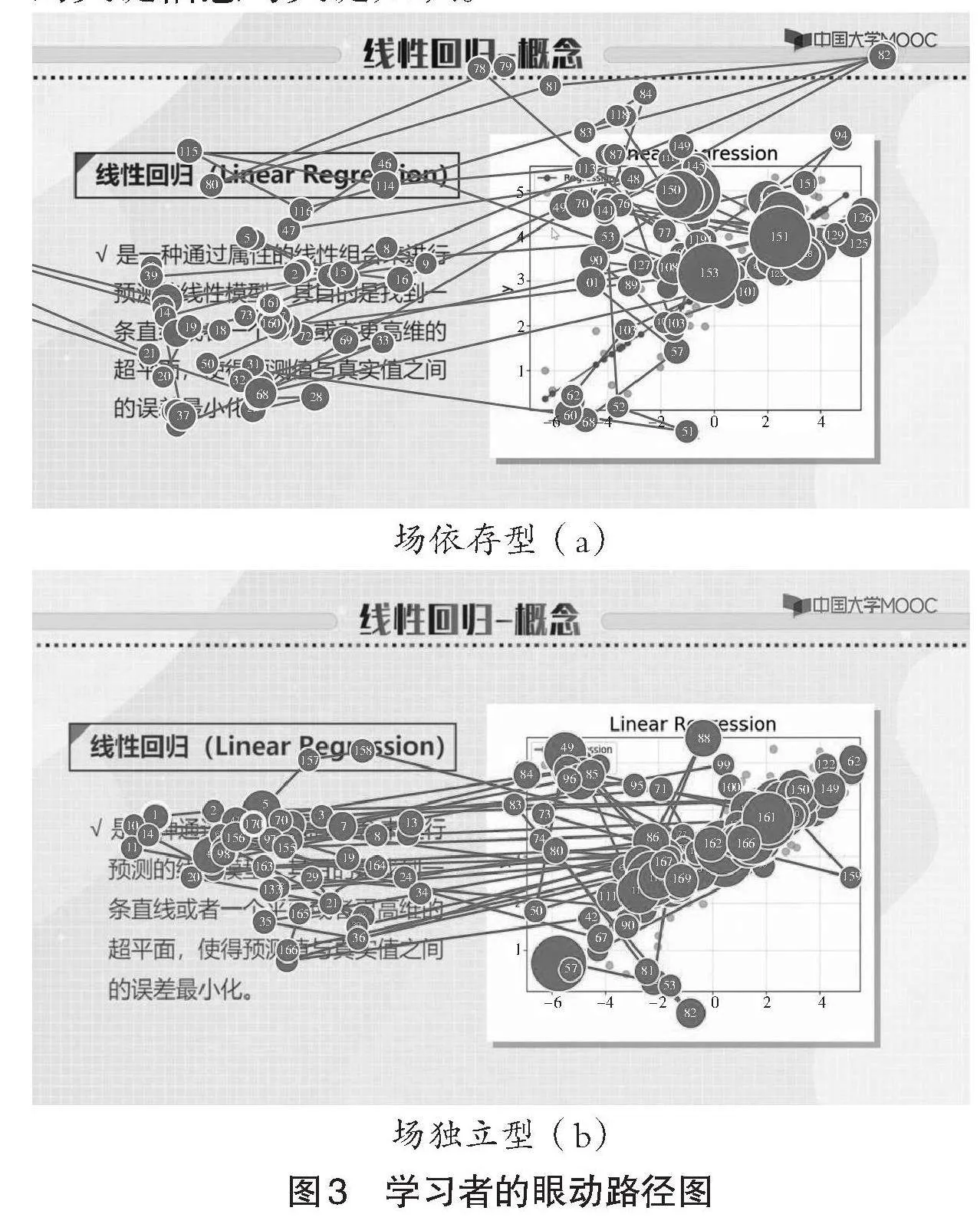

为了更深入地了解不同认知风格学习者在眼动行为上的差异,并为其个性化学习资源推荐提供指导,本研究对学习者的视觉模式与眼动指标进行了深入分析。图 2展示了一名场依存型学习者与一名场独立型学习者的眼动热力图,颜色越深、亮度越亮代表被试在该位置的注释时间越长。从图中两名学习者的注意力分布情况来看,场依存型学习者在注意力分配(即注视位置)方面比场独立型学习者表现出更显著的变化。场依存型学习者的注视位置较为分散,在文字、图片等区域都有大量的注视行为。场独立型学习者的注视位置较为集中,注意力主要分布在图片区域。在信息搜索方面,分散的注视点表明学习者难以将知识内容进行编码,在识别与理解知识内容方面具有更大的不确定性(Just et al.,1976);反之,较为集中的注视点反映了更高的视觉搜索效率,表明学习者可以更快速地进行知识编码并储存。通过实验可知,场独立型学习者比场依存型学习者具有更高的视觉搜索效率。

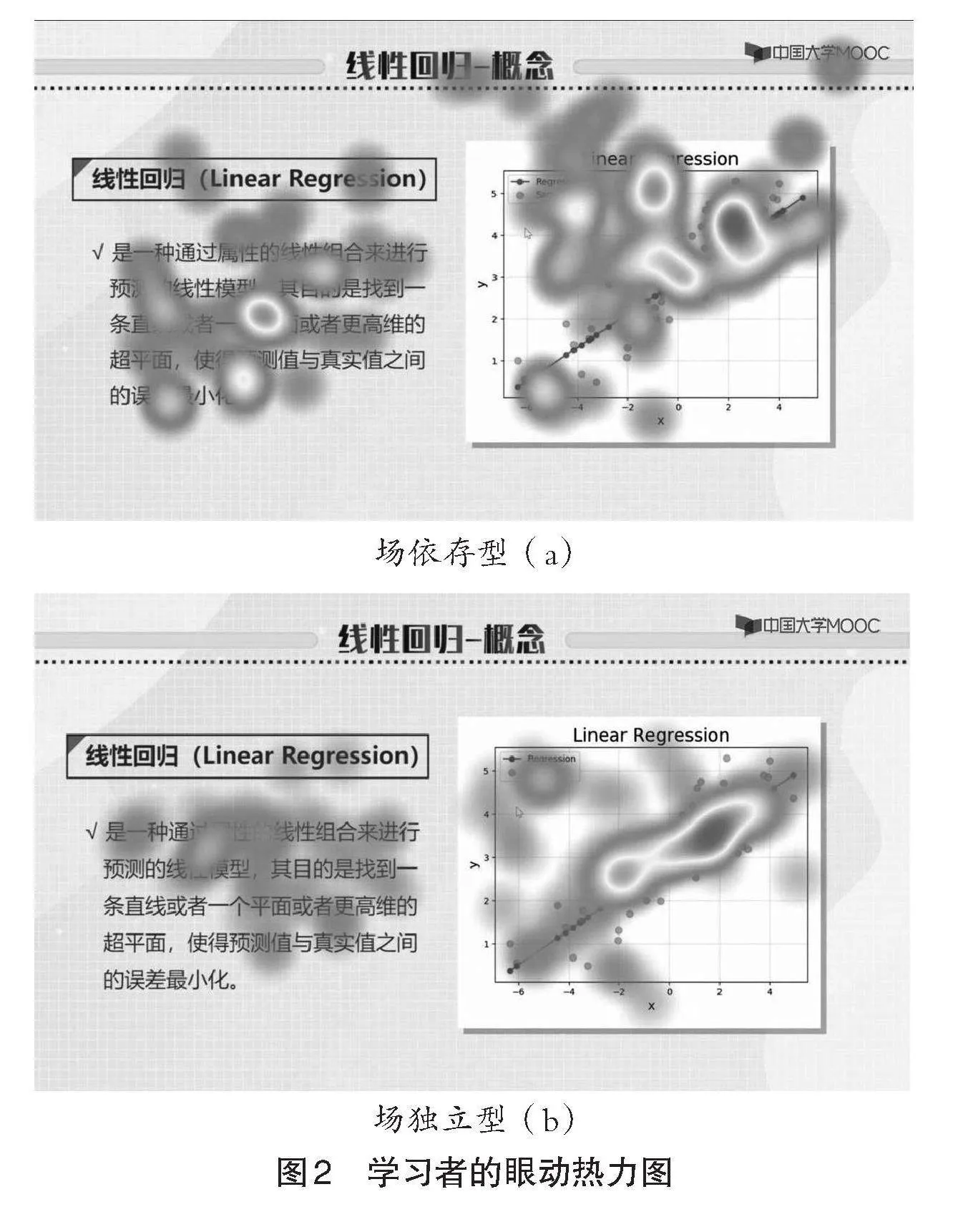

图 3展示了图 2中对应的场依存型学习者与场独立型学习者的眼动路径图,相邻的两个注视点由直线连接,并且在某注视点的注视时间越长,则该注视点的直径就越大。该图体现了不同认知风格学习者的视觉搜索模式。总体来看,相较于场独立型学习者,场依存型学习者的眼动路径较为分散与杂乱,且会受到与知识无关内容的影响。场依存型学习者的眼跳距离更大,且较多次地注视学习视频中的信息,体现出一种较为分散的视觉搜索模式。而场独立型学习者的眼跳距离较小,注视内容更加密集,体现了较为密集的视觉搜索模式。根据Rayner等人(1992)的研究结果,回视的次数反映了在视觉场景中搜索信息时定位关键内容的困难程度。图3同时也表明,场依存型学习者更难搜索到视频中的关键信息与关键知识。

结合场认知风格理论,不同认知风格的学习者产生不同视觉搜索模式的原因在于,场依存型学习者难以识别视频信息中的关键元素,需要依赖信息与环境之间的关系来辅助判断。因此,场依存型学习者需要逐个探测视频信息,由此产生了更多的扫视与回视等行为。相比之下,场独立型学习者表现出更精准的搜索模式,其特点是更少的扫视和回视。同时,场依存型学习者的注意力容易受到与课程内容不相关因素的影响,视线多次在课程标题与课程内容之间转移,体现出一定的迷失与分心情况。而场独立型学习者的注意力则集中分布在与课程内容有紧密关系的要素上,视觉行为更加定向。

3.不同认知风格学习者眼动指标差异性分析

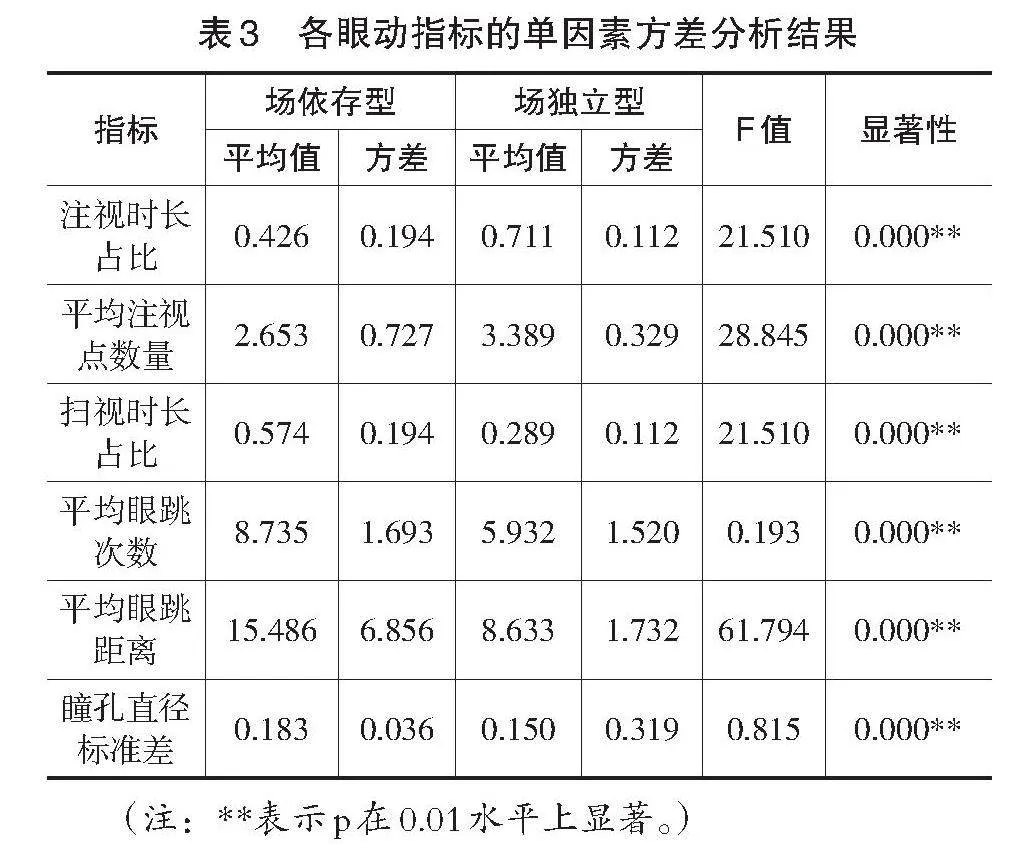

使用方差分析对眼动数据进行分析可知(结果如表 3所示),6个眼动指标均在0.01水平上具有显著差异。其中,场独立型学习者的注视时长占比与平均注视点数量均高于场依存型学习者,场依存型学习者的扫视时长占比与平均眼跳次数均高于场独立型学习者。这表明在视频学习的过程中,场独立型学习者进行了更多的注视行为,而场依存型学习者进行了更多的扫视行为。同时,场依存型学习者的平均眼跳距离显著大于场独立型学习者,与眼动路径图的结果一致,表明场依存型学习者需要大范围地进行信息检索。并且,场依存型学习者的瞳孔直径标准差显著大于场独立型学习者,表明场依存型学习者在学习过程中产生了更加显著的认知变化。

扫视指标的相关结果与以往研究一致,即场依存型学习者表现出更多的扫视行为。然而注视时长的结果与以往的研究不同。已有研究认为,场依存型学习者难以确定关键信息,因而需要更多的注视行为进行信息的获取与理解(Nisiforou et al.,2013);而本研究发现,场独立型学习者的注视时长与平均注视点数量均高于场依存型学习者。究其原因,已有的场认知风格—眼动研究中的实验材料是不限时的测试任务,需要统计被试完成任务整个过程中的眼动行为。由于场依存型学习者难以识别关键信息,他们会花费更长的时间来完成任务,在此过程中需要进行更多的认知处理,因此会产生更多的注视行为。然而本研究的实验材料为时长固定的课程视频,在相同的时间内,场依存型学习者会花费更多的时间来检索关键信息,因而会产生更多的扫视行为,从而减少了注视行为的占比。因此,虽在不同的背景与不同的需求下,对两种场认知风格学习者的眼动指标分析产生了不同的结果,但其背后隐含的认知原理却是相同的。

六、总结

1.逻辑回归算法是构建认知风格模型的良好方法

本研究旨在构建基于机器学习算法与眼动追踪技术的认知风格模型,实现学习者认知风格的自动分类,为智能学习系统的构建提供支撑。研究共选择了5种机器学习算法来构建认知风格模型。通过实验数据分析,发现逻辑回归(LR)算法在进行认知风格分类时的准确率与Kappa值均最高,分类准确率高达89.01%,是分类性能最佳的方法。因此,我们最终选取逻辑回归作为认知风格模型构建的机器学习算法。

2.不同认知风格学习者视觉模式存在差异

本研究通过眼动实验,深入挖掘了不同认知风格学习者的眼动行为差异。结果表明,在视频学习过程中,不同场认知风格学习者表现出不同的视觉行为模式。场依存型学习者有着较为分散的视觉注意模式,同时在信息检索方面存在一定困难,且在扫视过程中容易迷失和分心;场独立型学习者有着较为密集与定向的视觉注意模式,更加关注重点学习内容,信息搜索效率更高。

同时,对场依存型和场独立型学习者的眼动指标差异进行分析发现,两种认知风格的学习者在6个归一化眼动指标上均具有显著差异。在固定时长的视频学习过程当中,场依存型学习者展现了更多的扫视行为与更长的平均眼跳距离;场独立型学习者展现了更多的注视行为与较短的平均眼跳距离。这表明在进行同样时长的视频学习时,场依存型学习者会花费更多时间来进行信息检索,而场独立型学习者会花费更多时间来进行信息处理。

3.认知风格模型可为智能教育提供精准支撑

本研究所构建的认知风格模型可应用于智能学习系统的优化当中,具有丰富的现实意义。首先,本研究探索了学习者认知风格与视觉行为之间的联系,该结果可用于智能学习系统的课程资源优化设计。基于以学习者为中心的设计理论,在以学习者为中心的学习环境中提供能满足个人独特学习需求的资源,有助于加深学习者对学习内容的理解(牟智佳,2017)。当教师或教学设计者认识到不同认知风格学习者的视觉行为差异时,可以根据学习者的个体差异为其提供差异化的学习材料。例如,由于场依存型学习者难以识别课程中的关键信息,在课程设计的过程中,可加入更多的线索,如加粗、加亮关键字体,或通过添加箭头等形式,来为场依存型学习者提供学习辅助,帮助其快速定位关键信息,提升学习效率。

其次,认知风格模型还可用于智能学习系统的构建。个性化学习路径的规划是智能学习系统的重要功能之一,其实现的关键在于明确学习者的特征。学习者特征把握不精准,是目前个性化学习路径推荐准确率较低的主要原因(唐雯谦等,2021)。本研究提供了认知风格分类精确度近90%的模型,可以帮助设计者准确地把握学习者的认知风格特征。将训练好的模型嵌入到在线学习平台当中,可以实现对学习者认知风格的自动识别,构建更加细致的学习者画像,进而为学习者提供更适合的学习内容、更合理的学习路径,提升其学习体验和学习效果。

4.局限性与展望

首先,本研究的实验材料较为单一,仅提供了呈现方式较为单一的某一学科的课程视频作为实验材料。因此,未来的研究可使用更多样化的课程视频,或者是其他类型的视觉刺激,以检验实验方法与实验结果的可靠性和有效性。此外,应考虑更多的学习者特征如年龄、性别、学科背景等,探究其对认知风格和眼动行为的影响,同时可以将其作为新的自变量输入到机器学习算法当中,以提升模型的针对性与准确性。眼球运动也可能会受到学习环境的影响,仅使用眼动追踪数据来测量学习认知并不全面,未来可将其他的生理指标如脑电、心电等整合在研究中,通过不同模态数据之间的信息互补,提升数据分析的准确性,以完善学习者认知评估的可靠性。

参考文献:

[1]曹卫真,殷婷如,邢强等(2012).常见教学网页图文搭配方式对记忆效果影响的研究[J].电化教育研究,33(2):93-100.

[2]郭绍青,华晓雨(2022).论智慧教育与智能教育的关系[J].西北师大学报(社会科学版),59(6):139-147.

[3]牟智佳(2017).“人工智能+”时代的个性化学习理论重思与开解[J].远程教育杂志,35(3):22-30.

[4]唐雯谦,覃成海,向艳等(2021).智慧教育与个性化学习理论与实践研究[J].中国电化教育,(5):124-137.

[5]王靖,巴安妮,吴宝锁(2023).智能教学反馈的目标、机制与架构[J].现代远程教育研究,35(3):102-112.

[6]王雪(2015).多媒体学习研究中眼动跟踪实验法的应用[J].实验室研究与探索,34(3):190-193,201.

[7]新华网(2019).中共中央、国务院印发《中国教育现代化2035》[EB/OL].[2023-08-09].http://www.moe.gov.cn/jyb_xwfb

/s6052/moe_838/201902/t20190223_370857.html.

[8]薛耀锋,曾志通(2020).面向自适应学习的不同认知风格学习者眼动模型研究[J].现代教育技术,30(8):91-97.

[9]薛耀锋,李佳璇(2021).基于眼动追踪的在线同步学习系统可用性评测[J].现代教育技术,31(12):85-93.

[10]闫志明,郭喜莲,王睿(2018).多媒体学习研究中眼动指标述评[J].现代教育技术,28(5):33-39.

[11]詹泽慧(2013).基于智能Agent的远程学习者情感与认知识别模型——眼动追踪与表情识别技术支持下的耦合[J].现代远程教育研究,(5):100-105.

[12]张雁凌(2003).中国大学生的场独立/依存的认知风格对英语水平的影响[J].外国语言文学,(4):43-45.

[13]Al-Saai, A. J., amp; Dwyer, F. M. (1993). The Effect of Visualization on Field-Dependent and Field-Independent Learners[J]. International Journal of Instructional Media, 20:243-249.

[14]Bewick, V., Cheek, L., amp; Ball, J. (2005). Statistics Review 14: Logistic Regression[J]. Critical Care, 9(1):112-118.

[15]Breiman, L. (2001). Random Forests[J]. Machine Learning, 45(1):5-32.

[16]Carter, B. T., amp; Luke, S. G. (2020). Best Practices in Eye Tracking Research[J]. International Journal of Psychophysiology, 155:49-62.

[17]Eivazi, S., amp; Bednarik, R. (2011). Predicting Problem-Solving Behavior and Performance Levels from Visual Attention Data[C]// Proceedings of the 2nd Workshop on Eye Gaze in Intelligent Human Machine Interaction at IUI. Palo Alto, CA:9-16.

[18]Ghazizadeh, E., Abbasi-Moghadam, D., amp;" Nezamabadi-Pour, H. (2019). An Enhanced Two-Phase SVM Algorithm for Cooperative Spectrum Sensing in Cognitive Radio Networks[J]. Communication Systems, 32(2):e3856.

[19]Jacob, R. J. K., amp; Karn, K. S. (2003). The Mind’s Eye: Cognitive and Applied Aspects of Eye Movement Research[M]. Amsterdam, The Netherlands: Elsevier Science:573-605.

[20]Jiang, L. X., Cai, Z. H., amp; Zhang, H. et al. (2013). Naive Bayes Text Classifiers: A Locally Weighted Learning Approach[J]. Journal of Experimental amp; Theoretical Artificial Intelligence, 25(2):273-286.

[21]Jovanovic, M., Vukicevic, M., amp; Milovanovic M. et al. (2012). Using Data Mining on Student Behavior and Cognitive Style Data for Improving E-Learning Systems: A Case Study[J]. International Journal of Computational Intelligence Systems, 5(3):597-610.

[22]Just, M. A., amp; Carpenter, P. A. (1976). Eye Fixations and Cognitive Processes[J]. Cognitive Psychology, 8:441-480.

[23]Kharbech, S.," Dayoub, I., amp; Zwingelstein-Colin, M. (2016). On Classifiers for Blind Feature-Based Automatic Modulation Classification over Multiple-Input-Multiple-Output Channels[J]. IET Communications, 10(7):790-795.

[24]Liu, H. C. (2018). Investigating the Impact of Cognitive Style on Multimedia Learners’Understanding and Visual Search Patterns: An Eye-Tracking Approach[J]. Journal of Educational Computing Research, 55(8):1053-1068.

[25]Lou, Y., Liu, Y., amp; Kaakinen, J. K. et al. (2017). Using Support Vector Machines to Identify Literacy Skills: Evidence from Eye Movements[J]. Behavior Research Methods, 49(3):887-895.

[26]Mahvelati, E. H. (2020). Field-Dependent/Field-Independent Learners’Information Processing Behavior in an Implicit Learning Task: Evidence from Iranian EFL Learners[J]. Journal of" Psycholinguist Research, 49(6):955-973.

[27]Mathôt, S., amp; Vilotijeviô, A. (2023). Methods in Cognitive Pupillometry: Design, Preprocessing, and Statistical Analysis[J]. Behavior Research Methods, 55:3055-3077 .

[28]McKay, M. T., Fischler, I., amp; Dunn, B. R. (2003). Cognitive Style and Recall of Text: An EEG Analysis[J]. Learning and Individual Differences, 14(1):1-21.

[29]Nisiforou, E. A., amp; Laghos, A. (2013). Do the Eyes Have It? Using Eye Tracking to Assess Students Cognitive Dimensions[J]. Educational Media International, 50(4):247-265.

[30]Nisiforou, E., amp; Laghos, A. (2016). Field Dependence-

Independence and Eye Movement Patterns: Investigating Users’ Differences Through an Eye Tracking Study[J]. Interacting with Computers, 28(4):407-420.

[31]Pradnya Sidhawara, A. G., Wibirama, S., amp; Adji, T. B. et al. (2020). Classification of Visual-Verbal Cognitive Style in Multimedia Learning using Eye-Tracking and Machine Learning[C]// 2020 6th International Conference on Science and Technology (ICST). Yogyakarta, Indonesia:1-5.

[32]Rayner, K., amp; Pollatsek, A. (1992). Eye-Movements and Scene Perception[J]. Canadian Journal of Psychology, 46(3):342-376.

[33]Riding, R., amp; Cheema, I. (1991). Cognitive Styles: An Overview and Integratio[J]. Educational Psychology, 11:193-215.

[34]Saracho, O. (2003). Matching Teachers’ and Students’ Cognitive Styles[J]. Early Child Development and Care, 173:161-173.

[35]Szulewski, A. M. D., Roth, N., amp; Howes, D. M. D. (2015). The Use of Task-Evoked Pupillary Response as an Objective Measure of Cognitive Load in Novices and Trained Physicians: A New Tool for the Assessment of Expertise[J]. Academic Medicine, 90(7):981-987.

[36]Witkin, H. A. (1967). A Cognitive-Style Approach to Cross-Cultural Research[J]. International Journal of Psychology, 2(4):233-250.

[37]Workman, M. (2004). Performance and Perceived Effectiveness in Computer-Based and Computer Aided Education: Do Cognitive Styles Make a Difference[J]. Computers in Human Behaviour, 20(4):517-534.

[38]Yousef, A. M. F.," Atia, A., amp;" Youssef, A. et al. (2021). Automatic Identification of Student’s Cognitive Style from Online Laboratory Experimentation Using Machine Learning Techniques[C]// 2021 IEEE 12th Annual Ubiquitous Computing, Electronics amp; Mobile Communication Conference (UEMCON). New York:143-149.

收稿日期 2023-12-14 责任编辑 汪燕

Construction of Cognitive Style Model Based on Machine Learning and Eye Tracking

XUE Yaofeng, ZHU Fangqing

Abstract: Cognitive style reflects the patterns of students’ approaching, acquiring, organizing, processing and interpreting information, and can be used to explain and guide students’ behavior. Integrating cognitive style into intelligent systems can help develop personalized user models and promote the development of intelligent education. Currently, there is a lack of research on automatic classification of cognitive styles, and machine learning has not yet been combined with eye tracking technology for application in this research field. Based on machine learning and eye tracking, a cognitive style model is built. It selects six eye movement indicators closely related to cognition, including fixation duration, number of fixations, saccade duration, number of saccades, saccade distance, and pupil diameter. After normalization, machine learning algorithms are used to automatically classify cognitive styles. The experimental results show that learners with different field cognitive styles exhibit different visual behavior patterns when learning from videos of the same duration. Field-dependent learners have a more dispersed fixation points, showing more saccades, fewer fixations, longer saccade distances, and larger pupil diameter changes, resulting in lower information search efficiency. Field-independent learners have a more intensive and directional visual attention pattern, resulting in higher information search efficiency. After comparing the performance of five machine learning algorithms, it is found that the classification effect of logistic regression algorithm is the best, with an accuracy rate of 89.01% and a Kappa value of 0.774. This automatic classification model of cognitive styles can be used for optimizing the design of course resources in intelligent learning systems and for recommending personalized learning paths. In the future, more physiological data can be integrated to improve the accuracy of data analysis and the reliability of learner cognitive ability assessment through information complementarity between different modalities.

Keywords: Intelligent Education; Machine Learning; Eye Tracking Technology; Field Cognitive Style; Automatic Classification