基于D-S证据理论的多模态结果级融合框架研究*

程 腾,侯登超,张 强,石 琴,郭利港

(1.合肥工业大学汽车与交通工程学院,合肥 230000;2.安徽省智慧交通车路协同工程研究中心,合肥 250000;3.自动驾驶汽车安全技术安徽省重点实验室,合肥 230009;4.奇瑞汽车股份有限公司,芜湖 241000)

前言

随着交通环境日益复杂,在高级辅助驾驶系统和自动驾驶中,单一传感器在复杂交通场景下对目标车辆识别准确率较低,不能满足交通安全要求,所以目前大多数自动驾驶汽车都安装了多种传感器,它们可以提供车辆自身和周边环境的多模态信息。这些信息通常具有一定的互补性和一致性,可以弥补彼此间的缺陷与不足,比如在黑夜、曝光等光照异常场景下,激光雷达检测准确率优于对光照强度敏感的相机,而在雨雪恶劣天气中,相机检测准确率优于受反射影响的激光雷达。因此多模态融合逐渐成为自动驾驶汽车不断提升环境感知能力的重要手段。

多模态融合方法按融合层次可划分为数据融合、特征融合与结果融合[1]。其中,数据融合指输出数据作为后续模型输入的融合操作。Zhou 等[2]将激光点云投影至RGB 图像上生成RGB-D 图像,点云信息被扩展为图像的第四通道。Vora 等[3]提出PointPainting 方法,为激光点云赋予了图像生成的语义信息。相较于数据融合,特征融合所融合的信息为具备更深层次信息的特征数据。Chen 等[4]提出MV3D 融合算法,将激光点云投影为鸟瞰图与前视图,提取相应特征并融合RGB 图像特征用于回归检测任务。Qi 等[5]提出以2D 检测驱动3D 检测的融合方法F-PointNet,基于图像检测生成建议区域,算法对该区域内的点云进行实例分割与边框精修。结果融合指输入数据本身是目标输出且融合的结果用于结果修正的融合操作。虽然数据融合与特征融合在多模态信息融合中表现出巨大潜力,但它们对数据对齐较为敏感,且通常涉及复杂的架构,进一步引入了额外的计算开销。而结果融合包含了预训练的、固定的单模态检测器,仅需要在检测级别进行关联[6],并且结果融合模型相对简单,具备更高的实时性潜力。

纪嘉树[7]设计了基于相机和激光雷达的决策级融合系统,根据两种传感器输出的检测框重合度判断是否融合成功,融合结果较单一感知网络有较大提升,但是该系统没有考虑多传感器识别结果出现分类冲突时应如何处理。甘耀东等[8]设计了一种融合策略,考虑到相机具备更好的分类特性,雷达具备更好的位置捕捉特性,在融合时取相机识别的类别、雷达识别的位置作为融合结果,但是该方法没有考虑异常天气或复杂交通场景下对传感器的影响。李哲等[9]基于投票法融合了多特征下的多分类器,车标识别准确率得到进一步提升,但是投票法依赖基础模型间的检测效果不能差别过大。

考虑分类冲突的多模态融合方法有投票法[10-11]、贝叶斯计算法[12-14]、D-S 理论[15-16]等等。D-S证据理论[17]具有表达不确定性和融合不完善信息的能力,且能够适应不同基础模型的检测效果。周文文[18]利用先验知识设计概率密度函数,基于D-S 证据理论融合了多分类器的识别结果。类似基于专家经验构建概率密度函数的思想在文献[19]中亦有体现。然而,专家经验往往具有主观性,在复杂多变场景下决策可信度较低。Chavez-Garcia 等[20-21]提出了一种基于证据框架的感知融合架构,使用正弦变换将单分类器分类结果转换为质量函数形式,结合不确定性与复合表示,解决运动目标的检测与跟踪问题。Zhu 等[22]将多分类问题基于成对学习方法表示为二值分类,并在此基础上基于核密度估计构造概率密度函数,用于D-S 证据理论合成。以上方法避免了先验知识的局限性,却由于复杂数据模型的引入而带来了额外的计算开销。

Driss等[23]基于D-S 证据理论融合了5 种相机卷积神经网络用于X-ray 图像识别,将神经网络的置信度作为D-S 证据理论的概率密度值,该方法简单有效且具备较强鲁棒性,但没有考虑单一模态识别的局限性。针对上述问题,本文中提出一种基于DS 证据理论的多模态结果级融合框架,考虑不同模态的互补性,融合多种模态信息用于目标识别;考虑先验知识的局限性,利用深度神经网络的泛化能力与自学习能力,将神经网络输出的置信度作为概率密度函数,目标融合时通过D-S 证据理论组合多传感器多分类的置信度,根据组合后的结果确定最终分类信息。通过实验验证,本文所提出的框架具备普适性、精确性与解决分类冲突的能力。

1 基于D-S 证据理论的决策级融合框架

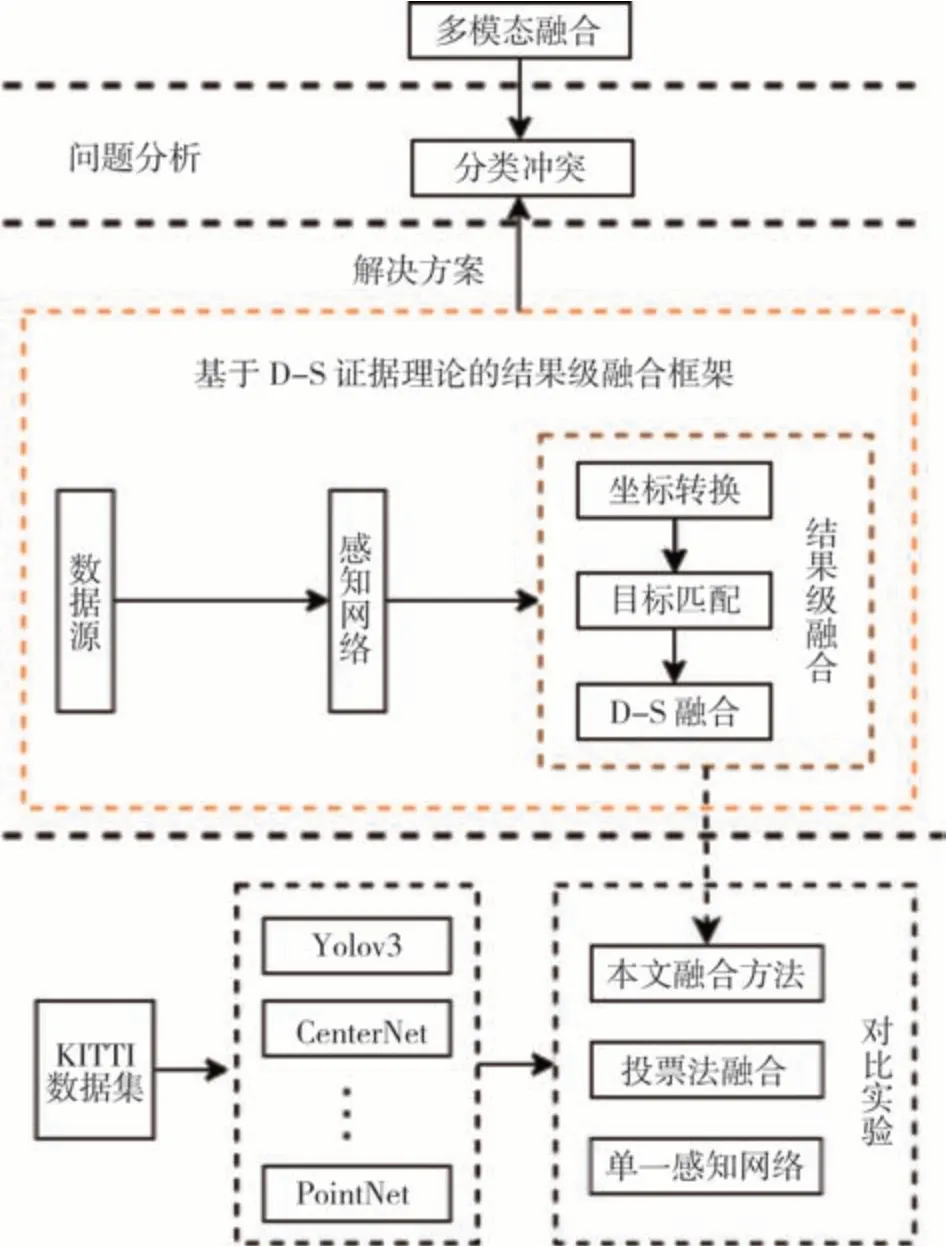

本文技术路线如图1 所示,在多模态融合领域,考虑分类冲突问题,提出一种基于D-S 证据理论的决策级融合框架,下文简称决策级融合框架,并设计了3 组实验,通过对比单一感知网络、投票法融合与本文所提出的融合方法的识别精确性,验证所提出方法的有效性。

图1 技术路线

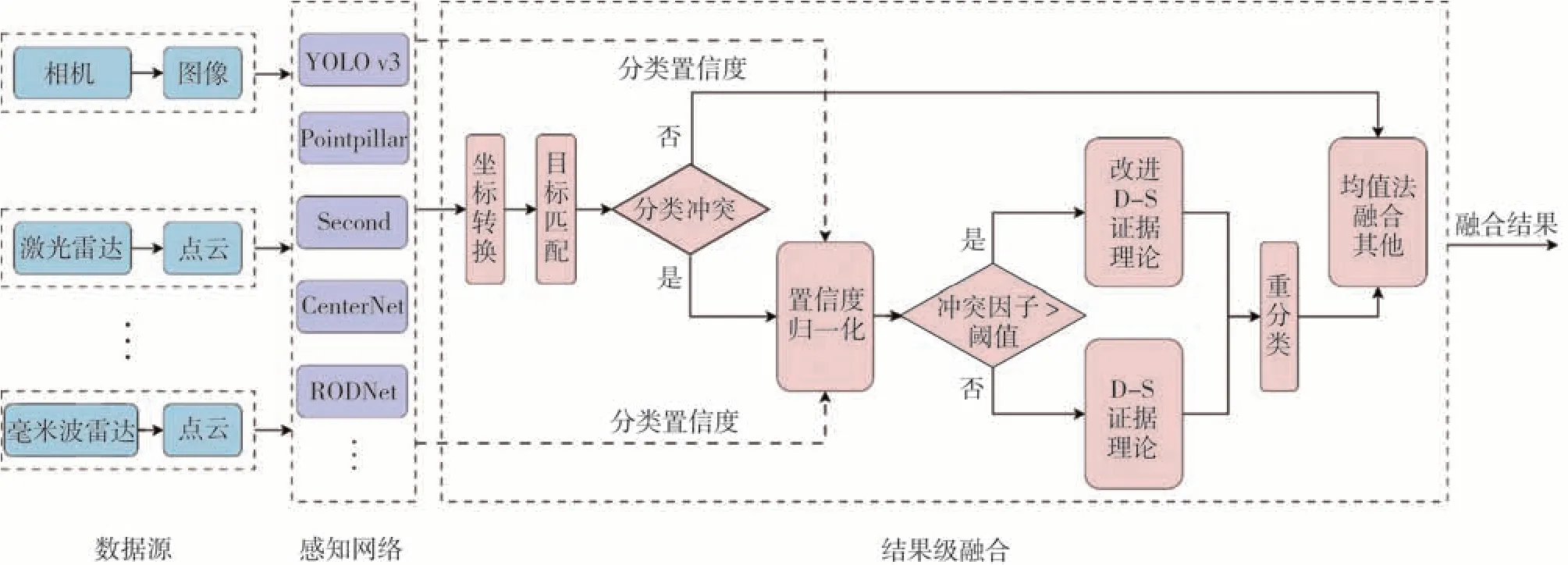

本文提出的多模态结果级融合框架由3 部分组成,分别是数据输入、感知网络和结果级融合,框架整体结构如图2 所示。首先,从多传感器中接收多源模态数据,将多模态数据输入至感知神经网络得到各自的检测结果,将检测结果的位置坐标信息转化,使多传感器检测到的目标映射至同一坐标系下,在该坐标系下完成感知结果的关联匹配,然后对关联结果进行融合,若融合过程中产生分类冲突,则判断冲突分类间的冲突因子是否大于高冲突阈值,若大于阈值,认为以上两个证据属于高冲突合成,则应用改进D-S 证据理论合成分类置信度,反之使用经典D-S证据理论合成,其中高冲突阈值为超参数,将在实验部分进一步论证如何确定。对融合后的置信度分数进行排序,将最高分数对应的类别作为冲突分类的修正结果。最后基于均值法融合其他信息,包括边界框、中心点位置等。

图2 基于D-S证据理论的多模态结果级融合框架

1.1 感知网络

深度神经网络具有强大的自学习和非线性映射能力,且经过训练后具有良好的泛化能力。相比于传统目标识别的机器学习方法等,深度学习具备更高的识别准确率与检测鲁棒性。因此本文将深度神经网络作为融合框架的基础感知模块。

目前主流深度神经网络主要分为两大类,分别是一阶段网络与二阶段网络。二阶段网络的核心思想是在第一阶段划分出感兴趣区域,得到建议框,即完成前景点和背景点的区分,第二阶段对建议框进行识别、精修等处理。常见的二阶段网络有RCNN系列的Faster-RCNN[24]、PV-RCNN[25]等;一阶段网络会把整个生成边界框的过程一体化实现,比如YOLO 系列[26-28]的网络通过将前景背景作为类别之一,取代了二阶段网络获取建议框的步骤,而CenterNet[29]系列的网络是基于anchor-free 的一阶段网络,通过预测中心点及回归偏移量计算出边界框,相较传统方式省去了对边界框的复杂操作。

1.2 结果级融合

结果级融合包含坐标转化、目标匹配与D-S 融合,其中坐标转换旨在将多传感器数据映射至同一坐标系下,目标匹配即在同一坐标系下完成多传感器识别结果集合间的关联,D-S 融合即将感知网络输出的目标置信度作为概率密度分配值,通过证据组合,将匹配的结果信息进行融合。

Driss等[23]基于D-S 证据理论融合了5种相机卷积神经网络用于X-ray 图像识别,将神经网络的置信度作为D-S 证据理论的概率密度值,识别准确率得到较大提升。借鉴Driss 等提出的思想,本文利用多种模态的互补性与一致性,融合多模态信息用于目标识别,同时将神经网络预测的类别置信度得分归一化后作为D-S 理论的基本概率分配值,通过证据组合,得到融合多模态后的类别置信度得分,根据置信度得分最大值,确定融合后的最终分类结果。

1.2.1 坐标转换

将笛卡尔坐标系下的三维检测点坐标经过外参矩阵Kext投影至相机坐标系下,再经过相机内参矩阵Kint投影至像素坐标系下,得到图像上的像素点位置(u,v),从而完成三维检测结果与二维检测结果的空间配准对齐。

1.2.2 目标匹配

感知神经网络模块对于目标检测的结果中包含目标的坐标信息即边界框和中心点,然而由于感知设备的不同和联合标定的精度限制,中心位置往往无法完全匹配,并且由于目标可能在某一坐标方向上位置相同。这都会产生模态数据中某一目标可能对应另一模态数据中多个目标的问题。

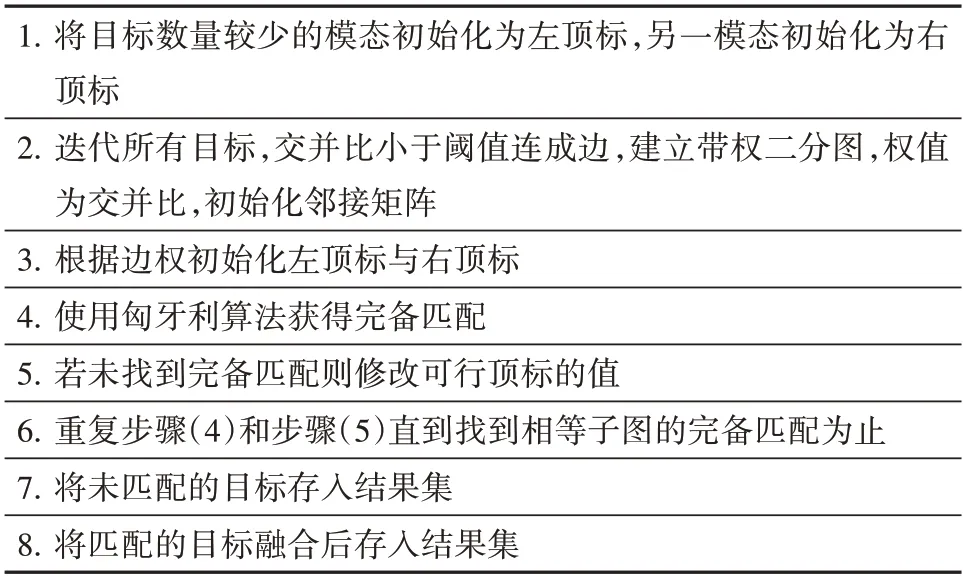

每一时刻的两种感知结果是天然的二分图数据结构,因此决策级融合可以应用二分图匹配算法将两种模态识别目标进行关联匹配。KM 算法是最优匹配算法,即保证二分图内的匹配目标的边权值最大。基于多模态融合场景,本文以待匹配目标间的边界框交并比作为二分图的边权值,算法流程如表1所示。

表1 KM 算法流程

1.2.3 D-S融合

在复杂交通环境下由于天气、光照等外部因素干扰,多种模态识别的分类结果可能出现不一致,融合时便会不可避免地出现分类冲突问题。

D-S 证据理论首先定义一个由所有假设结果组成的穷举集合及假设空间,其中所有假设都是两两互斥的。即设集合Ω 包含n个元素,Ω 可以表示如下:

Ω 的子集A 称为命题,Ω 的幂集2Ω是由Ω 的所有子集组成,包含2N个元素,幂集可以表示为

再定义函数m:2Ω→[0,1]即基本概率分配函数的映射,且他满足下列两个条件:

式中m(A)的数值表示结果A成立的确信程度。且如下是信任函数和似然函数:

根据上述公式就能得到融合多模态的多种分类置信度的公式:

式中k值为冲突因子,反映了证据冲突的程度,其计算方法如下:

当出现分类冲突时,如图3 所示,基于D-S 证据理论融合冲突分类对应的置信度分布,得到修正后置信度分布,并对其排序,取置信度分数最大值对应的类别作为分类冲突修正结果。

图3 分类冲突修正过程

然而,经典D-S证据理论存在一定局限性,在高冲突证据源合成时,会产生Zadeh 悖论。因此,本文在修正分类冲突前,首先计算冲突因子,判断其是否大于设定阈值,即是否出现高冲突证据合成现象,若证据间存在高冲突则使用Murphy[30]所提出的改进的D-S 证据理论方法融合分类置信度,即对初始证据集进行算数平均,再利用D-S 证据理论对n条证据迭代组合n-1次作为最终合成结果。

2 实验与讨论

为评估本文提出的融合框架的普适性、识别准确性和解决分类冲突的能力,本文设计了3 组对比实验:单一感知网络实验、基于投票法融合策略实验和本文融合方法实验。通过随机选择6 个经典单一感知网络,用于验证框架的普适性,将框架融合结果同单一感知网络与投票法融合结果进行对比,验证框架的识别准确性与解决分类冲突的能力。

2.1 数据集与实验设备

本文使用KITTI 数据集评估了所提出的融合框架。KITTI 数据集是目前国际上最大的自动驾驶场景下的计算机视觉算法评测数据集。数据采集车配备2个彩色相机和一个64线激光雷达。本文所采用测试服务器配置为NVIDIA GeForce GTX 3090 GPU。

2.2 单一感知网络实验

KITTI目标检测数据集包含7 481帧训练数据和7 518帧测试数据,每一帧包含一个同步的彩色图像与激光点云数据。文中以行人、机动车、非机动车3种分类作为检测目标,其中训练数据集为7 481 帧,测试数据集为随机选取的3 769帧。

为了验证框架的通用性与普适性,本文随机挑选了相机与激光雷达模态对应的7 种常用神经网络,其中包括了一阶段网络与二阶段网络。并且本文使用AP(average precision)、mAP(mean average precision)和IOU 作为指标评测目标检测性能,当检测目标与真值目标交并比超过0.5 时,认为该目标被正确识别。7 种深度神经网络的检测结果如表2 所示。

表2 单一感知网络检测结果

2.3 多模态结果级融合实验

通过调整感知神经网络输出,使其在输出结果时携带对目标分类预测的置信度,在多种模态的检测目标融合时,若出现分类冲突则通过D-S 理论融合多传感器预测的分类置信度,得到融合后的重新分配的类别置信度得分,选取得分最高的分类作为融合结果的类别。

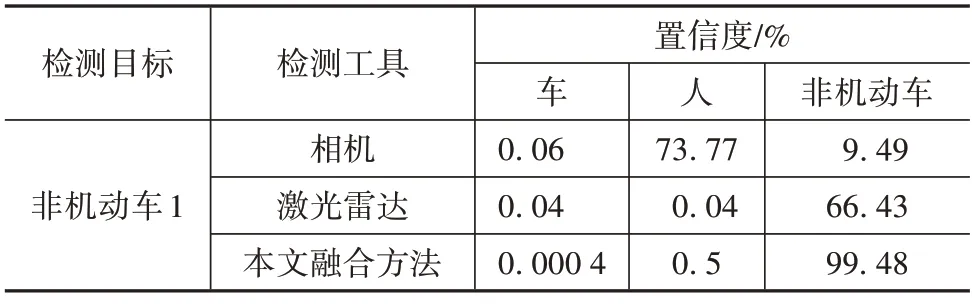

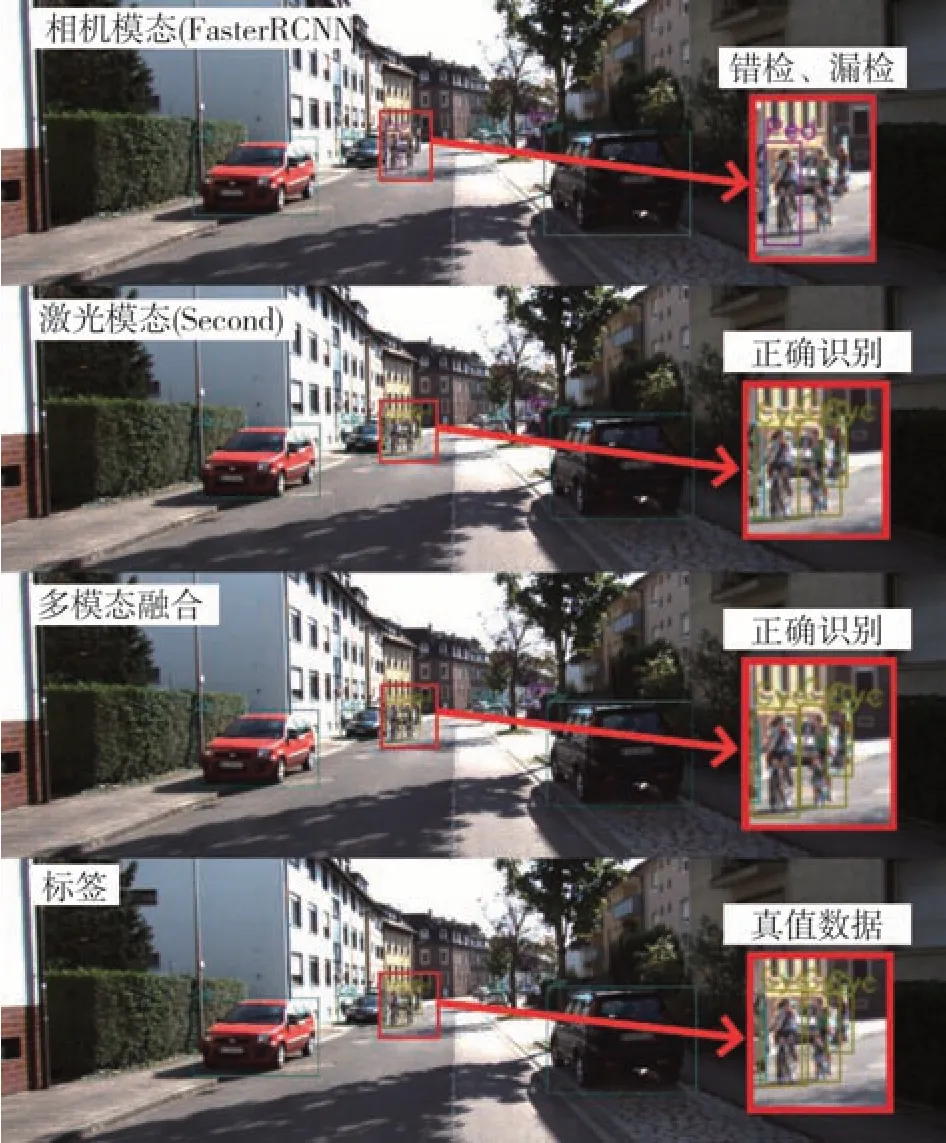

当交通参与者被遮挡或因距离过远而变成难以检测的小目标时,基于视觉的检测结果会不可避免地出现误分类、错检漏检等情况。针对该问题,通过本文融合方法融合激光雷达检测结果,得益于融合框架的融合不完善信息能力,如图4 所示,融合结果在分类冲突场景下可以有效识别出正确分类。同时,表3 列举了在分类冲突场景下本文融合方法重分配分类信息的计算结果,进一步论证了本文融合方法融合多模态互补性解决分类冲突的能力。

表3 分类冲突场景下本文融合方法的置信度重分配

图4 多模态融合前后的分类冲突表现

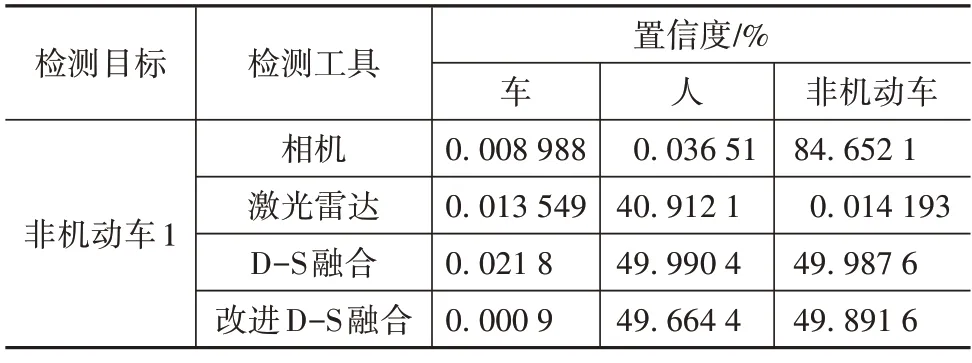

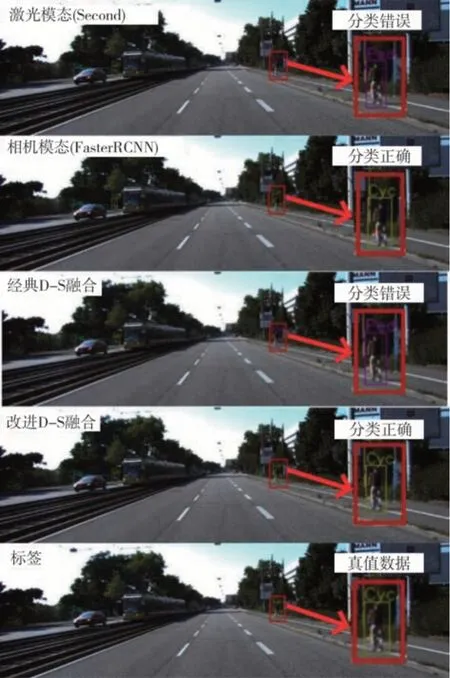

然而,当冲突因子大于设定阈值,即证据源间存在高冲突时,经典D-S 证据理论会产生有悖常理的合成结果。针对该问题,本文在证据源存在高冲突时使用Murphy 所提出的方法改进D-S 证据理论。如图5 所示,在高冲突场景,改进的D-S 证据理论有效地解决了经典D-S证据理论合成错误的问题。表4列举了高冲突场景下经典D-S证据理论与改进DS 证据理论的计算结果,进一步论证了改进D-S 证据理论的有效性。

表4 证据源高冲突场景下本文融合方法的置信度重分配

图5 证据高冲突场景下改进D-S融合前后的分类冲突表现

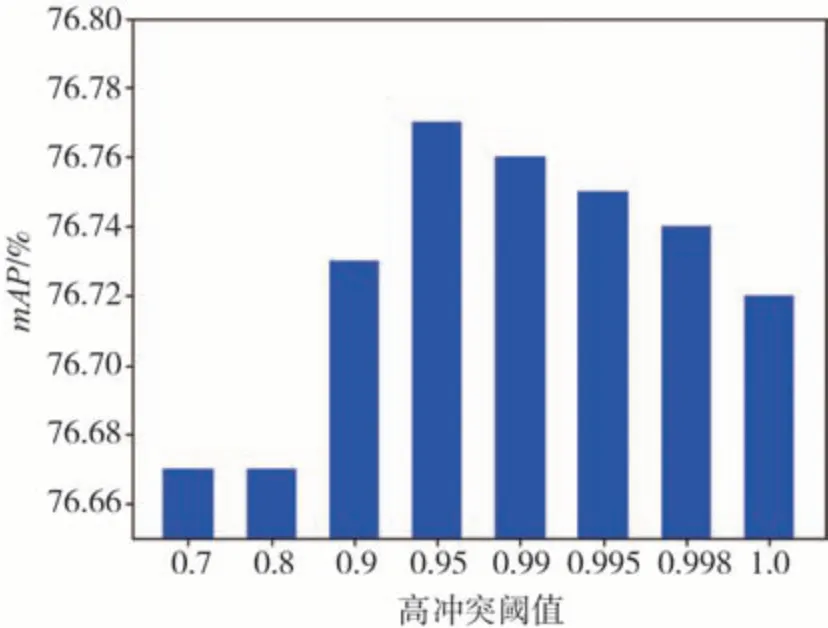

同时,为衡量高冲突因子选取对融合结果的影响,本文以FasterRCNN 融合Second 网络为例,分析了不同高冲突阈值对融合结果均值平均精度(mean average precision,mAP)的影响。如图6 所示,阈值在0.95时融合结果mAP值达到最高,因此本文高冲突阈值设为0.95。

图6 不同高冲突阈值与融合结果mAP表现

2.4 投票法融合实验

为验证本文融合方法的解决分类冲突能力,本节实验了投票法融合策略用于对比本文融合方法效果。投票法融合策略即将神经网络的置信度输出作为该网络对每种检测目标类别的票数,取所有票数中数值最大的数据作为融合后的目标分类结果。

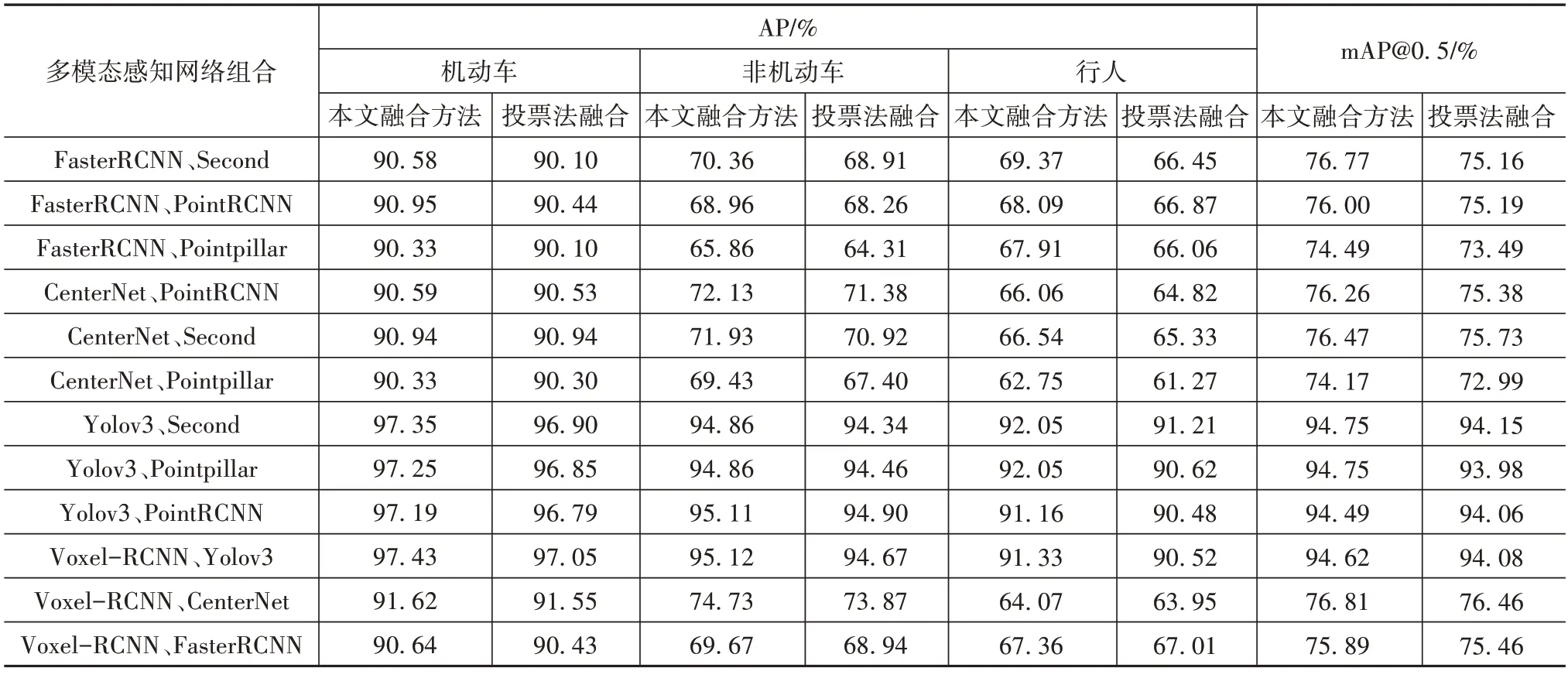

2.5 实验结果

通过实验数据(表5)和实验结果柱状图(图7)验证了本文所提出的融合框架以任意神经网络作为基础感知网络均能提高识别准确性,本文融合方法识别结果相比于单一感知网络mAP值普遍提升8%左右,其中YOLOv3 与PointPillar 的组合相较于PointPillar单网络感知结果提升32%;相比于投票法融合,mAP值普遍提升1%左右。

表5 融合实验结果数据对比

图7 融合实验结果对比

3 结论与展望

本文提出的基于D-S证据理论的多模态结果级融合框架能够有效地利用多模态间的互补性与一致性,使得融合结果精确度相较单一感知网络有较大提升,且通过实验验证了该框架具备普适性,不依赖基模型间的效果,即使模型间精度差距过大,融合结果也均能有进一步提升。实验测试的结果表明,框架输出的融合结果较单一感知网络mAP 值均能提高8%左右,其中Yolov3 与Pointpillar 的融合结果相较于Pointpillar 单一感知结果mAP值提高32%,同时,通过D-S 证据理论组合多模态神经网络分类置信度,有效减少了分类冲突情况,具有较好的应用前景。

由于文中所使用的数据集恶劣天气场景较少,因此实验测试结果中基于D-S证据理论的分类冲突修正相较投票法提升不多,但均能有所提升,可以证明本文所提出的基于D-S证据理论的多模态结果级融合框架相较于投票法具有一定的优势。后续研究可以采集恶劣天气下的交通场景数据,进一步论证本文所提出的框架的修正分类冲突能力。

同时,在证据源高冲突场景下,基于Murphy 所提出的方法改进D-S证据理论可以有效降低证据间的冲突现象,但是该方法仅通过取均值方法对证据源修正,没有考虑到不同模态在不同场景下对融合结果的影响程度。因此如何在复杂交通场景下,在Murphy 方法基础上为证据源赋予根据感知环境自适应调整的权重信息是本文下一个研究方向。