面向时间序列的混合图像化循环胶囊分类网络

陈容均,严宣辉*,杨超城

(1.福建师范大学 计算机与网络空间安全学院,福州 350117;2.数字福建环境监测物联网实验室(福建师范大学),福州 350117)

0 引言

时间序列数据广泛存在于各个领域,对它的分析被认为是数据挖掘领域最具挑战性的问题[1-2]。时间序列分析主要分为两类:1)时间序列预测[3],如对产品需求量的预测有助于提高仓库的利用率[4];对道路人流量的预测可以提前制定交通管理措施[5-6];对股票趋势的预测有助于制定合理的投资策略[7-8]。2)时间序列的分类,如对心电图信号进行分类以帮助医生诊断病情[9-10];用可穿戴的移动传感器采集人们运动时跑步、走路、游泳等行为活动数据,以便于在老年人康复、环境辅助生活、智能家居等多领域中改善人们的生活[11-12];分析电力系统的监测数据,有助于及时发现故障以提高电力系统的安全性[13]。可以看出,时间序列的应用场景十分广泛,对时间序列预测和分类的研究有着重要意义。

传统的时间序列分类算法通常需要基于数据间的某种相似或相异性度量,因此可以将时间序列分类算法概括为以下四类:1)基于时域相似性的分类算法。这类算法主要采用基于某种距离度量的最近邻(One-Nearest Neighbor,1-NN)方法,如欧氏距离和动态时间归整(Dynamic Time Warping,DTW)[14]等。2)基于形 状相似 性的分 类算法。如STC(Shapelet Transform Classifier)[15]是一种基于Shapelet[16]方法的分类模型,它通过计算时间序列特征中与前k个Shapelet的距离实现分类。3)基于变化相似性的分类算法。如TSF(Time Series Forest)[17]和RISE(Random Interval Spectral Ensemble)[18]算法通过时间序列中所包含的潜在间隔变化信息进行分类。4)基于字典相似性的分类算法。如符号-傅里叶近似的符号袋算法(Bag Of Symbolic-Fourier approximation Symbols,BOSS)[19]和时间序列分类的词汇提取算法(Word ExtrAction for time SEries cLassification,WEASEL)[20],对时间序列提取出子序列,每个子序列通过符号化的傅里叶近似法(Symbolic Fourier Approximation,SFA)[21]得到符号特征,对符号特征统计频率并作为时间序列子序列的特征,所有子序列的特征作为逻辑回归的输入对时间序列分类。

近些年来,深度学习被一些学者用于解决时间序列的分类问题,如多级小波分解网络(multilevel Wavelet Decomposition Network,mWDN)[22]、多尺度卷积神经网络(Multi-scale Convolutional Neural Network,MCNN)[23]、时序卷积神经网络(Time Series Convolutional Neural Network,TSCNN)[24]和时间序列注意原型网络(Time series attentional prototype Network,TapNet)[25]等。最经典的方法是将时序数据转换为二维时序图像,二维时序图像可以建立时空信息,并且应用计算机视觉领域成熟稳定的模型如卷积神经网络(Convolutional Neural Network,CNN),对时序图像进行分析与挖掘[26]。目前,研究人员提出了众多的序列图像化方法。例如,Chan等[27]利用小波变换从信号中提取信息,通过伸缩平移等运算将信号转换成为时频图;Wang等[28]用格拉姆角场(Gramian Angular Field,GAF)和马尔可夫跃迁场(Markov Transition Field,MTF)将时间序列转为图像;Hatami等[29]用重现图(Recurrence Plot,RP)和CNN 进行分类得到RP-CNN模型;Rodrigues等[30]提出绘图CNN 模型,用简易绘图的方式将时序数据转换为图像,继而用CNN 进行分类。

但上述图像化方法具有一定的局限性:1)图像化方法通常只能表现序列数据的片面信息,如GAF 只考虑了时间相关性,MTF 只考虑了时间位置关系,RP 只分析了时间序列周期性和平稳性。单一的图像化方法只能保留特定的特征,这导致在运用图像化方法之前需要分析时序数据的构成因素[31],才能得到一个相对较好的结果。2)用CNN 对序列图像进行分类时,卷积的平移不变性无法感受到输入时序数据的变化,这将弱化网络提取空间信息的能力。3)在卷积的过程中,由于感视野受到卷积核大小的限制[32],无法学习到时序图像中动态的时间关联信息。

为了解决上述问题,本文提出一种混合图像化循环胶囊神经网络(Fusion-Imaging Recurrent Capsule neural network,FIR-Capsnet),特色与优势在于:1)FIR-Capsnet 结合GAF、RP、MTF 三种图像化方法的优势,构造可以表现时序数据不同特征的多通道图像,以此融合时序数据所蕴含的多侧面时空特征,如时间相关性、位置关系、周期性和平稳性;2)引入胶囊神经网络,提取更多的潜在空间特征,并赋予一种内禀的注意力机制[33],强化浅层特征的提取和挖掘空间信息,提升网络鲁棒性;3)结合长短时记忆(Long-Short Term Memory,LSTM)网络的门机制与胶囊的旋转不变性实现神经元的激活和冻结,使胶囊特征之间具有记忆关联性,以此学习时序图像蕴含的时间特征,提高胶囊神经元的表达能力。此外,为了说明FIR-Capsnet 将循环记忆机制用于胶囊层的优势,本文同时将循环记忆机制运用于动态路由算法中,并通过对比实验分析循环记忆机制结合胶囊网络在不同阶段的优势。

1 问题定义与数据处理

1.1 问题描述和符号定义

在单变量时间序列分类问题中,一个样本表示为二元组{T,y},其中:T由L个观测值(T1,T2,…,TL)构成;y为类别的离散值,有NC种可能性。定义映射函数y=f*(T;θ),分类算法的目标是学习该映射的最优参数θ,以尽可能地逼近函数f*。

1.2 时间序列图像化处理

时间序列在一维空间上有多组特征,特征之间通常具有高度的关联性。例如,在一维的空间中,更多体现时序、周期、频率等特征。但一维时间序列上能够让人们捕捉到的信息有限,如时间点之间的相似度难以被分类网络提取[31]。因此,序列转换为图像后,可以在二维空间中用更多的语义特征如平稳性、周期、位置关系等表达时间序列所包含的潜在相空间信息[28]。

图像化时间序列常用的转换算法有GAF、RP 与MTF。其中:GAF 考虑时间相关性,将一维序列数据从直角坐标系转换到极坐标,并且通过反余弦函数消去噪声[28];MTF 考虑了时间状态关系,对时间序列进行量化,然后统计观测点之间的转换概率,构造马尔可夫转移矩阵[28];RP 综合了时间序列的周期性、混沌性和非平稳性,计算轨迹之间的成对距离[29]。为了解决图像化方法的局限性,本文结合多种图像化方法融合不同空间特征,如周期、位置、时间相关性,形成多通道数据,再通过FIR-Capsnet 提取多水平时空特征,最后对图像分类。即对时间序列分别进行了GAF、RP 和MTF 的3 种转换,最后将图像化时间序列合并为一个3 通道图像。

2 网络构造

胶囊神经网络作为当前新兴的深度学习模型,在图像处理中应用广泛[34-36]。它综合位姿信息将图像中所有的信息表征为向量,并通过动态路由算法提取空间信息[33]。因此本文利用胶囊神经网络提取融合的时空特征。但胶囊网络在某些时序样本数据集上表现不佳,这是由于它只能捕捉空间特征,忽略了时间特征。为了在捕捉空间特征的同时结合时间特征,本文结合LSTM 的门机制改进胶囊网络,命名为Caps-LSTM。此外,为了对比循环记忆机制在各个阶段的表现,本文分别在胶囊层和路由层引入循环记忆结构,得到2种不同的网络,分别命名为FIR-Capsnet 与混合图像化记忆循环胶囊神经网络(Fusion-Imaging Memory Recurrent Capsule neural network,FIMR-Capsnet),用于比较循环记忆机制作用在不同模块的优劣。

2.1 网络模型

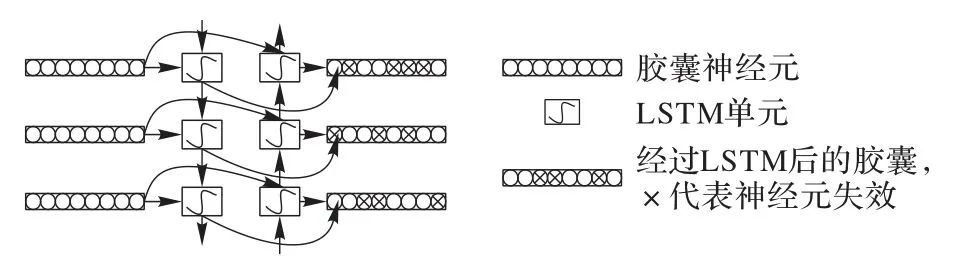

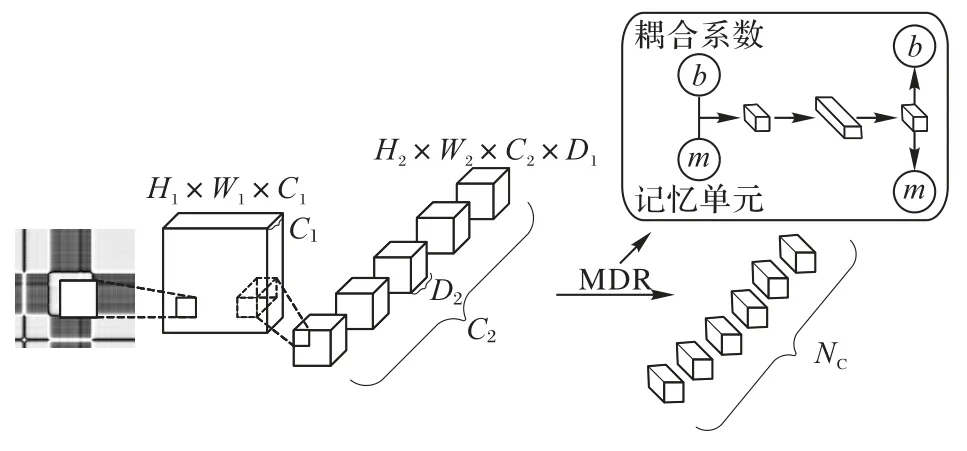

FIR-Capsnet 由卷积层、胶囊层、Caps-LSTM 层和路由(Dynamic Routing,DR)[33]层组成,如图1 所示。

图1 FIR-Capsnet结构Fig.1 Structure of FIR-Capsnet

卷积层的卷积核大小为m1×m1,通道数为C1,特征图大小为H1×W1×C1。胶囊层的卷积核大小为m2×m2,通道数为C2,向量神经元个数为D1,得到特征图大小H2×W2×C2×D1,H2×W2为胶囊层后的特征图大小。Caps-LSTM 的隐藏单元数为D1,输出单元数为D2。经过Caps-LSTM 的向量神经元的个数为H2×W2×C2×D2;经过卷积层、胶囊层与Caps-LSTM 层的特征提取,最后路由层将胶囊特征迭代iter次,输出NC个类胶囊。最终根据每个胶囊的模长,得到属于各个类的概率。

2.2 Caps-LSTM层

由于胶囊网络能够捕捉时序图像中的位置相对关系,因此本文将胶囊神经网络引入时序图像分类。同时希望让网络能够在时序图像卷积的过程中学习时序图像中潜在的时间关联性。例如网络数据流,当传输控制协议(Transmission Control Protocol,TCP)连接中的FIN(Function Item Number)位设置为1 时,表明此报文段的数据发送完毕,请求释放连接,后续因网络延迟而造成的滞后数据是无效数据[37]。但胶囊网络的核心操作是卷积操作,导致胶囊局限于卷积核大小,对时域特征不敏感。因此,本文借鉴LSTM 中的门机制,通过遗忘门传递特征,使时序图像的像素之间具有关联性,从而使时序特征关联区域不再局限于卷积核的大小。将该层命名为Caps-LSTM 层,它一方面利用胶囊挖掘多水平特征的空间信息,另一方面,则利用门机制学习时间序列数据隐含的时间关联性。

如图2 所示,Caps-LSTM 单元的输入是即时胶囊状态值、前一个Caps-LSTM 单元输出胶囊的隐藏值与前一个Caps-LSTM 单元输出胶囊的记忆值。在Caps-LSTM 层中,胶囊作为Caps-LSTM 中的输入,通过双向LSTM 捕捉胶囊之间的依赖关系,得到新的一组胶囊。Caps-LSTM 可以利用输出门对胶囊的某些特征闭合,并且通过遗忘门使胶囊之间具有关联性,对胶囊的重要特征进行前后的双向传递。虽然胶囊层得到的胶囊已经被卷积破坏了时序关系,但通过Caps-LSTM层,可以让胶囊学习隐含动态时间关联特征。Caps-LSTM 的输入门和遗忘门解决了特征动态关联问题,输出门解决了特征动态闭合问题。胶囊通过Caps-LSTM 能够输出更具有表征意义的特征。

图2 Caps-LSTM层Fig.2 Caps-LSTM layer

Caps-LSTM 用符号x{t}代表胶囊t的输入值;h{t-1}代表上一个胶囊的隐藏层状态值;c{t-1}代表长时记忆单元值;Γf{t}、Γu{t}、Γo{t}分别代表LSTM 的第t个单元的输入门、遗忘门和输出门表示备选记忆值;c{t}代表即时单元的记忆值;Wf、Wu、Wc、Wo分别表示输入门、遗忘门、记忆单元、输出门的权重;bf、bu、bc、bo分别表示输入门、遗忘门、记忆单元、输出门的偏置;σ代表Sigmoid 函数,能够将输入映射到0~1 的范围内。Caps-LSTM 层的运算公式概括如下:

Caps-LSTM 层在处理时序图像问题时有明显优势,本文将在3.7 节进行验证。

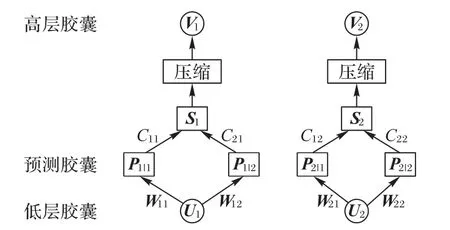

2.3 动态路由算法

经过Caps-LSTM 层的特征呈现了激活和冻结的状态,为了充分利用胶囊中的潜在特征,本文用动态路由减少深层高级特征的丢失[33]。动态路由通过计算预测胶囊和高层胶囊的相似度实现低层胶囊i向高层胶囊j路由的过程,越相似的胶囊被赋予了越大的权重。图3 是路由胶囊的简易结构。其中:Ui与Pj|i分别表示第i层胶囊与第j层预测胶囊;Vj代表第j层的输出胶囊;Wij是i向j的转换矩阵,即权重系数,可以通过反向传播算法(Back Propagation,BP)更新;Cij是i向j过渡的耦合系数,可以通过路由迭代算法更新,Cij越高代表相似度越高,预测胶囊越接近输出胶囊,胶囊之间相关性越强。路由迭代算法通过低层胶囊Ui和转换矩阵Wij得到预测胶囊Pj|i,将得到的预测胶囊与耦合系数相乘,获得总输出向量Sj,Sj经过压缩函数得到最终输出向量Vj。压缩函数保证了向量长度始终在[0,1]的区间。公式总结如下:

图3 动态路由过程Fig.3 Dynamic routing process

其中:耦合系数Cij依赖于当前胶囊的输入矢量,而不是依赖于学习到的权重系数。在路由迭代算法开始时,初始化逻辑对数bij=0,bij通过预测胶囊Pj|i和输出胶囊Vj之间的相似性进行更新:

当路由迭代次数增大,计算资源也会随之增加,因此常用的路由迭代次数为3[36]。本文将在3.6 节对比和分析不同路由迭代次数的性能。

3 实验与结果分析

为了证明网络的有效性,将本文方法与现有的时间序列图像化分类方法进行对比实验,并且在消融实验中消除了循环记忆机制的作用,让它退化为Capsnet 与本文方法进行对照,以此分析循环机制的效果;最后,在3.8 节对比了循环记忆胶囊与循环记忆路由的结果。

3.1 实验环境

实验环境的运行平台是python3.8+pytorch 1.8.1,并用GPU(Graphics Processing Unit)进行加速训练。

3.2 数据集

实验采用UCR 时序数据集[38]和人体活动识别(Human Activity Recognition,HAR)数据集[12]进行分析。

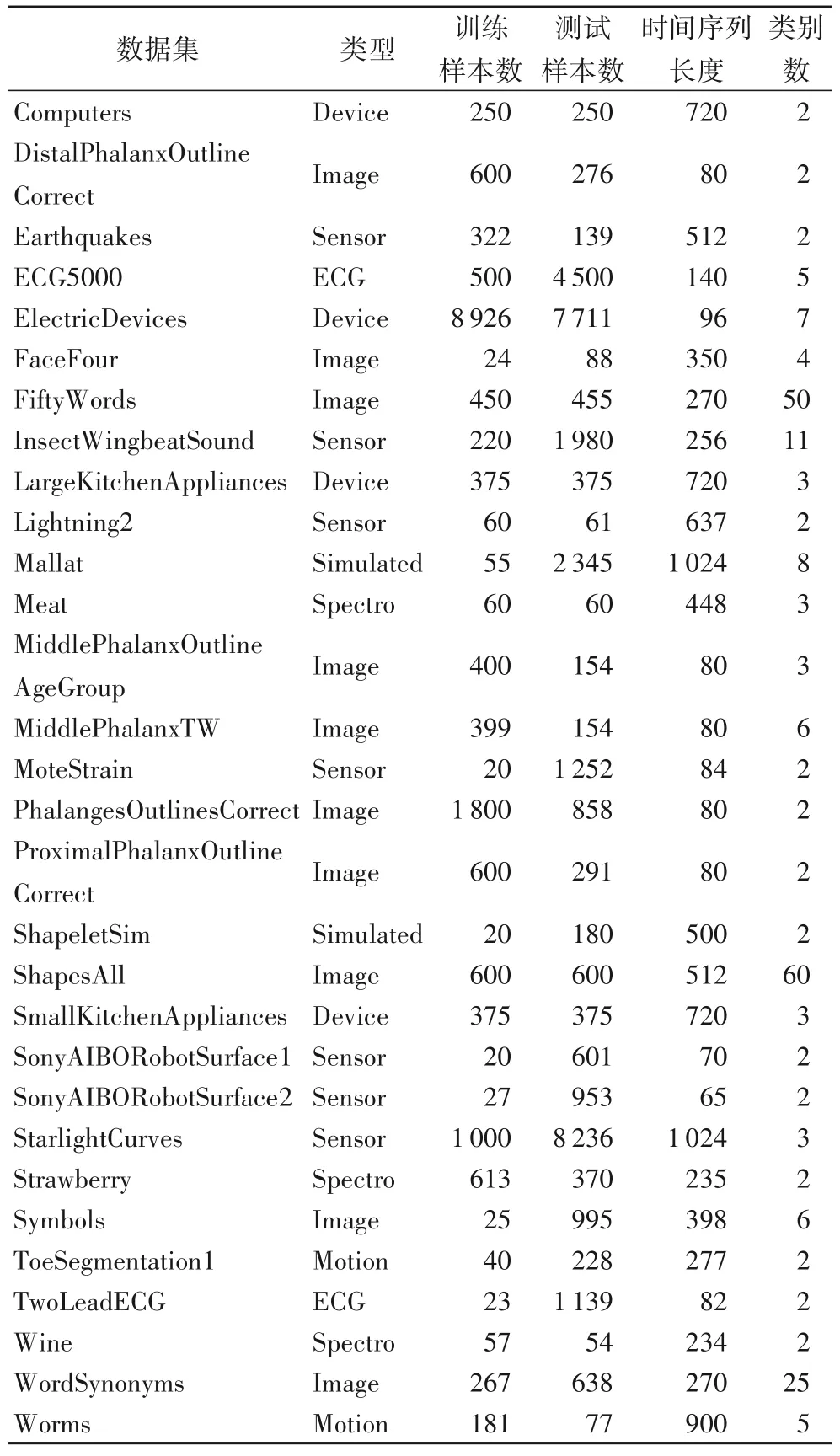

UCR 数据集用于时序分类的权威数据集,为了消除数据集中带入的主观性,随机选取UCR 中的30 个数据集进行训练和测试,包含了不同序列长度、类型与类别,如表1 所示。

表1 UCR数据集信息Tab.1 Information of UCR datasets

除了UCR 数据集,本文另外选取了HAR 作为实际实验数据。HAR 数据集的实验对象为30 名年龄在19~48 岁之间的志愿者。每个人在腰部佩戴智能手机进行6 项活动,分别为:走路、上楼、下楼、坐下、站直和躺下。使用嵌入式加速计和陀螺仪以50 Hz 的恒定速率捕获三轴线加速度和角速度。记录实验过程,并且为每一个样本标记标签。

实验过程中,传感器信号(加速计和陀螺仪)通过应用噪声滤波器进行预处理,然后在2.56 s 和50%重叠的固定宽度滑动窗口中采样(128 个读数/窗口)。从时域和空域计算变量获得特征向量,最后得到共计10 419 个时间序列长度为762 的样本数据。本文将获得的数据按照7∶3 的比例得到训练与测试数据,HAR 数据集样本数如表2 所示。

表2 HAR数据集信息Tab.2 Information of HAR dataset

3.3 实验参数设置

在实验中,GAF 的图像大小取决于分段聚合近似(Piecewise Aggregate Approximation,PAA)[39]窗口尺寸n×n的大小。PAA 将时间序列沿时间方向分割成段,对每一段中的所有观测点取均值作为新的序列值。本文将n分别设置为{ 32,48,64},如果序 列长度小于n,则n的取值 为min[n,L]。得到的图像缩放到统一尺度n×n,防止当序列长度不足窗口大小时尺度不统一。由于MTF 的图像大小取决于Q个量化区间,因此本文对MTF 的处理与GAF 相同,当序列长度不足Q时,令n为序列长度和Q的最小值。对于RP的图像化方法,将时延设为1,得到完全的循环图。

在训练FIR-Capsnet 的过程中,将批训练大小设为min[sample,64 ],其中,sample为样本数量。实验采用Adam优化器,β1=0.9,β2=0.999。同时使用指数衰减学习率加快收敛,初始学习率为0.001,衰减速度为1,学习率衰减系数为0.9。对所有的数据集采用相同的网络参数设计,卷积层的卷积核大小为5× 5,步长为2,通道数为64;胶囊层的卷积核大小为5× 5,步长为2,通道数为128,胶囊神经元个数设为8;Caps-LSTM 层的层数设为1,路由迭代次数设置为2。

3.4 实验结果

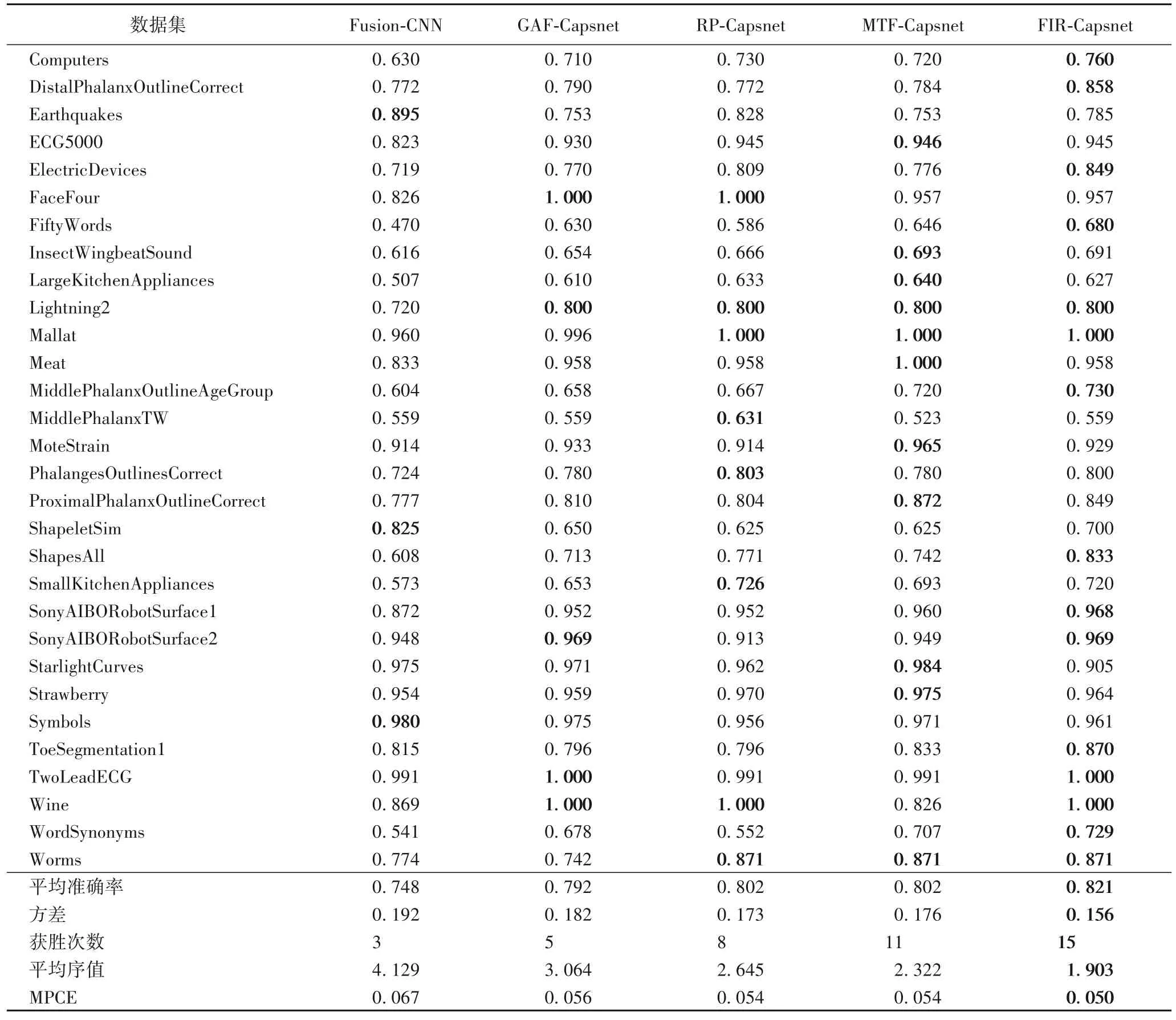

3.4.1 UCR数据集结果

对30 个来自不同领域的UCR 数据集运用交叉验证方法进行实验,采用30 次实验的均值作为最后的结果。4 种图像化方法与Fusion-CNN 的分类准确率如表3 所示,优胜者加粗表示,其中Fusion-CNN 表示图像采用融合方式,网络采用CNN。表格的底部是结果的统计值,分别计算各类算法的平均准确率、方差、获胜的次数、平均序值和均类误差(Mean Per-Class Error,MPCE)[40]。MPCE 值计算公式如下:

表3 在30个UCR数据集上的分类准确率Tab.3 Classification accuracy on 30 UCR datasets

其中:Dk为第k个数据集的类别数;ek为网络在第k个数据集的错误率。平均序值和MPCE 是评价多个算法在多个数据集下的常用指标,两者的值越小算法越优异。实验结果表明FIR-Capsnet 取得15 次胜利,相较于Fusion-CNN,FIR-Capsnet的平均准确率提高了7.3 个百分点。从图像化角度分析,采用混合图像化与单一图像化相比,平均准确率提高了1.9~2.9 个百分点,与GAF 的比较提升最明显。

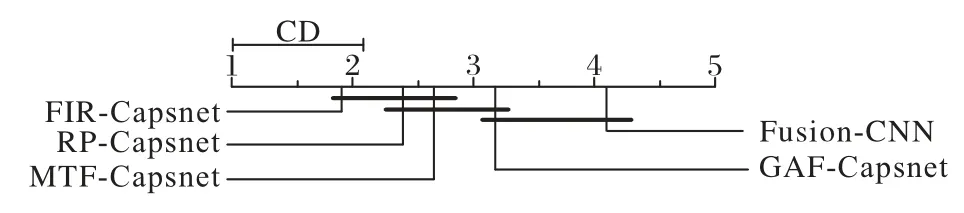

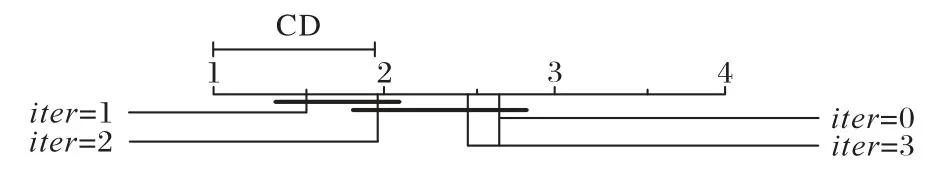

实验结果表明:1)融入多通道图像特征能够带来分类结果的小幅度提升;2)循环胶囊神经网络提高了网络的提取时空特征能力,主要原因是丢弃了池化层,用路由捕捉空间信息,并且用LSTM 记录时间信息。本文对上述网络用Nemenyi[31]后续检验,绘出临界差分(Critical Difference,CD)图,如图4 所示,置信度为95%。图中的横轴代表平均序值,平均序值越低,代表算法的表现越优异。可以看出,FIRCapsnet 与GAF-Capsnet 和Fusion-CNN 没有交叠,表明FIRCapsnet 与GAF-Capsnet、Fusion-CNN 有显著差异。

图4 不同图像化方法的临界差分图Fig.4 Critical difference diagram of different imaging methods

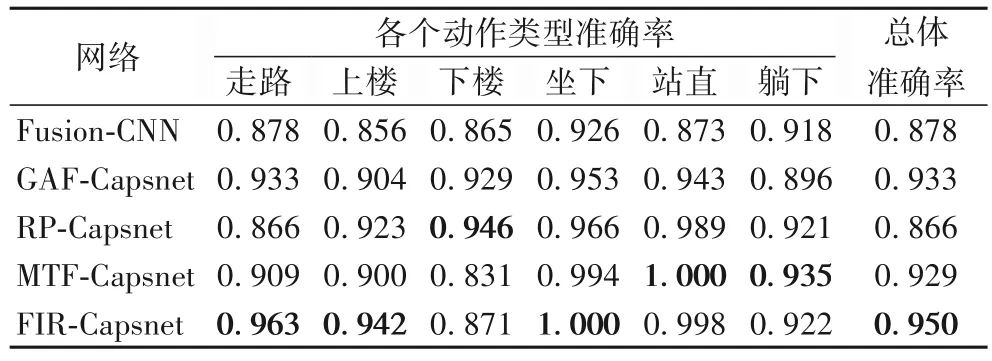

3.4.2 HAR数据集结果

为进一步研究网络对于各个类别的分类情况,以HAR数据集为例,结果如表4 所示,表中的数据是多次评估网络的结果。从总体的分类结果上看,FIR-Capsnet 在HAR 数据集上的分类表现优于其他网络,相较于Fusion-CNN,FIRCapsnet 的总体准确率提高了7.2 个百分点。FIR-Capsnet 的高准确率也说明网络具有较高的泛化能力,能适应不同的人体活动特征。对于单种图像化方法,混合图像化方法更具有优势。但在静态活动站直与躺下的分类准确率中,FIRCapsnet 结果不如MTF,这是因为混合图像的GAF 保存的时间相似度特征在静态活动中起负面作用带来的影响。这也使MTF 更适合检测静态活动,因此在检测老年人活动状态时,MTF-Capsnet 优于FIR-Capsnet。

表4 HAR数据集上的分类准确率Tab.4 Classification accuracy on HAR dataset

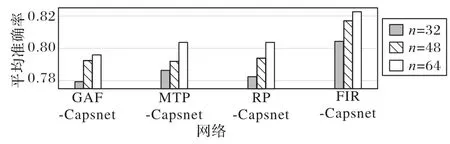

3.5 图像尺寸分析

为了确认超参数对准确率的影响,改变图像尺寸,分析时间序列窗口对结果的影响。分别设置n为{32,48,64}。考虑到深度学习的随机性,保持网络参数和随机种子不变,将UCR 的30 个数据集上的平均准确率作为最终的实验结果绘制成柱状图,如图5 所示。可以看出,窗口尺寸n×n的增大对结果有微弱影响。当n=48 时,网络效果最佳,并且采用混合图像化方法在任意窗口尺寸下均可以获得最优的分类准确率。

图5 不同方法在30个UCR数据集上的平均准确率Fig.5 Average accuracies of different methods on 30 UCR datasets

3.6 胶囊网络路由分析

胶囊网络中的超参数iter控制路由迭代的次数,iter越大,迭代次数越多,训练网络的时间越久;但iter会影响运行效率和分类结果,并非越大越好。为了探究iter的最优选取策略,在HAR 数据集上对胶囊层由低层胶囊路由到高层胶囊进行统计分析高层胶囊就是类胶囊,iter=1 等价为将所有低层胶囊均匀分配给类胶囊。当iter≥2,结果如图6 所示,低层向高层路由的频率为FLH,样本真实标签为“站直”,类别为4。

图6 FLH与iter的关系Fig.6 Relationship between FLH and iter

可以看出,当iter≥2 时,胶囊被路由到类别4(“站直”)的频率最多;其次是被路由到类别5(“躺下”)。表明在时序图像中,路由的迭代次数并不会对分类结果产生过多影响,大多数的胶囊被正确地路由到类胶囊上,但人体活动(“躺下”)会影响最终结果的输出。

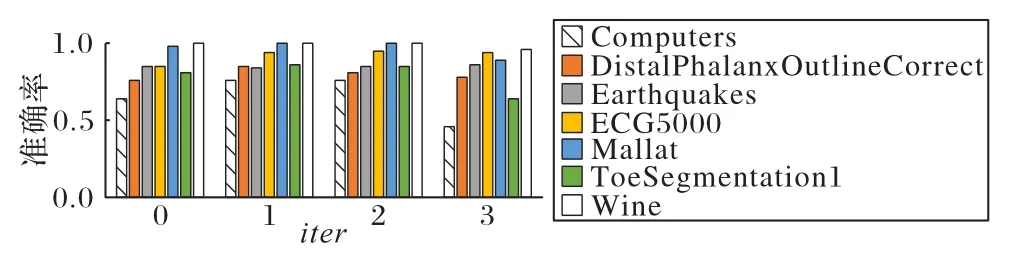

3.7 消融实验

为了验证循环机制在胶囊中的作用,本文设置了对照实验。在Caps-LSTM 中需要设置循环的次数,即网络的深度。为说明FIR-Capsnet 在时间序列分类问题上有良好的效果,本文针对改进的Caps-LSTM 层进行摘除和网络深度的叠加实验。首先对单个数据集进行特征关联性分析。当iter=0时,Caps-LSTM 层被摘除循环机制,变化成胶囊层,即网络退化为传统的Capsnet。本文随机地从7 个领域选取一个数据集作为代表,共选取7 个数据集,如图7 所示。可以看出,增加Caps-LSTM 层后,除了Sensor(Earthquakes)领域,在剩下的6 个领域中准确率都有所上升。这说明胶囊的时间特征关联性在时序图像中不可缺少。

图7 不同iter下7个数据集上的结果对比Fig.7 Comparison of results on 7 datasets under different iter

本文保持其余参数不变,分别在UCR 中的30 个数据集上进行训练和测试,最后绘出的CD 图结果如图8 所示。

图8 循环次数比较Fig.8 Comparison of recurrent times

可以看出,iter=1 的平均序值最低,其次是iter=2与iter=3,iter=0 的平均序值最高,结果表明循环机制能够提升胶囊网络的性能,但不能无限增长。当循环次数增大时,Caps-LSTM 层过度学习时序全局特征而忽略了局部特征。实验结果表明,胶囊网络融合门的机制能够让胶囊具有时间特征关联性,缩减了拟合系数,并且每个胶囊都能获取整个时间序列的特征。

3.8 循环记忆机制的比较

本文进一步设计了FIMR-Capsnet,对比循环记忆机制置于各个阶段的优劣。FIMR-Capsnet 具有3 层结构,由卷积层、胶囊层和记忆动态路由(Memory Dynamic Routing,MDR)层组成,如图9 所示。

图9 FIMR-Capsnet结构Fig.9 Structure of FIMR-Capsnet

卷积层和胶囊层的组成与FIR-Capsnet 相同,唯一区别的是在胶囊层得到H2×W2×C2×D1个胶囊后,对胶囊采用MDR 算法,不采用DR 算法。MDR 对胶囊迭代iter次后,同样得到NC个类胶囊。对比实验中,本文将参数设置为与FIRCapsnet 相同。在路由过程中,当经过一个更大的迭代次数时,最初的胶囊特征会因为算法的不断路由,导致信息不断丢失。第一次迭代出的耦合系数是更接近输入的,本文希望在计算时保留最初的输入系数,而不是经过多轮迭代后的输入系数。最初的输入能够矫正预测胶囊的路由过程,以便多轮迭代后输入系数能保留迭代过程中的重要信息。MDR 算法的伪代码如算法1 所示。相较于动态路由算法,增加了mij记忆单元。记录每一次的路由迭代信息,当算法开始时,与耦合系数相加,不断循环直到退出为止。

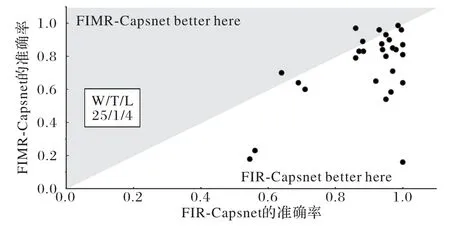

FIMR-Capsnet 和FIR-Capsnet 在30 个UCR 数据集上的训练结果如图10 所示。为了减少参数中的随机性,对所有的训练集进行30 次实验并取平均值作为最终结果。图10 中左上部分代表FIMR-Capsne 更优,右下部分代表FIR-Capsnet 更优,越接近左上或右下代表两者差异越大;W/T/L 分别代表FIR-Capsnet 获胜/平局/失败的数据集个数。可以看出,FIRCapsnet 优于FIMR-Capsnet,主要由于胶囊路由过程并不需要记忆机制。由3.6 节可以看出,当迭代次数iter≥2 时,增加iter的次数并没有让更多的低层胶囊路由到类胶囊。通过实验可以判断,iter并不会影响算法准确率,本文只需要一次动态路由就能达到接近最优的参数。因此,在动态路由算法中设计循环记忆单元并不能很好地融合路由机制。

图10 FIR-Capsnet与FIMR-Capsnet对照实验结果Fig.10 Comparison experiment result of FIR-Capsnet and FIMR-Capsnet

4 结语

本文应用融合图像化的方法聚合多水平的时空特征,并设计了具有循环结构的胶囊神经分类网络FIR-Capsnet 以挖掘时空特征。实验结果表明,在处理时间序列问题上的分类时,与实验中的图像化算法相比,FIR-Capsnet 的分类准确率有小幅提升,各项评价指标都优于对比算法。本文不仅通过图像化融合对比实验和关键层的消融实验验证了Caps-LSTM 层的作用,同时设计了FIMR-Capsnet 比较循环机制在不同阶段的效果。从实验结果可以看出FIMR-Capsnet 的准确率在大部分数据集上有不同程度下降,以此反证了FIRCapsnet 将循环记忆机制运用在胶囊层的合理性。

混合图像方法结合了多种图像化的优势,融合了多水平空间特征,保留了时间序列更多的语义信息。而循环胶囊网络不仅可以在尽可能保留空间特征的情况下,通过LSTM 的记忆门、遗忘门和输出门对特征激活和抑制,还可以通过LSTM 的记忆门提取时序图像时序特征。但本文网络在时序分类问题上还有进步空间,例如,在图像化序列的过程会丢弃序列片段的重要性,如何更好地将片段重要性特征融合至图像是未来重要的研究方向之一。