基于双模态深度学习模型诊断及鉴别诊断nAMD和PVC的研究

崔英杰,袁立飞,王艳辉,张胜娟,宋美娜,胡天翼,周庚显,王莉菲★

(1.华北理工大学,河北 唐山 063210;2.河北省眼科医院,河北 邢台 054001 ;3.北京邮电大学计算机学院,国家示范性软件学院,北京 100876)

年龄相关性黄斑变性(AMD)是黄斑的获得性疾病,其特征在于光感受器- 视网膜色素上皮复合物出现迟发性神经变性,进而引起进行性视觉损伤[1]。AMD 是一种不可逆的、严重的致盲性眼病,是目前我国第三大致盲性眼病,也是导致老年人群失明的主要原因,主要影响中心视力。此病患者的年龄多在50岁以上,双眼可先后或同时发病,视力呈进行性损害。预计到2040 年,全球AMD 病例数量将达到2.88亿例[2]。AMD 主要分为“干性”和“湿性”两个类型,而湿性AMD(wAMD)又可进一步分为新生血管性AMD(nAMD)和息肉状脉络膜血管病变(PCV)。wAMD 的早期监测和干预已被证明可以改善视力,因此早期诊断和治疗能最大限度地挽救患者的视力。光学相干断层扫描(OCT)检查作为近年来应用于临床眼科的新型检查技术,具有非侵入性、非接触性以及成像结果能够清晰、定量、直观显示病变的部位和层次等优点[3]。眼底照相(CFP)技术在眼科检查中应用广泛,并取得了一定效果。近年来随着人工智能(AI)技术的兴起和发展,利用机器学习对图像进行自动识别与分析在眼底图像自动分析等医学领域的研究中取得了重要进展。现阶段,眼科医生的数量与眼底病患者的数量不成正比,且根据CFP 和OCT 图像对wAMD 进行诊断会受到不同程度的干扰,增加了阅片难度。为缓解临床眼科医生工作量与患者需求量之间的矛盾,我们将AI 分析引入wAMD 辅助诊断领域,实现了对眼底图像中异常成分的自动实时识别,为临床医生提供疾病诊断参考并辅助医生进行快速诊断。目前,针对wAMD 进一步分类的研究较少,但由于nAMD 和PCV 的诊疗方案存在一定的差异,因此需要对wAMD 进行亚型分类,以利于临床辅助诊断工作的有效进行。本研究旨在利用AI 学习模型辅助识别和诊断PCV 和nAMD,以提高临床医师的工作效率和效能,具有重要的临床意义和公共卫生实践价值。

1 对象与方法

1.1 研究对象

选择2020 年1 月至2021 年12 月就诊于河北省眼科医院,经荧光素血管造影(FFA)和吲哚菁绿血管造影(ICGA)检查确诊的wAMD 及PCV 患者共56例作为研究对象,所有患者均行CFP 和OCT 检查,筛选体征典型、图像分辨率高的123 张CFP 影像和545 张OCT 影像(共4218 张)进行分析。

1.2 方法

1.2.1 图片预处理 对图片进行裁剪,隐藏所有患者影像资料中的个人信息及图片信息,且在训练数据上进行随机旋转、随机水平翻转、随机对比度增强等增强操作。

1.2.2 图片标注 进行标注系统搭建,首先由4 位临床眼科医生对该数据集进行标注,其中包括1 位主任医师,2 位副主任医师,1 位主治医师。标注共分为两轮,第一轮标注时,影像以患者为最小分发单位随机分发给4 位临床医生,该过程与临床诊断类似;第二轮标注时,由4 位医生共同对该批数据集进行阅片和标注。确保标注结果的准确性和一致性。标注内容包括视网膜内出血、渗出,视网膜层间积液,视网膜下积液,视网膜下高反射病灶、视网膜色素上皮(RPE)脱离,玻璃膜疣等眼底病变。

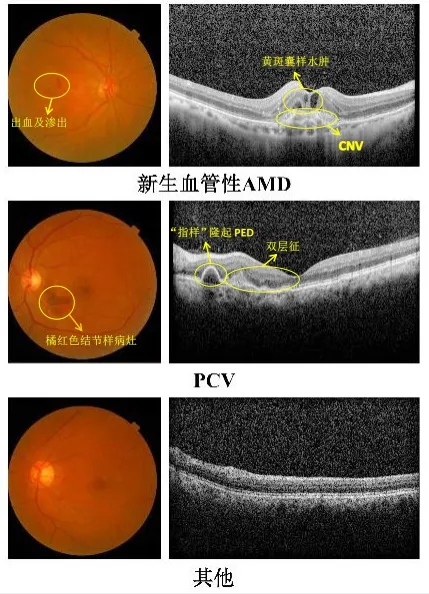

1.2.3 图片筛选 由4 名临床经验丰富的眼科医生进行独立观察、分析和筛选每幅图像,并完成诊断。若遇到诊断结论不一致的情况,则由另一名眼底病专家进行最后的判断。在将数据用于深度学习前,除去质量较差的影像后,将同一患者同一只眼的CFP 影像和OCT 影像匹配为一组双模态影像,如图1 所示。

图1 匹配为一组双模态影像示例

1.3 智能系统开发

针对目前辅助诊断领域普遍存在的只使用单一医学影像、未对wAMD 进一步分类等问题,我们提出了双模态wAMD 辅助诊断模型Wet-AMD-Net,该模型包括两个部分:1)不同特征提取模型应用于不同模态数据特征的提取;2)对特征表示进行融合。

1.3.1 特征提取 用于处理CFP 影像的特征提取模型记作F 模型,处理OCT 影像的特征提取模型记作O 模型。VGGNet 和ResNet 系列在主流的图像特征提取方法中是最具有代表性的。本研究先将VGG16、ResNet18 和ResNet34 三种模型分别作为同构特征提取模型,采用基于特征的连接策略进行测试,实验结果表明,使用VGG16 作为特征提取模型的Wet-AMD-Net 在F1 值、kappa 值、ROC 曲 线 下 面积(AUROC)、召回率、精确度上都比ResNet18 和ResNet34 模型的数据要好。第二步将VGG16 特征提取模型作为其中的一个固定模型,并分析不同特征提取模型组合效果的差异。实验的特征融合依然采取基于特征的连接策略,结果表明,当CFP 影像和OCT影像的特征提取模型都为VGG16 时,模型的性能达到最优。

1.3.2 特征融合 本研究分析了三种特征融合的方式,分别为基于特征的连接策略、基于特征的权重分配策略和基于分类结果的权重分配策略。我们将VGG16作为CFP 影像和OCT 影像的特征提取模型,采用三种不同的特征融合策略分别进行实验对比。实验结果表明,当两种模态影像的特征提取模型均为VGG16时,基于特征的连接策略为最优的融合策略。

1.4 AI 与专科医师比较

为了科学评价AI 模型的临床应用性和效能,我们将其与专业的医师进行比对分析,将4 位临床医生的第一次标注结果作为实际临床诊疗中的筛查结果,第二次标注结果作为数据的真实标签,可以得到4 位临床医生的标注F1 值等评价指标。

1.5 统计学方法

采用SPSS 22.0 统计学软件进行统计分析。应用ROC 曲线分析AI 的诊断性能,采用F1 值、Kappa 值、AUROC、召回率、精确度等作为系统评价效能指标。

2 结果

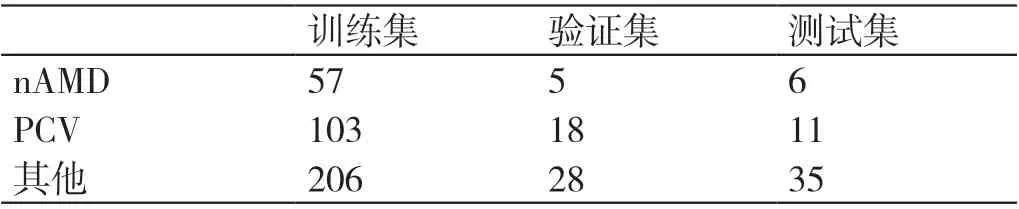

本次研究纳入明确诊断为wAMD 的56 例患者的123 张CFP 影像和545 张OCT 影像,其中68 张影像诊断为nAMD,132 张影像诊断为PCV,269 张影像诊断为其他。利用VGG16 的深度学习方法成功建立了两种特征提取模型。图像质量控制后,共得到469组影像,选择其中366 组影像进行训练,数据标签分布如表1 所示。对其中51 组影像进行验证及52 组影像进行测试,从而对构建的模型进行评估,其中标签为nAMD 的影像资料有57 组用于训练集,5 组用于验证集,6 组用于测试集;标签为PCV 的影像资料有103 组用于训练集,18 组用于验证集,11 组用于测试集;标签为其他的影像资料有206 组用于训练集,28 组用于验证集,35 组用于测试集。使用训练数据集测试了三种CNN 特征提取模型,结果表明VGG16表现最好。确定特征提取模型后,测试了三种不同的特征融合策略,结果VGG16 作为两种模态影像的特征提取模型为最优的融合策略。

为了展示我们提出算法的有效性,与临床经验丰富的医生进行了对比。AI 模型的性能由F1 值、Kappa 值、AUROC、召回率、精确度五个主要结果来表示。该模型在F1 值、召回率、精确度上分别达到了0.9798、0.9792、0.9821,表明该模型可以较为准确地识别及鉴别nAMD 和PCV ;该模型的Kappa 值、AUROC 分别达到了0.9550、0.9881,Kappa 值达到0.9550 表明该模型的一致性很高;AUROC 通常被用来评估AI 模型的性能,AUROC 达到0.9881 表明该模型的性能优异。而临床医生的平均水平在F1 值、Kappa 值、AUROC、召回率、精确度上分别为0.9110、0.7949、0.9557、0.9010、0.9522。可以得出该模型的水平均超过了4 位眼科临床医生,并且该模型能够准确且高特异性地诊断及鉴别nAMD 和PCV。详见表2。

表1 数据标签分布

表2 模型与临床医生对比实验

3 讨论

早期诊断wAMD 是一项非常重要且具有挑战性的任务,虽然OCT 和CFP 技术作为一种实时的非侵入性影像学检查在临床上应用已十分广泛,但因患者的早期筛查意识不到位,且眼科医生相对患者来说数量较少,导致阅片效率低下,因此对wAMD 的早期筛查仍存在巨大的挑战。在本研究中,我们利用深度学习方法构建了一个新智能模型来识别CFP 图像和OCT 图像中的特征并将其提取出来,进而辅助医生诊断和区分nAMD 与PCV。此次研究模型的尝试实现了AI 的双级跳,预示了巨大的临床转化应用前景。该系统无需使用ICGA 有创检查,仅利用无创的CFP和OCT 图像即可达到专业眼科医师的诊断水平,其安全性和高效性为以后在临床实际的广泛应用夯实了基础。本课题的主要目的是:第一,运用深度卷积神经网络模型,实现nAMD 和PCV 的分类诊断;第二,对比不同特征提取模型和特征融合策略的诊断效能差异;第三,评估对比深度学习模型和医生判读结果的诊断效能差异。

3.1 国内外相关研究的进展

AI 技术与wAMD 诊断相结合现已成为许多学者的研究热点。Burlina 等[4]人是最早研究基于深度学习网络实现AMD 智能辅助诊断的,他们利用预先训练好的深度神经网络分析眼底影像从而进行诊断,实现了利用AI 技术完成对正常、早期、中期和晚期AMD 的分型诊断。Venhuizen 等[5]人建立了一个基于深度学习实现通过OCT 影像进行分级诊断的AI 系统,可将无、早期、中期、伴有地图样萎缩的晚期AMD、伴有新生血管(CNV)的晚期AMD 5 个不同的级别进行诊断。该系统的AUROC 为0.980,灵敏度为98.2%,特异度为91.2%,医师的灵敏度分别为97.0% 和99.4%,特异度分别为89.7% 和87.2%,这与医师的表现形成了鲜明对比。

虽然单一维度的眼底AI 诊断系统可以获得较高的准确率,但是在真实的临床医学场景中,单一模态的AI 检测系统不足以对wAMD 进行确诊,不能满足当今的临床实际需求,而CFP 影像和OCT 影像可分别从平面、横断面的角度展示不同的体征信息,医师将CFP 与OCT 影像资料结合分析,从而可作出相应的临床诊断。Yoo 等[6]人通过将OCT 影像和眼底图像相结合提高了深度学习对AMD 诊断的准确性,建立了基于预先训练好的深度卷积神经网络和随机森林的多模态深度学习模型的基本结构,将眼底图像与OCT 图像联合应用的模型可提高诊断的准确率,AUC值为0.969,准确率为90.5%。这表明联合使用OCT和眼底图像优于单独使用OCT 影像或单独使用眼底图像的深度学习技术。在这项初步研究中,一种基于OCT 图像和眼底图像相结合的多模式深度学习算法与单独使用该数据相比提高了诊断准确率。

3.2 该模型的局限性

本研究仍有一定的局限性,例如为了保证纳入的数据均符合诊断标准,我们的数据来源均来自于一个中心,这就导致了数据量的不足。另外一个局限性则是各分类数据量的不均等,nAMD 组的数据量较其他2 组较少。但是最终模型效果并没有受很大的影响,我们的模型即使在较小的数据量训练的情况下,最终体现的效果也很好。虽然该模型的性能已达到了很好的水平,但目前仍有一定的缺陷,例如当前模型并不能作为一种诊断方式,而只能作为一种辅助诊断的手段,只能为诊断及治疗提供一定的参考,模型的可解释性较差,给出的辅助诊断结果可信度不高,不利于模型的临床落地。另外,该系统只能区分nAMD 和PCV,不能进一步识别wAMD 的其他亚型及评估病变的进展程度。为了有效解决可解释性问题,我们将进一步在wAMD 病变体征检测、分割领域展开研究,在为临床医生提供诊断结果的同时,给出CFP 影像和OCT 影像上相关病变体征的检测结果,为辅助诊断结果提供可解释性依据。在继续研究的同时,也要收集新的数据,继续对模型进行外部验证,对参数进行不断的调整,以达到最优化模型算法参数,从而提高模型的准确性,拓宽系统的适用性。如果将远程医疗与我们的模型相结合,可以确保我们的AI 系统得到广泛应用,并且可以帮助基层医疗卫生系统改善及提高诊断水平,降低医疗成本,为无法得到医疗帮助的人们提供医疗服务。

综上所述,我们开发了一种双模态深度学习方法用以辅助诊断wAMD,经过多次对比实验证明了该模型具有良好的性能,可以辅助临床医生进行诊断,提高工作效率,为更多患者提供医疗帮助。随着深度学习网络等技术的进一步发展,AI 有望在更多领域发挥辅助作用,改变现有的疾病诊断模式,为人类医疗水平的提升提供巨大的帮助。