基于边缘智能的煤矿外因火灾感知方法

赵端,李涛,董彦强,王志强,刘春

(1.中国矿业大学 矿山互联网应用技术国家地方联合工程实验室,江苏 徐州 221116;2.中国矿业大学 信息与控制工程学院,江苏 徐州 221116;3.国家电投集团 内蒙古白音华煤电有限公司,内蒙古 锡林郭勒 026200)

0 引言

火灾一直是煤矿的重点防治灾害,一般分为内因火灾和外因火灾[1-2]。内因火灾由矿井煤层自燃引起,主要影响煤矿正常开采。外因火灾主要由人员违规违章行为引起,如违章作业、设备检修不规范、违规堆放易燃物资等,一般火灾初期的火源较小,但常发生在生产区域,如果未及时发现,火情将会迅速扩大,造成煤矿人员伤亡和财产损失[3-5]。对煤矿外因火灾隐患进行检测,实现对初期火灾的可靠判识,对于提升煤矿火灾检测水平有重要意义,也是未来智能矿山建设的重要方向。

现有的矿井外因火灾检测方法主要包括基于传感器的检测方法、基于可见光图像和红外图像的检测方法、基于深度学习的检测方法等。基于传感器的检测方法[6-8]通过传感器采集环境中的温度、烟雾浓度、气体浓度等信息,利用阈值来判断火灾的发生情况,该方法准确率较高,但对微小火源感知不明显,且判识相对滞后。基于可见光图像和红外图像的检测方法[9]主要依赖于图像识别技术,利用颜色空间进行火焰图像分割,进而提取出尖角数、圆形度、质心位移等特征,再通过支持向量机进行分类,该方法易受井下移动发光物体(如探照灯)的影响[10]。基于红外图像、可见光图像及传感器多信息融合的矿井外因火灾感知方法[10-11]与单一方法相比提升了火灾感知准确率,但该类方法采用“分布采集−集中处理−远程控制”的方式,传感器信息、控制信息的传输依赖网络可靠性,网络波动可能会导致响应延迟、报警滞后等问题。随着深度学习在图像分类[12]、目标检测[13]等方面取得进展,卷积神经网络[14]、改进Mask R−CNN[15]、改进Faster−CNN [16]等被应用于火焰特征检测,该类方法对特征的识别精度更高,但网络模型参数量、计算量较大,检测速度慢,应用于煤矿时,通常需要配置高性能处理器,在地面集中处理视频信息,对视频图像传输网络的可靠性有较高要求。

YOLO[17]是一种单阶段目标检测网络模型,其检测速度快,适合部署在边缘侧硬件上,但对火灾初期小目标火源的识别能力不足。针对该问题,本文提出一种基于边缘智能的煤矿外因火灾感知方法。对YOLOv5s模型进行改进,在保证处理速度和轻量化的前提下,提高对火灾初期小目标火源的识别精度;对改进YOLOv5s模型提取的图像特征和传感器提取的物理特征进行融合分析,并将改进网络模型部署在智能边缘处理器上,用于煤矿外因火灾识别。这种煤矿灾害感知的新模式提高了火源检测的实时性和准确性,且不依赖长距离传输网络,提升了检测的可靠性,可用于矿山重点区域风险监控,为未来矿山的火源智能化巡检提供了算法支撑。

1 基于边缘智能的煤矿外因火灾检测模型

基于边缘智能的煤矿外因火灾检测模型主要由视频检测模块、多源信息融合模块及智能边缘处理模块组成,如图1所示。在智能边缘处理器上部署轻量化的改进YOLOv5s模型和多源信息融合模块,分别提取火源的图像特征和环境信息的多维度时空特征,通过特征融合判断是否发生火灾。

图1 基于边缘智能的煤矿外因火灾检测模型Fig.1 Detection model of coal mine external fire based on edge intelligence

智能边缘处理器是基于嵌入式微控制单元(Microcontroller Unit,MCU)和国产神经网络处理单元(Neural Processor Unit,NPU)开发的一款矿用边缘处理器。其核心是思元220边缘计算模组,具备专门用于深度学习的系统级芯片(System on Chip,SOC),采用ARM+NPU架构,芯片内部集成了CPU、NPU、视频处理单元及图像编解码单元;CPU为四核ARM Cortex−A55,主频为1.5 GHz,单片功耗为12 W,核心算力为每秒12×1012次操作。智能边缘处理器支持深度学习网络AlexNet,GoogleNet,VGG,ResNet,YOLO,SSD等。

采用矿用本安型网络摄像机KBA18(C)进行视频数据采集。摄像机在监测区域按一定距离部署,并通过网络接口与智能边缘处理器相连,为火灾检测提供视频图像数据。

采用矿用一氧化碳传感器GTH1000、矿用烟雾传感器GQLQ5及矿用温度传感器GWD150进行环境数据采集。传感器部署在矿用本安型网络摄像机周围,通过Modbus总线与智能边缘处理器相连,为火灾检测提供传感器数据。

2 改进YOLOv5s模型

2.1 YOLOv5s模型基本架构

YOLOv5s模型的基本框架可以分为输入端(Input)、主干网络(Backbone)、颈部(Neck)和输出端(Prediction)4个部分,如图2所示。输入端采用Mosaic数据增强方式,通过随机缩放、裁剪、排布对图像进行拼接。主干部分主要由跨阶段局部网络(Cross Stage Partial Network,CSPNet)模块组成,特征提取采用CSPDarknet53[18]网络结构,可降低计算损耗和内存成本。颈部使用特征金字塔网络(Feature Pyramid Network,FPN)和 路 径 聚 合 网 络(Path Aggregation Network,PANet)[19]来加强特征融合能力。输出部分主要由损失函数构成,采用CIOU_Loss作为损失函数,最后输出预测结果。

图2 YOLOv5s模型结构Fig.2 Structureof YOLOv5smodel

2.2 小目标检测层

为更适应火灾初期小目标火源的特征检测,提高小目标火源实时检测精度,综合考虑火焰检测精度和速度要求,在经典YOLOv5s模型基础上添加一个152×152的特征尺度,并改进为4尺度检测网络(图3),将目标的感受野变为4×4,使模型能够充分学习浅层特征,改善小目标检测性能。

图3 改进后的4尺度检测网络Fig.3 Improved 4-scaledetection network

2.3 自适应注意模块

YOLOv5s模型中,颈部使用FPN和PANet来加强其特征融合能力,然而在采样过程中,高层特征图会因为特征通道数的减少而造成上下文信息损失,影响检测精度。针对该问题,在原有FPN基础上添加自适应注意模块,通过空间注意力机制为每个特征图生成空间权重图,通过权重图融合上下文特征,生成包含多尺度上下文信息的新特征图,以减少上下文信息损失。

首先,将卷积得到的特征图M5(大小为 S)通过自适应平均池化层,获得不同尺度(a1×S,a2×S,a3×S )的多个语境特征,池化系数a1−a3可根据数据集中目标大小自适应变化。其次,将每个特征分别上采样后通过Concat层合并,得到特征图C5。 C5依次经过1×1卷积层、ReLU激活层、3×3卷积层及Sigmoid激活层,得到空间权重图W5。最后,将特征图C5和权重图 W5进行Hadamard乘积运算,分离后与特征图M5相加,得到包含多尺度上下文信息的新特征图A5, A5具有丰富的多尺度背景信息,在一定程度上缓解了由于通道数量减少而造成的信息损失,提高了模型的检测精度。自适应注意模块结构如图4所示。

图4 自适应注意模块结构Fig.4 Structure of adaptive attention module

3 多源信息融合

为解决井下光线条件差、粉尘多及摄像机拍摄角度引起的图像检测误差和漏检问题,进一步提高火灾检测精度,本文采用多传感器辅助检测,并提出一种动态加权算法,对图像和传感信息进行加权融合判识,具体流程如图5所示。

图5 图像和传感信息加权融合判识流程Fig.5 Weighted fusion identification process of image and sensor information

计算图像和传感信息动态加权值:

式中:α1—α4分别为摄像机、温度传感器、烟雾传感器、CO传感器的检测结果,取值为1或0;β1—β4为对应 α1—α4的权重参数,4个权重参数的和为1。

α1=0表示摄像机未检测到火焰,α1=1表示摄像机检测到火焰;α2=0表示井下温度在正常范围内,α2=1表 示井下温度已经超过正常情况; α3=0表示井下没有烟雾或者烟雾浓度忽略不计,α3=1表示井下烟雾浓度异常;α4=0表示井下CO浓度在正常范围内,α4=1表示井下CO浓度异常。

根据文献[20]设定权重参数,并以此为基础进行多组实验,得出最优权重参数和阈值,实验结果见表1。

表1 各权重对比分析结果Table 1 Comparative analysis results of each weight

当所有检测信息的动态加权值超过设定阈值时,表示检测到火灾发生。根据表1数据可得出,当视频检测到真实火焰时,设定β1—β4及阈值分别为0.90,0.05,0.03,0.02,0.92,检测准确率最高。当视频未检测到真实火焰时或者误检时,设定 β2—β4及阈值分别为0.79,0.11,0.10,0.89,检测准确率最高。

4 实验分析

4.1 数据集制作

为了提升本文方法在煤矿井下的检测性能,制作了火源特征数据集。该数据集由公共数据集(VOC2007)、项目组拍摄的12 000张图像、100张井下各种灯光图像构成,包含了火焰燃烧整个过程(从初期到后期,直至熄灭)的图像,涵盖不同光线条件和粉尘浓度情况。基于混合数据集训练网络模型,可提升模型的泛化能力。

图像拍摄地点为中国矿业大学火灾实验室和某煤矿提供的实验巷道(图6)。针对煤矿井下作业环境及相机拍摄角度的影响,采用多角度拍摄方式,拍摄参数见表2。

图6 实验巷道Fig.6 Experimental roadway

表2 图像拍摄参数Table 2 Image capture parameters

1号和2号相机的安装高度为0,表示相机正对火焰拍摄。3号和4号相机拍摄角度为正45°,表示相机在火焰正前方45°拍摄。部分现场拍摄样本如图7所示。

图7 部分现场拍摄样本Fig.7 Somesamples taken on site

4.2 参数设置与评价指标

设置所有模型训练批次为16,学习率为0.001,交并比阈值为0.5,训练轮数为100,在NVIDIA TITAN Xp GPU上训练模型。以召回率、交并比为0.5时的平均精度均值(mAP@0.5)及每帧推理时间作为模型评估指标。召回率计算公式为

式中:R为召回率;nTP为模型检测结果为正值的正样本数;nFN为检测结果为负值的正样本数。

mAP@0.5计算公式为

式中:Q为mAP@0.5的值;P为精确率;r为积分变量;nFP为虚假的正样本数。

4.3 实验结果分析

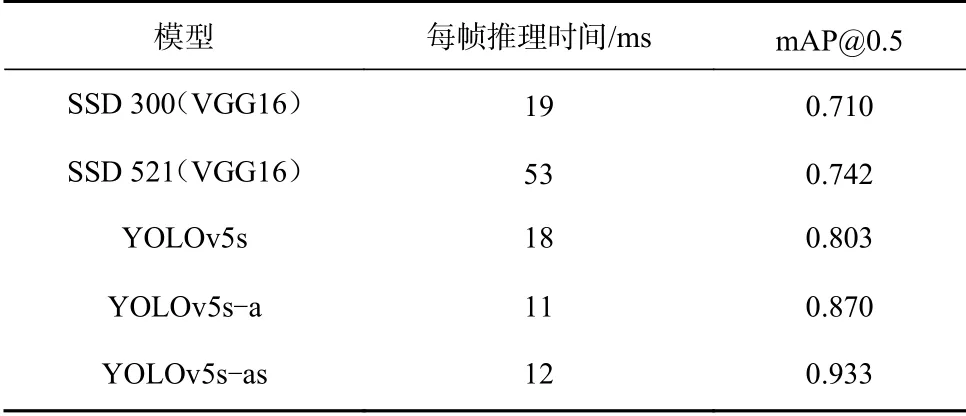

由于本文提出的方法由图像特征检测与传感器检测共同构成,为了与经典视频检测方法进行比较,先在YOLOv5s模型中加入小目标检测和自适应注意模块,得到YOLOv5s−a,再加入传感器信息融合判识,得到YOLOv5s−as。在各训练参数一致的前提下,与YOLOv5s,SSD−300[21],SSD−521[22]等经典图像识别模型比较召回率、mAP@0.5、每帧推理时间等,结果见表3。由表3可知,YOLOv5s−as模型由于通过图像特征和传感器感知特征共同判识,识别精度最高,但由于增加了传感器信息推理,每帧推理时间比YOLOv5s−a模型略有增加,但仍优于其他模型,原因在于改进模型对图像进行特征提取时视野更集中,处理速度更快。

表3 各模型移植前检测结果对比Table 3 Comparison of detection resultsof each algorithm before transplantation

将上述模型移植到智能边缘处理器上,并进行轻量化处理,在煤矿安全实验室模拟井下巷道场景,进行50次着火实验,以测试各模型在真实场景下的每帧推理时间及精度,实验结果见表4。

表4 各模型移植后检测结果对比Table 4 Comparison of detection resultsof each algorithm after transplantation

由表4可知,经过轻量化处理后,YOLOv5s−as模型的处理速度仍大于SSD 300(VGG16),SSD 521(VGG16)及YOLOv5s模型。但由于需对传感器信息和视频检测信息进行融合推理,每帧推理时间略长于YOLOv5s−a模型,但mAP@0.5提高了7.24%,与移植前的YOLOv5s模型相比,mAP@0.5提高了15.04%。

为了验证YOLOv5s−as模型的泛化能力,分别进行大目标火源、小目标火源和混淆实验,结果如图8所示。对于大目标火源,所有模型均能正常识别;对于小目标火源,SSD 300,SSD 512及YOLOv5s模型无法识别,这3种模型对小目标火源的适应性较差。YOLOv5s−a,YOLOv5s−as模型能够检测出小目标火源,适应性较好。

图8 火灾检测实验结果Fig.8 Firedetection test results

在混淆实验中,控制火焰亮度和形状趋近灯光,进行对比实验,发现除YOLOv5s−as模型外所有模型都将其识别为灯光。这是由于YOLOv5s−as模型加入了传感器信息融合判别,得到了正确结果,并发出警报。

4.4 边缘计算性能测试

为了比较边缘处理与传统的集中式处理2种方案的性能,将YOLOv5s−as模型从完成判识到报警输出的时间定义为响应周期,并进行对比测试。

集中式处理:将传感器数据通过RS485总线转以太网模块,并接入KJJ148井下环网交换机;摄像机通过网口接入KJJ148井下环网交换机,交换机通过光纤接入服务器;在服务器上部署YOLOv5s−as模型,对采集的视频和传感器信息进行分析和识别。主机硬件:CPU为英特尔E5−2609,64 GB RAM和1 TB固态磁盘,GPU为Nvidia TITAN Xp,网络测试带宽为300 Mbit/s,处理结果下行至现场的网络报警器。

边缘处理:传感数据、视频数据、报警器均通过网络接口接入边缘智能处理器,处理器每秒钟可进行12×1012次操作,网络传输带宽为300 Mbit/s。

对比结果见表5。可看出使用集中式处理方法时,需要经过5个步骤,响应周期为388 ms;使用边缘处理方式时,仅包括3个步骤,响应周期为238 ms,比集中式处理方法缩短了38.66%。

表5 边缘计算性能测试结果Table5 Edgecomputing performance test results

5 结论

(1)针对火灾初期的小目标火源,对YOLOv5s模型主干网络特征尺度进行改进,充分学习浅层特征,提高对小目标检测的能力;对YOLOv5s模型的颈部进行改进,在原有的FPN基础上添加自适应注意模块,提高模型检测精度。

(2)提出基于多源信息融合对井下火灾进行判识,使用动态加权算法将视频检测信息与多传感器检测信息相融合,构建了YOLOv5s−as模型。利用YOLOv5s−as模型的轻量化特点,实现边缘智能设备部署。

(3)实验结果表明:与未加入传感器信息融合推理的YOLOv5s−a模型相比,YOLOv5s−as模型推理时间略长,但mAP@0.5提高了7.24%;与移植前的YOLOv5s模型相比,移植到智能边缘处理器上并进行轻量化处理的YOLOv5s−as模型mAP@0.5提高了15.04%;对于小目标火源,SSD 300、SSD 512及YOLOv5s模型无法识别,YOLOv5s−a,YOLOv5s−as模型能够检测出小目标火源,适应性较好;使用边缘处理方式时,YOLOv5s−as模型的响应周期为238 ms,比集中式处理方法缩短了38.66%。

(4)基于边缘智能的煤矿外因火灾感知方法准确率较高,响应周期短,满足煤矿井下对火灾检测的实时性要求,适用于井下重点区域的外因火灾检测,也可用于未来智能矿山的智能巡检。