基于全局和局部特征的跨模态行人再识别方法

袁瑞超,胡晓光,2,杨世欣

(1中国人民公安大学 信息网络安全学院,北京 102600;2中国人民公安大学 侦查学院,北京 102623)

0 引 言

当前行人再识别方法主要是基于可见光图像和视频的行人再识别方法,着重解决可见光条件下目标人物的背景、光照、姿态等问题。然而,如果目标人物白天活动较少,夜间活动较多,仅依靠采集的可见光图像对目标人物再识别,难以应对目前犯罪嫌疑人昼伏夜出的问题。较为发达的城市除了大范围安装彩色(RGB)摄像机外,同时还会安装红外(IR)摄像机,不仅在白天可以采集到RGB图像,还会在夜晚采集到IR图像。因此,基于RGB和IR图像的跨模态行人再识别技术对于目标人物轨迹特征的捕捉非常重要。

在ILSVRC12的比赛中,Krizhevsky等人设计了识别精度较高的大型卷积神经网络,赢得了比赛胜利。自此,以卷积神经网络为代表的深度学习方法开始流行。应用在行人再识别领域的深度学习方法的特点是通过各种卷积神经网络获得丰富的行人特征,设计各种各样的损失函数来训练网络。Zhang等人提出了端到端的局部特征联合(Aligned)方法,采用难采样三元组损失监督训练,达到再识别目的。Park等人提出了相关关系网络模型,将三元组损失和交叉熵损失联合,作为最终的损失函数,多阶段对网络监督训练。Hermans等人改进传统的三元组损失函数,在行人类间差距大于类内距离的基础上,使类内距离要小于某个设定阈值,来对网络模型监督训练,获得了更好的识别效果。张涛等人提出了基于全局特征的三元组损失改进方法,在传统三元组损失的基础上引入类内距离,增大类间距离的同时,缩小类内距离,该模型达到了较好的识别效果。

近年来,基于RGB-IR图像的跨模态行人再识别方法成为了广泛关注点,用RGB和IR摄像机拍摄的行人图像,对网络进行训练,提高同一行人RGB和IR图像的匹配准确率。目前广泛使用的方法有2种。一种是图像生成方法,多采用生成对抗网络,将混合RGB和IR的多模态图像统一转换为单一模态的RGB或IR图像;另一种是神经网络学习分类的方法,对行人的RGB和IR图像同时进行特征提取,获得具有鉴别力的特征,使用合理的损失函数对网络进行监督训练。对此拟展开阐释分述如下。

(1)采用图像生成的方法。Dai等人采用GAN网络,从RGB和IR图像数据集中学习出具有判别力的特征,用判别器进行判断,最终提高判别器的识别能力。Wang等人提出了像级子网络,将RGB图像转换为IR图像,一定程度上扩充了数据集,在此基础上训练带有特征嵌入的子网络,从而减小模态差异,达到再识别目的。Wang等人利用GAN网络将RGB图像转换为IR图像,对真实的IR图像和虚假的IR图像进行判别验证,达到再识别目的。

(2)采用神经网络学习分类的方法。赵立昌等人提出了灰度能量差异性的红外图像与可见光图像融合方法,突出了目标信息和对比度。Wu等人提出了基于深度零填充的方法,采集了RGB-IR图像数据集SUSU-MM01,解决了再识别的研究问题。Ye等人提 出 了 双 向 中 心 约 束 的top-ranking(eBDTR)算法,使用了一对网络来分别提取RGB和IR图像特征,并采用SoftMax损失和双向约束排序损失(Bi-directional ranking loss),对网络进行监督训练。杜鹏等人提出自注意力模态融合的方法,利用Cycle GAN生成跨模态图像,使用自注意力模块区分原始图像和生成图像,使用模态融合模块融合特征,使用SoftMax损失监督训练,达到再识别目的。

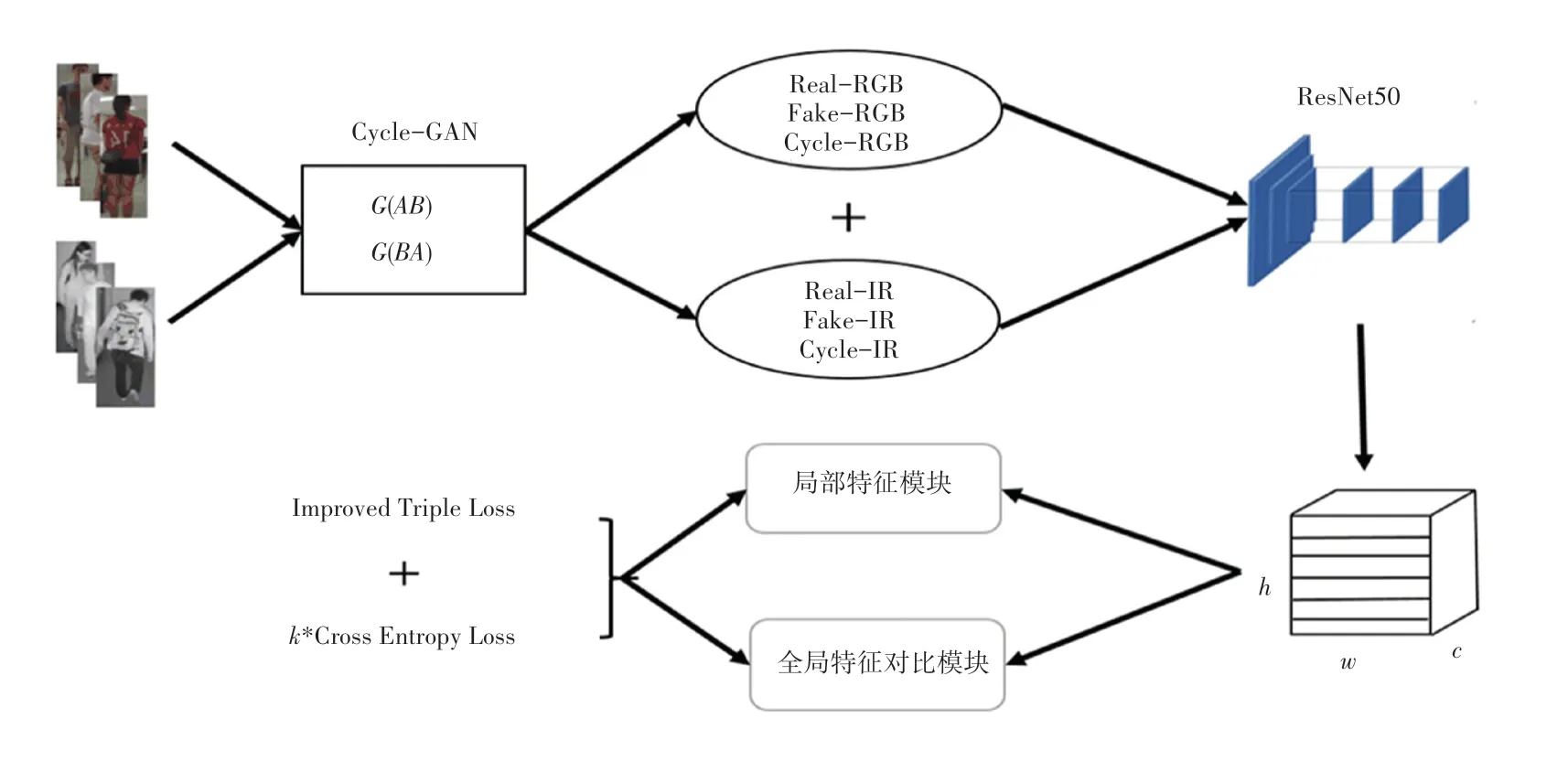

本文提出了基于全局和局部特征的方法。首先,采用Cycle GAN网络对数据集进行转换和扩充,降低行人体态变化带来的影响;在ResNet50网络的基础上,设计全局特征对比模块和局部特征模块,降低图像噪声带来的影响和行人图像的遮挡问题带来的影响;最后,将交叉熵损失和改进的三元组损失以比例加和的形式作为多损失联合函数,对网络进行监督训练。采用RGB图像和IR图像混合、RGB图像转换为IR图像、IR图像转换为RGB图像三种实验思路,做了相关实验。

1 相关理论介绍

1.1 Cycle GAN网络原理

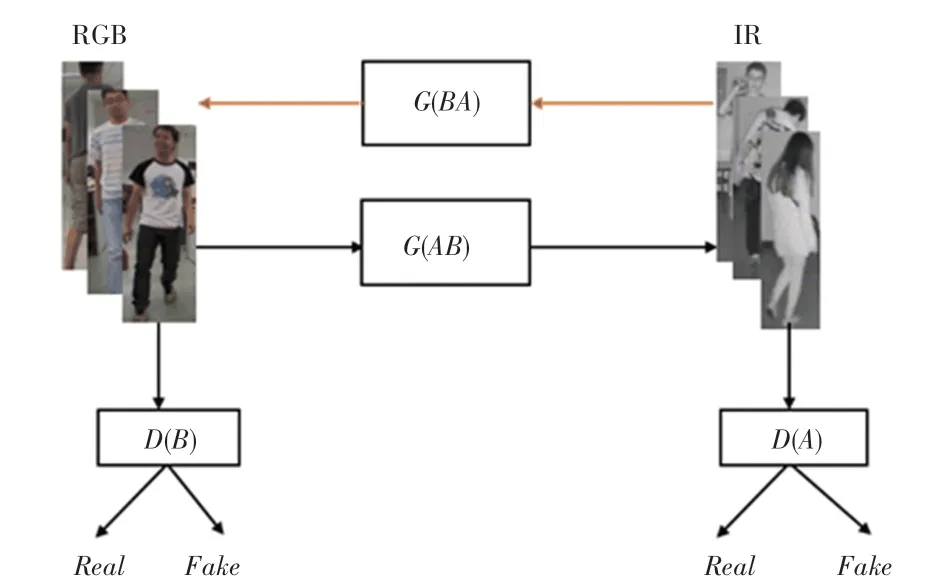

GAN网络通过构造生成器和判别器,使2种不同风格的图像相互学习,相互博弈,不断地提高其生成能力和鉴别能力,最终将一种风格的图像生成另外一种风格的图像,其生成效果非常逼真。虽然GAN网络的变体模型较多,Cycle GAN网络采用卷积和反卷积策略,不要求以成对的方式输入图像,生成图像的质量较好,故本文采用Cycle GAN网络实现RGB图像和IR图像之间的转换和扩充。

Cycle GAN网络实现RGB图像和IR图像转换和扩充的原理是:RGB图像经过生成器(),生成IR图像,和原有的IR图像经过判别器(),如原有的IR图像被判别为真(),生成的IR图像被判别为假(),Fake-IR图像再一次经过生成器()生成Cycle-RGB图像,Cycle-RGB图像和原始的RGB图像几乎一致;同理可知,IR图像也会转换为Fake-RGB图像和Cycle-IR图像。Fake-RGB图像和Fake-IR图像几乎可以以假乱真。Cycle GAN的对RGB图像和IR图像的转换和扩充示意如图1所示。

图1 Cycle GAN网络对RGB图像和IR图像转换和扩充的示意图Fig.1 Schematic diagram of the conversion and augmentation of RGB images and IR images by Cycle GAN network

1.2 全局特征对比模块和局部特征模块

使用Cycle GAN网络扩充数据集后,采用双线性插值算法,将图像分辨率统一为高384像素,宽128像素。使用扩充后的数据集训练ResNet50网络,得到大小为的整体特征图,将整体特征图输入全局特征对比模块,并将整体特征图在的层面上沿着划分出6个相等局部特征区域,获得局部特征图,将局部特征图输入局部特征模块,如图2所示。

图2 图像通过ResNet50网络后输入全局特征对比模块和局部特征模块的示意图Fig.2 The flow chart of global feature comparison module and local feature module after the image passes through the ResNet50 network

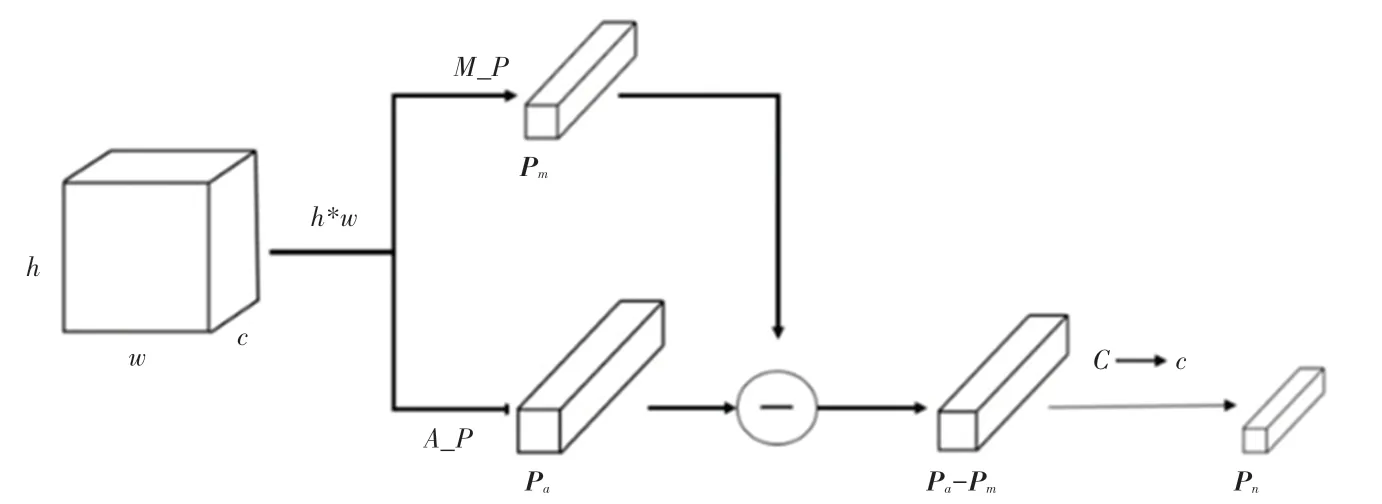

全局特征对比模块的原理:扩充后的数据集通过ResNet50网络后得到特征图,将其作为整体,分别进行全局最大池化和全局平均池化,得到通道数为的特征向量P和P;采取P-P方法,使用11的卷积核进行卷积,批处理归一化,函数激活,得到P;最终将特征图的通道降低。全局特征对比模块的原理示意如图3所示。图3中,,,分别表示特征图的高、宽、通道数,_、_分别表示平均池化和最大池化。

图3 全局特征对比模块原理示意图Fig.3 Schematic diagram of the principle of global feature comparison module

噪声在数字图像中体现为白点,卷积运算的原理是点乘、相加,噪声同样参与卷积运算,其影响同样存在于特征图和特征向量当中。平均池化和最大池化过程中图像噪声影响示意如图4所示。研究假设图像经过2个不同的卷积核的卷积运算形成和,假设的、有噪声的成分,且在数值上大于、,经过最大池化(Max Pooling)所形成的特征值也包含噪声成分;平均池化(Average Pooling)不同于最大池化,是将的所有值加和平均,含有噪声的、参与了平均池化运算,形成的特征值也会有噪声成分。将这2个同时含有噪声成分的特征值和相减,在一定程度上能够降低噪声。因此,全局特征对比模块中,P-P的方法在一定程度上能够降低图像噪声带来的影响。

图4 平均池化和最大池化过程中图像噪声影响的示意图Fig.4 Schematic illustration of the effect of images noise during Average Pooling and Max Pooling

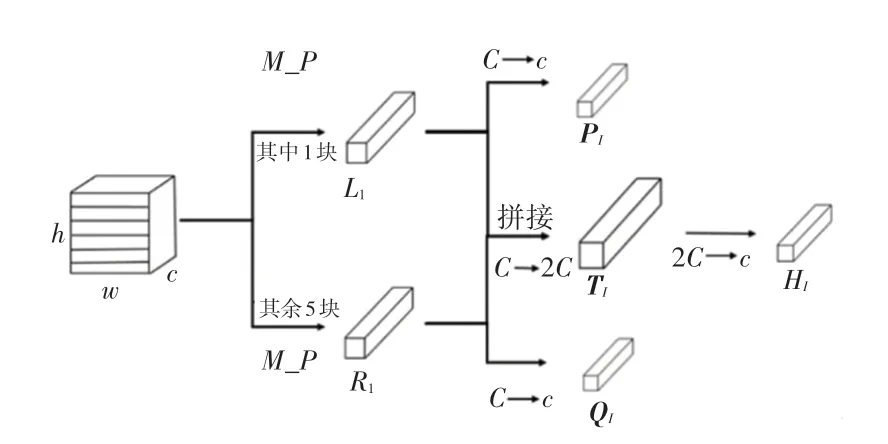

局部特征模块如图5所示,这里将整体特征图在层面上沿着方向划分为6个大小相等的区域,选择其中一个区域全局最大池化,得到特征向量L;其余的5个区域按顺序组合,形成另外一部分特征图,将这一部分特征图全局最大池化,得到特征向量R。一方面将L和R分别使用11的卷积核进行卷积、批处理归一化和函数激活操作,得到P和Q;另一方面将L和R拼接,得到特征向量T,对T使用11的卷积核卷积、批处理归一化和函数激活操作,得到H。由于将特征图划分为6个区域,每次选择其中的一个区域,其余的5个区域顺序组合,这样选择局部特征的方式共有6种,即P,Q,T分别有6种,记P={,,,,,},Q={,,,,,},T={,,,,,}。

图5 局部特征模块示意图Fig.5 Schematic diagram of global feature comparison module

由于将特征图均匀分割为6份,选取其中的一份进行运算得到P。假设行人图像的腿脚区域被遮挡,而P是头部区域运算得到的,这样通过运算得到的P就降低了遮挡带来的影响,局部特征模块在一定程度上能够降低遮挡对识别模型的影响。

1.3 多损失联合

交叉熵损失经常用于行人再识别中的多分类问题。传统的三元组损失在于寻找原始样本、正样本、负样本,通过网络不断学习,使原始样本和正样本之间距离不断地缩小,和负样本之间的距离尽可能地增大。难采样的三元组损失对其改进,所选择的正样本和原始样本之间的距离尽可能远,负样本和原始样本之间距离尽可能近。本文参考难采样三元组损失,对三元组损失进行修改:假设所选择的原始样本是行人的RGB图像,正样本选取同一行人的IR图像,正样本的背景与行人的动作姿态和原始样本的差异尽可能大;负样本选取不同行人的RGB图像,且和原始样本的RGB图像在背景和行人姿态方面尽可能相似。改进的三元组损失如图6所示。图6中,A表示原始样本的RGB图像,N表示和原始样本的RGB图像尽可能相似的负样本图像,P表示和原始样本RGB图像之间的距离尽可能远的正样本IR图像;反之,若原始样本选取为IR图像,其正样本和负样本的选取策略相似。

图6 改进三元组损失示意图Fig.6 Schematic diagram of improving triple loss

将交叉熵损失和改进三元组损失以比例加和的形式作为多损失联合函数,对此可表示为:

其中,L表示交叉熵损失;L表示改进的三元组损失;参数取正整数。

2 基于全局和局部特征的跨模态行人再识别方法的设计

根据以上原理,本文设计了基于全局和局部特征的跨模态行人再识别的网络结构,如图7所示。由图7可知,首先利用数据集训练Cycle GAN网络,分别将所有的RGB图像转换为IR图像,所有的IR图像转换为RGB图像。将同一行人生成的图像和原始的图像视作拥有同样的行人身份,对图像进行镜像、裁剪、颜色变换操作,以进一步扩充数据集。接着使用扩充后的数据集训练ResNet50网络,得到整体特征图,一方面将整体特征图输入全局特征对比模块;另一方面将整体特征图输入局部特征模块。最后,使用多损失联合函数对网络进行监督训练。

图7 基于全局和局部特征的跨模态行人再识别方法的网络结构图Fig.7 Network architecture diagram of cross-modal pedestrians re-identification method based on global and local features

Cycle GAN网络实现RGB图像和IR图像之间的转换和扩充后,将同一行人生成的图像和原始的图像视作拥有相同的行人身份,并进行镜像、裁剪、颜色变换操作,以进一步扩充数据集。将所有图像的分辨率统一调整为128×384,将生成的图像和原始的图像一同输入到ResNet50网络中进行训练,得到通道数为2 048的整体特征图。一方面,将整体特征图输入全局特征对比模块,在得到通道数为2 048的特征向量P和P后,采取P-P方法,使用256个1×1的卷积核进行卷积,批处理归一化,函数激活,得到P,最终将特征图的通道降低到256;另一方面,将整体特征图输入局部特征模块,在得到通道数为2048的特征向量L和R后,使用256个1×1的卷积核进行卷积、批处理归一化和函数激活操作,得到P和Q,将特征图的通道数降低到256;将L和R拼接,得到T,对T使用256个1×1的卷积核进行卷积、批处理归一化和函数激活操作,得到H,将特征图的通道数降低到256;最后,使用多损失联合函数对网络监督训练,其中参数取正整数。

3 实验仿真

本文实验均在PyTorch框架下运行。设定为64;设定为200;初始学习率设定为0001,从第50个开始进行衰减,衰减系数为01;多损失联合函数的参数取正整数。

评估指标选择常见的累计匹配特性(CMC)曲线的1、10、20和平均准确率均值()。指标越高,表示模型的识别效果越好。

3.1 数据集

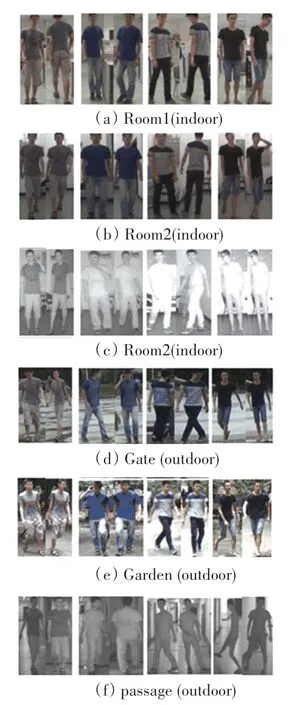

(1)数据集SYSU-MM01。分为室内模式和室外模式,共包含287 628张RGB图像,15 792张IR图像,共计491个行人。本文实验选取其中的395个行人的图像用于训练和验证,剩余的96个行人的图像用于测试,并对其多次划分,减小模型训练结果的误差,部分图像示例如图8所示。

图8 数据集SYSU-MM01部分图像示例图Fig.8 Example images of part of SYSU-MM01 dataset

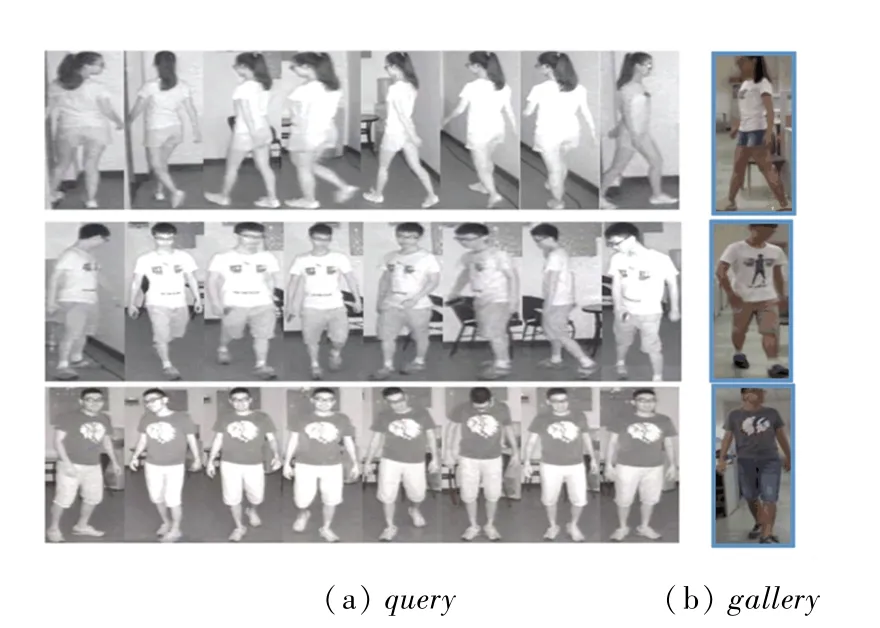

(2)数据集RegDB。包含8 240张行人图像,412个行人,每个行人10张RGB图像、10张IR图像。本文实验对数据集多次划分,一半用于训练和验证,另一半用于测试,减小模型训练结果的误差,部分示例图像如图9所示。

图9 数据集RegDB的部分图像示例图Fig.9 Example images of part of RegDB dataset

3.2 实验结果与分析

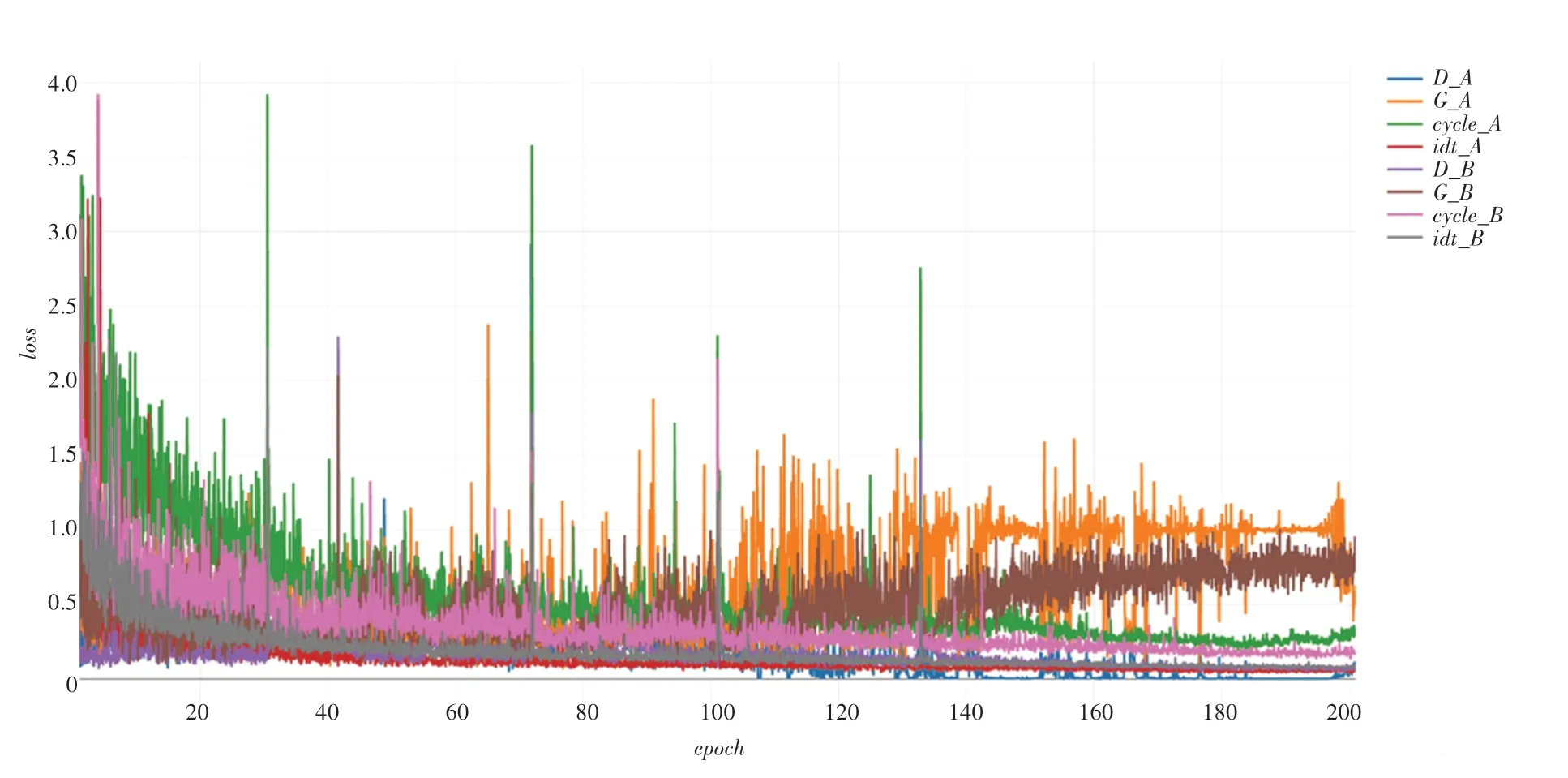

3.2.1 Cycle GAN网络对不同模态图像的转换结果以Cycle GAN网络训练RegDB数据集为例,损失曲线如图10所示。图10中,_的曲线表示判别器()的损失;_的曲线表示生成器()的损失;_的曲线表示图像经过生成器()生成图像后,由再经过生成器()生成的图像,和原始的图像相比较的损失;_的曲线表示判别器()的损失;_的曲线表示生成器()的损失;_的曲线表示图像经过生成器()生成图像,由图像经过生成器()生成的图像,和原始的图像相比较的损失;_的曲线表示将图像输入生成器()生成的图像和原始的图像相比较的损失,主要用于判断生成器()对输入的图像能否判断为其自身;_的曲线表示将图像输入生成器()生成的图像和原始的图形相比较的损失,主要用于判断生成器()对输入的图像能否判断为其自身。

图10 Cycle GAN训练RegDB数据集损失曲线图Fig.10 Loss curve of Cycle GAN training RegDB dataset

在选取生成器对数据集转换之前,综合考虑每一组模型的各个损失,使其尽可能小。本次实验选取为75的一组模型,其中,判别器()的损失为0232;生成器()的损失为0418;图像经过生成器()生成图像后,由再经过生成器()生成的图像,和原始的图像相比较的损失为0540;图像输入生成器()生成的图像和原始图像相比较的损失为0123;判别器()的损失为0248,生成器()的损失为0256;图像经过生成器()生成图像,由图像经过生成器()生成的图像,和原始的图像相比较的损失为0229;图像输入生成器()生成的图像和原始的图像相比较的损失为0217。

数据集RegDB经过Cycle GAN网络转换后的部分图像示意如图11所示。图11中,第一行人物图像的图像相比于图像,轮廓和动作更加清晰,图像、图像与原始的图像几乎没有大的变化;第二行人物图像的图像相比图像,衣着和背包显得更加清晰,图像、图像与原始图像几乎一致;第三行人物图像的图像相比于图像,轮廓更为清晰。图像转换为图像,在图像背景、人物衣着等有所变化,肢体动作等几乎保持原样,这类情况可以看作同一行人穿着不同颜色的衣服,在不同的光照条件下被摄像头捕捉到。因此,数据集通过Cycle GAN网络的转换和扩充,一方面增加了图像的数据量,另一方面增加了图像的轮廓等细节,这有助于降低跨模态行人再识别中行人的姿态变化带来的影响。

图11 数据集RegDB经过Cycle GAN网络转换后的部分图像示意图Fig.11 Schematic diagram of some images of RegDB dataset transformed by the Cycle GAN

3.2.2 在SYSU-MM01数据集上的识别结果与分析

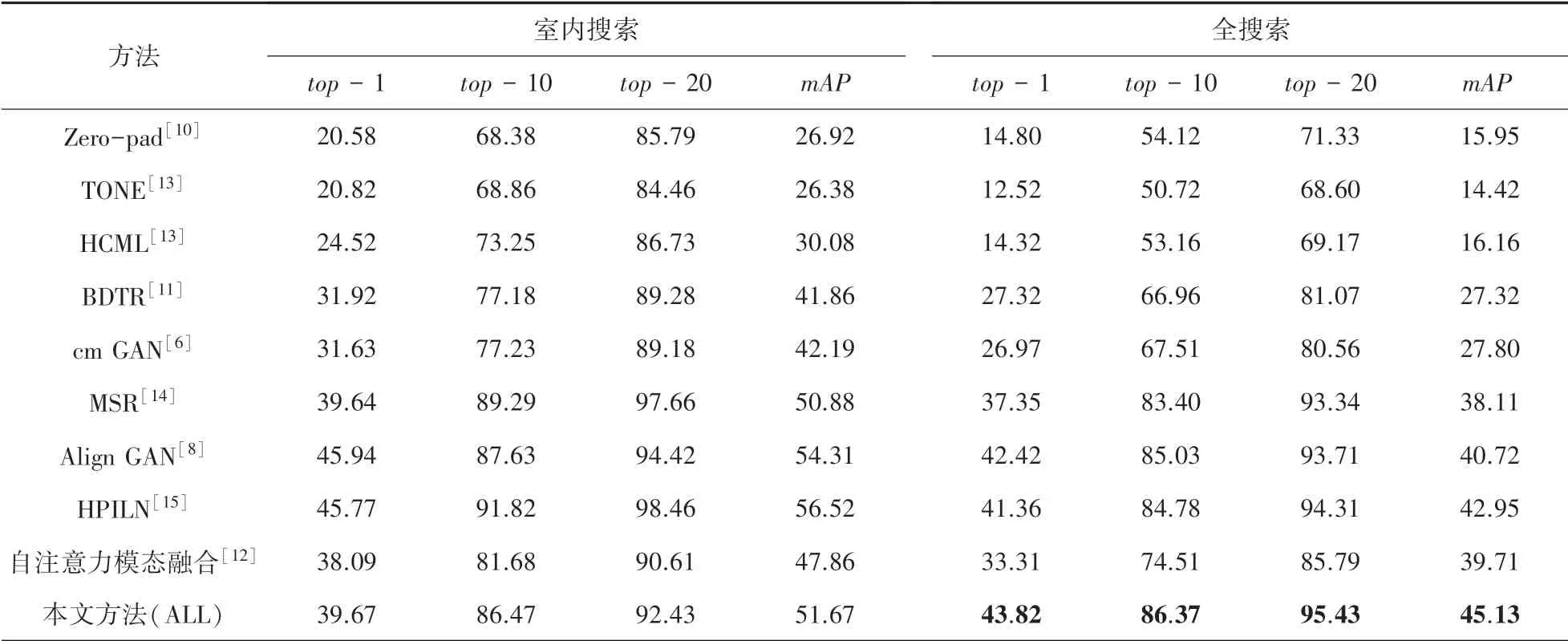

在数据集SYSU-MM01上识别测试有单击和多击两种模式。其中,单击模式选取所有的IR图像作为,并随机选取对应行人的一张RGB图像组成;在多击模式中,的选取和单击模式一致,是每个行人选取10张对应的RGB图像。室内场景下环境条件较为理想,图像质量较高;室外场景下行人图像的光照变化较大,存在遮挡现象,再识别难度较大。相比之下,单击模式更有实际意义,本次测试不论在室内模式、还是全搜索模式均采用单击模式。因该数据集存在部分行人缺失RGB图像或者IR图像的现象,因此研究中采用RGB图像和IR图像混合的方式进行实验。本文方法(ALL)的识别精度和其他方法的对比见表1。

表1 在SYSU-MM01数据集上单击模式的识别精度和其他方法对比Tab.1 Comparison of the recognition accuracy between single-click patterns and other methods on SYSU-MM01 dataset %

在全搜索场景下的单击模式,本文方法利用Cycle GAN网络对数据集SYSU-MM01扩充和转换,将生成的RGB图像、IR图像和原始的图像一同输入到ResNet50网络中进行训练;将特征图分别输入到全局特征对比模块和局部特征模块,使用参数为2的多损失联合函数进行监督训练,模型效果达到最好。本文方法(ALL)和Align GAN方法相比1指标提高了1.4%,10指标提高了1.34%;和HPILN方法相比20指标提高了1.12%,值提高了2.18%。在SYSU-MM01数据集上测试时部分图像的识别结果如图12所示。

图12 在SYSU-MM01数据集上测试时部分图像的识别结果图Fig.12 Recognition results of some images when tested on SYSUMM01 dataset

3.2.3 在RegDB数据集上的识别结果与分析

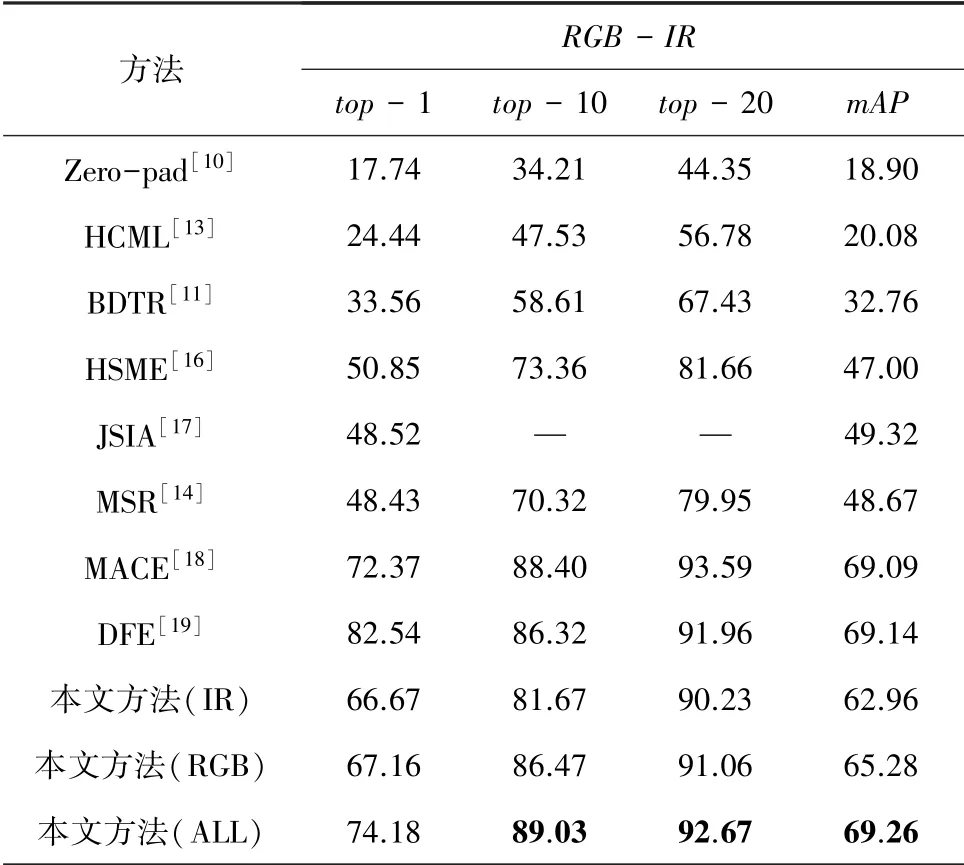

在数据集RegDB上测试时,测试集中所有的IR图像组成,所有对应的RGB图像组成,识别精度和其他方法的对比见表2。

由表2可知,本文方法(ALL)使用参数为3的多损失联合函数进行监督训练,模型精度最高。本文方法(ALL)的10指标达到了8903,比MACE方法提高了0.63%,值达到69.26%,比DFE方法提高了0.12%。

表2 在RegDB数据集上的识别精度和其他方法的对比Tab.2 Comparison of recognition accuracy with other methods on RegDB dataset %

本文方法(IR)和本文方法(RGB)是分别利用Cycle GAN网络将数据集RegDB的RGB图像转换为IR图像、IR图像转换为RGB图像,将原始的图像和转换后的图像一同输入到ResNet50网络中训练,将特征图分别输入到全局特征对比模块和局部特征模块,并使用参数为2的多损失联合函数监督训练,模型识别效果较好。指标分别达到了65.28%和62.96%,1指标分别达到67.16%和66.67%,10指标分别达到了86.47%和81.67%,接近MACE、DFE方法,20指标分别达到91.06%和90.23%,与本文方法(ALL)较为接近。

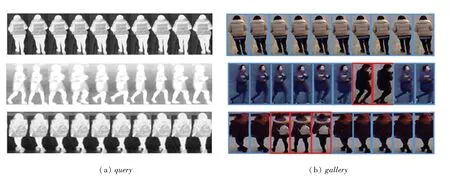

在RegDB数据集上测试时部分图像的识别结果如图13所示。图13中,图13(b)中的蓝色框部分的图像表示识别正确的图像,红色框部分的图像表示识别错误的图像。从识别错误的图像看出,识别错误的RGB图像在轮廓和姿势等方面都比较接近IR图像。

图13 在RegDB数据集上测试时部分图像的识别结果图Fig.13 Plot of recognition results for some images when tested on RegDB dataset

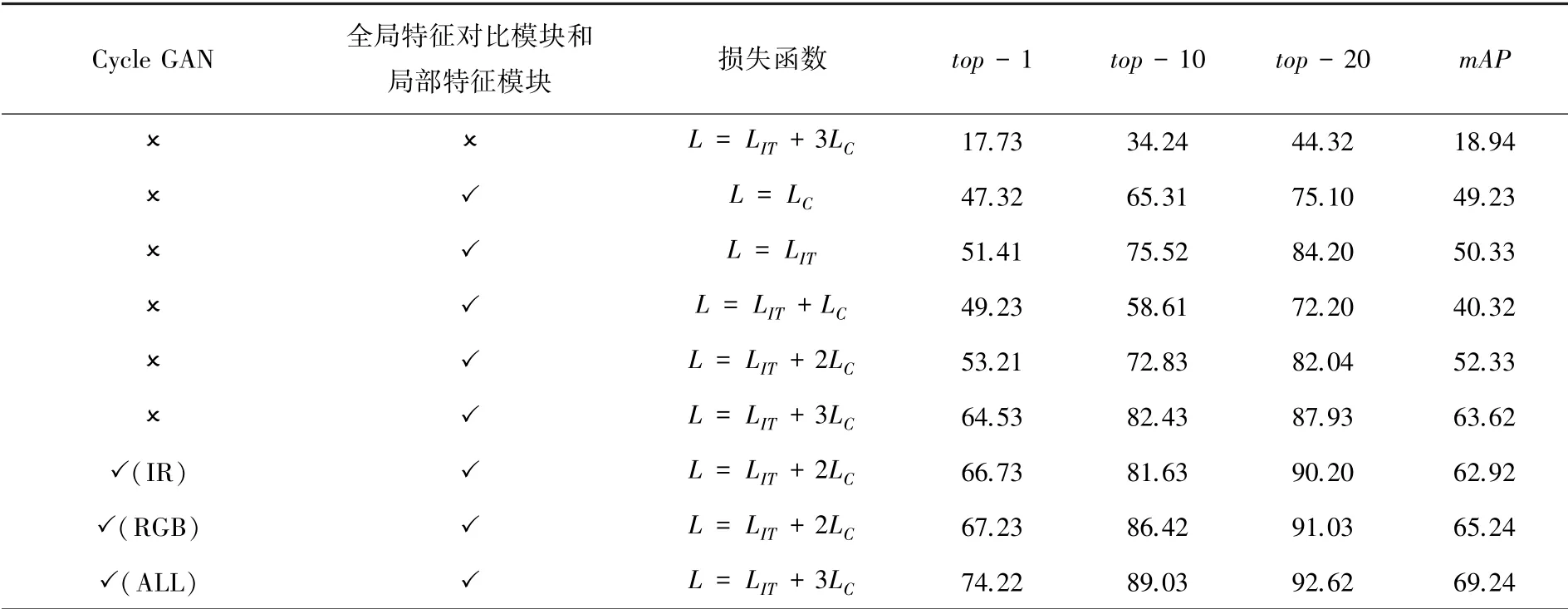

3.2.4 在RegDB数据集上的消融实验结果与分析

数据集RegDB的图像分布比较均匀,没有极低质量的图像,每个行人的图像之间较为相似,姿态变化较小。因此,在数据集RegDB进行消融实验,识别精度和其他方法对比见表3。

表3 在RegDB数据集上消融实验的结果Tab.3 Results of ablation experiments on RegDB dataset %

在消融实验当中,使用原始数据集RegDB训练ResNet50网络得到特征图,将特征图输入全局特征对比模块和局部特征模块,采用参数为3的多损失联合函数进行监督训练,与单独使用ResNet50网络,采用参数为3的多损失联合函数进行监督训练的方法相比,、1、10和20指标都有大幅度的提高,证明了全局特征对比模块和局部特征模块有助于提高模型的精度。

使用原始数据集RegDB训练ResNet50网络得到特征图,将特征图输入全局特征对比模块和局部特征模块,采用参数为3的多损失联合函数进行监督训练。和使用单个的交叉熵损失或改进的三元组损失监督训练的方法相比较,1指标分别从4732、5141提高到6453;10指标分别从6531、7552提高到8243;20指标分别从7510、8420提高到8793;值则分别从4923、5033提高到6362,证明了本文的参数为3的多损失联合函数有助于提高模型的精度。

本文方法(IR)和本文方法(RGB)是使用Cycle GAN网络将数据集分别转换为IR图像和RGB图像,输入到ResNet50网络得到特征图,将特征图输入全局特征对比模块和局部特征模块,采用参数为2的多损失联合函数进行监督训练,和不使用Cycle GAN网络对数据集转换的方法相比较,1指标从5321分别提高到6673和6723;10指标从7283分别提高到8163和8642;20指 标从8204分 别提高 到9020和9103,接近本文方法(ALL)的9262;值从5233分别提高到6292和6524,证明本文使用Cycle GAN网络将RegDB数据集统一转换为RGB图像或IR图像的方法同样对模型的识别精度有一定程度的提高。

本文方法(ALL)和不使用Cycle GAN网络对数据集扩充和转换的方法相比较,1指标从6453提高到7422;10指标从8243提高到8903;20指标从8793提高到9262,指标从6362提高到6924,证明了采用Cycle GAN网络扩充和转换的数据集,对于网络模型的识别精度有较大程度的提高,同时也验证了本文方法(ALL)的有效性。

4 结束语

本文提出了基于全局和局部特征的跨模态行人重识别方法。使用Cycle GAN网络对数据集扩充和转换,来降低同一行人的RGB-IR图像的姿态变化带来的影响;全局特征对比模块和局部特征模块分别降低图像噪声和行人遮挡现象带来的影响;将改进的三元组损失和交叉熵损失以比例加和的形式作为多损失联合函数,进行监督训练;探索多损失联合函数参数取不同的值,对模型精度的影响;分别采取RGB图像和IR图像联合实验、RGB图像转换为IR图像实验、IR图像转为RGB图像实验。在当前的SYSU-MM01、RegDB数据集上与当前多数方法相比,识别准确率有一定程度的提升。通过消融实验论证了Cycle GAN网络不论是数据集的扩充,还是将其统一转换为RGB图像或IR图像,对于网络模型的识别精度都有一定程度的提升。但是,Cycle GAN网络在IR图像转换为RGB图像时,转换的图像有一定的失真,噪声也较大;单流网络架构对于RGB-IR图像的跨模态行人再识别存在一定的局限性。因此,生成对抗网络对于RGB-IR图像数据集的扩充和转换、图像噪声的抑制、更好的网络模型及损失函数的探索可能是未来RGB-IR图像跨模态行人再识别研究的热点。