基于MDSCLDNN-HAN的调制识别算法

李天宇,侯 进,李昀喆,郝彦超

(1.西南交通大学 信息科学与技术学院 智能感知智慧运维实验室,四川 成都 611756;2.西南交通大学 唐山研究院,河北 唐山 063000;3.西南交通大学 综合交通大数据应用技术国家工程实验室,四川 成都 611756)

0 引言

无线信号调制识别在各种领域都有着重要的应用。在信号调制自动识别的研究中,主要有3个技术方向:一是基于决策理论的调制模式识别;二是基于统计机器学习理论的调制模式识别;三是基于深度学习的调制模式识别[1-3]。

随着深度学习在各个领域中展现的突出性能,O’Shea等[4-8]首次将卷积神经网络(Convolutional Neural Network,CNN)应用于调制识别领域,并提出了公开调制信号数据集RadioML2016.10a。

文献[9]设计了基于CNN的长短期记忆(Long Short-Term Memory,LSTM)全连接深度神经网络(Convolutional Long Short-Term Memory Fully Connected Deep Neural Networks,CLDNN)模型,文献[10]设计了一种时空多通道网络(Multi-Channel Convolutional Long Short-Term Memory Fully Connected Deep Neural Networks,MCLDNN)模型,文献[11]提出了Dual-CNN-LSTM模型,使用信号的同相正交(In-phase Quadrature,IQ)数据和幅度相位(Amplitude Phase,AP)作为输入。文献[12-14]将信号数据进行预处理转化为星座图、时频图等图像数据,使用图像分类的深度学习算法对调制信号进行分类。以上研究,在调制信号识别精度上表现出较好的性能,但都存在模型参数量和复杂度过大的问题,难以在实际通信环境中应用。

针对以上问题,设计了一种改进的MCLDNN模型——MDSCLDNN-HAN(Multi-Channel Depthwise Separable Convolution Long Short-Term Memory Dense Neural Network with Hierarchical Attention Networks),该模型中使用深度可分离卷积(Depthwise Separable Convolution,DSC)代替标准卷积,同时引入了分层注意力机制(Hierarchical Attention Networks,HAN),识别精度略优于现有模型,同时参数量和计算量大量减少。

1 算法建模

1.1 数据处理

本文算法模型考虑单输入单输出通信系统,使用信号的原始IQ数据和AP数据作为输入。接收信号r(t)可表示为:

(1)

接收信号r(t)由同相分量rI和正交分量rQ组成,离散信号r[n]可以表示为:

(2)

信号的AP数据计算如下:

(3)

(4)

式中,XA[n]为信号的幅度;XP[n]为信号的相位。

1.2 MDSCLDNN-HAN模型框架

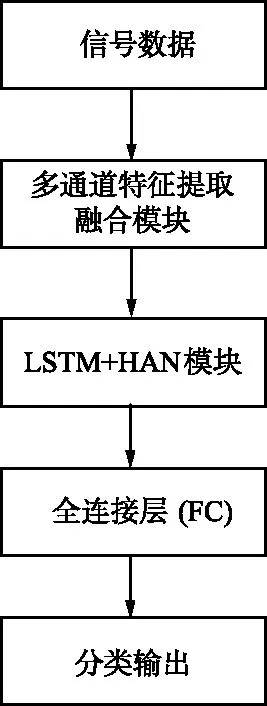

MDSCLDNN-HAN模型框架如图1所示,分为多通道特征提取融合模块、LSTM-HAN模块和全连接层3个模块,利用模块间的互补性和协同性,对时域和频域特征进行提取融合,最后将调制信号进行分类。

图1 MDSCLDNN-HAN模型框架Fig.1 Framework of MDSCLDNN-HAN model

1.3 多通道特征提取融合模块

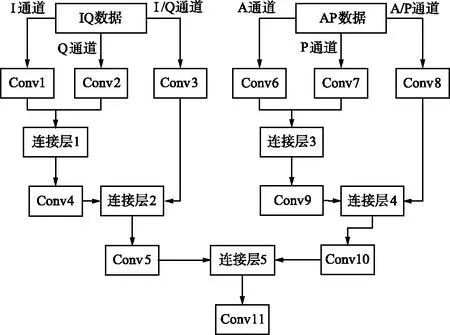

多通道特征提取融合模块网络结构如图2所示,由3个一维卷积层和2个二维卷积层组成。首先,将信号IQ数据分为独立的I通道、Q通道和I/Q通道分别输入Conv1,Conv2和Conv3,学习信号数据的单通道和多通道特征。然后在连接层1中对单通道特征进行融合,在连接层2中对单通道和多通道特征进行融合提取并输入Conv5。信号的AP数据采用与IQ数据同样的卷积模块进行特征提取,在连接层5处将IQ和AP数据的特征输出进行融合,再通过Conv11进行特征提取后送入下一模块。模块有效利用了信号的IQ数据和AP数据,同时设计使用分离通道,有效提取不同尺度下输入的特征。

图2 多通道特征提取融合模块结构Fig.2 Structure diagram of multi-channel feature extraction and fusion module

为加快网络的训练和收敛的速度,控制梯度爆炸,防止梯度消失、过拟合,每层DSC后加入了批归一化层(Batch Normalization,BN),使用线性整流函数(Rectified Linear Unit,ReLU)作为激活函数。该模块卷积层参数如表1所示。

表1 多通道特征提取融合模块参数

DSC具有参数量少和计算量小的优点,本模块使用DSC层代替标准卷积层。

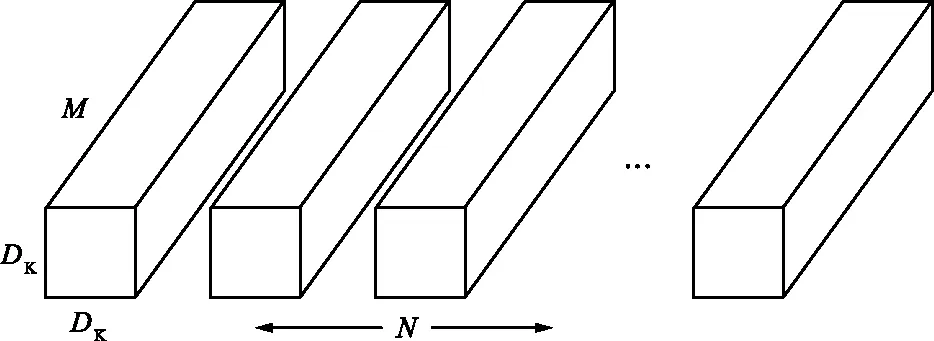

文献[15]提出使用DSC层替代标准卷积层。在标准卷积层中,卷积滤波器同时学习空间和通道相关性。DSC将上述过程分解为2层。在第1层中,使用标准的深度(通道)卷积以学习空间相关性;在第2层逐点卷积(1×1卷积),通过组合第1层的输出来学习通道相关性。标准卷积层和DSC层滤波器如图3所示。

(a) 标准卷积滤波器

(b) 深度可分离卷积滤波器

(c) 逐点卷积图3 标准卷积层和DSC层滤波器Fig.3 Schematic diagram of standard convolution and depthwise separable convolution filters

标准卷积层和DSC层参数量为:

P=(DK×DK×M)×N,

(5)

P=(DK×DK×M)+M×N,

(6)

式中,P为参数量;DK为输出特征图的大小;M为输入通道的大小;N为输出通道的大小。

标准卷积与DSC的参数量之比为:

(7)

可以看出,DSC层的参数量较标准卷积减少许多。

1.4 LSTM-HAN模块

LSTM是一种特殊的循环神经网络(Recurrent Neural Network,RNN),擅长处理具有时间序列关系的数据,可以有效提取数据中的时序特征。LSTM的计算如下:

it=σ(Wxtxt+Whiht-1+bi),

(8)

ft=σ(Wxfxt+Whfht-1+bf),

(9)

ot=σ(Wxoxt+Whiht-1+bo),

(10)

(11)

(12)

ht=ot·tanh(ct),

(13)

式中,it,ot,ft分别为输入门、输出门和遗忘门当前状态;W为权重;b为偏差;σ为Sigmoid函数。

近年来,注意力机制广泛应用于自然语言处理、图像识别和文本处理等领域[16]。文献[17]提出了一种用于文档分类的HAN网络结构。HAN通过在词层级和句子层级中使用注意力机制,找到对句子特征贡献最大的词语和对整篇文本特征贡献最大的句子,提取整篇文本中的高频特征。通过加大高频特征的权重和抑制低频特征的权重来提高神经网络的特征提取能力。

本文所提模型中使用一层单元数为128的LSTM层,为进一步提取信号的高频特征,在LSTM层后加入HAN网络结构,从而提升网络性能。

1.5 输出层

本文模型中,信号数据经过多通道特征提取融合模块和LSTM-HAN模块的特征输出,输入到一层单元数为64,使用ReLU激活函数的全连接层进行降维得到特征节点,再将特征节点输入到使用Softmax激活函数的全连接层进行分类,得到调制信号最终的分类结果。

2 实验结果及性能分析

2.1 实验数据

实验使用开源数据集RadioML2016.10a和RadioML2016.10b。RadioML2016.10a中共有220 000个调制信号,包含了WBFM,AM-DSB,AM-SSB,BPSK,CPFSK,GFSK,4-PAM,16-QAM,64-QAM,QPSK和8PSK等11种常见调制信号。RadioML2016.10b是RadioML2016.10a的更清晰、规范的拓展版本,每种信号数量是RadioML2016.10a的6倍,共有1 200 000个调制信号,不包含AM-SSB信号。二者中信号数据的信噪比取值在-20~18 dB,信号数据为IQ数据,数据格式为128×2的浮点数字。为模拟现实环境,信号数据在考虑了AWGN、多径衰落、采样率偏移和中心频率偏移等恶劣的传播条件下,使用GNU Radio模拟生成。2个数据集都是按照6∶2∶2的比例划分成训练集、测试集和验证集进行实验和测试。

2.2 实验环境

实验使用了Python3.8编程语言和TensorFlow 2.5内置的Keras框架搭建神经网络模型,使用NVIDA RTX 3080Ti GPU进行训练和测试。软硬件详细信息如表2所示。

表2 实验软硬件详细信息

2.3 消融实验

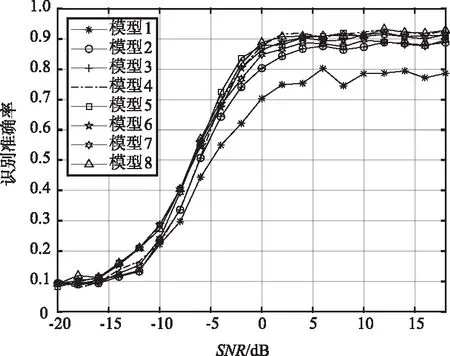

为验证MDSCLDNN-HAN模型中各模块对网络模型的影响,在RadioML2016.10a数据集上,使用8种模型进行消融实验。模型1~6使用IQ数据作为输入,模型7使用AP数据作为输入,模型8使用IQ数据和AP数据作为输入。8种网络模型识别准确率、参数量和计算量如表3所示,其中计算量使用指浮点运算数(Floating Point Operations,FLOPs)衡量,单位为百万(M)。图4展示了不同信噪比下各网络模型识别准确率。

表3 基于RadioML2016.10a数据集的消融实验

图4 基于RadioML2016.10a的消融实验识别准确率Fig.4 Ablation experiment recognition accuracy curve based on RadioML2016.10a dataset

模型1使用由2层卷积层构成的CNN做基础网络架构。模型2在模型1后加入LSTM层,学习信号的时域特征,识别准确率较模型1提升5.2%。模型3在LSTM模块后加入全连接层,可以将特征空间映射到更容易分类的输出层,识别准确率较模型2提高1.5%。模型4在模型3的基础上增加信号的分离通道I通道和Q通道,通过学习I通道、Q通道和IQ通道的互补信息,识别准确率较模型3提高3%。模型5加入了HAN网络结构,进一步学习IQ信号数据的高频特征,识别准确率达到62.5%。由于使用了DSC,模型6识别准确率较模型5下降0.6%,这是因为使用DSC提取特征时,会较标准卷积层缺失部分特征,但同时模型6的参数量和计算量较模型5分别下降49%和87%。模型7网络结构与模型6一致,只是输入数据改用AP数据,会缺失部分信号特征,故模型7识别率下降2.6%,AP数据较IQ数据会缺失部分信号特征。

模型8使用IQ和AP数据和它们的分离通道共六通道作为输入,IQ,AP数据提取的特征节点通过连接融合后,通过一层卷积核数较小的DSC层进行降维,模型8的参数量和FLOPs分别是模型5的59%和44%,识别准确率达到62.9%,略优于模型5。

2.4 对比实验

为进一步验证本文模型的性能,使用Radio-ML2016.10a和RadioML2016.10b数据集,选取了文献[9]的CLDNN、文献[10]的MCLDNN和文献[11]的Dual-CNN-LSTM 4种模型进行对比实验。文献[9]的CLDNN模型使用3层卷积层、1层LSTM层和1层全连接层,卷积核数设置为50,卷积核大小分别为(2,7),(1,7)和(1,7),LSTM的单元参数设置为250,全连接层单元数设置为128。文献[10]的MCLDNN模型将IQ数据分为3路输入进网络,通过卷积层对信号特征进行提取融合,经过2层LSTM和2层全连接层输入Softmax层进行分类输出。文献[11]的Dual-CNN-LSTM模型使用了2路CNN-LSTM网络结构,将信号的IQ数据和AP数据分2路输入网络。每一路CNN-LSTM网络都由3层卷积层和2层LSTM层组成。卷积层卷积核数分别为256,256和80,卷积核大小为(1,3),(2,3)和(1,3),LSTM层的单元数分别设置为100和50,通过扁平层后,2路特征输出在连接层融合,最后通过全连接层和Softmax层进行分类输出。

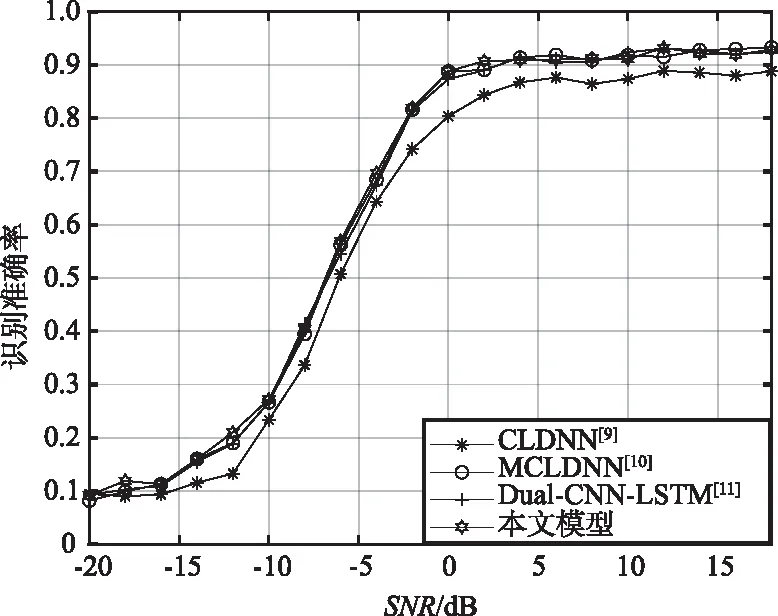

4种模型在RadioML2016.10a上的实验结果和识别曲线如表4和图5所示。在RadioML2016.10a数据集上,文献[9]模型的识别准确率为58.1%,当SNR在0 dB以上时模型的识别准确率为86.3%,明显低于其他网络模型。文献[10]的MCLDNN模型识别准确率达到62.7%,SNR在0 dB以上识别准确率达到91.4%,文献[11]的Dual-CNN-LSTM模型识别准确率和SNR在0 dB以上识别准确率分别为62.1%和90.8%。本文模型识别准确率为62.9%,SNR在0 dB以上识别准确率为91.6%,2项识别准确率略高于文献[10]的62.7%和91.4%。

表4 基于RadioML2016.10a数据集的对比模型实验结果

图5 RadioML2016.10a数据集上对比模型识别准确率Fig.5 Comparison of model recognition accuracy curves based on RadioML2016.10a dataset

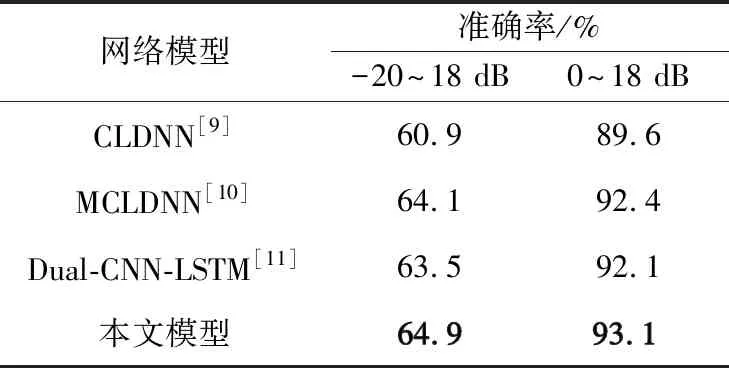

4种模型在RadioML2016.10b数据集上的实验结果和识别准确率曲线如表5和图6所示。在RadioML2016.10b数据集上,文献[9]模型识别准确率最低,只有60.9%,本文模型识别准确率达到64.9%,比文献[10]高0.4%,比文献[11]高0.6%。SNR在0 dB以上时,本文所提模型识别准确率稳定在92%以上。

表5 基于RadioML2016.10b数据集的对比模型实验结果

图6 RadioML2016.10b数据集上对比模型识别准确率Fig.6 Comparison of model recognition accuracy curves based on RadioML2016.10b dataset

4种模型的参数量和计算量如表6所示。文献[9]模型的参数量超过69万,FLOPs为13.1 M。文献[10]使用的MCLDNN模型设计了3路输入,参数量超过40万,FLOPs为35.8 M。文献[11]模型使用的Dual-CNN-LSTM模型同时将信号的IQ和AP数据送入神经网络模型,取得了较好的识别准确率,但同时牺牲了模型的参数量和计算复杂度,模型参数量超过118万,FLOPs超过285 M。本文所提模型通过使用DSC和参数优化,使用6路输入设计,在模型的识别准确率优于其他模型的同时,本文所提模型的参数量和FLOPs远小于文献[9-11]的模型。本文所提模型的参数量为113 497,仅为文献[10]的34.3%,文献[11]的11.7%,模型的FLOPs为8.4 M,是文献[10]的23.4%,文献[11]的2.9%。

表6 对比模型参数量和计算量

在所有文献提供的模型中,文献[9-10]中所提供的模型结构都存在一定缺陷和不足,文献[9]中提到的CLDNN仅在原始CNN网络中加入了LSTM结构,虽然该模型有效提高对时序特征的学习,但是原始信号存在I,Q两个通道,不同通道间的特征信息存在差异,而仅使用CLDNN模型难以对2个不同通道数据的特征各自进行提取,因此在文献[10]中设计了MCLDNN模型,针对这一问题进行了相应的改进。但是文献[9-10]都存在参数量较大的问题,会大大降低模型的运行效率,在硬件设备性能较差时,模型的实时性难以得到保证。

文献[11]在原始IQ数据的基础上,加入AP数据用于提取新的特征,该方式虽然有效提高了信号的识别率,但是该模型也存在参数量过大等问题。因此在综合考量各模型优势及缺点后,本文提出了一种新型的低参量模型,该模型在保持较高识别率的前提下,大大降低了模型的参数量和模型复杂度。

2.5 MDSCLDNN-HAN性能分析

MDSCLDNN-HAN模型在0 dB时,对Radio-ML2016.10a中各类信号识别准确率如图7所示。

图7 RadioML2016.10a,SNR=0 dB,混淆矩阵Fig.7 Confusion matrix based on RadioML2016.10a dataset,where SNR=0 dB

由图7可以看出,WBFM的识别准确率最低,只有33%,其中有67%的WBFM信号被错误地识别成AM-DSB信号。对8PSK,AM-DSB,QAM16和QAM64四种信号识别准确率均达到86%以上,对AM-SSB,BPSK,CPFSK,GFSK,PAM4和QPSK六种信号识别准确率均达到94%以上。

MDSCLDNN-HAN模型在0 dB时,对Radio-ML2016.10a中各类信号识别准确率如图8所示。由图8可以看出,当SNR=10 dB时,本文模型在RadioML2016.10a中,对WBFM识别准确率较低,少部分QAM64信号被识别成QAM16信号,除WBFM和QAM64以外的信号识别准确率均超过98%。

图8 RadioML2016.10a,SNR=10 dB,混淆矩阵Fig.8 Confusion matrix based on RadioML2016.10a dataset,where SNR=10 dB

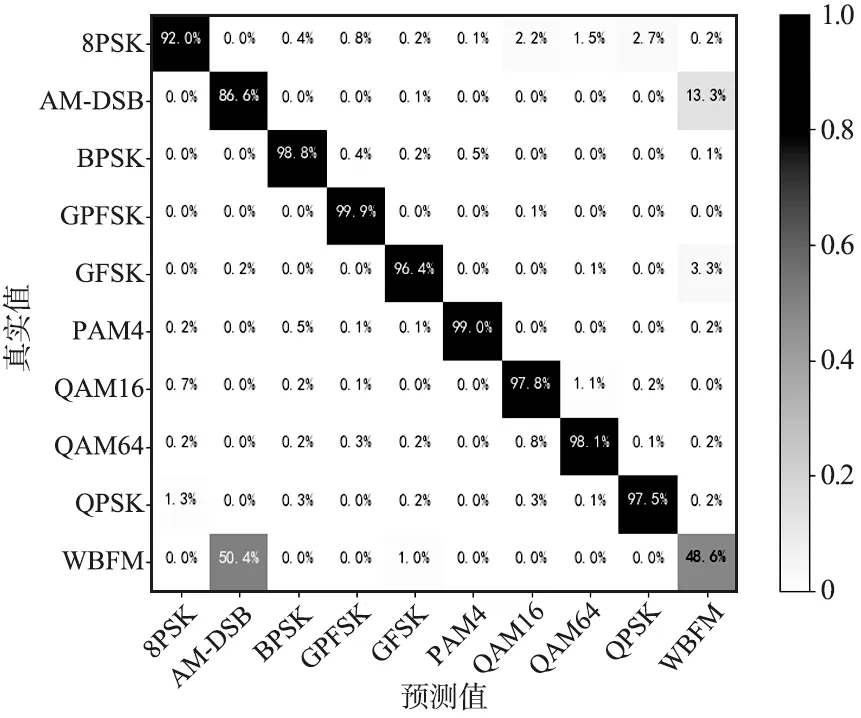

模型对RadioML2016.10b中各类信号在SNR=0 dB时识别准确率混淆矩阵如图9所示。本文模型对WBFM的识别准确率最低,只有48.6%,对8PSK,AM-DSB信号识别准确率分别达到92%和86.6%,对BPSK,CPFSK,GFSK,PAM4,QPSK,QAM16和QAM64七种信号识别准确率均超过96%。

模型对RadioML2016.10b中各类信号在SNR=12 dB时识别准确率混淆矩阵如图10所示。模型对除WBFM外的9种信号识别准确率均超过98.5%。

图9 RadioML2016.10b,SNR=0 dB,混淆矩阵Fig.9 Confusion matrix based on RadioML2016.10b dataset,where SNR=0 dB

图10 RadioML2016.10b,SNR=12 dB,混淆矩阵Fig.10 Confusion matrix based on RadioML2016.10b dataset,where SNR=12 dB

在对2个数据集的实验中,均出现将大量WBFM信号错误地识别成AM-DSB信号,SNR在0 dB以上时,模型对除WBFM的各类信号实现较高的识别精度。由于AM-DSB和WBFM信号都属于连续调制,因此它们之间的特征区别较小。此外,数据集中WBFM和AM-DSB是通过采样模拟音频信号生成的,数据中间存在信号的静默期导致2种信号更加难以区分,即使随着SNR的提高,WBFM的识别精度依然不能达到理想精度。如何使用深度学习的方法提高WBFM信号的识别精度,是后期需要改进的方向。

3 结束语

针对目前基于神经网络的调制识别算法中神经网络模型复杂和计算量大等问题,设计使用IQ和AP数据的6通道神经网络模型MDSCLDNN-HAN,使用信号的IQ和AP数据和其分离通道数据,有利于获得更有效的特征对信号进行分类。同时,在模型中使用注意力机制提取高频特征,使用DSC层代替普通卷积层,减少模型参数量和计算量。理论分析和实验结果表明,设计高效的模型结构和使用信号不同维度的数据提取融合特征,可以有效提高模型识别精度和降低模型复杂度。