基于改进语义分割模型的无人机多光谱图像杂草分割

徐国钦 黄明凤 黄建平

摘要:杂草与作物争夺肥料、阳光等养分,从而影响作物生长,快速有效地清除杂草危害对提高作物的产量和品质具有重要意义。传统的杂草防治方法常采取大面积喷洒除草剂等措施,无法满足智慧农业的精细化管理要求,精确、可靠的杂草检测是智能除草的关键。在卷积神经网络模型PANet的基础上进行改进,把原始特征提取网络ResNet替换为DenseNet-12 采用FPA模块提供像素级注意力信息,通过金字塔结构增加感受野。以无人机多光谱糖菜杂草图像为研究对象,分别构建近红外790 nm、红色690 nm和归一化植被指数NDVI的训练数据集进行网络训练。发现PANet的训练精度为97.38%,测试精度为93.41%;采用3通道(近红外790 nm+红色690 nm+NDVI)训练的模型F1值最高为0.872。结果表明,该方法可以实现无人机多光谱图像杂草的有效分割,可为农田杂草精确检测和农作物生长状况监测提供参考和借鉴。

关键词:杂草;改进语义分割模型;无人机;多光谱;图像分割;植被指数

中图分类号:TP391.41 文献标志码: A

文章编号:1002-1302(2022)12-0212-08

收稿日期:2022-01-04

基金项目:黑龙江省自然科学基金(编号:TD2020C001);中央高校基本科研业务费专项(编号:2572019CP19)。

作者简介:徐国钦(1996—),男,辽宁鞍山人,硕士研究生,主要从事检测技术与自动化装置研究。E-mail:xuguoqin0609@163.com。

通信作者:黄建平,副教授,博士生导师,主要从事视觉检测、图像处理研究。E-mail:jphuang@nefu.edu.cn。

世界人口将在21世纪下半叶达到100亿以上,世界人口快速增长对粮食农作物和资源的需求量越来越大[1];到21世纪中叶,自然资源的耗竭速度将是目前的3倍以上[2]。为了使农产品满足人口不断增长的需求,利用现代化技术手段实现农业产量和质量的最大化是有效的解决途径。农田杂草与作物争夺肥料、阳光等养分,从而影响作物的生长,快速有效地清除杂草危害对提高作物的产量和质量具有重要意义[3]。传统的杂草防治方法主要包括耗时费力的人工除草、大面积农田喷洒除草剂的化学除草等,不能解决作物和杂草共生相互遮挡的问题,无法满足智慧农业精细化管理的需求[4](图1)。随着机器人和计算机技术的进步,采用图像处理技术的智能农业机械装备如田间除草机器人[5-6]等取得了快速的发展,能够实现选择性除草、特定点除草剂喷涂和智能机械锄草等精准除草方式,可以有效降低农药的危害,提高农产品的品质[7-9]。

精确、可靠的杂草检测是智能除草的关键[10]。毛文华等利用苗期田间作物的位置特征,提出一种基于机器视觉的分割苗期田间杂草算法[11]。胡波等通过引入像素灰度级和邻域灰度级构成二维直方图,提出一种杂草彩色图像分割算法,提高了杂草的识别率[12]。胡盈盈等采集玉米和杂草的光谱信息,筛选出有效特征波段并带入到贝叶斯判别模型中,进而实现快速准确识别玉米田间杂草[13]。马兆敏等提出一种基于BP神经网络的杂草分割方法,该方法利用Bayes理论获得颜色空间中非线性最优分割曲面,减小了分割误差[14]。为进一步提高杂草的识别性能,邓向武等提出基于植物叶片形状、纹理及分形维数等多特征融合的杂草识别方法[15-17]。传统的计算机视觉和图像处理方法在杂草检测和分割上取得了较好的效果,但农作物和杂草边界存在一定的模糊性,给精准杂草检测和分割带来了挑战。随着机器学习的发展,基于数据驱动的深度学习技术被应用于植物物种分类、植物病虫害检测和杂草识别等农林邻域[18-20]。深度学习方法利用空间和语义特征可以有效提高杂草识别和检测的准确性。温德圣提出基于Faster-RCNN模型的复杂特征杂草准确分类及定位方法,并与SSD、TOLOv3方法以及VGG16、VGG19、ResNet50、ResNet101这4种卷积模型进行对比,发现该方法具有更高的杂草识别率[21]。Sa等通过训练密集语义分割模型SegNet实现了无人机多光谱图像杂草的

准确分割[22]。姜红花等采用基于Mask R-CNN的杂草检测方法提高了田间复杂环境下杂草的分割精度,并利用该方法设计农药变量喷洒装置实现了农药的精准喷洒[23]。孙俊等通过融合近红外与可见光图像构建多通道输入并采用深度可分离卷积的方法,减少了环境对分割效果的影响,并提高了分割精度[24]。Khoshboresh-Masouleh等开发出一种轻量级的、端到端可训练的无人机多光谱影像分割方法,实现了甜菜田间杂草的准确分割[25]。Su等提出一种基于随机图像裁剪和修补(RICAP)方法的新型数据增强框架,该框架能够有效地用于语义分割任务的数据增强,可以解决作物和杂草分类过程中过度拟合的问题[26]。Zhang等提出一种结合改进Grabcut算法、自适应模糊动态k-means算法和稀疏表示分类(SRC)的杂草物种识别方法,该方法不需要人工交互,能自动分割背景并有效识别杂草种类[27]。本研究对语义分割模型PANet进行改进,并将其应用于无人机多光谱影像的杂草分割。利用无人机搭载多光谱传感器在使用不同除草剂用量的田地上采集数据,其中包括只有杂草、只有作物和作物杂草混合3种类型的数据集。通过提取归一化植被指数作为地面实况,利用不同输入通道组合训练3种模型,发现该方法可以有效提高杂草-作物多光谱图像的分割效果。

1 数据和方法

1.1 数据采集与处理

本研究采用2017年瑞士苏黎世联邦理工大学采集的甜菜和杂草图像作为数据集[22],该数据集是在苏黎世的农场使用无人机搭载多光谱相机实地高空俯视平行拍摄试验区域的图像,无人机选用DJI Mavic型号搭载SequoIa MultiSpectral四通道多光谱传感器。试验区域为40 m×40 m作物-杂草试验田。将不同剂量的除草剂用于试验区域,将试验区划分为3个部分:默认剂量最大区域只包含作物,中等劑量区域作物杂草混合生长,还有一片区域只有杂草。由于植物的边界很难区分,需要某些领域的专业知识,所以作物-杂草图像的手动标注极具难度。本数据集在植物专家指导下标注了132张作物、243张杂草、90张作物-杂草多光谱图像,包含近红外波段(790 nm)、红色波段(660 nm)和NDVI图像(图2、表1)。其中,NDVI图像来自对应的近红外和红色通道图像。NDVI计算公式为,植被指数NDVI能够清楚地反映土壤和植物之间的差异。数据集中所有图像大小均为640像素×640像素。本研究在训练模型时采用以下方法扩充训练样本数据集。第一,随机裁剪。将输入的图像随机裁剪掉相同的部分。第二,锐化增强算法。去除一些细小的干扰细节和图像噪声,比一般直接使用卷积锐化算子得到的图像更可靠。第三,随机翻转。将图像在竖直、水平方向翻转。第四,随机噪声。在图像中随机加入少量的噪声。该方法对防止过拟合较有效,会让神经网络不能拟合输入图像的所有特征。第五,调整图像对比度与亮度。数据增强示例见图3。D59F83FD-BB1A-4987-968D-15A933D7EE84

1.2 研究方法

本研究提出一种改进语义分割PANet模型的无人机多光谱影像杂草分割方法。将原始主干网络深度残差网络ResNet替换为密集卷积网络DenseNet,减少网络参数量,提高特征利用效率。PANet将注意力机制和空间金字塔结构相结合,以实现提取准确而密集的特征并获取像素标签的功能。具体而言,PANet引入一个特征金字塔注意力模块(Feature Pyramid Attention module),在高层的输出上施加空间金字塔注意力结构,并结合全局池化策略来学习更好的特征表征。此外,利用每个解码器层中的全局注意力上采样模块(Global Attention Upsample module)得到的全局上下文特征信息,作为低级别特征的指导,以此来筛选不同类别的定位细节。提高整个模型对特征图空间信息的利用能力,从而提高图像分割精度(图4)。

1.2.1 密集卷积网络DenseNet-121 本研究对PANet语义分割模型进行修改,把残差网络 ResNet-101替换为DenseNet-121作为主干网络。

DenseNet-121网络与ResNet101网络结构对比见表2。DenseNet-121结构有121层网络,每层之间密集相连,相比ResNet-101网络前者每层学习得到的特征图会作为输入传给后面所有层,这样可以减少大部分计算量和参数量并提高网络的效率。同时,该方法还使用复杂度低的浅层特征,能够更好地解决样本较少时容易产生过拟合的问题。

1.2.2 特征金字塔注意模块FPA 特征金字塔注意(FPA)模块通过实现类似特征金字塔网络的“U”形结构,融合3种金字塔尺度下的特征(图5)。为了更好地提取不同尺度下金字塔特征的上下文信息,本研究在金字塔结构中分别使用3×3、5×5、7×7 的卷积核。由于高层次特征图的分辨率较小,因此使用较大的内核并不会带来太多的计算负担。金字塔结构逐步集成不同尺度下的特征信息,这样可以更准确地结合相邻尺度的上下文特征。经过1×1 卷积后,由卷积神经网络所提取的原始特征通过金字塔注意力特征进行逐像素相乘。此外,还引入全局池化分支来联结输出的特征,这将进一步提高FPA模块的性能。利用空间金字塔结构,FPA可以融合不同尺度的全局信息,对高级特征产生更好的像素级注意力。不同于PSPNet和ASPP模块需要做通道降维,FPA是全局信息与原始特征做逐像素相乘,可以减少大部分计算量。

1.2.3 全局注意力上采样模块GAU 本研究采用全局注意力上采样模块(GAU)。通过全局池化过程将全局上下文信息作为低层特征的指导,来选择类别的定位细节。具体而言,对低层次特征执行 3×3 的卷积操作,以减少卷积神经网络特征图的通道数。从高层次特征生成的全局上下文信息依次经过1×1卷积、批量归一化和相关非线性处理,然后再与低层次特征相乘。最后,高层次特征与加权后的低层次特征相加并进行逐步上采样过程。GAU模块不仅能够更有效地适应不同尺度下的特征映射,还能以简单的方式为低层次的特征映射提供指导信息(图6)。

2 结果与分析

2.1 试验环境与模型参数

本试验于2021年5月在东北林业大学进行。软件环境为:Ubuntu 18.04 LTS 64位操作系统,基于Pytorch(1.4.0)开源深度学习框架并使用Python(Python 3.8)作为编程语言。硬件环境:处理器为IntelCore i7-9700k;计算机内存为16 GB;GPU型号为NVIDIA GeForce RTX 080Ti,11 GB显存,使用CUDA Toolkit10.0和CUDN V7.6.5作为网络模型训练加速工具包。模型训练采用动量为0.8的随机梯度下降算法进行优化,初始学习率为0.00 权重衰减为0.00 以3幅图像为1个批次进行100次完整迭代。使用交叉熵损失函数,类别损失权重分别为0.4、1.0、1.4作为类别平衡。由图7可知,模型的训练损失值和验证损失值随迭代次数增加逐渐降低,没有出现欠拟合和过拟合以及梯度消失等问题。

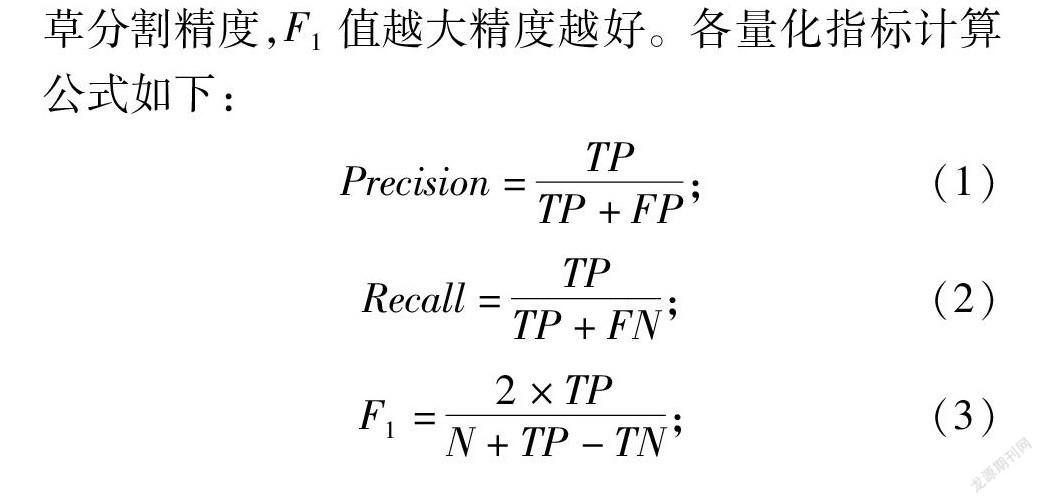

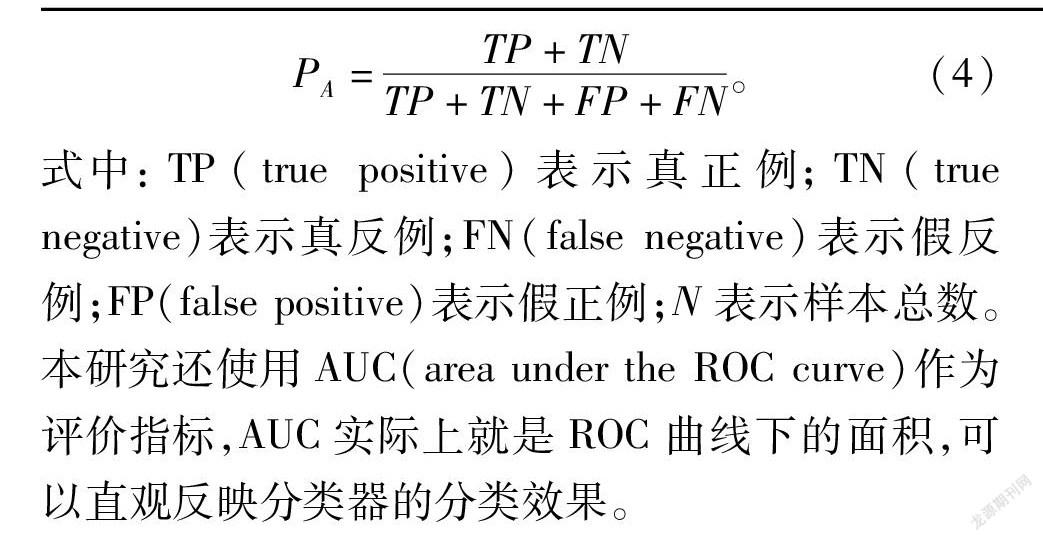

2.2 量化评价指标

为了清晰准确地评估模型对杂草分割的效果,本研究使用像素准确率(pixel accuracy,PA)、精确率(precision)、召回率(recall)和F1值作为评价指标。其中:PA表示像素点分类的精度,用图像中分类正确的像素点数量与像素点总数的百分比来表示,该值越大,说明模型效果越好;Precision是指分割出的杂草区域与实际杂草区域的符合程度;Recall是指正确分割杂草样本数占总样本数的百分比;F1值结合了精确率和召回率,能够更加全面地反映杂草分割精度,F1值越大精度越好。各量化指标计算公式如下:

Precision=TPTP+FP;(1)

Recall=TPTP+FN;(2)

F1=2×TPN+TP-TN;(3)

PA=TP+TNTP+TN+FP+FN。(4)

式中:TP(true positive)表示真正例;TN(true negative)表示真反例;FN(false negative)表示假反例;FP(false positive)表示假正例;N表示樣本总数。本研究还使用AUC(area under the ROC curve)作为评价指标,AUC实际上就是ROC曲线下的面积,可以直观反映分类器的分类效果。

2.3 讨论

本研究对比深度学习中常见的特征提取网络ResNet-18、ResNet-50、ResNet-101与DenseNet-121在测试集上的性能。准确率PA结果见图8,可见本研究采用的DenseNet-121特征提取网络精度最高,相比其他残差网络准确率都有小幅提升。D59F83FD-BB1A-4987-968D-15A933D7EE84

由图9可知,模型的训练精度随迭代次数增加逐渐提高,对于模型的测试精度存在相同规律没有出现欠拟合或过拟合以及梯度消失等问题。总体来看,模型的训练精度和测试精度分别达到97.38%、93.41%。

采用改进PANet方法的不同输入数据3个模型的F1值见图10,其中黄色、绿色和红色条形图显示不同数量输入通道的性能指标,红色条形3通道模型(近红外+红色+NDVI)效果比其他2通道好,对作物杂草分类的性能优于其他模型。由图11可知,该分类器分类效果很好。

使用效果最好的三通道模型对无人机多光谱田间图像进行预测,得到杂草图像分割结果(图12)。其中每行代表1个图像示例,前3列为3通道输入,第四列为标注的地面真值,第五列为分割结果。由图12可知,本研究提出的模型能够较好地分割杂草和作物,无明显误分和漏报现象。但仍可以看到极少数一些边界区域有混合的情况,如图12中分割结果第四行。这通常出现在农作物和杂草彼此包围的时候,说明网络不仅可以捕获低层次的特征,如边缘或强度,还可以捕获物体的形状和纹理。因此,复杂背景下对多目标区域的分割仍需进一步改进。

采用相同的数据集训练DeepLab模型和SegNet模型与本研究方法进行对比,对比结果见图13,可见本研究方法PANet的F1值比DeepLab和SegNet高。由图14可知,其他2种网络分割结果识别不完整、像元出现破碎形状、有椒盐现象产生。

3 结论

本研究采用改进的深度语义分割网络PANet、多光谱图像的光谱值特征和植被指数,对田间农作物杂草分割进行研究。发现近红外波段+红色波段+NDVI组合的模型分割效果最好,训练精度为97.38%,测试精度为93.41%。经过3种模型比较,发现植被指数可以对田间农作物多光谱图像杂草分割起到促进作用。利用多光谱图像技术和改进后PANet卷积神经网络可以在自然环境下实现田间农作物杂草的高精度分割。虽然本研究训练了大量作物和杂草图像的模型,但自然界存在不同类型的杂草和作物模型尚未训练。下一步将构建作物、杂草更丰富的数据集,实现自然环境下杂草的智能准确识别,进而为田间作物杂草侵害程度研究提供技术支持。

参考文献:

[1]梁 强. 人口与经济、环境协调发展问题研究[D]. 大连:东北财经大学,2010:25-28.

[2]周天勇,田 博. 新形势下我国人口与粮食安全战略思考[J]. 中国经济评论,2021(7):36-40.

[3]强 胜.中国杂草生物学研究的新进展[J]. 杂草学报,2018,36(2):1-9.

[4]张朝贤,钱益新,胡祥恩. 农田化学除草与可持续发展农业[J]. 农药,1998,37(4):8-12.

[5]陈子文,张春龙,李 南,等. 智能高效株间锄草机器人研究进展与分析[J]. 农业工程学报,2015,31(5):1-8.

[6]傅雷扬,李绍稳,张 乐,等. 田间除草机器人研究进展综述[J]. 机器人,202 43(6):751-768.

[7]刘成良,林洪振,李彦明,等. 农业装备智能控制技术研究现状与发展趋势分析[J]. 农业机械学报,2020,51(1):1-18.

[8]马 旭,齐 龙,梁 柏,等. 水稻田间机械除草装备与技术研究现状及发展趋势[J]. 农业工程学报,201 7(6):162-168.

[9]权龙哲,肖云瀚,王建宇,等. 智能除草装备苗草模式识别方法研究[J]. 东北农业大学学报,2018,49(9):79-87.

[10]赵 博,王宗甲,周 鹏,等. 智能杂草识别系统的设计与试验(英文)[J]. 农业工程学报,2012,28(增刊2):184-187.

[11]毛文华,王一鸣,张小超. 基于机器视觉的苗期杂草实时分割算法[J]. 农业机械学报,2005,36(1):83-86.

[12]胡 波,毛罕平,张艳诚. 基于二维直方图的杂草图像分割算法[J]. 农业机械学报,2007,38(4):199-202.

[13]胡盈盈,王瑞燕,郭鹏涛,等. 基于近地光谱特征的玉米田间杂草识别研究[J]. 江苏农业科学,2020,48(8):242-246.

[14]马兆敏,黄 玲,胡 波,等. 基于神经网络的杂草图像分割算法[J]. 计算机工程与应用,2009,45(24):216-218.

[15]邓向武,齐 龙,马 旭,等. 基于多特征融合和深度置信网络的稻田苗期杂草识别[J]. 农业工程学报,2018,34(14):165-172.

[16]何东健,乔永亮,李 攀,等. 基于SVM-DS多特征融合的杂草识别[J]. 农业机械学报,2013,44(2):182-187.

[17]赵川源,何东健,乔永亮. 基于多光谱图像和数据挖掘的多特征杂草识别方法[J]. 农业工程学报,2013,29(2):192-198.

[19]刘忠伟,戚大伟. 基于卷积神经网络的树种识别研究[J]. 森林工程,2020,36(1):33-38.

[20]Liu J,Wang X W. Plant diseases and pests detection based on deep learning:a review[J]. Plant Methods,202 17(1):22.

[21]温德圣. 深度学习在复杂特征杂草识别中的研究与应用[D]. 烏鲁木齐:新疆大学,2020:18-20.

[22]Sa I,Chen Z T,Popovic' M,et al. weedNet:dense semantic weed classification using multispectral images and MAV for smart farming[J]. IEEE Robotics and Automation Letters,2018,3(1):588-595.

[23]姜红花,张传银,张 昭,等. 基于Mask R-CNN的玉米田间杂草检测方法[J]. 农业机械学报,2020,51(6):220-228,247.

[24]孙 俊,谭文军,武小红,等. 多通道深度可分离卷积模型实时识别复杂背景下甜菜与杂草[J]. 农业工程学报,2019,35(12):184-190.

[25]Khoshboresh-Masouleh M,Akhoondzadeh M. Improving weed segmentation in sugar beet fields using potentials of multispectral unmanned aerial vehicle images and lightweight deep learning[J]. Journal of Applied Remote Sensing,202 15:34510-034510.

[26]Su D,Kong H,Qiao Y L,et al. Data augmentation for deep learning based semantic segmentation and crop-weed classification in agricultural robotics[J]. Computers and Electronics in Agriculture,202 190:106418.

[27]Zhang S,Huang W,Wang Z.Combing modified grabcut,k-means clustering and sparse representation classification for weed recognition in wheat field-sciencedirect[J]. Neurocomputing,202 452:665-674.D59F83FD-BB1A-4987-968D-15A933D7EE84