单幅图像去雨数据集和深度学习算法的联合评估与展望

胡明娣,吴怡,宋尧,杨静冰,张瑞芳,王红,孟德宇

1.西安邮电大学,西安 710121;2.西安交通大学, 西安 710049

0 引 言

单幅图像去雨任务主要利用雨图呈现的像素空间信息,或利用雨图和相应背景图的视觉属性来构建模型以获得干净背景图。由于时间信息的缺乏,单幅图像去雨任务通常比视频去雨任务更具有挑战性(Yang等,2021)。单幅图像去雨算法一般分为基于模型驱动的传统方法和基于数据驱动的深度学习的方法。基于深度学习的单幅图像去雨算法由于深度网络具有强大的自动特征学习能力,近年来超越了传统的模型驱动方法,吸引了领域研究者的关注(Yang等,2017,2021;Fu等,2017b)。众所周知,提高基于深度学习的单幅图像去雨算法的性能主要聚焦于两大方面:雨图数据质量以及图像去雨算法设计(Wang等,2021c)。关于雨图数据集的构建,Garg和Nayar(2006)首次提出使用粒子模拟器合成雨纹,将雨纹与背景简单叠加合成雨图。此后,陆续有学者提出一些新的合成雨图或雨图渲染方法以增强雨图数据集的表达能力。2019年,Wang等人(2019c)通过半自动的方法构建了较为真实的大规模雨图数据集SPA-Data(spatial attentive data)。因为雨图数据集的质量直接决定算法的去雨性能,因此了解雨图数据集是训练有效的去雨模型的前提之一,构建多样、逼真的雨图数据集也是单幅图像去雨需要研究的重要方向之一。综上,相关雨图数据集的详细调研也是必要的。

算法设计的目标是达成图像有效的去雨效果,理解雨形成的物理机制以及相关领域知识成为非常关键的因素。雨的合成模型、雨图的分解、雨图的空间信息、雨纹或雨滴的掩码、雨纹纹理和背景的先验信息等领域知识显式或隐式引导作用是构建有效的图像去雨算法或合成更逼真雨图的算法模型的核心要素。关于雨滴的建模、雨的物理模型以及雨和背景的相关领域知识详见Yang等人(2021)、Zhang等人(2021e)。为帮助研究者进一步深入理解基于深度学习的单幅图像去雨工作,有必要综述分析算法框架中相关领域知识的指导作用。

图像去雨通常被视为后续学习任务的预处理步骤。这些后续任务包括目标识别、语义分割和深度估计等(Tremblay等,2021),如图1所示。事实上,单幅图像去雨的图像增强技术已应用到机器视觉领域,例如自动驾驶、无人机、监控识别、行人重识别和遥感匹配等场景(Li等,2019c;Jin等,2021)。这些恶劣天气的高层任务(high level task)研究已经被领域学者关注,也是去雨工作的终极目标,比如Li等人(2019c)关注到去雨效果可以由后续高层任务的性能来评判,Jin等人(2021)针对雨天后续高层任务构建了数据集RaidaR(rich annotated image dataset of rainy street scenes)。综述整理雨天后续高层任务相关文献也为去雨研究者提供一个性能标准和底、高层任务相结合的方向。

图1 典型图像去雨后续高层任务(Tremblay等,2021)

算法的性能分析需要公平的评价体系。公平的评价指标能帮助研究者更好地确定算法的优势和局限性,以及未来的研究方向。本文综述了主要的单幅图像去雨算法性能评价指标,也指出公平的评价指标、基准数据集的建立仍是目前图像去雨工作的研究方向之一。

本文对单幅图像去雨相关研究的最具代表性的论文进行介绍。搜索了自2017年以来单幅图像去雨的主流文献,共获取基于深度学习的单幅图像去雨主流算法文献79篇和创建雨图数据集的主流文献23篇,其中4篇仅涉及雨图数据集,此外,综述了涉及雨天后续高层任务的单幅图像去雨研究的文献8篇,关于图像恢复评价指标研究的相关文献13篇。

近年来图像去雨工作已有综述文献6篇(Li等,2019c;Wang等,2019b,2020c;Yang等,2021;Zhang等,2021e;陈舒曼 等,2022)。其中,Wang等人(2020c)综述了视频和单幅图像去雨研究的进展,并对主流方法进行了性能比较分析,特别地,作者建立了一个去雨资料仓库(https://github.com/hongwang01/Video-and-Single-Image-Deraining)。Wang等人(2019b)介绍了单幅图像去雨的研究进展,并提出了一种新型的渐进去雨算法。Li等人(2019c)引入了一个大规模基准数据集MPID(multi-purpose image deraining),较为全面地包含3种类型的合成雨模型(雨纹、雨滴和雨雾),并对6种主流去雨算法进行了全面评估,特别的是此文提出用后续高层任务的性能评价去雨算法性能。Yang等人(2021)从基于模型驱动到数据驱动的角度回顾了单幅图像去雨方法的发展以及深度网络模型构建。Zhang等人(2021e)聚焦于数据驱动的单幅图像去雨,从数据、模型和网络3个因素对其进行分类介绍。陈舒曼等人(2022)介绍了典型的雨图合成模型,从模型驱动和数据驱动分析了典型图像去雨算法,综述了去雨图像质量评价指标及雨图数据集。这些综述论文对于促进现有单幅图像去雨研究的发展具有非常有益的推动作用。

本文除了特别面向中国的读者重新梳理基于深度学习的单幅图像去雨方法以外,与前面的综述论文不同之处在于:1)关于数据集,本文详细介绍了现有雨图数据集的生成与构建方法,并提供数据集的下载信息,以供领域学者方便搜寻使用这些训练集,或借鉴前人的合成手段提出考虑因素更全面准确的合成雨图数据集的方法,构造更逼真多样的雨图数据集以满足当前数据驱动的算法模型训练的需求。2)关于数据集和算法的相互作用,本文综述了数据集的构建方式,关注研究生成去雨循环互促的相关文献,强调雨图数据集质量的提高,有助于相应算法模型的优化,反过来合理有效的生成算法的构建可以渲染得到模型多样、复杂和逼真的雨图数据集。3)关于单幅图像去雨算法的综述,本文特别侧重于介绍领域知识在算法设计中隐式或显式引导作用,强调数据驱动和模型驱动的结合也许是未来值得进一步深入探讨的方向。陈舒曼等人(2022)仅仅是简单地罗列模型驱动和数据驱动的算法,没有涉及二者结合的研究。Zhang等人(2021e)虽然从模型、数据和网络3个因素对算法模型分类整理,也没有涉及隐式或显式的领域知识的嵌入在模型构建中的作用。4)关于雨天后续高层任务,本文详细介绍了单幅图像去雨后续高层任务研究,包括以后续高层任务的性能评价单幅图像去雨算法性能的研究(6篇综述文献中仅有Li等人(2019c)的研究涉及),本文还关注针对后续高层任务的特定任务数据集的渲染技术的研究。5)关于图像去雨算法性能评价指标的研究,6篇综述都有提及,但Li等人(2019c),Wang等人(2019b,2020c),Yang等人(2021)和Zhang等人(2021e)使用这些评价指标来帮助定量评价相关算法的性能,陈舒曼等人(2022)除了对10种算法进行定量比较,也对评价指标做了简单综述,但本文更全面地介绍了通用图像质量评价指标和新型图像评价指标。通用评价指标包括主、客观评价指标。客观评价指标又分为全参考、半参考和无参考评价指标。指出使用近年来新提出的融合评价指标是图像去雨性能评价值得关注的定性评价方法,指出后续高层任务的性能是图像去雨的根本目标所在,也是重要的具有直接实际应用价值的新型任务驱动式性能评价指标。具体来说,本文主要贡献如下:

1)介绍了20个合成雨图数据集和7个真实雨图数据集,依照雨图的获取方式将数据集分成4类,分别介绍了数据集的内容、特征和获取过程等。本文提供了大部分合成雨图数据集的下载地址,致力于为领域学者提供便利。指出真实数据集存在采集代价高,合成数据集存在雨纹种类有限、背景雨纹模型简单、忽略亮度、深度信息等,合成数据集与真实数据集存在较大域的鸿沟。

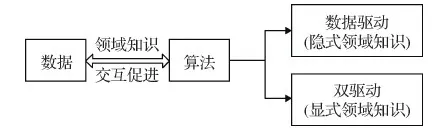

2)重新梳理了当前基于深度学习的单幅图像去雨算法、去雨和雨图生成循环算法的主流文献。首先分析了图像去雨算法针对不同任务场景有监督、半/无监督的学习机制下的基本网络结构。从算法的网络构架出发挖掘出领域知识在算法网络中的隐式或显式融入后有效的指导作用。算法、数据和领域知识的相互关系如图2所示。通过网络结构分析和实验比较得出模型数据双驱动算法因模型约束而避免了过拟合现象的发生,有潜力提高算法的泛化性,未来可能会有更大的发展空间;更全面的先验知识的挖掘也是去雨算法构建的必要基础;多任务统一学习方案较少,但是现实场景需要联合多任务有效解决;循环互促的算法和多阶段的去雨算法会表现出突出的性能。

图2 算法、数据、领域知识的相互关系

3)整理了单幅图像去雨后续高层任务研究的相关文献以及雨图集。指出针对特定场景的数据集的构建和底、高层联合算法的设计都是未来可考虑的方向。因为图像去雨终究是高层任务的预处理过程,结合特定任务的图像去雨是底、高层任务密切结合解决实际需要的有效方案。

1 雨图数据集的生成与构建

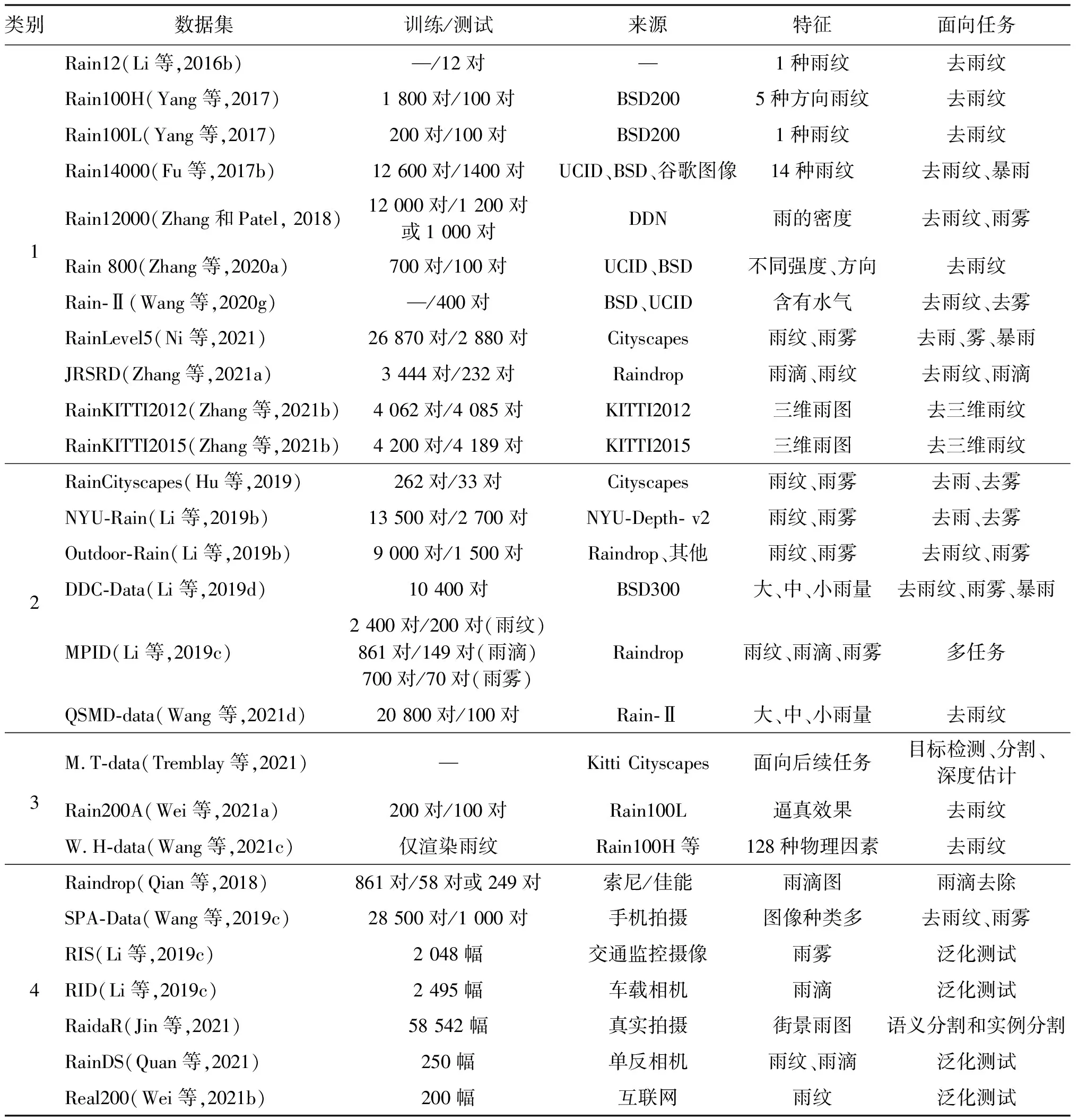

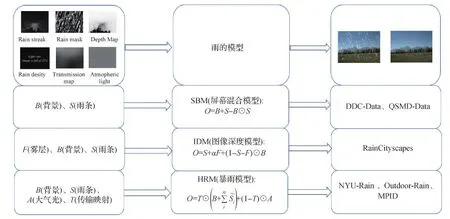

本文调研了23篇合成雨图数据集的研究文献。相关雨图数据集的合成方法、名称和出处、数据集的训练和测试样本数目、来源、特征、面向任务如表1所示。根据雨图获取方式,将这些数据集分为4类:1)基于背景、雨层简单加和的雨图集;2)基于背景、雨层复杂融合的雨图集;3)基于生成对抗网络(generative adversarial network, GAN)数据驱动的合成雨图集;4)半自动获取雨图集。其中,文献未命名的数据集名称本文采用与Zhang等人(2021e)一致的命名方法,或者个别数据集本文用第1作者姓氏命名。同时附上了数据集下载网址(见表2),并且从每个数据集都抽取了一对雨图/干净背景图像在图3进行展示。

图3 数据集的示例图像

表1 典型雨图数据集

表2 数据集网址

1.1 基于背景、雨层简单加和的雨图集

采用基于背景、雨层简单加和或者Photoshop合成的雨图数据集主要有:

1)Rain12(Li等,2016b)由1种类型雨纹和12个背景图像合成12幅雨图像构成的测试集,是成对的雨图集。

2)Rain100H(Yang等,2017)数据集共包含1 900个雨图/干净图对,其中训练集有1 800个图像对,测试集有100个图像对。干净背景图取自BSD200(Berkeley segmentation data)(Arbelez等,2011),合成的雨图包含5个雨纹方向,雨的类型包含雨纹和雨雾。常用做对比数据集。

3)Rain100L(Yang等,2017)数据集共包含300个雨图/干净图对,其中200对用于训练,100对用于测试。干净背景图取自BSD200(Arbelez等,2011),雨纹的合成有两种方法:(1)由图像真实渲染技术合成雨纹;(2)用Photoshop模拟锐利的方向和大小不同的雨纹。每幅雨图只有1种类型的雨纹。虽然这个数据集构建很早,而且雨纹类型单一,但是常用作对比数据集。

4)Rain14000(Fu等,2017b)数据集共包含14 000个雨图/干净背景图像对,其中12 600对用于训练,1 400对用于测试。作者从UCID(uncompressed colour image dataset)(Schaefer和Stich,2003)数据集、BSD(Arbelez等,2011)数据集和谷歌图像搜索收集1 000幅原始干净图,然后用Photoshop来合成雨图,构成成对雨图集。其中每幅干净的背景图叠加14种不同方向和尺度的雨纹合成14幅雨图,雨的类型包含雨纹和雨雾。该数据集广泛用于训练网络模型和评价去雨算法的性能。

5)Rain12000(Zhang和Patel,2018)数据集由训练集和测试集1、2构成。从DDN(deep detail network)(Fu等,2017b)中选取4 000幅干净背景图通过Photoshop软件合成12 000幅标注不同密度(大、中、小)的雨图形成训练集,然后用同样的方法合成1 200幅具有不同方向和尺度的雨纹的雨图构成测试集1,再从Rain14000中随机抽取1 000幅雨图构成测试集2。该数据集广泛用于训练网络模型和评价去雨算法的性能。

6)Rain800(Zhang等,2020a)数据集共包含800对雨图/干净图,其中700对构成训练集,100对构成测试集。训练集的干净图500幅是从UCID(Schaefer和Stich,2003)数据集的前800幅图像中随机选取的,200幅是从BSD-500(Arbelez等,2011)的训练集中随机选取的,测试集的前50幅是从UCID数据集的后500幅图像中随机抽取的,后50幅是从BSD-500数据集的测试集中随机抽取的,然后对干净背景图使用Photoshop添加雨纹得到雨图构成雨图/干净背景图像对。由于它包含了不同密度的雨,雨纹类型丰富而广泛用于算法模型的训练和测试。

7)Rain-II(Wang等,2020g)数据集共包含400个成对的雨图/干净图作为测试集。由来自BSD(Arbelez等,2011)、UCID(Schaefer和Stich,2003)的400幅干净背景图通过Photoshop合成的雨图。

8)RainLevel5(Ni等,2021)数据集包含29 750对雨/干净的图像,26 870 对用于训练,2 880 对用于测试。干净的图像来自 Cityscapes(Cordts等,2016)数据集,使用Photoshop技术合成了 5 个级别(25、50、75、100、200 mm/h)雨量的雨图像。

10)RainKITTI2012/RainKITTI2015(Zhang等,2021b)数据集为立体雨图/干净背景图成对数据集,主要用于3维图像、视频的去雨算法建模。RainKITTI2012(Karlsruhe Institute of Technology & Toyota Technological Institute at Chicago)包含8 147个图像对,4 062对为训练集,4 085对为测试集,RainKITTI2015包含8 389对图像,4 200对为训练集,4 189对为测试集。分别抽取公开立体图像集KITTI2012(Geiger等,2013)、KITTI2015(Geiger等,2013)的干净背景图,然后使用Photoshop合成立体雨图,构成成对立体雨图数据集。主要用于3维立体图像去雨算法的训练和测试。

Garg和Nayar(2006)提出的雨纹真实渲染技术可以合成各种类型的雨纹,然后直接加到相应背景图得到雨图形成成对雨图集。具体过程:1)在两个光源不同角度照明和相机不同方向拍摄的条件下获取真实雨纹;2)依照雨滴建模方程,即

ωn=2π([n(n-1)(n+2)σ]/(4π2ρr03))1/2

(1)

r[t,θ,φ]=r0(1+A2,0sin(ω2t)P2,0(θ)+

A3,1sin(ω3t)cos(φ)P3,1(θ))

(2)

式中,σ为表面张力,ρ为水的密度,θ为角度,φ为方位角,r0为雨滴大小,A2,0,A3,1为振幅,ω3为频率,这几个参数的取值通常通过经验知识进行设置(Garg和Nayar,2006),用式(1)和(2)合成雨纹;3)将合成的雨纹与干净的背景图直加得到雨图。整个流程如图4所示。

图4 雨图合成过程

1.2 基于背景、雨层复杂融合的雨图集

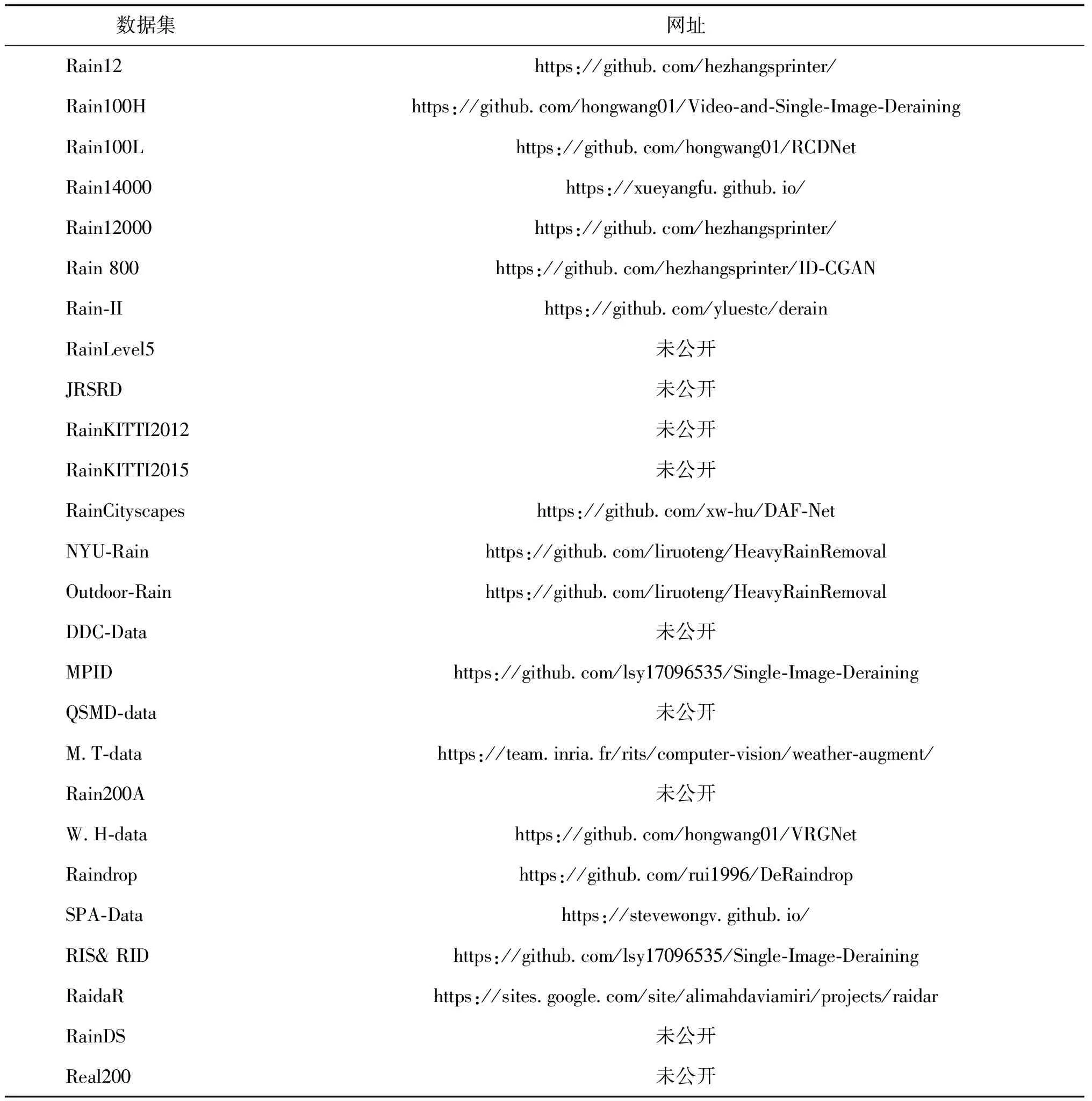

基于背景、雨层复杂融合的雨图数据集合成流程如图5所示。本节使用的雨图合成模型公式与Zhang等人(2021e)一致。

图5 基于雨的模型合成雨图(Zhang等,2021e)

1)DDC-Data(Li等,2019d)数据集包含了10 400对雨/干净背景图像,未划分训练集和测试集。干净背景图来自BSD300(Arbelez等,2011)数据集,雨纹用Photoshop软件添加噪声形成,雨纹具有不同的强度、方向,然后基于屏幕混绕物理模型(screen blend model,SBM)合成雨图。

2)QSMD-Data(Wang等,2021d)数据集包含20 800雨图/干净背景图对作为训练集,100对作为测试集,雨图基于屏幕混绕模型(SBM)合成,此合成数据集选取的背景图覆盖的场景比较丰富。

3)RainCityscapes(Hu等,2019)数据集包含296对雨/干净图像,其中263对用于训练,33对用于测试。先从Cityscape(Cordts等,2016)的训练和验证集中选择263幅训练图像和33幅测试图像作为干净图像,然后采用图像深度模型(image depth model, IDM)合成雨图。这个数据集常用于去雾算法。

4)NYU-Rain(Li等,2019b)数据集包含16 200雨/干净图对,其中13 500对作为训练集,2 700对作为测试集,使用来自NYU(New York University)-Depth-v2(Silberman等,2012)数据集的图作为干净背景图,采用暴雨模型(heavy rain model, HRM)合成数据集,合成的雨图包括雨纹(或称小雨),雨雾,雨的积累(或称大雨),暴雨(或称雨的遮挡(rain occlusion))。这个数据集常常用于网络模型(面向暴雨设计)的训练与测试。

5)Outdoor-Rain(Li等,2019b)采用与NYU-Rain相同的方法合成雨图像,采用HRM模型合成数据集,合成的雨图包括雨纹、雨雾和暴雨。干净背景图来自于Raindrop,该数据集包含9 000个训练样本和1 500个测试样本。

6)MPID(Li等,2019c)是目前包含雨类型较为全面的数据集,共包含5类数据内容:(1)雨纹:训练集包含2 400对雨/干净图像,测试集包含200对,此外还包含50幅真实雨纹测试数据。(2)雨滴:雨滴数据包含861对雨/干净背景图作训练集,149对合成图像作测试集,还包含58幅真实雨滴图像作测试样本,原始图像是从Raindrop数据集中选取;(3)雨雾(雨的累积):训练集包含700对雨/干净背景图像,测试集包含70对测试样本,还包含30幅真实的大雨雨图作测试数据。数据中雨雾通过两步形成,第1步基于大气散射模型添加雾,第2步基于背景雨图直加模型合成雨纹形成有雨有雾的雨图。所有合成雨图相应的干净背景图都是挑选阴天拍摄的户外无雨、无雾的照片,保证合成雨图更加逼真;(4)RID(rain in driving):车载摄像头拍摄的交通雨图;(5)RIS(rain in surveillance):监控摄像头拍摄的雨图。后两个都是不成对的真实数据集,用于评价算法的泛化性和利用面向后续高层任务的性能评价图像去雨算法的性能。

1.3 基于GAN的数据驱动合成雨图集

1)M.T-data(Tremblay等,2021)提出了3种不同的合成雨图方法:(1)基于物理模型(粒子模拟器+光照估计的方法);(2)基于GAN;(3)基于物理模型渲染(physics-based rendering,PBR)和GAN网络相结合的模型数据双驱动方法。在此重点介绍作者提出的第3种模型数据双驱动的方法合成雨图(如图6)。首先通过循环生成对抗网络(CycleGAN)学习雨纹信息,将干净背景图与雨纹融合输出为雨图,然后基于PBR方法控制雨量,生成不同雨量的雨图。作者基于物理模型PBR,分别在现有的数据集KITTI(Geiger等,2012)和Cityscapes(Cordts等,2016)上合成雨图;基于GAN 加PBR的方法在nuScenes(Caesar等,2020)数据集上合成雨图。其中KITTI(Karlsruhe Institute of Technology & Toyota Technological Institute at Chicago)、Cityscapes、nuScenes 数据集的所有图像都是干净的背景图,KITTI数据集标注实例分割基准,Cityscape数据集标注对象边界框,深度映射信息,nuScenes数据集有语义标签。作者将增强后的KITTI、Cityscape、nuScenes数据集用于与后续任务(对象检测、语义分割和深度估计)相关的图像去雨算法模型的训练和测试,通过平均精度均值(mean average precision, MAP),平均精度(average precision, AP),平方相对误差(squared relative error, Sq.Rel)评价指标,证实了基于作者增强后的数据集训练的算法性能都有很大提高。

图6 雨图合成过程(Tremblay等,2021)

2)Rain200A(Wei等,2021a)数据集包含200个成对雨/干净背景图像。雨图由无监督学习的有约束的CycleGAN网络合成(对应算法称为DerainCyclcleGAN),利用了迁移学习能力和循环结构,Rain200A包含更多类型的雨纹,视觉效果更逼真。文中设计的循环网络既可以生成雨图又可以去雨。该网络有两个分支:(1)真实雨图到合成雨图的循环一致性分支,由真实雨图生成无雨背景图,然后又由生成器再次重建雨图;(2)真实无雨背景图到生成无雨背景图的循环一致性分支,其中由无雨背景图生成雨图,然后由生成器重建无雨背景图。这两个分支之间由无监督学习注意力提取器模块迁移领域信息,该模块负责循环提取雨纹掩码。如图7所示,将真实无雨背景图和第2分支中间输出的合成雨图一起构成Rain200A的成对样本。事实上,在本文整理的文献中,涉及雨生成和去雨循环互促的网络模型的文献有6篇(Jin等,2019;Zhu等,2019;Ni等,2021;Ye等,2021;Wei等,2021a,b),但是只有少数文献将输出雨图与输入的无雨图构成成对数据集。因为GAN生成的雨图中雨纹、雾和光都是从真实雨图中自动学习得到的,因此合成的雨图的雨纹类型更具有多样性,合成雨图的视觉效果更显逼真。

图7 雨图合成过程(Wei等,2021a)

3)W.H-data(Wang等,2021c)为探索雨图的物理机制,在贝叶斯框架下构建了雨图像生成模型,把雨层隐式建模为一个生成器(雨层可看做一些潜在变量如方向、大小和厚度等的函数),采用模型加数据驱动的方法在变分推理框架下学习雨纹和背景的统计分布,然后利用学习后的生成器生成种类多样、不重复的雨纹。作者在实验中将合成的雨纹添加到Rain100L,Rain100H,Rain1400数据集上,然后在增强后的雨图集上训练去雨算法,通过峰值信噪比(peak signal-to-noise ratio, PSNR),结构相似性(structural similarity, SSIM)评价指标值,可以看出所有的算法性能都有显著提高,合成过程如图8所示。

图8 雨图合成过程(Wang等,2021c)

1.4 半自动采集的真实雨图数据集

半自动获取真实雨图集主要有:1)雨图/干净背景成对数据集:Raindrop(Qian等,2018),SPA-Data(Wang等,2019c)等;2)不成对的数据集:RID&RIS(Li等,2019c),RaidaR(Jin等,2021),RainDS(Quan等,2021),Real200(Wei等,2021b)等。

2)SPA-Data(spatial attentive)(Wang等,2019c)数据集包含170个真实的雨视频,其中84个视频使用iPhone X或iPhone 6SP拍摄,86个视频从StoryBlocks或YouTube上搜集得到。抽取29 500帧雨图,半自动生成对应的干净图构成成对真实雨图集。其中,28 500对用于训练,1 000对用于测试。半自动生成干净背景图像过程如下:(1)在静态背景上捕捉一个雨景视频,人工在N帧中分辨出某个特定像素何时被雨覆盖,何时未被雨覆盖的图像帧;(2)基于人工判断出无雨像素值集成为近似真实的背景;(3)对背景进行平滑;(4)用户评估图像。如果评估失败,继续添加图像帧数重复以上过程,直到合格后输出干净背景图像,与雨图一起构成真实的成对图像数据集。该数据集包含连续雨量的雨图,背景涵盖常见的城市场景(如建筑物、街道)、郊区场景(如街道、公园)和野外(如森林)。这是目前最大的真实雨图集,因此很多算法都用SPA-Data来比较泛化性。

3)RID&RIS(rain in driving/rain in surveillance)(Li等,2019c)数据集属于MPID数据集中真实的不成对的雨图子集。RID包含2 495幅车载摄像头获取的雨图,它的雨图退化效果接近于雨滴。大多数图像的分辨率是1 920×90像素,只有少数例外分辨率为4 023×3 024像素。RIS包含2 048幅监控摄像机获取的雨图,雨图退化效果接近于雨纹和雨雾,大多数图像的分辨率是640×368像素,只有少数例外是640×480像素。两个数据集的图像背景是各种不同的交通地点,Li等人(2019c)给图像中汽车、人、公共汽车、自行车和摩托车等标注了对象边界框。使用这两个真实雨图子集在单幅图像去雨算法性能评估中创建了任务驱动式的评价标准。

4)RaidaR(Jin等,2021)数据集包含18 895幅无雨图和58 542幅雨图的不成对的街景图像,其中对5 000幅图像标注语义分割基准,对3 658幅标注实例分割基准。图像是通过安装在屋顶上的照相机拍摄获取,雨天图像有雾、有路面反射、有水滴等特征。该数据集是针对雨天后续高层任务构建的。

5)RainDS(Quan等,2021)构建了一个真实雨滴、雨纹图像数据集,共1 000幅图像,其中包含250幅图像对(雨滴),用单反相机拍摄下雨的图像。(1)针对雨滴:在相机前面插入一块带有粘附的水滴的玻璃来模拟雨滴的情况,通过去除有雨滴的玻璃,停止喷水,得到干净的背景图像;(2)针对雨纹:用洒水器喷水来产生雨纹,同时控制曝光时间和ISO(International Standards Organization)参数,以拍摄不同光照条件下不同长度的雨纹。此真实数据集的雨图像覆盖多种场景,包括停车场、公园和城市地区。此外,还在不同的时间采集数据,即上午、中午和下午,以获得真实场景中不同的光照条件。

6)Real200(Wei等,2021b)包含200幅图像。所有的雨图像都是从互联网上挑选的高分辨率图像,并且在保留真实图像中雨纹的多样性的同时,对雨纹区域进行人工裁剪,突出雨纹区域。此数据集中的雨图像的雨纹与合成图像的雨纹并没有太大的区别,因此对于半监督模型的训练是有益的,可以用于半监督单幅图像去雨任务。

1.5 现有数据集实验分析

如前文所述,雨图合成数据集的分布各有偏好,雨图真实数据集的样本仍然不足,本文通过实验证实分析雨图数据集目前存在的问题和挑战。

1)分别在基于背景雨层简单加和的合成雨图集Rain12、Rain100H、Rain100L、Rain1400、Rain800,基于GAN数据驱动生成的雨图集Rain200A、W.H-Data,半自动采集的真实雨图集SPA-Data的数据集上随机选取一幅雨图在图9中进行对比展示。通过对每个数据集进行用户打分,其对应的逼真度可见Wang等人(2021c)中的图5所示,其中,W.H-Data逼真度为0.74,SPA-Data逼真度为0.72,Rain1400逼真度为0.52,Rain800逼真度为0.48,Rain100H逼真度为0.24。Wei等人(2021a)证实了基于GAN数据驱动合成的数据集Rain200A比基于简单直加合成的数据集Rain100L有更高的数据质量。Wang等人(2021c)证实了基于贝叶斯模型结合数据模型双驱动算法生成雨图提高了雨图数据集的多样性和逼真度,增强后的数据集重新训练去雨算法,算法性能都能够明显提升。但是,合成数据集与真实雨图数据集仍然存在较大域的鸿沟,复杂多样的W.H-Data也一样(Wang等,2021c)。

图9 8个雨图数据集示例(只有SPA-Data是真实雨图)

2)图10展示了用4个合成数据集Rain100H、Rain100L、Rain800、Rain1400的训练集对近5年6种代表性去雨算法进行训练后,用SPA-Data的数据集的真实雨图进行测试的结果。其中6种算法是:DerainNet(Fu等,2017a)、Residual-Guide-Net(Fan等,2018)、RESCAN(recurrent squeeze-and-excitation context aggregation net)(Li等,2018b)、LPNet(Fu等,2020)、PReNet(Ren等,2019)和RCDNet(Wang等,2020 d)。由测试结果可见,(1)由于基准的差异性,不同方法的泛化性呈现出不一样的效果,整体而言,无论是去雨效果还是细节保留方面,PReNet和RCDNet更具有竞争力;(2)即便取得了一定的泛化效果,但是不同合成数据集上训练得到的模型其泛化性能依然有提升的空间。这也从一定程度上反映了现有合成数据集与真实场景下的雨图分布存在不同程度的差异性。

图10 泛化性能比较

总之,未来仍需要一个大规模、统一的基准数据集,而真实雨图采集代价太高,因此面向渲染丰富多样的雨图数据集,进一步探究更合理准确的雨图合成模型,基于领域知识和雨图合成模型设计有效的雨图生成算法也是重要的研究方向。

2 基于深度学习的单幅图像去雨算法

雨天室外任务获取的图像通常会被雨纹、雨雾、雨帘,暴雨和雨滴降低图像的质量。雨纹导致图像内容的强度变化,模糊了背景或场景;雨的累积(也称为雨帘效应),单个的雨纹和水颗粒累积形成类似于薄雾或雾视觉效果,削弱了背景对比度,显著降低了远处场景的能见度;当没有背景信号通过时,此时雨信号完全遮挡一些背景信号,这种现象本文称之为雨的遮挡即暴雨。各种类型的雨对图像的损毁效果如图11所示。

图11 包含各种类型雨的单幅雨图示例

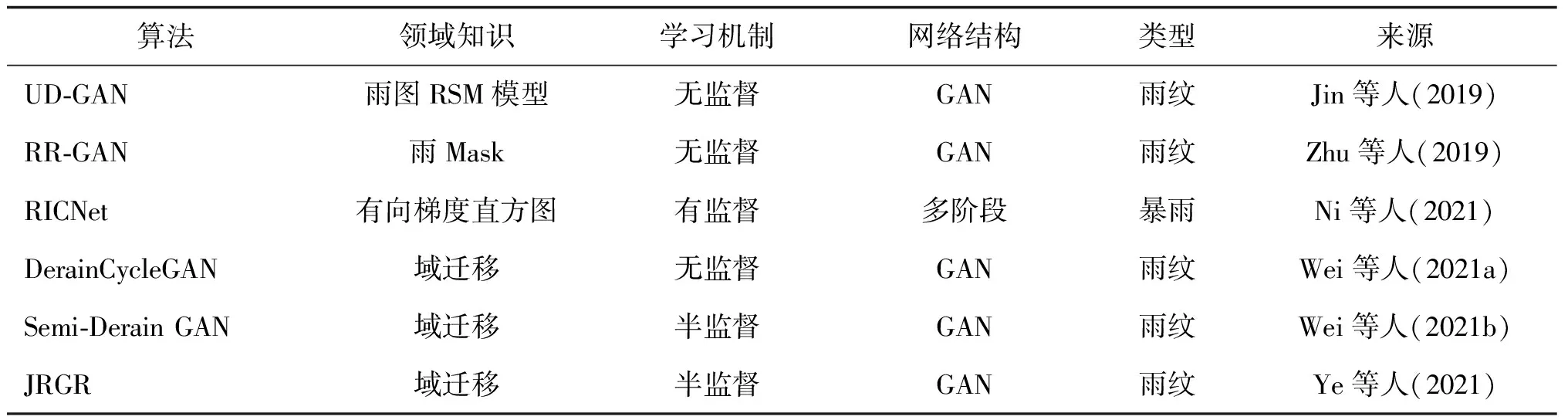

由于单幅图像去雨工作一般是面向任务设计算法。其中有单任务,如:雨滴、雨纹、雨雾、暴雨;联合任务,如:雨纹和雨滴、雨纹、雨滴、霾、雪、模糊联合去除等。一般情况下算法能够去除暴雨也就能去除雨雾和雨纹,如果算法能够去除雨雾也就能够去除雨纹。基本上雨纹、雨雾、暴雨是雨量轻、中、大的相应表现。本节以雨滴、雨纹、雨雾、暴雨(有监督、半/无监督)、联合任务(有监督、半/无监督),以及生成、去雨循环(有监督、半/无监督)来介绍近年来代表性的基于深度学习的单幅图像去雨算法。表3—表8分别展示了面向雨滴、雨纹、雨雾、暴雨的单任务图像去雨算法,联合任务图像去雨算法,去雨生成循环算法的具体信息。

表3 典型雨滴去除方法

表5 典型雨雾去除方法

表6 典型暴雨去除方法

表7 典型联合任务图像去雨方法

表8 典型去雨循环交互算法

大多数单幅图像去雨文献根据雨量的大小、雨纹的多样性、雨纹的重叠程度区分任务场景,根据领域知识显式或隐式引导构建深度神经网络,核心技术在于准确识别图像中雨纹的位置,同时关注雨纹对背景的模糊程度、亮度大小等。本文依据单任务和联合任务场景综述算法的学习机制以及相应的网络设计思想。

2.1 雨滴场景

基于深度学习雨滴去除的主流研究文献中,仅在有监督学习机制下提出去除雨滴的算法。典型的去除雨滴算法如:Qian等人(2018)提出的Attentive GAN网络能去除玻璃窗或镜头黏附的雨滴。该算法的主要贡献是在生成网络和判别网络上分别嵌入视觉注意力模块提取雨滴掩码(mask)及其全局位置关系。Shao等人(2021b)关注到雨滴的多样性和稠密性,以及雨滴的颜色随着背景的变化而变化的特征,提出选择性跳跃连接生成对抗(selective skip connection GAN,SSCGAN)网络去除雨滴和污染物。网络结构设计在编解码结构中嵌入了注意力模块提取全局结构特征获得干净的背景图。Quan等人(2019)针对透过黏附雨滴的窗口获取的有噪图像,提出了包含双重注意力机制的卷积网络用于恢复干净背景图像。其中物理注意力提取雨滴的形状和位置信息,通道注意力重新校准不同大小的雨滴。Shao等人(2021a)又提出不确定性引导的多尺度注意网络模块去除雨滴,作者将掩码提取从硬掩码推广到软掩码,掩码取值域为[-1,1])表示背景上雨滴的模糊隶属度,利用雨滴模糊隶属度属性使得对雨滴去除更有弹性更精细,其次作者构建了一个多尺度的金字塔结构,用迭代机制来提取雨滴的多尺度模糊信息去除雨滴恢复干净背景图。Liu等人(2019)使用成对对偶算子提出双残差编解码网络模型完成雨纹、雨滴、霾、模糊和噪声的去除。但是,针对不同的任务作者构建了不同的网络模块,也体现了不同任务蕴含不同的先验知识在网络中的嵌入引导作用。但是每种任务对应的网络都包含由多尺度模块提取有损图像不同尺度的特征,都包含注意力模块提取位置信息,都使用循环学习方式由粗到精恢复背景图像。以上面向雨滴去除的图像去雨算法都基于有监督学习机制隐式嵌入领域知识去构建网络模型。

2.2 雨纹场景

2.2.1 有监督

有监督学习机制即计算预测的去雨图像与真实的无雨图像之间的损失优化网络。

1)基于CNN的多分支结构。这类结构的典型文献有:Fu等人(2017a)提出一阶段并行网络去雨算法DerainNet;Li等人(2019d)提出深度分解组合网络(deep decomposition composition network,DDCNet)。Fu等人(2017a)将图像分解为低频基本层(base layer)和高频细节层(detail layer),设计简单的CNN网络学习特征去除高频层的雨纹,然后将增强后的高频层与低频层进行融合即可得到最后重构的干净背景层。Li等人(2019 d)构建的模型第1阶段由分解模块组成,第2阶段由组合模块构成,分解模块由干净背景分支和辅助雨纹并行分支构成,两分支分别提取无雨背景图,雨纹掩码。第2阶段基于屏幕混绕模型将第1阶段输出的背景和雨纹掩码再合成雨图,利用合成雨图和原始雨图的残差训练网络提高去雨性能。这种网络构建方式隐式嵌入了雨图的物理模型。

2)基于GAN的生成结构。由于GAN模型具有保持背景细节的作用,背景细节如:潮湿地面、背景纹理等。基于GAN的图像去雨或者雨图渲染工作非常多,有采用有监督学习机制,也有采用半/无监督学习机制。有监督的代表性的工作如Wang等人(2020h)提出了一种端到端的双任务去雨网络(dual-task deraining network, DTDN)。它由生成对抗网络(GAN)和卷积神经网络(convolutional neural network, CNN)两个子网络组成。DTDN-GAN主要用于去除雨纹,而DTDN-CNN主要用于恢复原始图像中的细节。该算法隐式嵌入了雨图合成的物理背景知识或者雨图的先验知识。

3)多尺度结构。近年来有一部分算法注重多尺度提取雨图特征。利用雨天图像在相同尺度或不同尺度内的自相似性协助提高去雨性能。Fu等人(2020)构建了轻量化特征金字塔网络(lightweight pyramid network, LPNet)算法,使用图像处理领域的知识简化了学习过程。作者在神经网络中引入高斯—拉普拉斯图像金字塔分解技术后,通过各金字塔层采用递归和残差网络结构提取3个尺度的雨图特征映射,并逐尺度去雨后合并输出干净雨图。

4)基于编解码结构。Du等人(2020a,b)利用VAE(variational auto-encoder)的强大的学习复杂数据的潜在结构的特点提出了条件变分图像去雨网络(conditional variational image deraining,CVID)。假定输入数据和输出数据条件下相应的潜在变量向量服从某参数下的独立高斯分布,利用编、解码器学习相应参数。然后分信道恢复干净背景图加权输出预测。该算法添加了空间密度估计(spatial density estimation, SDE)模块来估计每个图像的雨密度映射。CVID网络是雨图先验假设显式引导下构建的网络模型。因此,本文也把此模型归为数据模型双驱动学习方式。此外,Li等人(2018a)提出了一种由对称编码器和解码器组成的非局部增强网络(non-locally enhanced encoder-decoder network, NLEDN),准确地提取了雨纹的有效特征,并较好地保留了图像细节。Wang等人(2021a)结合表示学习的方式构建编解码结构提高图像去雨效果。后两个算法结构属于领域知识隐式引导构建而成。

图12 模型和数据驱动的框架示意图

2.2.2 半/无监督

半监督模式使用带标记和无标记数据一起训练网络,可以在迁移学习、域自适应和网络参数共享等方面优化网络。如,Wei等人(2019a)使用Fu等人(2017b)提出的深度细节网络(deep detail network, DDN)作为骨干网络,高斯混合模型(Gaussian mixture model, GMM)作为先验形式,以半监督的方式通过合成成对图像和真实不成对雨图训练网络得到图像去雨模型。这种半监督策略降低了数据采集成本,并在一定程度上缓解了网络过拟合问题。考虑到GMM在模拟真实降雨层时的不充分性,Yasarla等人(2020b)结合高斯处理过程提出了一种新的半监督学习(semi-supervised learning, SSL),对中间变元进行提取学习来微调网络,获得了更好的泛化性。

2.3 雨雾场景

1)基于注意力机制和Transformer。网络设计中越来越关注注意力模块的加入,近年的去雨算法几乎都有注意机制模块的设计,如,Hu等人(2019)分析了不同场景深度下的雨的视觉效果,构建了雨成像模型,构建深度注意力特征网络(depth-attentional features networks, DAFNet)。该算法创新性地构建了由图像深度物理属性引导的注意机制模块,由该注意力模块抓取图像深度特征。更为突出的就是Transformer的提出,完全由注意力模块组成的网络结构。Qin等人(2021)提出了高效Transformer 去雨网络(efficient Transformer derain network, ETDNet),其中efficient Transformer模块可以提取出丰富的多尺度和上下文信息协助模型从粗到细去除雨纹。Tan等人(2021)首次将移动窗口Transformer(shifted windows Transformer,Swin-Transformer)引入图像去雨领域,改进了Swin-Transformer的基本模块,表现出优良的去雨性能。注意力模块的构建和融入也属于隐式嵌入了雨图形成的物理属性和雨层表现的先验知识。

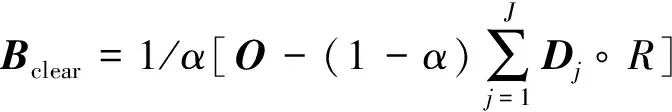

2)基于模型和数据学习方式。在单幅图像去雨的工作中,嵌入式可解释模型、数据双驱动的图像去雨算法代表文献如Wang等人(2020d)。作者提出可解释雨的卷积词典网络(rain con-volutional dictionary network, RCDNet),建立了雨纹的卷积字典RCD模型,并利用近端梯度下降技术设计了一个只包含简单算子的迭代算法求解模型,通过网络展开,构建了RCDNet网络结构,其中每个网络模块都有明确的物理意义,并与算法中涉及的相应算子对应。Wang等(2020d)进一步构建一个称为DRCDNet(dynamic RCDNet)的动态雨卷积字典网络,获得了更好的泛化能力。Wang等人(2020g)构建了一种算法,作者首先分析简化雨形成的物理机制,提出了一个雨模型I=T∘B+R(T表示有雾的雨图,∘表示像素相乘),使用3个子网络VNet(vapor transmission maps,TV)、ANet(atmosphere light,A)、SNet(transmission maps,TS)分别学习大气传输映射TV、大气光A及雨纹的传输映射TS,由物理模型O=(TS+TV)∘B+[1-(TS+TV)]∘A反解得到干净的背景B。以上网络模型的构建显式地嵌入了相关领域知识。

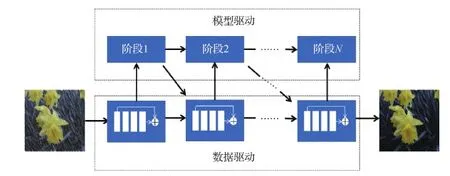

2.4 暴雨场景

1)循环和多阶段结构。Li等人(2017)针对暴雨、各种不同尺度的相互重叠的雨纹,设计了尺度敏感多阶段递归渐进去雨网络(scale-aware multi-stage recurrent network, SMRNet),各阶段由多个并行网络构成,这些并行网络的不同分支提取不同尺度的雨纹信息,通过跨阶信息传递可以利用信息冗余渐进去除雨纹,最终得到较好的干净背景的视觉效果,n阶或迭代循环简略网络结构见图13。Ren等人(2019)通过重复展开浅层ResNet,构建渐进式残差神经网络(progressive ResNet, PRN),继而引入一个循环层,利用各级深层特征的依赖性,构建了渐进循环去雨网络(progressive recurrent network, PReNet)。循环或多阶段去雨都假设雨层是叠加形成的,考虑到了雨形成的大气光、传输映射等成因,而且考虑到了解雨的形成首先要了解雨纹定位以及雨纹、雨层和背景的位置关系,也就是要从局部到全局提取相应的信息协助图像去雨。另一方面雨量的增大可看做雨层的叠加,图像去雨是一个逆过程,自然考虑到设计循环多阶段渐进去雨的构架。

图13 N阶循环网络模型示意图

2)多尺度结构。Yang等人(2020a)开发了雨的累积模型(rain accumulation model,RAM),用RAM模型模拟真实暴雨、雨纹积累和重叠的现象,然后基于RAM模型设计了联合雨的检测和去除(joint rain detection and removal, JORDER)深度学习网络。网络的核心创新点是用上下文扩展网络模块(contextual dilated network, CDN)提取多尺度的雨图特征。不同尺度的上下文信息是通过3个具有不同扩张因子和感受野的卷积路径得到,再通过递归结构,为后续各层提供越来越大的感受野,从而提取全局上下文信息。Jiang等人(2020)提出了多尺度渐进融合网络(multi-scale progressive fusion network, MSPFN)。该网络结构也采用多尺度金字塔结构,提取多尺度信息并且对应尺度去雨后级联融合得到干净雨图。该算法从输入图像的不同尺度和层次深度的角度抓取雨纹的多尺度协同表示力。对于不同位置相似的雨纹,采用长短期记忆网络(long short term memory network, LSTM)循环计算捕获全局纹理特征,从而得到空间维上的互补信息和冗余信息来表征目标雨纹。多尺度网络结构是汲取了图像的非局部相似性的领域知识去设计网络,也属于隐式嵌入领域知识的方式。

3)基于模型和数据学习方式。Yang等(2019a)构造了扩展的残差密集网络,结合小波学习去除雨纹,其中小波分解将图像分解为高频和低频成分,对低频成分进行去雨,在恢复的低频成分的指导下采用递归模块对高频成分上的细节进行循环恢复。Vu等人(2021)让网络结合集成学习的方法构建组合式双模学习框架,实现了单幅图像暴雨的去除。该算法使用3个子网络,空间通道注意力网络、初始残差网络和初始通道注意力网络,分别提取了粗去雨图像、中间干净背景图和干净背景图,将所得结果集成学习后输出,集成学习的权重使用注意力混扰模块学习。

2.5 联合任务图像去雨

现实中,机器视觉任务面对处理雨滴和雨纹、雨雾,以及霾、雪和模糊等同时出现导致图像质量降低的现象更为常见,因此联合任务的去雨工作也逐渐得到关注。但是主流的联合任务图像去雨算法文献仅涉及有监督机制下学习算法模型。

Quan等人(2021)提出了互补级联CCN(complementary cascaded network)网络同时去除雨纹和去除雨滴。首先将雨图输入两个并联的分支,一个分支先经由雨条去除模块(rain streak removal, RSR)去除雨纹输出结果,并进入雨滴去除模块(raindrop removal, RDR)去除雨滴再次输出结果;另一个分支先经由RDR模块去除雨滴输出结果,并进入RSR模块去除雨纹再次输出结果;最后将这4个输出级联后输入到基于注意力的特征融合模块(attention based feature fusion, AFF),恢复出干净背景图。这个网络使用神经网络搜索(neural architecture search, NAS)方法得到。Zhang等人(2021a)提出双重注意力(dual attention-in-attention model, DAiAM)网络可以去除连续雨量的雨纹和雨滴。DAiAM网络包含两个并行用于去除雨纹和雨滴的双重注意力模块,这个双注意力模块有两个注意力映射分别关注大雨和小雨,指导去除不同雨量的雨纹和不同大小的雨滴,从而重建出干净的背景图。Wang等人(2021e)提出了一种高效的基于Transformer的Uformer网络结构,使用Transformer块构建了一个分层的跳跃连接的编解码网络结构实现基于多尺度特征编解码的图像恢复过程。Li等人(2020b)使用一个网络,同样的权值参数联合去除雨、雾、雪和雨滴等,恢复出干净背景图像,本文将此算法简记为Li-Net。为了实现联合任务图像去雨,作者首先设计了一个由多个特定恶劣天气退化任务对应的编码器组成的生成器;然后利用神经结构搜索优化处理从所有编码器提取的图像特征;最后,引入了一系列基于张量的操作,将退化的图像特征转换为干净的背景特征。其中,在网络中封装了雨、雾、雪和黏附雨滴形成背后的基本物理原理。

2.6 去雨和生成循环交互

基于深度学习的单幅图像去雨性能的提高既依赖高质量的数据集,又依赖有效的算法设计。现有算法大多数致力于复杂有效的网络结构搭建,然后在现有的合成数据集上进行训练。由于现有的合成数据集包含的雨的种类有限,且与真实数据集之间往往存在分布差异性,所以算法的泛化性通常都有局限。针对这个挑战,近年来出现了合成与去雨循环交互促进的算法,一方面从数据中学习雨和背景的真实成像属性从而更好地提高去雨性能;另一方面通过去雨算法加深对雨的内在属性的理解,从而辅助合成更为逼真的雨图。本文根据学习机制将此类算法分为以下3类。

2.6.1 有监督

Ni等人(2021)提出雨强度控制网络(rain intensity controlling network, RICNet),如图14所示。该网络通过双向连续控制雨量达到去除各种雨量类型的雨,同时也合成连续雨量的雨图。首先雨图经过背景提取网络(background extraction network,BEN)和 高频雨条估计网络(high-frequency rain streak elimination network,HREN),然后将这两个网络的输出和雨图一同输入到主要控制网络中(main controlling network,MCN)(此网络包含并行门控模块(parallel gating module,PGM)和噪声增强模块(noise boosting module,NBM)),通过在深度特征空间中插值,可以连续控制雨图的雨量由小变大,反之通过一个递减的学习策略使得大雨变为小雨,图14从下到上生成连续雨量的雨图,从上到下连续渐次去除雨,恢复出无雨图。

图14 RICNet网络示意图

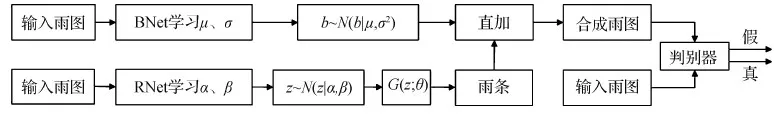

2.6.2 半/无监督

Ye等人(2021)提出了联合雨的生成和去除(joint rain generation and removal, JRGR)网络如图15所示。具体来说,网络由合成—真实模块(synthetic to real, S2R)和真实—合成模块(real to synthetic,R2S)构成,目标为使合成图像更加逼近真实雨图,缩小合成图像和真实图像之间的域的鸿沟。该网络在每个模块中嵌入图像去雨模块和雨图生成模块,从而保证了雨图生成或图像去雨算法的鲁棒性。为了更好地恢复背景图像,网络还引入干净背景的自一致性损失和对抗性损失用于训练网络提升模型效果。Wei等人(2021b)提出Semi-Derain GAN,由有监督和无监督的两个分支构成,通过半监督雨的掩码学习器(semi-supervised rain mask learner, SSRML)模块提取雨图和真实雨图中雨纹的物理属性,使提取的属性在上下两个分支中共享,上分支网络去雨,下分支网络合成雨图,同时完成图像去雨和雨图合成。

图15 JRGR网络示意图(Ye等,2021)

Zhu等人(2019)的雨的去除生成对抗网络(rain removal GAN, RR-GAN)算法设计了新颖的生成器和判别器。生成器由循环多级的注意记忆模块和U-Net构成,判别器由多尺度的深度监督网络构成。生成器使用不成对的雨图和干净的图来训练注意力记忆模块,聚合来自不同阶段的潜在雨纹掩码和上下文信息,雨图和潜在的雨纹掩码信息同时输入U-Net恢复出干净背景图像。恢复后的背景图通过鉴别器进行正则化,无论低级细节或全局层次结构上都保证了恢复的背景图的外观尽可能接近用于训练的干净背景图。同时将这些潜在雨纹掩码和恢复的干净背景图通过雨纹模型(rain streak model, RSM)合成雨图,让合成的雨图和原始雨图满足一致性正则作为损失函数的一部分来进行微调网络,使得恢复的干净背景图保持了真实的颜色和结构。Jin等人(2019)提出了一种无监督去雨对抗网络(unsupervised deraining GAN,UD-GAN)。分别由雨纹导向模块(rain guidance module, RGM)和背景导向模块(background guidance module, BGM)关注雨和背景层,在它们的导向下,由GC(生成器)生成无雨图,将此无雨图输入DC(判别器)得到干净无雨背景图,同时将GC(生成器)生成无雨图经由GR(生成器)完成保持与原图颜色和纹理一致的雨图的循环重建。Wei等人(2021a)提出基于有约束的循环生成对抗网络的注意力导向单幅图像去雨算法DerainCycleGAN(attention-guided deraining by constrained CycleGAN),该网络有两个分支(如图16),每个分支有3个部分。3个部分是:无监督学习的基于注意力的雨纹提取器(unsupervised attention guided rain streak extractor, U-ARSE),同时关注雨图中雨纹信息;两个生成器GN和GR分别生成无雨图和有雨图;两个鉴别器DN和DR鉴别生成图像的真假。得到两个有约束U-ARSE的网络分支是:雨—无雨—合成雨图,无雨图—雨—恢复无雨图,用它们完成雨图和无雨图的重建。文献不仅实现了图像去雨任务,还通过合成分支构建了成对的雨图数据集Rain200A。

图16 DerainCycleGAN网络示意图(Wei等,2021a)

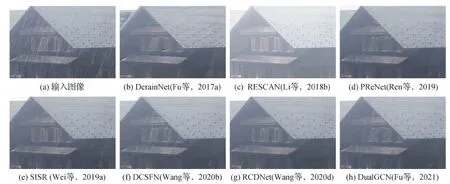

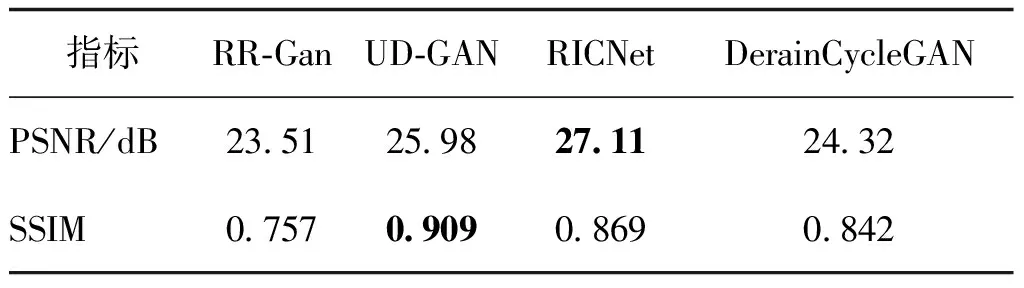

2.7 现有图像去雨算法实验效果分析

本文测试了具有代表性的7种去除雨纹的算法:RESCAN(循环迭代)、PReNet(多阶段)、SISR(半监督)、DerainNet(多分支结构)、DCSFN(多尺度)、RCDNet(双驱动)和DualGCN(多尺度)。这7种算法在Rain100H的训练集上训练,分别在Rain100H的测试集和真实雨图上进行测试。另外,本文在Raindrop的训练集训练去雨滴算法:DuRB(注意力机制)、Attentive Gan(基于GAN),然后在Raindrop的测试集上测试。在Rain800的训练集上训练去雨循环互促算法DerainCycleGan、RR-Gan、UD-GAN、和RICNet,然后在Rain800的测试集上测试。测试结果分析如下:

1)定性分析。从图17可见,7种图像去雨算法在合成雨图集Rain100H的测试集的测试效果,从图18可见它们在真实雨图的雨纹去除泛化效果。从图19可见DuRB、Attentive GAN在真实雨滴污染图像上的去除效果。可以证实如下结论:从背景纹理细节保持的程度来看(图17),算法RCDNet背景细节保持最好,可见模型数据双驱动算法能够充分利用准确的先验知识有效构建算法模型。从去雨效果来看(图18),迭代算法RESCAN和多阶段算法PReNet去雨效果相对较好,原因是通过多阶段或者通过迭代可以渐次从局部到全局提取图像的位置信息,协助准确定位提高图像去雨效果。SISR不能去除明显的雨纹,效果较差,初步分析可能的原因是该算法使用的CNN共享网络模型较简单所致。利用低通滤波器将雨图分解为细节层和背景层,从而分别进行特征提取的算法DerainNet的去雨效果相对较好,但是背景纹理恢复有局部效果不满意的表现,说明雨纹纹理和背景纹理有效区分的先验知识的挖掘还有待进一步研究。从泛化性来看(图18),模型数据双驱动算法RCDNet泛化性能较好,说明双驱动模型能够使用准确的可解释性有效地构建算法模型。从雨滴去除效果可见(图19),相比较Attentive GAN严重模糊了图像背景细节,DuRB算法清晰地保留了图像背景细节信息,而且在视觉上去除雨滴效果好,可能的原因是后者嵌入多尺度注意力模块可以提取雨滴的位置信息和相关冗余信息。

图17 7种图像去雨算法在Rain100H上的测试效果

图18 泛化性测试

图19 2种算法在Raindrop上的去雨结果

2)定量分析。(1)由表9可见7种图像去雨算法在合成雨图上去除的PSNR、SSIM值,RCDNet的PSNR和SSIM值最高,说明模型数据双驱动算法的去雨性能优于数据驱动的算法,这也充分体现了领域知识显式正则嵌入,先验知识有效挖掘的重要性;

表9 在Rain100H和 Rain100L数据集上各类算法平均PSNR和SSIM

(2)由表10可见雨滴去除的PSNR、SSIM值,对于Raindrop两个测试集和两个评估指标的4个组合,DuRB方法的PSNR和SSIM值都优于Attentive GAN,说明多尺度注意力优于单尺度的注意力模块;(3)由表11可见4种去雨循环互促算法去除雨纹的PSNR、SSIM值,RICNet与其他方法相比取得了更高的PSNR和SSIM值,说明RICNet具有更好保持自然属性的性能。

表10 在Raindrop数据集上各类算法平均PSNR和SSIM

表11 去雨循环交互算法在Rain800上的结果比较

3 图像去雨后续高层任务研究

类似于Wang等人(2016)、Liu等人(2018)、Li等人(2019a)、Jin等人(2021)探讨图像增强对后续任务的重要性,近年来,图像去雨算法也逐渐关注到后续任务的性能提升。图像去雨通常可作为目标检测、行人重识别等后续高层任务的预处理步骤,使用后续任务来判定去雨算法性能这一思想已逐渐受到更多学者的关注(Li等,2019c;Liu等,2019;Fu等,2020;Jiang等,2020,2021;Zhang等,2020a;Wang等,2020a;Jin等,2021)。以下介绍此方向的典型工作。

Li等人(2019c)在单幅图像去雨领域尝试了利用后续高层任务的性能评价图像去雨性能,创建了一个去雨算法性能评估的任务驱动式评价标准。文献收集了两个真实雨图数据集RID(rain in driving)和RIS(rain in surveillance)。作者给两个数据集中所有图像都标注了汽车、人、公共汽车、自行车和摩托车等对象边界框。由于雨图特点不同,对于RIS使用去除雨滴预处理,对于RID使用去除雨纹和雨雾的预处理。作者用目标检测模型,如Faster RCNN(region CNN)(Ren等,2017)、YOLO-V3(you only look once)(Redmon和Farhadi,2018),在去雨预处理后的数据集上测试其目标检测性能。实验表明,去除雨的效果越好,目标检测模型(在恢复的干净图像上训练)的表现就越好。图20展示了去雨后使用YOLO-V3进行目标检测的结果。同样地,Fu等人(2020)提出去雨的轻加权金字塔网络LPNet。他们对比了单纯的Faster RCNN(Ren等,2017)和LPNet+Faster RCNN对雨图的检测效果,无论从丢失检测对象或检测识别的置信度上,后者相较前者性能均有提高。

图20 对RIS去雨后目标检测结果(Li等,2019c)

Tremblay等人(2021)使用了3种不同的方法,基于物理模型的、基于数据的、基于物理和数据相结合的合成技术增强KITTI、Cityscapes和nuScenes数据集。数据增强处理之前,这3个数据集分别面向目标检测、语义分割和深度估计进行了基准标注。数据增强处理之后得到相应的不同雨量(小、中、大)的雨图数据集Rain KITTI、Rain Cityscapes、Rain nuScenes。Faster RCNN算法分别在KITTI和小中大Rain KITTI数据集上测试目标检测,结果如图21所示,随着雨量增大,Faster RCNN目标检测识别率变小;金字塔场景解析网络(pyramid scene parsing network,PSPNet)(Zhao等,2017)在Cityscapes和小中大Rain Cityscapes数据集上测试语义分割,结果如图22所示,随着雨量增大,PSPNet语义分割误差变大;BTS(big to small)(Lee等,2019)算法在nuScenes和小中大Rain nuScenes上测试深度估计,结果如图23所示,随着雨量增大,BTS深度估计误差变大。

图21 基于PBR增强后KITTI数据集的目标检测(Tremblay等,2021)

图22 基于PBR增强后Cityscapes数据集的语义分割(Tremblay等,2021)

图23 基于PBR增强后nuScenes数据集的深度估计(Tremblay等,2021)

随着安全监控、自动驾驶和导航系统的快速发展,高层后续任务的应用越来越广泛。图像去雨作为重要的预处理步骤,对于推动这些任务在恶劣天气下的鲁棒性提升具有重要的价值与意义,需要领域学者持续的关注和推动。但目前存在的问题是面向特定任务的数据集很少,而且目前大部分都是合成的雨图,数据集的质量欠佳,导致不能够训练出好的模型,不能帮助提高后续高层任务的算法性能。

目前,去雨后续高层任务的研究比较少见,但是实际应用中视频监控、无人驾驶视觉分析,野外深度评估等都需要各种天气下的图像的预处理工作,特定任务数据集的构建或联合底/高层任务的算法设计都是极有意义的研究方向。

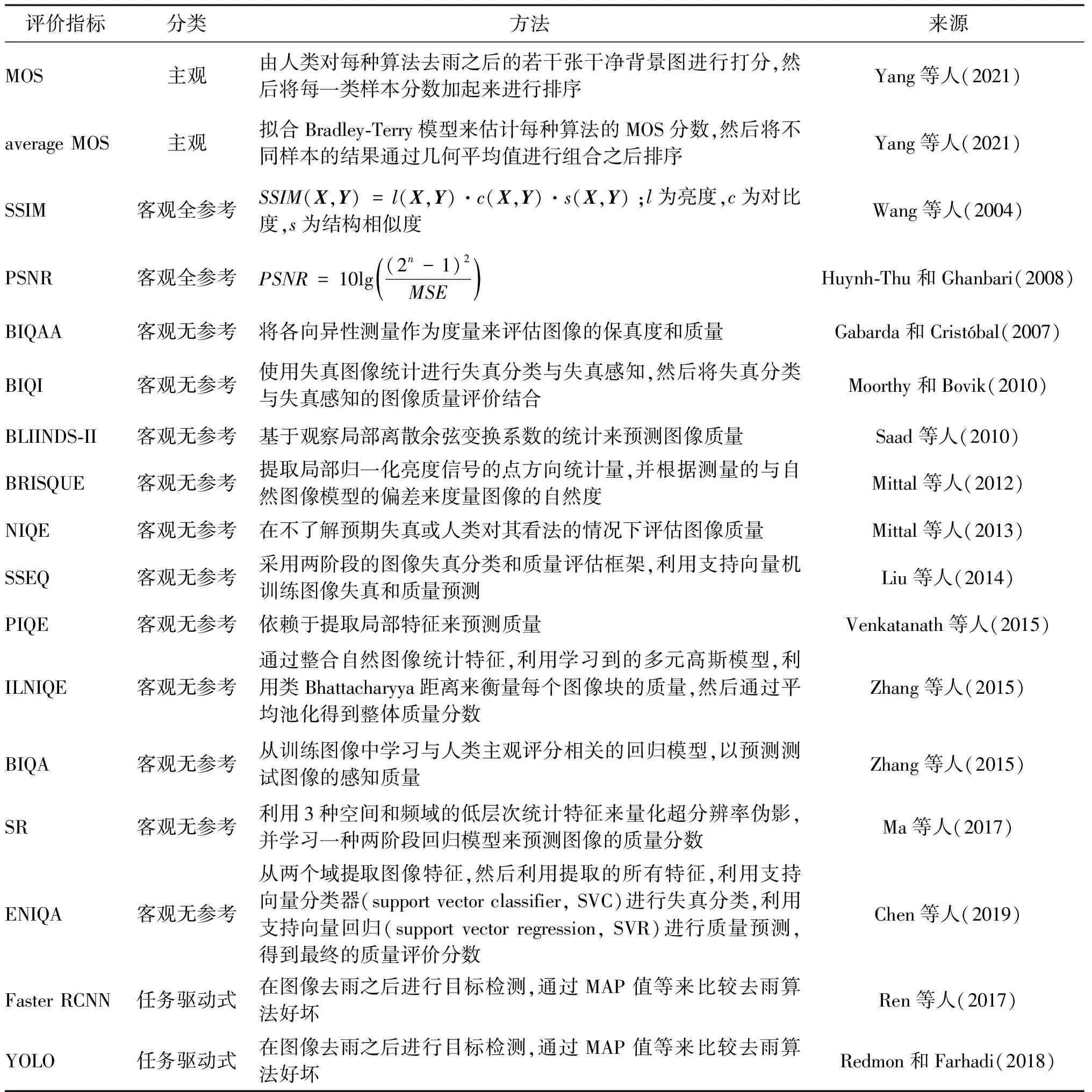

4 评价指标

图像去雨算法的性能分析和雨图合成的数据集的质量评估都需要公平的图像质量评价(image quality assessment,IQA)指标。现有的评价指标一般分为主观评价和客观评价(Athar和Wang,2019)。主观评价就是收集被测试者对测试图像的质量感知的可靠的打分结果平均值(mean opinion scores,MOSs)作为人类对测试图像质量的评估结论。在主观评价方法中,主要的几个已成为ITU-R(International Telecoommunication Union-Radiocommunication Sector)和ITU-T(International Telecmmunication Union-Telecommunication Standardization Sector)推荐规范中的标准化方法,一般分为单刺激因素、双刺激因素和多刺激因素。客观评价方法就是构造评价模型实现算法性能评价自动化(Ma和Fang,2021)。根据有无参照信息将客观评价方法分为全参考(full-reference,FR)、部分参考(reduced-reference, RR)、无参考(no-reference,NR)评价方法或称盲图像质量评价(Li等,2020a;Ma等,2021)。以上评价方法又通称为通用的评价指标。近年来,学者们开始关注另外一种面向特定任务或后续任务,通过任务实现性能的好坏来评价前期图像处理的效果的方法,称为任务驱动式评价指标。

本文所调研的主流文献使用的评价方法包括主观评价方法、全参考客观评价方法和无参考客观评价方法。分别有:主观意见分(mean opinion score,MOS)(Yang等,2021)、average MOS(Yang等,2021)、结构相似度(structural similarity index measure, SSIM)(Wang等,2004)、基于各向异性的盲图像质量评估(blind image quality assessment through anisotropy, BIQAA)(Gabarda和Cristóbal,2007)、峰值信噪比(peak signal to noise ratio, PSNR)(Huynh-Thu和Ghanbari,2008)、盲图像质量指数(blind image quality index, BIQI)(Moorthy和Bovik,2010)、基于离散余弦转换统计的盲图像完整性标记(blind image integrity notator using DCT statistics,BLIINDS-II)(Saad等,2010)、自然图像质量评估器(naturalness image quality evaluator, NIQE)(Mittal等,2013)、无参考图像空间质量评估器(blind/reference less image spatial quality evaluator, BRISQUE)(Mittal等,2012)、基于空间普熵的质量(spatial-spectral entropy based quality, SSEQ)(Liu等,2014)、基于感知的图像质量评估器(perception-based image quality evaluator,PIQE)(Venkatanath等,2015)、融合局部的自然图像质量评估器(integrated local NIQE,ILNIQE)(Zhang等,2015)、盲图像质量评价(blind image quality assessment,BIQA)(Zhang等,2015)、超像素(super resolution,SR)(Ma等,2017)、基于熵的无参考图像质量评价(entropy-based no-reference image quality assessment,ENIQA)(Chen等,2019)以及任务驱动式评价方法。最常用来评价的指标还是传统的PSNR、SSIM等。本文整理了这些评价方法的分类以及来源,详细内容见表12。

表12 评价指标分类信息

主观评价指标可靠准确,但是耗时费力,实现困难。尽管近年来基于深度学习的客观评价指标(Zhang等,2021c;Ma等,2021)的研究取得了快速进展,很多学者提出了融合全参考评价(Athar和Wang,2019)、无参考评价的方法(Zhang等,2020b),融合主、客观评价方法(Li等,2016a),但是,仍然存在全参考评价指标理想图像获取困难,无参考评价指标大多与人类图像质量感知相关性差(Zhang等,2021d),因此,任务驱动式评价指标是近年来较为被关注的方法之一(Zhang等,2021d)。另一方面,不同评价指标对图像处理算法的优化性能评价也有所不同(Ding等,2021b),数据集又各有特色,各有面对任务的不同,合成数据与真实数据域的鸿沟仍然很大,所以,关于图像去雨的基准数据集的建立和公平的评价体系的构建是未来的研究重点。

5 结 语

本文对近年来面向单幅图像去雨任务的雨图数据集构建以及深度学习算法、雨天后续高层任务的工作以及图像去雨评价指标进行了回顾与介绍。特别地,本文提供了大部分数据集的构建方式以及下载网址,以便领域学者下载使用。此外,本文对当前基于深度学习的单幅图像去雨算法的介绍着重于分析领域知识在算法模型构建中显式正则嵌入或隐式的有效引导作用,并特别回顾了图像去雨、生成双向循环工作和图像去雨对后续高层任务的影响。

单幅图像去雨作为一个典型的图像处理病态反问题,是非常具有挑战性的研究任务。即使目前去雨算法得到了可喜的发展,仍然存在进一步研究空间。本文通过数据集的质量的比对以及算法网络设计的分析和性能比对,指出领域知识挖掘的重要性,领域知识的显式呈现比隐式引导更能提高算法性能或缓解对数据集的需求。

面临的挑战:

1)真实数据集的采集代价很高、实现很难。合成雨图数据集雨纹种类有限,雨纹和背景的融合模型较为简单,忽略了亮度信息、深度信息等,因考虑的因素不足,导致合成雨图的逼真度低,而且合成雨图目前都没有真实表现出雨滴、雨雾和潮湿路面的自然效果。现有数据集的场景不够丰富,并且,面对特定高层任务的数据集构建规模较小。因此,更为全面领域知识的挖掘、构建与编码,对于建立更有效更合理的算法模型,合成多样逼真的数据集,均具有极其重要的价值与意义。

2)真实数据采集困难,合成数据建模估计不足,导致合成数据集与真实数据集的域的鸿沟不可避免。造成的后果是使用合成数据集训练的算法模型在真实数据集上的去雨效果并不乐观,于是当前算法的跨数据的泛化能力仍是巨大的挑战。

3)模型数据双驱动的思想仍处于初步阶段,需要进一步发展。模型驱动方法的一个突出特征是,当模型足够精确时,在理论意义上可严格证明预期解决方案的最优性,然而模型驱动方法的核心问题在于缺乏对现实场景与数据的自适应性与灵活适用性。反之,数据驱动方法尽管对于数据有很好的针对性与适用性,却缺乏具有理论根基的可解释性,且由于缺乏充分物理特性的嵌入刻画而导致在领域信息变化时发生过拟合问题,泛化性能差。因此如何挖掘全面有效的先验知识,结合模型驱动与数据驱动的算法构建依然面临巨大挑战。

4)雨图背景纹理多样,很多背景纹理和雨纹的纹理非常相似,去雨算法效果好的时候很难避免背景的过度光滑。因此,有效准确提取雨的掩码,背景特征等先验知识存在挑战。

未来研究方向:

1)多任务统一学习框架。在真实场景中,雨的类型不仅有雨纹,还有雨滴、雨雾等,可以考虑设计多任务统一学习框架将雨纹、雨滴和雨雾联合处理,在一定程度上可以提高算法的泛化性,同时在恶劣天气情况下,可以考虑雨雪雾的联合处理。

2)针对特定场景处理。考虑比较多的场景,如夜间场景,它包含特定的点光源等,成像特性和雨天场景不一样,还可以考虑自动驾驶、视频监控和野外场景中面临的图像去雨问题等。

3)泛化能力的提升。复杂的雨图模型设计,可以使训练数据更加逼真,现有数据集的使用方式比较少,未来可以寻找更多的模式,如自监督、增广等。学习模式的改变也对泛化性能的提升有一定帮助,未来可以探索更多无监督、半监督的算法,同时更有效、更全面的先验知识的挖掘和融入也可以提高算法的泛化性能。

4)公开的评价体系。目前尚无一个基准数据集可以评价算法性能的好坏,未来可以结合下游任务提出更具有代表性的评价指标。

5)雨天后续高层任务。底、高层任务联合处理,针对雨图特征提取,以后续任务作为引导可以提取出更有效的雨图特征,基于此提升高层任务的鲁棒性,也可以考虑将雨图先验引入到雨天高层任务中。

附录

文中缩写词全称:

DNLRB(dense non-local residual block),SPANet(spatial attentive network),SISR(semi-supervised),SKRF(selective Kernel convolution using a residual Refine factor),ID-CGAN(image de-raining conditional generative adversarial network),ERLNet(entangled representation learning network),VRGNet(variational rain generation network),QSMD(quasi-sparse multi-decoding deraining network),PRRNet(paired rain removal network),RDARENet(recurrent dual-attention-residual network),DAF-Net(depth-attentional features network),UMRL(uncertainty guided multi-scale residual learning),DRD-Net(detail-recovery image deraining network),AMPE-Net(rain model parameter estimation network),ETDNet(efficient transformer deraining network),SDNet(swin-transformer deraining network),RWL(recurrent wavelet learning),ReHEN(recurrent hierarchy enhancement network),RMP(residual multiscale pyramid),RDDAN(residual dense dilated aggregated network),MSRM(multi-scale residual model),RLNet(representation learning network),GLA-HRRNet(global and local attentions to effectively remove heavy rain from single images),LDNet(lightweight dense network),MRCANet(multi-resolution context aggregation network),NCANet(non-local channel aggregation network),MSKSN(multi-scale kernel selection network),D-DAiAM(differential-driven dual attention-in-attention model), JRGR(joint rain generation and removal), RICNet(rain intensity controlling network), SRNet(structural residual network),DFN(distributed feedback network), CRFN(clique recursive feedback mechanism based network),DCSFN(deep cross-scale fusion network), MSPFN(multi-scale progressive fusion network),NLEDN(non-locally enhanced encoder-decoder network)

参考文献(References)

Athar S and Wang Z.2019.A comprehensive performance evaluation of image quality assessment algorithms.IEEE Access, 7: 140030-140070[DOI: 10.1109/ACCESS.2019.2943319]

Caesar H, Bankiti V, Lang A H, Vora S, Liong V E, Xu Q, Krishnan A, Pan Y, Baldan G and Beijbom O.2020.nuScenes: a multimodal dataset for autonomous driving//Proceedings of 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Seattle, USA: IEEE: 11618-11628[DOI: 10.1109/CVPR42600.2020.01164]

Chai G Q, Wang D W, Lu B and Li Z.2021.Lightweight dense network based on attention mechanism for single-image deraining[J/OL].[2021-09-15].Journal of Beijing University of Aeronautics and Astronautics, 1-8(柴国强, 王大为, 芦宾, 李竹.2021.基于注意机制的轻量化稠密网络单幅图像去雨[J/OL].[2021-09-15].北京航空航天大学学报, 1-8.https://kns.cnki.net/kcms/detail/detail.aspx?doi=10.13700/j.bh.1001-5965.2021.0294)

Chen C H and Li H.2021.Robust representation learning with feedback for single image deraining//Proceedings of 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Nashville, USA: IEEE: 7738-7747[DOI: 10.1109/CVPR46437.2021.00765]

Chen S M, Chen W and Yin Z.2022.Research status and prospect of single image rain removal algorithm.Application Research of Computers, 39(1): 9-17(陈舒曼, 陈玮, 尹钟.2022.单幅图像去雨算法研究现状及展望.计算机应用研究, 39(1): 9-17)[DOI: 10.19734/j.issn.1001-3695.2021.05.0209]

Chen X Q, Zhang Q Y, Lin M H, Yang G Y and He C.2019.No-reference color image quality assessment: from entropy to perceptual quality.EURASIP Journal on Image and Video Processing, 2019(1): 77[DOI: 10.1186/s13640-019-0479-7]

Cho J, Jang H, Ha N, Lee S, Park S and Sohn K.2019.Deep unsupervised learning for rain streak removal using time-varying rain streak scene.Journal of Korea Multimedia Society, 22(1): 1-9[DOI: 10.9717/kmms.2019.22.1.001]

Cordts M, Omran M, Ramos S, Rehfeld T, Enzweiler M, Benenson R, Franke U, Roth S and Schiele B.2016.The cityscapes dataset for semantic urban scene understanding//Proceedings of 2016 IEEE Conference on Computer Vision and Pattern Recognition(CVPR).Las Vegas, USA: IEEE: 3213-3223[DOI: 10.1109/CVPR.2016.350]

Deng S, Wei M Q, Wang J, Feng Y D, Liang L M, Xie H R, Wang F L and Wang M.2020.Detail-recovery image deraining via context aggregation networks//Proceedings of 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Seattle,USA: IEEE: 14548-14557[DOI: 10.1109/CVPR42600.2020.01457]

Ding J J, Guo H L, Zhou H, Yu J, He X X and Jiang B.2021a.Distributed feedback network for single-image deraining.Information Sciences, 572: 611-626[DOI: 10.1016/j.ins.2021.02.080]

Ding K Y, Ma K D, Wang S Q and Simoncelli E P.2021b.Comparison of full-reference image quality models for optimization of image processing systems.International Journal of Computer Vision, 129(4): 1258-1281[DOI: 10.1007/s11263-020-01419-7]

Du Y J, Xu J, Qiu Q, Zhen X T and Zhang L.2020a.Variational image deraining//Proceedings of 2020 IEEE Winter Conference on Applications of Computer Vision(WACV).Snowmass, USA: IEEE: 2395-2404[DOI: 10.1109/WACV45572.2020.9093393]

Du Y J, Xu J, Zhen X T, Cheng M M and Shao L.2020b.Conditional variational image deraining.IEEE Transactions on Image Processing, 29: 6288-6301[DOI: 10.1109/TIP.2020.2990606]

Fan Z W, Wu H F, Fu X Y, Huang Y and Ding X H.2018.Residual-Guide Network for Single Image Deraining//Proceedings of the 26th ACM International Conference on Multimedia.Seoul, Korea(South): ACM: 1751-1759[DOI: 10.1145/3240508.3240694]

Fu X Y, Huang J B, Ding X H, Liao Y H and Paisley J.2017a.Clearing the skies: a deep network architecture for single-image rain removal.IEEE Transactions on Image Processing, 26(6): 2944-2956[DOI: 10.1109/TIP.2017.2691802]

Fu X Y, Huang J B, Zeng D L, Huang Y, Ding X H and Paisley J.2017b.Removing rain from single images via a deep detail network//Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition.Honolulu,USA: IEEE: 1715-1723[DOI: 10.1109/CVPR.2017.186]

Fu X Y, Liang B R, Huang Y, Ding X H and Paisley J.2020.Lightweight pyramid networks for image deraining.IEEE Transactions on Neural Networks and Learning Systems, 31(6): 1794-1807[DOI: 10.1109/TNNLS.2019.2926481]

Fu X Y, Qi Q, Zha Z J, Zhu Y R and Ding X H.2021.Rain streak removal via dual graph convolutional network//Proceedings of the 35th AAAI Conference on Artificial Intelligence(AAAI).Palo Alto, USA: AAAI: 1352-1360

Gabarda S and Cristóbal G.2007.Blind image quality assessment through anisotropy.Journal of the Optical Society of America A, 24(12): B42-B51[DOI: 10.1364/JOSAA.24.000B42]

Garg K and Nayar S K.2006.Photorealistic rendering of rain streaks.ACM Transactions on Graphics, 25(3): 996-1002[DOI: 10.1145/1141911.1141985]

Geiger A, Lenz P, Stiller C and Urtasun R.2013.Vision meets robotics: the KITTI dataset.The International Journal of Robotics Research, 32(11): 1231-1237[DOI: 10.1177/0278364913491297]

Geiger A, Lenz P and Urtasun R.2012.Are we ready for autonomous driving? The KITTI vision benchmark suite//Proceedings of 2012 IEEE Conference on Computer Vision and Pattern Recognition.Providence, USA: IEEE: 3354-3361[DOI: 10.1109/CVPR.2012.6248074]

Hu X W, Fu C W, Zhu L and Heng P A.2019.Depth-attentional features for single-image rain removal//Proceedings of 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Long Beach, USA: IEEE: 8014-8023[DOI: 10.1109/CVPR.2019.00821]

Huang H B, Yu A J and He R.2021.Memory oriented transfer learning for semi-supervised image deraining//Proceedings of 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Nashville, USA: IEEE: 7728-7737[DOI: 10.1109/CVPR46437.2021.00764]

Huynh-Thu Q and Ghanbari M.2008.Scope of validity of PSNR in image/video quality assessment.Electronics Letters, 44(13): 800-801[DOI: 10.1049/el:20080522]

Jiang K, Wang Z Y, Yi P, Chen C, Huang B J, Luo Y M, Ma J Y and Jiang J J.2020.Multi-scale progressive fusion network for single image deraining//Proceedings of 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Seattle,USA: IEEE: 8343-8352[DOI: 10.1109/CVPR42600.2020.00837]

Jiang N F, Chen W L, Lin L Q and Zhao T S.2021.Single image rain removal via multi-module deep grid network.Computer Vision and Image Understanding, 202: #103106[DOI: 10.1016/j.cviu.2020.103106]

Jin J C, Fatemi A, Lira W M P, Yu F G, Leng B, Ma R, Mahdavi-Amiri A and Zhang H.2021.RaidaR: a rich annotated image dataset of rainy street scenes//Proceedings of 2021 IEEE/CVF International Conference on Computer Vision Workshops.Montreal, Canada: IEEE: 2951-2961[DOI: 10.1109/ICCVW54120.2021.00330]

Jin X, Chen Z B, Lin J X, Chen Z K and Zhou W.2019.Unsupervised single image deraining with self-supervised constraints//Proceedings of 2019 IEEE International Conference on Image Processing(ICIP).Taipei, China: IEEE: 2761-2765[DOI: 10.1109/ICIP.2019.8803238]

Lee J H, Han M K, Ko D W and Suh I H.2019.From big to small: multi-scale local planar guidance for monocular depth estimation[EB/OL].[2021-09-23].https://arxiv.53yu.com/pdf/1907.10326.pdf

Li B Y, Ren W Q, Fu D P, Tao D C, Feng D, Zeng W J and Wang Z Y.2019a.Benchmarking single-image dehazing and beyond.IEEE Transactions on Image Processing, 28(1): 492-505[DOI: 10.1109/TIP.2018.2867951]

Li G B, He X, Zhang W, Chang H Y, Dong L and Lin L.2018a.Non-locally enhanced encoder-decoder network for single image de-raining//Proceedings of the 26th ACM International Conference on Multimedia.Seoul, Korea(South): ACM: 1056-1064[DOI: 10.1145/3240508.3240636]

Li L D, Yan Y, Fang Y M, Wang S Q, Tang L and Qian J S.2016a.Perceptual quality evaluation for image defocus deblurring.Signal Processing: Image Communication, 48: 81-91[DOI: 10.1016/j.image.2016.09.005]

Li L D, Zhou Y, Gu K, Yang Y Z and Fang Y M.2020a.Blind realistic blur assessment based on discrepancy learning.IEEE Transactions on Circuits and Systems for Video Technology, 30(11): 3859-3869[DOI: 10.1109/TCSVT.2019.2947450]

Li R T, Cheong L F and Tan R T.2017.Single image deraining using scale-aware multi-stage recurrent network[EB/OL].[2021-11-01].https://arxiv.53yu.com/pdf/1712.06830.pdf

Li R T, Cheong L F and Tan R T.2019b.Heavy rain image restoration: integrating physics model and conditional adversarial learning//Proceedings of 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Long Beach, USA: IEEE: 1633-1642[DOI: 10.1109/CVPR.2019.00173]

Li R T, Tan R T and Cheong L F.2020b.All in one bad weather removal using architectural search//Proceedings of 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Seattle,USA: IEEE: 3172-3182[DOI: 10.1109/CVPR42600.2020.00324]

Li S Y, Araujo I B, Ren W Q, Wang Z Y, Tokuda E K, Junior R H, Cesar-Junior R, Zhang J W, Guo X J and Cao X C.2019c.Single image deraining: a comprehensive benchmark analysis//Proceedings of 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Long Beach, USA: IEEE: 3833-3842[DOI: 10.1109/CVPR.2019.00396]

Li S Y, Ren W Q, Zhang J W, Yu J K and Guo X J.2019d.Single image rain removal via a deep decomposition-composition network.Computer Vision and Image Understanding, 186: 48-57[DOI: 10.1016/j.cviu.2019.05.003]

Li X, Wu J L, Lin Z C, Liu H and Zha H B.2018b.Recurrent squeeze-and-excitation context aggregation net for single image deraining//Proceedings of the 15th European Conference on Computer Vision(ECCV).Munich, Germany: Springer: 262-277[DOI: 10.1007/978-3-030-01234-2_16]

Li Y, Tan R T, Guo X J, Lu J B and Brown M S.2016b.Rain streak removal using layer priors//Proceedings of 2016 IEEE Conference on Computer Vision and Pattern Recognition.Las Vegas, USA: IEEE: 2736-2744[DOI: 10.1109/CVPR.2016.299]

Liu D, Wen B H, Liu X M, Wang Z Y and Huang T S.2018.When image denoising meets high-level vision tasks: a deep learning approach//Proceedings of the 27th International Joint Conference on Artificial Intelligence.Stockholm, Sweden: AAAI Press: 842-848

Liu L X, Liu B, Huang H and Bovik A C.2014.No-reference image quality assessment based on spatial and spectral entropies.Signal Processing: Image Communication, 29(8): 856-863[DOI: 10.1016/j.image.2014.06.006]

Liu R S, Jiang Z Y, Fan X and Luo Z X.2020.Knowledge-driven deep unrolling for robust image layer separation.IEEE Transactions on Neural Networks and Learning Systems, 31(5): 1653-1666[DOI: 10.1109/TNNLS.2019.2921597]

Liu X, Suganuma M, Sun Z and Okatani T.2019.Dual residual networks leveraging the potential of paired operations for image restoration//Proceedings of 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Long Beach, USA: IEEE: 7000-7009[DOI: 10.1109/CVPR.2019.00717]

Ma C, Yang C Y, Yang X K and Yang M H.2017.Learning a no-reference quality metric for single-image super-resolution.Computer Vision and Image Understanding, 158: 1-16[DOI: 10.1016/j.cviu.2016.12.009]

Ma J P, Wu J J, Li L D, Dong W S, Xie X M, Shi G M and Lin W S.2021.Blind image quality assessment with active inference.IEEE Transactions on Image Processing, 33: 3650-3663[DOI: 10.1109/TIP.2021.3064195]

Ma K D and Fang Y M.2021.Image quality assessment in the modern age//Proceedings of the 29th ACM International Conference on Multimedia.ACM: 5664-5666[DOI: 10.1145/3474085.3478870]

Mittal A, Moorthy A K and Bovik A C.2012.Blind/referenceless image spatial quality evaluator//Proceedings of 2011 Conference Record of the 45th Asilomar Conference on Signals, Systems and Computers(ASILOMAR).Pacific Grove, USA: IEEE: 723-727[DOI: 10.1109/ACSSC.2011.6190099]

Mittal A, Soundararajan R and Bovik A C.2013.Making a “Completely Blind” image quality analyze.IEEE Signal Processing Letters, 20(3): 209-212[DOI: 10.1109/LSP.2012.2227726]

Moorthy A K and Bovik A C.2010.A two-step framework for constructing blind image quality indices.IEEE Signal Processing Letters, 17(5): 513-516[DOI: 10.1109/LSP.2010.2043888]

Mu P, Chen J, Liu R S, Fan X and Luo Z X.2019.Learning bilevel layer priors for single image rain streaks removal.IEEE Signal Processing Letters, 26(2): 307-311[DOI: 10.1109/LSP.2018.2889277]

Ni S Q, Cao X Y, Yue T and Hu X M.2021.Controlling the rain: from removal to rendering//Proceedings of 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR).Nashville,USA: IEEE: 6324-6333[DOI: 10.1109/CVPR46437.2021.00626]

Pan J S, Liu S F, Sun D Q, Zhang J W, Liu Y, Ren J, Li Z C, Tang J H, Lu H C, Tai Y W and Yang M H.2018.Learning dual convolutional neural networks for low-level vision//Proceedings of 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Salt Lake City, USA: IEEE: 3070-3079[DOI: 10.1109/CVPR.2018.00324]

Qian R, Tan R T, Yang W H, Su J J and Liu J Y.2018.Attentive generative adversarial network for raindrop removal from a single image//Proceedings of 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Salt Lake City, USA: IEEE: 2482-2491[DOI: 10.1109/CVPR.2018.00263]

Qin Q, Yan J K, Wang Q, Wang X, Li M Y and Wang Y Q.2021.ETDNet: an efficient transformer deraining model.IEEE Access, 9: 119881-119893[DOI: 10.1109/ACCESS.2021.3108516]

Qiu Y R, Yao G L, Feng J and Cui H Y.2021.Single image de-raining algorithm based on semi-supervised learning[J/OL].[2021-06-11].Journal of Computer Applications, 1-7(邱永茹, 姚光乐, 冯杰, 崔昊宇.2021.基于半监督学习的单幅图像去雨算法[J/OL].[2021-06-11].计算机应用, 1-7.https://kns.cnki.net/KCMS/detail/detail.aspx?dbcode=CJFQ&dbname=CAPJLAST& filename=JSJY20210610002)

Quan R J, Yu X, Liang Y Z and Yang Y.2021.Removing raindrops and rain streaks in one go//Proceedings of 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Nashville, USA: IEEE: 9143-9152[DOI: 10.1109/CVPR46437.2021.00903]

Quan Y H, Deng S J, Chen Y X and Ji H.2019.Deep learning for seeing through window with raindrops//Proceedings of 2019 IEEE/CVF International Conference on Computer Vision.Seoul, Korea(South): IEEE: 2463-2471[DOI: 10.1109/ICCV.2019.00255]

Redmon J and Farhadi A.2018.YOLOv3: an incremental improvement[EB/OL].[2021-11-01].https://arxiv.53yu.com/pdf/1804.02767.pdf

Ren D W, Zuo W M, Hu Q H, Zhu P F and Meng D Y.2019.Progressive image deraining networks: a better and simpler baseline//Proceedings of 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Long Beach, USA: IEEE: 3932-3941[DOI: 10.1109/CVPR.2019.00406]

Ren S Q, He K M, Girshick R and Sun J.2017.Faster R-CNN: towards real-time object detection with region proposal networks.IEEE Transactions on Pattern Analysis and Machine Intelligence, 39(6): 1137-1149[DOI: 10.1109/TPAMI.2016.2577031]

Saad M A, Bovik A C and Charrier C.2010.A DCT statistics-based blind image quality index.IEEE Signal Processing Letters, 17(6): 583-586[DOI: 10.1109/LSP.2010.2045550]

Schaefer G and Stich M.2003.UCID: an uncompressed color image database//Proceedings of SPIE 5307, Storage and Retrieval Methods and Applications for Multimedia 2004.San Jose, USA: SPIE: 472-480[DOI: 10.1117/12.525375]

Shao M W, Li L, Meng D Y and Zuo W M.2021a.Uncertainty guided multi-scale attention network for raindrop removal from a single image.IEEE Transactions on Image Processing, 30: 4828-4839[DOI: 10.1109/TIP.2021.3076283]

Shao M W, Li L, Wang H and Meng D Y.2021b.Selective generative adversarial network for raindrop removal from a single image.Neurocomputing, 426: 265-273[DOI: 10.1016/j.neucom.2020.06.134]

Silberman N, Hoiem D, Kohli P and Fergus R.2012.Indoor segmentation and support inference from RGBD images//Proceedings of the 12th European Conference on Computer Vision.Florence, Italy: Springer: 746-760[DOI: 10.1007/978-3-642-33715-4_54]

Su Z P, Zhang Y X, Zhang X P and Qi F.2022.Non-local channel aggregation network for single image rain removal.Neurocomputing, 469: 261-272[DOI: 10.1016/j.neucom.2021.10.052]

Tan F X, Kong Y T, Fan Y Y, Liu F, Zhou D X, Zhang H, Chen L, Gao L and Qian Y R.2021.SDNet: mutil-branch for single image deraining using swin[EB/OL].[2021-05-31].https://arxiv.53yu.com/pdf/2105.15077.pdf

Tremblay M, Halder S S, De Charette R and Lalonde J F.2021.Rain rendering for evaluating and improving robustness to bad weather.International Journal of Computer Vision, 129(2): 341-360[DOI: 10.1007/s11263-020-01366-3]

Venkatanath N, Praneeth D, Chandrasekhar M, Channappayya S S and Medasani S S.2015.Blind image quality evaluation using perception based features//Proceedings of the 21st National Conference on Communications(NCC).Mumbai, India: IEEE: 1-6[DOI: 10.1109/NCC.2015.7084843]

Vu D T, Gonzalez J L and Kim M.2021.Exploiting global and local attentions for heavy rain removal on single images[EB/OL].[2021-04-16].https://arxiv.53yu.com/pdf/2104.08126.pdf

Wang C, Wang H Y, Su Z X and Yang Y.2019a.Embedding non-local mean in squeeze-and-excitation network for single image deraining//Proceedings of 2019 IEEE International Conference on Multimedia and Expo Workshops.Shanghai, China: IEEE: 264-269[DOI: 10.1109/ICMEW.2019.00-76]

Wang C, Wu Y T, Su Z X and Chen J Y.2020a.Joint self-attention and scale-aggregation for self-calibrated deraining network//Proceedings of the 28th ACM International Conference on Multimedia.Seattle, USA: ACM: 2517-2525[DOI: 10.1145/3394171.3413559]

Wang C, Xing X Y, Wu Y T, Su Z X and Chen J Y.2020b.DCSFN: deep cross-scale fusion network for single image rain removal//Proceedings of the 28th ACM International Conference on Multimedia.Seattle, USA: ACM: 1643-1651[DOI: 10.1145/3394171.3413820]

Wang G Q, Sun C M and Sowmya A.2021a.Context-enhanced representation learning for single image deraining.International Journal of Computer Vision, 129(5): 1650-1674[DOI: 10.1007/s11263-020-01425-9]

Wang H, Wu Y C, Li M H, Zhao Q and Meng D Y.2019b.Survey on rain removal from video and single image.SCIENCE CHINA Information Sciences[EB/OL].[2021-11-01].https://arxiv.53yu.com/pdf/1909.08326.pdf

Wang H, Wu Y C, Xie Q, Zhao Q, Liang Y, Zhang S J and Meng D Y.2021b.Structural residual learning for single image rain removal.Knowledge-Based Systems, 213: #106595[DOI: 10.1016/j.knosys.2020.106595]

Wang H, Xie Q, Wu Y C, Zhao Q and Meng D Y.2020c.Single image rain streaks removal: a review and an exploration.International Journal of Machine Learning and Cybernetics, 11(4): 853-872[DOI: 10.1007/s13042-020-01061-2]

Wang H, Xie Q, Zhao Q and Meng D Y.2020d.A model-driven deep neural network for single image rain removal//Proceedings of 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Seattle, USA: IEEE: 3100-3109[DOI: 10.1109/CVPR42600.2020.00317]

Wang H, Yue Z S, Xie Q, Zhao Q, Zheng Y F and Meng D Y.2021c.From rain generation to rain removal//Proceedings of 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Nashville, USA: IEEE: 14786-14796[DOI: 10.1109/CVPR46437.2021.01455]

Wang M H, He H J and Li C.2020.Single image rain removal based on selective kernel convolution using a residual refine factor.Journal of Image and Graphics, 25(12): 2484-2493(王美华, 何海君, 李超.2020.自适应卷积的残差修正单幅图像去雨.中国图象图形学报, 25(12): 2484-2493)[DOI: 10.11834/jig.190682]

Wang T Y, Yang X, Xu K, Chen S, Zhang Q and Lau R W H.2019c.Spatial attentive single-image deraining with a high quality real rain dataset//Proceedings of 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Long Beach, USA: IEEE: 12262-12271[DOI: 10.1109/CVPR.2019.01255]

Wang X F, Chen J, Jiang K, Han Z, Ruan W J, Wang Z Y and Liang C.2020e.Single image de-raining via clique recursive feedback mechanism.Neurocomputing, 417: 142-154[DOI: 10.1016/j.neucom.2020.07.083]

Wang Y L, Gong D, Yang J, Shi Q F, Van Den Hengel A, Xie D H and Zeng B.2020f.Deep single image deraining via modeling haze-like effect.IEEE Transactions on Multimedia, 23: 2481-2492[DOI: 10.1109/tmm.2020.3013383]

Wang Y L, Ma C and Zeng B.2021d.Multi-decoding deraining network and quasi-sparsity based training//Proceedings of 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Nashville, USA: IEEE: 13370-13379

Wang Y L, Song Y B, Ma C and Zeng B.2020g.Rethinking image deraining via rain streaks and vapors//Proceedings of the 16th European Conference on Computer Vision.Glasgow, USA: Springer: 367-382[DOI: 10.1007/978-3-030-58520-4_22]

Wang Z, Bovik A C, Sheikh H R and Simoncelli E P.2004.Image quality assessment: from error visibility to structural similarity.IEEE Transactions on Image Processing, 13(4): 600-612[DOI: 10.1109/TIP.2003.819861]

Wang Z, Li J W and Song G.2020h.DTDN: dual-task de-raining network//Proceedings of the 27th ACM International Conference on Multimedia.Nice, France: ACM: 1833-1841[DOI: 10.1145/3343031.3350945]

Wang Z D, Cun X D, Bao J M, Zhou W G, Liu J Z and Li H Q.2021e.Uformer: a general U-shaped transformer for image restoration[EB/OL].[2021-11-15].https://arviv.org/pdf/2106.03106.pdf

Wang Z Y, Chang S Y, Yang Y Z, Liu D and Huang T S.2016.Studying very low resolution recognition using deep networks//Proceedings of 2016 IEEE Conference on Computer Vision and Pattern Recognition.Las Vegas,USA: IEEE: 4792-4800[DOI: 10.1109/CVPR.2016.518]

Wei W, Meng D Y, Zhao Q, Xu Z B and Wu Y.2019a.Semi-supervised transfer learning for image rain removal//Proceedings of 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Long Beach, USA: IEEE: 3872-3881[DOI: 10.1109/CVPR.2019.00400]

Wei Y Y, Zhang Z, Wang Y, Xu M L, Yang Y, Yan S C and Wang M.2021a.DerainCycleGAN: rain attentive CycleGAN for single image deraining and rainmaking.IEEE Transactions on Image Processing, 30: 4788-4801[DOI: 10.1109/TIP.2021.3074804]

Wei Y Y, Zhang Z, Wang Y, Zhang H J, Zhao M B, Xu M L and Wang M.2021b.Semi-deraingan: a new semi-supervised single image deraining//Proceedings of 2021 IEEE International Conference on Multimedia and Expo(ICME).Shenzhen, China: IEEE: 1-6[DOI: 10.1109/ICME51207.2021.9428285]

Wei Y Y, Zhang Z, Zhang H J, Hong R C and Wang M.2019b.A coarse-to-fine multi-stream hybrid deraining network for single image deraining//Proceedings of 2019 IEEE International Conference on Data Mining.Beijing, China: IEEE: 628-637[DOI: 10.1109/ICDM.2019.00073]

Xie Q Q, Zhang H and Gai S.2022.Multi-resolution context aggregation network for single image rain removal.Journal of Computer-Aided Design and Computer Graphics, 34(2): 232-244(谢强强, 张海, 盖杉.2022.多分辨率上下文聚合网络的单幅图像去雨方法.计算机辅助设计与图形学学报, 34(2): 232-244)[DOI: 10.3724/SP.J.1089.2022.18887]

Xue P and He H.2021.Research of single image rain removal algorithm based on LBP-CGAN rain generation method.Mathematical Problems in Engineering, 2021: #8865843[DOI: 10.1155/2021/8865843]

Yang W H, Liu J Y, Yang S and Guo Z M.2019a.Scale-free single image deraining via visibility-enhanced recurrent wavelet learning.IEEE Transactions on Image Processing, 28(6): 2948-2961[DOI: 10.1109/TIP.2019.2892685]

Yang W H, Tan R T, Feng J S, Guo Z M, Yan S C and Liu J Y.2020a.Joint rain detection and removal from a single image with contextualized deep networks.IEEE Transactions on Pattern Analysis and Machine Intelligence, 42(6): 1377-1393[DOI: 10.1109/TPAMI.2019.2895793]

Yang W H, Tan R T, Feng J S, Liu J Y, Guo Z M and Yan S C.2017.Deep joint rain detection and removal from a single image//Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition.Honolulu, USA: IEEE: 1685-1694[DOI: 10.1109/CVPR.2017.183]

Yang W H, Tan R T, Wang S Q, Fang Y M and Liu J Y.2021.Single image deraining: from model-based to data-driven and beyond.IEEE Transactions on Pattern Analysis and Machine Intelligence, 43(11): 4059-4077[DOI: 10.1109/TPAMI.2020.2995190]

Yang Y Z and Lu H.2019b.Single image deraining using a recurrent multi-scale aggregation and enhancement network//Proceedings of 2019 IEEE International Conference on Multimedia and Expo.Shanghai, China: IEEE: 1378-1383[DOI: 10.1109/ICME.2019.00239]

Yang Y Z and Lu H.2019c.Single image deraining via recurrent hierarchy enhancement network//Proceedings of the 27th ACM International Conference on Multimedia.Nice, France: ACM: 1814-1822[DOI: 10.1145/3343031.3351149]

Yang Y Z, Ran W and Lu H.2020b.Rddan: a residual dense dilated aggregated network for single image deraining//Proceedings of 2020 IEEE International Conference on Multimedia and Expo(ICME).London, UK: IEEE: 1-6[DOI: 10.1109/ICME46284.2020.9102945]

Yasarla R and Patel V M.2019.Uncertainty guided multi-scale residual learning-using a cycle spinning CNN for single image de-raining//Proceedings of 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Long Beach, USA: IEEE: 8397-8406[DOI: 10.1109/CVPR.2019.00860]

Yasarla R and Patel V M.2020.Confidence measure guided single image de-raining.IEEE Transactions on Image Processing, 29: 4544-4555[DOI: 10.1109/TIP.2020.2973802]

Yasarla R, Sindagi V A and Patel V M.2020.Syn2Real transfer learning for image deraining using gaussian processes//Proceedings of 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Seattle, USA: IEEE: 2723-2733[DOI: 10.1109/CVPR42600.2020.00280]

Ye Y T, Chang Y, Zhou H Y and Yan L X.2021.Closing the loop: joint rain generation and removal via disentangled image translation//Proceedings of 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Nashville, USA: IEEE: 2053-2062[DOI: 10.1109/CVPR46437.2021.00209]

Yu W J, Huang Z, Zhang W, Feng L T and Xiao N.2019.Gradual network for single image de-raining//Proceedings of the 27th ACM International Conference on Multimedia.Nice, France: ACM: 1795-1804[DOI: 10.1145/3343031.3350883]

Zhang H and Patel V M.2018.Density-aware single image de-raining using a multi-stream dense network//Proceedings of 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Salt Lake City, USA: IEEE: 695-704[DOI: 10.1109/CVPR.2018.00079]

Zhang H, Sindagi V and Patel V M.2020a.Image de-raining using a conditional generative adversarial network.IEEE Transactions on Circuits and Systems for Video Technology, 30(11): 3943-3956[DOI: 10.1109/TCSVT.2019.2920407]

Zhang K H, Li D X, Luo W H and Ren W Q.2021a.Dual attention-in-attention model for joint rain streak and raindrop removal.IEEE Transactions on Image Processing, 30: 7608-7619[DOI: 10.1109/TIP.2021.3108019]

Zhang K H, Luo W H, Yu Y J, Ren W Q, Zhao F, Li C S, Ma L, Liu W and Li H D.2021b.Beyond monocular deraining: parallel stereo deraining network via semantic prior[EB/OL].[2021-05-09].https://arxiv.53yu.com/pdf/2105.03830.pdf

Zhang L, Zhang L and Bovik A C.2015.A feature-enriched completely blind image quality evaluator.IEEE Transactions on Image Processing, 24(8): 2579-2591

Zhang W X, Li D Q, Ma C, Zhai G T, Yang X K and Ma K D.2021c.Continual learning for blind image quality assessment[EB/OL].[2021-02-19].https://arxiv.53yu.com/pdf/2102.09717.pdf

Zhang W X, Ma K D, Yan J, Deng D X and Wang Z.2020b.Blind image quality assessment using a deep bilinear convolutional neural network.IEEE Transactions on Circuits and Systems for Video Technology, 30(1): 36-47[DOI: 10.1109/TCSVT.2018.2886771]

Zhang W X, Ma K D, Zhai G T and Yang X K.2021 d.Task-specific normalization for continual learning of blind image quality models[EB/OL].[2021-07-28].https://arxiv.53yu.com/pdf/2107.13429.pdf

Zhang X F and Li J J.2021.Single image de-raining using a recurrent dual-attention-residual ensemble network.Journal of Software, 32(10): 3283-3292(张学锋, 李金晶.2021.基于双注意力残差循环单幅图像去雨集成网络.软件学报, 32(10): 3283-3292)[DOI: 10.13328/j.cnki.jos.006018]

Zhang Z, Wei Y Y, Zhang H J, Yang Y, Yan S C and Wang M.2021e.Data-driven single image deraining: a comprehensive review and new perspectives.TechRxiv Preprint

Zhao H S, Shi J P, Qi X J, Wang X G and Jia J Y.2017.Pyramid scene parsing network//Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition.Honolulu, USA: IEEE: 6230-6239[DOI: 10.1109/CVPR.2017.660]

Zheng Y P, Yu X, Liu M M and Zhang S L.2019.Residual multiscale based single image deraining//Proceedings of the 30th British Machine Vision Conference 2019.Cardiff, UK: BMVC: 147

Zheng Y P, Yu X, Liu M M and Zhang S L.2022.Single-image deraining via recurrent residual multiscale networks.IEEE Transactions on Neural Networks and Learning Systems, 33(3): 1310-1323[DOI: 10.1109/TNNLS.2020.3041752]

Zhu H D, Wang C, Zhang Y J, Su Z X and Zhao G H.2020.Physical model guided deep image deraining//Proceedings of 2020 IEEE International Conference on Multimedia and Expo(ICME).London, UK: IEEE: 1-6[DOI: 10.1109/ICME46284.2020.9102878]

Zhu H Y, Peng X, Zhou J T, Yang S F, Chanderasekh V, Li L Y and Lim J H.2019.Singe image rain removal with unpaired information: a differentiable programming perspective.Proceedings of the AAAI Conference on Artificial Intelligence, 33(1): 9332-9339[DOI: 10.1609/aaai.v33i01.33019332]