基于最小二乘法的关节机器人定位精度标定方法

欧阳旭东,骆林,许璟,刘子杨

基于最小二乘法的关节机器人定位精度标定方法

欧阳旭东,骆林,许璟,刘子杨

(成都飞机工业( 集团) 有限责任公司,四川 成都 610091)

关节机器人的定位精度标定通常需要建立复杂的数学模型,本研究提出一种关节机器人定位精度标定方法,旨在简化标定过程中的复杂计算。将相机置于关节器人末端,垂直于相机光轴的平面上放置靶标,在关节转动过程中采集各测量点的靶标图像,然后利用图像算法识别各测量点靶标的成像情况,应用最小二乘法求解关节的转动误差分布情况。通过对机器人的J1关节进行标定试验,得到J1关节的转动误差分布情况,并求解出补偿角度,补偿以后J1关节的定位精度得到了改善。

最小二乘法;机器人;定位精度;标定

机器人的定位精度取决于很多因素,主要包括机器人零部件的加工制造误差,机器人的安装、传动结构的误差,机器人连杆和关节的柔性及机器人工作环境等因素[1-2]。标定技术是应用先进的测量手段,辨识出机器人模型的准确参数,从而提高机器人的定位精度[3-4]。离线标定是最简单的标定方法,主要通过摄像机的成像特性将需要标定的参数进行分解,建立相应的方程组,然后将离线状态下测量点的位置坐标带入,最终得到需要标定的参数[5-6]。Zhuang等[7]将摄像头安装在机器人手臂末端,然后利用复杂的非线性算法同时对计算摄像机参数和转换矩阵求解。刘宏建等[8]利用机器人自身的运动模式,直接确定初值,在一定程度上减小经验选择给结果带来的误差。虽然上述方法建立的模型相当精确,但计算却非常复杂,同时需要估计适当的初始条件值。

针对多关节机器人,提出一种基于最小二乘法的关节机器人定位精度标定方法,对每个关节的定位精度依次进行标定,通常在其他关节运动归零的情况下进行标定,机器人的末端位置变化相对简单,可以降低复杂的计算,提高标定效率,以建立一种有效、快速的视觉检测系统。

1 基于最小二乘法的关节定位精度标定方法

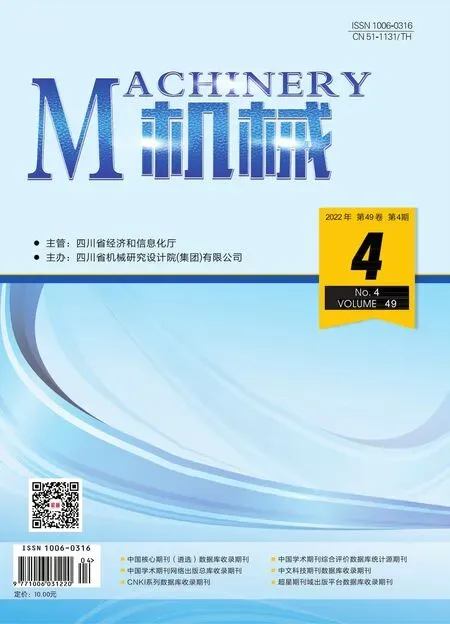

将相机固定于机器人手部末端位置,在垂直于相机光轴的平面上放置一个用于标定检测的目标对象(靶标),始终保持其位置不变,当相机随机器人位置变化时,目标对象在相机中的成像位置也会发生变化,且总是和相机的运动方向相反,相机的成像情况如图1所示。

图1 关节转动过程目标点在相机中的成像原理

控制机器人其中一个关节转动,其他关节保持不动,在到达各指定位置时,采集若干含有目标对象的图片,然后利用图像处理程序识别目标对象的中心,使用最小二乘法拟合计算出各目标对象中心之间的相对位置关系[9],进而求解出相机及机器人末端位置的变化。所以方法的重点在于目标对象的识别以及目标对象之间位置关系的计算。目标对象残缺或在相机视野中丢失,都会影响到其相对位置的确定。因此,在标定操作过程中,应保证各指定位置拍摄的图片上目标对象的完整性。为了能让机器人在标定实验中有较大的活动范围,可以采用小焦距镜头,获得较大的视野,同时增大目标对象的面积,提高识别的准确性。

2 关节机器人定位精度标定实验

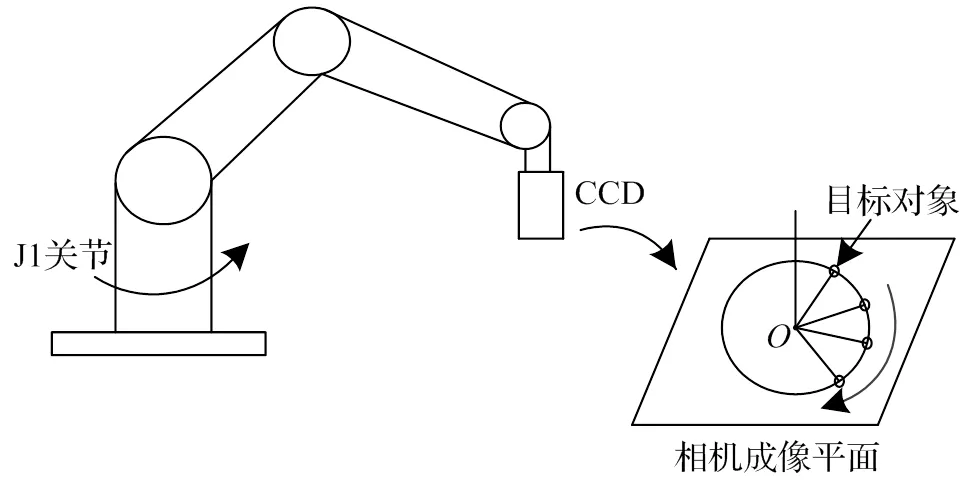

图2是关节机器人精度标定的试验平台,主要包含关节机器人、机器人控制器、CCD相机、图像采集卡、计算机以及相关软件组成。在实验过程中,机器人的位置会发生各种变化,CCD相机完成目标图像的获取后,经过图像采集卡的量化获得数字图像,再使用图像的识别算法得到目标对象在图像中的像素位置,最后通过定位算法就可以计算出机器人变化后的位置,将其作为标定机器人的数据。

图2 基于机器视觉的标定试验平台

2.1 J1关节标定实验

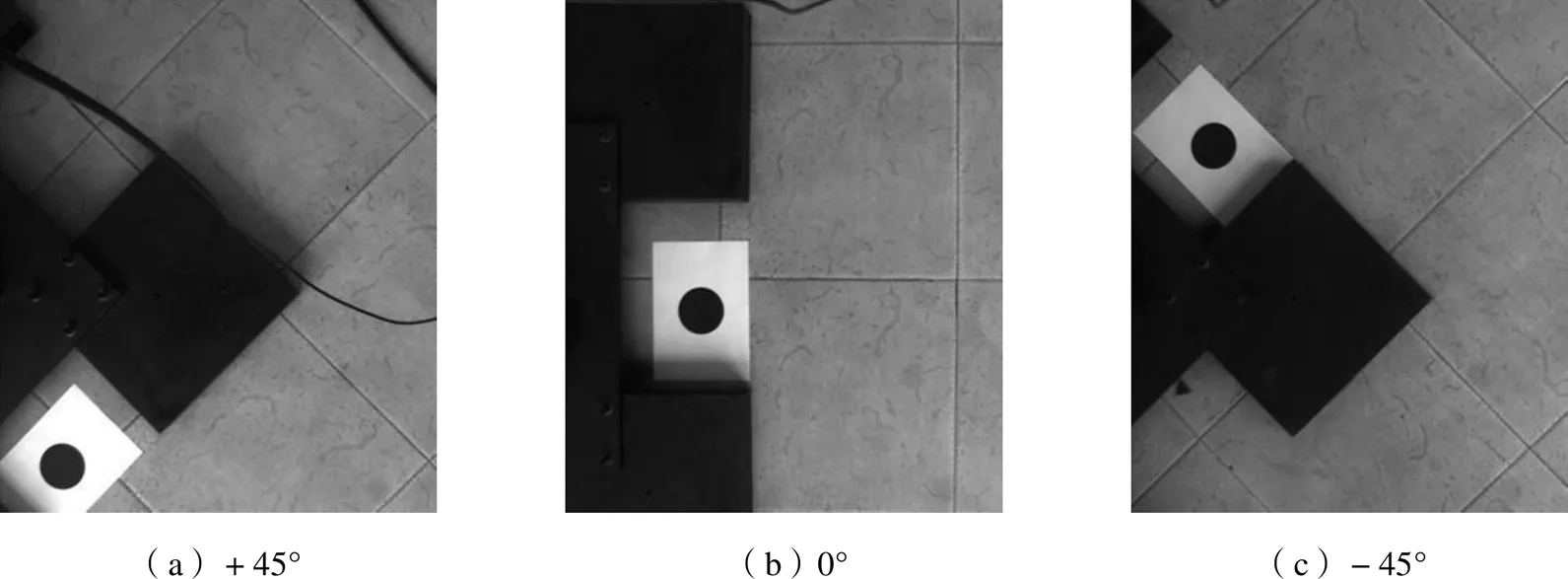

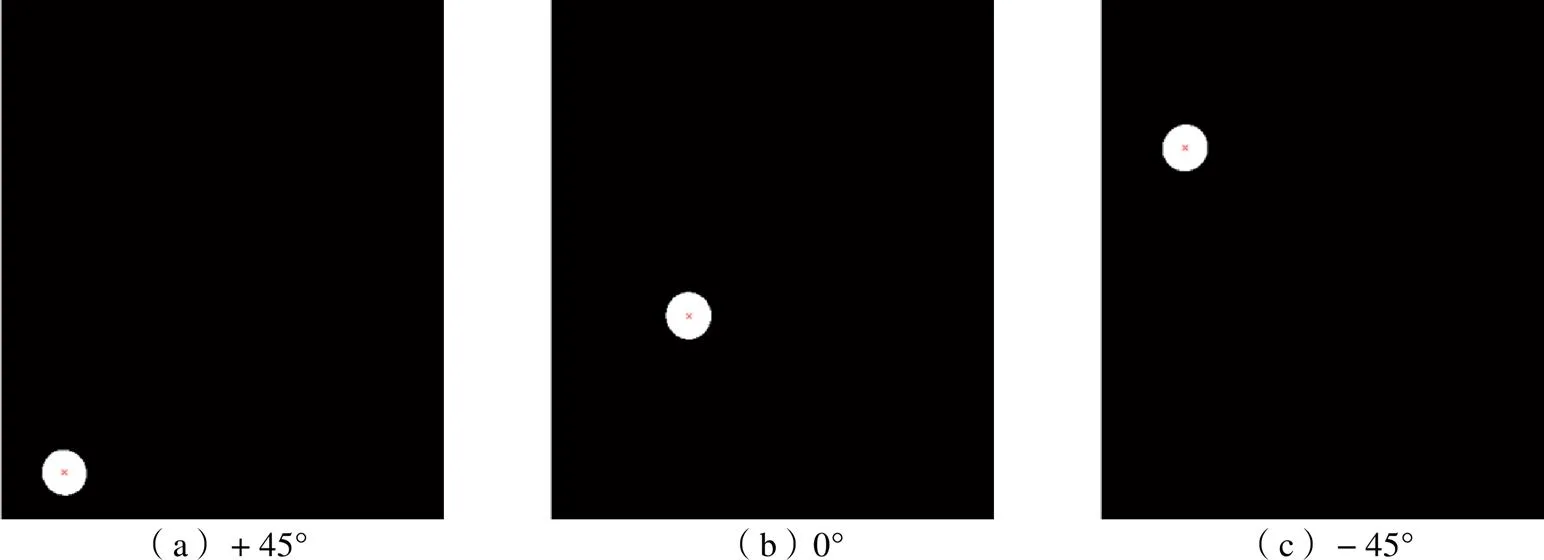

J1关节的标定如图3所示,将目标对象放置于垂直相机的平面上,具体实验步骤如下:

(1)将机器人所有关节回到零位,拍下此时靶标的图片,作为零点图片。

(2)将J1轴逆时针旋转到+45°的位置,整个标定过程其余轴都保持在零位不动,拍下此时靶标的图片,标记为1。

(3)以每5°为步距,让其向反方向运动,拍下每一个位置点的靶标图片,并依次标号,在-45°的位置停止运动。把+45°到-45°的过程规定为去程,即图片1~19表示去程。

(4)继续以5°为步距,让其向正方向运动,拍下每一个位置点靶标的图片,并依次标号,在+45°的位置停止运动。把-45°到+45°的过程规定为回程,即图片19~37表示回程。

图3 J1关节标定实验

2.2 数据处理

其他关节的标定步骤和J1关节大致相同,只是需要调整靶标的放置平面,始终保证平面与相机的光轴垂直,同时整个标定过程其余轴都保持在零位不动。每个关节的标定实验都采集多组数据求平均值,且每次实验之前都要回零,并拍下零点图片。

按照上述J1关节的标定步骤,每一组实验可以获得标号为1~37的靶标图片,图4为J1关节分别在+45°、0°、-45°时对应的靶标图片。通过计算这些靶标之间的相对旋转角度,可以求解关节的实际转动角度。

应用图像处理对各靶标图片进行识别以及中心的提取,处理结果如图5所示。

在得到37个靶标中心点的坐标位置之后,利用最小二乘法将这些离散点拟合成一个圆,进而求取各个测定点的机器人实际偏转角度,拟合后的结果如图6所示。

然后对相应的角度进行求解和分析,求取相邻两点之间的转动角度,即可对机器人输入输出单响应进行分析;求取测点和零点图片靶标之间的转动角度,即可对机器人累积误差和输入输出累积响应进行分析。

图4 J1关节标定实验靶标图片

图5 图像处理后的图片

2.3 数据分析

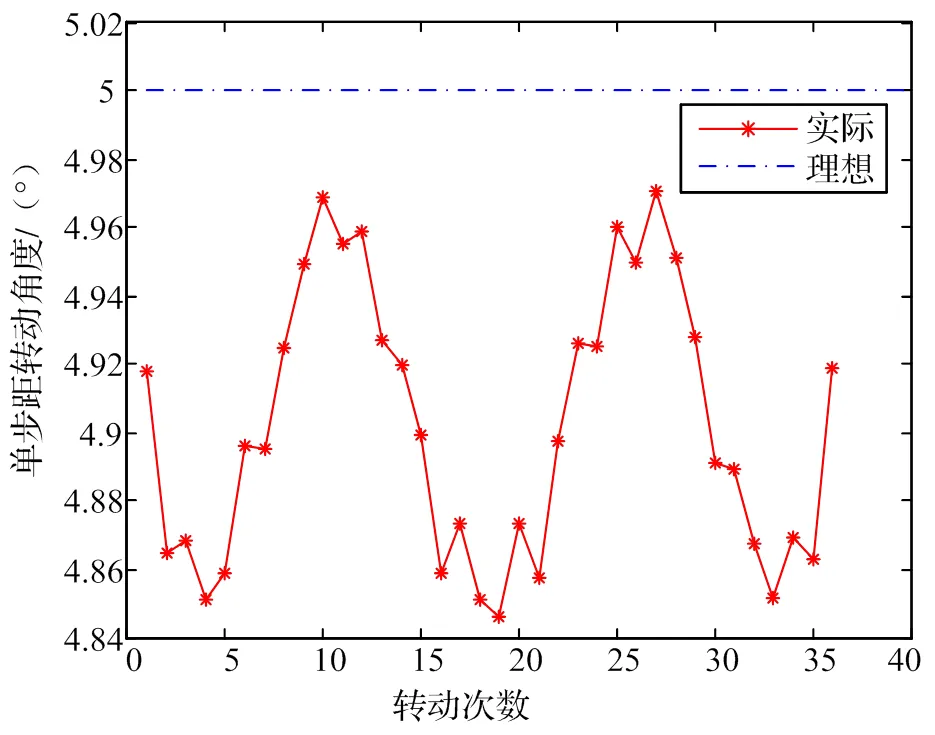

(1)输入输出单响应分析

该实验是以每5°为步距,发出信号控制机器人的运动,但机器人每次实际运动的步距可能存在着偏差,需要对其输入输出单响应进行分析。

图6 实测数据拟合圆

图7 J1关节输入输出单响应分布

图7为J1关节输入输出单响应的分布情况,其中第1~19次为去程时每次输入的响应,第19~36次为回程时的响应。可以看出,去程和回程的单响应呈相似的波动关系,响应值都小于理论值5°,其中误差最大值为0.1539°。

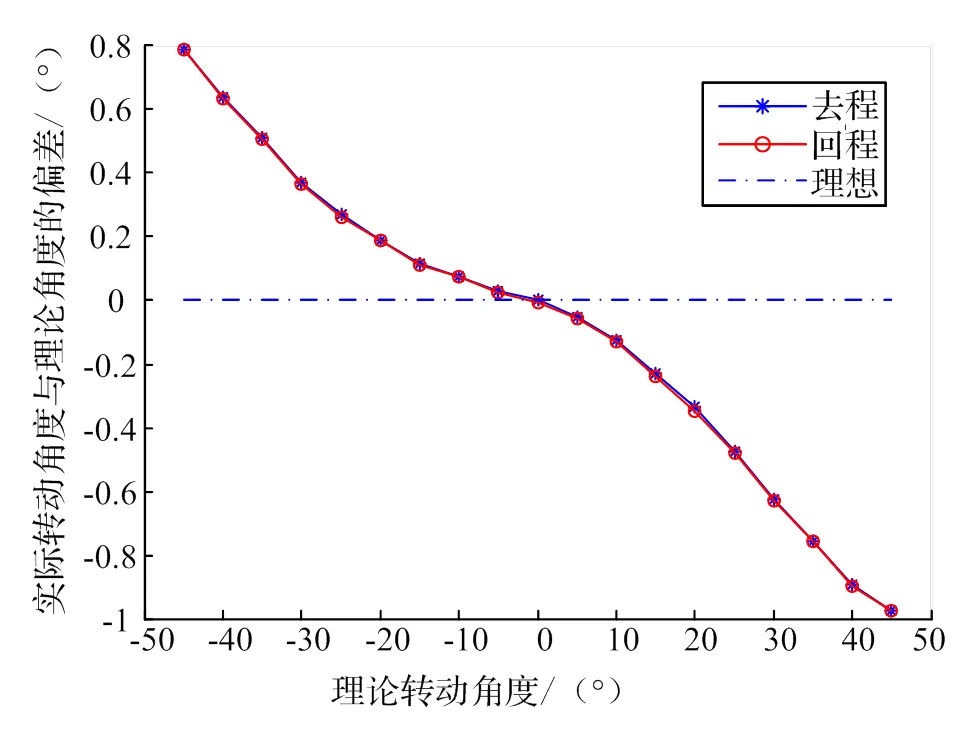

(2)输入输出累积响应分析

J1关节每次的单响应值都存在偏差,所以计算出每一个测量点的关节转动值定会存在累积误差。在求得各测定点机器人实际偏转角度后,将其与理论输入角度进行比较,可得:

式中:Δ为实际转动角度与理论角度的偏差,(°);θ为测量出来的关节实际转动角度,(°);θ为关节理论转动角度,(°)。

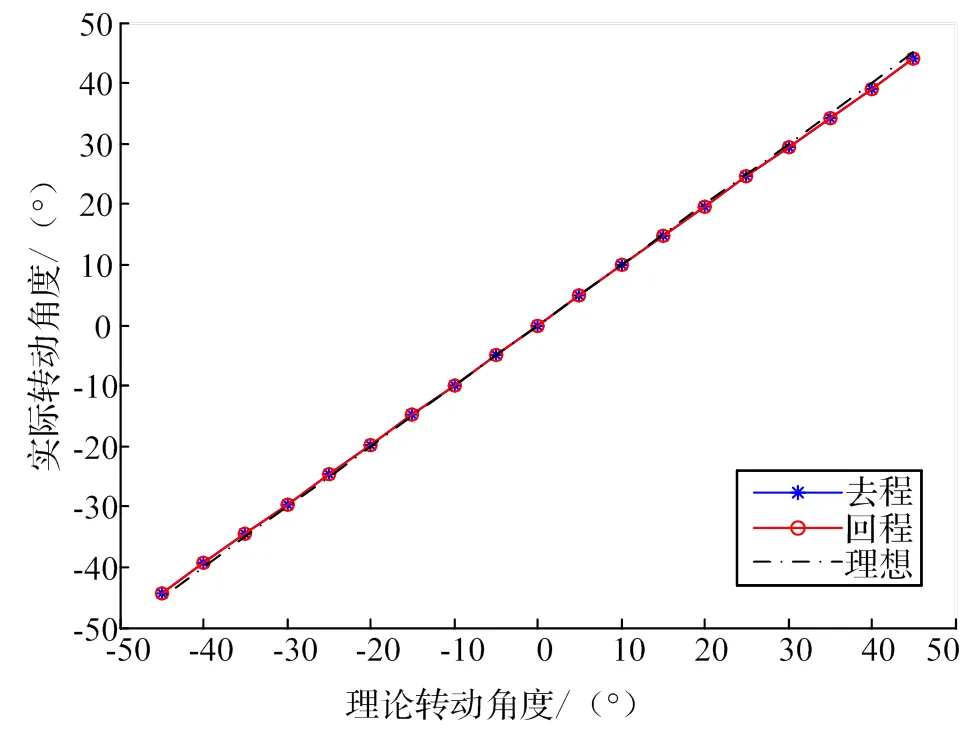

机器人关节转动过程中,其实际转动角度和理论转动角度总存在偏差,且测量次数越多,偏差越呈现关于某一平均值的正态分布[10]。由于机器人在同一位置的重复定位精度非常高,这里取多组实验数据的平均值作为J1关节的实际输出角度,得到J1关节的累积误差分布和输入输出累积响应关系,如图8和图9所示。

图8 J1关节累积误差分布情况

图9 J1关节输入输出累积响应关系

在机器人的控制程序中添加J1关节的角度补偿-Δθ1,图10为补偿以后的机器人角度偏差与补偿前的比较情况。由图可知,补偿以后机器人的定位精度偏差在数量级。

3 结论

通过设计一种关节机器人定位精度标定方法,对J1关节进行标定试验,结论如下:

(1)机器人J1关节转动过程中,去程和回程的响应误差呈相似的波动关系,且去程和回程的重合度相当高,说明重复定位精度高。

(2)分析J1关节的累积误差分布情况,求解角度补偿值-Δ1,并在机器人的控制程序中进行控制,补偿以后机器人的J1关节定位精度得到了较大改善。后续将继续探究对关节机器人的其他关节进行标定研究。

[1]焦国太,冯永和,王锋,等多因素影响下的机器人综合位姿误差分析方法[J]. 应用基础与工程科学学报(4):435-442.

[2]黄松,胡晓兵,周飞,等. 关节机器人定位精度影响因素分析[J]. 机械,2014,41(4):70-74.

[3]李振,张玉茹,刘军传. 一种基于机器视觉的机器人标定方法[J]. 机械设计与研究,2007(3):70-73.

[4]王东署. 工业机器人标定技术研究[D]. 沈阳:东北大学,2006.

[5]钱兴. 工业机器人离线标定与运动参数估计研究[D]. 天津:天津大学,2018.

[6]蔡江,刘欢. 一种用于机器人离线编程的标定方法[J]. 机电信息,2017,9(374):114-115.

[7]Zhuang H,Wang K,Roth Z. Simultaneous calibration ofa robot and a hand-mounted camera[J]. IEEE Transactionson Robotics and Automation,1995,11(5):649-640.

[8]刘宏建,石繁槐,刘允才,等. 基于机器人运动模式的手眼标定初值估计[J]. 上海交通大学学报,2005 (3):396-399.

[9]朱艳华. 最小二乘法拟合参数的求解分析[J]. 时代教育(教育教学版),2012(19):151.

[10]陈先锋,苏志兵,赵英凯. 转角-线位移式全闭环位置伺服系统及误差分析[J]. 机械与电子,2005(7):34-35.

Calibration Method of Joint Robot Positioning Accuracy Based on Least Square Method

OUYANG Xudong,LUO Lin,XU Jing,LIU Ziyang

( Chengdu Aircraft Industrial (Group) Co., Ltd., Chengdu 610091, China )

The positioning accuracy calibration of joint robot usually needs a complex mathematical model. In this study, a positioning accuracy calibration method of joint robot is proposed to simplify the complex calculation in the calibration process. The camera is placed at the end of the joint, the target is placed on the plane perpendicular to the optical axis of the camera, the target image of each measurement point is collected during the rotation of the joint, then the image algorithm is used to identify the imaging situation of the target of each measurement point, and the rotation error distribution of the joint is solved by the least square method. Through the calibration test of the J1 joint of the robot, the rotation error distribution of the J1 joint is obtained, and the compensation angle is solved. After the compensation, the positioning accuracy of the J1 joint is improved.

least square method;robot;positioning accuracy;calibration

TP242

A

10.3969/j.issn.1006-0316.2022.04.011

1006-0316 (2022) 04-0063-05

2021-09-14

欧阳旭东(1989-),男,四川绵阳人,硕士,工程师,主要从事机加工艺、自动化应用研究工作,E-mail:ouyangxd@foxmail.com。