基于融合卷积神经网络的术后宫颈癌靶区及危及器官自动勾画

【作者】周瑾,杨微,谷珊珊,全红,刘杰,鞠忠建

1 武汉大学 物理科学与技术学院,武汉市,430072

2 中国人民解放军总医院第一医学中心 放疗科,北京市,100853

3 北京东方瑞云科技有限公司,北京市,100020

0 引言

利用机器学习实现医学图像自动勾画,是现今研究的热点和难点,且已在医学图像分割领域取得初步成果[4-5]。近几年在放疗领域,利用深度学习自动分割医学图像也获得了极大发展,在鼻咽癌危及器官进行自动检测与分割[6]、肝癌的OARs分割[7]以及前列腺MRI分割[8]等均取得良好的分割结果。当前,基于MRI自动分割盆腔部位器官的研究已经取得较好的成果[9-10]。但临床中仍主要基于CT图像轮廓勾画,患者通过其他途径提供的MRI经过转存和配准后转化为CT图像存在一定误差。基于CT图像自动分割盆腔器官的研究更具临床意义,因受器官边界模糊、位置和体积变化、造影剂等因素的影响,目前仍是极具挑战性的工作。本研究尝试基于V-Net和DenseNet的融合网络,直接对宫颈癌患者盆腔部位CT图像的靶区和危及器官自动分割,评估其分割精度,及其在临床上的适用性。

1 材料与方法

1.1 病例选择

回顾性收集中国人民解放军总医院第一医学中心放疗科2016年5月到2020年6月收治的近500例宫颈癌术后患者病例数据。患者采用仰卧位热塑体膜固定,使用西门子SOMATOM Definition AS 大孔径CT机定位扫描,分辨率512×512,层厚5 mm。选取宫颈癌IB期和IIA期肿瘤靶区(cancer target volume,CTV)勾画范围大致相同患者共170例。肿瘤靶区和危及器官勾画参考RTOG CTV勾画标准,由两位主治医师完成勾画,一位主任医师审核通过。随机选取其中150例病例数据作为训练集,20例病例作数据作为测试集。

1.2 网络结构

密集V-Net网络(Dense V-Net,DVN)结合了两个网络各自的优点:V-Net能直接使用3D卷积处理输入量,其在低样本量数据集分割上有很好的效果[11-12]。DenseNet主要利用稠密块令每一层都以前馈方式直接连接到其他每一层,这种密集连接改善了欠拟合现象[13]。DVN下采样子网是由三个稠密块组成的序列,这些堆栈通过下采样跨步卷积连接,上采样网络采用双线性上采样到最终分割分辨率,令三个稠密块最终输出的大小一致。融合网络既减少了冗余参数和占用内存空间,又减少了过度拟合现象,有效地解决了训练三维数据时出现的梯度消失等问题,还改善了收敛,在不增加训练集的前提下,通过单纯地增加网络深度来提高网络性能。DVN的输出前添加了空间先验P[14],一个可训练参数的低分辨率3D映射,通过双线性上采样到最终分割分辨率。

为了提高CTV自动分割精度,根据宫颈癌靶区勾画的标准,研究采用血管定位的方法首先粗略地确定靶区区域,髂总动脉的分布及其走向与宫颈癌CTV密切相关,且个体差异性小,然后使用DVN网络精确勾画CTV。

1.3 模型训练

本融合卷积神经网络算法基于TensorFlow开发,在两块NVIDIA(GTX 1080)图形显卡的服务器上实施训练、评估和错误分析。初始学习效率设为0.0005,学习速率衰减因子为0.5,衰减步长为1000,迭代次数设为10000进行训练。

1.4 评估方法

1.4.1 评估参数

分别从勾画相似度(戴斯相似性系数,Dice similarity coefficient,DSC)、轮廓整体偏移程度(豪斯多夫距离,Hausdorff distance,HD)和体积差异(相对体积偏差,relative volume difference,RVD)三个代表性的评价标准,对自动分割结果进行分析。参数公式如下所示,其中A和B分别表示手动勾画和自动勾画的集合。

DSC表示自动分割与手动勾画区域的相似度,DSC值范围为0~1,数值越高代表自动分割效果越好:DSC(A,B)=2(|A∩B|)/ (|A|+|B|)

何晏父亲早亡,曹操娶了他母亲尹氏为妾,尹氏把何晏也带进了曹家,这种不太合常理的事情,也只有曹操做得出来。

HD衡量与手动勾画相比自动分割轮廓的偏移程度,反映的是两轮廓之间的最大差异,HD值越小分割准确率越高:HD(A,B)=max {h(A,B),h(B,A)};其中h(A,B)=max(min‖a-b‖),a∈A,b∈B。

RVD衡量两种勾画体积差异程度,RVD范围为-1~1,数值越接近于0,表示两者重合度越好:RVD=(VB-VA)/VA。

1.4.2 专家评估

另选取宫颈癌术后IB期和IIA期10例新病例的CT图像进行DVN自动勾画,由一名肿瘤专家对这10例自动勾画的膀胱、直肠和CTV进行修改评估,用体积修正大小作为评估标准。为解决标准勾画可能存在主观性偏差的问题,将其他医学中心的一组术后宫颈癌数据集用训练好的DVN模型自动勾画,进行多中心评估,以此评价该网络模型的普适性。并使用同一数据集将DVN与传统U-Net网络的自动勾画对比,以评价DVN在危及器官和靶区自动勾画上的表现。

1.5 参数统计分析

将经融合网络自动分割后的数据和肿瘤医师手动勾画的数据导入MIM.Maestro 6.6.5软件中,建立工作流计算勾画的评估参数,使用SPSS 20.0软件分别对DVN和U-Net的3项评估参数进行单因素方差分析。

2 结果

2.1 总体分割结果

本研究所提出的融合模型算法的自动分割精度量化评价的结果如下:膀胱的DSC为 (0.92±0.04),HD为 (0.11±0.07) cm,RVD为 (0.10±0.08);直肠DSC为 (0.75±0.08),HD为 (0.39±0.29) cm,RVD为 (0.44±0.15);左右股骨头的DSC分别为 (0.80±0.04)和 (0.79±0.04),HD分别为 (0.46±0.16) cm和 (0.51±0.17) cm,RVD分别为 (-0.19±0.09)和 (-0.24±0.08);CTV的DSC为(0.87±0.01),HD为(0.17±0.02) cm,RVD为(0.02±0.06)。膀胱、股骨头和CTV的结果表明,通过融合网络自动分割得到的勾画与肿瘤专家手动勾画的结果一致性较强。两区域重合度较高的标准为DSC值大于0.75,而直肠的平均DSC为0.75。

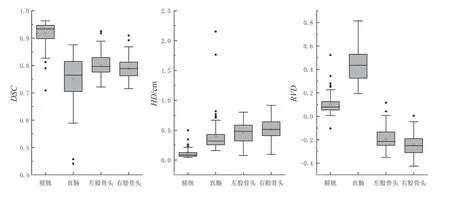

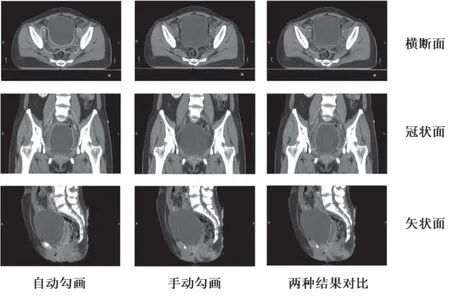

如图1所示,膀胱和直肠的三个参数的极端值偏差都较大,同时还存在少量异常值。图2显示了基于CT图像的CTV自动勾画、手动勾画以及两者对比的结果,其中自动勾画轮廓与手动勾画轮廓的一致程度较好,表明经训练后DVN能够准确地勾画出CTV。

图1 危及器官各评价参数箱型图Fig.1 Box plot of each evaluation parameter for critical organs

图2 靶区自动勾画与手动勾画轮廓对比Fig.2 Comparison between automatic and manual outline of target area

2.2 肿瘤专家评估

10例新病例的体积修正百分比,如表1所示。将经DVN自动勾画后需要修改的体积大小划分为5个等级:0~20%、20%~40%、40%~60%、60%~80%、80%~100%。肿瘤专家认为膀胱和CTV的自动勾画大部分是令人满意的(0~40%的体积修正分别占90%和80%),直肠经自动勾画后普遍还需要大幅度的修改(40%~100%的体积修正占90%)。

表1 10例新病例的体积修正百分比(%)Tab.1 Size of volume correction for 10 new cases

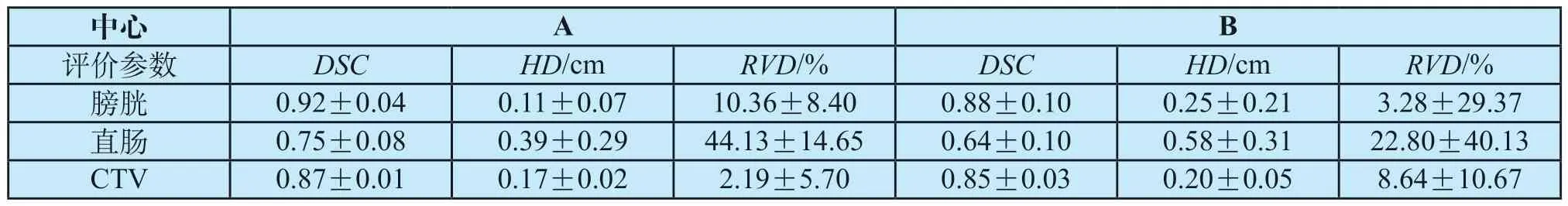

表2所示自动勾画两个中心不同数据集的膀胱、直肠和CTV的评价参数(其中A为本中心,B为其他中心)。在B医学中心重新训练得到的分割结果不如A中心得到的勾画结果精确。主要原因有,不同肿瘤专家对危及器官勾画的个人经验存在差异,DVN在训练的过程中会受到肿瘤专家手动勾画经验的影响。

表2 两中心危及器官和CTV的各参数评价结果Tab.2 Results of evaluation of various parameters of OAR and CTV in two medical centers

将该研究的数据集使用U-Net进行自动分割,通过1000次迭代训练,膀胱、直肠、股骨头和CTV的平均DSC结果分别为0.91,0.75,0.90和0.82。与DVN自动勾画结果相比,基于DVN自动勾画的膀胱和CTV结果优于U-Net,但股骨头的表现不如U-Net,两种网络勾画直肠的结果相近,且表现都不佳。

3 讨论

放射治疗技术使宫颈癌等多类型肿瘤得到了更好的控制,但这些技术的临床优势需要更加准确的轮廓勾画、剂量分布和计划实施。靶区和危及器官的轮廓勾画枯燥耗时,但其是肿瘤复发和生存缩短的主要因素[15]。利用深度学习可以优化轮廓的勾画,减少了边界的变化,同时提高效率减少了勾画轮廓所需的时间。

不少研究者已尝试使用各种神经网络模型分割盆腔靶区和危及器官:利用 2D U-Net实现准确分割[16],但基于二维图像进行分割在实际应用中会造成一定的偏差。用增强边界表征能力的全卷积方法解决边界模糊和形变大的问题[17],但生成软标签步骤烦琐,冗余信息大,不适合临床应用。使用深度膨胀卷积神经网络自动分割盆腔危及器官[18],但对肠和结肠的识别准确度低。

自动勾画宫颈癌靶区和危及器官尚存在以下难点,如若膀胱内存在或周围软组织对比度相近,会影响网络识别分割。若直肠肠道存在大量气体或内容物时DVN无法准确勾画肠壁,另外对直肠上下界的识别与手动分割还存在差异。对于宫颈癌阴道受侵病例,肿瘤专家将腹股沟区少量淋巴囊肿划入CTV勾画,但网络难以判断该情况。此外,肿瘤专家手动勾画靶区CTV时会根据患者膀胱充盈程度将CTV前界适当外扩,而神经网络只关注到该区域的解剖差异,不具备特异形变的判断性。

本研究基于150例患者的CT影像集,通过融合神经网络构建了一个人工智能的宫颈癌靶区和危及器官轮廓自动勾画工具。自动勾画的结果与放射肿瘤专家的手动勾画进行比较,具备较高的精确度。经自动勾画测试集的结果显示,DVN容易受到金属植入物的影响造成勾画不准,个别病例肠道形状差异过大网络也无法识别肠道气体,股骨头由于在CT图像上易分辨表现尚可,本融合网络借助对髂总动脉的识别能够实现精准勾画CTV,经过多中心评估发现DVN的勾画还不具备普适性。

4 小结与展望

近几年基于深度学习的医学图像自动分割发展迅速,但因CT图像对比度低导致器官边界不清晰,可供研究的盆腔CT图像公共数据集少,临床病例收集较少,盆腔器官个体差异较大且术后器官位置变化也大,所以目前基于CT图像的术后宫颈癌危及器官自动分割仍面临巨大挑战。DVN网络通过融合了DenseNet和V-Net的优势,在训练的数据集较少时,精确地自动分割术后宫颈癌患者靶区和危及器官。本融合网络的另一大优势在于借助对CTV周围血管的识别达到高精度的CTV轮廓勾画,为减轻肿瘤专家工作量提供了一定的帮助,但在自动勾画某些形变大、术后空间位移大的器官时相较于U-Net没有明显的优势,另外针对不同肿瘤专家的病例还需不同的训练模型。为了能够让神经网络自动分割更具适普性,统一危及器官的勾画标准,以此为标准建立公共数据集是推进深度学习自动分割的有效途径之一。