无人直升机目标跟踪算法研究

侯英娟

中国直升机设计研究所

作为无人直升机侦察领域的关键技术,目标识别与跟踪技术正在快速发展。但是,无人直升机难以识别和跟踪小型目标。鉴于此,本文提出深度学习yolov5算法与图像特征算法相融合的方法,以解决无人直升机不易跟踪小型目标的问题。

作为当代低空超低空作战领域的重要装备之一,无人直升机具有空中悬停、低空飞行等优势,在监视、侦察、精确打击等作战任务中发挥着重要作用。随着计算机视觉技术的发展,无人直升机自主飞行能力得到快速提升,可出色完成目标识别与跟踪任务。当前,目标识别与跟踪技术已成为众多学者及开发者重点研究的热点方向。

无人直升机目标跟踪算法

早期目标跟踪技术主要采用雷达发射电磁波,雷达对所获取的回波信息进行分析,进而识别目标。近年来,随着图像处理技术的发展,许多基于图像处理技术的目标检测算法应运而生。无人直升机在识别与跟踪目标时,选用基于图像处理技术的目标检测算法,能够快速而精准地识别、跟踪目标。

本文提出深度学习yolov5算法与图像特征算法相融合的目标跟踪算法,该算法提升了无人直升机识别与跟踪小型目标的精度与速度。

本文算法

本文提出的目标跟踪算法分为两方面内容。一是使用yolov5算法对目标进行检测,在复杂背景下提取候选目标;二是使用图像特征算法,从候选目标中筛选出最终目标。相较于普通目标跟踪算法,本文提出的算法具有识别与跟踪精度高、检测速度快等优势。

yolov5算法

在计算机视觉技术领域,yolo系列算法是比较流行的单阶段目标检测算法,它的创新点是将候选区域识别和对象识别这两个阶段融于一体,算法结构简单,提高了目标检测速度。yolov5算法是yolo系列中的第五个版本,在yolov4算法的基础上,添加了如下新的改进思路,计算速度与精度得到极大的提升。

1.输入端

在模型训练阶段,yolov5算法提出了一些改进思路,主要包括Mosaic数据增强、自适应锚框计算、自适应图片缩放。

2.准网络

yolov5算法融合了其他检测算法的一些新思路,例如Focus结构与CSP结构。

3.Neck网络

目标检测网络通常会在输入端与最后的Head输出层之间插入一些层。yolov5算法添加了FPN+PAN结构。

4.Head输出层

输出层的锚框机制与yolov4算法相同,训练时的损失函数GIOU_Loss以及预测框筛选的DIOU_nms获得改进。

yolov5算法的网络结构

yolov5算法的网络结构以coco数据集为基准。网络结构由输入端,输出端组成。此外,还包含CBL模块、Resunit模块、CSPX模块、SPP模块、Focus模块共5个基本组件。其他基础操作包括张量拼接和张量相加。

损失函数

yolov5算法用到的损失函数为定位损失(box_loss)、置信度损失(object_loss)和分类损失(class_loss)三部分的加权和。yolov5算法的定位损失使用的是CIoU_loss,损失函数计算公式如式(1)所述。

其中,IoU为预测框和真实框的交并比,交并比计算公式如式(2)所述;dc为预测框中心点与真实框中心点之间的距离;ds为预测框和真实框最小外接矩形的对角线长度;α表示平衡参数;ν表示真实框宽高比的倾斜角度。

α的计算公式如式(3)所述,ν的计算公式如式(4)所述。

其中,w表示宽度;h表示高度;wgt表示真实框宽度;hgt表示真实框高度。

CIoU_Loss的计算公式如式(5)所述。

图像特征提取

无人直升机光电系统拍摄的视频存在光照引起的颜色误差以及不同角度拍摄导致的形态多样化问题。单一的图像匹配算法不能很好地解决上述问题,所以本文图像特征提取同时采用感知哈希算法、HSV颜色直方图算法以及LBP局部纹理直方图算法,对图像相似度进行打分,筛选出分数最高的候选目标,作为光电系统识别与跟踪的目标。

在感知哈希算法中,一维离散余弦变换公式如式(6)所述。

式(6)中,F(n)表示一维离散余弦变换后的系数;c(n)表示补偿系数,公式(7)可计算补偿系数;f(i)表示最原始信号;N表示原始信号的点数;n表示广义频率,i表示第i个信号。

二维离散余弦变换公式如式(8)所述。

式(8)中,F(n,m)表示二维离散余弦变换后的系数;f(i,j)表示在i行j列的图像的像素值;m,n表示离散频率变量(0,1,2……7)。

HSV颜色直方图算法第一步把图像从RGB格式转换到HSV格式,HSV颜色直方图算法公式如式(9)、式(10)所述。

式(9)中,V表示亮度值,(R、G、B)表示颜色空间内的任一像素值,而R,G,B属于[0,255]。

式(10)中,S表示饱和度值。

式(11)中,H表示色彩值。假如H<0,则H=H+360,输出0≤V≤1,0≤S≤1,0≤H≤1。

LBP局部纹理直方图算法公式如式(12)所述。

式(12)中,(xc,yc)表示中心像素;p表示采样点数;s表示一个函数;ip表示相邻像素的灰度值;ic表示灰度值。

式(13)中,s(x)为符号函数。

图像相似度计算打分

本文使用汉明距离算法对感知哈希算法进行相似度计算。HSV颜色直方图算法和LBP局部纹理直方图算法用巴氏距离算法进行相似度计算。

汉明距离算法如式(14)所述。

式(14)中,d(r,t)表示距离;j=0,1,..n-1;r,j都是n位的编码;⊕表示异或。

公式(15)可计算出HSV颜色直方图算法的相似度的巴氏距离。

式(15)中,d(H1+H2)为HSV颜色直方图算法相似度距离值;H1和H2分别表示目标图像和检测图像的HSV颜色直方图算法特征提取值;R表示直方图的bin数目;I表示bin的序号。

公式(16)可计算出LBP局部纹理直方图算法的相似度的巴氏距离。

式(16)中,d(L1+L2)为LBP局部直方图算法相似度巴氏距离值;T表示直方图的bin数目;L1和L2分别表示目标图像和检测目标图像的LBP局部纹理直方图算法提取的向量。

计算打分时相似度得分设置阈值为60%。当最高相似度得分低于阈值时,则当前帧没有目标。当最高相似度得分大于阈值时,即该候选目标为当前帧的目标。本文HSV颜色直方图算法相似度的权重系数a=0.4;LBP局部纹理直方图算法相似度的权重系数b=0.4,感知哈希算法特征相似度的权重系数c=0.2。

式(17)中,Si表示相似度打分;Y表示放大系数;d(Hi+H0)表示HSV颜色直方图算法巴氏相关系数;d(Li+L0)表示LBP局部纹理直方图算法巴氏相关系数;d(r,t)表示感知哈希算法相关系数。

实验与结果

数据采集

制作数据集的图片来源于无人直升机光电系统拍摄的视频及图片。在拍摄过程中,光电系统应在不同角度、光照下对地面情报物体进行拍摄。数据采集者将录制好的视频以MP4格式保存,使用opencv开发库读取视频总帧数,并将视频文件转换成图片格式的文件。

图1 部分数据集样本。

图2 标记后的图片。

数据集制作

本文采用人工标注的方法,首先使用VoTT工具对图像进行标记,然后设置标签,最后导出需要的数据集格式。VoTT工具支持CNTK Faster-RCNN、TFRcords、TensorFlow Pascal VOC和YOLO等多种导出格式的数据集。

实验结果对比

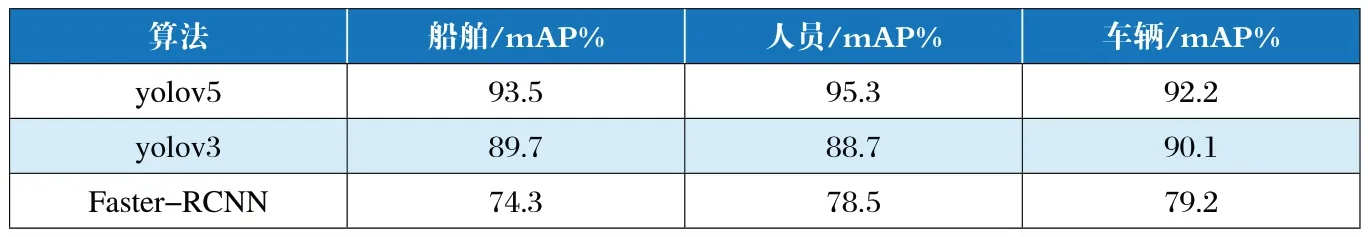

本文采用yolov5算法作为目标检测算法,与原来的yolo系列算法相比,yolov5算法在性能、灵活性、计算速度以及模型快速部署等方面均有一定的提升。本文采用yolo系列算法和Faster-RCNN算法进行模型训练与对比,实验结果是,对于一些小目标检测,yolov5算法的精确度占优势。本文以船舶、人员、车辆作为实验对象进行实验对比。

表1 基于yolov5、yolov3、Faster-RCNN算法的目标检测精度。

总结

本文提出的无人直升机目标跟踪算法,采用深度学习yolov5算法与图像特征算法相融合的方法,提高了目标跟踪精度与速度。在每次执行任务时,使用者可以切换不同种类的数据集进行目标检测,对检测出的图像进行图像特征对比,最后得到跟踪的目标。该算法不足之处是须要提前训练好各种目标跟踪的模型,以及须要大量数据进行训练。