基于交互关系分组建模融合的组群行为识别算法

王传旭,刘 冉

(青岛科技大学信息科学技术学院,山东 青岛 266061)

0 引 言

近年来,行为识别[1-3]在计算机视觉中取得重大进展,其包括单人行为或多人合作的组群行为,在智能监控、集体行为分析、大规模监测和体育分析等领域具有重要的研究价值。与此同时,随着深度学习网络在计算机视觉领域的应用,其逐渐成为行为识别研究的热点。

由于组群行为是多人参加的集体活动,在研究过程中,不仅要考虑单人的行为,还需要分析人与人之间的交互关系,而这些交互关系承载了组群行为的核心信息,制约着识别精度。文献[4]提出了一种基于LSTM(Long-Short Term Memory)网络的循环交互上下文模型,利用LSTM的信息传播和聚集属性建立模型,达到识别群组行为的目的。文献[5]构建了一种层次关系网络,计算组群成员之间的个人表示和潜在关系并用于多人行为识别。文献[6]设计出一种新的逐步细化群组行为低层次特征和高层次关系的方法,该方法构造了一个语义关系图(Semantic Relation Graph, SRG),用于建模人物之间的关系,然后根据2个马尔可夫决策过程对SRG逐步细化,得到最终的组群行为标签。文献[7]设计了一种基于层次长短期并发记忆(H-LSTCM)的模型,通过模拟人群之间长期相互关联的动态信息来识别人物之间的相互作用。文献[8]通过社交互动将人群划分为不同的社交群体,预测个人行为和社交行为,从而得到群组行为。文献[9]将图卷积网络扩展应用到组群行为识别中,提出了一种成员关系图(Actor Relation Graphs, ARG),利用二维CNN和图卷积网络构建了人物关系图,以捕捉人物之间的外观和位置关系,并推理他们的交互关系,使得群组行为识别的准确性显著提升。

以上这些基于深度学习网络的组群行为识别方法虽然都取得了不错的结果,然而它们存在如下2个问题:1)没有充分考虑复杂场景中组群成员的角色多样繁杂,导致交互关系推理复杂度高,它们实际上是不宜采用单一的交互关系架构来刻画整个组群的特征。2)没有考虑成员之间对组群行为的贡献大小不一,缺少对核心成员在组群行为的决定性作用分析,笼统地考虑所有成员的交互关系,则会导致信息冗余和引入无关成员因素的噪声干扰问题。因此,本文提出一种复杂组群场景下分组交互关系推理,并进一步再融合的模型,将场景成员以分组和全局统筹2种信息互补方式分别进行交互关系推理,逐步融合细化关系特征,再构成互补双路识别,旨在提升组群行为识别精度。

本文的工作主要有:

1)针对多角色复杂组群情况下的交互关系建模,根据视频场景的初始化信息提出了分组建模方式,例如,根据组群成员之间的空间距离阈值(CAD数据集等)或空间坐标(Volleyball数据集等)实施分组建模,则整个组群化整为零,不仅降低了交互关系推理的复杂度,还提升了交互关系建模的精细程度。

2)设计同一场景下不同分组建模中关键人物匹配的反馈优化策略。在全局场景下,将利用GCN网络得到的全局关系特征作为真实值,而各分组的局部关系特征合并组成的全局关系特征为预测值,构建两者之间的交叉熵损失函数反馈优化上一级分组交互关系GCN网络,旨在提升2个分组中的关键人物与全局中关键人物的匹配成功率。

3)构建双路互补的决策融合架构,本文利用全局信息作为信息互补策略,结合初始特征构成一路组群行为识别支路;同时,利用组间关系特征与初始特征构成另一路组群行为识别支路,最后采用决策融合策略整合2个支路的识别结果,得到最终群组行为识别标签。

1 相关工作

1.1 常规无交互关系的群组行为识别方法

早期的群组行为识别方法关注于对整体组群场景的描述和建模,缺少对组群成员之间交互关系的刻画。文献[10]提出了一种Coherence Constrained Graph LSTM(CCG-LSTM)框架,抑制无关运动,提取相关运动以及其对群组行为的贡献来实现行为识别。文献[11]提出了一种基于多流架构与长短时记忆网络的模型,融合局部和全局的外观和运动信息得到组群行为类别。文献[12]提出了一种用于群体行为识别的半监督、多级序列生成对抗网络(MLS-GAN)结构,该结构以鉴别器和生成器对抗性的真假进行半监督学习,实现对群组行为的判断。文献[13]通过基于LSTM的层次关注和上下文建模框架同时处理对行为有重大贡献的人和团体中的背景结构问题,进行群组行为的识别。文献[14]设计了一个弱监督群体行为识别,在只有视频级标签可用的情况下进行训练和测试。上述方法虽然注意到了对全局组群场景的描述和利用,但是由于缺少对组群内部成员交互关系的体现而显得整体组群特征比较粗糙,使得它们的识别精度受限。

1.2 基于交互关系建模组群行为识别方法

随着研究方法的深入,认识到组群成员内部的交互关系才是描述组群行为的核心信息载体[15],近年提出了不少交互关系建模的深度学习方法。文献[16]构造了一种分层图型模型,考虑个人行为标签之间的依赖性来优化每个行为的预测标签,然后捕捉单人行为类别,达到识别群组行为的目的。文献[17]提出了基于注意力和图架构的群体行为识别模型,通过捕获多个人交互关系,构建关联图,进行关系推理,实现群组行为标签的预测。文献[18]提出了一种结构递归神经网络(SRNN),利用一系列相互连接的RNN网络来共同捕捉个人行为、人与人之间的交互关系及群组行为。文献[19]提出了嵌入图关注块(GAB)的图注意力交互模型(GAIM),以在架构中显式和自适应地推断个人和组群级别的不平衡交互关系,并进一步学习和时空演化这些互动中的集体行为预测标签。以上方法均重视了利用交互关系构建组群特征,并通过对应的消融测试(ablation tests)证实了交互关系模块可以有效提升识别精度。

1.3 基于关键人物的交互关系建模的组群行为识别方法

交互关系描述可以细致刻画组群内部的成员之间的互动,从组群内部反映群体行为的本质,近期的文献在此基础上提出以关键人物为核心的交互关系建模方法,不仅约简了交互关系模型,重点突出了核心成员对组群行为的影响,还抑制了无关人员的冗余信息干扰。

文献[20]提出了一个基于注意力机制和递归神经网络RNN的模型,该文通过他们提出的大规模仅有运动时间标注的篮球数据集上,测试该模型证明了关键人物在多人行为识别中的决定性作用。文献[21]提出了一种参与贡献时间动态模型(PC-TDM)以便排除无关次要人员的干扰,得到群组行为标签。文献[22]结合时空注意力的语义图提出了一种注意力语义递归神经网络(stagNet),利用时空注意力模型来关注关键人物,以提高识别性能。文献[23]开发了一种语义保存师生(SPTS)网络体系结构,证明利用注意力机制确定关键人物能提升3%的准确率。文献[24]构建了一种使用门控融合单元(Gated Fusion Unit, GFU)进行特征融合的组群行为识别框架,其重点关注关键人物特征信息,忽略无关人员对群组行为的影响,最后送入softmax分类器进行组群行为类别分类。

1.4 基于多支路决策融合的组群行为识别方法

交互关系是组群行为的核心但不是全部信息载体,本文基于信息互补思想,除了分组交互关系信息支路实现行为识别外,还设计包含底层时空信息和全局信息的另一路识别网络,希望通过决策融合的方法,获得更佳识别效果。

总的说来,决策水平可以融合模型中不同的分类结果,同时不同分类器的错误互不相关、互不影响,不会造成错误的进一步累加,常见的融合方式包括最大值融合(max-fusion)、投票法[25]、加权平均法(averaged-fusion)[11]和基于贝叶斯规则的融合(Bayes’rule based)[26]等。考虑到分类器存在拒识别问题,经过对上述方法分析对比后,本文采用权重自适应方法进行2支路的决策融合,即对于2个支路得到的结果进行归一化处理,计算本路准确度在结果集合中所占比例作为支路的权重划分依据(权重之和为1),以期能有效提高最终的识别结果。

综合考虑以上4种方法的优点,本文拟将复杂群组划分为交互相对简单鲜明的几个小组,通过关系推理选取它们中的关键人物(交互关系最强的人员)来进行整个群组行为的预测。重点解决如何充分利用关键人物和交互关系信息,以及为了进一步降低交互关系推理的复杂度提出分组建模,来提高群组行为识别精度。

2 算法描述

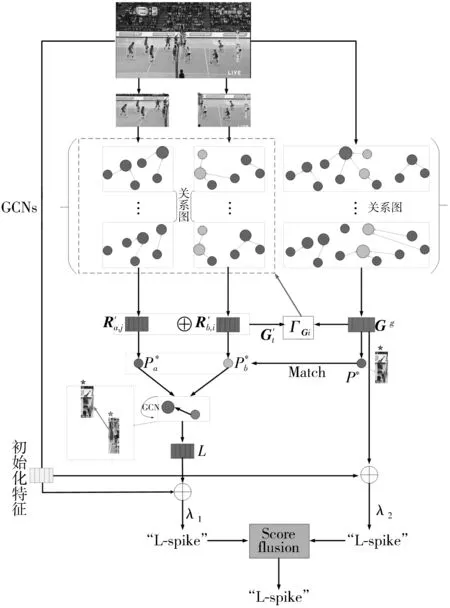

算法模型如图1所示,概述如下。

图1 本文整体算法架构

首先,将组群成员按照位置信息分为2组。基于数据集提供的bounding boxes标注信息,本文进一步通过Inception-v3[27]和RoIAlign[28]这2个网络提取视频外观特征,并将此称为初始特征。利用个人空间坐标X排序大小先后建立组群成员序号{ID=(0,1,…,n)},n表示组群成员人数,并对组群进行二分组(以6个人为一组从左到右分为2组)。这样可得分组a、分组b和全局3个组群场景。

最后,构建信息互补的双路识别网络,通过决策融合获得组群行为类别。将初始特征信息分别与上述得到的全局特征Gg和精简全局关系特征L组成2支路识别网络,并通过决策融合得到组群行为标签。

3 初始特征提取

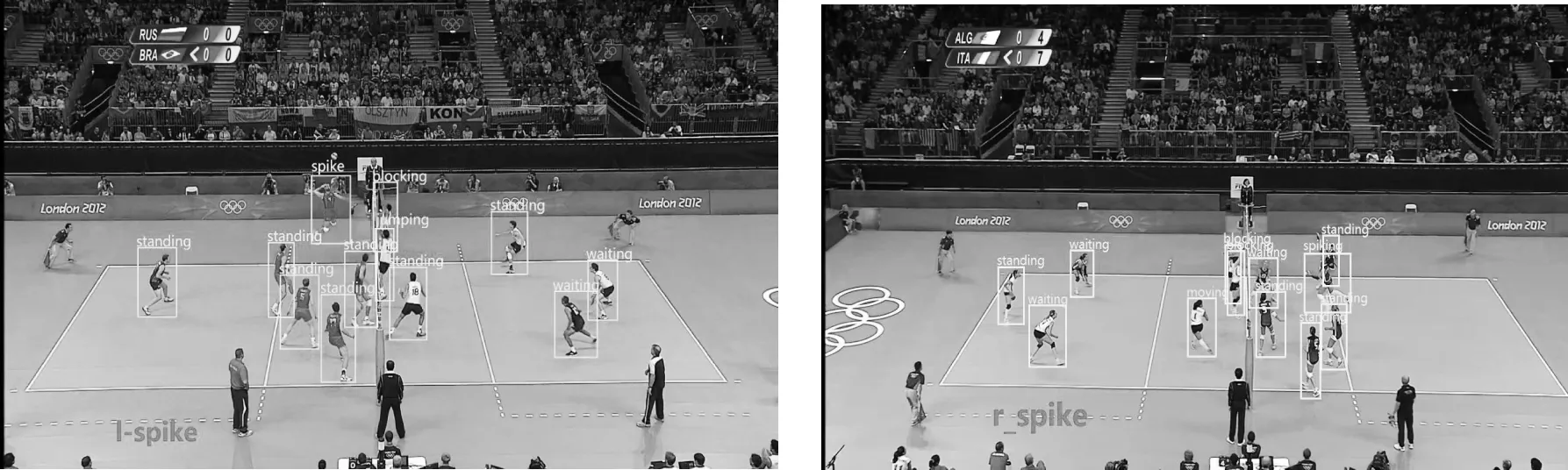

本文主要针对Volleyball数据集进行数据预处理得到组群成员的外观特征信息。

首先,借用文献[29]提供的针对该数据集的轨迹数据,得到组群成员的边界框,如图2所示,利用该标注信息形成每个成员的边界框序列。然后,采用Inception-v3和RoIAlign网络提取每帧边界框成员的精准外观特征。最后,经过全连接层获得每个成员的d维外观特征向量,即每个人的初始特征。

图2 Volleyball数据集中个人和组群行为的边界框标定样例

4 交互关系分组建模

由于复杂群组情况下,参与人数较多和角色复杂会导致交互关系推理难度提升,本文采用分组建模方法。针对Volleyball数据集,利用每个人的bounding box的X坐标和序号ID将整个组群分为2组,如图3所示的小组a和小组b。然后,针对每组群体采用GCN网络进行交互关系建模,详细过程如下。

图3 Volleyball数据集中整体组群分为2组展示

4.1 组内交互关系建模

利用GCN进行组群交互关系建模时,需要先初始化交互关系。受到文献[9]的启发,本文利用组群成员间的外观特征、位置信息,构建有向关系图作为GCN的初始输入。

4.1.1 组内交互关系的初始化

针对群内成员关系图的初始化,本文随机轮流选取多个成员作为目标节点,分别将成员间的外观特征相似度、相对位置远近和关系值大小作为度量,构建多个关系图。如图4所示的3个有向关系图实例,它们是同时选取成员0和5作为目标节点产生的,规定箭头方向指向目标节点。下面针对上述3个度量进行阐述。

图4 分组a关系图展示

针对外观信息相似度的计算,本文采用嵌入向量卷积方法,公式如下:

(1)

针对空间位置远近的计算,本文采用距离编码的方式,公式如下:

(2)

其中,φt使用不同波长的正弦和余弦函数将2个人物的相对距离嵌入到高维表示中,Wt,p和bt,p是嵌入特征转换为标量的权重向量,最后进行ReLU激活。

基于上述信息,则成员i和j的关系值度量,本文采用如下公式:

(3)

针对关系图初始化的最佳数量问题,为了避免初始化关系图的偏颇,本文针对一个分组场景生成了多个初始化关系图,以表征其交互关系的多样性和可能性,将在实验部分通过统计分析的方法,确定初始化关系图的最优数量范围。

4.1.2 交互关系分组推理

初始化后的关系图送入GCN进行组内交互关系推理。如图5所示,以分组a中目标节点0、5为例,针对每个初始化输入关系图,令Ga∈RKa×Ka表示该图中各个节点之间的相关性矩阵,Ka代表分组a的人物总数;Ha(l)∈RKa×d代表GCN第l层的节点特征集合,Wa(l)∈Rd×d代表l层的学习权重矩阵,则GCN对该图的目标节点利用公式(4)与其关系节点进行信息聚合,图中用节点体积变大代表聚合信息的增加,如图5右侧关系图中目标节点0和5。

图5 分组a推理关系图展示

GCN推理单张关系图的简化公式为:

Ha(l+1)=ReLU(GtHa(l)Wa(l))

(4)

(5)

4.2 交互关系推理可视化

下面以组群行为“L-spike”为例,阐述上述交互关系推理的可视化过程,旨在进一步论述组群中每个成员的交互关系融合机理和关键人物的确认。

图6中,横坐标表示目标成员,纵坐标代表与之交互的关系成员,用灰色的暗淡代表交互关系的强弱。其中,图6(a)展示了全局场景下群组交互关系推理出的成员之间相关性矩阵图,通过计算每个目标成员所在列之和作为其对外的关系强度,进而经过排序定位出关键人物;以目标成员2和5为例,经过排序后,目标节点2的交互关系强度最弱,其融合关系节点的特征最少,优先排除作为关键人物的可能性;目标节点5与其他成员的交互关系强度最强,交互关系强度排在第一位,所以定位“5”为全局关键人物,如图所示关键人物用星号标注,又由于其行为属性为“spike”,进而为下一步组群行为预测为“L-spike”提供重要信息。图6(b)和图6(c)展示的是分组场景下群组交互关系推理的相关性矩阵图,根据同样规则进行关系强度排序,定位关键人物分别为“5-spike”和“6-block”。

(a) 全局:“L-spike”

(b) 分组a:“Spike”

(c) 分组b:“Block”图6 “L-spike”组群行为下的各组交互关系可视化

5 全局与子组内关键人物匹配和再优化

图7 关键人物再优化和匹配结构图

(6)

(7)

其中,⊕表示连接,C=cI+cg,cI和cg分别代表个人和群组行为的类别数量。

6 基于信息互补构建双路识别

针对全局关系特征Gg比较宽泛,而组间关系特征L相对精简,为了达到信息互补的目的,本文将初始特征分别与两者相结合,构建双路识别网络。

(8)

(9)

其中,yG和yL代表全局和分组的组群行为分数,λ1、λ2是自适应权重。

图8以“L-spike”组群行为识别为例,展示整个群组行为双路识别架构。2个分组作为支路,经GCN关系推理和关键人物匹配再优化得到精简组间关系特征L与初始特征聚合,送入分类器进行群组行为识别;初始特征和全局关系特征Gg聚合,送入分类器实现另一路群组行为识别,两者经过决策融合得到最终的行为识别标签“L-spike”。

图8 “L-spike”推理过程样例图

为了低成本保留时间信息,在时间和计算资源的合理预算下实现端到端学习。本文模型采用稀疏时间采样策略提取时间域中的信息。在训练期间,从数据集中随机采样一组N=3帧,并在这些帧中的人物上构建时间图。在测试时,使用滑动窗口方法,对所有窗口的活动分数求平均以形成全局活动预测。

7 算法验证

本文采用公开数据集Volleyball和NBA进行算法的验证。

7.1 数据集

Volleyball数据集[5]包含55个排球比赛视频,每个比赛视频又划分出了多个组群行为片段,共计4830个视频片段;其中每个片段包含1个组活动标签,包括Right set、Right spike、Right pass、Right winpoint、Left set、Left spike、Left pass、Left winpoint这8种类别。此外,每个片段都标有个人动作标签,这些个人行为共包括9种类型:waiting、setting、digging、falling、spiking、blocking、jumping、standing、moving。本文选用其中的3493个片段作为训练,1337个测试片段用来测试。

NBA数据集[14]包含181个篮球比赛视频,每个比赛视频又划分出了多个组群行为片段,共计9172个视频片段;其中每个片段包含1个组活动标签,包括2p-succ、2p-fail.-offff、2p-fail.-def、2p-layup-succ、2p-layup-fail.-offff、2p-layup-fail.-def、3p-succ、3p-fail.-offff、3p-fail.-def这9种类别,本文选用其中的7624个片段作为训练,1548个测试片段用来测试。

7.2 实验配置和网络参数初始化

本实验在Pytorch框架下进行,Ubuntu版本为18.04,CUDA版本为8.0,CUDNN版本为6.0,显卡型号为NVIDIA GTX1080Ti。为了计算高效、所需内存少,本文使用Adam的随机梯度下降来学习具有固定超参数的网络参数(θ1=0.9,θ2=0.999,ε=10-8),对于Volleyball数据集:最小批次为32帧,学习率为0.00005,Epochs为100;对于NBA数据集,使最小批次为64帧,学习率为0.0001,Epochs为200;对于关系推理来说,GCN的参数设置为dk=256、ds=32对数据进行统一化,防止网络不收敛。

本文使用第3章提到的方法,为每个人物提取1024维特征向量。通过第4章的方法,把每个人看成一个节点,构建关系图作为GCN网络的输入。融合GCN输出关系图的数据生成每个人的交互关系特征向量,并用来进行关键人物的提取和群组行为的识别。实验期间,经过对VGG16[29]网络和Inception v3进行比较,决定采用第2个网络为骨干网络,并与现有算法进行比较。

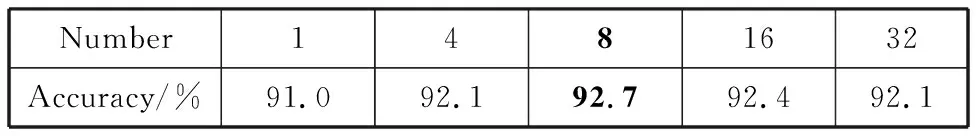

7.3 初始化交互关系图最佳数量的确定

为了确定初始化关系图数量的最佳范围,本文通过实验并以组群行为识别准确率作为评价指标来进行验证和统计。全局和分组的初始化关系图测试结果如表1所示。

从表1(a)与表1(b)对比中发现,全局和分组人物初始关系图得到最佳结果的数量要求不同,在全局交互关系推理中16张图最佳,在分组交互关系推理中8张图最有效,这是因为随着群组成员的数量变化,不同类型的交互关系数量也会发生改变,初始关系图的数量要求也有所不同。在以下实验中采用全局关系图的数量为16,分组关系图的数量为8。

表1 基于排球数据集的群组行为识别准确率表(a) 全局关系:不同数量初始化关系图时的识别精度比较

表(b) 分组关系:不同数量初始化关系图时的识别精度比较

7.4 消融测试

为了测试分组交互关系对组群行为分类的重要性,本文设计3种基线方法与本文模型进行比较。

Baseline1为全局场景下,群组成员经过关系图建模和GCN关系推理,得到最终的识别结果,简称B1。

Baseline2为场景分组,对各分组成员分别进行关系图建模和GCN关系推理得到各自的关键人物,然后再次进行GCN推理,最后将获得的精简组间关系特征送入分类器进行识别,简称B2。

Baseline3为没有交叉熵损失函数优化的情况下,全局交互关系指导组间交互关系的推进,各分组通过关系推理得到组关键人物,对组间关键人物再次进行关系推理,后期采用决策融合的方式得到最终行为标签,简称B3。

Baseline4即本文算法,在交叉熵损失函数对分组关系推理再优化的情况下,全局交互关系指导组间交互关系推理,各分组通过关系推理得到组内关键人物,对组间关键人物再次进行关系推理,后期采用决策融合的方式得到最终行为标签,简称B4。

表2展示了本文模型在Volleyball数据集上各基线方法的实验结果。

表2 模型在Volleyball数据集上各种基线方法的比较

经过表2实验结果对比,分析得到:1)B2比B1准确率提升了0.6个百分点,这是因为与全局关系推理不同,分组交互关系推理简化了复杂群组的关系建模,降低了信息冗余,因此能够提高组群行为识别率。2)B3比B2准确率提升了0.4个百分点,因为通过分组交互关系的推理结合全局关系推理,确定了各分组关键人物的重要程度,有利于精简全局关系图的构建,后期经过信息互补的双路决策融合,能让群组行为识别更为准确。3)B4比B3准确率提升了0.8个百分点,最大原因是,在进行B4模型推理前期,通过交叉熵损失函数确保全局和分组关键人物能够匹配成功,在一定程度上防止了信息不收敛,能显著提升群组行为的识别效果。B4准确率高于其他基线模型,这表明,按照场景信息分组,精简全局交互关系推理和信息互补双路识别,对提高群组行为的识别精度有着重要作用。因此,本文模型即B4的实验效果最佳。

7.5 本文模型与其他方法的比较

为了证明本文算法的有效性和先进性,本文通过以准确率为基准与其他先进算法进行比较。

7.5.1 Volleyball数据集

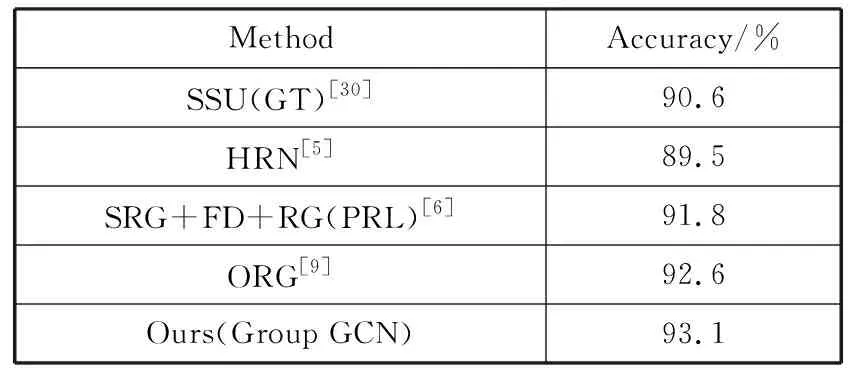

表3为本文算法和近两年CVPR算法在Volleyball数据集上的实验结果。从表中数据分析,本文融合了前4种方法中的特征提取、外观和位置信息和关系推理的方法,取得了较为优越的识别效果,识别精度分别提高了2.5个百分点、3.6个百分点、1.3个百分点和0.5个百分点。

表3 Volleyball数据集流行方法的比较

表3中,本文使用与文献[30]相同的Inception-v3模型进行特征提取,但该文献模型侧重通过全连接层(FCN)对特征提取层进行微调,以使其能够捕获上下文和交互信息,而本文模型主要通过捕获和利用群组成员之间的交互关系进行建模,定位了关键人物,并进一步构建组间交互关系模型,并与全局交互关系模型构成双路互补识别网路,然后,双路网络再进行决策融合实现最终的组群行为识别,因此在识别准确性方面提高了2.5个百分点。文献[5]在关系建模时缺少对空间位置信息的考量,因此提取的交互关系特征不充分,无法证明交互关系的完整性,本文方法优点在于构建了基于位置和外观信息的关系图,并通过GCN网络进行交互关系推理,从而实现整个群组行为的分析。文献[6]的语义关系图主要是采用底层时空特征和原始交互特征作为群组成员节点的属性,而本文使用了更为具体的外观和位置信息构建出的关系图和采用了更为有效的关系图时间建模方法,因此,组群行为准确率从91.8%提升到93.1%。最后,本文模型准确率高于文献[9],主要是因为本文在其全局关系推理的基础上,又采用了分组关系推理的方法,利用代表各分组信息的组关键人物进行精简交互关系推理,并与全局关系推理进行决策融合达到信息互补的目的,来提高识别结果的准确性。

7.5.2 NBA数据集

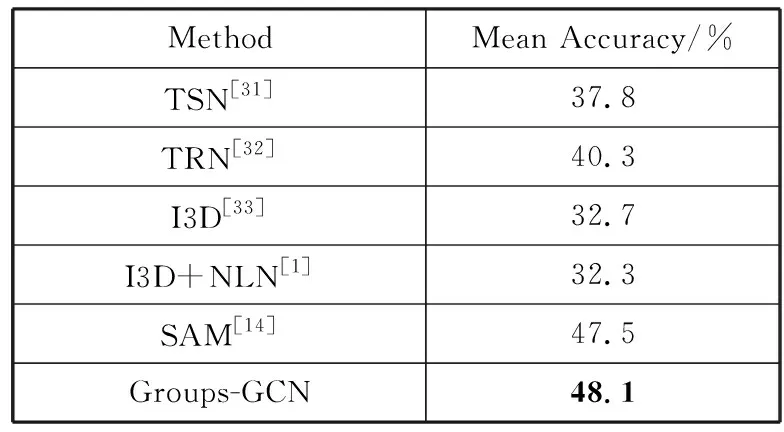

本实验借用文献[14]中目标检测模块提供的成员真实边界框和行为标签信息来验证本文算法的有效性,并在NBA数据集上与近几年视频分类算法的测试结果进行了比较,包括:TSN[31]、TRN[32]、I3D[33]、I3D+NLN[1]、SAM[14],从表4中数据分析,识别精度分别提高了10.3个百分点、7.8个百分点、15.4个百分点、15.8个百分点和0.6个百分点。

表4中,本文算法准确率高于文献[31-32],是因为“TSN”和“TRN”的方法仅使用帧级信息,而本文在使用帧级信息的基础上,再利用视频帧内成员的外观、位置和交互信息构建关系图,通过提炼帧内信息的方式,达到提高群组行为识别准确度的目的。本文算法准确率高于文献[1,33],主要是因为“I3D”和“I3D+NLN”模型过度依赖于密集视频帧,信息冗余,无法精炼信息,所以在测试中表现不佳。本文算法准确率高于文献[14],是因为,首先本文算法是在文献[14]目标检测模块获取的人物候选框的基础上,再通过Incvption-v3和RoIAlign网络获得更为精确的外观信息;然后本文算法与文献[14]在视频帧内建立关系图的方式不同,文献[14]对所有成员使用全连接的方式,会导致信息冗余、计算量大的问题,降低识别效果,而本文模型在全局和分组场景下建立交互关系模型,再利用代表各分组信息的组关键人物进行精简交互关系推理,大幅度降低了计算量,提升了识别精度,最终在通过全局和组间关系推理进行决策融合的方式进行信息互补,提高了识别结果的准确性。

表4 NBA数据集流行方法的比较

8 结束语

本文针对组群行为中个体成员运动属性较多,交互关系复杂以及常规全连接交互关系模型中的信息冗余等问题,构建一种复杂组群分组交互关系建模的框架。通过分别对场景分组和全局群组的交互关系建模,提取到了各分组和全局关键人物,并对两者进行匹配和再优化操作;然后,对匹配成功后的组间关键人物再次进行交互关系建模,得到精简全局关系特征;最后,全局和精简全局关系特征分别结合初始特征,构建了双路组群行为识别架构,并利用决策融合实现群组行为的识别。在Volleyball数据集和CAD数据集上对本文模型进行训练和测试,并对比多种方法,验证了分组关系推理在组群行为识别的有效性。