采用改进Unet网络的茶园导航路径识别方法

赵 岩,张人天,董春旺,刘中原1,,李 杨

采用改进Unet网络的茶园导航路径识别方法

赵 岩1,3,张人天1,2,3,董春旺2,刘中原1,2,李 杨2※

(1. 石河子大学机械电气工程学院,石河子 832000;2. 中国农业科学院茶叶研究所,杭州 310000;3. 农业农村部西北农业装备重点实验室,石河子 832000)

针对目前在茶园垄间导航路径识别存在准确性不高、实时性差和模型解释困难等问题,该研究在Unet模型的基础上进行优化,提出融合Unet和ResNet模型优势的Unet-ResNet34模型,并以该模型所提取的导航路径为基础,生成路径中点,通过多段三次B样条曲线法拟合中点生成茶园垄间导航线。该研究在数据增强后的茶园垄间道路训练集中完成模型训练,将训练完成的模型在验证集进行导航路径识别,根据梯度加权类激活映射法解释模型识别过程,可视化对比不同模型识别结果。Unet-ResNet34模型在不同光照和杂草条件下导航路径分割精度指标平均交并比为91.89%,能够实现茶园垄间道路像素级分割。模型处理RGB图像的推理速度为36.8 帧/s,满足导航路径分割的实时性需求。经过导航线偏差试验可知,平均像素偏差为8.2像素,平均距离偏差为0.022 m,已知茶园垄间道路平均宽度为1 m,道路平均距离偏差占比2.2%。茶园履带车行驶速度在0~1 m/s之间,单幅茶垄图像平均处理时间为0.179 s。研究结果能够为茶园视觉导航设备提供技术和理论基础。

导航;深度学习;茶园可视化;路径识别;语义分割;样条曲线拟合

0 引 言

中国是世界上最大的茶叶种植、消费、出口国之一,茶产业已成为茶区推进乡村振兴战略和实现共同富裕的支柱产业。近年来,城乡人口逐步向城市转移,农业劳动力老龄化趋势明显,面对茶业生产“机器换人”发展的迫切需求,急需开展以精准、智能为导向的茶园装备研究[1]。随着智能农机装备导航技术不断发展,机器视觉和卫星定位导航技术逐渐成为主流[2]。卫星导航系统适用于大田垄间种植距离较宽的场景,机器视觉导航技术符合茶园行间距较窄的环境,能够为茶园智能履带车提供实时路径信息[3-4]。已有学者针对传统机器视觉路径导航技术开展了研究,Montalvom等[5]为了区分树冠与天空,提取图像中不同的G值,拟合桃树行中心线为导航路径。张成涛等[6]通过Cg分量灰度化彩色图像,进而利用改进遗传算法和线性相关系数约束法检测作物行直线,导航跟踪试验表明,其横向偏差分别小于33和12 mm,但后者算法检测导航线耗时较长。关卓怀等[7]运用2R-G-B综合阈值算法进行图像二值化处理,并采用多段三次B样条曲线拟合水稻收获区域的边缘。传统机器视觉图像处理算法因人工选择颜色、纹理等特征,会产生较大局限性,通常只适合特定环境识别路径,在复杂环境中泛化能力不强,在茶园行间复杂环境中仍存在识别困难的问题[8-10]。同时,履带车在茶园前进过程中需根据道路情况实时进行调整,因此对图像数据的实时处理速度提出较高要求[11]。

近年来,深度学习在机器视觉导航领域得到广泛应用[12],尤其是全卷积神经网络被广泛应用在各类非结构化的农业道路识别场景中[13-15],并实现较好的识别效果。李云伍等[16]使用全卷积网络(Fully Convolutional Networks,FCN)在丘陵检测田间道路,道路分割平均交并比(Mean Intersection over Union,MIoU)为0.732。Lin等[17]在全卷积网络(FCN)的基础上运用E-Net模型完成茶行蓬面像素分割,茶行分割平均交并比(MIoU)为0.734,利用Hough变换拟合茶行轮廓中心线,为跨行乘坐式采茶机提供实时导航。韩振浩等[18]基于U-Net语义分割模型获取果园道路信息,使用扫描法获取边缘点并生成道路中点,最终运用多段三次B样条曲线拟合果园导航线。果园道路在不同光照下交并比(MIoU)为89.52%、86.45%、86.16%,道路实际平均距离误差为0.044 m。饶秀勤等[19]提出基于Unet网络剪枝后的Fast-Unet模型,模型在导航路径精确度变化不大的情况下,进一步提升了推理速度。上述基于深度学习算法的不同农田道路场景分割试验为本研究思路的提出提供了较好的借鉴。

目前茶园道路导航线识别方法依然有以下问题:1)采用传统图像处理算法易受复杂环境和光照变化等因素的干扰,精确性不高;2)由于茶树低矮,较难识别树干等特征,茶园道路不规则等问题,采用垂直投影法、最小二乘法等直线拟合方法不适合曲线路径检测。基于上述问题,该研究提出Unet-ResNet34实时茶园道路语义分割模型,实现图像中茶园垄间道路像素级分割,生成道路对应的掩码区域;通过扫描掩码图像获取两侧边缘信息和道路中点,并利用多段三次B样条曲线拟合茶园导航路径。本研究为解决茶园复杂环境、路径不规则的问题提供参考。

1 材料与方法

1.1 图像采集与数据集构建

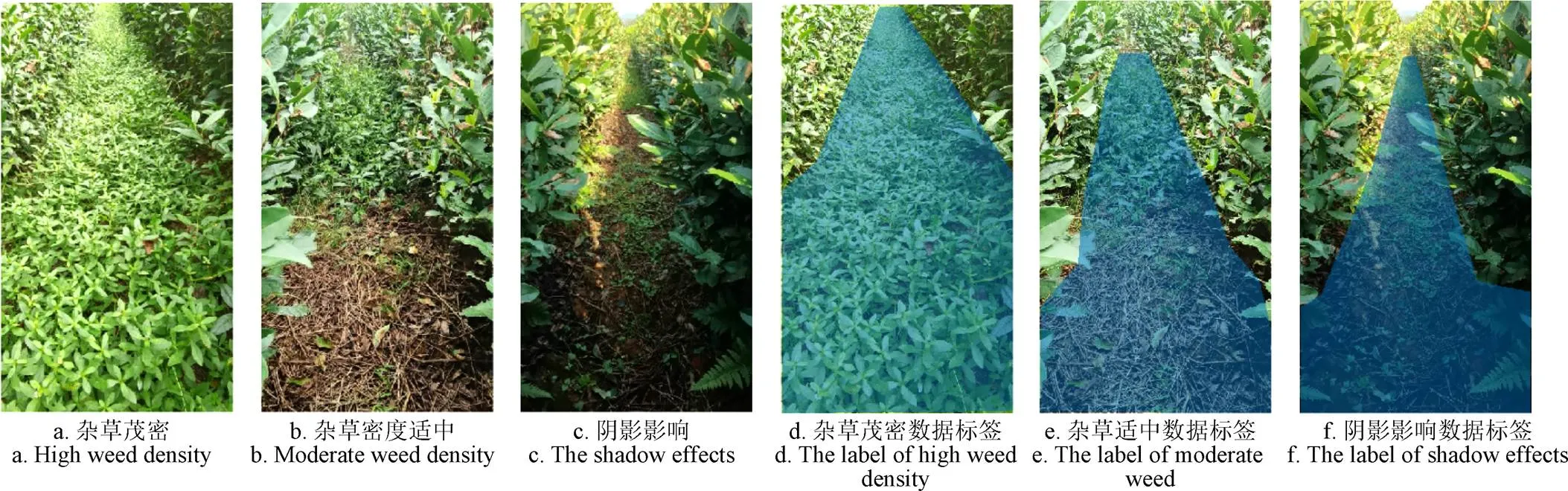

数据采集地点位于浙江省杭州市中国农业科学院茶叶研究所龙井种植园,茶树品种为龙井43、中茶108和白叶1号,拍摄时间为2021年10月1日至11月1日,拍摄条件包括不同光照强度(强光、弱光)、不同杂草密度(杂草茂密、杂草稀疏)、不同杂草种类和叶片遮挡等情况。

使用履带式底盘模拟机具作业状态,车顶搭载Intel公司的D455深度相机采集道路信息,视频数据存入笔记本电脑中。相机通过云台安装于底盘前端,向下倾斜15°,拍摄方向为行走路线正前方。底盘前进速度约为1.2 m/s,图像分辨率为1 920×1 080像素。随机选取1 824幅图像用于茶园垄间道路数据集制作,数据集按4∶1划分为训练集和验证集,其中1 568幅为训练集,256幅为验证集。本文采用Matlab 2019中Image Labeler人工标注茶园垄间道路图像数据,将标签分为2类,分别是茶园垄间道路和背景,将茶园垄间道路进行标注,背景不做标注。不同环境下茶园垄间道路数据集及标注结果如图1所示。

图1 不同环境下茶园道路数据集及标注结果

1.2 数据增强

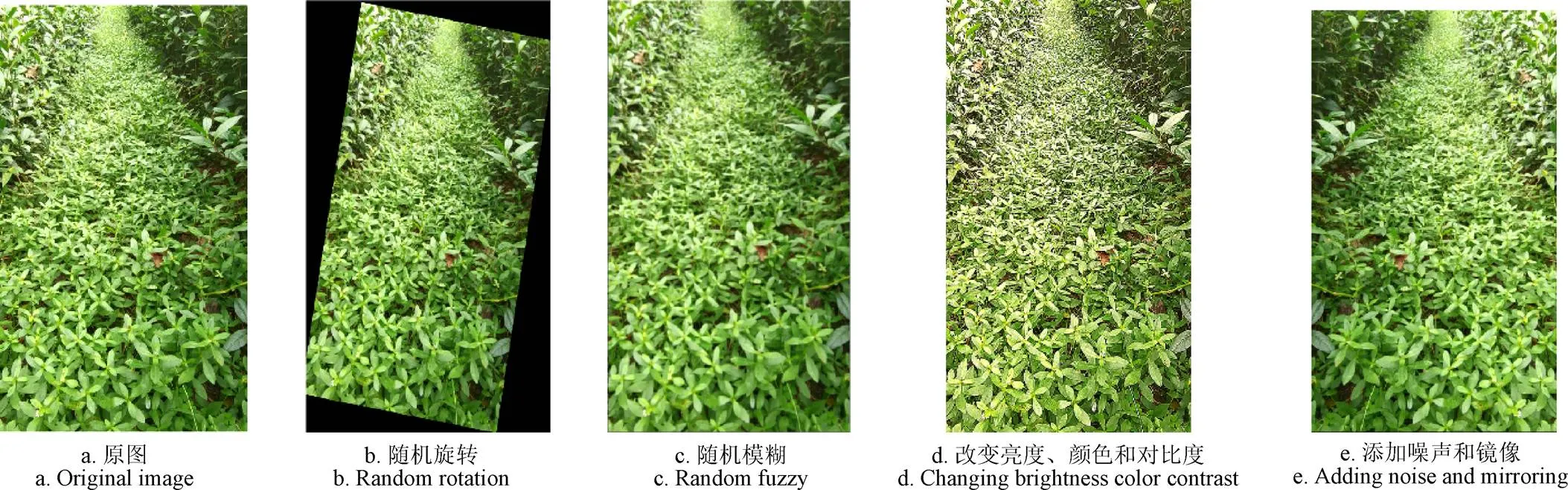

为了扩大训练样本的数据量,提高模型在复杂茶园环境中学习的准确性和泛化能力,本文在训练过程中对输入图像执行旋转、亮度变化、颜色变换、对比度增强和随机添加噪声等方法。在每次训练时,训练集中的茶园垄间图片按图2中的方式进行数据增强,除模糊方法外,其余方法都会有80%的概率触发。其中,随机旋转为在±30°以内的任意角度,可模拟茶园行间导航道路的不同方向;亮度变化为在(−32,32)范围内随机增加或减小图像中每个像素的值来改变图像的亮度;颜色变换为在HSV颜色空间(−18,18)范围内增加或减小图像的H通道值来改变色度,并通过对图像的S通道乘以一个系数(0.5,1.5)中的随机值来改变饱和度;对比度增强为对图像中每个像素的值乘以(0.5,1.5)范围内的任意数;模糊为随机添加均值为0方差为1.0的高斯噪声,亮度、颜色、对比度方面的数据增强可模拟茶园不同的光照强度和场景。

图2 数据集增强

1.3 评价指标

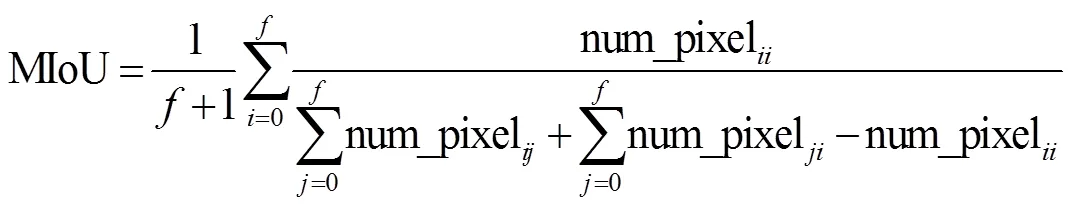

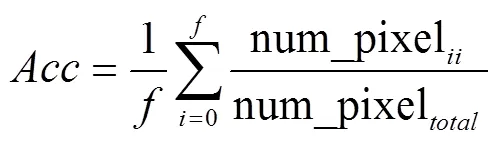

在语义分割任务中,一般从模型精度、推理速度、浮点运算次数(Floating Point Operations,FLOPs)和参数量等几个方面进行考量。模型精度估算一般选取平均交并比(Mean Intersection-over-Union,MIoU)和像素准确率Acc(Pixel accuracy),推理速度代表模型的运算速度,浮点运算次数和模型参数量代表模型的大小和复杂度。本文茶园垄间道路分割任务采用的评价指标主要包括平均交并比MIoU、像素准确率、型推理速度、浮点运算次数和参数量。推理速度(inference speed)为模型每秒处理茶园图片帧数(Frames Per Second,FPS)。FLOPs是指模型所需的计算次数,参数量是算法在运行时实际占用计算机内存资源数值。

平均交并比(MIoU)是真实值与预测值两个集合的交集占并集的比例,计算公式

像素准确率(Acc)为判断正确像素数在图像总像素数中占的比值,计算公式

式中num_pixel是实际为类且预测也为类的像素数,num_pixel是实际为类但预测为类的像素数,num_pixel是实际为类但预测为类的像素数,num_pixel是图像总像素数;为总类别数量,由于本文只区分茶园垄间道路和背景,因此= 1。

1.4 试验平台

试验选用的硬件配置为Intel Core i7-8700CPU,基准频率为3.2 GHz,32 GB内存,NVIDIA GeForce GTX3090 GPU。

在Windows 10系统下,CUDA 10.2,cuDNN 7.6.05,运用Python3.7语言进行编程,基于PyTorch1.8框架搭建本文语义分割模型。

2 基于语义分割的茶园垄间道路识别模型

2.1 茶园道路语义分割网络构建

茶园道路识别存在光照强度变化、相机角度变化、图片尺度变化、非结构化茶园环境和茶树叶片遮挡道路等多种场景,基于传统图像处理算法的导航路径提取方法难以适应上述场景。针对这一问题,为满足茶园道路识别的精准性和实时性要求,本文提出语义分割模型Unet-ResNet34对茶园垄间道路图像进行逐像素分类。

Unet是传统全卷积神经网络(FCN)的一种扩展网络,采用U型编码、解码结构,两侧结构对称分布,适用于语义简单、数据集较小的分割任务[20-23]。相较于浅层网络,拥有更多隐含层的深层神经网络能处理更为复杂的数据[22-23],ResNet包含的残差单元能大幅增加网络深度,而不给网络训练带来额外计算量。Unet编码结构与ResNet编码结构相同,都是通过卷积、池化等操作提取图像复杂特征[24]。因此,Unet的编码结构可以由不同深度的ResNet所取代,从而形成一个全新图像分割模型。

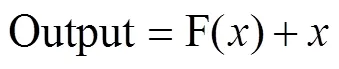

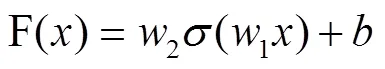

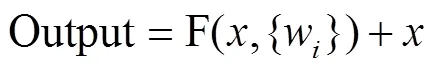

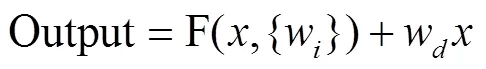

在残差结构中,输出(Output)数学表达式

式中为特征输入向量,F()为卷积层函数,为线性整流单元(ReLU)的激活函数,1和2为前两层的权重,为偏差。两层残差结构输出(Output)数学表达式

当恒等映射输入变量与经卷积层操作后输出的数值尺寸不同时,应将恒等映射改为线性映射,即在捷径连接(shortcut connection)处加入卷积层以匹配图像尺寸。

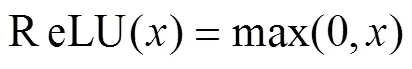

茶园垄间道路分割网络(如图3)由编码(图中虚线框)和解码阶段组成:编码阶段用ResNet34特征提取模块替换Unet相应模块,特征图首先输入卷积核大小为7×7的卷积层和3×3的最大池化层,粗略提取图片特征并减小尺寸,然后进入堆叠残差层,残差层主要包括4个阶段,每个阶段分别由3、4、6、3个的残差模块组成。同一个阶段之间的特征传递数量和特征图像尺寸不变,但特征图像尺寸为前一个阶段的一半。解码阶段包含4个上采样模块,每个模块包含1个2×2反卷积层、1个跳跃连接层和1个3×3卷积层,网络末端添加1个1×1卷积层,网络中所有卷积层后都加入了批归一化(BN)和线性整流函数(RELU)。每个模块先经过反卷积层处理,随后与对应编码阶段的特征图进行维度拼接,通过跳跃连接进行维度拼接方法改进了像素定位和分类问题。

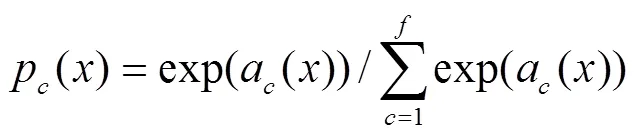

模型训练时,输出特征图中逐像素回归值p()的计算公式

式中a()为位置特征通道像素得分;为类的数量;p()为像素特征通道逐像素回归值。

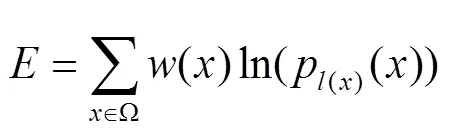

能量函数为逐像素回归值交叉熵损失函数,计算公式

式中p(x)()为像素的softmax损失函数;()为像素标签值;()为像素权重。

茶园道路分割模型训练结束后,输入测试集图像可得到回归概率,道路分割情况如图4b所示。

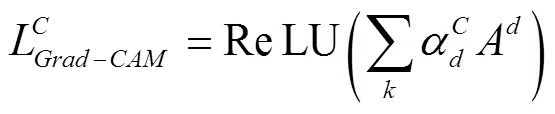

2.2 模型可视化

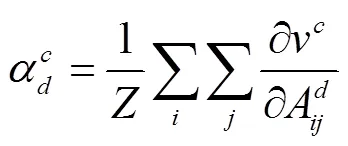

为了方便理解本文语义分割模型,使用Grad-CAM方法可视化解释道路识别任务。Grad-CAM神经元权重为最后1×1卷积层的梯度信息,并只解释模型输出层中特定决策内容。Grad-CAM中特征图对应类别权重计算公式

式中Z表示图像中总像素个数;vc表示对应类别C的概率,表示特征图(第d个)在位置(i, j)上的像素。

2.3 导航路径与导航线识别

现有路径识别方法主要通过垂直投影法、最小二乘法、Hough变换等算法线性拟合直线路径。受茶树长势和茶园环境的影响,茶园垄间道路边缘呈不规则形状且导航线多为曲线,运用上述方法对路径进行拟合偏差较大。本文采用斜向+水平扫描法提取茶园道路两侧关键信息点,然后对两侧信息点运用加权求和法得到道路中点,最后基于三次B样条曲线原理拟合导航线。

2.3.1 边缘信息与拟合中点提取

二值化操作Unet-ResNet34模型分割后的掩码图片,选取道路掩码最大区域并进行中值滤波和膨胀处理,使道路边缘更加平滑。二值化后道路形状呈“凸”字形,道路起始和中间区域形状都为长方形,尽头区域形状为三角形。如果只采用垂直投影法扫描道路,会出现边缘信息不完整的问题,针对上述特点,本文提出了一种基于斜向+水平扫描法的道路两侧信息点获取方法,获取方法如流程图所示,具体步骤如下:

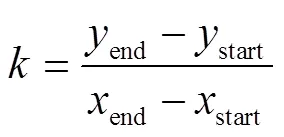

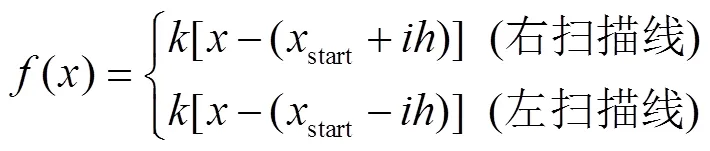

1)选取二值化图像起始区域下半部分道路中心点作为起始点,最大掩码区域轴上像素最小点为道路终点,进而求得两点斜率,斜率公式为

式中(start,start)为道路起始点坐标;(end,end)为道路终点坐标。

2)以道路起始点和终点连线为中心线,分别在中心线左右两侧选取距离其间距为的斜向扫描线,扫描线斜率由步骤1)生成,其中间距为的第对斜向扫描线公式如下

式中为扫描间距。

3)对图像进行二值化处理后,掩码区域像素灰度为255,背景区域像素灰度为0,在图像中沿斜向扫描线由上到下进行逐像素扫描。当以某点为中心左右连续两个相邻像素灰度值变化,则该点为道路边缘关键点,具体解释如下:该点左边相邻位置连续2个像素灰度为0,右边相邻位置连续2个像素灰度为255,则该点为左侧边缘关键点;相反,若该点左边相邻位置连续2个像素灰度为255,右边相邻位置连续2个像素灰度为0,则为右侧边缘关键点。

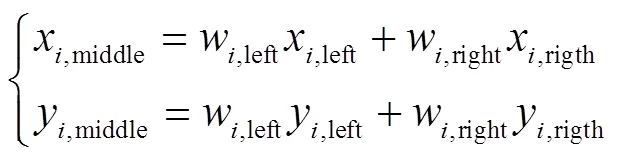

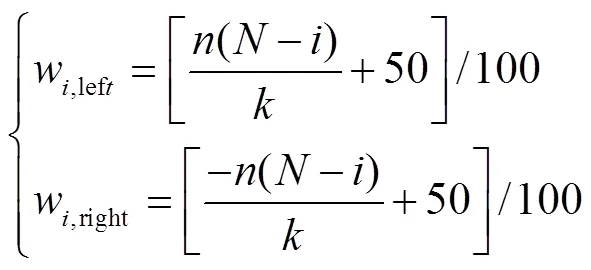

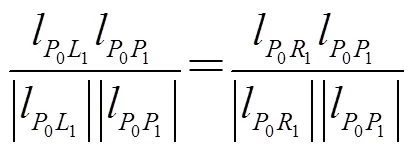

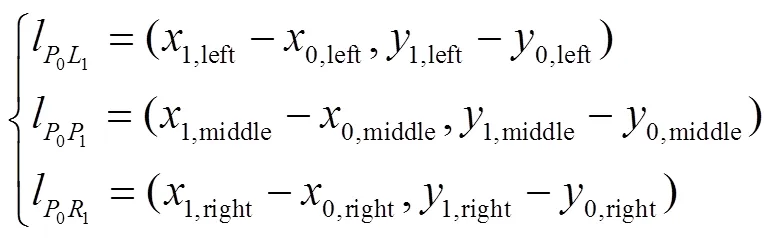

4)通过斜向扫描生成道路两侧多对边缘关键点,对边缘关键点坐标加权求和,得到自上而下的茶园垄间道路中点,第个拟合中点坐标数学表达式为

其中

式中(xleft,yleft)为道路左侧关键点坐标;(xright,yright)为道路右侧关键点坐标;(xmiddle,ymiddle)为拟合中点坐标;wleft、wright分别为左、右侧权重值;为斜向扫描次数;为修正系数。

其中

由式(16)可知,由道路边缘关键点计算的前两个路径中点连线为道路夹角的角平分线,因此路径中点的权重w,left和w,right会随着相机视角和道路形状发生变化,在每幅图像由式(14)、(15)、(16)、(17)联立所得。

5)道路最大掩码区域近似为“凸”字型,只采用单一斜向扫描获得的道路两侧信息不能完全反映道路形状,斜向扫描完成后,以步骤4)中最后一个拟合中点距离50像素的位置开始进行水平扫描,这里“50像素”的选取依据为经过多张图片试验所得,为经验值。由于此值和相机视角、图片分辨率、相机焦距、相机位置等均有关系,当相机的相关参数发生变化时,此值会稍有不同。

6)运用水平扫描法生成多对道路两侧边缘关键点,然后对关键点坐标加权求和得到茶园垄间道路剩余拟合中点。由于此处为“凸”字型的下半部分,其为长方形,因此在每幅图像中两侧权重均为定值0.5。

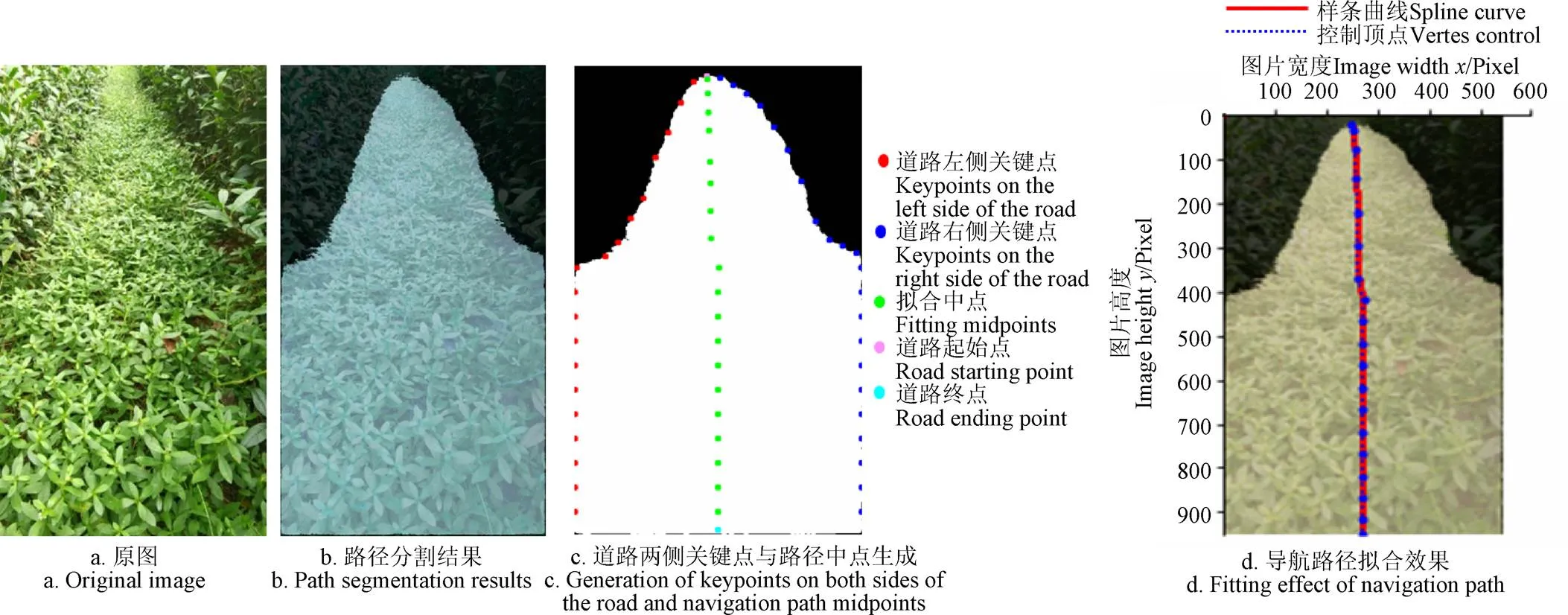

茶园道路边缘关键点和拟合中点效果如图5c,由图可知,道路两侧边缘关键点提取方法能适应茶园道路不同形状并得到较为精准的拟合中点。

2.3.2 基于B样条曲线的导航线拟合方法

茶园垄间道路边缘呈不规则形状且导航线多为曲线,使用B样条曲线方法拟合导航路径具有连续性、局部可控等优势,适合智能履带车导航路径生成。本文把路径起始点、导航拟合中点和道路终点作为控制点,完成多段三次B样条曲线拟合,生成道路导航线[25-26]。

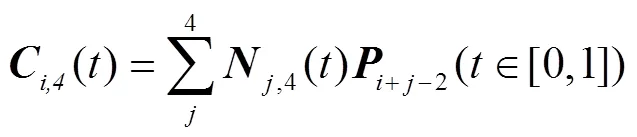

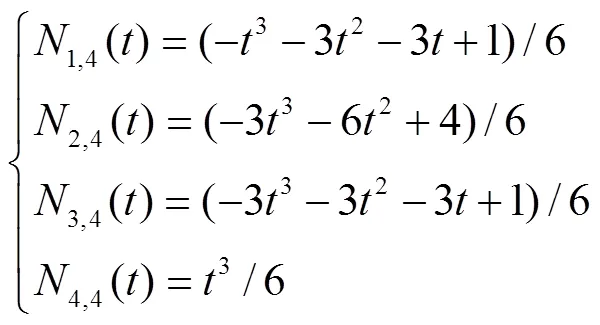

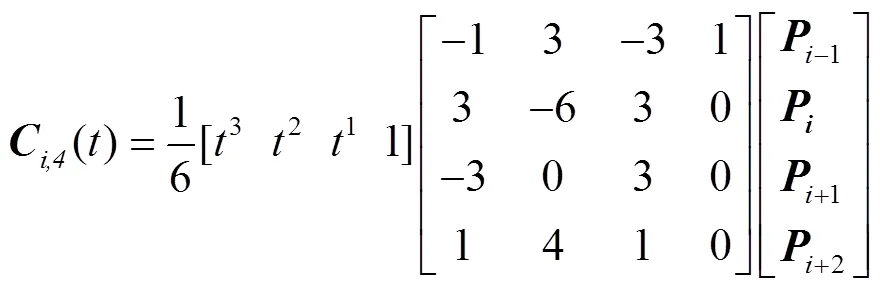

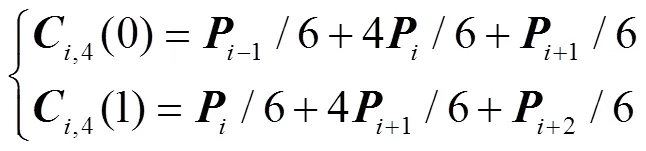

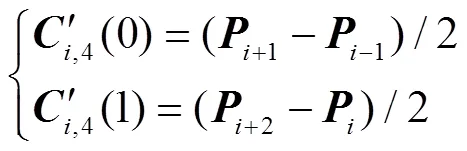

导航线拟合基于+ 1个控制顶点(=0, 1, 2, 3,…,),三次B样条曲线拟合基于已知的4个控制顶点,即4个相邻拟合中点可得一段曲线,第段三次B样条曲线表达式

式中为曲线参数;,4()为三次B样条曲线基函数;-2为曲线相应控制顶点;, 4()为包含横纵坐标的曲线。

样条曲线基函数

式中为曲线参数。

第段三次B样条曲线矩阵数学表达式

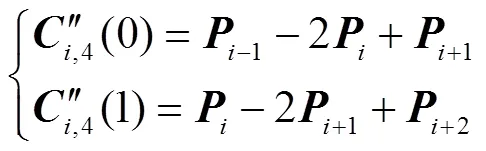

第段三次B样条曲线始末端点坐标位置、一阶及二阶导数分别为

根据上述公式推导,完成多段三次B样条曲线拟合,生成的道路导航线如图4d所示。基于样条曲线拟合原理,扫描间距越小,三次B样条曲线拟合的中点越多,拟合精度越高,但会导致曲线过拟合且计算量较大。相反,扫描间距越小,拟合的中点越少,拟合精度则会下降。经多张图片试验所得,本文扫描间距取35像素,能真实反应茶园道路信息且计算量较小。由于扫描间距取值与相机视角、图片分辨率等均有关系,因此不同大小图像取值会稍有不同。

图4 导航线生成流程

2.3.3 导航线测试方法

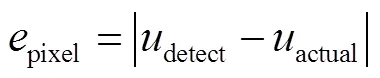

履带车在茶园中行驶并不断采集茶园垄间图像,在茶园垄间道路图像中等距选取10个实际道路中点。茶园垄间道路图像中等距选取实际道路中点的具体步骤:在实际茶园中,对照图像选取的实际茶园路径点,在实际道路中用卷尺测量垄间道路并标记道路中点,按相应位置标记在图片中。与相同横坐标的识别路径点进行纵坐标像素计算,对计算结果取绝对值,公式如下

式中detect为识别路径点像素纵坐标;actual为实际道路点像素纵坐标。

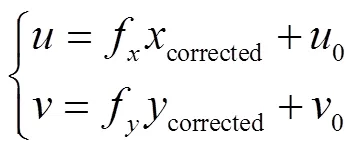

为了将图像中的像素误差转换为实际茶园中的距离误差,根据针孔相机成像模型将实际路径点和识别路径点的像素坐标转化成相机坐标,通过两点欧氏距离的计算得到实际茶园距离误差。相机内外参数和畸变系数已标定,其中f=1 559.249 53,f=1 557.660 1,0=540.697 63,0=955.759 58,1=−0.022 97、2=0.314 68、1=0.000 23、2=0.000 04,由于12较小,代入公式时按0处理。近距离误差测量为1%。坐标转换公式

式中(,)为像素坐标;f、f、0、0为相机内部参数;(corrected,corrected)为归一化平面纠正坐标;1、2、1、2为相机畸变参数;为归一化平面极径;(,,)为相机坐标系坐标。

3 结果与分析

通过道路分割和导航线识别试验,验证本文提出的导航线提取方法在茶园垄间道路数据集中的准确性和有效性。

3.1 参数设置与模型训练

训练周期(Epochs)为450,单次批量训练图像数量为(Batch Size)8,选择随机梯度下降法(Stochastic Gradient Descent,SGD)作为优化算法,负对数似然损失方法(Negative Log-likelihood Loss,NLLLoss)作为损失函数;学习率进行动态调整,初始学习率为0.01,每训练5个周期学习率衰减0.8,动量因子为0,权重衰减系数为0.0001。本文模型可直接输入茶园垄间道路图像进行训练,图像尺寸为1 920像素×1 080像素,为了加快训练速度,图像分辨率统一缩放为960像素×544像素;茶园垄间道路分割模型使用迁移学习法进行训练,加载ImageNet数据集预训练权重初始化方法。

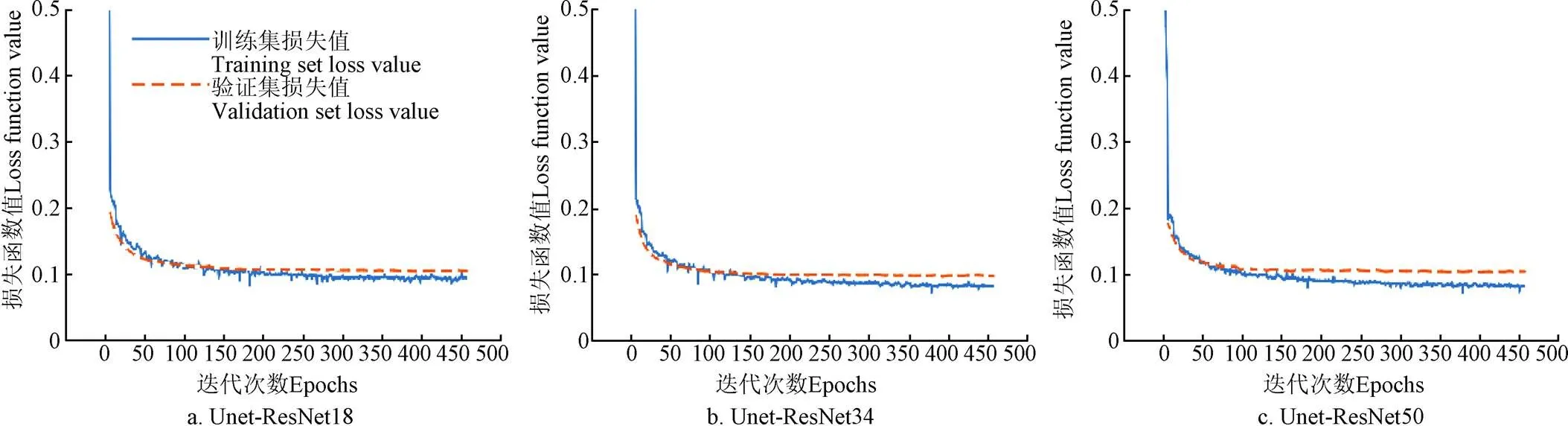

本文可选择18、34和50层的Unet-ResNet模型,通过对比不同深度模型分割效果,初步确定茶园垄间道路分割模型的深度。不同深度模型训练损失函数曲线如图5所示。

图5 不同深度模型训练损失函数曲线

观察图5损失曲线可知,训练集损失始终小于测试集损失,随着迭代次数增加,模型损失值趋于收敛。Unet-ResNet34测试集损失值最小,说明其在测试集上的泛化性最好。

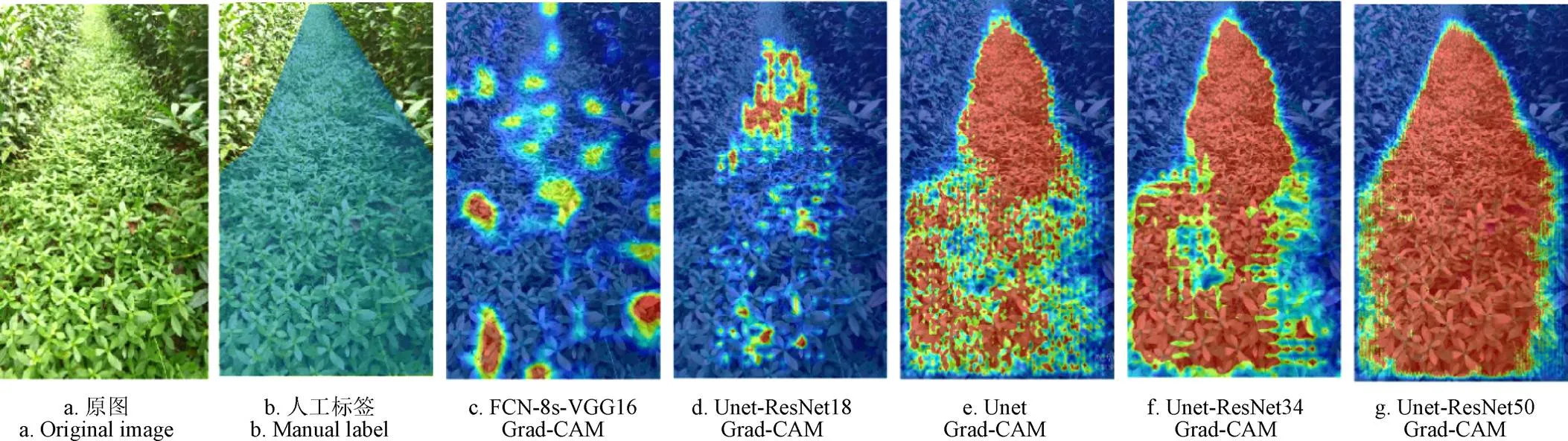

分别对Unet、Unet-ResNet18、Unet-ResNet34、Unet-ResNet50和FCN-8s-VGG16模型最后的卷积层进行解释,茶园垄间道路可视化结果如图6所示。

观察不同模型可视化Grad-CAM热力图,可以看出对茶园垄间道路关注区域各有不同,从图6c和6d中观察到模型Unet-ResNet18和FCN-8s-VGG16只关注茶园垄间道路局部区域,即红色区域过于分散,不同尺度特征之间缺乏联系,图像特征识别存在极大缺陷。从图6e、6f和6g中观察到模型Unet、Unet-ResNet34和Unet-ResNet50关注茶园垄间道路内的特征,读取的特征接近图6b人工标签,但从图6e和6g中可以观察到,Unet模型对道路图像的下半部分关注不足,即下半部分红色区域较为分散未能覆盖道路,Unet-ResNet50模型对垄间道路识别强度较高,即红色区域完全覆盖道路,但模型有过拟合的可能,会较低模型运算速度。

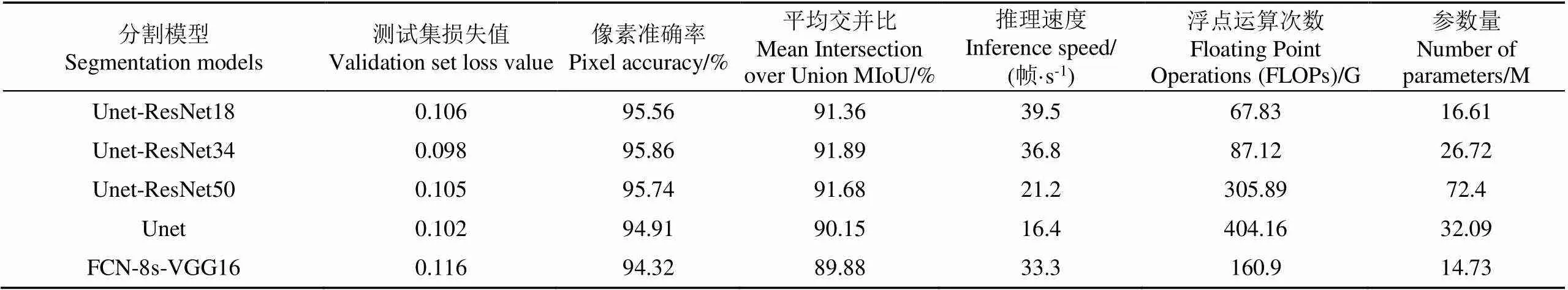

3.2 模型性能验证

将960×544像素的茶园垄间导航路径测试集图片输入模型进行测试,模型分割结果如表1所示。可以看出,Unet-ResNet34模型的像素准确率为95.86%,平均交并比为91.89%,均优于另外4种模型且推理速度仅次于Unet-ResNet18,能满足实时性需求。同时在浮点运算次数和参数量上可以看出,模型Unet-ResNet34相比Unet-ResNet18略大,相比Unet-ResNet50和原始Unet均较小,而模型FCN-8s-VGG16虽然参数量较小,但浮点运算次数较大,因此综合考虑模型性能和大小,本文选择Unet-ResNet34模型作为最终分割模型。

注:在Grad-CAM图中,蓝色区域是模型关注少的部分,红色区域是模型关注多的部分,颜色越红的区域表示模型越关注的部位。

表1 模型训练结果对比

导航路径的连续性导致本文数据集相邻帧的图像可能差距不大,当前图像的垄行估计可以在上一帧的基础上加以修正,但是这种方法会随着算法的迭代使导航误差不断累计。同时,当垄行图像发生较大变化时,此算法也将很难适用。而Unet-ResNet34模型速度较快,从获取图像到完成提取路径的耗时约36.8帧/s(250 ms),参数量为26.72 M,并未过多增加计算成本,且能够适应不同的场景,因此具有一定的优势。其在茶园垄间道路测试集的分割效果如图7所示。

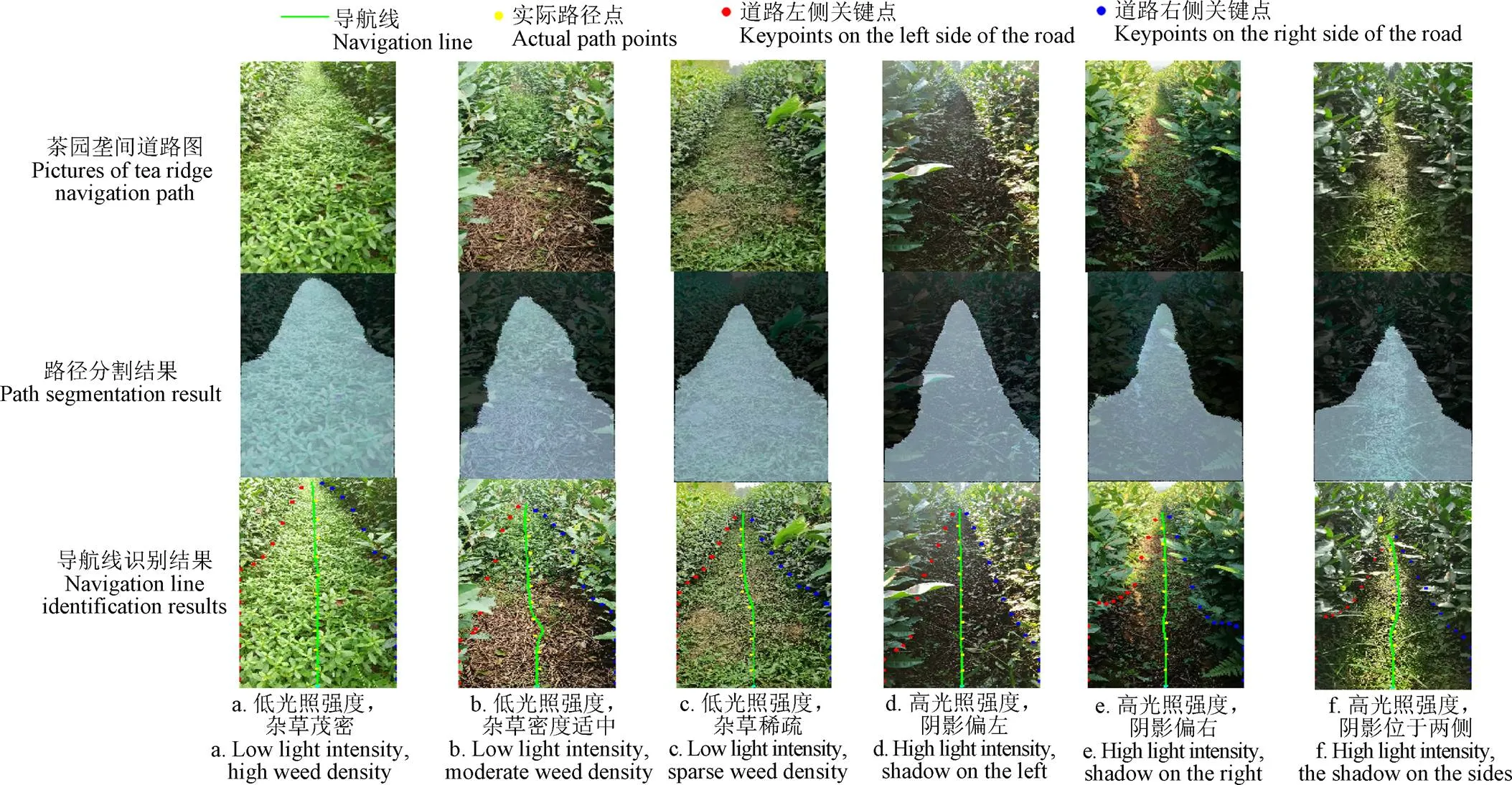

图7 不同环境下路径分割和识别结果

3.3 路径识别结果

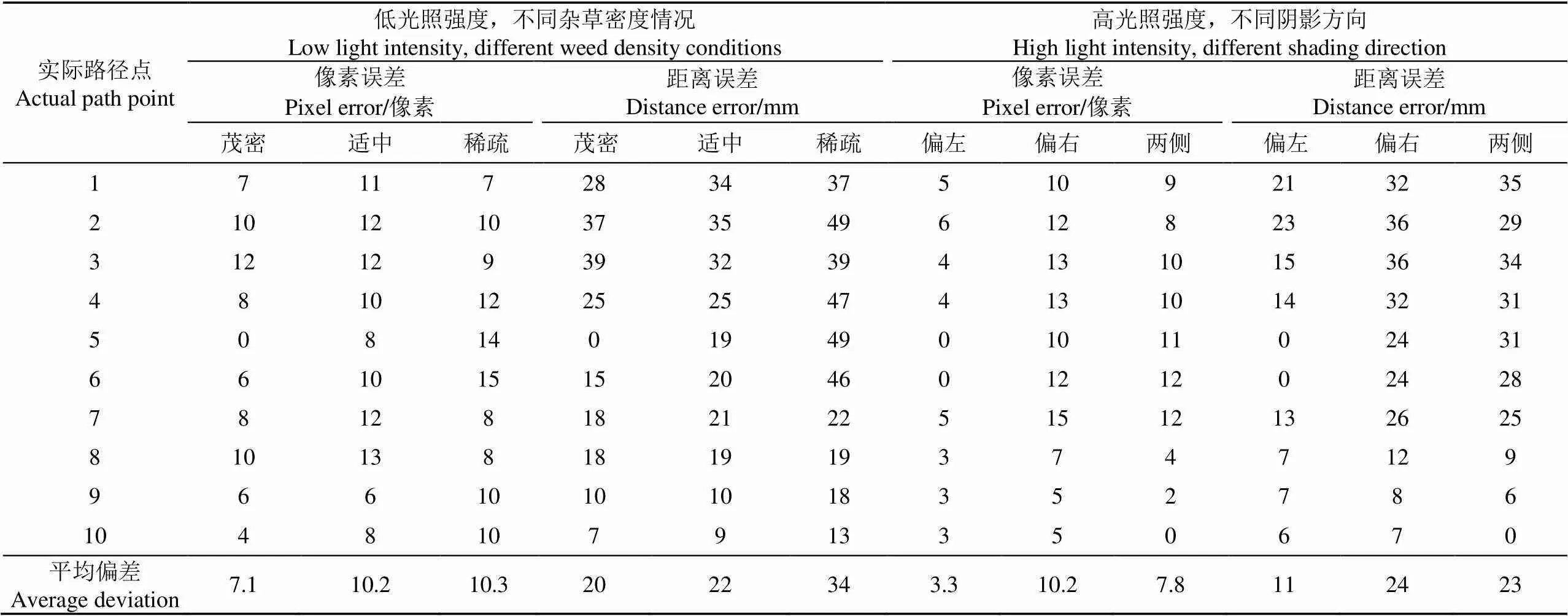

茶园垄间道路像素偏差和实际距离结果如表2,从像素偏差结果可以看出,低光照强度且不同杂草密度情况下,道路平均像素偏差为7.1、10.2、10.3像素。高光照强度且不同阴影情况下,道路平均像素偏差为3.3、10.2、7.8像素。综上可得,不同茶园环境下垄间道路平均像素偏差为8.2像素。从实际距离偏差结果可以看出,低光照强度且不同杂草密度情况下,道路平均实际距离偏差为0.02、0.022、0.034 m。高光照强度且不同阴影情况下,道路平均实际距离偏差为0.011、0.024、0.023 m。不同环境下道路平均距离偏差为0.022 m。路径点到相机的实际距离为0.985~6.435 m之间,随着实际路径点与相机距离不断增大(表2路径点10表示图7中道路最近点,点1表示图7中道路最远点),欧式距离变大,因此由像素偏差换算后的道路实际偏差越大。由上述试验结果可知,在复杂茶园环境条件下,本文提出的Unet-ResNet34模型对茶园道路的识别效果受环境影响较小,边缘提取法可以正确识别茶园垄间道路轮廓,通过加权求和方式得到边缘不断变化的道路中点,三次B样条曲线拟合法能得到连续、顺滑的导航路径。已知茶园垄间道路平均宽度为1 m,道路平均距离偏差占比2.2%,从获取图像到完成提取路径的耗时总计0.179 s。分别在不同光照强度、不同杂草密度和不同阴影方向等茶园环境测试集图片中完成垄间道路识别试验,道路识别结果如图7所示。

表2 茶园垄间道路识别偏差结果

4 结 论

本文针对智能履带车实现茶园垄间道路中的自动导航问题,在Unet模型的基础上通过优化结构提出Unet-ResNet34模型。然后根据模型分割后的掩码图像提取茶园垄间道路两侧边缘信息,并运用加权求和法生成垄间道路中点,最后基于多段三次B样条曲线拟合导航路径。结论如下:

1)本研究在Unet基础上提出Unet-ResNet34模型,该模型在不同光照和杂草条件下垄间道路平均分割交并比为91.89%,像素准确率为95.86%,推理速度为36.8帧/s,满足茶园垄间道路导航的精确性和实时性要求。

2)运用Grad-CAM方法解决不同模型在茶园垄间道路分割过程中难以可视化解释的问题。从Grad-CAM图中激活区域的强度和位置参数出发进一步说明模型的关注区域,验证了Unet-ResNet34模型的合理性。

3)通过斜向+水平道路边缘扫描法和基于三次B样条曲线提取方法从模型分割的茶园垄间道路中提取道路中线,作为履带车导航线。经过导航线偏差试验可知,本文提出算法的平均像素偏差为8.2像素,平均距离偏差为0.022 m。已知茶园垄间道路平均宽度为1 m,道路平均距离偏差占比2.2%,从获取图像到完成提取路径的耗时总计0.179 s。本文提出的道路识别方法有较高的精度和实时性,能够为智慧茶园自动驾驶技术提供部分视觉参考。

[1] 董春旺. 茶叶智能化加工技术的创新思考[J]. 中国茶叶,2019,41(3):53-55.

Dong Chunwang. Innovative thinking on intelligent tea processing technology[J]. Chinese Teas, 2019, 41(3): 53-55. (in Chinese with English abstract)

[2] 胡静涛,高雷,白晓平,等. 农业机械自动导航技术研究进展[J]. 农业工程学报,2015,31(10):1-10.

Hu Jingtao, Gao Lei, Bai Xiaoping, et al. Review of research on automatic guidance of agricultural vehicles [J]. Transactions of the Chinese Society of Agricultural Engineering(Transactions of the CSAE), 2015, 31(10): 1-10. (in Chinese with English abstract)

[3] 孟庆宽,张漫,仇瑞承,等. 基于改进遗传算法的农机具视觉导航线检测[J]. 农业机械学报,2014,45(10):39-46.

Meng Qingkuan, Zhang Man, Qiu Ruicheng, et al. Navigation line detection for farm machinery based on improved genetic algorithm[J]. Transactions of the Chinese Society for Agricultural Machinery, 2014, 45(10): 39-46. (in Chinese with English abstract)

[4] 张雄楚,陈兵旗,李景彬,等. 红枣收获机视觉导航路径检测[J]. 农业工程学报,2020,36(13):133-140.

Zhang Xiongchu, Chen Bingqi, Li Jingbin, et al. Path detection of visual navigation for jujube harvesters[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(13): 133-140. (in Chinese with English abstract)

[5] Montalvo M, Pajares G, Guerrero J M, et al. Automatic detection of crop rows in maize fields with high weeds pressure [J]. Expert Systems with Applications, 2012, 39(15): 11889-11897.

[6] 张成涛,谭彧,吴刚,等. 基于达芬奇平台的联合收获机视觉导航系统路径识别[J]. 农业机械学报,2012,43(S1):271-276.

Zhang Chengtao, Tan Yu, Wu Gang, et al. Path recognition of visual navigation system of combine harvester based on da vinci platform[J]. Transactions of the Chinese Society for Agricultural Machinery, 2012, 43(S1): 271-276. (in Chinese with English abstract)

[7] 关卓怀,陈科尹,丁幼春,等. 水稻收获作业视觉导航路径提取方法[J]. 农业机械学报,2020,51(1):19-28.

Guan Zhuohuai, Chen Keyin, Ding Youchun, et al. Visual navigation path extraction method in rice harvesting[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(1): 19-28. (in Chinese with English abstract)

[8] 赵立明,叶川,张毅,等. 非结构化环境下机器人视觉导航的路径识别方法[J]. 光学学报,2018,38(8):267-276.

Zhao Liming, Ye Chuan, Zhang Yi, et al. Path recognition method of robot vision navigation in unstructured environments[J]. Acta Optica Sinica, 2018, 38(8): 267-276. (in Chinese with English abstract)

[9] 吕艳鹏,潘玉田. 基于BP神经网络的非结构化道路识别[J]. 机械工程与自动化,2014(3):178-180.

Lü Yanpeng, Pan Yutian. Unstructured road recognition based on BP neural network [J]. Mechanical Engineering and Automation, 2014(3): 178-180. (in Chinese with English abstract)

[10] 韩树丰,何勇,方慧. 农机自动导航及无人驾驶车辆的发展综述[J]. 浙江大学学报(农业与生命科学版),2018,44(4):381-391,515.

Han Shufeng, He Yong, Fang Hui. Recent development in automatic guidance and autonomous vehicle for agriculture: A review[J]. Journal of Zhejiang University (Agriculture & Life Sciences), 2018, 44(4): 381-391, 515. (in English with Chinese abstract)

[11] Lin Y, Chen S. Development of navigation system for tea field machine using semantic segmentation[J]. IFAC PapersOnLine, 2019, 52 (30): 108-113.

[12] Lecun Y, Bengio Y, Hinton G. Deep learning [J]. Nature, 2015, 521(7553): 436-444.

[13] Saleem M, Potgieter J, Arif K. Automation in agriculture by machine and deep learning techniques: A review of recent developments[J]. Precision Agriculture, 2021, 22(6): 2053-2091.

[14] Kamilaris A, Prenafeta-boldu F X. A review of the use of convolutional neural networks in agriculture[J]. Journal of Agricultural Science, 2018, 156(3): 312-322.

[15] 钟昌源,胡泽林,李淼,等. 基于分组注意力模块的实时农作物病害叶片语义分割模型[J]. 农业工程学报,2021,37(4):208-215.

Zhong Changyuan, Hu Zelin, Li Miao, et al. Real-time semantic segmentation model for crop disease leaves using group attention module[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(4): 208-215. (in Chinese with English abstract)

[16] 李云伍,徐俊杰,刘得雄,等. 基于改进空洞卷积神经网络的丘陵山区田间道路场景识别[J]. 农业工程学报,2019,35(7):150-159.

Li Yunwu, Xu Junjie, Liu Dexiong, et al. Field road scene recognition in hilly regions based on improved dilated convolutional networks[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(7): 150-159. (in Chinese with English abstract)

[17] Lin J, Wang W, Huang S, et al. Learning based semantic segmentation for robot navigation in outdoor environment[C]// Otsu: Proceedings of the Joint World Congress of International Fuzzy Systems Association & International Conference on Soft Computing & Intelligent Systems, 2017.

[18] 韩振浩,李佳,苑严伟,等. 基于U-Net网络的果园视觉导航路径识别方法[J]. 农业机械学报,2021,52(1):30-39.

Han Zhenhao, Li Jia, Yuan Yanwei, et al. Path recognition of orchard visual navigation based on U-Net[J]. Transactions of the Chinese Society for Agricultural Machinery, 2021, 52(1): 30-39. (in Chinese with English abstract)

[19] 饶秀勤,朱逸航,张延宁,等. 基于语义分割的作物垄间导航路径识别[J]. 农业工程学报,2021,37(20):179-186.

Rao Xiuqin, Zhu Yihang, Zhang Yanning, et al. Navigation path recognition between crop ridges based on semantic segmentation[J]. Transactions of the Chinese Society of Agricultural Engineering(Transactions of the CSAE), 2021, 37(20): 179-186. (in Chinese with English abstract)

[20] Shelhamer E, Long J, Darrell T. Fully convolutional networks for semantic segmentation[J]. Ieee Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(4): 640-651.

[21] Ronneberger O, Fischer P, Brox T. U-Net: Convolutional networks for biomedical image segmentation[J]. Springer International Publishing, 2015, 9351: 234-241

[22] 李琳,余胜生. 基于深度学习模型的图像质量评价方法[J]. 华中科技大学学报:自然科学版,2016,44(12):70-75.

Li Lin, Yu Shengsheng. Image quality assessment based on deep learning model[J]. Journal of Huazhong University of Science and Technology: Science and Technology, 2016, 44(12): 70-75. (in Chinese with English abstract)

[23] Wu Z, Shen C, Van Den Hengel A. Wider or deeper: Revisiting the ResNet model for visual recognition[J]. Pattern Recognition, 2019, 90: 119-133.

[24] Zhou D, Li M, Li Y, et al. Detection of ground straw coverage under conservation tillage based on deep learning[J]. Computers and Electronics in Agriculture, 2020, 172: 105369.

[25] 吕恩利,林伟加,刘妍华,等. 基于B样条曲线的智能叉车托盘拾取路径规划研究[J]. 农业机械学报,2019,50(5):394-402.

Lü Enli, Lin Weijia, Liu Yanhua, et al. Pallet picking path planning of intelligent forklift based on B-spline curve[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(5): 394-402. (in Chinese with English abstract)

[26] 王晓栋,徐成,刘彦. 一种实时鲁棒的非结构化道路检测算法[J]. 计算机应用研究,2010,27(7):2763-2765,2769.

Wang Xiaodong, Xu Cheng, Liu Yan. Real-time and robust method for unstructured roads detection[J]. Application Research of Computers, 2010, 27(7): 2763-2765, 2769. (in Chinese with English abstract)

Navigation path recognition between tea ridges using improved Unet network

Zhao Yan1,3, Zhang Rentian1,2,3, Dong Chunwang2, Liu Zhongyuan1,2, Li Yang2※

(1.,,832000,; 2,,310000,;3,,832000,)

Navigation path recognition has been widely regarded as one of the most important sub-tasks of intelligent agricultural equipment. An intelligent tracked vehicle can also be expected to realize the automatic navigation on the road between the tea garden ridges. However, there are still some challenges on the navigation path recognition between tea ridges using deep learning models, such as the low accuracy, real-time performance, and model interpretability. In this research, a new Unet-ResNet34 model was proposed to accurately and rapidly recognize the navigation path between the tea ridges using semantic segmentation. The midpoints of the navigation path were then generated using the navigation path extracted from the model. Finally, the multi-segment cubic B-spline curve equation was used to fit the midpoints, in order to generate the navigation line between the tea garden ridges. The Image Labeler toolbox in the Matlab 2019 platform was selected to label the navigation path in the collected images for the navigation path dataset. A navigation path dataset was then obtained consisting of 1 824 images. Among them, 1 568 and 256 images in the dataset were randomly selected for the training and the validation set, respectively. Under different illumination and weed conditions, the Mean Intersection over Union (MIoU) was utilized as the accuracy indicator of the Unet-ResNet34 model, which was 91.89% for the tea road segmentation. The navigation path segmentation mask was also used to generate the navigation information and keypoints for the path fitting. Furthermore, the multi-segment cubic B-spline curve equation was selected to calculate the navigation line of the tea road between ridges using the midpoints as the control points. Additionally, the navigation line was selected to further calculate the pixel and distance error. The mean difference between the predicted pixel and distance error of tea navigation paths were 8.2 pixels and 0.022 m, respectively. As such, the width of the tea navigation path was achieved about 1 m, where the ratio was 2.2% between the average distance error and the width of the tea navigation path. In terms of real-time performance and the number of parameters, the inference speed of the Unet-ResNet34 model was 36.8 frames per second. The number of parameters of the Unet-ResNet34 model was 26.72 M. The inference speed was 36.8 frames per second to process the RGB image with a size of 960×544. A visualization method of gradient weighted class activation mapping (Grad-CAM) was used to visually represent the final extraction feature of the improved models. More importantly, the special features were highlighted on the navigation path between the tea inter-ridges in the optimized Unet-ResNet34 structure, while retaining only the most crucial feature extractors. The speed of the tracked vehicle in the tea was mostly 0-1 m/s, particularly with the 0.179 s average processing time of a single tea inter-ridge image. In summary, the improved model can be fully realized the real-time and accurate navigation path recognition of tea ridges. The finding can also provide the technical and theoretical support to the intelligent agricultural equipment in the tea environment.

navigation; deep learning; visualization of tea garden; path recognition; semantic segmentation; spline curve fitting

10.11975/j.issn.1002-6819.2022.19.018

S24

A

1002-6819(2022)-19-0162-10

赵岩,张人天,董春旺,等. 采用改进Unet网络的茶园导航路径识别方法[J]. 农业工程学报,2022,38(19):162-171.doi:10.11975/j.issn.1002-6819.2022.19.018 http://www.tcsae.org

Zhao Yan, Zhang Rentian, Dong Chunwang, et al. Navigation path recognition between tea ridges using improved Unet network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(19): 162-171. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2022.19.018 http://www.tcsae.org

2022-06-01

2022-07-26

浙江省“尖兵”研发攻关计划(2022C02010);中央级院所基本科研业务费专项(1610212021004;1610212022004)

赵岩,教授,研究方向为农业机械化工程。Email:115374865@qq.com

李杨,博士,助理研究员,研究方向为智能农业装备。Email:Li91yang@163.com