引入超分辨率下采样误差的图像边信息估计隐写

赵鑫,王垚飞,陈可江,张卫明,俞能海

1. 中国科学技术大学网络空间安全学院, 合肥 230027; 2. 中国科学院电磁空间信息重点实验室, 合肥 230027

0 引 言

隐写是一种隐蔽通信技术,通过轻微地修改载体上的元素来嵌入并传输秘密信息,其安全性由对抗隐写分析检测的能力来衡量(Fridrich,2006)。最小化失真隐写框架是实现安全隐写的主流框架。STC(syndrome-trellis codes)(Filler等,2011)和隐写极化码SPC(steganographic polar codes)(Li等,2020b)的出现,使得针对任意加性失真函数,隐写方能够在给定嵌入率下接近总体失真的理论下界。所以当今隐写领域的主要研究方向是如何设计更好的失真函数。

失真函数通过量化载体上每个像素点被修改所产生的影响,为每个像素点分配修改失真。在加性隐写条件下,所有修改带来的影响总和代表了载体图像和载密图像之间的总体失真(Wang等,2016)。现有很多用于空域图像的失真函数算法,比如HUGO(highly undetectable stego)(Pevny等,2010)、WOW(wavelet obtained weights)(Holub和Fridrich,2012)、SUNIWARD(universal wavelet relative distortion for the spatial)(Holub和Fridrich,2013)、HILL(high-pass, low-pass, and low-pass)(Li等,2014)和MVGG(multivariate generalized Gaussian)(Sedighi等,2015)。这些失真函数为像素点嵌入时的±1修改赋予了相等的失真,称之为对称失真函数。但在实际情况下,由于自然图像的分布特性,像素点+1和-1的修改失真不应该总是一样的。

现实场景中,隐写方用于嵌入消息的载体大多已经经过了各种各样的图像处理操作,比如下采样、颜色转换和有损压缩等,而这些图像处理过程中产生的辅助信息,比如量化误差,可以被隐写方利用来提升隐写安全性。Denemark和Fridrich(2015)通过利用量化误差提出原始边信息隐写方法。实验表明,利用载体图像生成过程中的量化误差对初始失真进行调整,隐写安全性可得到显著的提升。

虽然Denemark和Fridrich(2015)证实了利用原始图像提供的辅助信息进行边信息隐写的有效性,但是现实中隐写方并不总能拥有原始图像,所以Li等人(2020a)在JPEG域中提出估计边信息隐写方法,通过估计JPEG压缩过程产生的量化误差,并将其作为辅助信息调整初始失真,大大提升了JPEG隐写的安全性。

然而目前尚未有针对空域图像边信息估计的隐写方法,空域图像与JPEG图像不同,不存在JPEG压缩过程,但是大多数空域图像是由大图像下采样得到的小图像,因此提出利用超分辨率(super resolution, SR)技术来获取空域边信息,超分辨率的目标是从低分辨率(low resolution, LR)图像中恢复出高分辨率(high resolution, HR)图像,其难点在于,一个LR图像对应了多个HR图像,因此这是一个不适定性问题。随着深度学习的发展,出现了多种基于深度学习的超分辨率方法,如SRResNet(deep residual network for image super resolution)、SRGAN(generative adversarial network for image super resolution)(Ledig等,2017)、EDSR(enhanced deep super-resolution)(Lim等,2017)、RRDBNet(residual in residual dense block network)、ESRGAN(enhanced super-resolution generative adversarial networks)(Wang等,2018)和RCAN(residual channel attention networks)(Zhang等,2018)等。本文利用超分辨率网络生成HR空域图像,然后以浮点型精度下采样HR图像获得量化误差边信息,从而调整初始失真实现最优嵌入。

为了更好地估计下采样边信息,本文对比了多种超分辨率网络和调整失真的策略。值得注意的一点是,与超分辨率任务中所追求的感知指标不同,如峰值信噪比(peak signal to noise ratio, PSNR)、结构相似度(structural similarity, SSIM)等,本文区分用于边信息估计隐写的好坏,是通过对抗隐写分析的检测能力来衡量的。最终本文选择了使用残差通道注意力机制网络RCAN生成对应载体的HR图像,之后以浮点型精度下采样HR图像得到与载体图像同分辨率的参考图像,即未量化载体;利用未量化载体和载体对应像素点之间差值的极性决定初始失真的调整方向,并对初始失真以不同权重进行调整获得非对称失真。实验表明,利用本文方法,在抵抗基于手工特征和基于深度学习的隐写分析器时,相对于传统对称失真隐写,大幅提升了隐写安全性,接近甚至在某些情况下超过原始边信息的隐写安全性能。

1 相关工作

1.1 空域图像原始边信息隐写

Denemark和Fridrich(2015)提出原始边信息隐写,通过利用载体对应的原始图像,即预载体,在图像处理过程中产生的量化误差,调整载体元素±1修改的初始失真,使得隐写安全性得到显著提升。先回顾基于下采样处理获取空域图像原始边信息的隐写。

(1)

(2)

式中,λ值计算为

(3)

式中,m是嵌入消息的比特长度。Filler和Fridrich(2010)证明式(3)右侧的熵在λ上是单调递减的,所以在可行域内给定一个消息长度m,λ可以通过二分搜索方法快速确定。

1.2 超分辨率网络

本文要解决如何准确估计预载体的问题,因此为了尽可能准确地恢复原始的高分辨率图像,以获得相应的下采样边信息,利用几个超分辨率网络估计HR预载体图像。相关网络的主要特性包括:

1)基于生成对抗网络的超分模型SRGAN(Ledig等,2017)。SRGAN使用深度残差网络SRResNet(Ledig等,2017)作为生成器,使用VGG(Visual Geometry Group)网络(Mahendran和Vedaldi,2016)作为判别器。其中SRResNet以均值平方误差(mean square error, MSE)为失真函数进行优化,在PSNR和SSIM指标上具有非常优秀的表现,而SRGAN由于加入了判别器,内容感知损失和对抗损失作为失真函数,更加注重结果的真实性。

2) 加强的深度残差网络EDSR(Lim等,2017)。EDSR在SRResNet的基础上去掉了标准化层(batch normalization, BN)。原因在于超分辨率任务与计算机视觉领域的其他任务(比如图像识别、目标检测)的区别:前者的输出是具体的像素值,而后者只需要输出一个标签。在BN层去均值操作之后,输出更像一个相对值,并不利于超分任务。对于不同的面向 PSNR 的任务,比如超分辨率和去模糊任务,去掉 BN 层已经被证明能够提高表现和减小计算复杂度。

3)加强的基于生成对抗网络的超分模型ESRGAN(Wang等,2018)。ESRGAN在SRGAN的基础上针对网络结构、对抗损失和感知损失进行改进:提出残差—残差密集块(residual in residual dense block, RRDB),将多层残差和密集连接相结合,同时也去掉了所有BN层;对抗网络借鉴RaGAN(relativistic average generative adversarial networks)结构(Jolicoeur-Martineau,2018),SRGAN 中的判别器用于估计输入到判别器中的图像是真实且自然图像的概率,而 ESRGAN的判别器则尝试估计真实图像相对伪造图像来说更逼真的概率;改进感知损失,使用激活之前的VGG特征,会提供更尖锐的边缘和更符合视觉的结果。

4) 深度残差通道注意力网络RCAN(Zhang等,2018)。作者认为在LR图像的输入和特征中,包含了大量的低频信息,而这些信息在通道间被同等对待,阻碍了卷积神经网络的表征能力;同时越深的图像超分网络越难训练。所以作者提出了残差嵌套(residual in residual,RIR)结构,以构造非常深的可训练网络。RIR中的长跳连接和短跳连接有助于绕过大量的低频信息,使主网络学习到更有效的信息。此外,作者引入通道注意力(channel attention,CA)机制,目的是区别对待不同的特征通道,自适应地调整不同通道的权重,并和残差思想融合,确保信息在网络中的流动,加快网络训练速度。

2 基于超分辨率网络的空域图像边信息估计隐写

2.1 本文方法框架

本文研究图像下采样过程中的边信息对于隐写过程的帮助,方法框架如图1。其中超分辨率网络由成对的图像训练;图中的初始失真可由任意失真函数A获得,比如在本文中A∈{HILL,SUNIWARD};量化误差为未量化载体与载体的差值。本文中的下采样过程均采用MATLAB中的标准双三次插值函数。

图1 基于超分辨率网络的图像边信息估计隐写框架Fig.1 Framework for image side information estimation steganography based on super-resolution network

(4)

式中,调整系数η∈[0,1]。得到调整后的最终失真,即非对称失真后,便可以使用STC(Filler等,2011)或SPC(Li等,2020b)等执行消息嵌入过程。

2.2 超分网络的选择

2.2.1 超分辨率网络的性能比较

1)训练和测试。使用隐写领域常用的3个数据集,BOSSBase(break our steganographic system) 1.01(Bas等,2011),BOWS2(break our watermarking system 2)(Bas和Furon,2007)和MRNC(mixed resized never-compressed)(Li等,2015),分别包含10 000幅512×512像素、10 000幅512×512像素和8 000幅768×768像素的灰度图像。它们对应的下采样图像均采用MATLAB中的标准双三次插值函数获得。使用BOSSBase中的图像和对应下采样得到的256×256像素图像作为训练集进行训练,然后在3个数据库上进行测试。在获得超分图像之后,分别随机选择1 000幅图像测试其平均PSNR和RP,以初步评估超分网络的性能。

2)结果和分析。表1为基于上述相关网络和3个传统插值方法(Nearest、Bilinear和Bicubic)在2倍和4倍上采样生成的HR图像后与原始图像之间的平均PSNR和RP,数值越高在一定程度上反映生成的HR图像质量越好。可以看出,在上采样比例为2,即图像宽和高分别放大2倍的情况下,RCAN几乎在全部数据库上达到了最优值,而上采样比例为4时,RRDBNet和EDSRL表现较好,但整体效果都相对较差。因为上采样比例越高,对于超分辨率网络的性能要求越高,越难以得到准确的HR图像,所以本文方法采用上采样比例为2的超分辨率网络估计预载体。值得注意的是,基于传统插值的方法得到的正确率Rp同样具有较高水平,甚至高于EDSRL所得到的结果,本文指出较高的Rp并不能完全对应较高的隐写安全性。

表1 不同上采样方法在缩放比例为2或4时生成的图像与原始图像之间的PSNR和极性估计正确率RpTable 1 The PSNR and correct rate of polarity estimation(Rp) between the image generated and the original image by different upsampling methods when the scaling factor is 2 or 4

2.2.2 基于不同网络的边信息估计隐写的安全性

通过以下初步实验选定本文方法的网络结构。使用各个网络的最终训练模型来获取估计边信息,并根据式(4)进行失真调整。载体图像库为BOSSBase中1万幅尺寸为256×256像素的灰度图像,嵌入率为0.4 bit/像素,初始失真函数使用HILL(Li等,2014),隐写分析过程在基于手工特征SRM(spatial rich model)(Fridrich和Kodovsky,2012)的集成分类器(Kodovsky等,2012)上训练和测试,训练集和测试集按1 ∶1划分,使用检测错误率Pe作为安全性的观测指标,计算为

(5)

式中,PFA和PMD分别为误警率和漏警率,即将载体误认为载密的概率和将载密误认为载体的概率,该值越大说明隐写安全性越高。为了尽量消除随机性,本文所有检测错误率均取10次独立训练测试的平均值,实验结果见表2。

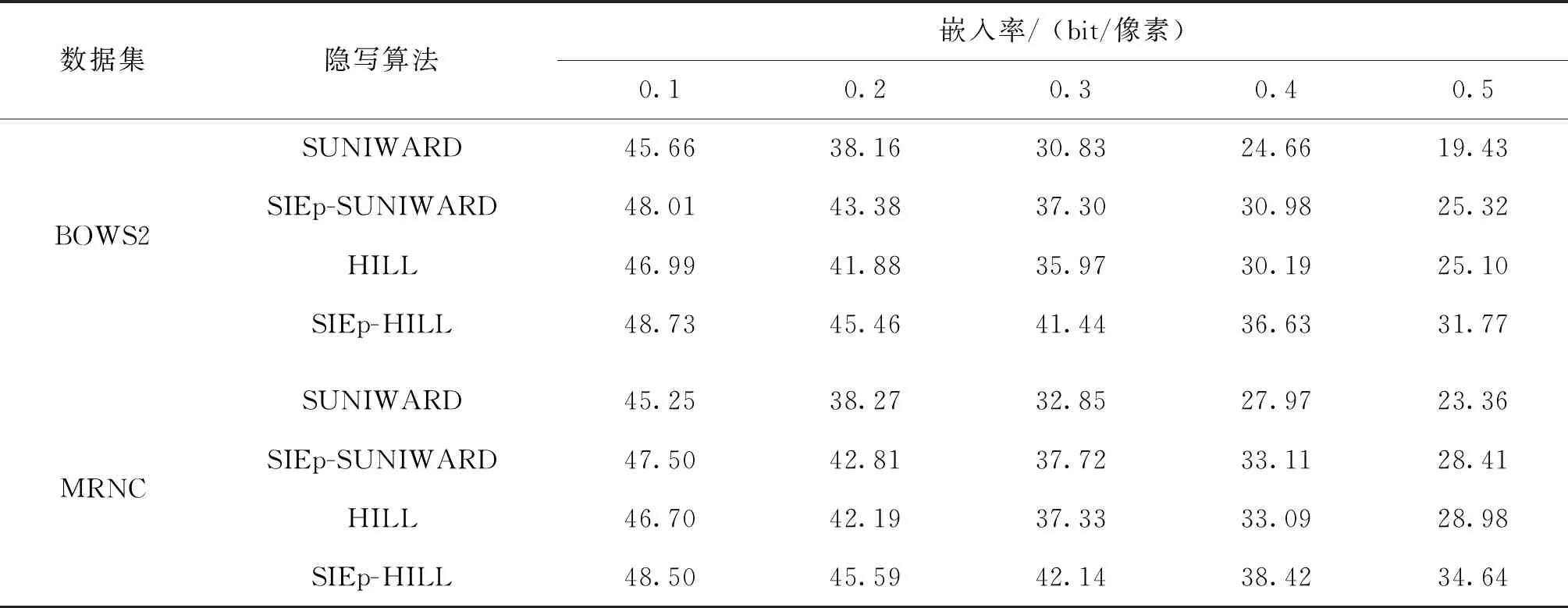

表2 SIEp-HILL采用不同上采样方法及调整系数(η)时在SRM特征集上的检测错误率Table 2 Detection error rate on SRM feature set when SIEp-HILL adopts different upsampling methods and factors η /%

表2中展示了在上采样比例为2时,基于边信息估计隐写SIEp-HILL,利用不同上采样方法在不同调整系数时所得到的检测错误率。其中,调整系数η=1.0等价于初始失真不进行任何调整的情况。从表2中可以看出,RCAN、RRDBNet、EDSRM、SRResNet均在η=0.5时获得了各自最优值,并且RCAN获得了所有结果中最高的6.85%的提升。基于此,本文选择RCAN作为上采样网络,生成HR预载体,对应的边信息估计隐写方法命名为SIEp(RCAN×2)-A。

此外,表1中两个基于生成对抗的网络(SRGAN和ESRGAN)分别在面向PSNR的网络(SRResNet和RRDBNet)基础上加入对抗网络,导致PSNR值有所降低,但它们面向生成更具真实性的图像,这对于超分任务本身是有益的。从表2中可以看出,使用两种基于生成对抗的网络(SRGAN和ESRGAN)估计下采样边信息,对于隐写安全性提升不明显。从表1和表2中发现,超分网络获得的PSNR较高时,会带来更高的安全性提升,因此面向高水平PSNR的超分网络或将更适合用来估计下采样边信息,而追求估计图像的真实性并不一定更有效。隐写领域与计算机视觉领域不同,前者只需要得到接近原始图像的相关性,而后者还需要考虑真实性。

另外,基于MATLAB中标准双三次插值函数(Bicubic)估计的边信息使得隐写的安全性大幅度降低,表明了基于传统插值的上采样方法即使具有较高的极性估计正确率,也不能为隐写提供有效的边信息。

3 实 验

本文实验在BOSSBase、BOWS2、MRNC数据库上进行,初始失真函数采用HILL(Li等,2014)和SUNIWARD(Holub和Fridrich,2013),消息嵌入使用最优模拟嵌入(Pevny等, 2010),并采用基于手工特征的和基于深度学习的隐写分析器评估隐写安全性。

对于不同数据集、不同的嵌入率情况,可以通过遍历所有调整系数来确定不同嵌入率时的最优调整系数,所以如果为了获得更高的安全性,可以耗费更多的代价,通过遍历来获得更优的调整系数。

但是从实际应用考虑,分析表2和表3,可以看出,在3种数据集、不同嵌入率情况下,虽然最优调整系数稍有不同,但是在调整系数为0.5时,均能显著提高安全性,并且和最优调整系数下的安全性差距很小,所以本文取0.5作为实际实验中的调整系数。

3.1 本文方法在跨库上的隐写安全性

由于本文的超分网络模型基于BOSSBase库中的512×512像素和256×256像素图像对训练,为了证明本文方法利用的估计边信息对于嵌入修改的方向具有普适的指导作用,而不是超分网络单纯地学到了本数据库内的HR图像和LR图像的对应关系。以训练集之外的图像库作为载体,分别采用HILL和SUNIWARD作为初始失真函数进行边信息估计隐写,并抵抗SRM和SRNet(steganalysis residual network)(Boroumand等, 2019)隐写分析。

表3 不同嵌入率、不同调整系数在BOWS和MRNC上的安全性(隐写分析器的检测错误率)Table 3 The security of different adjustment factors on BOWS and MRNC at different embedding rates /%

3.1.1 抵抗SRM隐写分析的安全性

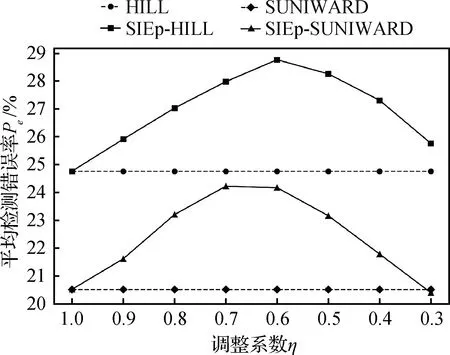

在BOWS2库中256×256像素大小的图像和MRNC库中384×384像素大小的图像上使用本文方法SIEp(RCAN×2)。在不同嵌入率下,与初始失真HILL和SUNIWARD方法的安全性对比结果如表4。

表4 调整系数为0.5时本文方法在BOWS2和MRNC上对抗SRM的安全性(隐写分析器的检测错误率)Table 4 While the adjustment coefficient is 0.5, the security of the proposed method against SRM on BOWS2 and MRNC /%

从表4中可以看出,本文方法在训练集之外的数据集上同样能够有效提升隐写安全性,嵌入率越高,提升效果越大,如在BOWS2库中,SIEp(RCAN×2)-HILL比HILL在0.5 bit/像素时提升6.67%;在MRNC库中,SIEp(RCAN×2)-HILL比HILL在0.5 bit/像素时提升5.66%。注意,这里采用的载体图像是已知经过MATLAB中标准双三次插值下采样得到的。

为了证明本文方法可以应用于不同来源,如来自于不同的原始尺寸,或者并非单纯地直接通过MATLAB中标准双三次插值下采样获得的载体上。比如BOSSBase(Bas等,2011)由来自7个不同摄像机的10 000幅从未压缩过的图像组成。该数据库中所有图像均以RAW(raw image format)格式(CR2(camera raw 2)或DNG(digital negative))的全分辨率彩色图像创建,首先调整图像大小,使较小的一边长为512,然后将其裁剪为512×512像素大小,最后转换色彩为数据库中的灰度图像。

以BOSSBase中512×512像素大小的图像为载体,在嵌入率0.4 bit/像素下,评估本文方法的有效性和安全性。图2中,本文方法基于两种初始失真函数,分别在调整系数为0.55和0.65时达到最大提升:4.04%和4.0%,再次证明本文方法利用估计的下采样边信息对于嵌入修改方向的指导是有意义的,也说明了本文方法具有普适性。

图2 本文方法在BOSSBase 512×512像素灰度图像上的安全性Fig.2 The security of the proposed method on BOSSBase 512×512 pixel grayscale image

3.1.2 抵抗SRNet隐写分析的安全性

现代隐写分析方法除了传统的基于手工特征的集成分类器检测,还有基于深度学习的隐写分析网络。采用具有代表性的深度学习隐写分析网络SRNet,并按照建议的实验设置训练网络。

设置学习率l1为0.001,l2为0.000 1;对于嵌入率为0.4 bit/像素的载体载密图像对的隐写分析直接以l1迭代400 000次,然后以l2迭代100 000次,并选取最后100 000次迭代中在验证集上检测错误率最低的模型作为最终的检测器;对于其他嵌入率的情况,首先基于0.4 bit/像素的载体载密图像对,以l1迭代80 000次,再以l2迭代50 000次,取最后50 000次迭代过程中在验证集上表现最优的模型作为其他嵌入率情形下的预检测器。

表5为本文方法以BOWS2库上256×256像素的图像为载体隐写,以检测错误率Pe为指标评估对抗SRNet的安全性。可以看出,在基于HILL和SUNIWARD两种初始失真函数的各个嵌入率下,隐写安全性均有明显提升;其中以SUNIWARD为初始失真函数,嵌入率为0.2 bit/像素时,本文方法的安全性相比传统SUNIWARD提升11.5%。

3.2 本文方法与原始边信息隐写安全性的对比

Denemark和Fridrich(2015)使用原始边信息隐写方法证明了下采样边信息对于提升隐写安全的有效性。受该工作启发,探究边信息估计隐写与原始边信息隐写的区别。

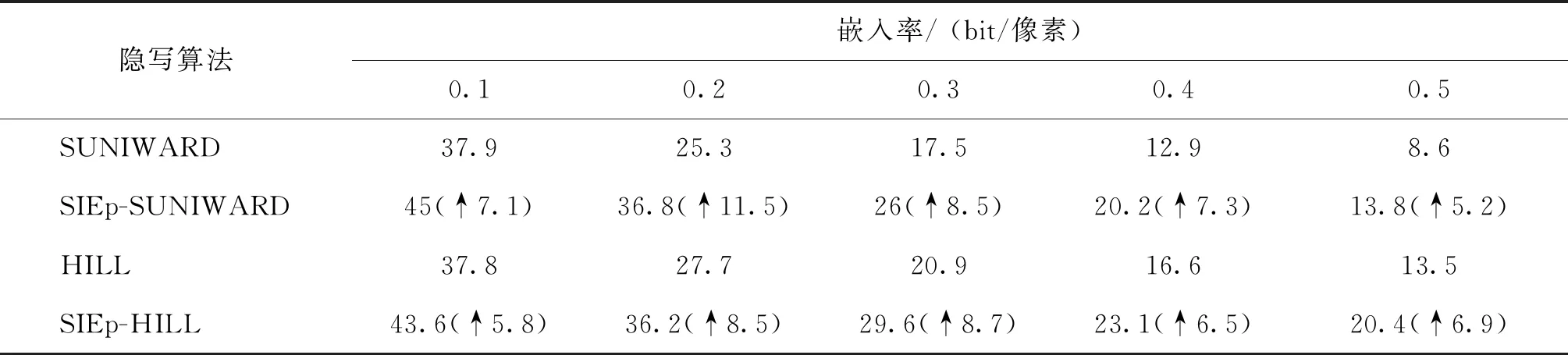

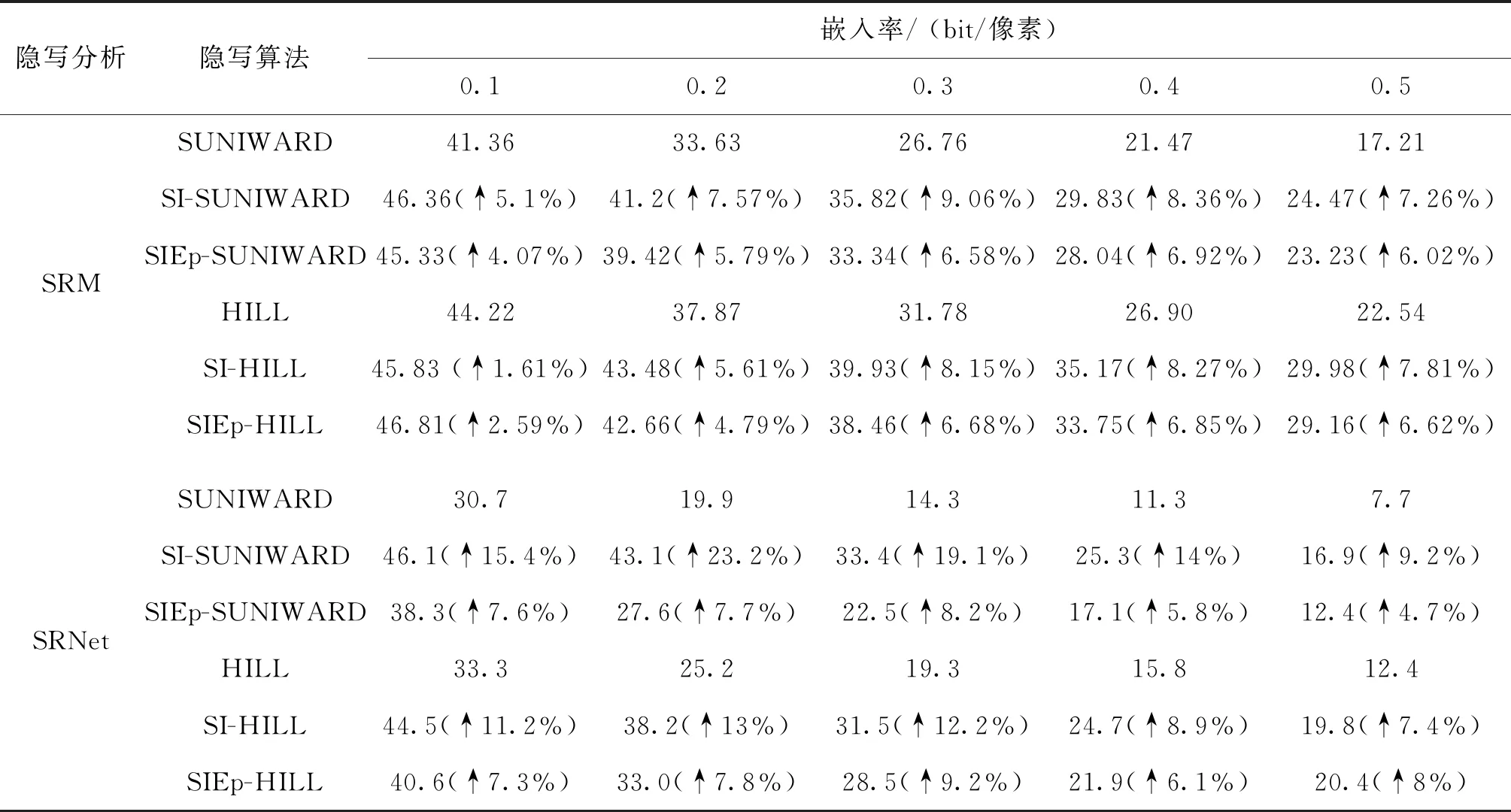

在不同嵌入率下对比了本文方法与原始边信息隐写的安全性,实验以BOSSBase中256×256像素的灰度图像为载体。表6是两种方法分别对抗SRM特征和SRNet隐写分析的检测错误率和相对于初始对称失真隐写方法安全性的提升,其中边信息估计过程采用RCAN×2网络,调整系数为0.5。

可以看出,在不同嵌入率下,本文方法虽然总能在原始对称失真的基础上明显提升安全性,但距离原始边信息所带来的提升仍有一定差距,尤其是在以SUNIWARD为初始失真时的差距较大。主要原因在于以下两点:1)本文使用超分辨率网络恢复得到的高分辨率图像没有原始图像准确;2)本文使用的失真调整策略相对简单,很难将图像下采样过程中产生的量化误差对于失真调整的指导发挥到极致。

为了进一步探究本文方法和原始边信息隐写的差异,图3展示了不同修改失真在嵌入率为0.4 bit/像素的情况下,嵌入修改点的数量和分布。可以看出,相比传统隐写,原始边信息隐写造成了更多的修改点,并且分布相对均匀;而同样相比传统隐写,本文方法造成的修改点数量仅有略微增多,而且分布相似,这说明基于边信息估计的隐写修改和基于原始边信息的隐写虽然都极大地提升了隐写安全性,但是其修改模式是不同的。

表5 调整系数为0.5时,本文方法在BOWS2上对抗SRNet的安全性(检测错误率)Table 5 While the adjustment coefficient is 0.5, the security of the method in this paper against SRNet on BOWS2 /%

表6 调整系数为0.5时,本文方法SIEp(RCAN×2) 和SI在不同嵌入率下的安全性对比实验(检测错误率)Table 6 While the adjustment coefficient is 0.5, the security comparative experiment between the proposed SIEp(RCAN×2) and SI under different bpp /%

图3 载体和不同失真函数在嵌入率0.4 bit/像素时的嵌入修改点分布图Fig.3 The cover and the embedding modified point distribution based on different distortion functions at the embedding rate of 0.4 bit/pixel ((a) ‘72.pgm’ in the BOSSBase library with a size of 256×256 pixel; (b) HILL; (c) original side information steganography; (d)the side information estimated steganography of this paper)

值得注意的是,在以HILL计算初始失真,嵌入率为0.1 bit/像素,对抗SRM隐写分析时,本文方法的安全性超过了基于原始边信息的隐写1.08%;且在嵌入率为0.5 bit/像素,对抗SRNet隐写分析时,本文方法的安全性超越原始边信息隐写0.6%。证明本文方法的性能接近(对抗SRM)甚至在某些情形下超过(对抗SRNet)原始边信息隐写的安全性。

4 结 论

本文工作的主要贡献有:1)提出利用估计的下采样边信息指导初始失真的修改方向,以提高隐写安全性;2)提出使用超分辨率网络估计原始高分辨率图像,从而获得估计的下采样边信息。

首先介绍了已有的空域的原始边信息隐写和JPEG域中的边信息估计隐写方法,然后介绍了本文使用的一些超分辨率网络的结构和特性,并基于已有的JPEG域中边信息估计隐写失真调整策略实施本文的初始失真调整策略。

以PSNR和极性估计准确率为指标初步评估生成的高分辨率图像的准确度,同时探索这两个指标与隐写安全性的提高是否具有关联性。在对于使用不同超分辨率网络时的隐写安全性进行初步评估之后,选择残差通道注意力网络RCAN作为估计高分辨率预载体的网络。在实验部分,为了表明本文方法的有效性和广泛适用性,在训练集图像库之外的载体上测试了本文方法在抵抗SRM和SRNet隐写分析的安全性,均有明显提升。进一步与原始边信息隐写的安全性进行对比,发现本文方法的性能接近甚至在部分情况下超越了原始边信息隐写的安全性,同时通过分析修改点分布,认为基于边信息估计隐写的修改模式与原始边信息隐写是不同的。

为了进一步提升本文方法的安全性,有两个关键方面值得考虑:1)边信息估计网络的选择,希望能够选择对隐写安全性有更大提升的超分辨率网络甚至是其他领域的网络结构;2)本文的失真调整策略过于简单,很可能没有完全发挥估计边信息的潜力。下一步将寻找更合适的边信息估计方法和更优的失真修改策略,同时考虑将本文方法扩展到JPEG域中。