基于改进SSD的航拍城市道路车辆检测方法*

宋世奇, 李 旭, 祝雪芬, 杨 峰, 武文翀, 吴琳琦

(1.东南大学 仪器科学与工程学院,江苏 南京 210096; 2.交通运输部路网监测与应急处置中心,北京 100020;3.浙江大华技术股份有限公司,浙江 杭州 310000)

0 引 言

随着我国汽车保有量的爆发性增长,加之我国道路交通状况复杂,致使交通拥堵和交通事故频发。为了解决上述问题,智能交通系统的有关研究受到了各界学者的广泛关注[1]。其中,准确实时地对城市道路中车辆进行检测是构建智能交通系统必不可少的重要环节。然而,在固定位置安装视觉传感器对道路交通中车辆进行检测的传统方法覆盖范围小,灵活性差,且成本较高。随着无人机技术的不断提升,基于无人机搭载视觉传感器对道路车辆检测研究成为近年来的研究热点[2~4]。与固定位置安装摄像头相比,无人机航拍可提供更大视角,更广覆盖范围,且具有更高灵活性,可应用在关键道路区域和突发交通场景,但充分

发挥无人机航拍的大视野和高度灵活性优势的同时,该视角下的大部分具有稀少特征点的小尺度车辆目标以及快速性要求也为车辆的准确、实时检测带来了挑战。

目前,国内外针对于无人机航拍视角下常用的车辆检测方法可分为三类:基于运动目标检测、人工特征加传统机器学习以及深度学习的方法。基于运动目标检测的方法具体主要有背景差法[5]、侦差法[5,6]和光流法[7],该类方法实现简单,但对背景变化高度敏感、对于低速行驶及小尺度车辆识别困难;基于人工特征并结合传统机器学习的方法从图像中提取车辆尺度不变特征变换(scale invariant feature transform,SIFT)、方向梯度直方图(histogram of oriented gradients,HOG)等特征,然后采用支持向量机(support vector machine,SVM)、AdaBoost等常用的分类器进行学习和分类车辆目标[8],该类方法只提取浅层次特征、对于拥有较多小目标的航拍场景应用效果不佳;而近年来随着深度学习技术的不断发展,卷积神经网络凭借其强大的特征提取能力被广泛应用于计算机视觉等多个领域。其中,以R-CNN(region with CNN features)系列为代表的多阶段网络因采用先提取目标候选区域后进行回归定位与目标分类的双步策略而取得了较高精度,但其实时性较差,无法满足于无人机航拍车辆检测场景的实时性要求;而以SSD(single shot detector)[9]为代表的单阶段卷积神经网络模型因采用直接以回归方式解决目标检测问题的方法,故速度较多阶段网络更快,更适宜部署应用在航拍车辆检测场景中,但其对于该场景中占较大比例的小尺度车辆目标检测效果不佳。

针对以上几类方法存在的问题,本文针对SSD深度学习网络框架进行改进,搭建针对无人机航拍城市道路的车辆检测网络。

1 基于SSD网络改进的航拍车辆目标检测方法

1.1 默认候选框参数优化

SSD[9]是经典的单阶段深度学习网络检测框架,其主要思路是均匀地在图像多个层数的特征图上进行密集抽样,抽样时采用不同尺度和长宽比,然后利用卷积网络进一步提取特征后直接进行分类与回归。其密集抽样时默认候选框参数的设置,包括尺度和长宽比两个方面。对于先验框的尺度,基准SSD网络遵守一个线性递增规则,即随着特征图尺寸降低,先验框尺度线性增加。该方法得到的默认候选框参数并不适用于小尺度目标占比较大的无人机航拍城市道路车辆检测场景,因此,为充分利用无人机航拍场景下的车辆目标多为小尺度的先验知识,提高网络的检测精度,本文针对无人机航拍城市道路车辆数据集,采用K-means++聚类算法,分别得到默认候选框的尺度和宽高比信息。

其次,运用K-means++聚类算法对默认候选框尺度和宽高比两个样本集进行聚类,包括初始化K个聚类中心以及进行标准K-means聚类迭代两个步骤,在两个步骤中所采用距离公式均为

(1)

式中sk,rk分别为尺度样本集S和宽高比样本集R中单个样本,μsj,μrj分别为针对尺度样本集S和宽高比样本集R聚类过程中的第j个聚类中心。

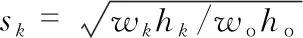

K-means++聚类算法摒弃随机选择K个初始聚类中心的方式,而是先随机获取一个样本集中的数据作为第一个聚类中心,然后通过式(1)运算得出计算每个样本到最近聚类中心的距离,由此,每一个样本都有一个长度,长度越大的样本,被选为下一个聚类中心的概率越高。然后不断重复至得到K个初始聚类中心,之后运行基准K-means聚类算法,该方法选择的初始聚类中心较基准方法更加准确。默认候选框尺度聚类K值设为5,对应改进SSD网络中5个用于检测回归的特征图,宽高比聚类则根据基准SSD网络经验设为6,则迭代收敛后,得到聚类结果如表 1所示。与基准SSD网络相同,5个用于分类回归的特征图层依据其尺寸选择相应默认候选框尺度,每个尺度对应聚类得到的6个宽高比,共得到11 634个候选框。

表1 默认候选框尺度与宽高比聚类结果

1.2 网络结构改进

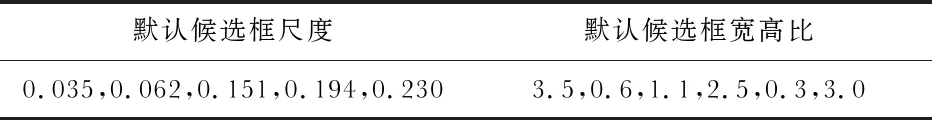

卷积网络结构中用于特征提取的骨干网络对特征图不断利用池化操作进行下采样,会导致出现采样混叠效应。该现象导致特征图中前景与背景的边缘等特征发生畸变,经后续多次下采样致使特征畸变不断累积。尤其对于航拍场景下的小目标,因为其构建特征的像素点稀少,混叠现象对于该场景下深度卷积网络模型的最终检测效果影响更加显著,而在下采样之前对提取到的特征进行低通滤波操作可以较为明显地改善这一现象。因此,为减小混叠效应给小目标特征提取带来的影响,并考虑到小目标边缘等特征提取主要位于特征提取网络的前面部分,本文在基准SSD网络的特征提取骨干VGG网络中加入了自适应的低通滤波层。

由于特征图的不同通道包含如边缘、颜色变化等不同频率的特征,故本文采用的滤波器结构不仅针对特征的空间位置分布层面学习到对应的滤波器参数,同时考虑到在特征图的不同通道上学习不同的滤波器参数。如图1所示,F为输入特征图的一个通道,共c个通道,考虑到为每个通道的特征预测不同的滤波器计算代价过大,便将输入的特征图依次分为g个连续通道组,每c/g个通道特征共享相同的滤波器参数。输入特征图经过一个卷积操作后跟随一个批量标准化(batch-normalization,BN)层,并引入SoftMax层以保证每个学习到的滤波器参数均为正数、和为1,以保证其为低通滤波器。每个通道特征学习到的滤波器为W,其维度为n×k2×h×w,n, 表示批处理样本数,k2表示每个特征元素所对应的k×k滤波器参数。在学习到滤波器参数后,对第g组中通道特征图F,利用对应的第g组滤波器进行滤波操作

(2)

图1 低通滤波层结构

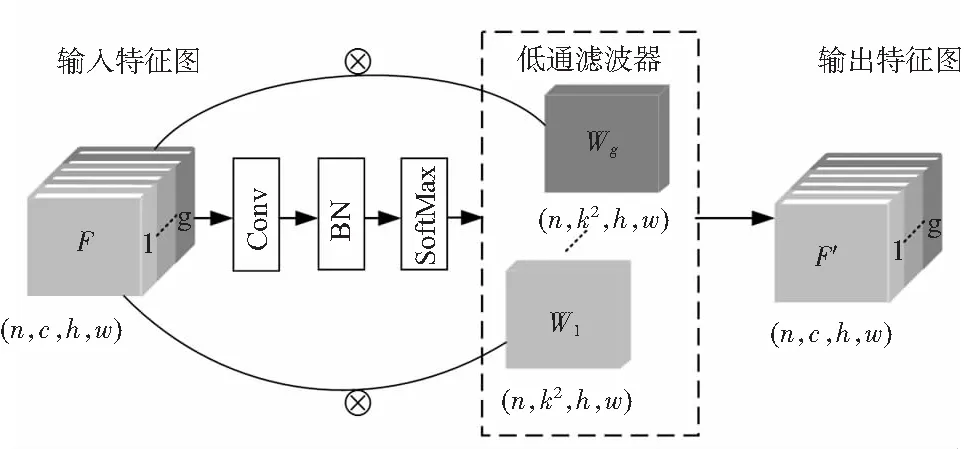

基准SSD网络的特征提取骨干VGG网络中的Conv4_3层后的特征图用于预测小尺度目标,因此本文在该层前的三次最大池化层前,即在Conv1_2,Conv2_2,Conv3_3后引入低通滤波层Filter1,Filter2,Filter3,其中根据每个滤波层输入的特征图通道数设定滤波器核尺寸k均为3,特征图通道组数分别为4,6,8。

卷积网络中随着卷积层的深度增加,得到的特征图的感受野更大,因此会丢失掉更多的小尺度目标的细节信息,且基准SSD网络中检测回归所使用的Conv11_2主要用于检测在图像中占比超过50 %的大目标,故本文将基准SSD网络中的Conv11_2层的检测部分丢弃,仅保留前5个特征图进行小尺度目标检测,最终搭建的针对无人机航拍城市道路车辆检测的网络结构如图2所示。

图2 改进后的SSD网络结构

改进后的车辆检测网络使用的损失函数包括类别置信度和位置损失两部分

(3)

式中n为默认框的正样本数量,c为类别置信度预测值,l为默认框所对应边界框的偏移位置预测值,g为真值标签的位置参数,包括航拍车辆目标中心位置与宽高信息的偏移量。位置损失为

(4)

(5)

2 实验验证

2.1 实验条件

本文所使用数据集由VisDrone多目标航拍数据集中选取的城市环境下道路交通航拍图像组成,数据集中标注车辆目标大部分为小目标,包括小汽车、公交车、卡车、货车4种车型,共1 800张图片,最终将1 500张图片作为训练集,300张图片作为测试集,并保证测试集与训练集中数据相互独立不重复。本文利用该数据集对基准SSD网络与改进后的网络进行训练和测试,网络输入图片尺寸均为512×512,整个实验在Ubuntu18.04操作系统下完成,并使用单个NVIDIA GeForce 960M型号GPU加速训练和推理。

2.2 检测结果及分析

将测试集中300张无人机航拍图片分别输入训练好的基准SSD网络和本文最终改进的网络模型中进行测试,测试的部分结果如图3所示,上下两部分分别为基准SSD网络和本文最终改进后的网络模型测试结果,图像中识别出的车辆由矩形框标出。

图3 城市环境下航拍车辆部分检测结果

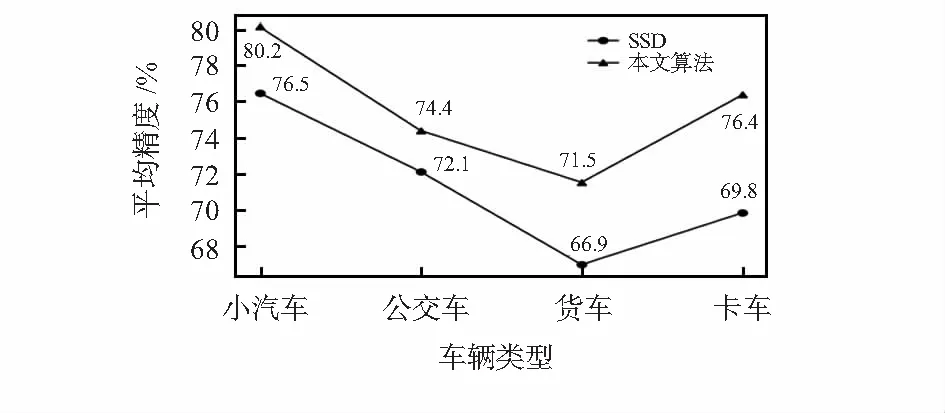

为进一步分析改进后网络的效果,本文选择均值平均精度(mean average precision,MAP)、检测平均精度(average precision,AP)和帧率(frame per second,FPS)三个评价指标来分析网络的检测效果和检测速度。其中,在计算MAP时约定IOU大于5为目标检测正确。表2为基准SSD网络和本文改进的网络模型在测试集上的检测性能对比情况,针对四种车型的检测精度对比结果如图4所示。

表2 城市环境下航拍车辆检测结果对比

图4 不同车辆类型的检测精度对比

3 结 论

针对无人机航拍视角下城市道路车辆目标识别任务,通过对比实验的检测结果可知,较基准SSD网络,本文首先通过对航拍场景下城市道路车辆目标检测所需默认候选框参数信息进行优化,提取了检测目标尺度信息的先验知识,使检测精度提升了2.1个百分点;其次,在基准SSD网络骨架中引入可学习的低通滤波层,降低了混叠效应对小目标特征影响,并丢弃原有网络中针对最后一层特征图的检测回归,进一步提高了网络针对小尺度车辆目标特征的

传递与提取能力。针对四种不同车型,本文最终的检测算法平均精度较基准SSD网络均有提高,均值平均精度提高了4.3个百分点,而网络每秒的推理速度达到了14帧,基本能够满足无人机航拍视角下城市环境道路车辆检测的实时性要求。