一种针对特定目标的提议算法

郑琛媛,程远增,付 强

(陆军工程大学石家庄校区,石家庄 050003)

0 引言

目标检测是计算机视觉中基础的任务之一,其研究的主要目的是从复杂的背景中检测并定位所设定种类的目标物体[1]。近年来,目标检测在医学、军事、智能交通、视觉导航等多个领域发挥着越来越重要的作用,有着广泛的应用前景和潜在的经济价值。

传统目标检测算法利用滑动搜索窗,通过改变其位置、大小和长宽比遍历整幅图片,得到一系列的候选框,然后利用提取的特征和分类器对候选框进行处理,从而检测出要求的目标[2]。对于这种检测算法,如果要求检测结果的准确性高,就需要对图像的遍历过程更加精细,但是这样会引起计算量的增加,影响检测的速度;如果想加快检测速度,那么对图像的遍历过程就会相对粗糙,造成检测结果的准确性降低[3]。如何更加快速准确地检测出目标也已经成为当今学者们普遍关注和研究的一个重要课题[4]。近些年来,为了更好地调节检测的准确性和快速性之间的矛盾,人们对得到的候选框进行研究,着眼于提高候选框的质量、减少候选框的数量,进而提出了“目标提议(proposal)”的概念。目标提议认为在一张图像中并不是每个子窗口都包含有目标,仅有少量的候选窗口对目标的检测是有意义的[5],利用一些方法将这些对目标检测有意义的窗口提取出来,就是目标提议的过程。两种检测算法的流程图如图1所示。

根据候选区域生成过程的不同,proposal算法大致可分为两类[5]:一类是先将图片分割,然后再聚合的方法,即聚合法,其中比较经典的算法有Selective search[6]、CPMC[7]、MCG[8];另一类则是生成大量的候选窗并根据一些低层次的特征快候选窗进行评分,然后过滤掉低分的方法,即候选窗评分法,其中比较经典的算法有 Edge boxes[9]、Bing[10]。利用这些方法对图像进行处理可得到几千个甚至几百个包含目标的可能性较高的候选框,这不仅提高了检测的确性,而且降低了后续操作的时间复杂度,提高了检测的速度[5]。

现有的提议算法都是针对常规物体,当仅需要针对某种特定目标进行检测时,如监控场景中只检测人或车辆、军事应用中仅关心敌方飞机或导弹的情况,可以利用已有的先验知识改进现有提议算法,提高其性能。Edge boxes是一种不需要进行学习的快速[9]提议生成算法,处理一帧图像平均需要0.27 s,因此,本文在edge boxes基础上进行研究。目标的边缘图像可看作是由许多的轮廓(线段)组成,如果组成某一轮廓的所有像素点都位于候选框中,那么则认为该轮廓就是一条被候选框完全封闭包围的轮廓。Edge boxes将被候选框完全封闭包围的边缘轮廓的数量作为候选框评分的依据。但是,当一候选框包含特定目标及其周围背景中物体时,利用edge boxes的评分依据进行评分,通常情况下比恰好包含目标的候选框的评分要高,这会影响对某一特定目标检测的结果。为了得到针对某一特定目标的候选框,本文在Edge boxes算法的基础上进行改进,提取被候选框完全封闭包围的轮廓在候选框不同区域的边缘像素点,以这些边缘像素点幅值的均值组成特征向量,将各个候选框与目标的特征向量的差值、被候选框完全封闭包围的轮廓数量联合起来作为评分的依据。实验结果证明,该方法能够提高针对特定目标的候选框的准确性。

1 Edge Boxes简介

输入一幅图像Edge boxes包括两个步骤:1)计算边缘图像;2)对候选框进行评分。

1.1 计算边缘图像

对边缘图像的计算主要包括两个步骤:1)得到初始的边缘图像;2)对原始边缘图像进行稀疏化处理。首先,根据文献[11]中所提出的结构化边缘检测算法得到原始的边缘图像,然而,此边缘图像中包含细节的边缘较多,影响检测速度。为此对边缘像素点进行处理,要求只有当边缘像素点的幅值mp>0.1时,将其作为边缘像素点,这样就得到了稀疏化的边缘图像。如图2所示,其中(a)图表示原始图像,黄色矩形框表示目标位置;(b)图表示稀疏化的边缘图像,蓝色矩形框表示对应目标的边缘图像的位置。记稀疏化的边缘图像中任一像素点p,其对应的幅值和方向角分别记为mp、θp。后续过程均在稀疏化的边缘图像上进行。

1.2 对候选框进行评分

Edge boxes将被候选框完全封闭包围的轮廓的数量作为评分标准,而轮廓可以看作是由许多相似性很高的像素群组成,通过计算像素群间的相似性,可以快速区分出被候选框完全封闭包围的轮廓以及与候选框有重叠的轮廓。对于任意候选框b,具体评分计算过程如下[9]:

首先,计算像素群。对于任意p∈b,利用贪婪搜索的方法不断寻找像素点8-连通范围内与其相似性最高的像素点,直到这些像素点方向的差值和超过(π/2),这些像素点就组成了一个小的像素群。

其次,计算像素群间的相似度。如果相邻的两个像素群的方向角与平均位置夹角相同,那么这两个像素群间具有很高的相似性。因此,对于一个像素群集合S中任意两条相邻的像素群si和sj,记si和sj的平均位置分别为xi和xj,平均方向角为θi和θj,其相似度a(si,sj)计算公式为:

其中,θij为 xi和 xj的夹角。为了简化计算,如果 a(si,sj)<0.05或两个像素群间隔两个或两个以上像素点,则将两个像素群间的相似度记为a(si,sj)=0。

然后,计算像素群的权值wb(si)。对于像素群集合S中任一像素群si中所包含的像素点 p的幅值mp的和记为mi,用Sb代表与候选框b有重叠的像素群的集合,如果si∈Sb,wb(si)=0,那么si与候选框b的关系wb(si)计算公式如下:

其中,T是指从候选框的边缘开始到达si的像素群序列集合也即路径。通过寻找与候选框的边缘有重叠的像素群与任一si间的相似度最高的路径,得到与候选框有重叠的轮廓。

最后,计算候选框评分hnin由于在候选框的中心处的边缘对检测结果影响很小,因此,可以减去候选框b中心处框bin中的所有边缘像素点幅值的和,候选框评分计算公式为:

其中,bw和bh分为为候选框的宽和高,bin的宽和高分别为bw/2和bh/2。

2 本文算法

利用edge boxes算法处理图像,如果候选框包含目标和其周围部分背景,或者图像背景中部分区域的边缘轮廓比目标区域边缘轮廓多,那么此时得到的候选框的评分通常比恰好包含目标的候选框的评分要高。因此,针对特定目标,仅靠候选框中完全封闭包围的轮廓数量不足以实现对特定目标的候选框的优选。鉴于此,本文在edgeboxes算法评分依据中加入了特定目标。

对于一候选框,记其中完全封闭包围的轮廓为Sf。如果候选框越接近刚好能将目标包围的情况,那么该框中完全封闭包围的轮廓越接近目标的轮廓,也即构成Sf的像素点与构成目标轮廓的像素点的差别越小,那么构成候选框中Sf的像素点与目标的像素点在不同区域的幅值均值越接近。基于此,本文选取了10个不同区域[12](如图3所示)并得到各个区域中构成Sf的像素点的幅值均值,利用这些幅值均值构成的特征向量表征候选框中对应每个区域中的轮廓信息。特征向量表示如下:

其中,gi表在第i个区域边缘像素点幅值的均值。那么对应的目标在10个区域的像素点的幅值均值构成的特征向量记为GT。

对于任一候选框,其提取的特征向量与目标特征向量的总差值可通过wbg来表示,其计算公式如下:

如果候选框的大小、形状和位置越接近标准框,那么其与目标的边缘轮廓的差异就越小,即wbg值就越小;相反,如果候选框的大小、位置和形状与标准框差别越大,该框与目标的边缘轮廓的差异就越大,那么wbg值就越大。候选框b的评分hbs计算公式如下:

hbs越大表明候选框包含目标的可能性越大。

针对特定目标,本文利用候选框中边缘轮廓整体信息和局部信息相结合的方式,评价候选框包含特定目标的可能性。即利用被候选框完全封闭包围的轮廓的数量,候选框与目标特征向量的差异来评价该框包含目标的可能性的,因此,候选框的评分计算公式如下:

这里,sb值越大表明候选框包含目标的可能性越大。

Edge boxes提议算法流程如下页图4所示。

3 实验

CVPR2013[13]测评集中包含50个完整标注的视频序列,涵盖了目标检测跟踪面临的主要挑战性场景,近年来许多检测跟踪算法都以该测评集为基准进行实验和测评。本文在CVPR2013测评集中选取了 couple、David3、singer1视频序列中的部分图像,利用这些序列图像对改进算法与Edge boxes算法的性能进行评估,实验设置参照Edge boxes[9]方法进行。本文的实验平台为配置3.2 GHz i5处理器、8 GB内存、4核的普通电脑,仿真环境为MATLAB2013b。

将两个框相交部分的面积与相并得到的面积相除得到的数值记为IoU,实验过程中设定一阈值,当某一候选框与标准框的IoU大于该阈值,将该框的位置存储起来。首先,得到得分最高的1 000个候选框,然后在每个候选框的周围通过改变滑动搜索窗的大小和长宽比得到得分最高的候选框即为提议算法在该位置提取的候选区域。以couple视频序列中的某幅图像为例,分别利用Edge boxes与改进算法得到的部分评分较高的候选框,如图5所示(黄色矩形框代表目标位置,红色矩形框代表候选框)。

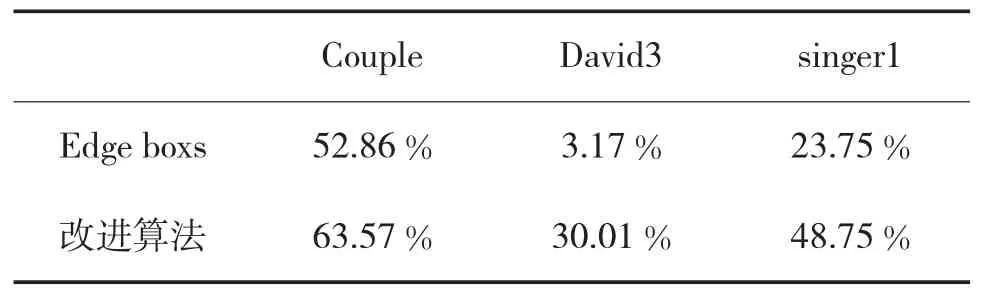

本文利用精度来反映算法的性能:选取一定数量的候选框,那么与目标真实位置的IoU在阈值范围内候选框数量与所选取候选框的数量的比值就代表了算法的精度。实验选取了couple视频序列中140幅图像、David3视频序列中50幅图像、singer1视频序列中79幅图像,在选取的视频序列图像中分别利用edgeboxes和改进算法分别对这些图像提取候选框,IoU设定为0.7时,实验结果如表1所示。

实验发现,IoU设定为0.7时,同一视频序列,精度至少提升了10.71%。对于Couple视频序列,分别改变提取候选框数量和IoU取值得到的精度曲线分别如图6所示:图6(a)表示IoU为0.7时提取1 000个候选框的精度变化曲线,图6(b)表示IoU从0.5变化到1的精度变化曲线。从图中可以看出IoU一定,改变提取候选模板的数量;或者提取候选模板数量一定,改变IoU取值时,利用改进算法比利用edgeboxes算法得到的精度都要高。尤其是提取模板数量一定,IoU在0.6~0.75这一范围内取值时。

表1 edge boxes与改进算法针对各中目标实验结果

从提议算法中可以看出,hbin和hbs的计算过程是相互独立的,可以采用并行的方式实现,提议算法处理一幅图像需要1.04 s。

4 结论

本文从特定目标的检测问题出发对Edge boxes算法进行了研究,提出了一种改进的Edge boxes提议算法。在评分过程中,选取目标的10个不同区域,计算组成被候选框完全封闭包围的轮廓的像素点在各个区域的幅值均值,从而提出了特定目标的特征向量,将候选框与目标特征向量的差异、被候选框完全封闭包围的轮廓的数量结合起来作为评价各个候选框包含目标可能性大小的依据。提议算法在测试集上进行了评测,精度提升了10.71%左右,表明该算法具有良好的目标-背景判别能力,鲁棒性能良好。

参考文献:

[1]郭明玮,赵宇宙,项俊平,等.基于支持向量机的目标检测算法综述[J].控制与决策,2014,29(2):193-200.

[2]胡正平,董淑丽,赵淑欢.多尺度局部区域响应累积的非滑窗快速目标检测算法 [J]. 信号处理,2016,32(1):37-45.

[3]刘涛,吴泽民,姜青竹,等.基于候选区域的视觉目标识别算法[J].军事通信技术,2015,36(4):16-20.

[4]张建军,黄山,张洪斌,等.基于视频的运动目标检测与识别[J].现代电子技术,2009,39(8):87-91.

[5]HOSANG J,BENENSON R,DOLLAR P,et al.What makes for effective detection proposals [J].Pattern Analysis and Machine Intelligence,2016,38(4):814-830.

[6]UIJLINGS J R R,VAN DE SANDE K E,GEVERS T,et al.Selective search for object recognition[J].International Journal of Computer Vision,2013,104(2):154-171.

[7]CARREIRA J,SMINCHISESCU C.Cmpc:automatic object segmentation using constrained parametric min-cuts[J].Pattern Analysisand MachineIntelligence,2012,34 (7):1312-1328.

[8]ARBELAEZ P,TUSET J P ,BARRON J,et al.Multiscale combinational grouping[C]//Conference on Computer Vision and Pattern Recognition,2014:328-335.

[9]ZITNICK C L,DOLLAR P.Edge boxes:locating object proposals form edges[J].European Conference on Computer Vision,2014:391-405.

[10]CHENG M M,ZHANG Z M,LIN W Y,et al.BING:binarized normed gradients for objectness estimation at 300fps[C]//Conference on Computer Vision and Pattern Recognition,2014:3289-3293.

[11]DOLLAR P,ZITNICK C L.Structured forests for fast edge detection[C]//International Conference on Computer Vision,2013:1841-1848.

[12]ZHU G,PORIKLI F,LI H D.Beyond local search:tracking objects everywhere with instance-specific proposals[C]//Conference on Computer Vision and Pattern Recognition,2016:943-951.

[13]WU Y,LIM J,YANG M H.Online object tracking:a benchmark[C]//IEEE Conference on Computer Vision and Pattern Recognition,Portland,USA,2013:1354-1362.