基于通道注意力机制和U-net的医学图像分割方法

王枫 吕泽均

摘 要: 随着人工智能和医学大数据的发展,基于深度学习的医学图像分割技术因具有重要的应用价值和前景,已经成为目前的研究热点。为了增强特征图的语义信息,在U-net网络的基础上引入通道注意力机制,对U-net生成的特征逐通道进行压缩,将压缩后的特征逐通道计算权重,然后将该权重与原始特征相乘得出最终的特征。通过在两个不同器官的医学图像数据集上进行实验,Dice系数相较于原始U-net网络分别提高了2.7%和1.8%,验证了该方法的可行性和有效性。

关键词: 深度学习; U-net网络; 通道注意力机制; 医学图像分割

中图分类号:TP391 文献标识码:A 文章编号:1006-8228(2021)05-64-04

Medical image segmentation method based on channel attention mechanism and U-net

Wang Feng, Lv Zejun

(College of Computer Science (College of Software), Sichuan University, Chengdu, Sichuan 610000, China)

Abstract: With the development of artificial intelligence and medical big data, medical image segmentation technology based on deep learning, for its important application value and prospects, has become a current research hotspot. In order to enhance the semantic information of the feature map, a channel attention mechanism is introduce for U-net network to compress the features generated by U-net channel by channel, calculate the weights of the compressed features channel by channel, and then get the final features by multiplying the weights by the original features. The experiment on medical image data set of two different organs show that the Dice coefficient is increased by 2.7% and 1.8% respectively compared with the original U-net network, which verifies the feasibility and effectiveness of the method.

Key words: deep learning; U-net network; channel attention mechanism; medical image segmentation

0 引言

醫学图像分割是医学图像分析领域的关键步骤,它将医学图像中具有特殊含义的部分分割出来并提取相关特征,目的是为临床诊断提供参考数据,辅助医生做出更加准确的诊断和治疗方案[1]。由于医学图像具有不均匀、模糊、差异性等特点,对医学图像分割带来了较大的困难和挑战。因此,研究并找出更好的医学图像分割方法,提升医学图像分割技术水平,对于整个医疗领域和人工智能领域都具有重要的意义,对社会的发展和进步也具有不可替代的作用。

近年来,随着深度学习方法的迅速发展,基于深度学习的图像分割算法在医学图像分割任务中取得显著的成就。全卷积神经网络FCN是第一次将端到端的卷积网络推广到了语义分割的任务当中,随后被广泛使用和研究。例如Zhang等人[2]利用原始大脑的 MR 图像训练粗糙分割的FCN模型,检测出肿瘤的整体区域,再使用肿瘤区域作为训练样本训练最终分割得到脑肿瘤的内部结构。但由于FCN模型忽略了像素与像素之间的关系,使其检测结果不够精细。而U-Net模型是在此基础上对FCN的改进,比如Vittikop等人[3]使用U-Net网络对脑肿瘤MR图像进行分割,通过跳跃连接融合了浅层和深层的图像特征信息,取得较好的效果,提高了分割精度。U-Net对经过多次下采样得到的低分辨率信息和从编码器直接传递到同高度解码器上的高分辨率信息结合起来,可以更好的适用于边界模糊、梯度复杂的医学图像。然而该方法平等对待输出特征的每一个通道,从而缺少处理不同类型信息的灵活度。

为了解决上述问题,本文在U-net网络结构的基础上引入通道注意力机制。研究表明[4],注意力机制能够加强网络对重要特征的关注度,增强特征图的语义信息,在复杂度和计算量不变的基础上可以有效提高网络的分割精度。本文中的通道注意力机制主要分为三个部分,首先是特征压缩部分,该部分将U-Net输出的特征逐通道进行压缩;其次是通道权重模块,通过两层全连接层计算特征各个维度的权重,对应原始特征各个通道的权重;最后通过残差机制,将各个通道的权重与原始特征逐通道相乘。通过上述机制,将原始的特征逐通道根据通道权重进行区别对待,从而增加特征中的所包含的语义信息,提高U-Net网络的性能。经过在不同器官的医学图像分割数据集3Dircadb[5]和Bound-archieve中的实验,结果表明,本文方法的性能高于原始U-net网络的性能。

1 基于U-net的和通道注意力机制医学图像分割技术

1.1 U-net网络

为了充分利用高分辨信息用于精准分割以及分割目标在人体图像中的分布很具有规律,简单明确的语义信息,Olaf Ronneberger等人[6]提出了U-net网络结构,通过U形网络结构和跳级连接实现语义信息与图像高分辨率信息进行融合,能够很好的适用于医学图像任务。文献[7]中使用基于改进后的3D-Unet医学图像处理模型对上一步骤生成的结果进行分类,剔除假阳性的候选,保留真正的结节,实现对输入的胸部CT图像进行肺结节检测。文献[8]利用U-net网络对直肠癌CT影像进行智能分割,同时加入图像增强、批归一化等方法缓解过拟合现象,最终在验证集上的Dice系数达到0.9329,验证了U-net的具有优越的图像分割效果。

U-net网络包括两部分,收缩路径和扩张路径。收缩路径用来获取上下文信息,减少特征图的空间维度,增加特征通道数量。分为四个阶段,每一阶段接受一个输入后经过两个3*3的卷积层,并且使用修正线性单元激活函数进行激活,然后进行下采样,经过步长为2的2*2的最大池化操作。每个阶段后,特征通道的数量都会加倍。扩张路径是网络的核心,用来对任务目标的精确定位。与左边对称同样分为四个阶段,使用上采样来恢复目标细节和空间维度。每个阶段过后特征图的大小加倍,特征数量减半。最后通过一个1*1的卷积操作,将64通道的特征图转换成类别数为2的特征图,再经过 sigmoid 函数输出一个概率值,该值反映预测结果的可能性,概率越大则可能性越大[9]。

1.2 通道注意力机制

在计算能力有限情况下,注意力机制是解决信息超载问题的主要手段的一种资源分配方案,将计算资源分配给更重要的任务。通过注意力机制[4]可以加强网络对重要特征的关注度,在复杂度和计算量不变的基础上可以提高网络的分割精度,在特征提取、分类、检测、分割等处理中广泛应用。文献[10]通过显式地建模通道之间的相互依赖关系,自适应地重新校准通道的特征响应,该方法思想简单,易于实现,并且很容易可以加载到现有的网络模型框架中。文献[11]依次应用通道和空间注意模块,强调空间和通道这两个维度上的有意义特征,提高关注点的表示。通过针对不同尺度的图像动态生成卷积核的方式,文献[12]在超分辨率任务上有很大提升,并且在分类任务中也有很好的表现。

文献[10]中提出了一种新的架构单元,“Squeeze-and-Excitation”(SE)块,通过显式地建模通道之间的相互依赖关系,自适应地重新校准通道式的特征响应,通过这种机制可以学习使用全局信息来选择性地强调信息特征并抑制冗余的信息特征。受此启发,本文设计了一种新的通道注意力机制,具体的结构如图1所示。首先输入网络提取的图像特征[f∈Rc×h×w],然后经全局特征提取后,将特征的形状转换为[f1∈Rc×1×1],其次经过通道权值计算模块计算[f1]中每个元素的权值,该权值即为输入特征通道的权值,最后将该权值与输入特征逐通道相乘,计算出最终加权后的特征[f3∈Rc×h×w],为输出的特征。

为了计算特征通道的依赖关系,需要统计输入特征中的每个通道矩阵最具代表性的描述,使该描述能够保留该特征的全局信息,因此提出了全局特征模块,该模块形式化表示为公式⑴,其中,[pool?]为全局特征提取函数,这里采用池化函数实现,包括最大池化和平均池化。其中平均池化能够最大限度的保留特征的全局信息,而最大池化能够提取最具代表性的特征。

[f1=poolf] ⑴

为了充分利用特征压缩后的信息,接下来需要计算特征通道之间的相关性,该操作分为两个步骤,首先对特征[f1]进行公式⑵的计算,得出压缩后的特征[f2]:

[f2=h1w1*f1+b1] ⑵

其中,[h1]为relu激活函数,使特征值限制在(0,1)范围内。[w1∈RC×C/r],[b1∈RC/r],其中r为衰减系数。然后需要对特征[f2],进行公式⑶计算,得出通道权重atte:

[atte=h2w2*f2+b2] ⑶

其中,[h2]为sigmoid激活函数,[w2∈RC/r×C],[b2∈RC]。最终通过公式(4)得出输出特征[f3],其中c表示[f3]的第c个通道。

[f3c,:,:=attec*f2c,:,:] ⑷

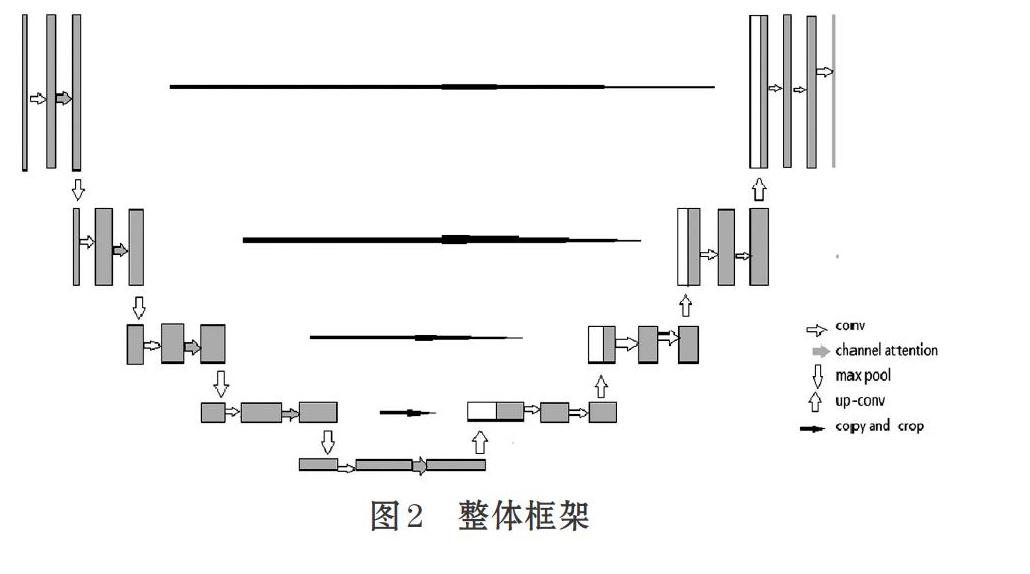

1.3 整体框架

图2显示的即为本文所设计的网络结构图,将U-net的每一层提取的特征,送入通道注意力模块,得出混合通道之间依赖关系的特征。加入注意力机制的U-net网络可以在特征提取的过程中把注意力集中在关键特征上,抑制其他无关特征,将U-net输出的特征逐通道进行压缩,然后计算每个通道的权重再将权重与原始特征通道相乘,由此区别对待不同的特征通道,增强了特征中的语义信息,从而提高医学图像的分割效果。

2 实验

2.1 数据集

本次实验将使用两个不同器官的医学图像数据集进行验证实验,以检测本文提出的模型在不同数据集上的表现效果。第一个数据集是3D-IRCADb-01数据库[5],包含20例肝脏三维CT扫描图像男女各10例),其中75%为患有肝肿瘤的患者。部分患者病例的相关信息如图3所示。第二个数据集是一组肺部的CT影像,包含ID从000到266总共267位患者的肺部影像。每个图片的具体信息如图4所示。

2.2 实验结果与分析

本文的实验在肝脏3Dircadb和肺部Bound-archieve两个数据集中进行,将数据集中的每张图像的尺寸resize为256×256,数据集的前80%作为训练集来训练模型,后20%作为测试集验证模型。实验所用的設备为CPU: Intel Core i7-9700K,GPU: GTX 1080Ti,RAM:16GB。使用Python3.6,Pytorch1.1.0实现。为了验证本文所提出的方法的有效性,本文称加入通道注意力机制的模型为(Ours),与原始模型U-net进行了对比实验,采用SGD优化网络,初始学习率为0.001,进行10次迭代后,学习率衰减为原来的百分之一,同时本文模型的衡量指标采用较为通用的Dice系数,经过上述训练过程,实验结果如表1所示。

表1中,Ours-avgpool表示公式(1)中使用的pool操作为平均池化,Ours-maxpool表示公式(2)中使用的pool为最大池化。由表1所示,在肝脏数据集中U-net的精度为0.8456,而对加入了注意力机制模块的本文模型精度来说,使用平均池化操作的精度为0.8725,使用最大池化操作的精度为0.8726;在肺部数据集中U-net的精度为0.8925,而对于本文模型的精度来说,使用平均池化操作的精度为0.9082,使用最大池化操作的精度为0.9098。由此得出,本文方法的精度均明显高于原始U-net网络,另外最大池化操作的精度略高于平均池化,由此可以驗证本文方法相比于原始U-net网络具有更加良好的分割效果,达到了预期优化目标。

为了展示更明显的效果,图5显示了部分分割样例。从图中可以看出,利用本文方法进行分割得到的预测结果相比于数据集中由医生手工标注的结果,在整体形状和位置上都已十分接近,且相对于手工标注的边界更为圆滑,对于局部的图像信息也展现的较为详细和清晰,线条相对逼真和准确,基本能够达到和医生手工标注同样的效果,能够对医疗诊断起到一定的辅助作用。

3 结束语

本文在U-net的基础上,提出了引入注意力机制模块的基于U-net网络的医学图像分割算法,借助神经注意力机制专注输入子集的能力,选择特定的输入,在计算能力有限的情况下,将计算资源分配给较为重要的任务。与此同时在两个不同的医学图像数据集上进行实验验证,结果表明本文提出的方法可以更好地对医学图像分割进行处理操作,相比于基本的U-net网络,图像分割效果更好,精度更高,训练速度相对较快,同时也具有一定的通用性,对于以后用于临床辅助诊断也有一定的参考价值。但实验中也存在一些不足,预测的器官轮廓不够细致,且模型容易出现过拟合,主要因为由医生标记好的医学图像数据较少,导致模型的训练样本量不够大,以后将增加样本数据量,并使用图像增强技术,优化模型。

参考文献(References):

[1] Patil D D, Deore S G. Medical Image Segmentation: AReview[J]. International Journal of Computer Science & Mobile Computing,2013.2(1).

[2] ZHANG C, FANG M, NIE H. Brain tumor segmentationusing fully convolutional networks from magnetic resonance imaging[J]. Journal of Medical Imaging and Health Informatics,2018.8:1546-1553

[3] VITTIKOP B S, DHOTRE S R. Automatic segmentation ofMRI images for brain tumor using unet[C]//2019 1st International Conference on Advances in Information Technology (ICAIT). Chikmagalur, India, IEEE,2019:507-511

[4] Snyder D, Garcia-Romero D, Povey D, et al. Deep neuralnetwork embeddings for text- independent speaker verification[C]//Conference of the International Speech Communication Association. Interspeech,2017:999-1003

[5]张睿,吴水才,周著黄等.基于增强CT图像的肝脏血管三维分割方法研究[J].中国医疗设备,2017.32(11):48-54

[6] Ronneberger 0. Invited Talk: U-Net ConvolutionalNetworks for Biomedical Image Segmentation[J].2015,9351:234-241

[7] 陈星宇.基于改进后的3D-Unet肺结节图像检测研究[J].科技资讯,2020.18(24):217-219

[8] 谭俊杰,钟妤,黄泽斌.基于U-net的直肠癌智能分割[J].计算机时代,2020.8:18-20,26

[9] 魏小娜,邢嘉祺,王振宇,王颖珊,石洁,赵地,汪红志.基于改进U-Net网络的关节滑膜磁共振图像的分割[J].计算机应用,2020:1-7

[10] Hu J, Shen L, Sun G. Squeeze-and-excitation networks[C]//Proceedings of the IEEE conference on computer vision and pattern recognition,2018:7132-7141

[11] Woo S, Park J, Lee J Y, et al. Cbam: Convolutional blockattention module[C]//Proceedings of the European conference on computer vision (ECCV),2018:3-19

[12] Li X, Wang W, Hu X, et al. Selective kernel networks[C]//Proceedings of the IEEE conference on computer vision and pattern recognition,2019:510-519