强人工智能体的刑罚体系构建

李少君

(华东政法大学 刑事法学院,上海 200333)

一、问题的提出

人工智能的概念于1956 年的达特茅斯会议上被首次提出,是指智能机器人模拟人类去完成某项任务的技术[1]。近年来,人工智能技术发展迅猛,诸如机器人索菲亚获得公民资格、百度董事长李彦宏乘坐公司研发的无人驾驶汽车在北京市五环路上行驶[2]、“刑事同案不同判预警系统”在江苏部分法院试点应用[3]等事件均可看出人工智能技术正逐渐深入到人类生活的方方面面。

面对前所未有的人工智能时代,尽管有观点认为人工智能技术不会对人类造成威胁,如马云认为:“尽管人工智能正变得越来越睿智,但它仍然无法与人类智慧相提并论。”[4]但我们应当认识到,人工智能机器人既可以在人类事先编制的程序内实施行为,也可基于其超强的学习和反馈能力独立实施某种行为。从该项技术兴起开始,人工智能伤人事件便已屡见不鲜。如1978 年日本广岛的摩托汽车厂机器人突然转身将背后的工人抓住并切割。1985 年全苏国际象棋冠军古德柯夫同机器人棋手下棋连胜三局,机器人棋手突然不受控制,本应继续下棋的棋手机器内部程序发生紊乱,仿佛由于“不服气”而报复性地释放出电流将对手古德柯夫击倒。2016 年11 月18 日,深圳高交会的参展机器人“觉醒”伤人等。以上事件已经暗示了人工智能技术背后的刑事风险。

只有在当下提前预想人工智能可能带来的刑事问题,方能在强人工智能时代到来时应对各种挑战。本文欲解决的问题是在人工智能具备辨认、控制能力且能够独立承担刑事责任的前提下,当前的刑罚体系是否可以直接适用,是否需要构建以及如何构建专属于人工智能的刑罚体系。学界已无争议的是,对于弱人工智能,以及在人类设计的程序范围内实施行为的强人工智能体,由于其不能成为刑事责任主体,故当然无法适用刑罚,只需将责任归咎于背后的制造者、使用者。对于制造者、使用者的处罚,现行的刑罚体系足以适用。但在强人工智能体能否成为刑事责任主体这一命题中,刑事责任的承担是承认其主体地位的必然结果,而刑罚又是承担刑事责任的主要方式。因此,如何构建针对并适合强人工智能体的刑罚体系,是在探讨强人工智能体刑事责任主体地位的同时必须解决的重要问题。

二、强人工智能体适用刑罚体系的局限性

尽管学者们普遍认为我国当前的刑罚体系既宽严相济又目标统一,既内容合理又方法人道,既体系完整又结构严谨[5],但是古往今来,各国的刑罚体系均在不断地发生变化。刑罚属于刑法的分支,而刑法又属于法律这一上层建筑,因此是由经济基础决定的,同时也是和社会文明程度相对应的,什么程度的社会文明便会催生出什么样的刑罚体系。从封建社会到现代社会,刑罚体系的中心刑罚种类也在不断改变。从最初的死刑,到后来的肉刑,再到徒刑,最后才是如今的自由刑。在人工智能时代,强人工智能体必然会成为刑事责任主体,但目前的刑罚体系适用于强人工智能体却存在一定的局限性。

我国现有的刑罚体系中一共存在四类刑罚,分别是生命刑、自由刑、财产刑和权利刑。对于当前两类刑事责任主体——自然人和单位而言,自然人可以适用以上任何一种刑罚,单位只能适用财产刑中的罚金。而面对强人工智能体成为刑事主体的情形,现有刑罚体系中的四类刑罚便会显得鞭长莫及。

生命刑即死刑,是剥夺罪犯生命的刑罚,也是所有刑罚中最严厉的一种。适用死刑的前提条件是犯罪主体拥有生命权。对强人工智能体而言,是否具有生命仍存在争议。肯定者认为,动物、微生物都拥有生命,人工智能机器人也应拥有。否定者则认为,生命仅限于拥有新陈代谢、能够与自然界交涉的生物,而人工智能只是人类创造出的物,当然不具有生命。其实对于人工智能是否具有生命的否定论者,也是对强人工智能体能否成为刑事责任主体这一命题的否定论者。可以看出,死刑能否适用于强人工智能体取决于其是否具有生命,但在目前看来,将死刑运用至强人工智能体的刑罚体系中,难免会超出国民的预测。

自由刑包括管制、拘役、有期徒刑和无期徒刑。自由刑惩罚罪犯的方式是“把人同外界隔绝,强制他陷入深沉的灵魂孤独之中,把法律的惩罚同神学的折磨结合起来”[6]。但对于强人工智能体而言,将其同外界隔绝,却存在两处弊端:第一,可能违背人类创造人工智能的初衷。人类创造人工智能是为了更好地辅助人类改造客观世界,从而获得收益,且这种收益应当大于其创造成本。若将自由刑适用于强人工智能体,则可能会导致人工智能带来的经济利益降低,这与人类创造人工智能的目的是相违背的。第二,将自由刑适用于强人工智能体,其执行方式难以明确。对自然人而言,可以通过监禁的方式在一定时间内剥夺其人身自由,且剥夺的时间越长,犯罪分子的年龄越大,由此伴随着犯罪能力减弱、犯罪情感降低等效果,最终降低自然人再次实施犯罪行为的可能性。但对于强人工智能体而言,只要有源源不断的能量就能不断运行,其活动能力不会随着年龄的变大而减弱,信息处理能力也不会随着时间的推移而降低。这也将导致强人工智能体在自由刑执行完毕后回归社会的难度降低,不会如自然人一般产生融入社会的困难。因此,相较于自然人,某一段时间内自由权的丧失对强人工智能体造成的影响极小。另外,若是为了限制强人工智能的自由权,基于刑罚的节俭原则,对其采取断电措施即可,并无必要采取监禁的方式限制其自由。

财产刑包括罚金和没收财产,尽管笔者支持强人工智能成为刑事责任主体,但学者们对这一问题仍处于争论中。在民法上,强人工智能体尚未成为民事主体,因此其尚未享有财产权等民事权利。在强人工智能体的财产权尚未得到法律认可的情况下,要求刑法剥夺或限制其财产权便只能是“镜中之花”“水中之月”。当然,笔者并不否认随着人工智能技术的更迭,强人工智能体可能会被赋予财产权,从而适用财产刑,但就目前而言,财产刑适用于强人工智能体仍然存在困难。

权利刑的局限性与财产刑相同,在尚未赋予强人工智能体政治权利的前提下而用刑法剥夺,便会是空中楼阁。如今沙特阿拉伯已经授予了人工智能机器人公民身份,相信随着伦理观念和法学研究的进步,未来强人工智能体拥有政治权利也并非异想天开,但至少在现在适用权利刑并不适宜。

面对现有刑罚体系的局限性,笔者认为应当适当调整刑罚体系,增设强人工智能体专有的刑罚,如刘宪权教授提出“对于人工智能机器人,可以增设如删除数据、修改程序和永久销毁的刑罚处罚方式”[7](以下简称“肯定论”)。笔者欲在该观点的基础上对质疑者的观点进行批判,同时也对该观点的合理性进行反思,最终提出更为科学、合理的刑罚体系。

三、对质疑观点之批判

有论者主张,对实施犯罪行为的智能机器人相关人员加以惩罚,才能从源头上遏制此类犯罪的发生,真正实现刑罚的目的和价值,因此并无必要构建专属于强人工智能体的刑罚体系。其论证思路是,对于强人工智能体造成的危害社会的结果,不应当对该机器人进行谴责,而是应当归责于存在过失的相关自然人或单位[8]。这一观点正是从刑罚适用的角度否定强人工智能的刑事责任主体地位。笔者认为,这一观点固然具有一定的合理性,但在规制的范围上仍存在漏洞。一方面,如果智能机器人在设计和编制的程序范围内实施行为,那么应当认为此时该行为体现的是研发者的意志[9]。即这一情形下的强人工智能体与当前的弱人工智能机器人没有明显区别,均属于人类大脑在物上的延伸。对于这一情形,可以运用类似于商法中的“法人人格否认制度”来否认强人工智能体的人格,直接追究其背后研发者的责任。但另一方面,对于强人工智能体在设计和编制的程序范围外实施的行为,否定论者认为应当通过过失犯罪对强人工智能体背后的设计者、制造者进行处罚,从而填补法律规制的漏洞。笔者认为这种过失归责原则有待考量,在面对人工智能时代的刑事风险时,过失责任是捉襟见肘的,对此可从两个角度予以说明。

首先,当行为主体具有故意或过失之时,行为主体的行为才具有过错的理由,对于行为主体才具有道义上或者人格上进行否定评价的合理前提[10]。因此该论者认为刑法应当赋予设计者、制造者更严格的义务,在其违反这些义务时承担相应的责任,但其对于所谓的“更严格的义务”并没有更具体的阐述。若设计者、制造者在履行了刑法设置的义务后,强人工智能体仍然实施犯罪行为,此时应当由谁承担责任?在强人工智能体不能成为刑事责任主体的情形下,便找不到可以归责的对象,因为法律调整的是人与人之间的社会关系,而不是人与物(在不承认强人工智能刑事主体的前提下只能认定其为法律上的“物”)之间的关系。若认定为意外事件,似乎又难以满足公众朴素的感情。但若刑法将责任归咎于设计者、制造者,在其已经尽到注意义务时仍进行归责,难免有强人所难的嫌疑。正如我国台湾地区学者韩忠谟所言:“行为者对于危险性之行为应加以注意,但亦有非行为者所可能认识者,则虽尽相当之注意,仍不可识,此时自不能强其必识。”[11]

其次,查明行为与结果之间的因果关系是犯罪的必要条件之一[12]。因此若要将强人工智能体的危害行为归责于设计者、制造者,则必须证明设计者、制造者的设计、制造行为与危害结果之间存在刑法上的因果关系。笔者认为,设计、制造强人工智能体的行为与人类社会中培育后代的行为并无区别。当父母生育子女后,即使未尽到抚养义务,未使子女树立正确的善恶观与伦理观,若子女因此实施犯罪行为,父母也不会受到刑法的谴责,因为二者之间不存在刑法上的因果关系。这样的论证过程同样适用于强人工智能体,对于强人工智能而言,其自身已经具有了独立的学习能力、辨认能力和控制能力,在其学习、生活过程中,设计者、制造者很难直接左右其善恶观与伦理观,学习过程是由人工智能自我独立实施的。因此,强人工智能实施犯罪行为与设计者、制造者之间不存在刑法上的因果关系。

再者,即使能够证明设计、制造的行为与危害结果之间存在因果关系,但强人工智能体复杂的算法与编程一般是很多设计者、制造者劳动的结合,其设计和制造往往是多人协作的结果,而不是由一人独立完成的。并且强人工智能体可以通过学习从而具备独立思考的能力,那么设计者、制造者的工作过失与强人工智能体学习新信息的行为之间,哪些行为才与危害结果之间存在因果关系,以及存在何种程度的因果关系,这些都是难以判断的。

通过以上分析可知,若不对设计者、制造者的过失责任进行限缩(仅限于强人工智能体在设计和编制的程序范围内实施犯罪行为由设计者、制造者承担责任),则会导致过失责任成为严格责任的“面具”。实际上,在风险社会中,任何技术都有导致伤害的风险,对于风险何时发生、如何发生,设计者、制造者都是难以预见的,甚至是无法预见的。制造强人工智能体本就是一种风险,但如福田平所说,“如果法将引起法益的侵害或者危险的行为都作为违法予以禁止,我们的社会生活就只能立即静止”[13]。同样,将强大的刑事责任强加于人工智能的生产者、设计者身上恐怕会遏制人工智能技术的发展,甚至无限延期强人工智能到来的这一天,而这与我国对人工智能技术的态度也是相违背的①比如2020年2月24日,教育部、国家发展改革委、财政部发文指出要依托“双一流”建设,深化人工智能内涵,构建基础理论人才与“人工智能+X”复合型人才并重的培养体系,探索深度融合的学科建设和人才培养新模式,着力提升人工智能领域研究生培养水平,为我国抢占世界科技前沿,实现引领性原创成果的重大突破,提供更加充分的人才支撑。。

另有质疑者从刑罚的目的和功能出发,认为刑罚的功能在于惩罚和预防犯罪,人工智能尽管在一定程度上具备辨认和控制能力,但是并不具备与人类完全相同的善恶观、伦理观,对其施以刑罚处罚也难以发挥刑罚预防犯罪的功能[14]。快乐、忧伤等情绪的感受属于最低级别的认知,人工智能的认知水平相较于动物仍望尘莫及,因此无法如人类一般拥有各种情绪,从而不会具备趋利避害的本性,最终刑法的威慑力在人工智能面前便荡然无存。在笔者看来,这种质疑的错误之处在于模糊概念,以当下的弱人工智能概念取代将来的强人工智能,以弱人工智能的特点推定强人工智能的性质。该论者认为,当前人工智能的认知水平均与人类存在着不同程度的差异[15]。由于当前人工智能也仅仅处于弱人工智能的水平,笔者亦同意仅就当前来看人工智能的认知水平与人类存在不同程度的差异。但以当前的认知水平推定将来,无疑是模糊了弱人工智能与强人工智能的概念。若要彻底反驳该观点,接下来需要论证的便是刑法对于强人工智能而言,能否起到预防犯罪的功能。

笔者认为,在特殊预防方面,由于强人工智能体具有辨认和控制能力,因此完全可以对自身的犯罪行为进行反省,刑罚的痛苦也会促使其改造自身的善恶观,进而避免再次犯罪,从而实现特殊预防的效果。由于刑罚所体现的不完全是功利主义,其本身也是一种社会观念的传递,而强人工智能体又具有辨认和控制能力,因此可以与人类一样领悟到刑罚所表达的社会观念,理解人类世界的法律,伴随着趋利避害的本能,从而遵守法律规范。所以在一般预防方面,刑罚也可以实现其效果。

再如,有质疑者认为删除数据、修改程序、永久销毁、报废、回收改造等刑罚方式都仅仅能够起到使人工智能失去再犯罪能力的效果,这些刑罚方式都是消极且被动的[16]。其论证思路是自然人在承受刑罚之后会因刑罚的痛苦以及犯罪带来的后悔、恐惧心理而调整自我行为,从而步入正常的生活轨道,但人工智能调整行为的方式是人为的、被动的。若没有人类强制删除数据的惩罚就无法引导其调整自身行为。如此而言,刑罚便失去了教育、改造的功能。

笔者对此提出两点质疑:首先,“被动”改造是否一定逊色于所谓的“主动”改造?笔者认为,改造的好坏标准不在于“主动”或“被动”,而在于改造后的再犯可能性大小。消极的改造是删除人工智能机器人的犯罪记忆,并人为地引导正确的善恶观、伦理观。这实际上是一种“重生”,且由于人为的引导,这种“重生”的再犯可能性是极小的。有德国学者认为,与其将大量的资金投入监狱,还不如将其投入学校等机构以培育规范忠诚型的人格倾向,因为后者对于预防犯罪更加经济、有效[17],删除数据这一刑罚方式正相当于学校机构重新培育人工智能的忠诚型人格倾向。而对于主动改造,当罪犯重新步入社会,是否会有重新犯罪的可能?如果这种可能性极低的话,恐怕《刑法》第六十五条关于累犯的规定早已没有设立的价值,然而实际上并不是这样。另外,即使罪犯的是非伦理观念在改造后得到纠正,但犯罪的记忆是伴随其一生的。而对人工智能而言,并没有这种痛苦。从这个意义上讲,人工智能的“被动”改造反倒优于自然人的“主动”改造。

其次,笔者认为所谓的“主动”改造已经蕴含了被动的前提。试问,如果没有刑罚的强制性,犯罪分子在犯罪后是否就会主动改造自身?答案是只会更加肆无忌惮。因此,笔者认为,并不存在纯粹的“主动”改造。刑罚是国家强制力的体现,在刑罚的强制性面前,任何主体都是消极且被动的。本质上,自然人的改造与人工智能的改造相同,均是在一定强制力的威慑与强迫之下,被动与主动并存的改造。

亦有质疑者认为,人工智能犯罪本身在具有极高的技术性与隐蔽性、不易发现,并可作为刑法上的独立刑事责任主体后,刑罚对于犯罪行为有了惩罚对象,在无法进一步深入探究时,最终导致真正的犯罪行为责任人被放纵[18]。笔者认为这种担忧是多余的。第一,该问题属于技术层面的问题,而非刑罚问题。既然行为人可以通过相关技术实施人工智能犯罪,那么侦查机关自然可以研发出相应的技术找出背后的始作俑者。第二,前文已经提及的人格否认制度可以较为完善地解决该问题。第三,为避免人工智能机器人被犯罪分子利用而拒绝其成为刑事责任主体无异于因噎废食,强人工智能体无法成为刑事责任主体只会导致未来更多的强人工智能犯罪难以使用当前的刑法规制。

还有质疑者从刑法的严厉性角度否认“删除数据”这一刑罚,认为这种刑罚和行政处罚难以区分,无法体现刑罚特有的严厉性。持此种观点的学者实际上没有认识到人工智能机器人运作的实质——以程序为核心,以数据为对象。从微观的角度分析人工智能的运作机理,人工智能是通过对数据的分析来模拟人类大脑的运行。因此,删除数据和修改程序均改变了人工智能的运作核心,作为制裁手段对于强人工智能体而言,都是极其严厉的[19]。

最后,有质疑者指出,永久销毁这一刑罚相当于当前刑罚中的死刑,但废除死刑已经成为各国的必然趋势,在人工智能立法中却增设类似死刑的这一刑罚,有违刑罚发展的理念[20]。笔者从两个角度对这种合理怀疑进行解释:首先,尽管废除死刑是必然趋势,但不可否认,死刑仍将在我国甚至是域外国家立法中存在很长一个时期。若要求人工智能的刑罚中废除“死刑”(即永久销毁),那么传统刑罚中的死刑也应废除,只有这样才能实现刑罚体系的协调性。然而死刑将在何时被废除是不可知的,因此在人工智能刑罚中增设“死刑”就当下来看并非没有合理性。其次,尽管学者们应当更多地注重强人工智能体与人类的相似性,但我们必须承认,强人工智能体与人类相比最大的不同之处在于其更加智能,或者说在犯罪领域人工智能造成的社会危害性会比人类造成的社会危害性更大。甚至在强人工智能技术发展到一定程度时,强人工智能体一旦摆脱人类的控制,这种危害性将可能是毁灭性的。因此,从这个角度来看,强人工智能体相当于比人类更智慧的“洪水猛兽”,人类不能再将其看作“人”。对于无论是智慧上还是体力上人类都难以抗衡的强人工智能,在其实施犯罪行为且后期无法改变时,永久销毁或许是最佳的解决方案。

四、对“肯定论”之反思

尽管“肯定论”在目前看来具有较大的合理性,但笔者认为该观点也存在一些偏颇之处。首先,“肯定论”存在违反罪刑相适应原则的嫌疑。罪刑相适应原则要求刑罚的轻重必须与犯罪的轻重相适应,不能重罪轻判,也不能轻罪重判[21]。试想,若强人工智能体独立实施了杀人行为,根据《刑法》第二百三十二条规定,是有可能适用死刑的。但根据肯定论的观点,删除数据、修改程序、永久销毁构成了专门适用于人工智能机器人的刑罚阶梯,体现了处罚的层次性[22]。但正是这种层次性,对于强人工智能体故意杀人的行为,首先适用的是删除数据这一刑罚,只有在该人工智能机器人无法被正确引导时,才会适用之后的修改程序和永久销毁的刑罚。而对于受害者家属或是一般民众来说,仅仅删除机器人的犯罪记忆恐怕是难以接受的,因为正义要求每一项罪孽(犯罪)都要通过有期限的苦难而偿付;要求该苦难,亦即该刑罚与罪行相当;要求被违反的特定的法律得到恢复(复仇)[23]。所以以上设想的案例暴露出肯定论存在的第一个问题——刑罚设置的梯度是否合理,是否违反罪刑相适应原则?

在当前刑法中,刑罚是根据相关犯罪的社会危害性和主观有责性进行设置的。如《刑法》第二百七十五条规定的故意毁坏财物罪的法定最高刑为7年有期徒刑,与故意杀人罪最高可判死刑的规定相比乃天壤之别。究其原因是毁坏财物的故意与杀人的故意相比主观恶性较小,且造成的结果恶劣程度更低,因此在刑罚的设置上存在较大差异。而在笔者看来,肯定论者对于人工智能机器人的刑罚是根据再犯可能性设置的。若人工智能机器人在首次犯罪后无再犯可能性,便不管该罪的社会危害性和主观有责性的严重程度,即使是实施故意杀人的行为,也只需适用最低梯度的刑罚——删除数据。但对于自然人杀人的行为,根据《刑法》第二百三十二条的规定应当按照死刑、无期徒刑、有期徒刑的梯度顺序进行适用,根据具体情节作出判断。即首先可能适用的是死刑,而删除数据与死刑相比,在严厉性上实在微不足道。只有罪刑相当,方能实现社会的公平正义。所以,是否违反罪刑相适应原则是肯定论者需要面对的第一个问题。

其次,刑罚的报应功能、惩罚功能是刑罚的最基本的功能,是刑罚其他各种功能得以存在的前提和基础,刑罚的预防功能是仅次于报应的重要功能。在传统刑罚的设定中,正是遵循着报应功能为主、预防功能为辅的理念。基于第一个问题,我们可以看出在强人工智能体适用的刑罚中,反倒以预防和教育功能为主,忽视了刑罚应有的报应功能。在自然人和人工智能刑罚的立法模式上,为何会存在功能冲突?这是肯定论者亟待解决的第二个问题。

再次,在论述强人工智能体成为刑事责任主体时,肯定论者往往从强人工智能体与自然人的相似性(即都具有辨认能力和控制能力)出发进行论证。既然二者基于同样的逻辑基础产生了刑事责任主体的适格性,为何在刑罚适用的顺序上出现了不同的逻辑差异?这是肯定论者欲自圆其说应当回答的第三个问题。

五、对“肯定论”之修正

前文已经论述肯定论有违反罪刑相适应原则的嫌疑,究其根本,实则是对刑罚目的的理解不同。肯定论者侧重于预防,认为“刑罚的目的是预防犯罪,不能实现此种目的的刑罚即是不合理、无必要的刑罚”[24],“预防其再犯的可能途径决定了适用于该主体的刑罚种类与执行方式”[25],因此设置了删除数据、修改程序、永久销毁的刑罚梯度。但笔者认为刑罚的目的也应当蕴含报应的属性,正如加罗法洛所说:“如果刑罚全然失去了惩罚的目的,如果刑罚真的是具有教育、改造,甚至治疗的目的,那么人们不禁要问:当罪犯没有受到身体上的痛苦、其犯罪所获得的唯一后果是免费教育的特权时,刑罚的存在还有何意义?”[26]惩罚既是刑罚的属性,同时也是刑罚的目的[27]。且刑法分则在具体罪名的刑罚的设置上,也根据社会危害性的大小规定了轻重不一的量刑幅度,这也正是刑罚目的中报应主义最有力的证明。

值得一提的是,肯定论者自身也主张“应使智能机器人所实施的犯罪与刑罚之间‘保持实质的对应关系’,重罪重罚,轻罪轻罚,建立层次分明的刑罚阶梯”[28],但倘若仅按照再犯可能性进行刑罚的设定,这本身就与“重罪重罚,轻罪轻罚”的理念相违背,由此可见肯定论者在对强人工智能体刑罚构建所坚持的原则中存在相互抵牾的情形。相反,报应主义却可将刑罚的轻重程度与犯罪行为的社会危害性相匹配。报应所体现的是刑罚的正义原则,这为刑罚的不确定性设定了上限与下限;预防所体现的是刑罚的功利原则,决定着刑罚效益性目的。无论正义还是功利,都是现代刑罚的内在要求。因此,笔者认为在对强人工智能体刑罚的设置上,应当遵循报应与预防相结合的二元论思想,即根据社会危害性和再犯可能性的大小设置刑罚梯度,并以此对肯定论进行修正。

首先需要解决的是永久销毁这一刑罚的适用,笔者认为既然永久销毁相当于当前刑罚中的死刑,因此同样也只适用于罪行极其严重的犯罪分子(强人工智能体)。对于刑法分则相关罪名中设置的死刑,应类比至永久销毁适用于强人工智能体。即在罪行极其严重的情况下,即使可以通过多次删除数据或修改程序降低强人工智能机器人的再犯可能性,也应当对该强人工智能体适用永久销毁的刑罚,从而与当前对自然人犯罪的处罚相一致。

尽管肯定论者认为基于刑罚节俭性原则,“对智能机器人应慎重判处永久销毁的刑罚,能够不销毁而依然可以实现对智能机器人的改造目的的,便尽量不销毁”[29]。但笔者认为对智能机器人适用永久销毁的条件和对自然人适用死刑的条件相同,均只适用于罪行极其严重的犯罪分子。“罪行极其严重”这一附加条件以及《刑法》明文规定的适用死刑的相关罪名已经很大程度上限制了永久销毁的适用。当前对于死刑立即执行,需报请最高人民法院核准,将来在永久销毁的适用上,也完全可以在程序上对其进行类似的限定,从而保证谨慎判处永久销毁的刑罚。另外肯定论使用的“尽量”一词,表明其并不是在能实现改造目的的前提下一味否定永久销毁的适用,而是认为应当谨慎适用。在强人工智能体的罪行极其严重时,当然应当适用永久销毁,从而表达社会正义观念,恢复社会心理秩序。

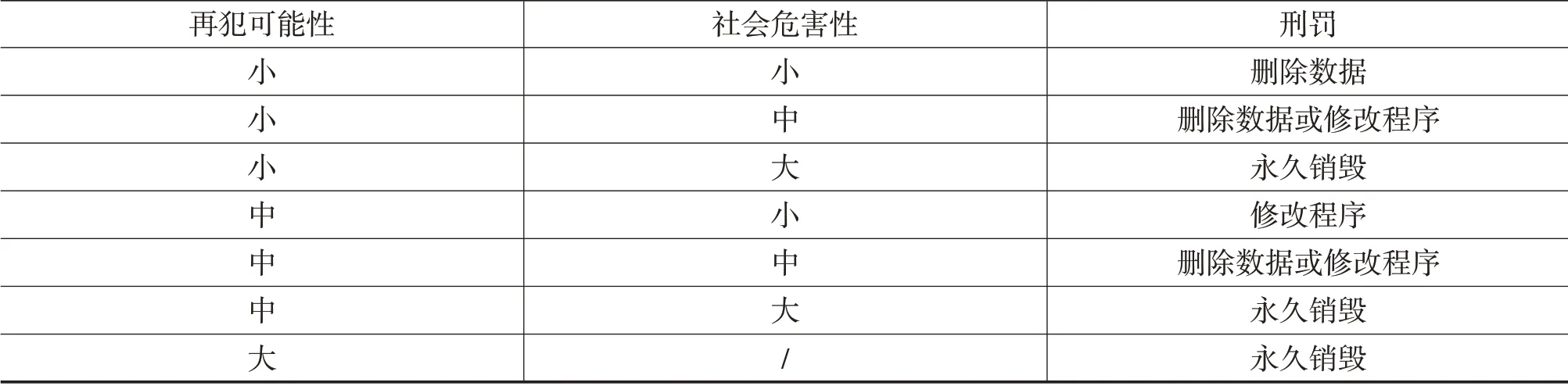

其次,关于删除数据与修改程序,修改程序在刑罚的严厉性上显著高于删除数据,因为修改程序是强制性地修改人工智能机器人的基础程序,将其从外界学习的能力限定在一定范围内。限制学习能力的最终结果是无法产生自我意志,这对人工智能机器人而言是极其残酷的。笔者认为,为实现罪刑相适应,不应当仅根据智能机器人的再犯可能性进行选择适用,即不能只在通过多次删除数据仍然无法阻止机器人主动获取有可能实施违法犯罪行为的“负面数据”时才适用修改程序的刑罚。对强人工智能体判处的刑罚应当以再犯可能性为基础,将其分为小、中、大(极其严重)三个层次,并引入社会危害性进行补足,最终判断适用何种刑罚,具体适用情形如下表所示。

从该表可以看出,肯定论的修正既没有对报应主义一味否定,也没有对预防主义全盘接受,而是合理吸收安排双方的结构,从而体现出现代法治精神。在预防犯罪的同时维护社会公众对刑法的信任,最终为强人工智能体的刑罚提供了比较理想的正当化构建。

注:再犯可能性小、中、大分别指:抹除犯罪记忆即可使人工智能机器人恢复到实行犯罪行为之前的状态;多次删除数据仍然无法阻止机器人主动获取有可能实施违法犯罪行为的“负面数据”;删除数据、修改程序均无法降低实施了犯罪行为的智能机器人的再犯可能性。社会危害性小和中需法官结合具体案情进行判断,社会危害性大指罪行极其严重,与自然人判处死刑的程度相当。