基于改进Mask RCNN和SVR的无接触梭子蟹体质量预测研究

唐 潮, 胡海刚*, 史 策, 钱云霞

基于改进Mask RCNN和SVR的无接触梭子蟹体质量预测研究

唐 潮1, 胡海刚1*, 史 策2, 钱云霞2

(1.宁波大学 海运学院, 浙江 宁波 315832; 2.宁波大学海洋学院, 浙江 宁波 315832)

提出了一个改进Mask RCNN目标检测算法用以对养殖梭子蟹进行视觉特征测量. 通过在养殖区域采集梭子蟹图像, 用上位机识别梭子蟹旋转角度以及甲长和甲宽方向, 对输出的Mask进行模板修补, 提高模板内区域的置信度. 通过图像-实景对应关系换算梭子蟹的真实尺寸, 并估算其投影面积、甲宽与甲长, 结果准确率高于85%. 同时, 对视觉算法得到的梭子蟹尺寸特征与其体质量进行拟合, 引入-means聚类, 实现双模型支持向量回归机(SVR)预测结构. 通过差分进化算法对SVR适应度函数进行寻优, 设计了随迭代次数、寻优效果同步变化的缩放因子, 以及适者更易生存策略的交叉概率因子, 以验证改进算法的寻优能力. 测试时, 对新传入的数据首先进行归一化处理, 然后判断所归属的聚类中心, 再传至相应的SVR模型进行预测. 测试结果相对误差小于18%.

梭子蟹; 视觉特征; 体质量; Mask RCNN; 无接触测量

在梭子蟹工厂化循环水养殖过程中, 工作人员需要定期检测其尺寸、形状, 观察其颜色等特征, 为饵量、用药、分级等提供依据[1]. 目前养殖蟹主要通过人工肉眼判断, 手工接触或使用简单工具进行测量, 不仅效率低还容易导致蟹感染疾病, 甚至死亡[2]. 通过计算机视觉技术, 在养殖环境下实现对水生生物特征进行无损检测已成为趋势[3]. 该方法可实现对水质和生物生长、行为等监控[4], 这种监测具有经济、可远程操作、无须接触和精度高等特点[5]. 传统机器视觉的无监督分割方法的效果主要取决于目标与背景的差异[6], 在水产养殖中应用较少. 文献[7-9]分别在专设背景下对鱼、蟹目标进行分割, 提取尺寸特征后建立了目标物与其体质量的回归模型. 但在梭子蟹养殖中, 水中会出现虫蛾、残饵、泥沙等杂质, 这对传统的无监督图像目标检测和分割方法带来了挑战. 随着计算机技术的进步, 特别是深度学习的发展, 基于卷积神经网络的目标检测方法在复杂背景下展现了优势, 不再需要将生物体移框到专设的拍摄区域[10-11].

目前学界将深度学习的目标检测算法分为两类[12]: 一类是基于回归的YOLO系列算法[13], 将类别和边界框的坐标同时进行预测, 该算法速度快, 但召回率稍差; 赵德安等[14]利用该算法对水下的灰度河蟹图像进行了检测, 取得了较好效果. 另一类是基于区域的RCNN系列算法[15], 将前景与背景分割, 前景分类, 该算法识别速度较慢, 但召回率较高. 这两类算法都只能识别出目标的范围, 不能较好地分割出物体的轮廓, 也不能根据物体旋转的角度对边界框进行旋转, 因此不能满足对尺寸识别的需要. 为此, He等[16]提出了Mask RCNN算法,该算法具有物体掩膜(Mask)的预测分支, 可以分割出图像中的实例, 从而可进一步由面积等参数回归获得梭子蟹实时体质量的预测. 在体质量预测方面, 王静安等[17]对河蟹甲壳尺寸与体质量进行了线性拟合, 发现雌雄河蟹甲长、甲宽等与体质量密切相关. 张超[18]利用最小二乘法对梭子蟹面积和体质量进行了单因子拟合. 为进一步提高精度, 唐杨捷等[19]采用甲宽、甲长和面积实现了3因子对体质量的拟合, 将预测误差降至2.23%以下.但现有方案还不能做到在养殖背景下的基于实时图像的尺寸测量. 因此, 如何将多元体质量拟合方法与无接触图像算法进行有机结合, 以进一步提高模型性能具有重要意义.

本文以无接触图像识别为出发点, 提出了一种通过获取养殖环境下梭子蟹投影面积、甲宽与甲长, 并经特征聚类后对应不同聚类中心建立体质量的预测模型, 通过静态图像识别估测梭子蟹的体质量. 该技术可辅助实现饵料投放的“闭环”控制, 有助于提高水产养殖的智能化水平.

1 检测材料和方法

1.1 实验平台的搭建

实验平台设备主要包括三脚架、CCD工业相机、定焦镜头、连接设备和上位机PC.

实验对象为单筐养殖梭子蟹. 选取生长状况良好、个体大小不同, 共200只梭子蟹, 依次放置在养殖筐内, 在养殖筐中注入海水和泥沙模拟养殖环境. 用三脚架将工业相机架设在养殖筐上方, 视野保持在养殖筐范围. 相机镜头的选型与实际工作匹配. 实验采集装置的工作距离(WD)约1m. 为便于一对一编号和基于视觉尺寸提取, 单次拍摄的视场尺寸(FOV)与框体尺寸(400mm×300mm)一致. 相机镜头焦距的计算公式为:

式中:CCD为相机靶面尺寸, 取12.7mm(1/2英寸), 有效像素1920×1440.

为保证整个框体完全处于视野中, 分横纵2个方向分别计算值, 取两者较小值, 即选用焦距为16mm的定焦镜头, 镜头像面尺寸为19.9mm(2/3英寸), 大于相机的靶面尺寸, 以互相兼容[20].

1.2 模板修正的Mask RCNN尺寸提取

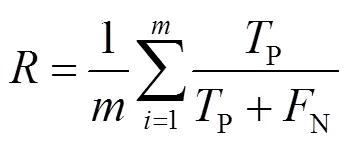

图1 Mask RCNN网络结构

Mask分支将特征图池化为28×28像素, 并在预测时计算出每个像素前景可能性的概率, 超过阈值则被判定为前景. 小尺度的Mask特征图减小了生成掩膜所需的算力, 使得Mask RCNN在增加实例分割功能的基础上不增加运算时间.

残饵、反光等会影响梭子蟹轮廓的识别, 或有部分螯足被虚警, 造成甲壳识别出现小面积的畸形. 为了提高Mask识别的准确度和识别养殖环境下梭子蟹的旋转角度, 本文在Mask分支预测出的概率矩阵基础上, 提出了优化梭子蟹甲壳分割的方法, 即通过统计大量甲壳形状找到最具普适性的甲壳模板, 并将模板最佳匹配到生成的掩膜位置, 按照模板形状对Mask的概率矩阵进行修正, 以进一步削弱超出正常梭子蟹轮廓部分, 删除明显离群的虚警部分.

1.3 聚类优化梭子蟹体质量预测

图2为梭子蟹体质量建模和预测过程. 依据梭子蟹体质量与甲壳长和宽的密切关系[22], 在采用面积的基础上, 加入甲长、甲宽, 搭建3因子回归模型, 以提高预测的准确度. 模型根据梭子蟹3个视觉特征的内在属性, 通过聚类建立各类预测模型, 并将其输入到支持向量机(SVM)中加以训练.

图2 梭子蟹体质量预测模型

2 基于后验逻辑的模板匹配

2.1 模板获取

由于掩膜的修正依赖模板, 因此改进效果优劣直接取决于模板能否代表绝大多数梭子蟹的甲壳范围. 梭子蟹通过多次脱壳实现生长, 每次脱壳后甲宽和甲长都有一定增长, 但增长趋势十分接近, 长宽比基本保持不变[23].

本文采用200只水平放置的梭子蟹甲壳区域的二值图作为样本集, 按甲壳宽等比归一化, 得到甲宽相同甲长各异的新样本; 按照重心位置叠加, 取所有样本图像的交集, 得到一张可以覆盖各种形状的初始甲壳模板t. 始终固定模板宽度不变, 长度从样本的最小值按照设定步长增至最大值, 模板与样本(=200)的平均交并比(Avg IOU)的计算公式为:

将满足平均交并比最大的位置所对应图片的长和宽作为最终模板尺寸(图3).

图3 梭子蟹甲壳模板

2.2 基于图像矩的重心和倾角识别

由网络推断出的实例虽然具有语义, 但并不能识别其相对于模板旋转的角度, 这为模板的匹配带来了困难. 针对梭子蟹甲壳的对称性, 本文采用二阶矩计算输出掩膜的倾斜角度.

实例分割出的Mask为甲长方向个像素, 甲宽方向个像素的二值图像,(,)表示坐标为(,)点对应的像素值, 若位于实例内, 则为1, 否则为0.

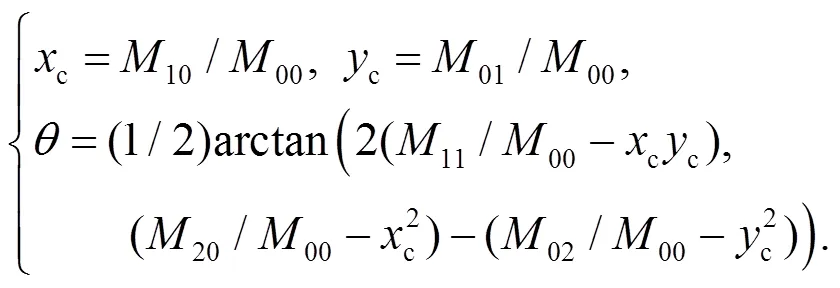

式(3)可分别计算出预测Mask的图像矩, 其中00为零阶矩,01和10为一阶矩,20、02和11表示二阶矩, 通过式(4)可求出实例的重心(c,c)和旋转角.

2.3 模板后验匹配

为了减少匹配产生误差, 需要对模板图按实例大小进行缩放, 以重心为中心旋转至Mask相同的角度. 由于水中颗粒存在散射, 会造成实例尺寸明显大于梭子蟹的真实甲壳, 若按回归Mask长宽放大模板会导致模板包含过多的背景部分. 经比较最终采用面积匹配法, 放大倍数的计算公式为:

式中:SJ为衰减因子, 取0.9左右, 以平衡图像噪音的干扰, 并防止放大倍数过大;Mask为实例面积, 随个体大小变化;Temp为模板面积, 取定值.

完成放缩后旋转, 为保证旋转前后模板甲壳区域面积不发生改变, 需要对仿射变换后的图片重心位置和边界框尺寸进行如下调整:

采用Python 3.6软件中pencv模块下cv2.Get- RotationMatrix2D函数计算按模板重心(C,C)给定角度的变换矩阵, 并根据式(7)对稍作调整, 矩阵中前2列实现旋转, 最后1列实现移动转轴至任意点, 并修正因旋转可能导致的越界部分.

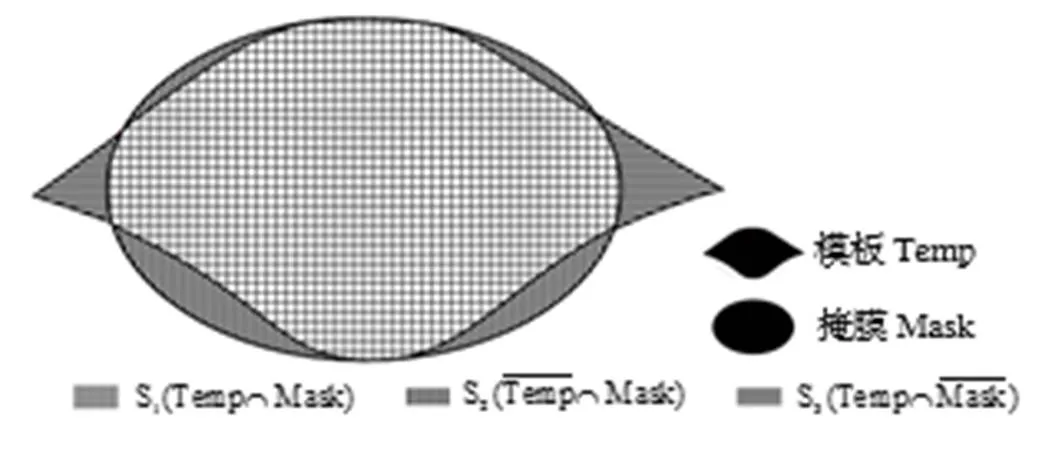

将修正后的变换矩阵传入warpAffine函数进行仿射变换和边界调整, 计算输出模板重心. 根据新模板和Mask重心完成Mask与模板图片的匹配, 此时模板图与Mask产生3处逻辑关系(图4).

图4 模板与掩膜逻辑关系

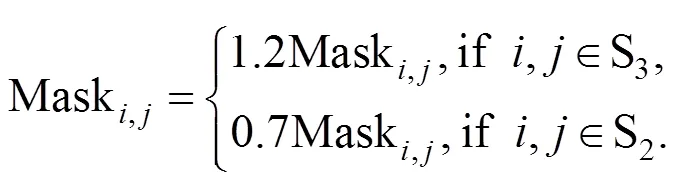

图4中S1为模板和Mask的共同置信区域, 最有把握识别正确; S2为Mask识别出而不包含在模板中的部分, 很可能是水中颗粒散射造成的虚警部分, 应予衰减; S3是由于甲壳边缘部分特征不明显很难被识别出的部分, 应增大Mask矩阵中相应位置的概率. 对不同区域Mask的概率进行增益或衰减的具体数值计算公式为:

3 模型训练与测试

3.1 实验数据集制作

(1)图像收集. 为消除地域和人工选育的影响, 分别选用产地为浙江宁波和山东青岛的梭子蟹, 品种为养殖蟹和野生蟹, 共收集梭子蟹甲壳训练集1000张, 验证集200张, 测试集85张, 测试集与训练集图片采自不同时间和产地的梭子蟹.

(2)数据增广. 在梭子蟹识别中经常会因为视角的倾斜、镜头畸变、光线变化、局部遮挡、波纹和旋转等造成识别准确率下降, 因此通过变换训练集以达到提前模拟这些工况. 数据增广方式为: 首先对所有图片进行水平和垂直翻转, 然后对3倍大小的训练集随机进行仿射变换、高斯噪声、亮度调整、局部涂黑和高斯模糊中的一种或多种变换, 从而将训练集扩充至6000张.

(3)前景标记. 采用Labelme插件完成数据ground truth标注.

3.2 模型的迁移学习

训练和测试配置为Intel i7 6700K处理器及七彩虹GTX1070显卡, 内存16GB, 采用GPU加速. 训练采用迁移学习方式, 输入标记好前景的训练集图像进行前向模型计算, 反向误差传递, 更新顶层权重, 训练阶段采用异步随机梯度下降算法防止训练陷入马鞍点. momentum参数选为0.9, 训练重复次数(epoch)为30, 权值初始学习率设为0.001. 随着epoch次数增加逐渐减小, 衰减系数设为0.0001. 图5是改进Mask RCNN训练损失值及交并比曲线.

虽然很多高校都成立了诸如大学生创业园、创业孵化基地、创客空间等创新创业平台,也开发了创新创业教育教材,并设置了固定创新创业学时,但存在着投入大、收效小的尴尬局面,实际成效难以量化,象征性意义大于实质性意义,对于提升人才培养质量、提高人才核心职业竞争力的帮助极为有限。

图5 损失值与交并比随改进Mask RCNN训练次数的变化

由图5可看出, 随着训练迭代次数的增加, 损失值迅速降低, 并逐渐收敛稳定在0附近; 交并比逐渐增大, 但因实际测试环境较为复杂, 受波纹、残饵等影响, Mask RCNN始终不能完全精确地将梭子蟹甲壳部分与背景分割开, 最终交并比稳定在0.9以上. 从上述各参数的训练过程看, 模型的收敛结果较为理想.

3.3 图像与实际尺寸的转化

由于在镜头选型时确保视野内只包含单只蟹框, 因此在硬件不变条件下, 每次采集图像的视野长、宽和包含像素始终固定, 可以通过每个像素的长度换算图像中梭子蟹对应的真实尺寸. 定义单位真实尺寸对应图像中个像素, 其单位为像素·mm-1, 满足:

式中:pixel为采集图像在宽度上分布的像素数目,针对同一镜头和相机感光元件, 存在固定的分辨率和像素, 像素与分辨率的比值确定图像的像素尺寸;0为整个视野真实的宽度, 测量时选取与梭子蟹主体位于同一水平面的最大视野的实际长度.

本例采用1920×1440像素与96ppi, 取像素宽度为1440, 视野宽度为养殖框的宽度, 取300mm, 代入式(9), 得=4.8. 由此可以根据梭子蟹图像在长度(或宽度)方向所占据的像素数目(L)和梭子蟹实例在图像上所占据的总像素数(A), 根据式(10)推导出所对应的真实尺寸()及真实投影面积(), 其计算公式为:

3.4 算法性能对比

85张测试集图像采自真实养殖状态, 背景包含水面、残饵、粪便、泥沙等. 推断时将测试集依次传入训练所得模型, 由于蟹螯足、残饵与蟹甲壳纹理接近, 据先验知识将检测框分辨率像素设为128×128、256×256、512×512, 即删除不匹配梭子蟹甲壳的推荐区域(RPN)尺寸, 避免对非目标区域的误识别, 识别的综合效果见表1. 性能评价采用召回率()和平均精度(P)2项指标, 其计算公式分别为:

式中:为测试集包含的图片数;P为每张图像中真阳性个数;N为虚警语义个数;P为出现的假阳性个数.

3.5 验证结果分析

表1 梭子蟹识别模型的平均性能

图6和图7分别是改进前后掩膜范围对比, 以及梭子蟹甲长、甲宽和面积算法推断与人工实测误差对比. 从图6和图7可看出, 梭子蟹面积、甲长和甲宽的估算准确率基本保持在85%以上, 对甲壳部分分割良好. 甲宽误差大部分呈负值, 说明算法对甲壳尖端部分分割效果较差, 造成甲宽估算过短, 如编号6、54、71等样品; 甲长估测有部分误差超过10%, 如编号5、11、53等样品, 其原因为误将收起的梭子蟹大螯识别为甲壳, 造成甲长被错误地放大.

图6 改进前后掩膜范围对比

图7 算法改进前后测量误差对比

由图7(a)可看出, 在甲长识别时, 改进算法明显减小了误差折线的波动和误差峰值, 将甲长误差绝对值基本保持在10%以下. 从图7(b)可看出, 由于梭子蟹大螯部分被误识别时会明显增加甲长的估测值, 但其相对于甲壳部分面积较小, 改进算法能有效地依照模板将多余部分删除, 提高甲长估测的准确性. 改进算法由于依靠原始算法的掩膜输出, 面积误差部分与原算法趋势相同, 优化程度较小(图7(c)). 由表1可知, 改进后误差均方波动减小较为明显, 改进前后测试集中甲长、甲宽和面积3个尺度的误差绝对值均保持在0.10以下的样本数量由44个增加到60个, 均保持在0.05以下的样本数量由6个增加到29个. 在峰值误差方面, 由于某些样本中采集模糊、反光, 如编号50的梭子蟹图像, 造成原始算法对梭子蟹甲长、宽和面积估测显著减少, 误差较大的初始掩膜对改进算法的效果也产生负面影响, 最终因模板变形后对甲宽方向的伸长作用, 初始掩膜和模板叠加后一定程度上补偿了面积和甲宽的缺失, 但是由于面积的负误差, 造成模板对甲长方向没有改进效果, 最终使得算法针对某些样本出现较大的峰值误差. 适当采用较大的模板放大系数、良好的补光、稳定的高速摄像机可缓解这类问题的产生.

综上可知, 改进算法对于提取梭子蟹的视觉尺寸相比原始算法在精确度和稳定性上都有一定提高, 为后续体质量回归提供了更准确的数据.

4 梭子蟹体质量预测

4.1 改进的差分进化算法

差分进化算法是一种寻优算法, 其基本思想是随机产生初始种群, 通过变异得到新个体, 将新个体与当代种群中预先决定的个体相比较, 优胜劣汰, 引导搜索过程向最终的最优解靠近.

4.1.1 差分进化算法的参数改进

(1)追逐适应度的自适应变异因子

在寻优初期, 通过较大的寻优函数返回值加大变异缩放因子, 保持群体多样性, 避免早熟[24]. 随着代数的增加和均方误差的下降, 缩放因子迅速减小, 回到设定值0附近[25], 提高搜索到最优解的概率. 但只通过代数的增长进行衰减较为刻板, 不能根据当前寻优过程的特异性优化寻优过程, 若代数设置较大, 则寻优过程会经历长时间的较大变异缩放因子, 引起寻优过程频繁跳过最优值, 浪费算力. 本文通过Sigmoid函数缩放两代之间的适应度以调整取值, 随着适应度减少, 调整变异幅度, 减小寻找最优值所需的步数. 本文设置的缩放因子计算公式为:

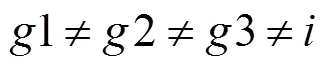

式中:0为预设的缩放因子, 取0.5;为算法当前代数;n为预设进化总代数;为权重常数, 经实验选取0.8时表现较好;为源自神经网络生长曲线S型激活函数, 可将实数域的适应度之差缩放为0~1之间数值, 其表达式为:

best()表示第代种群中适应度最高个体对应的适应度, 当超过3代后, 便可计算前两代间的适应度差异, 从而指导进行自适应变化.

(2)适者生存的交叉策略

除缩放因子外, 交叉概率(r)也会影响寻优效果.r主要反映在交叉过程中, 子代与父代、中间变异体之间交换信息量的大小程度.r值越大, 包含新信息程度越大, 收敛速度较慢, 但有利于保存物种多样性; 反之, 如果r值偏小, 虽然收敛速度加快, 但会使种群的多样性快速减小, 不利于全局寻优.

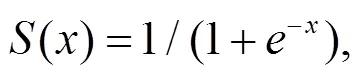

本文设计的自适应交叉概率可根据每个个体与当代整体水平的关系进行调整, 对优秀个体的性状更加宽容, 能够兼顾收敛速度和种群多样性.r的计算公式为:

4.1.2 寻优性能验证

为了测试本文提出的改进算法(-r-DE)的收敛性能和逃出马鞍点能力, 将-r-DE算法与标准差分进化算法(DE)以及自适应交叉因子的DE算法(r-DE)进行仿真结果对比. 实验参数设置为: 粒子种群大小Z=20, 最大迭代次数max=500, 搜索区间为[-10,10].

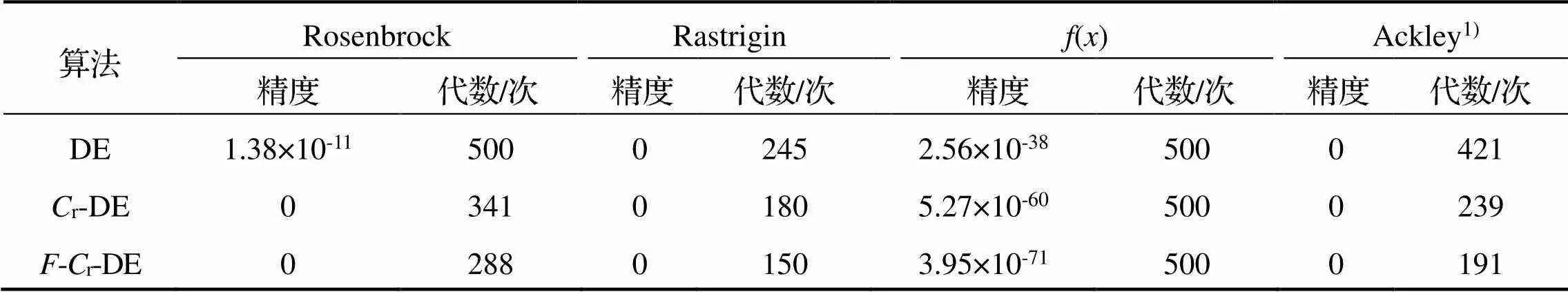

表2 3种算法在不同适应度函数下的收敛精度

注: 1)Ackley函数因Python计算精度原因, 在0处仍出现-4.44×10-16的误差, 因此认为当迭代出现相应精度时, 误差为0.

选取Rosenbrock、Rastrigin、()和Ackley测试函数[26], 这些函数存在众多局部最小值区域, 且均存在最小值(0). 分别用上述函数进行标准DE算法、rDE算法以及r-DE算法试验对比, 结果见表2.

由表2可知, 当差分进化进行迭代时, DE算法更容易陷入局部最优的马鞍点且难以逃离, 导致算法收敛性能较弱.r-DE算法对于优秀的个体降低采纳标准, 可以显著提高进化过程的收敛速度.-r-DE算法增强了防止越过最优值的性能, 随着代数次数的增加逐渐减小变异因子. 但只通过代数的增长进行衰减不能反映数据衰减的特性, 不能紧跟适应度的减少调整变异幅度. 通过Sigmoid函数缩放两代之间的适应度, 用差值进一步减小取值, 匹配空间搜索速度, 可显著减小寻找最优值所需的步数.

r-DE算法和-r-DE算法比DE算法精度有显著提升. 以寻优精度达到0为前提, 在寻优步数方面,-r-DE算法收敛时的迭代次数比r-DE算法与DE算法平均减少了16.7%与38.7%; 在精度方面,-r-DE算法始终能搜寻到3种方案中的最优值. 因此,-r-DE算法在适应度函数的寻优步数和精度上均有优势, 其交叉因子和变异因子的自适应改进均有效.

4.2 基于k-means聚类和自适应DE算法的支持向量回归(SVR)梭子蟹体质量预测模型

4.2.1 数据来源

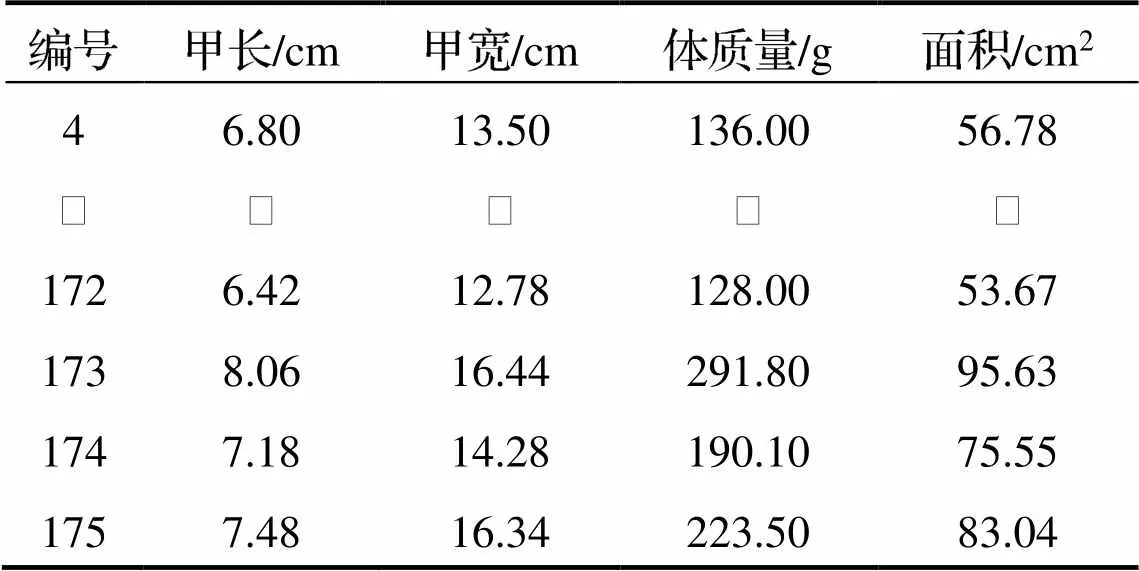

用于体质量预测的梭子蟹特征数据来自宁波大学智慧养殖实验室. 样本为带有体质量标签的175只梭子蟹养殖图像, 详见表3. 经改进Mask RCNN方法提取样本梭子蟹甲长、甲宽、面积3个视觉特征作为训练特征, 对应的体质量信息作为预测目标.

表3 原始数据

续表

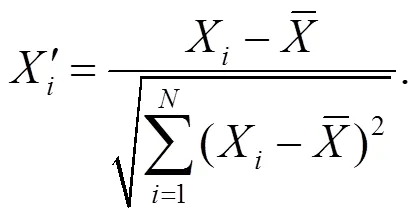

4.2.2 样本的-means聚类

-means聚类是在给定个初始中心点情况下, 把每个点分到离其最近的簇中心点所代表的簇中, 所有点分配完毕后, 再根据一个簇内的所有点重新计算该簇的中心点, 然后再迭代进行分配点和更新簇中心点, 直至簇中心点的变化很小, 或者达到指定的迭代次数.

在对数据进行聚类前, 为排除3个坐标尺度不同对聚类产生的影响, 根据式(17)分别将3个视觉参数归一化到[0,1]区间, 其中X和分别表示归一化前后的视觉参数,为个数据点的平均数.

数据依个中心聚类结果显示: 当=1时, 梭子蟹体质量分布散乱, 数据标准差为52.83; 将设为2时, 两类数据标准差都有所减少, 一类甲宽较大, 且甲壳面积较突出, 基本分布在200g以上, 命名为“宽大型”, 其标准差为28.76; 另一类相比前类甲宽较小, 甲壳面积也较小, 命名为“窄小型”,其标准差为50.77; 将设为3时, 原先窄小和宽大型数据在150g左右的交界区域又细分出新型数据, 依照分类自变量可将新聚类中心命名为“方正型”, 表现出甲宽较短、甲长较长的特征, 围成的面积更大, 新聚类中心的生成使3组数据的标准差都有所下降, 分别为22.9、43.59和28.45, 但考虑到“方正型”与另外2类区别不显著, 且3次聚类后“宽大型”数据量过少, 预测时会出现过拟合现象, 综合考虑选择=2.

当=2时, 梭子蟹按照生长程度自发归成2类, 符合自然生物规律. 聚类后可以更有效地区分同一批梭子蟹由外形尺寸的权重不同导致的体质量预测差异, 每一组归属于不同聚类中心的数据都有各自的预测模型, 模型的准确性相应提高.

4.2.3 聚类优化SVR预测结果分析

SVR是支持向量机一个重要的应用分支, SVR通过寻找使所有的样本点总偏差最小的最优超平面实现参数回归.

将参数应用到SVR模型中, 对新传入来自2个聚类中心的25个测试集样本点归一化后, 判断所归属的聚类中心, 再传入相应的预测模型进行回归, 得出预测体质量值, 预测体质量与实际体质量对比结果如图8所示.

计算预测值与真实值之间的相对误差, 并与原始SVR模型、聚类后的原始SVR模型和BP神经网络模型进行对比, 其中BP神经网络采用6隐藏节点数目, epoch设为50, 隐含层转移函数: tansig, 输出层转移函数: purelin, 训练函数: traninbr, 最大训练次数设为1000, 目标最小误差设为0.00001,学习速率设为0.0001.

图9为各模型预测结果. 从图9可知, 优化算法可以有效找到拟合效果最好的参数, 提高预测精度, 相比未改进算法其相对误差显著减小, 误差峰值基本保持在20%以下.

图8 改进模型预测体质量与实际体质量对比

图9 各模型预测结果对比

通过图9与表4可看出, 虽然BP神经网络和聚类优化后的支持向量机都表现出较好的预测性能, 最大相对误差都未超过20%, 但未经聚类的算法由于损失函数针对2个聚类中心的不同特征, 旨在建立对2个中心共同的最小误差模型, 因此其误差损失波动性较大, 且对任一样本点的预测都有均衡偏差, 如图9中SVR和BP神经网络曲线, 其整体趋势基本围绕在轴上下, 但波动较强; 对比聚类后, 由于后者能够分别学习到不同样本簇的特征, SVR均方误差降低了5.8g, 聚类+优化SVR均方误差性能超越BP神经网络, 在4类算法中表现最优. 由此可验证, 2类样本尺寸-体质量模型并不相同, 若用单一模型进行预测难以找到统一的优化指标和回归曲线, 无法得到最佳性能.

从预测精度看, 无论采用何种预测方法, 编号23样本总出现严重的负误差, 该体质量样本对应视觉样本编号77, 由于面积预测时过多受到遮挡, 视觉输出存在较大误差, 面积参数由Mask RCNN的掩码转换而来, 因而造成体质量预测错误, 这类现象可由补光优化进一步改进. 聚类+优化SVR的最大相对误差比BP神经网络和聚类+SVR分别低54%和3%; 对于均方根误差, 聚类+优化SVR的均方根误差最小, 即预测模型表现稳定. 总体而言, 聚类和差分进化算法符合梭子蟹尺寸及体质量回归预测多变量、多模型的特点, 可提高SVR的预测性能.

表4 模型预测误差比较

5 结语

本文采用CCD相机获取梭子蟹图像, 提出了模板匹配的改进Mask RCNN检测算法, 通过自适应选择缩放因子和交叉概率的差分进化算法优化支持向量回归, 实现了对梭子蟹体质量的预测, 测试效果良好.

计算机辅助蟹尺寸识别及其体质量预测可提高蟹工厂化养殖的自动化程度, 降低人工成本, 具有一定的应用价值. 但蟹厚度也会对蟹体质量造成影响, 因此在后续研究中将考虑采用双目视觉方案, 获取梭子蟹的厚度信息, 建立多元拟合模型, 以达到更精确的预测效果.

[1] 曹广斌, 蒋树义, 韩世成, 等. 工厂化水产养殖中的自动控制技术[J]. 水产学杂志, 2011, 24(1):60-64.

[2] 周显青, 孙儒泳, 牛翠娟. 应激对水生动物生长、行为和生理活动的影响[J]. 动物学研究, 2001, 22(2):154- 158.

[3] Mathiassen J R, Misimi E, Bondø M, et al. Trends in application of imaging technologies to inspection of fish and fish products[J]. Trends in Food Science & Technology, 2011, 22(6):257-275.

[4] 段延娥, 李道亮, 李振波, 等. 基于计算机视觉的水产动物视觉特征测量研究综述[J]. 农业工程学报, 2015, 31(15):1-11.

[5] Zion B. The use of computer vision technologies in aquaculture – A review[J]. Computers and Electronics in Agriculture, 2012, 88:125-132.

[6] 周莉莉, 姜枫. 图像分割方法综述研究[J]. 计算机应用研究, 2017, 34(7):1921-1928.

[7] Viazzi S, van Hoestenberghe S, Goddeeris B M, et al. Automatic mass estimation of Jade perchby computer vision[J]. Aquacultural Engineering, 2015, 64:42-48.

[8] 王文静, 徐建瑜, 吕志敏, 等. 基于机器视觉的水下鲆鲽鱼类质量估计[J]. 农业工程学报, 2012, 28(16):153- 157.

[9] 张超, 徐建瑜, 王文静. 基于机器视觉的梭子蟹质量估计方法研究[J]. 宁波大学学报(理工版), 2014, 27(2):49- 51.

[10] 姚霆, 张炜, 刘金根. 基于深度学习的图像分割技术[J]. 人工智能, 2019, 6(2):66-75.

[11] 骆桂兰, 陈军, 王会聪, 等. 水产养殖过程中计算机视觉的应用[J]. 畜牧与饲料科学, 2017, 38(12):91-92.

[12] 房永峰. 基于深度学习的牲畜目标检测与跟踪算法研究[D]. 合肥: 中国科学技术大学, 2019.

[13] Redmon J, Divvala S, Girshick R, et al. You only look once: Unified, real-time object detection[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2016:779-788.

[14] 赵德安, 刘晓洋, 孙月平, 等. 基于机器视觉的水下河蟹识别方法[J]. 农业机械学报, 2019, 50(3):151-158.

[15] Girshick R, Donahue J, Darrell T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]//2014 IEEE Conference on Computer Vision and Pattern Recognition, 2014:580-587.

[16] He K M, Sun J, Tang X O. Single image haze removal using dark channel prior[C]//2009 IEEE Conference on Computer Vision and Pattern Recognition, 2009:20-25.

[17] 王静安, 陈开健, 刘小燕, 等. 大通湖水域河蟹体长、体重及头胸甲关系研究[J]. 湖南文理学院学报(自然科学版), 2017, 29(1):35-39.

[18] 张超. 计算机视觉技术在梭子蟹养殖中的应用研究[D]. 宁波: 宁波大学, 2014.

[19] 唐杨捷, 胡海刚, 张刚, 等. 基于计算机视觉和GA- SVM的梭子蟹体重预测[J]. 宁波大学学报(理工版), 2019, 32(1):32-37.

[20] 陈军. 基于机器视觉的汽车油泵支撑杆尺寸实时检测系统[D]. 杭州: 浙江大学, 2017.

[21] Ren S Q, He K M, Girshick R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6):1137-1149.

[22] 高保全, 刘萍, 李健, 等. 三疣梭子蟹形态性状对体重影响的分析[J]. 海洋水产研究, 2008, 29(1):44-50.

[23] 高天龙, 王燕飞, 鲍雪宁, 等. 单体筐养三疣梭子蟹的蜕壳与生长规律研究[J]. 生物学杂志, 2016, 33(3):41- 46.

[24] 高岳林, 刘军民. 差分进化算法的参数研究[J]. 黑龙江大学自然科学学报, 2009, 26(1):81-85.

[25] 颜学峰, 余娟, 钱锋, 等. 基于改进差分进化算法的超临界水氧化动力学参数估计[J]. 华东理工大学学报(自然科学版), 2006, 32(1):94-97; 124.

[26] 纪震, 廖惠连, 吴青华. 粒子群算法及应用[M]. 北京: 科学出版社, 2009:74-78.

Weight estimation of non-contact swimming crabs based on improved Mask RCNN and SVR

TANG Chao1, HU Haigang1*, SHI Ce2, QIAN Yunxia2

( 1.Faculty of Maritime and Transportation, Ningbo University, Ningbo 315832, China; 2.School of Marine Science, Ningbo University, Ningbo 315832, China )

The data of farmed crabs mainly rely on manual measurement, which is both labor intensive and resource wasting. In this paper, an improved Mask RCNN size measurement algorithm is proposed, and the original Mask based on probability output from Mask RCNN is modified according to the template obtained in advance to achieve more accurate size estimation. First, crab images are captured by using cameras, which are then segmented with the Mask RCNN algorithm. After applying a second-order moment algorithm on the mask, the template is transferred and rotated into the center of the original mask, and the corresponding part is modified by adding and subtracted benefits, so as to obtain a more accurate image of the carapace. The real size of the crab is converted through the image-real scene mapping, and the area, width and length of the crab carapace are estimated with an accuracy of more than 85%. The size obtained by the visual algorithm is fitted to the weight of the swimming crab. In order to improve the matching degree of the model, the-means clustering is introduced to implement a dual-model support vector regression machine (SVR) prediction structure, which uses the differential evolution algorithm to optimize the fitness function of the SVR. In the test process, after normalizing the newly input data, the cluster center to which it belongs is first determined, and then the corresponding SVR model is applied for prediction. The test set results show that the relative error remains below 18%.

swimming crab; visual feature; weight; Mask RCNN; non-contact measurement

TP274

A

1001-5132(2021)02-0031-11

2020−05−18.

宁波大学学报(理工版)网址: http://journallg.nbu.edu.cn/

浙江省公益技术项目(2017C32014); 浙江省重点研发计划(2019C02055); 宁波市科技富民项目(2017C10006); 宁波市自然科学基金(2019A610424).

唐潮(1995-), 男, 江苏宿迁人, 在读硕士研究生, 主要研究方向: 计算机视觉. E-mail: 2906941684@qq.com

胡海刚(1966-), 男, 浙江舟山人, 高级实验师, 主要研究方向: 船舶工程安全技术与机电控制. E-mail: huhaigang@nbu.edu.cn

(责任编辑 史小丽)