基于DenseNet-Attention模型的高光谱图像分类

张永鹏,张春梅,白 静

基于DenseNet-Attention模型的高光谱图像分类

张永鹏,张春梅,白 静

(北方民族大学计算机科学与工程学院,宁夏 银川 750021)

针对高光谱图像标记样本量少,提取特征不充分以及提取到的特征不区分贡献度的问题,提出一个新型的DenseNet-Attention网络模型(DANet)。首先,该模型利用三维卷积核同步提取联合光谱空间特征,同时密集连接网络(DenseNet)的稠密连接块除了能够充分提取更加鲁棒的特征外,还减少了大量参数;其次,自注意力(self-attention)机制作为一个模块加入到稠密连接块中,可以使上层提取到的特征在进入下一层网络之前,经过该模块对其进行权重分配,使具有丰富的物类别信息的特征得到加强,进而区分特征的贡献度。网络模型以原始高光谱图像邻域块作为输入,无需任何预处理,是一个端对端学习的深度神经网络。在印第安松树林和帕维亚大学数据集上进行对比试验,网络模型的分类精度分别能够达到99.43%和99.99%,有效提高了高光谱图像分类精度。

三维卷积;高光谱图像分类;稠密网络;自注意力机制;残差连接

高光谱图像利用成像光谱仪以数十个、至数百个连续细分的波段对目标区域进行成像,形成以像素为单位的高维图像,凭借其丰富的空间和光谱信息,极大地提高了地物的区分能力,因此在农业、环境监测、城市规划等领域有着广泛的应用。由于高光谱数据的高维特性,训练模型需要大量的样本,才能保证良好的精度。但是高光谱数据样本量较少,训练得到的模型很容易产生休斯(Hughes)现象,即在高光谱分析的过程中,随着参与运算的波段数目的增加,分类精度先增后降的现象[1]。因此,高光谱的准确分类还面临着一系列的挑战。

近年来,由于深度神经网络强大的自动提取特征能力,包括卷积神经网络(convolutional neural network,CNN)在内的深度学习网络模型也逐步应用在高光谱图像分类领域。CHEN等[2-3]首先提出了一种融合空间和光谱特征的深度学习框架,该框架采用堆叠自编码器和深度置信网络作为特征提取器,来获取高级特征以获得分类结果。基于二维卷积核(2D-CNN)的方法需要分别在光谱和空间维度上提取信息,使得网络设计冗余复杂,且不能充分提取联合光谱和空间特征,导致部分信息丢失。使用三维卷积核(3D-CNN)可以有效地提取深度联合光谱-空间特征,以进行准确的高光谱图像(hyperspectral image,HSI)分类,而无需依赖任何预处理或后处理技术。CHEN等[4]提出了一种基于3D-CNN的深度特征提取网络,在高光谱分类领域为CNN及其扩展网络架构指出了方向。LI等[5]提出了一种用于准确的HSI分类的3D-CNN框架,并使用原始高光谱数据作为输入,有效地提取了融合的光谱空间特征。ZHONG等[6]提出了一种光谱-空间残差网络(spectral-spatial residual network,SSRN),该网络分别使用光谱和空间残差块从HSI的丰富光谱特征和空间信息中学习深层区别特征,但是光谱特征提取器和空间特征提取器使得网络设计冗余,训练时间过长。WANG等[7]为了减少训练时间并提高分类精度,提出一种端到端的快速密集光谱空间卷积模型(fast dense spectral–spatial convolution network framework,FDSSC),使用不同大小的卷积核,分别提取多尺度的空间和光谱特征,使得分类精度提高。HE等[8]利用多尺度卷积的策略,使用不同大小的3D-CNN在不同感受野上提取有效特征。郑姗姗等[9]使用3D-CNN对多尺度滤波器组和残差单元进行改进,提出了深度三维卷积神经网络(multi-scale 3D residual convolutional neural network,M3RCNN),可以有效提高分类精度。

尽管基于CNN的方法在HSI分类领域获得了很好的效果,但是仍然存在一些问题。首先,由于HSI样本较少,如何能够在数据量少的情况下提取出有效的特征,对于分类精度的提高有着至关重要的作用。其次,样本量少和神经网络的深度之间的平衡问题也必须考虑。最后,虽然各种特征提取器可以提取出良好的特征,但是提取出来的特征对于网络层各节点的贡献是均等的,如何区分特征的贡献度也是一个难题。

基于以上问题,本文引入了自注意力机制。自注意力机制会通过模型训练,让神经网络学习到图片中更加有效的信息。其原理是通过在图上附加权重矩阵,将图中的关键信息使用掩码来形成注意力。WANG等[10]借鉴了非局部均值滤波操作的思想,提出了可以嵌入到神经网络的非局部块(non-local block,NL Block),使用自注意力机制对远程依赖进行建模,融合了全局信息,而不是仅仅通过多层卷积来获得较大感受野的信息,为网络提供了丰富的语义信息,但是该网络的计算开销很大。HU等[11]提出了压缩-激励网络(squeeze-and-excitation networks,SENet),该模型通过对通道之间的相关性进行建模,统计图像的全局信息,获得了ImageNet2017分类比赛的冠军。然而SENet通过权值重标记来调整通道注意力,不能够充分利用全局上下文信息。CAO等[12]提出了全局上下文网络(global context network,GCNet),该网络将简化的NL Block和SENet相结合,在减少计算量的同时,充分利用全局上下文信息,从而得到很好的分类效果。WOO等[13]提出了卷积块注意力机制模块(convolutional block attention module,CBAM),该网络先后使用通道注意力模块和空间注意力模块,提供了更加精细的信息,有利于提升模型的表达能力。ROY等[14]对SENet进行改进,提出了空间通道压缩-激励模块(concurrent spatial and channel squeeze and channel excitation,scSE),该模块利用注意力机制增强有效特征,抑制无效特征,应用在图像分割领域,可以使分割边缘更加精细。魏祥坡等[15]将通道注意力机制和残差网络相结合,在高光谱图像数据集上取得较高的分类精度。

为了充分提取并利用对分类更加有效的特征,提高模型的性能,本文提出了一个适用于高光谱图像的分类模型,该模型基于密集连接的卷积网络,并且在其中融合了自注意力机制。密集连接的卷积网络缓解了梯度消失的问题,加强了特征传播,鼓励特征重用,并且大大减少了参数量,能够在数据量少的情况下提取出更加鲁棒的特征。同时,利用自注意力机制为提取到的特征分配权重,能够有效利用更加重要的特征,提高分类精度。

1 基本原理

本节主要介绍基于DenseNet-Attention模型的思想,包括密集卷积网络以及适用于高光谱图像分类的自注意力机制。最后,总体说明DenseNet-Attention的具体实现方法。

1.1 DenseNet

密集连接网络是残差网络的一种变体,残差网络[16]的连接机制是每层与其前面的一至两层通过逐元素相加的方式进行短路连接,即

而与其不同的是,DenseNet的连接机制是使所有的层都相互连接,每个层都会接受前面所有的层作为输入,并将每层特征图都在通道维度上进行连接,即

其中,x为第层输出;[0,1,···,x-1]为从输入层到-1层的特征图拼接;H(·)为非线性转化函数,该函数是一个包含BN层、ReLU层以及卷积层的组合操作。在DenseNet中,每层从前面所有层中获得额外的输入,并将其特征映射继续传递到后续所有的层。DenseNet前向传播如图1所示,每一层都能接收到来自前面所有层的特征信息,使得特征信息和梯度能够在网络中很好的传递,可以训练更深的模型,并且加强了特征重用。

图1 DenseNet前向传播图

DenseNet网络结构主要是由多个密集连接块(dense block)和过渡层(transition)组成[17]。各个dense block内的特征图大小保持统一,可以很方便地进行维度拼接。假设每层只产生个特征图,根据DenseNet的网络设计,那么第层的输入维度可表示为

其中,k0为输入层的通道数。由式(3)看出,如果特征图通道数不加限制,拼接后的数目较大。为了减少特征图数量,减少计算量,便于融合各个通道特征,在dense block中加入瓶颈层。dense layer结构如图2所示,在3×3卷积前面加入一个1×1的卷积操作,令其生成4K个特征图,极大的降低了特征图数量,压缩了模型参数,提升了计算效率。

对于过渡层,主要连接2个dense block,其中包含了一个1×1的卷积和2×2的平均池化,用以降低特征图大小。如果上一层的dense block输出个特征映射,过渡层可以生成个特征映射,其中0≤≤1称为压缩因子,当=1时,特征映射保持不变;当<1时,过渡层能够压缩模型。

在最后一个dense block执行结束后,由全局平均池化层(global average pooling,GAP)代替全连接层,输入到softmax分类器中进行分类,大大减少了参数量,也缓解了由于全连接层引起的过拟合现象。

1.2 self-attention机制

计算机视觉领域中的注意力机制的基本思想是让网络能够在众多特征中忽略无关信息从而关注到对当前任务重要的特征信息[18]。注意力机制分为软注意力机制和强注意力机制,由于强注意力机制是不可微的注意力,需通过增强学习等策略进行训练,而软注意力机制是可微分的,可以在训练过程中使用梯度下降算法来更新网络参数,自注意力机制就是其中的一种。

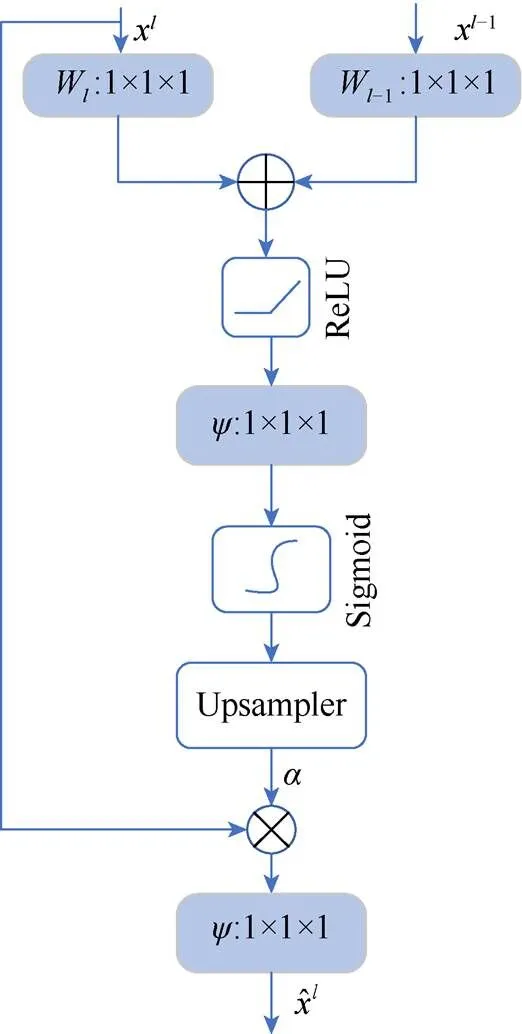

自注意力机制使用带有权重参数的掩码(mask)来形成注意力。利用特征图自主学习权重分布,再用学习得到的权重施加在特征上,使对分类任务贡献度大的特征得到加强,抑制了贡献度小的特征。本文提出了改进的自注意力方法应用于高光谱图像分类。改进的自注意力方法如图3所示。

图3 DenseNet-Attention模型结构

由图3可知,层输出和-1层输出的特征图经过1×1×1卷积进行线性映射,来压缩通道,分别得到W和W-1特征,然后二者逐元素相加,经过ReLU函数、1×1×1卷积和sigmoid操作,生成一个权重图,称之为注意力系数,即

1.3 DenseNet-Attention模型

由于高光谱图像高维的特性,使用2D-CNN来提取光谱空间特征需要很多复杂、冗余的计算。而3D-CNN能够同时在空间和光谱维度进行卷积,在保留原有网络模型的同时能够充分提取联合光谱空间特征,从而解决了这个问题。本文将三维卷积、稠密连接网络和自注意力机制结合起来,提出一种适合高光谱图像分类的网络模型。该模型如图4所示,将高光谱图像切割成××大小的邻域块作为网络的输入,先经过一层卷积操作提取浅层的特征,然后进入dense block,为了平衡网络的深度和复杂性与高光谱图像样本量少的矛盾,在每个dense block中有3个dense layers作为特征提取器。与ZHANG等[19]不同的是,本文在2个dense layers之间加入了自注意力机制模块,来自前2层的特征图都要经过该模块计算之后才能作为下一层的输入,为特征分配权重。之后再进入到过渡层,对特征图下采样,并压缩模型参数数量。最后一个dense block后面连接的是代替全连接层的GAP层,其对每一个特征图求均值,直接赋予每个通道的类别标签,经过softmax完成对高光谱图像的分类。全局平均池化层在减少参数量的同时能够对整个网络结构做正则化防止过拟合。以上所有的卷积层都有BN层和非线性激活函数ReLU连接,分类采用交叉熵损失函数。

图4 改进的Self-attention结构图

2 实验结果与分析

本次实验所采用的计算机硬件环境为一块Tesla V100显卡、32 GB内存,软件环境为pycharm、Keras 2.1.6、TensorFlow1.12。系统环境为Centos 7.0。为了验证该模型的有效性,在2个真实的高光谱图像数据集上进行了测试:印第安松树数据集和帕维亚大学数据集。本文采用平均分类精度AA (average all,AA)、总体分类精度(over all,OA)和Kappa系数对模型结果进行评估。

2.1 数据集介绍

Indian Pines是最早的用于高光谱图像分类的测试数据,由机载可视红外成像光谱仪(airborne visible infrared imaging spectrometer,AVIRIS)于1992年对美国印第安纳州一块印度松树进行成像,图像尺寸为145×145。AVIRIS成像光谱仪成像波长范围为0.4~2.5 μm,在连续的220个波段对地物连续成像,但是由于第104~108、第150~163和第220个波段不能被水反射,因此,一般使用的是剔除了这20个波段后剩下的200个波段作为研究的对象。该光谱成像仪所成的图像的空间分辨率约为20 m,因此,较容易产生混合像元,给分类带来难度。该数据总共有21 025个像素,但是其中只有10 249个像素是地物像素,其余10 776个像素均为背景像素。在实际分类中,该像素是需要剔除的,由于截取的这块区域均是植物,总共有16类,因此不同的地物具有较为相似的光谱曲线,而且16类中样本的分布极不均匀。Pavia University数据是由德国的机载反射光学光谱成像仪(Reflective Optics SpectrographicImaging System,ROSIS-03)在2003年对意大利的帕维亚城所成像的一部分。该光谱成像仪对0.43~0.86 μm波长范围内的115个波段连续成像,所成图像的空间分辨率为1.3 m。其中12个波段由于受噪声影响被剔除,因此一般使用的是剩下103个光谱波段所成的图像。该数据的尺寸为610×340,共包含2 207 400个像素,但是其中包含大量的背景像素,包含地物的像素总共只有42 776个,共包含9类地物,包括树、沥青道路(asphalt)、砖块(bricks)、牧场(meadows)等。

2.2 实验结果与分析

本次实验的训练集、验证集和测试集的划分比例为2∶1∶7,训练样本是在每个样本中随机按比例选取得到的,剩余的样本用于验证和测试。学习率为0.001,一共运行150个Epoch,采用梯度下降算法对参数进行更新,优化器采用Adam[20]。

2.2.1 邻域参数设置

对于高光谱遥感图像,空间邻域信息对分类精度的影响很大[21]。本文将在数据集上分别测试不同空间邻域对分类精度的影响。

从表1中可以看出,对于印第安松树林数据集,随着空间邻域尺寸的增加,在空间邻域达到15×15时,精度达到最高,随后开始下降。所以对于印第安数据集来说,选择空间邻域大小为15×15的数据立方体作为网络的输入。

表1 不同空间邻域输入精度对比

对于帕维亚大学数据集来说,由于该数据集的地物面积较大,所以采取一个大的空间邻域更加有利于保存一类物体的空间特征信息。从表2中可以看出,在空间邻域大小为19×19时,各项评估精度达到最佳,因此对于帕维亚大学数据集选择空间邻域大小为19×19的数据立方体作为网络的输入。

表2 不同空间邻域输入精度对比

2.2.2 实验结果

为了得到更好的空间位置信息,提高分类精度,对于Indian Pines数据集,网络的输入为15×15×200大小的立方体数据;对于Pavia University数据集,采用19×19×103的立方体数据作为网络输入。

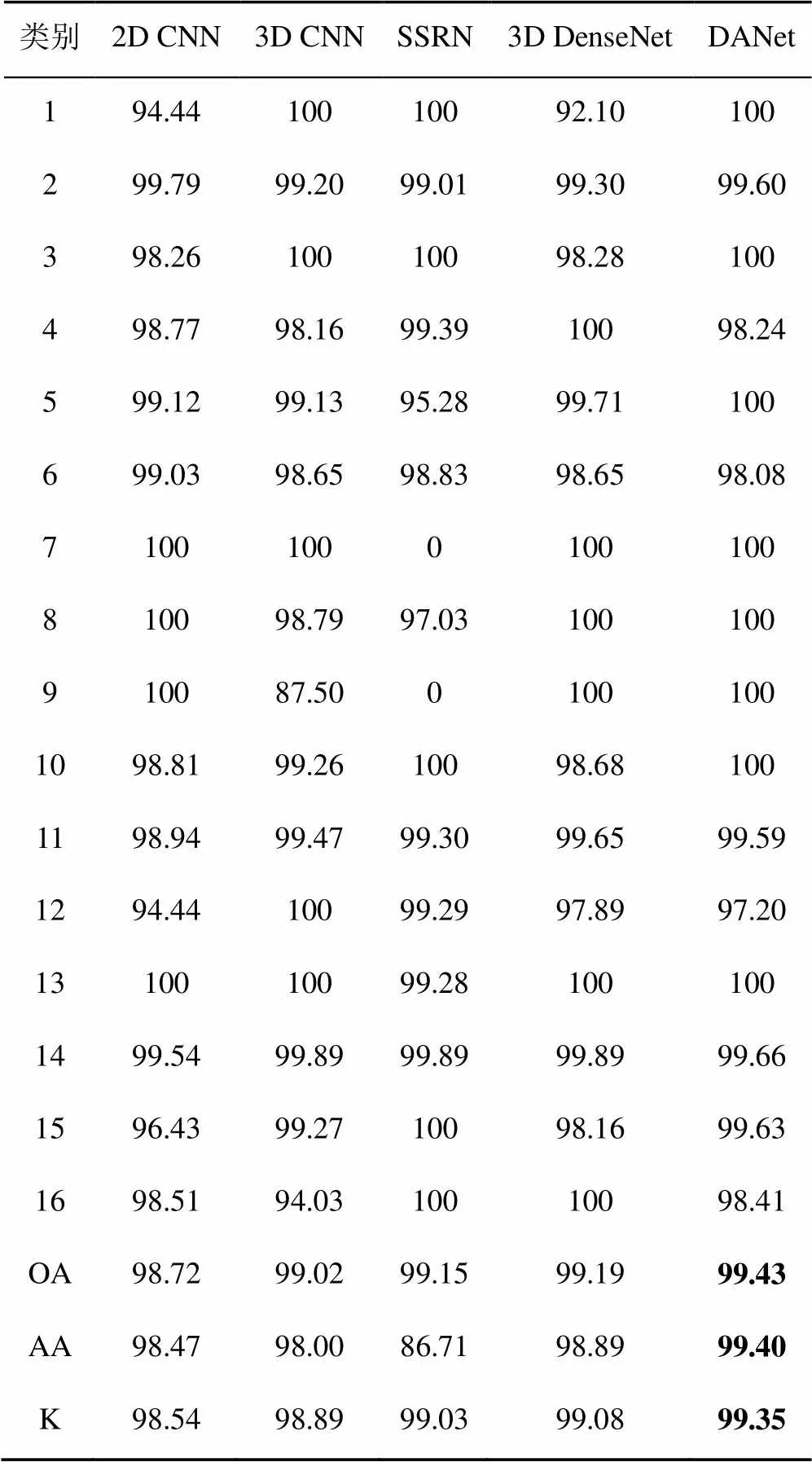

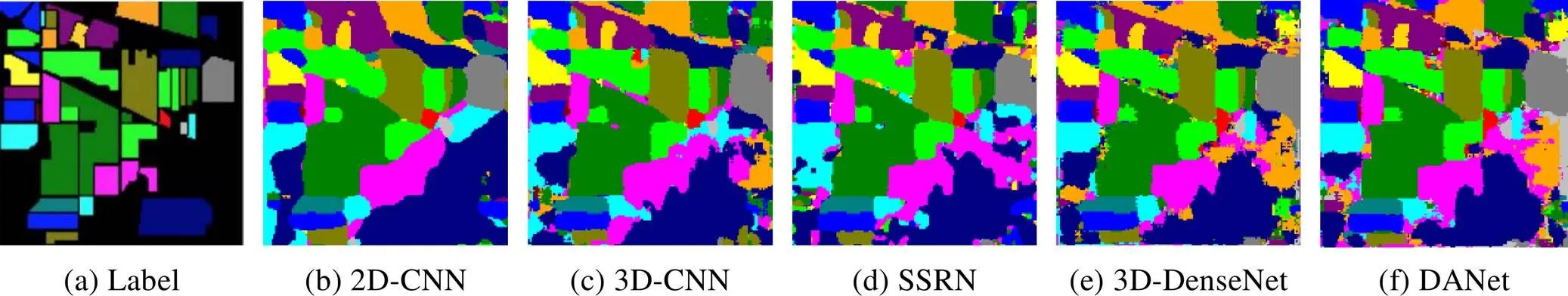

为了验证试验的有效性,本文和2D-CNN[22],3D-CNN[4],SSRN[6],3D-DenseNet[19]高光谱分类网络进行了试验对比。为了保证公平性,所有实验都在相同的实验环境中进行,以上所提及到的对比方法的网络参数与原始论文相同。2种数据集的实验分类结果见表3和表4,分类效果及标签图如图5和图6所示。

表3 Indian Pines数据集分类精度(%)

表4 Pavia University数据集分类精度(%)

2.2.3 实验结果分析

由表3和表4可以看出,本文提出的DANet模型效果是5种模型中最好的。对于Indian Pines数据集,SSRN无法分类出第7类和第9类地物,导致总体精度高,但是平均精度低,因为这2类地物的数据量很少,分别只有28个和20个像素,体现了SSRN对于小样本的地物分类不稳定。3D DenseNet与3D CNN相比,OA,AA,Kappa系数分别提升了0.71%,0.89%,0.19%。3D DenseNet与SSRN相比,OA,AA,Kappa系数分别提升了0.04%,12.18%,0.02%。由此说明,密集连接比残差连接可以更好地加深模型深度,提取更加深层、更加全面的特征,提高分类精度。本文提出的DANet和3D DenseNet相比,OA,AA,Kappa系数分别提升了0.24%,0.51%,0.27%。由此可以看出,通过采用自注意力机制为不同的特征赋予不同的权重,选取更加有效的特征,有效地利用更具有信息量的特征,从而提高网络的特征提取能力,具有更好的泛化能力。对于Pavia University 数据集,由于该数据集相对于Indian Pines数据集样本量要大一些,所以无论哪种方式分类精度都比较高。但总体而言,DANet的OA值达到了99.99%,比2D-CNN,3D-CNN,SSRN,3D-DenseNet分别提高了0.25%,0.11%,0.05%,0.04%。模型的平均分类精度也达到了99.96%,实现了最好的分类精度,且分类效果稳定。在表3和表4中还可以发现一个直观的现象,基于3D CNN的4种模型比2D CNN模型分类精度都要高,主要因为对于高维的高光谱图像来说,3D卷积能同时充分提取联合光谱空间特征,利用更多的光谱-空间特征进行网络训练,从而提高模型的分类精度。由对应的分类效果图(图5~6)可以看出,本文的分类效果图更加精确且同质区域噪点少。

图5 Indian Pines标签和分类结果图

图6 Pavia University标签和分类结果图

3 结 论

针对高光谱图像标记样本量少和现阶段适用于高光谱分类的神经网络提取特征不充分的问题,提出一个新型的、改进的DenseNet-Attention网络模型,其中3D-CNN用来同时提取光谱-空间联合特征,DenseNet用来提取更加鲁棒的特征,加入的自注意力机制模块用来为特征赋予对应权重,使具有丰富地物类别信息的特征得到加强,进而区分特征的贡献度。实验结果证明,本文所提出的模型性能明显优于2D-CNN,3D-CNN,SSRN,3D-DenseNet,拥有更强的特征表达能力,提高了分类精度。后续研究可以考虑将其与半监督方法或者自监督学习方法结合,利用少量训练样本来提高分类精度。

[1] 杨哲海, 李之歆, 韩建峰, 等. 高光谱中的Hughes现象与低通滤波器的运用[J]. 测绘学院学报, 2004, 21(4): 253-255, 258. YANG Z H, LI Z Q, HAN J F, et al. The hughes phenomenon in hyperspectral analysis and the application of the lowpass Filter[J]. Journal of Institute of Surveying and Mapping, 2004, 21(4): 253-255, 258 (in Chinese).

[2] CHEN Y S, LIN Z H, ZHAO X, et al. Deep learning-based classification of hyperspectral data[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2014, 7(6): 2094-2107.

[3] CHEN Y S, ZHAO X, JIA X P. Spectral–spatial classification of hyperspectral data based on deep belief network[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2015, 8(6): 2381-2392.

[4] CHEN Y S, JIANG H L, LI C Y, et al. Deep feature extraction and classification of hyperspectral images based on convolutional neural networks[J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(10): 6232-6251.

[5] LI Y, ZHANG H K, SHEN Q. Spectral–spatial classification of hyperspectral imagery with 3D convolutional neural network[J]. Remote Sensing, 2017, 9(1): 67.

[6] ZHONG Z L, LI J, LUO Z M, et al. Spectral–spatial residual network for hyperspectral image classification: a 3-D deep learning framework[J]. IEEE Transactions on Geoscience and Remote Sensing, 2018, 56(2): 847-858.

[7] WANG W J, DOU S G, JIANG Z M, et al. A fast dense spectral–spatial convolution network framework for hyperspectral images classification[J]. Remote Sensing, 2018, 10(7): 1068.

[8] HE M Y, LI B, CHen H H. Multi-scale 3D deep convolutional neural network for hyperspectral image classification[C]//2017 IEEE International Conference on Image Processing. New York: IEEE Press, 2017: 3904-3908.

[9] 郑姗姗, 刘文, 单锐, 等. 基于改进多尺度三维残差网络的高光谱图像分类[EB/OL]. [2020-01-14]. https:// kns.cnki.net/kcms/detail/detail.aspx?dbcode=CAPJ&dbname=CAPJLAST&filename=JSJC20200110003&v=fpDLQvPDFGfUcjKDeQEH1EP7nY%25mmd2BxPjPlPKisOI0N9WdEhYW124R48nVMINfyipsA. ZHENG S S, LIU W, SHAN R, et al. Hyperspectral Image Classification Based on Improved Multi-Scale 3D Residual Network[EB/OL]. [2020-01-14]. https:// kns.cnki.net/kcms/detail/detail.aspx?dbcode=CAPJ&dbname=CAPJLAST&filename=JSJC20200110003&v=fpDLQvPDFGfUcjKDeQEH1EP7nY%25mmd2BxPjPlPKisOI0N9WdEhYW124R48nVMINfyipsA (in Chinese).

[10] WANG X L, GIRSHICK R, GUPTA A, et al. Non-local neural networks[C]//2018 IEEE Conference on Computer Vision and pattern recognition. New York: IEEE Press, 2018: 7794-7803.

[11] HU J, SHEN L, ALBANIE S, et al. Squeeze-and- excitation networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2020, 42(8): 2011-2023.

[12] CAO Y, XU J R, LIN S, et al. Gcnet: non-local networks meet squeeze-excitation networks and beyond[C]//2019 IEEE/CVF International Conference on Computer Vision Workshops. New Yoek: IEEE Press, 2019: 1971-1980.

[13] WOO S, PARK J, LEE J Y, et al. Cbam: convolutional block attention module[C]//2018 European Conference on Computer Vision. Heidelberg: Springer, 2018: 3-19.

[14] ROY A G, NAVAB N, WACHINGER C. Concurrent spatial and channel ‘squeeze & excitation’in fully convolutional networks[C]//2018 International Conference on Medical Image Computing and Computer-Assisted Intervention. Heidelberg: Springer, 2018: 421-429.

[15] 魏祥坡, 余旭初, 管凌霄. 利用残差通道注意力网络的高光谱图像分类[J]. 测绘科学技术学报, 2019, 36(2): 161-166, 172. WEI X P, YU X C, GUAN L X. Hyperspectral image classification using residual channel attention network[J[. Journal of Geomatics Science and Technology, 2019, 36(2): 161-166, 172 (in Chinese).

[16] HE K M, ZHANG X Y, REN S Q, et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2016: 770-778.

[17] HUANG G, LIU Z, VAN DER MAATEN L, et al. Densely connected convolutional networks[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2017: 4700-4708.

[18] WANG F, JIANG M Q, QIAN C, et al. Residual attention network for image classification[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2017: 3156-3164.

[19] ZHANG C J, LI G D, DU S H, et al. Three-dimensional densely connected convolutional network for hyperspectral remote sensing image classification[J]. Journal of Applied Remote Sensing, 2019, 13(1): 016519.

[20] KINGMA D P, BA J. Adam: a method for stochastic optimization[EB/OL]. [2019-10-17]. https://arxiv.org/ abs/1412.6980.

[21] AUDEBERT N, SAUX L B, LEFEVRE S. Deep learning for classification of hyperspectral data: a comparative review[J]. IEEE Geoscience and Remote Sensing Magazine, 2019, 7(2): 159-173.

[22] YUE J, ZHAO W Z, MAO S J, et al. Spectral–spatial classification of hyperspectral images using deep convolutional neural networks[J]. Remote Sensing Letters, 2015, 6(6): 468-477.

DenseNet-attention for hyperspectral remote sensing image classification

ZHANG Yong-peng, ZHANG Chun-mei, BAI Jing

(School of Computer Science and Engineering, North Minzu University, Yinchuan Ningxia 750021, China)

A new neural network, called DenseNet-Attention (DANet), was proposed in this paper for hyperspectral images classification to solve the problems of small sample quantity, insufficient features extraction, and indiscriminating contribution of the extracted features. First, it employed the three-dimensional convolution kernel to simultaneously extract both spectral and spatial features. Meanwhile, due to its dense blocks, DenseNet can not only fully extract more robust features, but reduce a large number of parameters. Second, the self-attention mechanism was added to the dense block as a module. Before the extracted feature was passed into the next layer of network, the weight was assigned to the feature according to its contribution through this model, thus strengthening the representation of the feature with ground object information. DANet was an end-to-end deep learning framework, which took the neighborhood block of the original hyperspectral image as an input without any preprocessing. Comparative experiments on Indian Pines and Pavia University datasets show that the classification accuracy of the network model proposed in this paper can reach 99.43% and 99.99% respectively, effectively enhancing the classification accuracy of hyperspectral images.

three-dimensional convolution; hyperspectral remote sensing image classification; DenseNet; self-attenrion; skip connect

TP 391

10.11996/JG.j.2095-302X.2020060897

A

2095-302X(2020)06-0897-08

2020-07-19;

2020-08-01

19 July,2020;

1 August,2020

国家自然科学基金项目(61461002,61762003);宁夏回族自治区重点研发计划项目(2019BDE03011);宁夏高等学校一流学科建设项目(电子科学与技术学科) (NXYLXK2017A07)

National Natural Science Foundation of China (61461002, 61762003);Key Research and Development Project of Ningxia Hui Autonomous Region (2019BDE03011); Ningxia University First-Class Discipline Construction Project (Electronic Science and Technology) (NXYLXK2017A07)

张永鹏(1996–),男,山东德州人,硕士研究生。主要研究方向为计算机视觉与模式识别。E-mail:darrenzhang1007@163.com

ZHANG Yong-peng (1996-), male, master student. His main research interests cover computer version and pattern recognition. E-mail:darrenzhang1007@163.com

张春梅(1964–),女,宁夏银川人,教授,硕士。主要研究方向为视觉信号处理。E-mail:chunmei66@hotmail.com

ZHANG Chun-mei (1964-), female, professor, master. Her main research interest covers computer version and signal processing. E-mail:chunmei66@hotmail.com