基于双显微视觉的光刻版位姿定位算法

吕红阳, 陈立国, 仲丁元, 薛立伟

(苏州大学机电工程学院机器人与微系统研究中心, 苏州 215021)

在机械工程、微电子、液晶显示器(liquid crystal display, LCD)等行业的产品制造和检测过程中,实现零部件的精密定位与对准工序是必不可少的一步。统计数据显示,在电子制造业,52%~71%的电子元器件故障和缺陷与视觉对位过程相关[1]。因此高精度自动对位系统是现代工业发展的基础,也是国家制造业水平的重要标志之一。伴随着微米、纳米级工艺的发展,元器件引脚尺寸及蚀刻线路宽度逐步降低至微纳米级,而相应基底工件如电路板、光刻板的尺寸却逐步增大[2],传统的定位对准方式如人工式、机械式和电感应式等,均存在定位精度底、对位精度低的缺点,已无法满足日益增长的精度要求[3]。因此,如何实现基底工件的跨尺度级高精度定位与对准已成为精密加工与检测现场的难点。

显微视觉作为机器视觉在微观领域的拓展,具有非接触、检测精度高、稳定性好等优点,已被诸多学者应用于微机电制造、生物医药、集成电路等领域[4]。Agnus等[5]设计一套基于双显微视觉的自动化装配系统,视觉模块包括光轴垂直分布的显微相机及光轴与Z轴成45°夹角的侧视显微视觉。Chen等[6]构建远心双目微视觉系统、设计快速高精度图像处理算法,完成两光纤5自由度精密对接。郉泽惠[7]基于企业需求,利用双相机系统与UVW平台完成触摸屏与柔性印刷线路板(flexible printed circuit board,FPCB)的对位贴合。可见,基于显微视觉引导的快速高精度对位成为解决基底工件跨尺度对位困难的有效手段,而具有质量检测和定位作用的视觉系统及图像算法是影响对位精度的关键。

现搭建基于双显微视觉的高精度对位系统,通过相机阵列,解决了显微视觉视场、景深与分辨率间的固有矛盾;通过对光刻版工件两端进行局部位姿检测,获取其与参考工件之间的整体位姿偏差,解决基底工件跨尺度高精度自动对位的难点,促进国内视觉对位设备的发展具有重要的现实意义。算法首先通过优化Canny算子并基于多项式插值细分完成亚像素级边缘轮廓提取;然后基于RANSAC算法对离散边缘点进行直线拟合,求取左右相机图像中“Mark”标志中心点位置坐标及偏转角度;进而推导局部位姿间数学关系,获取光刻版工件在左相机坐标系下的整体位姿偏差。最后基于所建立的双显微视觉实验系统获取光刻版对位图像,对改进Canny算法、亚像素细分算法的边缘定位精度,光刻版工件的移动位姿获取精度与稳定性进行了实验分析。

1 系统总体设计

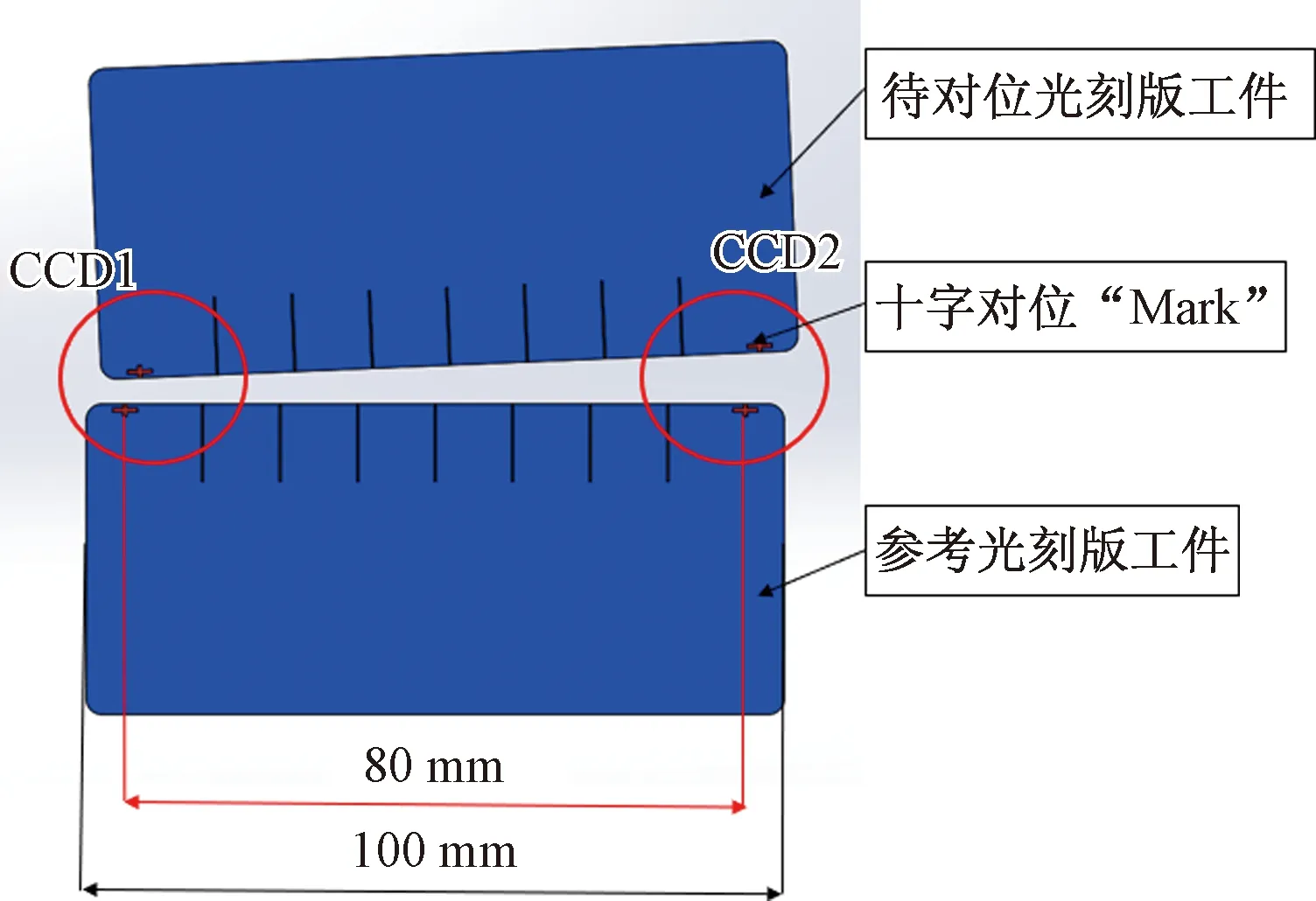

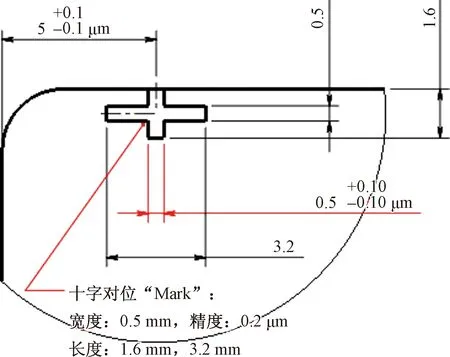

系统的检测对象为光刻版工件,对位原理示意图如图1所示,两侧“Mark”标志细节如图2所示。在精密加工领域,一般光刻版蚀刻线路线宽0.1 mm,若要求两侧光刻版蚀刻线路有90%以上重合度,则平移对位精度要求为±5 μm,旋转对位精度要求为±0.02°,而视觉检测精度则需达±1 μm。视觉对位的目的就是令参考光刻版工件和待对位工件两侧的“Mark”标志中心分别重合,从而保证两个光刻板上的蚀刻线路能一一对齐。

图1 光刻版对位示意图

图2 光刻版参考标记细节图

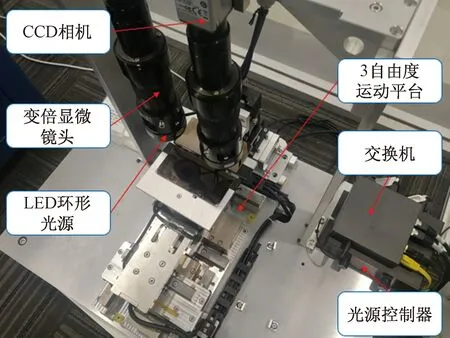

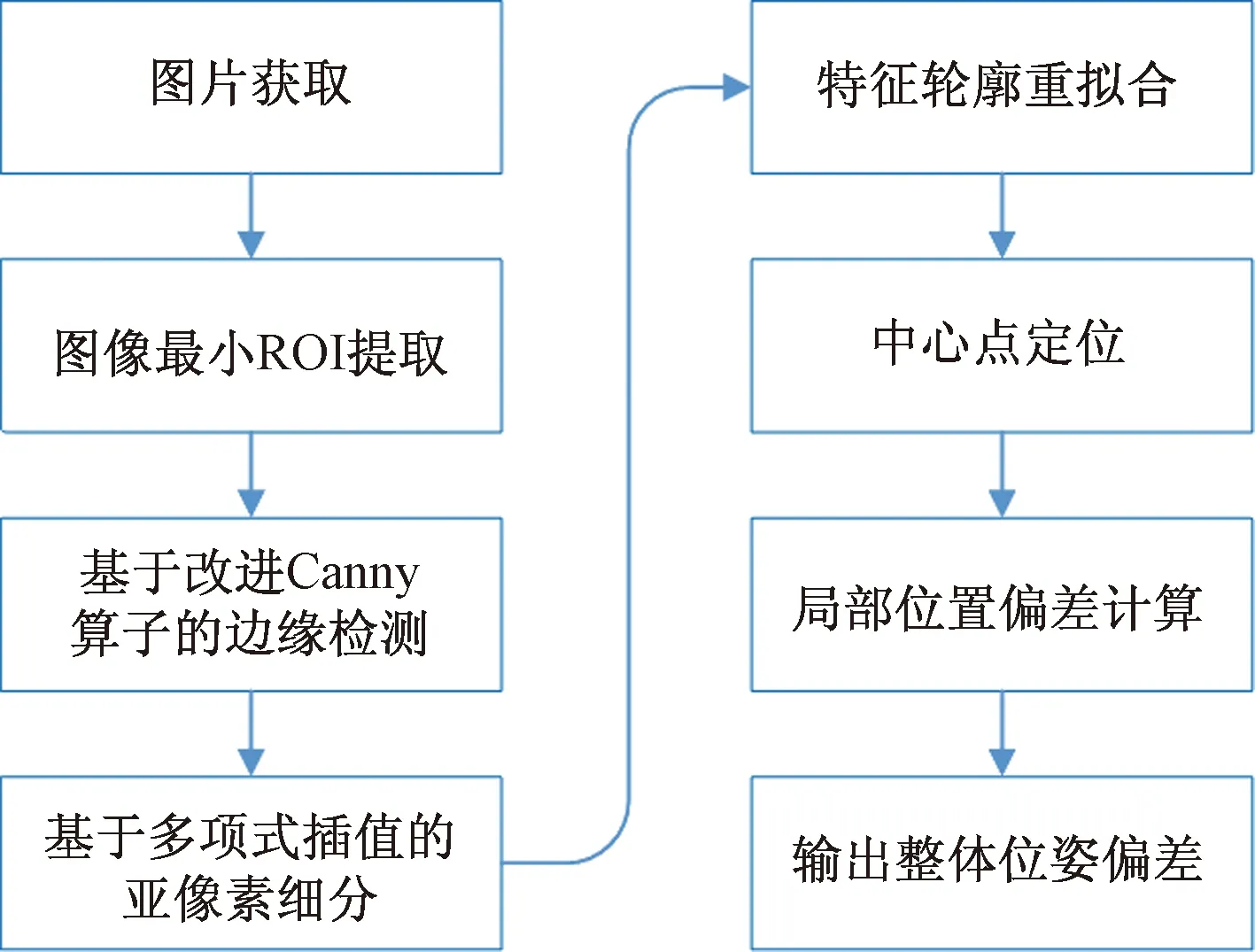

鉴于光刻版尺寸远大于视觉检测精度,采用双显微视觉同时获取工件两端局部图像后,经由视觉算法,获取局部位姿信息,进而得到光刻版工件在左相机图像坐标系下的整体位姿偏差。接着由上位机发送至运动控制系统,完成纠偏调整。图像采集子系统包括大华A3600CG 600万像素面阵相机、桂光仪器DXT06/L90变倍显微镜头、白色LED可调环形光源;图像处理子系统包括计算机:CPU i5-7200U、8GRAM,软件环境:Windows10、Visual Studio2015+OpenCV 3.2。运动控制系统包括新型3自由度精密运动台,平移定位精度±2 μm,旋转定位精度±0.006 7°。实验装置示意图如图3所示,视觉算法流程如图4所示。

图3 实验装置示意图

图4 视觉算法流程

2 亚像素边缘检测

2.1 最小感兴趣区域(ROI)提取

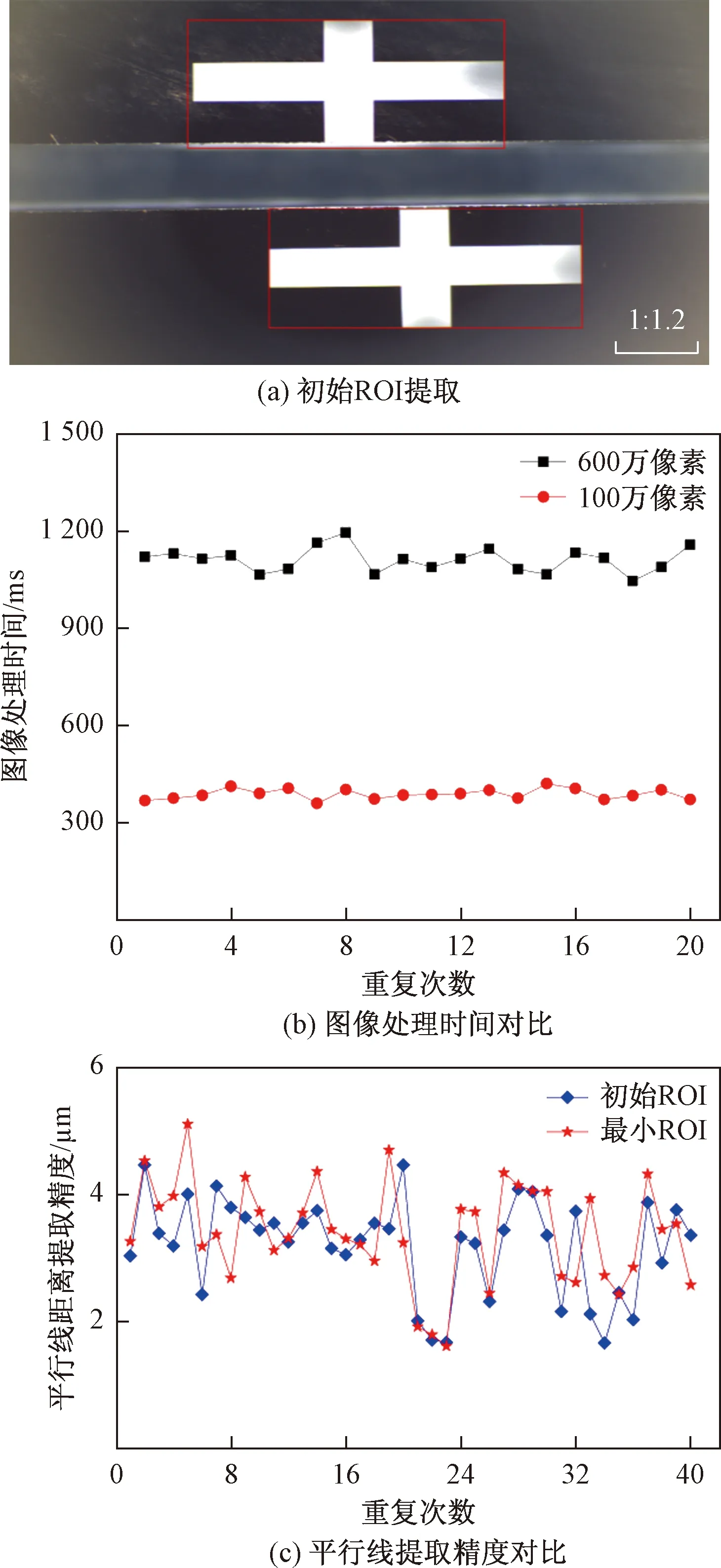

实验在对全局图像进行处理时,时间大于1 000 ms无法满足后期视觉实时对位的要求。而感兴趣区域(region of interest, ROI)的提取,可以减少图像处理时间,提升视觉定位的精度[8]。图像最小ROI提取分为以下两步。

(1)初始ROI提取:采用最小外接矩形法提取十字“Mark”标志的外接正矩形。根据“Mark”标志几何参数设置外接矩形最小面积为300 000,外接矩形长宽比最小为0.5,最大为4,以过滤背景杂质及部分背景反光,初始ROI提取如图5(a)所示。

(2)最小ROI提取:鉴于边缘离散点数量的部分减少不影响边缘直线拟合精度,因此在不影响直线拟合精度的前提下获取最小矩形区域。即以初始ROI中心为中心,以50×25像素为步幅,逐步缩小ROI区域,直至无法完全检测出4类边缘直线段。本节获取左右相机各十幅图像进行实验,经最小ROI提取后图像处理结果对比如图5(b)、图5(c)所示。可知通过最小ROI提取,图像像素大小从600万像素减小为100万像素;图像处理时间从1.1 s,减少为350 ms,对于平行直线的提取距离精度不变。

图5 最小ROI提取

2.2 基于改进Canny算子的边缘检测

传统Canny算子虽然可以很好地定位边缘,但在高斯滤波、梯度计算、高低阈值设定等方面仍存在不足[9-10]。因此就该问题提出改进Canny算子,以提升边缘粗定位精度,减少后续亚像素定位工作量。具体改进如下。

(1)采用自适应平滑滤波器代替高斯滤波:Canny算子采用的高斯滤波在消除噪声的同时也会弱化边缘信息。因此选用自适应平滑滤波在平滑噪声的同时保留边缘信息。

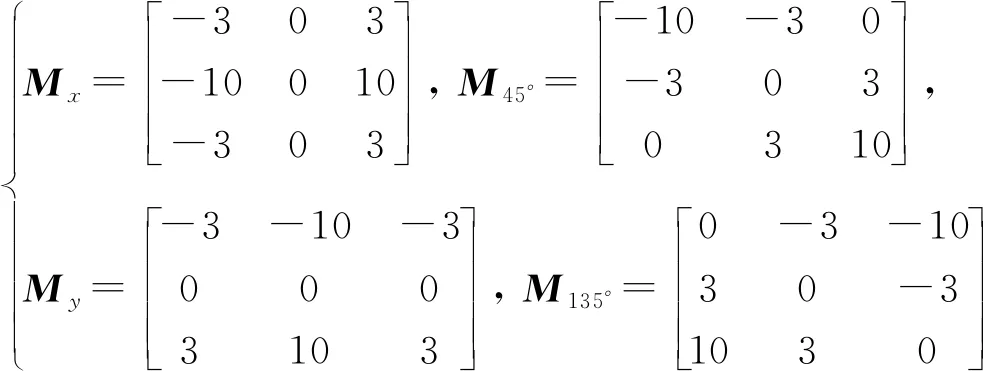

(2)改进梯度计算方法:采用Scharr滤波器代替Sobel算子计算梯度幅值及方向,并添加45°及135°方向卷积核,如式(1)所示。传统Canny算子中一阶微分算子只采用了水平、竖直方向卷积模板,添加45°和135°方向卷积模板可以更精确的定位倾斜边缘。Scharr算子相较于Sobel算子,中心元素所占权重更大,可以消除小核Sobel导数误差,梯度幅值计算更为精确。

(1)

(3)自适应双阈值选取:传统Canny算子高低阈值选取需根据经验人为设定,不具有普遍适用性。改进算法采用Otsu法自动确定高低阈值。具体原理为:遍历图像灰度级,获取类间方差最大值时的灰度阈值T,返回前景C1、背景C2的灰度均值M1、M2为高低阈值。

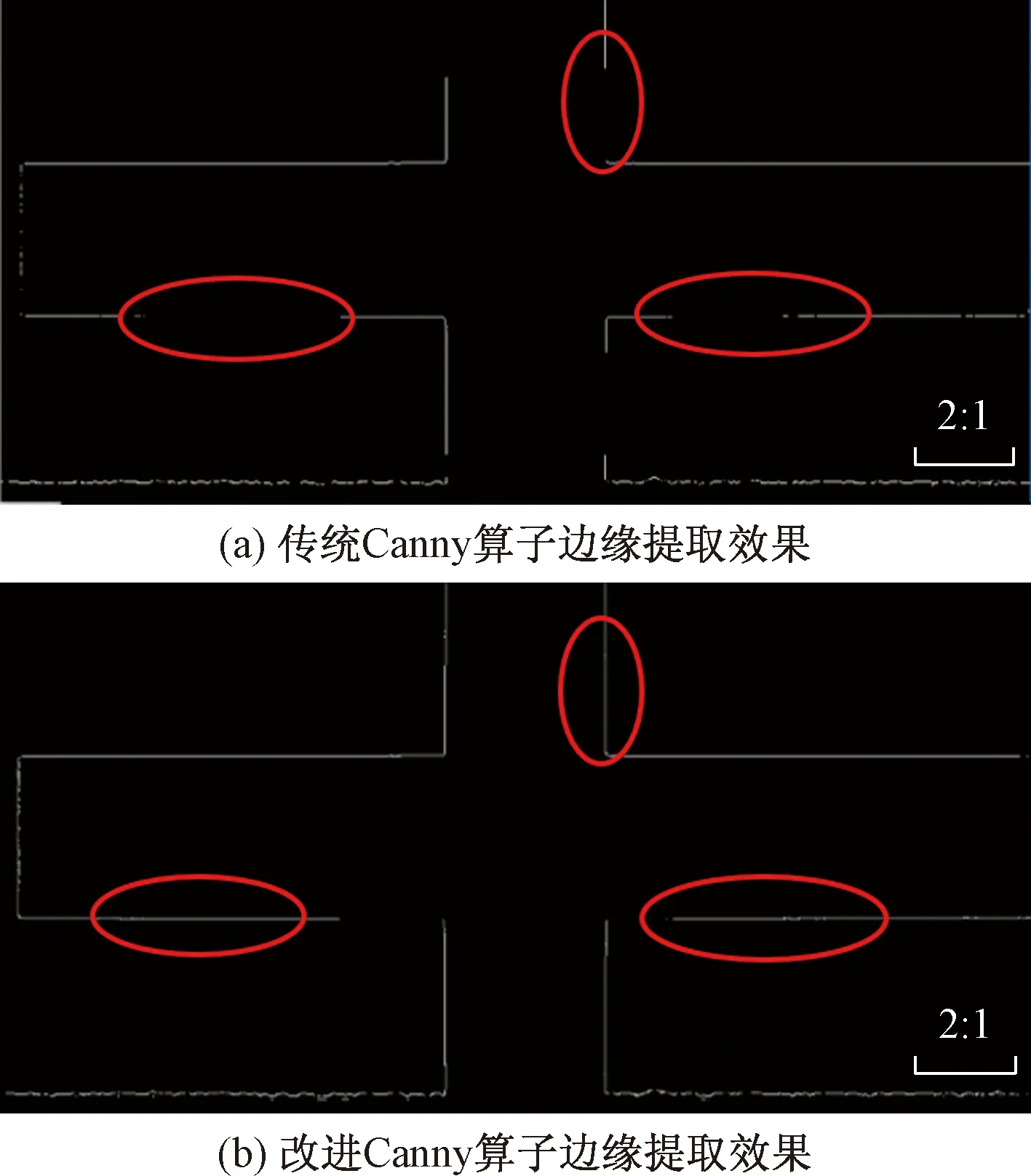

图6 边缘检测对比

采用传统Canny算子和改进Canny算子对 “Mark”标志边缘进行提取,效果如图6所示。可知传统Canny算子提取的边缘信息出现断裂,丢失了一些关键的边缘点信息,降低了后期边缘拟合的精度,而改进算法可以获得清晰的边缘点信息,边缘连续性更好。

2.3 基于多项式插值的边缘亚像素细分

传统边缘检测方法包括Canny算子检测精度最高只能达到像素级。系统图像像元尺寸约为2.4 μm,无法满足视觉检测的精度要求,因此采用基于多项式插值的亚像素边缘细分算法,进一步提升边缘定位精[11-13]。亚像素细分算法首先利用改进的数学形态学梯度算子进行边缘点粗定位,在像素级上确定边缘点的坐标和梯度方向,然后再利用多项式插值法对提取出来的图像边缘点进行插值运算,即亚像素精定位。具体算法流程如下。

(1)利用Canny算子将边缘定位到一个像素精度,并求取原始图像各像素点的梯度幅值及梯度方向。

(2)

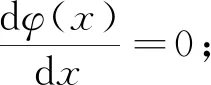

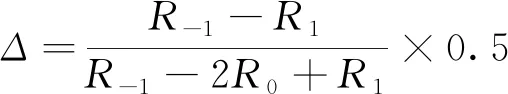

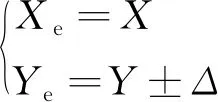

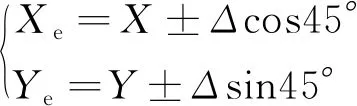

(3)对于边缘点P0,若其像素点坐标为(x,y),则可根据梯度方向确定的沿梯度切向方向的亚像素修正分量,进而得到亚像素坐标(Xe,Ye),共分为3种情况。

边缘点梯度方向为水平方向时:

(3)

边缘点梯度方向为45°及135°方向时:

(4)

边缘点梯度方向为竖直时:

(5)

3 光刻版工件位姿定位算法

再对局部图像进行边缘检测及亚像素细分后,所提取出的边缘轮廓为离散数据点,需要对这些离散点进行直线拟合和定位计算,以确定“Mark”标志的中心点位置坐标和边缘斜率,计算整个光刻版在左相机像素坐标系下X、Y、R3个自由度方向上的偏差位移数据。

3.1 基于RANSAC算法的直线拟合

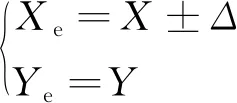

随机抽样一致(RANSAC)算法:从一个观察数据集合中,估计模型参数(模型拟合)的迭代方法[14]。算法将数据集分为局内集合与局外集合,这样可以有效去除离群点、无效点的影响。基于改进随机抽样一致的直线检测算法进行边缘定位,该算法首先利用HoughP变换来初步定位“Mark”标志的四条边缘,并提取出每条边缘上的离散边缘点,接着采用基于最小二乘的直线拟合算法来对边缘进行精确定位,然后计算边缘离散点集Pi(xi,yi)中的各点到拟合直线的距离,并结合阈值去除边缘离群点,重复3次,得到最精确的直线方程。具体算法流程如下:①利用概率霍夫直线检测(HoughP)算法对亚像素边缘进行检测得到多个直线段模型;②对直线段模型进行分类,共分为4类以对应“Mark”标志的4条长边,并选取每一类直线段中尺寸最长模型作为最优模型;③依次获取距4条最优直线段模型所代表直线10个像素范围内的所有边缘点数据,得到点集Pi(xi,yi),i=1,2,…,m;m为边缘离散点个数;④利用最小二乘直线拟合算法拟合点集Pi(xi,yi),得到初始直线方程;⑤求取上述点集Pi(xi,yi)到所拟合直线方程的距离;并判断所得到的距离是否满足阈值要求,去除不满足要求的离群点,得到内点集合Qi(xi,yi),i=1,2,…,m-k;k为所舍弃点的个数;⑥对内点集Qi(xi,yi)重新进行直线拟合,得到精确的直线方程;重复步骤⑤、步骤⑥两次。

图7 基于RANSAC算法的直线拟合

对亚像素细分轮廓点的直线检测如图7所示,图7(a)为经HoughP直线检测后最优直线段选取示意图,图7(b)、图7(c)为线段1的边缘点集获取与直线拟合图。可知基于改进RANSAC算法的直线检测算法可以精确的拟合出直线方程。

3.2 工件位姿精确定位

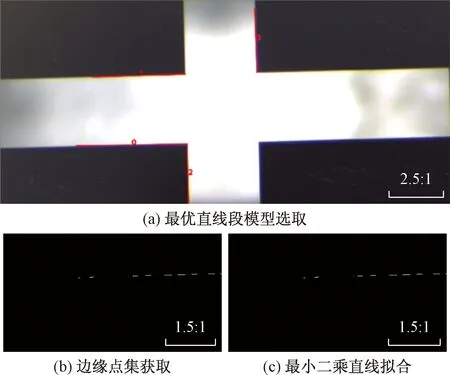

根据直线拟合后得到的四条边缘直线方程,求取十字“Mark”标志的中心点O1及偏转角度。进而求取光刻版工件在单相机坐标系下的位姿偏差及双相机坐标系下的联合偏差。具体原理如下。

(1)对于单一“Mark”标志的偏转角度,采用直线l1、l2的倾斜角度均值作为偏转角度;对于中心点O1位置坐标,采用4条直线l1、l2、l3、l4的4个交点A、B、C、D的横纵坐标均值作为位置坐标。

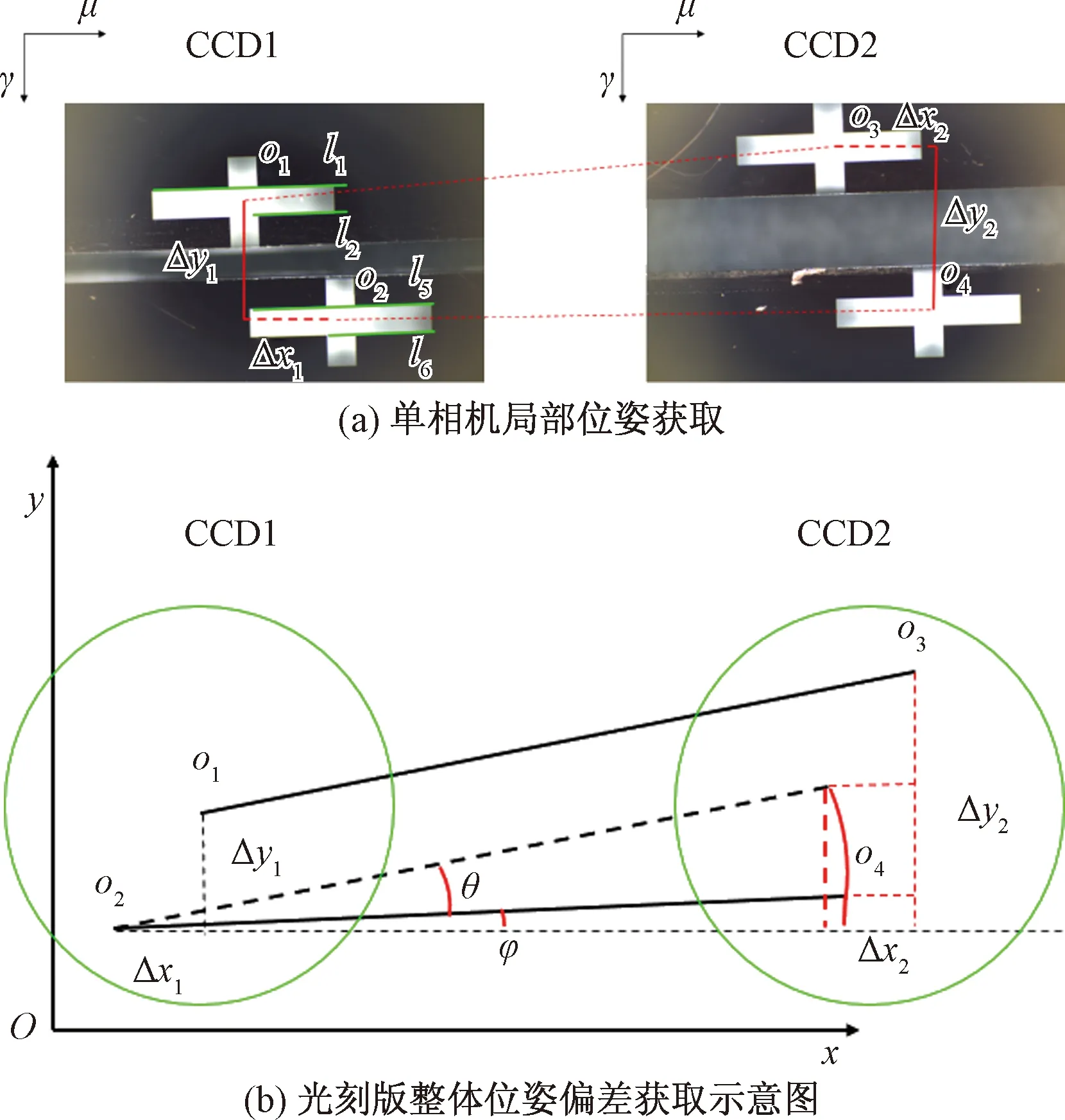

(2)对于单相机坐标系下,光刻版工件的角度偏差及位移偏差。采用取上下“Mark”标志4条直线l1、l2、l5、l6的夹角均值作为角度偏差;采用中心点O1、O2的像素坐标偏差Δx1、Δy1作为位移偏差,如图8(a)所示。

(3)对于光刻版工件的整体位姿偏差,设左相机坐标系下偏差角度θ1,右相机坐标系下偏差角度θ2,待对位光刻版工件偏转角度为φ,位置偏差分别为Δx1、Δy1、Δx2、Δy2。由几何关系图8(b)可得关系式(6),进而求取光刻版工件整体位姿偏差。

(6)

图8 光刻版位姿偏差获取

4 实验与结果分析

4.1 算法的定位精度测试

为了检验视觉算法的精度,设计两组实验,分别检验亚像素边缘提取的精度及双显微视觉下光刻版工件的位姿偏差提取精度。

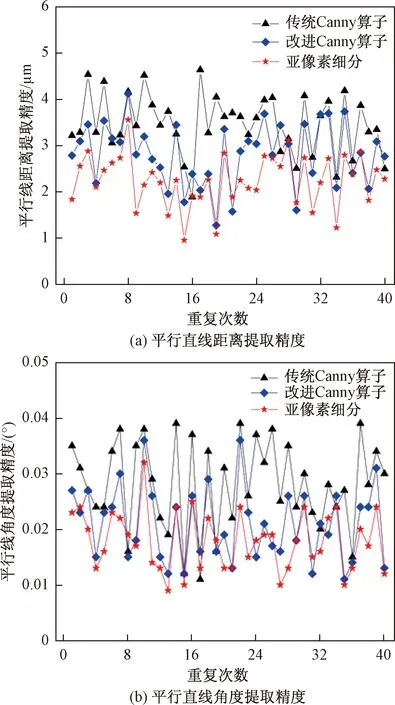

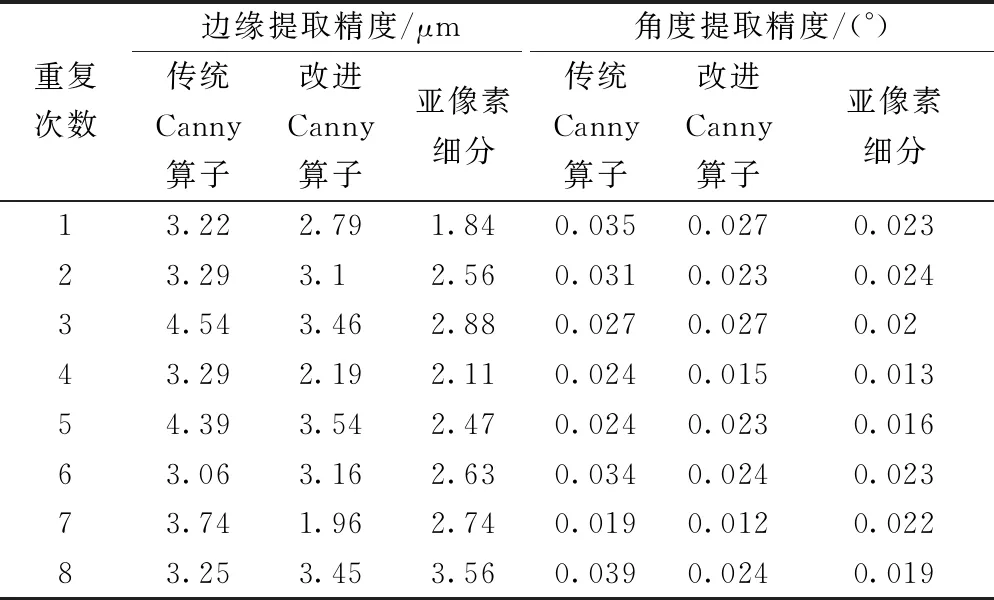

实验1为检验本文的改进Canny算子边缘提取精度及亚像素边缘细分精度,以直线拟合后“Mark”标志平行线的距离值及角度差值作为评价标准。实验采用传统Canny算子、改进Canny算子及基于多项式差值亚像素细分3种方法对20组40幅ROI图像进行边缘提取,并在此基础上对图像中平行直线进行拟合,获取拟合后的平行线距离精度和角度差值。3种算法的边缘提取距离精度,边缘提取角度精度如图9所示。部分实验数据如表1所示。

图9 平行线拟合精度对比

表1 平行线边缘提取精度对比

由图9、表1可知,相对于传统Canny算子,改进Canny算子在直线拟合后定位精度更高,对于间距为0.5 mm的平行线,边缘提取精度由原来的3.57 μm提升至2.75 μm,对于平行线角度提取精度由0.028°提升至0.022°;在经过亚像素细分之后,平行线距离精度进一步提升至1.93 μm,角度提取精度则提升至0.018°。表明改进Canny算子和多项式插值亚像素细分可以很好地定位边缘轮廓,单直线拟合精度小于1 μm,达到亚像素级别,满足视觉检测要求。

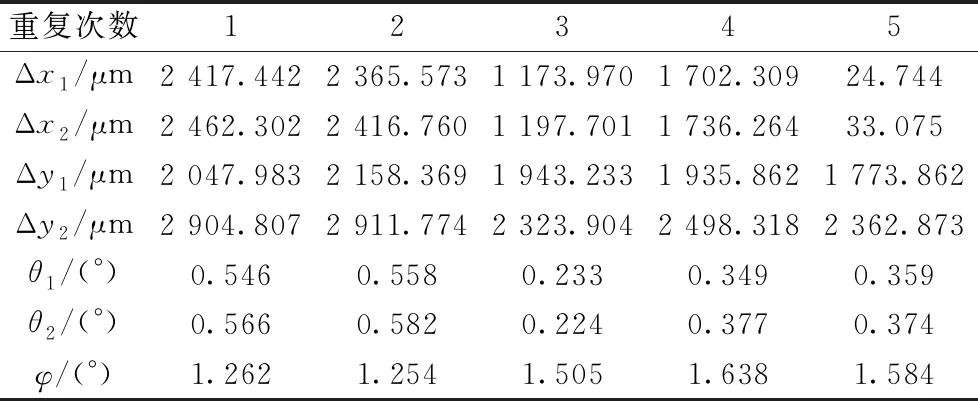

实验2为检验位姿定位算法对光刻版整体位姿偏差的提取精度。采用双显微视觉同时获取工件左右两端的局部位姿偏差,并根据式(6)对理论位姿偏差与实际位姿偏差进行比较,重复实验5组。每组获取左右相机像素坐标系下x向偏差Δx1、Δx2;y向偏差Δy1、Δy2;角度偏差θ1、θ2及待对位光刻版工件偏差φ;并根据式(6)将右相机像素坐标系下位姿偏差进行转化,获取光刻版工件在左相机坐标系下的整体位姿偏差。实验数据如表2所示。可知左右相机对于光刻版间的角度偏差提取误差达0.009°,对于x向、y向位置偏差提取满足式(6);相对于工件尺寸,x向最大测量误差为0.037%,y向最大测量误差为0.10%。

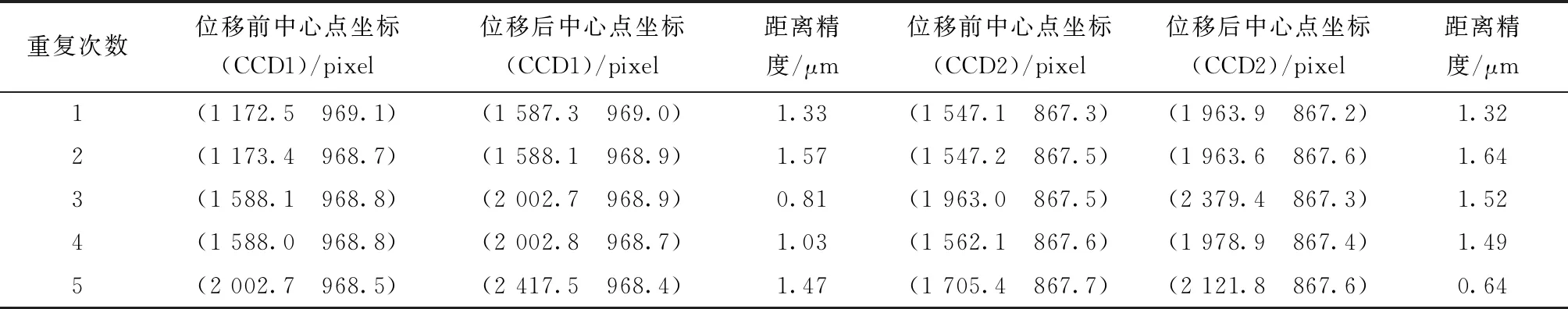

4.2 算法的稳定性测试

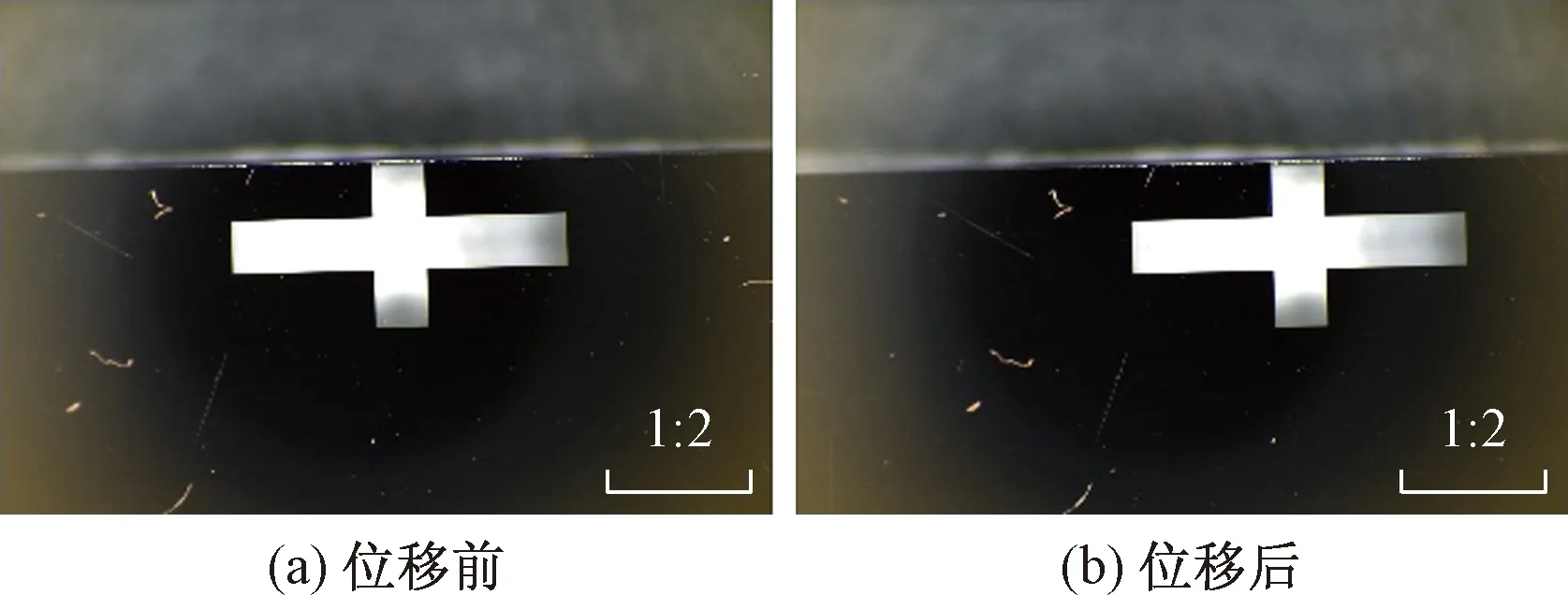

由于视觉对位需在动态过程中进行光刻版工件位姿定位,因此需要检验该算法在动态环境下能否准确进行位姿获取。驱动3自由度精密定位台将待对位光刻版移动一定距离,并以高晟激光干涉仪(分辨率为0.1 μm)测量其中心点精确的位移距离。为减小视觉定位偏差,采集每次位移前后左右相机各5幅图片,采用本文算法进行位姿定位,并重复试验5次。位移前后左相机光刻版位置如图10所示,视觉算法检测到的位移信息如表3所示。可知:左相机x方向视觉检测精度达0.24 pixel,右相机x方向视觉检测精度为0.35 pixel,左右相机y方向重重复定位精度均达0.1 pixel,达到亚像素级别。

表2 光刻版位姿提取精度

图10 沿x轴正向移动1 mm

5 结论

针对光刻版工件高精度视觉对位的要求,搭建了双显微视觉对位系统,通过两端局部位姿提取推导工件整体位姿偏差,解决了工件尺寸与定位精度之间的矛盾。首先,通过最小ROI获取,使得图像处理时间从1.2 s减小为350 ms;其次,通过对Canny算子的优化并基于多项式插值细分完成了“Mark”标志亚像素级边缘轮廓提取,实验表明,对于0.5 mm平行线的提取精度逐步从3.57 μm提升至1.93 μm,角度精度则提升至0.018°;最后,通过RANSAC算法拟合边缘并由局部位姿间数学关系精确定位光刻版工件整体位姿偏差。实验表明,左右相机对于光刻版间的角度偏差提取误差小于0.009°,相对于工件尺寸x向最大测量误差为0.037%,y向最大测量误差为0.10%。左相机x方向视觉检测精度达0.24 pixel,右相机x方向视觉检测精度为0.35 pixel,左右相机y方向重复定位精度均达0.1 pixel,达到亚像素级别,满足后期视觉对位高速高精度的定位需求。

表3 移动位姿测量数据