复杂环境下一种基于改进核相关滤波的视觉鲁棒目标跟踪方法

何 容,赖际舟,吕 品,刘国辉,王 博

(1.南京航空航天大学自动化学院,南京 211106; 2. 江苏金陵智造研究院有限公司,南京 210001)

0 引言

目标跟踪是计算机视觉领域中的重要组成部分,其在给定第一帧目标初始位置的情况下,预测连续图像序列的目标位置。目标跟踪在自动驾驶、智能监控系统等实时视觉应用中发挥着重要作用。

在军事领域,目标跟踪技术能够实时获取移动目标的位置,从而完成对目标的精确打击与追踪。在自动驾驶领域,无人驾驶车辆通过目标跟踪技术对行人、车辆等交通参与载体保持密切跟踪,并借此制定自身的导航与控制策略,提升无人驾驶的安全性。

在计算机视觉中,目标跟踪算法基于原理可大致被分为生成式目标跟踪算法与鉴别式目标跟踪算法。生成式目标跟踪算法先建立目标模型或提取目标特征,在跟踪过程中仅使用目标特征进行邻域的搜索与匹配,不考虑背景信息。然而背景信息同样影响着跟踪算法的性能,在不考虑背景信息的情况下,跟踪器往往难以应对目标遮挡、光照变化以及运动模糊等情况,易造成跟踪失败。与之相比,鉴别式目标跟踪算法将跟踪问题视为分类问题,在建模及特征提取中考虑背景信息,在复杂运动场景下具有更好的鲁棒性。目前,一些先进的鉴别式跟踪算法已经实现了对目标的高速跟踪,例如L1T[1]、CT[2]、Struck[3]、TLD[4]等。近年来,基于相关滤波的判别式跟踪算法取得了显著的进展[5-7],使得视觉跟踪算法能够在保证实时性的前提下,实现鲁棒高效的跟踪。

然而,视觉跟踪任务仍存在着一些挑战以及关键性问题。核相关滤波(Kernel Correlation Filter,KCF)视觉跟踪器一般通过在线学习与更新目标的外观特征进行目标的跟踪定位[8],这类方法易受光照等环境因素与目标姿态变化的影响,且一般不具备处理遮挡与重新初始化的能力。针对上述问题,文献[9]与文献[10]提出了分块跟踪匹配的方法,但该方法受限于分块特征以及匹配方法的鲁棒性,仅在部分遮挡情况下应用效果较好。文献[11]与文献[12]使用RGB-D传感器,通过分析深度信息以及KCF跟踪器的响应值进行遮挡的判断与处理,但该方法的判断成功率与捕获深度图的精度有关。

针对相似干扰与目标形变问题,为了提高跟踪结果的鲁棒性,跟踪与检测结合互补的方式被广泛应用。随着深度神经网络的普及,许多基于神经网络的跟踪算法应运而生。文献[13]将相关滤波器作为深层神经网络中的可微层,能够学习与相关滤波器紧密耦合的深层特征。文献[14]利用递归神经网络对目标进行建模,提高了跟踪器在相似干扰情况下的鲁棒性。然而神经网络往往需要大量的数据进行训练,在线获取的目标跟踪结果作为训练样本可能无法满足对训练样本数量的需求。

由此可见,在目标跟踪领域,遮挡以及相似干扰等具有挑战性的情况下,跟踪器的精度与鲁棒性仍有待提高。针对该问题,本文提出了一种基于改进KCF的视觉鲁棒目标跟踪方法。创新点主要包括:1)针对遮挡判断问题,提出了基于检测辅助的改进KCF目标跟踪算法,设计了检测跟踪结合架构,利用检测与跟踪结果的相关性进行遮挡与干扰的判断;2)针对相似干扰以及遮挡/丢失后的重定位问题,提出了基于拓展特征匹配的抗干扰目标跟踪方法,设计构建了目标ORB(Oriented FAST and Rotated BRIEF)特征模板,通过在检测结果范围内进行特征匹配的方式,实现了目标的重新定位。本文方法将目标检测器、KCF与ORB特征匹配相结合,有效解决了目标遮挡、相似干扰、形变等问题,实现了对目标快速稳定的跟踪。

1 改进KCF鲁棒目标跟踪算法架构

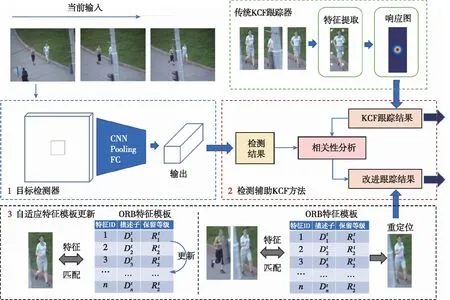

为提高传统KCF跟踪方法在遮挡以及相似干扰情况下的跟踪鲁棒性,本文对传统的KCF算法进行了拓展,增添了目标检测器模块与目标特征模板的构建模块,如图1所示。在获取到新一帧的图像后,分别利用跟踪器的跟踪结果以及目标检测器的检测结果,通过二者的相关性分析进行跟踪结果的检测,判断是否存在遮挡及相似干扰的情况。在无遮挡或干扰的情况下,提取跟踪结果中的ORB关键点进行目标特征模板的构建;在发生遮挡或相似干扰后,根据目标检测结果以及特征模板匹配,实现对跟踪目标的重定位。

图1 改进KCF鲁棒目标跟踪算法框架Fig.1 Improved robust target tracking algorithm framework based on kernel correlation filtering

2 基于检测辅助的改进KCF目标跟踪算法

(1)KCF目标跟踪算法

KCF算法的实质是求解岭回归问题。在KCF算法中,以上一帧图像的跟踪结果x为基样本,将x进行循环位移得到m×n个大小一致的样本xi,i=1,2,…,m×n,利用xi及岭回归方法完成分类器的训练。在岭回归中,训练器的任务是找到一个回归函数使得损失函数最小,即

(1)

(2)

经过映射函数φ(xi),样本在新的映射空间中的线性回归函数为

f(z)=ωTφ(z)

=αTφ(X)φ(z)

(3)

(4)

KZ=C(kxz)

(5)

其中,x表示训练基样本;z表示检测基样本;C表示循环位移过程函数。在KCF检测过程中,计算z的响应度为

(6)

响应最大的区域即为跟踪目标所在位置。

(2)检测辅助的KCF目标跟踪算法

跟踪器的更新策略影响着其跟踪定位精度。KCF算法易于实现且具有明显的速度优势,但其更新方式使得新引入的训练样本快速覆盖历史储存目标的外观信息,导致KCF只能记录目标较新的外观,且只能适应连续的外观模型。因此,一旦引入错误的训练样本,所有保留的外观信息将被污染。KCF本身也不具备对跟踪结果进行判断的能力,当目标被遮挡或跟踪结果已经出现漂移时,跟踪器只会利用污染的模板进行接下来的匹配,极易导致跟踪器的漂移以及跟踪失败。

针对上述问题,本文通过增添视觉检测模块,辅助KCF进行质量判断与遮挡判别。在跟踪目标类别确定的情况下,结合检测器及跟踪结果进行遮挡与丢失的判断。这种方法可以避免引入错误的训练样本,缩小目标检索过程中的检测范围(在短时间遮挡时只需要检测原始目标候选区域及其周围区域),并增加跟踪器在复杂环境下的鲁棒性。

本文利用目标检测器进行跟踪结果的辅助判断,并且辅助进行目标丢失后的重定位,因此需要保证检测结果的准确性。为了保证目标检测结果的可靠性,并且考虑到进一步开发的实时性,选用YOLOv3[15]作为目标检测器。YOLOv3是J.Red-mon等在2017年提出的目标检测算法,是YOLO算法的第3个版本,其在COCO[16]数据集上实现了在51ms内mAP达到57.9%的效果,能够同时保证准确率与检测速率,满足本文的开发需求。在本文中,选取行人作为固定的跟踪类目进行算法的阐述与验证。

(7)

(8)

3 基于拓展特征匹配的抗干扰目标跟踪方法设计

在实际的跟踪应用中,常会出现同种类目标的相似干扰情况。经典KCF算法中,采用HOG(Histogram of Oriented Gridients)[17]特征进行跟踪目标的描述,往往只能学习到目标的边缘特征,若存在同种类相似目标于跟踪目标附近时,跟踪器易出现目标混淆的情况;且存在相似干扰时,与跟踪结果相关的检测结果也不止一个,此时遮挡与丢失的判断也会受到影响。

在运动目标的跟踪过程中,为解决相似干扰及遮挡后的重定位问题,跟踪器往往设计使用多种特征对跟踪目标进行描述。本文使用具有尺度及旋转不变性的ORB特征作为跟踪目标的拓展描述,在无遮挡及干扰时,构建目标的自适应特征模板,通过特征匹配在干扰及遮挡后完成跟踪目标的重定位。

(1)拓展特征模板构建

ORB[18]是Ethan Rublee于2011年提出的一种基于视觉信息检测与描述特征点的算法,具有尺度及旋转不变性,并且对尺度、方向、外观、光照变化以及遮挡均不敏感,使用ORB进行跟踪目标的拓展特征描述能够很好地处理相似干扰及遮挡后的重定位问题。

本文使用构建特征模板的方式实现目标的ORB特征描述,其由ORB关键点及其特征描述子构成,定义如下

(9)

其中,Vm×n表示构建的目标ORB特征模板,为一m×n维矩阵,其中m表示特征点个数,n表示特征点对应的n维描述子(本文中n=256);gn(pi,θi) 表示特征点pi的旋转不变描述子,其相对BRIEF算子fn(pi)进行了特征方向θi的角度校正,利用校正后的测试点对(xij,yij)∈Qθi进行二进制描述子的计算,得到了具有旋转不变性的关键点特征。

(2)自适应特征模板更新

随着场景、目标形态及外观的变化,ORB特征模板需要进行自适应更新。为了保证目标特征模板的时效性,本文借鉴文献[19]中的模板更新策略,为每一特征点设置一保留等级,得到的拓展特征模板为

(10)

其中,Ri表示特征模板中第i个特征点的保留等级,反映了该特征点属于该跟踪目标的置信度。将保留等级的最大值设置为Rmax。

特征模板自适应更新过程如图2所示。利用第t帧目标跟踪结果进行ORB关键点的提取,得到其特征集Vobj,并将其与已经构建的特征模板VRt进行特征匹配。将VRt中匹配成功的特征点更新为Vobj中的对应点,并将其保留等级设置为最大值;将匹配失败的特征点保留等级减1。若跟踪结果特征集中存在未匹配成功的特征点,则说明目标由于外观变化出现了新的特征,将这些特征作为新特征加入特征模板中,并将其保留等级最大化。为了保证特征模板中某一特征点保留等级降为0,说明该特征长期没有得到匹配,则删除该特征点的所有信息。

图2 自适应目标特征模板更新示意图Fig.2 Adaptive target feature template update diagram

(3)抗干扰相似目标判断及目标重定位

(11)

4 实验结果与分析

为对本文算法进行评估并验证其实际效果,本文在测试集与移动机器人上都进行了充分的实验验证。通过测试集验证试验,对跟踪算法的精度及成功率进行了定量的评估;通过移动机器人平台视觉跟踪验证试验,对算法在实际的移动机器人跟踪场景中的现实跟踪效果进行了验证。

(1)数据集视觉跟踪验证试验

本文选用测试集为公开的跟踪算法性能评估测试集OTB-2015[20],该测试集包括100个带有9种标记属性的视频序列,覆盖了视觉跟踪的挑战性问题,如光照变化、尺度变化、遮挡形变、运动模糊等。本文选取OTB-2015中以行人为跟踪目标的jogging1-2和Girl2等6组视频序列进行测试验证,这些视频涵盖了尺度变化、目标形变、遮挡、平面内外旋转等视觉跟踪挑战性情况。为更好地说明所提算法的有效性与优越性,本文将其与KCF算法进行对比,并对两种算法进行了跟踪结果的定性评估。

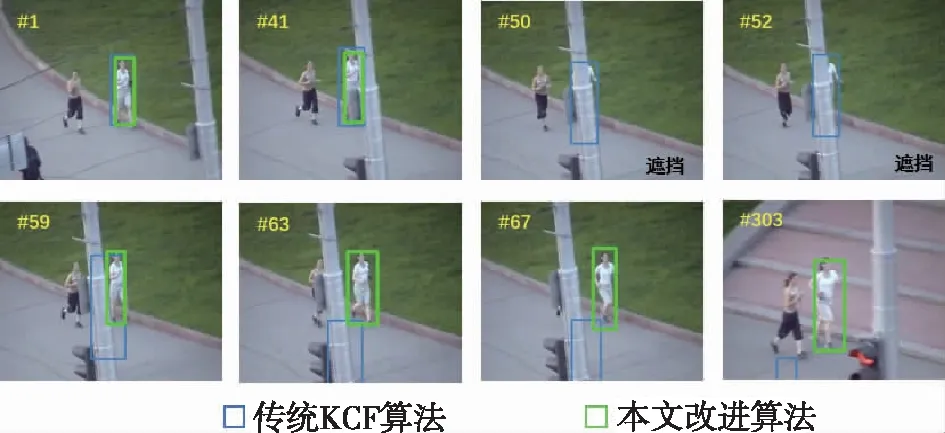

图3所示为本文算法与KCF算法在遮挡及相似干扰情况下的跟踪结果。图3(a)为OTB-2015中jogging-2视频序列KCF算法及本文算法的实验结果对比图。在该序列中,41帧时目标行人开始出现障碍物遮挡情况,在51~54帧时被完全遮挡,64帧时再次完全出现。如图第52帧及63帧结果,本文方法对目标行人的遮挡情况进行了判别,在遮挡时暂停了跟踪;当目标行人经过遮挡后再次出现时,通过前期构建的目标ORB特征模板成功对目标行人进行了重定位,跟踪器重新初始化并工作。而KCF跟踪器在出现遮挡时仍然进行工作,不断引入错误的特征导致其不断出现漂移,最终造成了跟踪失败。

图3(b)为OTB-2015中Girl2视频序列KCF算法及本文算法的实验结果对比图。该视频序列在第92帧时出现了相似物遮挡干扰情况。如图所示,本文算法成功利用检测结果确定了相似物的遮挡干扰,并利用ORB特征模板继续跟踪过程,在遮挡过程中图像中的所有行人都不满足式(11)中的重定位条件,因此无跟踪结果(如115帧所示);而目标再次出现后,算法成功进行重定位,重新初始化跟踪器继续跟踪过程。KCF算法由于无法判断遮挡,跟踪失败。

(a) Jogging-2处理结果对比

(b) Girl2处理结果对比图3 OTB-2015视频序列实验结果Fig.3 OTB-2015 video sequence experiment results

图4所示为本文算法及KCF算法跟踪精确度对比图[20],其中包括2个指标:跟踪精确度及跟踪成功率。跟踪精确度反映了跟踪结果(bbox)与真值的中心位置误差小于一定阈值的帧数百分比,一般将阈值为20的精确度作为跟踪算法的精度代表值;跟踪成功率反映了跟踪结果(bbox)与真值的重合度大于某个阈值的帧数百分比,一般情况下,重合度大于50%即视为跟踪成功。

(a)跟踪精确度

(b)跟踪成功率图4 所提方法与KCF算法性能曲线Fig.4 The proposed method and KCF algorithm performance curve

由实验结果可知,本文算法与KCF算法相比,能有效地改善目标跟踪的精度,对干扰及遮挡等情况进行判别,并根据检测结果实现目标的重定位。

(2)移动机器人平台视觉跟踪验证试验

在实际的应用场景中,目标跟踪算法经常被搭载在智能移动平台中,在该使用场景下,跟踪目标以及进行视觉感知的摄像头在场景中均为移动体。为验证所提算法在移动平台下(实际动背景下)的实地使用效果,本文进行了移动机器人平台验证试验。实验使用移动机器人平台为百度自动驾驶开发套件Apollo D-Kit,使用视觉传感器为Kinect v2型RGB-D摄像头(图5)。实验中采集1734帧图像,像素为640×480。

图5 移动机器人视觉跟踪验证平台Fig.5 Visual tracking and verification platform for mobile robot

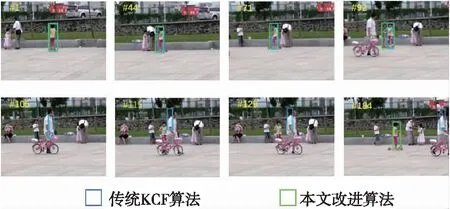

在整个测试序列中,跟踪目标全程处于附近有其他目标类别的情况。在视频开始时,目标行人与干扰行人并排贴近行走,在视频中段分别出现了一次相似类别遮挡情况以及一次相似干扰情况。实验结果表明,当目标经过遮挡后再次出现时,本文跟踪算法能够准确地判断遮挡并重新锁定目标,不会与其他行人混淆;当存在相似干扰时,跟踪器也能准确地判别出目标行人。图6所示为目标在相似遮挡以及相似干扰情况下的跟踪结果。图7所示为移动机器人视觉跟踪验证试验算法性能曲线。

图6 移动机器人平台视觉跟踪验证结果Fig.6 Verification results of vision tracking for mobile robot platform

(a)跟踪精确度

(b)跟踪成功率

5 结论

针对遮挡及相似干扰问题,本文提出了一种结合基于神经网络的目标检测、KCF及ORB特征的视觉鲁棒目标跟踪算法。算法分析与试验结果表明:

1)跟踪器的更新策略影响着其跟踪定位精度。本文算法利用检测器与相关性分析对跟踪结果进行质量判断,实现了跟踪过程中对遮挡及目标丢失的判别,使跟踪器在遮挡/丢失等情况下停止更新。

2)本文算法通过拓展特征模板的构建与匹配,对目标的视觉特征进行了补充描述,实现了跟踪器的抗干扰相似目标判断及丢失后的目标重定位。

3)本文所提方法提高了KCF方法在遮挡及相似干扰情况下的鲁棒性,在保障实时性的前提下,有效地提高了跟踪精度。算法在遮挡、相似性干扰比较强的环境下表现良好,验证了本文算法的可信性和可靠性。

4)移动机器人平台验证试验证明了本文算法在移动平台的可行性。在集成了960M GPU的工控机移动平台中,本文算法可满足实时运行需求。