基于共同空间模式的情感脑电信号的空域特征提取

闫梦梦,吕 钊,2,孙文慧

基于共同空间模式的情感脑电信号的空域特征提取

闫梦梦1,吕 钊1,2,孙文慧1

(1. 安徽大学计算机科学与技术学院,安徽 合肥 230601;2. 杭州电子科技大学脑机协同智能技术浙江省重点实验室,浙江 杭州 310018)

为了改善基于脑电(EEG)的情感分类性能,提高多分类情况下的识别准确率,提出了一种基于共同空间模式(CSP)的空域滤波算法。首先使用传统的CSP方法设计空域滤波器,并通过该滤波器对3种情感类型(即积极、中性和消极)的EEG信号进行线性投影,以提取空域特征。此外,考虑到传统近似联合对角化(JAD)算法是使用“得分最高的特征值”准则进行特征向量的选择,该情况可能导致无法有效区分多分类的情感状态,因此针对最高分特征值位置存在的所有可能情况设计了不同的特征值选择方法。对实验室自主采集数据集,使用支持向量模型(SVM)作为分类器进行对比实验。结果表明基于CSP的空域特征提取方法在三分类情感识别中平均准确率达到了87.54%,证明其在情感识别应用中具有可行性。

情感脑-机交互;共同空间模式;近似联合对角化;空域滤波;情感识别

脑-机接口(brain-computer interface,BCI)是一种由神经活动直接驱动的特殊人机交互技术[1-2]。通过非侵入性BCI系统测量大脑活动,并将其直接转换为操作外部设备的控制命令,以实现用户与计算机之间的信息交互。然而,由于情绪感知能力较弱,很多系统都无法根据用户的心理状态来调整交互模式,这极大地限制了BCI系统的功能和应用[3]。幸运的是,情感识别技术在用户和计算机之间建立了情绪感知的桥梁,可以提供一种类似于人们之间交流的自然互动方式。此外,有研究[4]表明,在康复医疗护理领域,积极情感可以促进患者身体功能的恢复,而负面情感往往会导致情绪低落,长期处于这种状态将不利于患者身体功能的恢复。如果能够根据患者的情感状态采取不同的护理措施,护理质量将得到明显改善。因此,将情感识别引入到传统的BCI系统中已成为人工智能和认知科学等众多跨学科领域的重要研究热点[5-6]。

为了实现基于脑电(electroencephalogram,EEG)的情感BCI系统,人们情感信息的有效获取和识别成为至关重要的一步[7]。近年来,为了实现这一目标,一些比较成功的情感脑电特征提取方法相继被提出。例如,文献[8]从5个与情感相关的频带中提取出的微分熵(differential entropy,DE)和功率谱密度(power spectral density,PSD)特征,在三分类的情感识别中获得了86.08%的平均识别率。文献[9]提出一种基于时-频域的分析方法,在二分类的情感识别任务中取得平均识别率为86.52%。尽管这些研究在支持情感计算的理论、方法、以及实验上都取得显著成功,但其关注的是时域或时-频域的特征分析,而忽略了脑电信号中与情感计算相关的空域特征。为了有效解决该问题,本文进行了一些分析实验,以探索空域特征是否能够对基于EEG的情感状态识别提供更有价值的情感信息。

1 实验设计和数据获取

本实验所用的全部数据均为实验室自己采集,受试者6位,分别为2男4女(所有受试者均为在校学生,双眼视力正常或矫正后正常,年龄在23~26岁)。在实验过程中,所记录的数据是30通道的情感脑电信号,其中采样率为250 Hz,精度为16位。头皮电极位置符合国际标准10-20系统[10]。

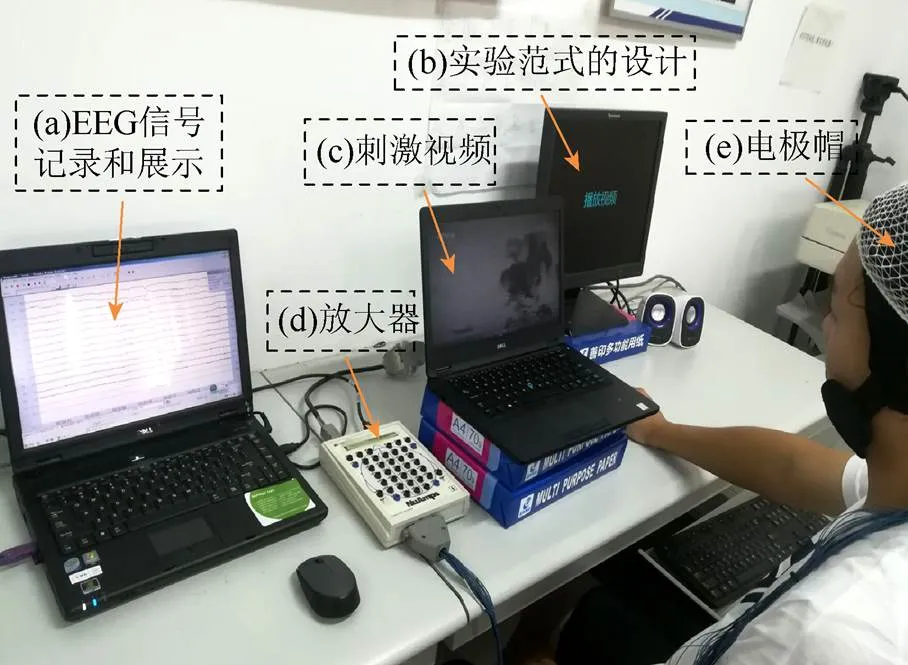

关于情感诱发材料的选择,考虑到视频片段包含场景和声音、具有视听双重的刺激,可以让受试者接触到更多的真实场景,从而引发出更强烈的主观和生理变化。现有的研究已经表明视频作为情感刺激诱发材料的有效性[11]。此外,考虑到本土文化在情感识别实验中也会起到重要的作用,因此,最终选择了具有母语和相关文化背景的带有情感因素的电影片段作为刺激材料。在实验前,所有受试者均被告知参与的实验目的和过程。在实验进行中,要求被试者静坐在桌前,集中注意力观看正前方的视频片段,并且在影片播放中尽量保持不动,以免增加剧烈的肌电等干扰。具体实验场景如图1所示。

图1 实验场景图

数据采集实验范式如图2所示。每个大的单次实验(Trial)总时长为75 s,共分3部分。实验开始时,计算机发出“嘀”的提示音,同时屏幕上出现提示字“准备”,表示此次实验正式开始。随后,计算机会随机播放时长为60 s的3种不同类型的情感电影片段(积极、中性、消极)。最后电脑屏幕上出现“休息”字样,受试者此时可以进行10 s的适当休息等待下一次实验。每个受试者有3种情感状态,每种情感状态均有12个大的单次实验(持续时长为60 s),因此,每个受试者所拥有大的单次实验总数是3´12=36。在后续的数据处理中,情感基本单元(利用滑动窗实现数据段的划分)被设置为=6 s,并且滑动步长为/3。最终,每个受试者共有3´324=972个小的单次实验(用于分类训练和测试的总样本数)。实验选用的分类模型是支持向量模型(support vector model,SVM),其中惩罚因子为1,核函数为多项式核函数。

图2 实验范式图

2 方 法

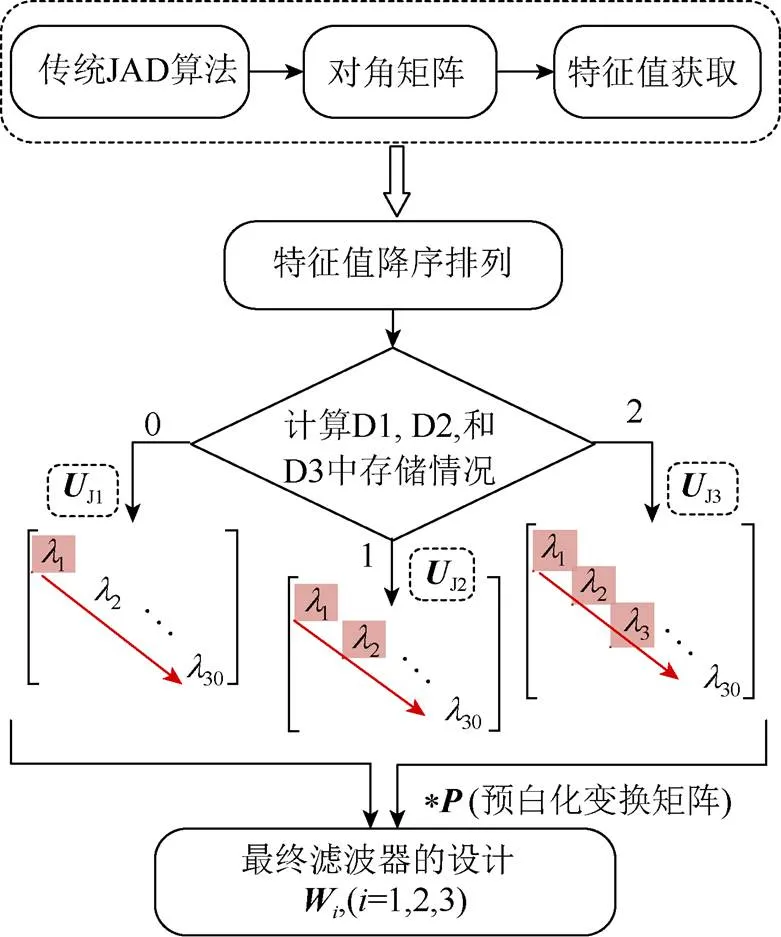

该算法的目的是探索基于共同空间模式(common spatial pattern,CSP)的空域特征提取方法,提高脑电情感识别准确率。算法的具体流程如图3所示,主要包括4个部分:对采集到的30通道脑电信号进行数据预处理、基于近似联合对角化(joint approximation diagonalization,JAD)算法的空域滤波器设计、脑电信号的空域特征提取以及最终情感状态的分类识别。

图3 基于CSP空域滤波方法的流程图

2.1 数据预处理

为了去除眼电(electrooculogram,EOG)、肌电(electromyography,EMG)和工频干扰等伪迹对情感识别效果的影响,同时为了保留更有效的情感脑电成分,首先通过人工检查波形情况手动去除了干扰较为明显的数据片段。其次采用8~60 Hz (包含有效的情感响应频带)的带通滤波器对EEG数据进行滤波。最后对实验数据进行窗长的划分进而实现数据的分段,选取不同时长和不同频段的脑电信号进行更深一步的分析,具体细节部分在实验对比部分给出。

2.2 基于CSP的情感识别

在传统的二分类CSP算法[12]中,训练集会根据情感类型的标签划分为2个子集合,然后分别计算其平均协方差矩阵和广义特征值分解,最终选择最大特征值所对应的特征向量构成CSP空域滤波器{1,2}。由于当前工作主要研究的是基于三分类的情感识别,在此基础上本文选择JAD方法[13]实现多分类的扩展。

JAD方法与传统的两分类CSP算法之间有很多的相似性,主要区别在于特征值的选择准则。为了解决在多分类问题中,当其中某一类特征值最大时,另外两类特征值差异也能达到最大化。JAD方法设置了如下的一个score()函数[14]用于特征值的选择。

2.3 改进的多分类CSP算法

在设计CSP空滤波器的过程中,经过多次实验发现使用传统的JAD方法在解决多分类问题时存在一个严重缺陷。即,针对不同情感状态得分最高的特征值在特征值对角矩阵中处于同一位置。在这种情况下,不同情感状态的EEG数据会对应于同一个特征向量,所设计的空域滤波器也是相同的。此时3种情感状态对应的空域特征没有被准确区分开,所设计的空域滤波器是无效的,影响最终的识别性能。

为了有效的解决上述问题,针对3种情感任务得到的特征值所在对角矩阵中的位置情况,提出一种改进的算法,即“I_JAD”算法。主要实现原理是:将特征值按照由score()函数计算的得分由高到低降序排序,并将每种情感状态下得分最高的特征值在原对角阵中的位置情况存储在,(=1,2,3)中,通过比较其中存储的数字实现了3种不同的特征值选择方法U1,U2和U3的设计。其中,如果得分最高的特征值的位置情况全部不同(即,(=1,2,3)中存储的数字相同的个数为0),此时选择U1方法。算法流程如图4所示。

3 结 果

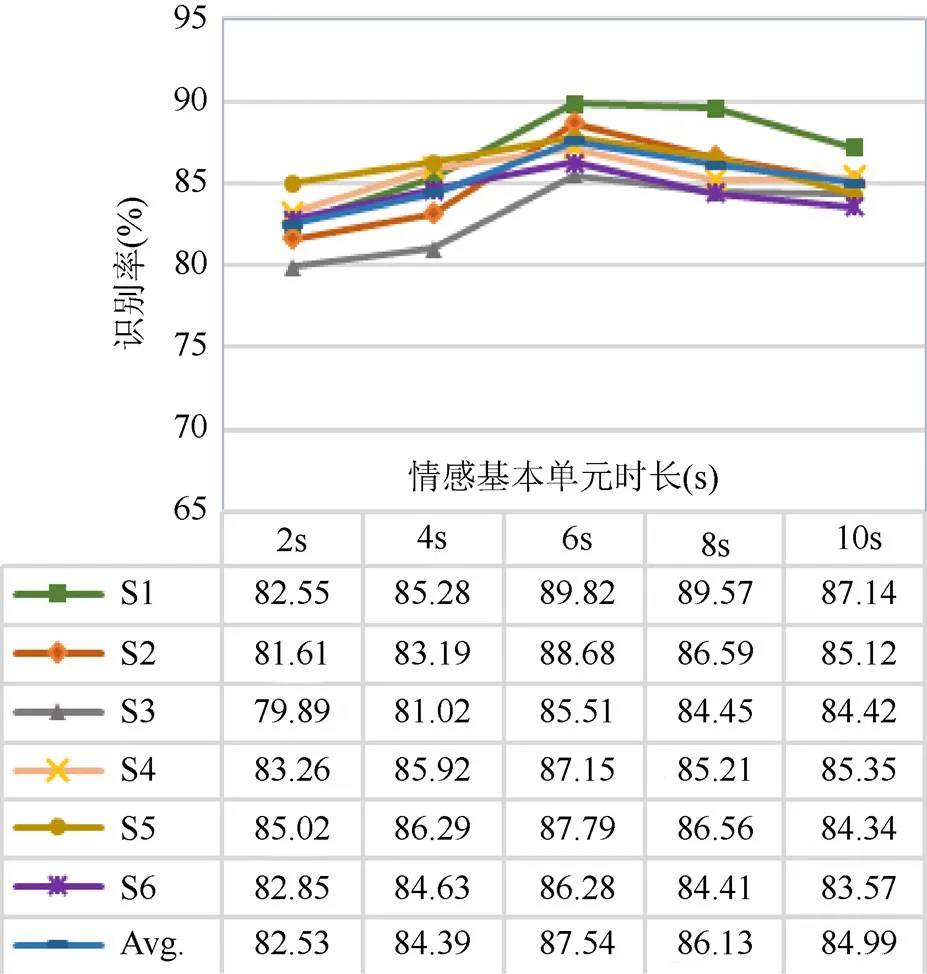

3.1 单次实验的最优长度选择

对于基于CSP的空域滤波方法,为了获得情感基本单元的最优长度,选取了持续时间从2~10 s (以2 s为时间间隔)这5个不同长度的时间窗作对比。对不同长度的时间窗对应的EEG信号进行空域滤波,利用所映射的空域特征对情感状态进行分类。实验结果如图5所示。

从图5可以看出,与其他长度的时间窗相比,该方法在时间窗为2 s时获得最低的平均识别率(82.53%)。随着持续时间长度的增加,平均识别率也逐渐提高,当持续时间达到6 s时,所有受试者的平均识别率达到最高值(87.54%)。随着持续时间的继续增加识别率无明显变化甚至有轻微下降的趋势。分析产生这种现象的原因主要有2个:①情感基本单元(单次样本持续时间)过短,无法有效激发受试者的真实情感,但持续时间过长可能会导致多种情绪状态在同一个数据段内同时存在。②单次Trial持续时间的长短影响着实验样本的数量,数量过少不能够有效的反映情感EEG信号的真实统计特征,过多则可能会增加计算量。经分析最终选择了情感基本单元的最佳长度为6 s。

图4 基于JAD实现不同的特征值选择方法(带有箭头的直线表示特征值按降序排序)

图5 不同时长的单次Trial对比结果(S1~S5表示受试者的编号)

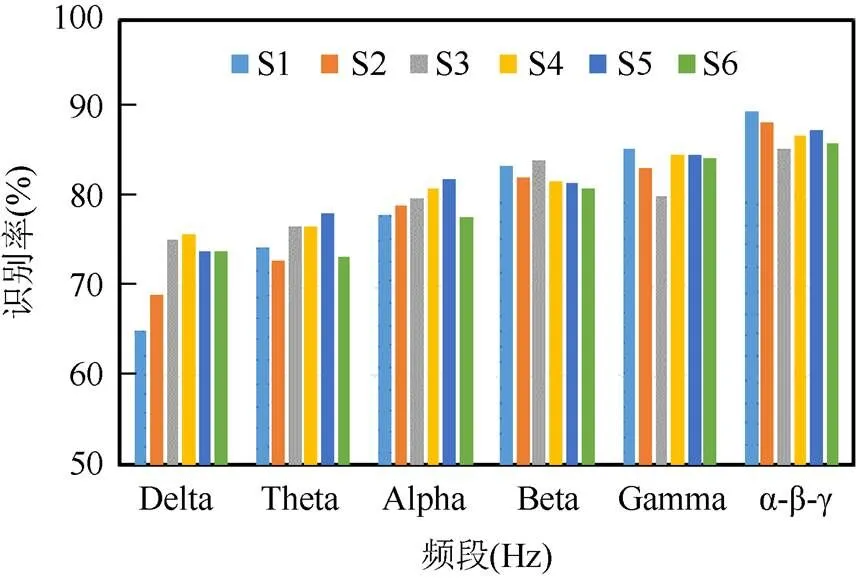

3.2 关键频带分析

为了提取有效的空域特征,对delta (1~3 Hz),theta (4~7 Hz),alpha (8~12 Hz),beta (13~30 Hz)和gamma (31~60 Hz)这5个常用生理频段的EEG信号进行了对比,实验结果如图6所示。

图6 处于不同频段EEG信号的识别结果

图6所显示的结果表明alpha (8~12 Hz),beta (13~30 Hz)和gamma (31~60 Hz)这3个频段的识别性能明显优于其他频段,这表明高频段的EEG信号相较于低频段对情感认知活动的关联性更强。同时,在当前阶段也有相关的研究[15-16]在一定程度上证实了这3个频段对于情感识别的重要性。综上,在实验分析中,选择8~60 Hz (包含alpha,beta和gamma)的频段对于情感识别的研究更有价值,同时本文将此频段命名为‘α-β-γ’。

3.3 对比传统方法

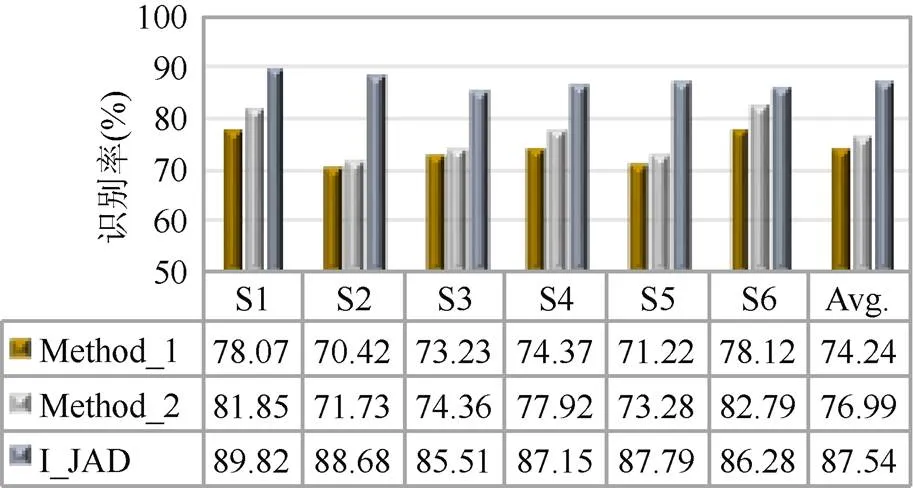

为了验证所提I_JAD算法的有效性,将其与以下2种方法进行比较。方法1:从delta,theta,alpha,beta和gamma这5个频段中提取左右脑的PSD和谱不对称性特征。方法2:利用传统的基于“得分最高的特征值”准则的JAD方法。实验比较结果如图7所示。

从图7可以明显的观察到,空域滤波方法(方法2与I_JAD方法)相较于传统的时-频域方法(方法1),整体识别率都有所提升。方法1取得的平均识别率为74.24%,比方法2和I_JAD方法分别低了2.75%和13.3%。而所提出的I_JAD与方法2相比,平均识别率则增加了10.55%。

图7 不同方法下的识别结果比较

分析造成这种结果差异的原因是由于传统的时-频域分析方法对实际实验中的环境非常敏感,如电极的轻微移动、无意识产生的肌电、脉冲噪声等,这些都可能造成噪声与有用的EEG信号在频谱上的重叠。方法2考虑了时-频域特征的缺点,能在一定程度上抑制干扰噪声的影响,因此与方法1相比,识别性能有了一定的提升。但方法2可能会存在滤波器设计无效的问题,降低空域特征分析在情感识别上的应用性能。空域滤波方法的原理是通过使得各个情感任务能量差异的最大化,来实现有效情感空域特征的提取。这种差异即使在低信噪比(signal-to-noise ratio,SNR)情况下依然存在。因此,提出的I_JAD方法的识别性能要高于上述2种方法,具有一定的鲁棒性。

4 结束语

本文提出了一种基于脑电情感识别的空域滤波方法,利用改进的CSP空域滤波算法在三分类情感脑电信号的识别中达到了87.54%的平均识别率。并且通过一系列对比实验选取了最优的情感基本单元和相关的频带分布。最后与传统的时频域方法进行了比较,结果表明空域特征的获取对于情感识别的应用有显著的性能提升。未来的工作重点将放在对提出的算法进行改进,包括实现噪声抑制与EEG信号质量评估,对CSP算法中的参数进行优化等,并希望将其应用到情感BCI系统的实现中。

[1] RAMADAN R A, VASILAKOS A V. Brain computer interface: control signals review[J]. Neurocomputing, 2017, 223: 26-44.

[2] 于淑月, 李想, 于功敬, 等. 脑机接口技术的发展与展望[J]. 计算机测量与控制, 2019, 27(10): 5-12. YU S Y, LI X, YU G J, et al. Development and prospect of brain computer interface technology[J]. Computer Measurement & Control, 2019, 27(10): 5-12 (in Chinese).

[3] ODA T, KUDOH N S. Heuristic BCI system recognizing the cognitive situation from various EEG patterns induced by the same cognitive task[C]//2018 IEEE International Conference on Systems, Man, and Cybernetics (SMC). New York: IEEE Press, 2018: 3842-3846.

[4] WIDGE A S, DOUGHERTY D D, MORITZ C T. Affective brain-computer interfaces as enabling technology for responsive psychiatric stimulation[J]. Brain-Computer Interfaces, 2014, 1(2): 126-136.

[5] 宗立成. 产品情感配色的计算机辅助设计及其评价方法[J]. 图学学报, 2018, 39(4): 623-628. ZONG L C. On Computer Aided Design of Product Emotion Color Matching and Its Evaluation Method[J]. Journal of Graphics, 2018, 39(4): 623-628 (in Chinese).

[6] DALY I. Affective brain–computer interfacing and methods for affective state detection[M]// Brain–Computer Interfaces Handbook. Boca Raton: Taylor & Francis, CRC Press, 018: 147-164.

[7] 林丽, 阳明庆, 张超, 等. 产品情感研究及情感测量的关键技术[J]. 图学学报, 2013, 34(1): 122-127. LIN L, YANG M Q, ZHANG C, et al. The product emotion and key technologies for emotional measurement[J]. Journal of Graphics, 2013, 34(1): 122-127 (in Chinese).

[8] ZHENG W L, LU B L. Investigating critical frequency bands and channels for EEG-based emotion recognition with deep neural networks[J]. IEEE Transactions on Autonomous Mental Development, 2015, 7(3): 162-175.

[9] HADJIDIMITRIOU S K, HADJILEONTIADIS L J. Toward an EEG-based recognition of music liking using time-frequency analysis[J]. IEEE Transactions on Biomedical Engineering, 2012, 59(12): 3498-3510.

[10] HERWIG U, SATRAPI P, SCHÖNFELDT-LECUONA C. Using the international 10-20 EEG system for positioning of transcranial magnetic stimulation[J]. Brain Topography, 2003, 16(2): 95-99.

[11] SCHAEFER A, NILS F, SANCHEZ X, et al. Assessing the effectiveness of a large database of emotion-eliciting films: a new tool for emotion researchers[J]. Cognition & Emotion, 2010, 24(7): 1153-1172.

[12] ARVANEH M, GUAN C T, ANG K K, et al. Optimizing spatial filters by minimizing within-class dissimilarities in electroencephalogram-based brain–computer interface[J]. IEEE Transactions on Neural Networks and Learning Systems, 2013, 24(4): 610-619.

[13] 吕钊, 陆雨, 周蚌艳, 等. 基于共同空间模式的扫视信号特征提取算法[J]. 华中科技大学学报:自然科学版, 2016, 44(10): 123-127. LV Z, LU Y, ZHOU B Y. Research on feature parameters extracting algorithm of saccade signals based on common spatial pattern[J]. Huazhong Univ. of Sci. & Tech: Natural Science Edition, 2016, 44(10): 123-127.)

[14] NGUYEN T H, PARK S M, KO K E, et al. Multi-class stationary CSP for optimal feature separation of brain source in BCI system[C]//2012 12th International Conference on Control, Automation and Systems. New York: IEEE Press, 2012: 1035-1039.

[15] 陈曾, 刘光远. 脑电信号在情感识别中的应用[J]. 计算机工程, 2010, 36(9): 168-170. CHEN C, LIU G Y. Application of EEG signal in emotion recognition[J]. Computer Engineering, 2010, 36(9): 168-170 (in Chinese).

[16] WANG X W, NIE D, LU B L. Emotional state classification from EEG data using machine learning approach[J]. Neurocomputing, 2014, 129: 94-106.

Extraction of spatial features of emotional EEG signals based on common spatial pattern

YAN Meng-meng1, LV Zhao1,2, SUN Wen-hui1

(1. School of Computer Science and Technology, Anhui University, Hefei Anhui 230601, China; 2. Zhejiang Key Laboratory for Brain-Machine Collaborative Intelligence, Hangzhou Dianzi University, Hangzhou Zhejiang 310018, China)

In order to enhance the performance of electroencephalogram (EEG)-based emotion recognition and improve the accuracy of multi-classification, a spatial filtering algorithm using the common spatial pattern (CSP) was proposed. Firstly, the traditional CSP method was used to design the spatial domain filter. On this basis, three types of emotion recognition EEG signals (i.e., positive, neutral, and negative) were linearly projected by this filter, so as to extract spatial features. Furthermore, considering that the traditional joint approximation diagonalization (JAD) algorithm using the “highest score eigenvalue” criterion may result in the failure to distinguish the multi-classification emotional states, different eigenvalue selection methods were designed in terms of the position of the eigenvalues with the highest scores. Under our lab environment, the comparative experiments using the support vector model (SVM) as a classifier have been carried out. The results show that the CSP-based spatial feature extraction method has an impressive accuracy of 87.54% on average in three-class emotion state recognition, proving the feasibility of the method in the application of emotion recognition.

affective-brain computer interaction; common spatial pattern; joint approximation diagonalization; spatial filtering; emotion recognition

TP 391

10.11996/JG.j.2095-302X.2020030424

A

2095-302X(2020)03-0424-06

2019-11-17;

2019-12-12

国家自然科学基金项目(61972437);安徽省高等学校自然科学基金项目(KJ2018A0008);脑机协同智能技术浙江省重点实验开放基金(BMCI2018-001)

闫梦梦(1995-),女,安徽宿州人,硕士研究生。主要研究方向为生物医学信号处理与人机交互。E-mail:ymm199566@163.com

吕 钊(1979-),男,安徽宿州人,教授,博士,博士生导师。主要研究方向为智能信息处理、人机交互等。E-mail:kjlz@ahu.edu.cn