基于阶梯网络的广告转化率预测∗

李 岩

(江苏科技大学 镇江 212001)

1 引言

随着互联网的快速发展,搜索广告和电商广告在互联网广告中的占比越来越高,成为互联网行业最主要的商业模式之一。与此同时,搜索广告以其巨大的商业价值和研究价值吸引了大量的专家学者,在学术界得到了广泛的研究。搜索广告的转化率,作为衡量广告转化效果的指标,从广告创意、商品品质、商店质量等多个角度综合刻画用户对广告商品的购买意向,即广告商品被用户点击后产生购买行为的概率。

广告数据里总是存在着大量的相关特征和离散特征,如何从这些特征中提取出有意义和健壮的特征显得尤为重要。传统的特征工程往往需要丰富的先验知识和大量的搜索与尝试,因此建立一个模型都会在特征工程上花费大量的时间和精力。本文利用阶梯网络保留其中更为健壮的特征来替代原来的特征工程并改进算法效果。

线性模型[1]是一种简单并且易于解释的方法,但是表达能力往往有限。本文将阶梯神经网络[2]应用到数据挖掘中去,并根据数据挖掘的数据特征,将其与交叉网络结合,生成更加有意义和健壮的特征,从而提升算法的效果。

2 相关工作

利用无监督学习来学习特征的方法有很多,比 如 经 典 的 自 编 码 器[3~5],以 及 降 噪 编 码 器(DAE)[6~7]。自编码器在函数形式上与 RBM[8]十分相似,尽管它们在原理和训练方式上不尽相同。深度置信网络(Deep belief networks[9])在提取层次化的特征方面效果也很好。

将有监督学习和无监督学习结合的算法早已有之,但是这些算法[10~11]都是将无监督学习作为预训练步骤来辅助有监督学习的进行。阶梯网络结合DAE和噪源分离结构(DSS)[12],将有监督学习与无监督结合起来去发现有用于分类任务的特征,共同训练有监督学习网络和无监督学习网络,通过在解码器部分增加与编码器的连接来改善特征学习的效果并在半监督学习任务上取得了较好的效果。

DAE(降噪自编码器)从加入噪声的信号x͂里学习原信号x,通过最小化重建信号x̂与x之间的误差来训练网络,目标函数为‖‖x-x̂2。DAE只考虑源信号和重新构建的源信号之间的误差,阶梯网络还考虑到了隐变量z和重建的隐变量ẑ之间的误差,损失函数形式与DAE相同,为‖‖z-ẑ2。阶梯网络和DAE的另一个区别在同层的编码部分和解码部分之间多了一重连接,这种结构被证明可以更有效地使高层网络专注于更为抽象的特征[13],使其更适合有监督学习,从而获得有效的有监督学习特征。阶梯网络可以理解为一系列嵌套的DAE的集合,使得该网路结构更容易解释和理解。

3 模型实现

本章主要介绍该模型的具体结构。首先将稀疏特征通过嵌入层进行降维,然后输出和密集特征进行合并,最后再通过阶梯网络输出最终结果。模型整体架构如图1所示。

图1 模型总体结构图

3.1 嵌入层与混合层

广告转化率预测(CVR)数据的特征中存在很多的类型特征,在对其进行one-hot编码后维度很高,为了避免维灾难我们利用嵌入层对稀疏特征进行降维,嵌入层的计算公式如式(1),Xi是特征i,Xembed,i是特征i进行嵌入后的向量:

然后将降维后的向量与稠密向量进行组合,组合方式只需简单将向量合并,具体方法如式(2)所示,Xcom是组合后的向量,Xdense是未经降维的原始稠密向量:

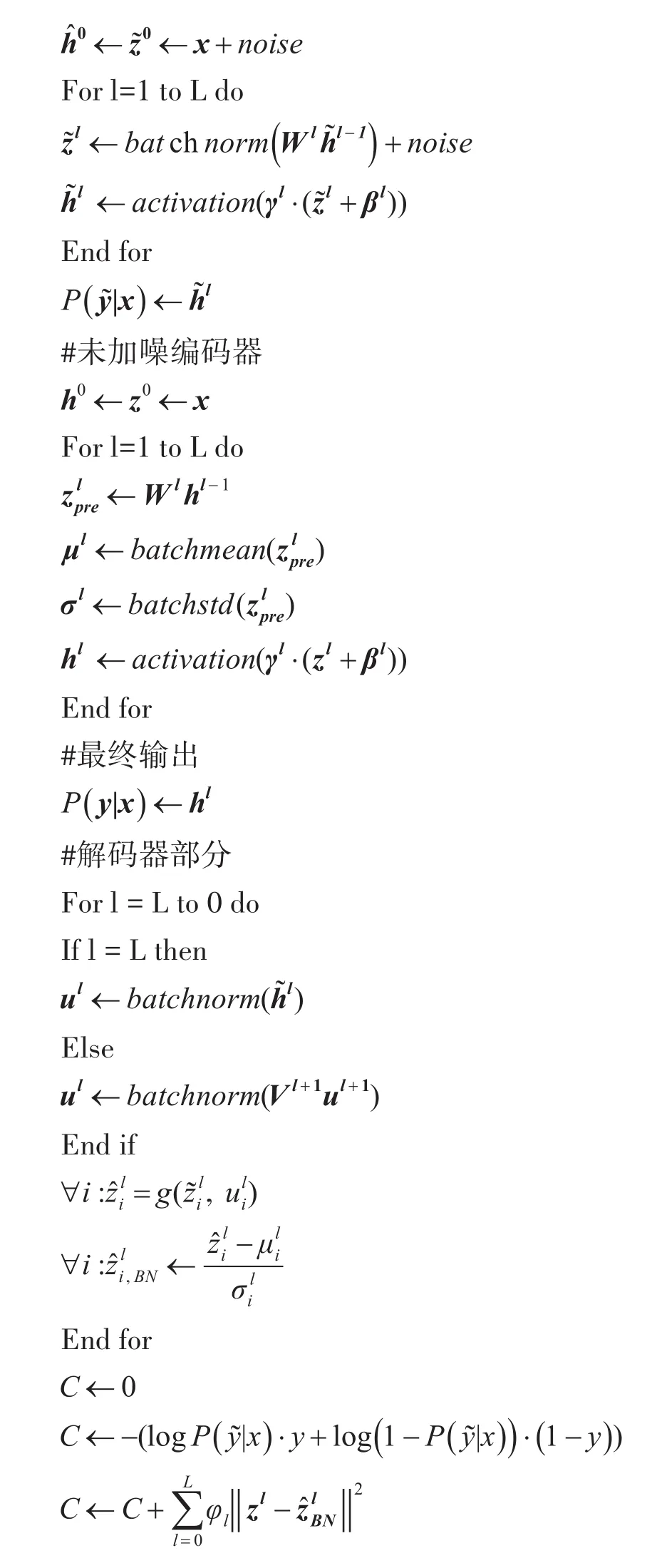

3.2 阶梯网络

图2 阶梯网络结构

阶梯网络具体算法如下,x为输入向量,噪声(noise)分布服从标准差为σ标准正态分布。Batchnorm为批标准化函数,activation(激活函数)除了输出层均使用relu函数,输出层使用sigmod函数。降噪函数如下式:

算法一:阶梯网络算法

#加噪编码器

4 实验结果

本部分会对实验步骤进行介绍,并在广告转化率数据集上进行实验,并对实验结果进行分析。

4.1 广告转化率数据

本文选用阿里妈妈广告营销的数据集,该数据集大概包含1700万条用户记录,时间跨度为一周。论文将前六天数据作为训练集,将最后一天的数据随机分为验证集和测试集。数据包含25个整型特征和7个基数很高的类型特征。由于用户基数很大,对实验结果0.001的改进对公司来讲都会是一笔不小的利润。

4.2 模型细节

论文利用tensorflow实现该模型,下面简单介绍模型的细节。

数据预处理和嵌入层:所有的实值特征都会进行对数变换,对于每个类型特征,通过嵌入层降维到log(基数)+1。

优化算法:论文采用Adam优化算法[14]去求解变量。阶梯网络引入批标准化,批量大小设为500。

超参数:通过网格搜索来寻找隐层数量和大小,以及交叉层数量,和初始学习率的最优值。阶梯网络隐层数量范围为1~4,神经元数量范围为100~800。

4.3 模型性能分析

本部分首先对阶梯网络和DNN的最优性能进行了比较,然后再将两个模型不同超参数的细节进行可视化,包括两个模型验证误差的比较,以及对阶梯网络模型不同参数模型的对比。

两个模型在测试集上使用交叉熵作为比较标准。阶梯网络在隐层数量为4,隐层节点数为800时表现最优,DNN则是在隐层数量为2,隐层节点数为200表现最优。在两个模型的最优参数下,都分别独立进行了10次实验,模型交叉熵损失的均值和标准差如下:阶梯网络:0.188±9×10-5,DNN:0.204±3.7×10-4。可以看出阶梯网络的表现是优于DNN的。

表1展示了两个模型在相同隐层数量,相同隐层节点数的情况下,模型性能表现的差值。负值代表本文模型优于DNN。可以看出,几乎在所有的情况下,阶梯网络的性能都是优于DNN的。

表1 阶梯网络和DNN在相同参数下的验证误差的差值

阶梯网络在不同隐层数量和节点数下的交叉熵损失如图3所示。可以看出,随着隐层数量和节点数的增加,模型的表现也越来越好。但是当隐层数量超过3时,模型性能提升并不理想。

5 结语

数据挖掘中关键部分就是特征工程,特征工程的质量总是与丰富的先验知识有着很大的关系,因此消耗的时间和成本也随之增大。论文将阶梯网络应用于广告转化率的预测中去,与DNN相比,在有效地提取更为健壮的特征,提高模型的精度上有更好的效果。

图3 不同隐层数量和节点数的损失

下一步研究将会考虑使阶梯网络模块化,更好地与不同类型的网络结合,生成更具表达力的特征。