水稻收获作业视觉导航路径提取方法

关卓怀 陈科尹 丁幼春 吴崇友 廖庆喜

(1.华中农业大学工学院, 武汉 430070; 2.农业农村部南京农业机械化研究所, 南京 210014)

0 引言

水稻是我国的主要粮食作物,收获是水稻生产的重要环节。水稻收获须在黄熟期到完熟初期的5~8 d内完成,否则会直接影响产量、品质和下茬作物种植时机。收获时,机手需要根据作物长势和收获效果及时调整工作部件运行参数。自动导航技术的不断成熟,极大地提高了机械的田间作业品质和效率,降低了驾驶员劳动强度。通过机器视觉识别水稻已收获与未收获区域之间的分界线,再根据当前车辆位置与航线之间的像素差,计算航向偏差与横向偏差,是规划收获作业导航路径的一种有效手段[1-3]。

针对农田作业机具的作物线提取和视觉导航技术,国内外学者已开展了研究。文献[4]通过提取图像中的G值,区分果园中树冠与背景,拟合树行中心线为导航线,试验表明,自主导航系统在桃园中的行进误差的均方根为2.13 cm。文献[5]设计了ROI区域动态选择方法,使用3B-R-G法对彩色图像进行灰度化处理,基于过已知点的Hough变换法检测棉花收获导航线。文献[6]运用2G-R-B灰度化算法和随机Hough变换检测作物中心线,通过像素信息与世界坐标的变换,提取了位置偏差信息。文献[7-10]采用与光照无关的Cg分量对彩色图像进行灰度化处理,分别利用基于线性相关系数约束法和改进的遗传算法提取作物行中心线,两种方法对横向偏差的检测平均误差分别小于12 mm和33 mm,但基于线性相关系数约束法的图像处理耗时较长。文献[11]基于HSV色彩空间对大拱棚路径图像信息进行处理,以道路尽头横向中心点作为导航信息标定点,导航线横向平均识别偏差为2.4 cm。文献[12]基于图像中I分量对番茄垄间道路图像进行灰度化处理,采用最小二乘法拟合导航线离散点,结果表明,该算法对导航线拟合的平均正确率达91.67%,平均相对偏差率0.71%。文献[13-14]提出了基于图像旋转投影的导航路径检测算法,并且在大曲率路径时,采用双切线法估计转弯半径,识别准确率达95%以上。综上,由于机器视觉系统易受光照条件、阴影噪声等环境因素的影响,故要求图像处理算法具有良好的鲁棒性和实时性,从而确保自动导航系统的作业精度。现有作物线提取方法大多将作物线视作直线进行拟合,但因作物生长和收获时情况复杂,作物线往往为不规则形状,采用直线法拟合作物线必然导致航线提取的偏差。

为解决上述问题,本文提出一种水稻收获作业视觉导航路径提取方法。通过相机标定获取相机内部参数和畸变参数,矫正原始图像,高斯滤波钝化图像,采用2R-G-B超红特征模型的综合阈值进行图像二值化分割,基于形态学的开-闭运算抑制二值图像中的噪声干扰,根据图像灰度垂直投影值动态设定ROI区域,水平扫描获取作物线关键点,采用多段三次B样条曲线拟合法提取水稻待收获区域边界线,最后通过室内试验和田间试验对视觉导航路径提取方法进行验证。

1 图像预处理

1.1 畸变矫正

通过相机采集到的田间图像是像素信息,需获取相机的内部参数,把图像间的像素关系转换为具体物理单位。同时,由于镜头存在畸变,需要获取相机的畸变参数,再进行图像矫正。

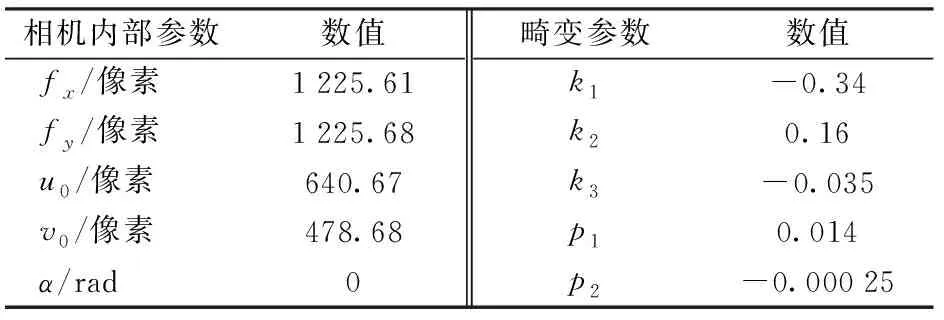

本文基于张正友法[15],通过40幅不同角度的标定板图像完成标定。标定软件如图1所示。标定结果如表1所示。平面靶标图像特征点的平均像素误差perr为0.1像素,绝对误差ferr为0.25 mm。

图1 相机标定软件界面Fig.1 Camera calibration software interface

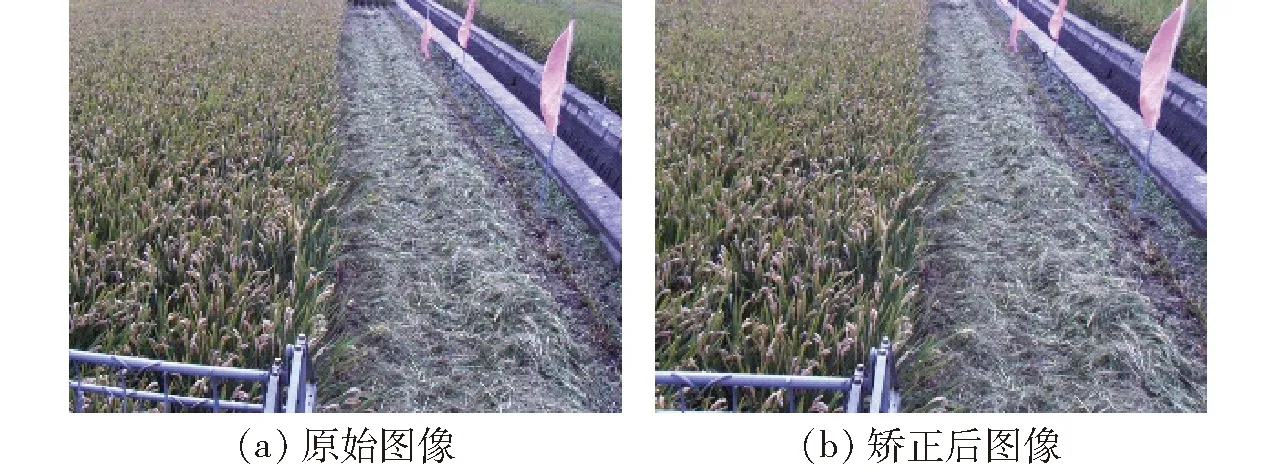

基于相机标定结果获得已知像素与其世界坐标的映射关系,对畸变图像进行变换缩放,生成消除透视畸变和镜头畸变的矫正图像,矫正后的图像如图2所示。

1.2 高斯滤波

图像处理过程中易受到噪声的干扰而产生误判或丢失重要信息。图像增强可以有目的地强调图像的某些特性,抑制不感兴趣区域,加强图像判断和机器决策效果。对于水稻收获图像,作物间的空白和作物线附近突出的水稻茎秆都会影响导航路径的提取。本文基于高斯平滑滤波,通过降低图像细节进行模糊化,降低噪声的干扰。二维高斯滤波函数为

表1 相机标定结果Tab.1 Result of camera calibration

注:fx、fy为焦距f在x、y方向上的值,u0、v0为主点(图像原点)坐标值,k1、k2、k3为径向畸变系数,p1、p2为切向畸变系数。α为相机内部参数成像平面倾角。

图2 图像畸变矫正结果Fig.2 Image distortion correction

(1)

式中 (x,y)——像素点坐标

σ——正态分布的标准差

像素点坐标在图像处理中是整数,正态分布的标准差决定高斯滤波模板的宽度。认为3σ距离之外的像素对中心点不起作用,设3σ取整后的值为k,则高斯滤波窗口为(2k+1)×(2k+1)矩阵。使用模板对窗口矩阵内的像素进行卷积,矩阵内每个像素都是周围相邻像素加权平均,令矩阵中心点的像素等于加权平均值。通过高斯函数离散化得到的高斯函数值作为滤波模板系数,窗口矩阵内各元素的值为

(2)

如果σ较小,则生成模板的中心系数较大,周围的系数较小,对图像的平滑效果不明显;反之,若σ较大,则生成模板的各个系数相差不是很大,图像的平滑效果比较明显,通过试验,根据图像调节σ,抑制噪声。本文取σ=0.7,滤波窗口为一个5×5的矩阵。滤波前图像如图2b所示,滤波后图像如图3所示。

图3 高斯滤波后图像Fig.3 Image after Gauss filter

1.3 图像灰度化与二值化

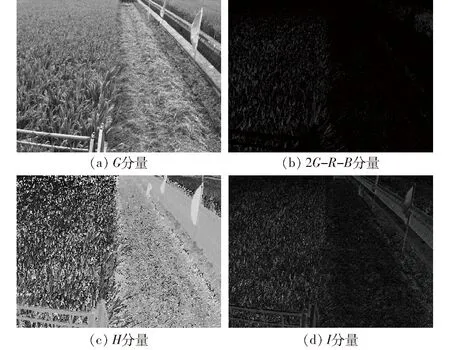

为提取图像中的作物边界,需要将彩色图像转换成灰度图像,以统计像素灰度信息。RGB、HSV和HSI是农业工程图像处理领域常用的颜色模型[16-18]。基于多种颜色模型和常用的灰度化算法对收获图像进行灰度化后的结果如图4所示,包括RGB的G分量(图4a)、RGB的2G-R-B分量(图4b)、HSV的H分量(图4c)、HSI的I分量(图4d)。

图4 颜色空间分量图Fig.4 Component graphs of each color space

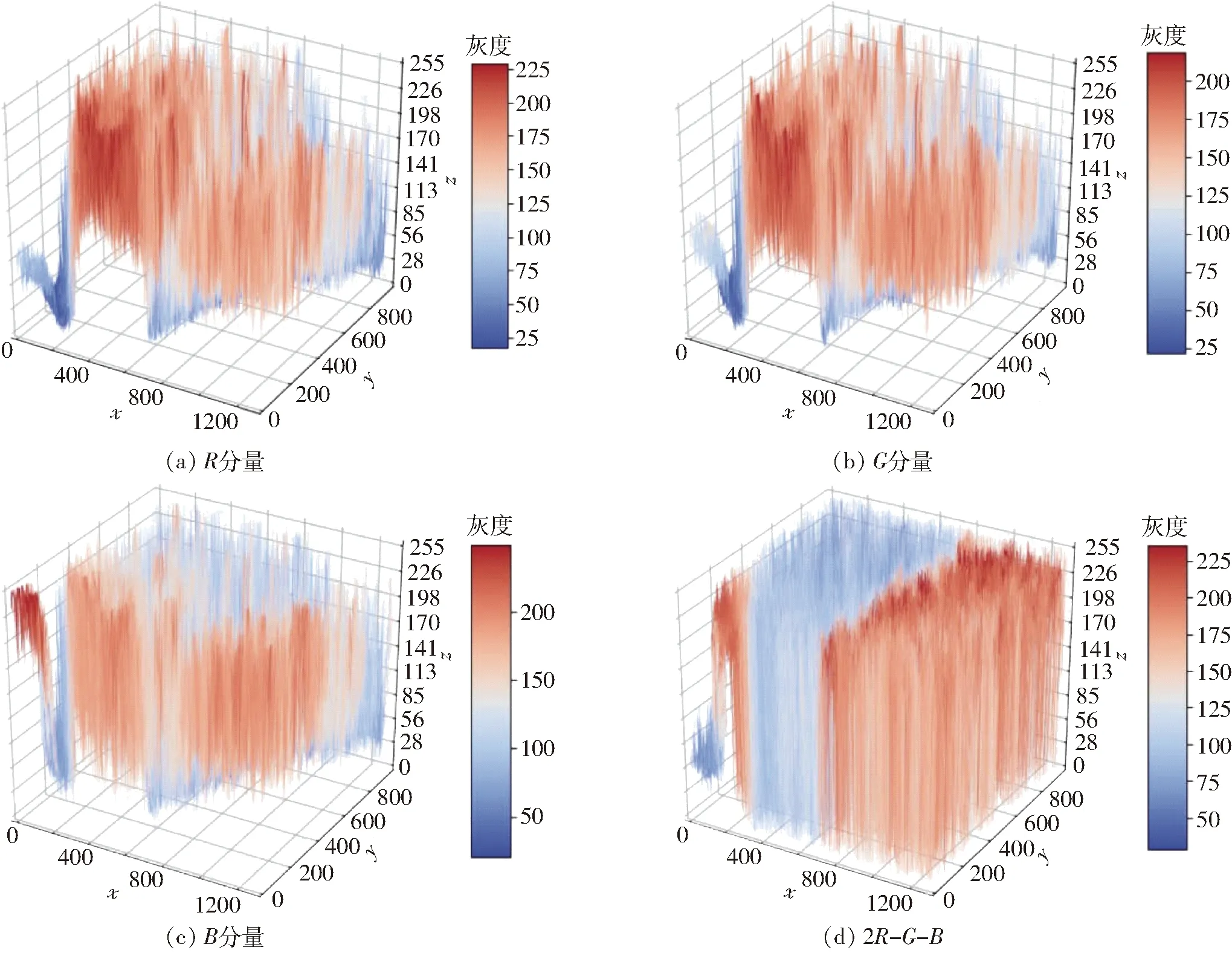

由图4a可知,水稻收获区域灰度图像中,已收获区域与未收获区域边界并不明显,图4b~4d中在未收获区内部,存在较多噪声,不利于作物线的提取。水稻收获图像主要由已收获的水稻区域、未收获的水稻区域和两个区域间的田地组成。从颜色看,已收获区域主要覆盖为联合收获机碎草机构打碎的秸秆,以绿色为主;未收获区域中,水稻谷穗为黄色,叶片和茎秆为绿色;背景田地为红黑色,颜色特征区分较为显著。对图像在RGB空间的分布特征进行定量分析,基于Python和Matlab提取了各颜色特征空间,如图5所示。

图5 颜色特征空间与图像灰度化效果Fig.5 Color space and gray processing

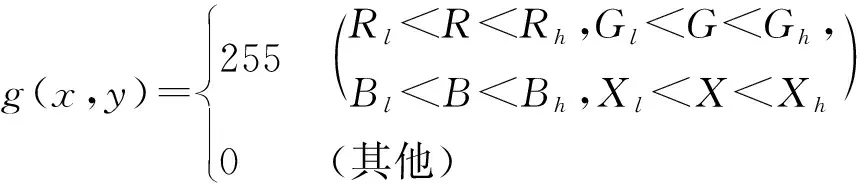

由图5a~5c可知,收获图像中R、G、B分量在各个区域交互存在,不易直接区分。由图5d可知,图像经2R-G-B运算后,可明显区分已收获区域与未收获区域,且能够突出作物线同田间背景的对比度,适合作为水稻收获图像的灰度化算法。根据这种颜色空间分布特征,本文提出了一种基于2R-G-B超红特征模型的综合阈值二值化算法,设X=2R-G-B代表超红分量,Rl、Gl、Bl、Xl为各分量的阈值下限,Rh、Gh、Bh、Xh为各分量的阈值上限,算法表达式为

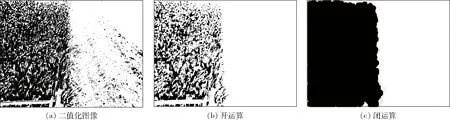

图6 二值化与形态学处理结果Fig.6 Results of binary and morphology

(3)

式中g(x,y)——点(x,y)的灰度

设定各分量阈值,作为图像灰度化、二值化的依据,区分已收获区域与未收获区域,二值化处理后的收获图像如图6a所示。二值化图像中,未收获区域存在噪声点,已收获区域中也存在大量空洞。为了消除这些干扰,基于形态学处理方法,先对二值图像进行开运算,消除未收获区域的噪声点(图6b),再进行闭运算,填充已收获区域中的孔洞(图6c),得到可以进行边界拟合的二值化图像。

2 作物线拟合

2.1 感兴趣区域设定

作物线识别过程中,图像处理运算量过大会增加计算时间,影响系统工作的实时性。感兴趣区域(Region of interest,ROI)是从图像显示窗口中选择的一个关键部分,减少数据处理量,提高系统的处理速度。但是由于作物线在图像中的位置是随机的,无法确定ROI位置。若ROI区域无法涵盖整个作物边界,必然导致关键点的失拟,但ROI区域过大又会增加计算量。为解决此类问题,本文提出了基于垂直投影法的动态ROI区域设定算法。

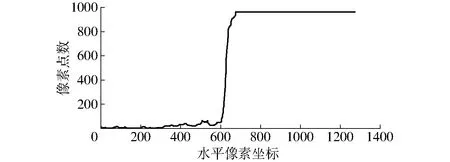

在二值图像中,未收获区域在图像左侧为黑色(灰度为0),未收获区域在图像右侧为白色(灰度为255)。将图像进行垂直投影,若像素灰度为255则累加,统计各列灰度为255的像素点数M。设第i列像素点数Mi为最大值,这表明此列白色像素点最多,必然是未收获区域。设定未收获区域在图像左侧,若存在多列M值相同,则取最左侧列;未收获区在右侧同理,在试验前进行设定。以列像素位置为中线,左右取200像素宽,即为感兴趣区域,垂直投影统计的像素如图7所示。

图7 像素垂直投影Fig.7 Pixel vertical projection

2.2 关键点选取与作物线拟合

现有作物线拟合方法包括Hough变换及其改进算法[3]、最小二乘法[19]、垂直投影法[20]等。这些拟合方法针对直线型作物线的拟合效果较好,但对于曲线型和不规则形状的作物边界,作物线拟合误差增大。受田间复杂环境和作物长势影响,作物边界一般不会为严格的直线。本文采用水平扫描法,提取作物线拟合关键点的横坐标,并提出一种基于三次B样条曲线的作物线拟合方法,以适用于各类边界形状的作物线。

设拟合关键点坐标为(xi,yi),图像二值化后未收获区灰度为0,已收获区的灰度为255,两者的分界点就是灰度由0变为255的点。所以在ROI内进行水平扫描,就可以确定分界点,即作物线拟合关键点xi。

关键点的数量影响作物线拟合质量。选取过多会增加计算量,过少则影响拟合精度。设每隔l行提取一个关键点,则关键点数量为

m=V/l

(4)

式中m——关键点数量

V——图像像素总行数

根据关键点数量,将图像沿纵向平均分割,区域也为m个,取每个区域内形心的纵坐标yi为拟合定位点的纵坐标

(5)

式中y——像素纵坐标

A——区域内像素点的集合

j——区域内的像素点数

在ROI内以从上到下的顺序进行m次水平扫描,即可获取所有的拟合关键点。在获取关键点后进行曲线拟合。

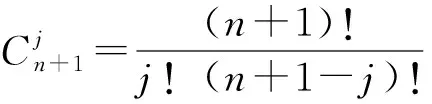

设样条曲线基于给定的n+1个控制点pi(i=0,1,2,…,n),n次B样条曲线段的参数表达式为

(6)

式中Fi,n(t)——n次B样条基函数

Fi,n(t)展开式为

(7)

(8)

本文基于三次B样条曲线进行作物线拟合,取n=3,样条曲线基函数为

(9)

矩阵形式为

(10)

将相邻两个定位点归为一组,每组通过插值运算生成4个控制点,生成单条三次B样条曲线,整幅图像共拟合m-1条三次B样条曲线。所以,作物线的表达式为m-1条所拟合的三次B样条曲线组成的分段函数

(11)

三次B样条曲线拟合的关键点越多,曲线越光滑,拟合的精度也越高,但关键点过多会导致曲线过拟合,同时增加计算量,影响图像拟合的实时性。本文取l=60,图像尺寸为1 292像素×964像素,则关键点数m=15,所拟合的作物线如图8所示。

图8 作物线拟合结果Fig.8 Fitting result of crop line

3 试验与结果分析

3.1 坐标变换

图像使用大恒MER-125-30GC型工业相机拍摄,130万像素,配置H2Z0414C-MP镜头。用于 图像处理的计算机处理器为Inerl Core i7,主频2.5 GHz,内存16 GB;图像处理程序基于Microsoft Visual Studio 2015和OpenCV 3.3开发。

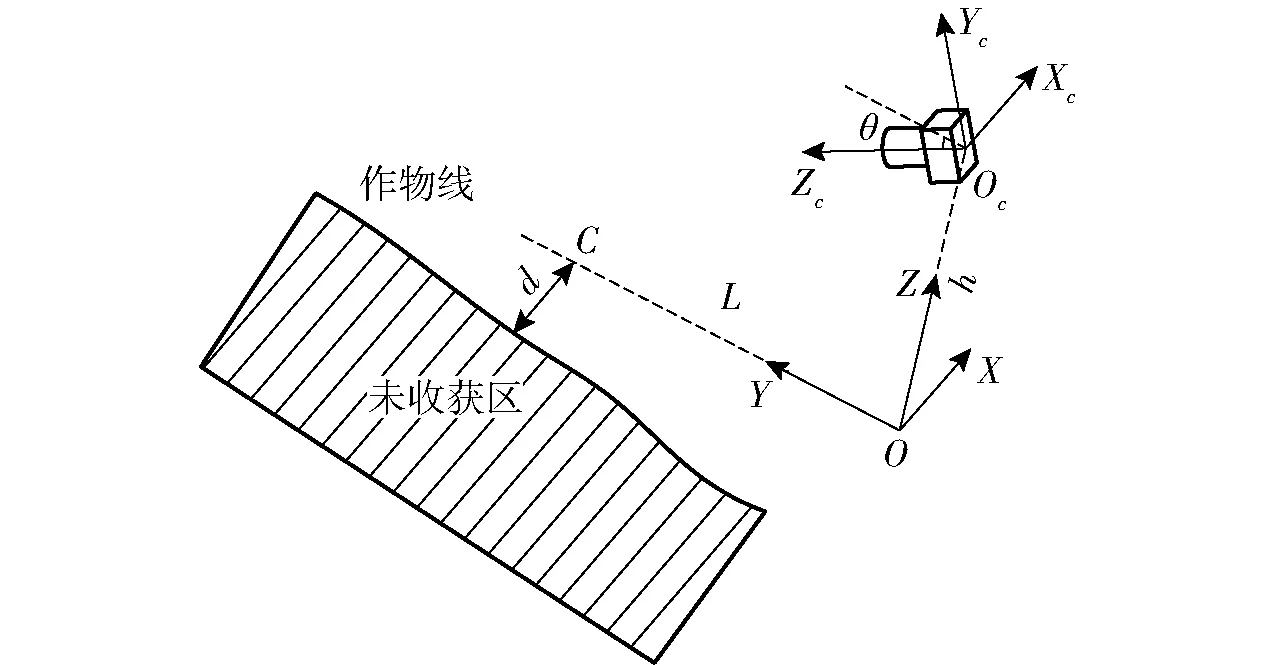

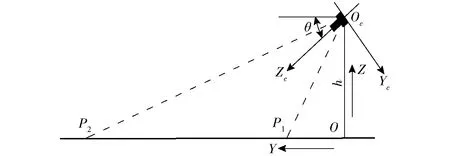

为了将图像像素信息转换为实际位置信息,需要将相机坐标系转换至世界坐标系,进而将图像中的像素点数关系转换为实际的距离和角度关系。如图9所示,设Oc为视觉坐标系OcXcYcZc的原点,相机的右方为Xc轴(图9中为垂直于直面向内),O为相机坐标系原点在地面的投影,作为世界坐标系OXYZ的原点,X方向与Xc一致。

图9 相机坐标系与世界坐标系的位置关系Fig.9 Positional relationship between camera coordinate system and world coordinate system

相机坐标系至世界坐标系的转换矩阵为

(12)

式中θ——相机与水平面的夹角,(°)

h——相机中心距离地面高度,m

设作物线拟合点为C(xC,yC),前视距离L=yC,则横向偏差d=xC。

3.2 室内试验

通过室内试验,检验相机标定的准确性和图像处理算法的有效性。见图10,室内试验时,相机的安装位置与地面的距离h=1.58 m,相机轴线与水平面的夹角θ=30°,摄像机视野范围lP1P2=11.88 m,lOP1=1.32 m,lOP2=13.20 m。

图10 相机安装位置Fig.10 Installation location of camera

如图11所示,通过本文的图像处理方法,计算地面白色纸带上红色圆点的圆心距和白色纸带间的夹角,并与实际值进行对比。纸带上贴有10个红色圆点,相邻圆点的圆心间距为500 mm。

图11 室内试验Fig.11 Laboratory test

基于机器视觉计算相邻圆心的间距,改变相机的摆放位置,重复试验,检验距离识别精度。试验共重复6组,每组试验输出9个距离检测值,试验结果如表2所示。

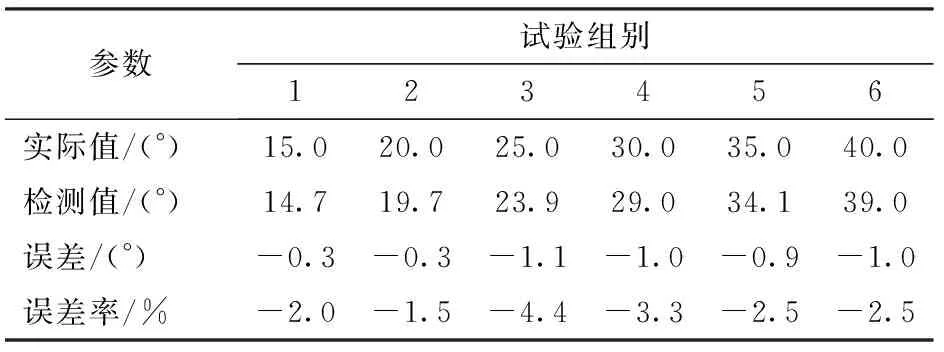

同理,在地面上贴两条带有红色圆点的白色纸带,通过本文所述方法计算两纸带的夹角,试验共进行6组,试验结果如表3所示。

表2 距离识别结果Tab.2 Distance calculation result

表3 角度识别结果Tab.3 Angle calculation result

试验表明,图像处理获得的圆心距与实际值相比,平均误差为9.9 mm,偏差率2.0%,方差为44.8 mm2,均方差为6.5 mm;角度检测试验平均误差0.77°,误差率2.7%,方差0.13(°)2。距离检测平均误差小于1 cm,角度检测平均误差小于0.8°,室内试验表明,相机标定准确,图像处理方法有效,可以较好地开展距离识别和角度计算。

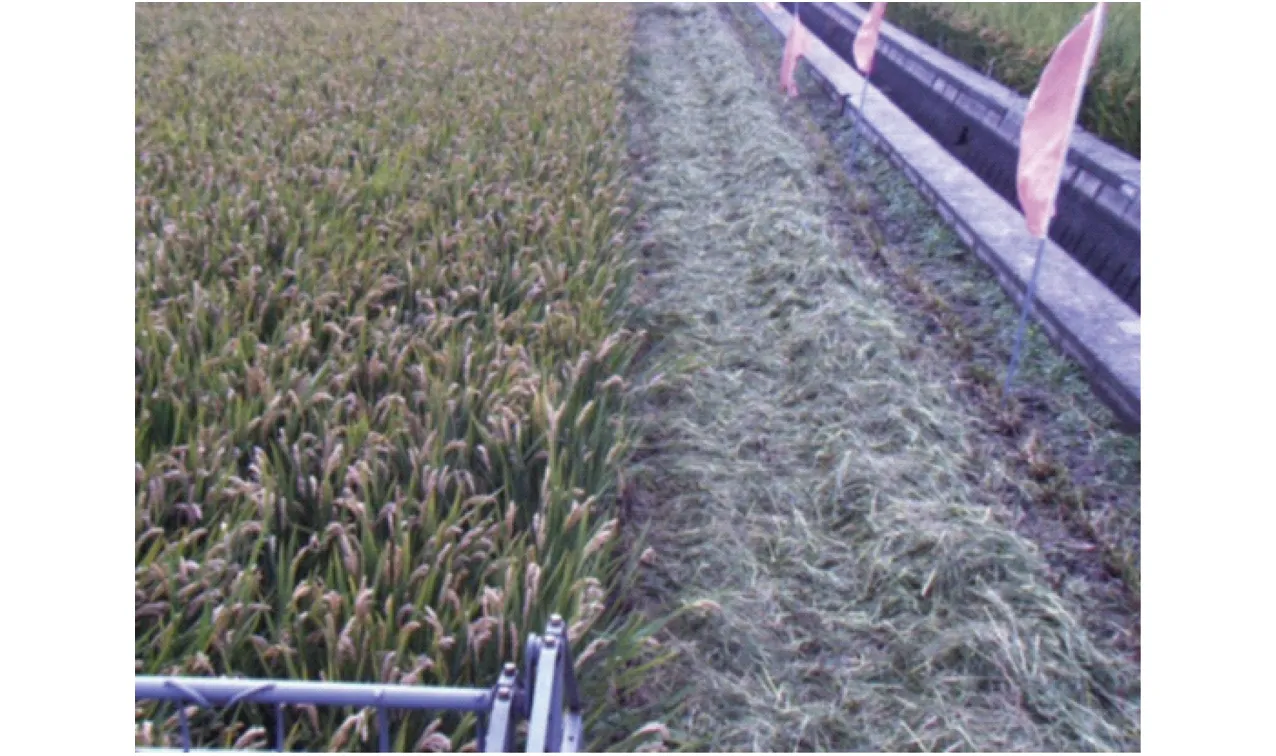

3.3 田间试验

试验在泰州红旗农场水稻田中进行,田间试验过程中,相机安装在星光4LZ-5型履带式联合收获机操作台右前方。相机高度h=2.35 m,相机轴线与水平面向下的夹角θ=30°,联合收获机工作速度约为1.1 m/s。通过检测所拟合的作物线与图像中心线的距离偏差,对比实际偏差,检验作物线拟合结果。验证图像处理算法在不同光照环境下、对各类形状的作物边界线进行检测的结果。

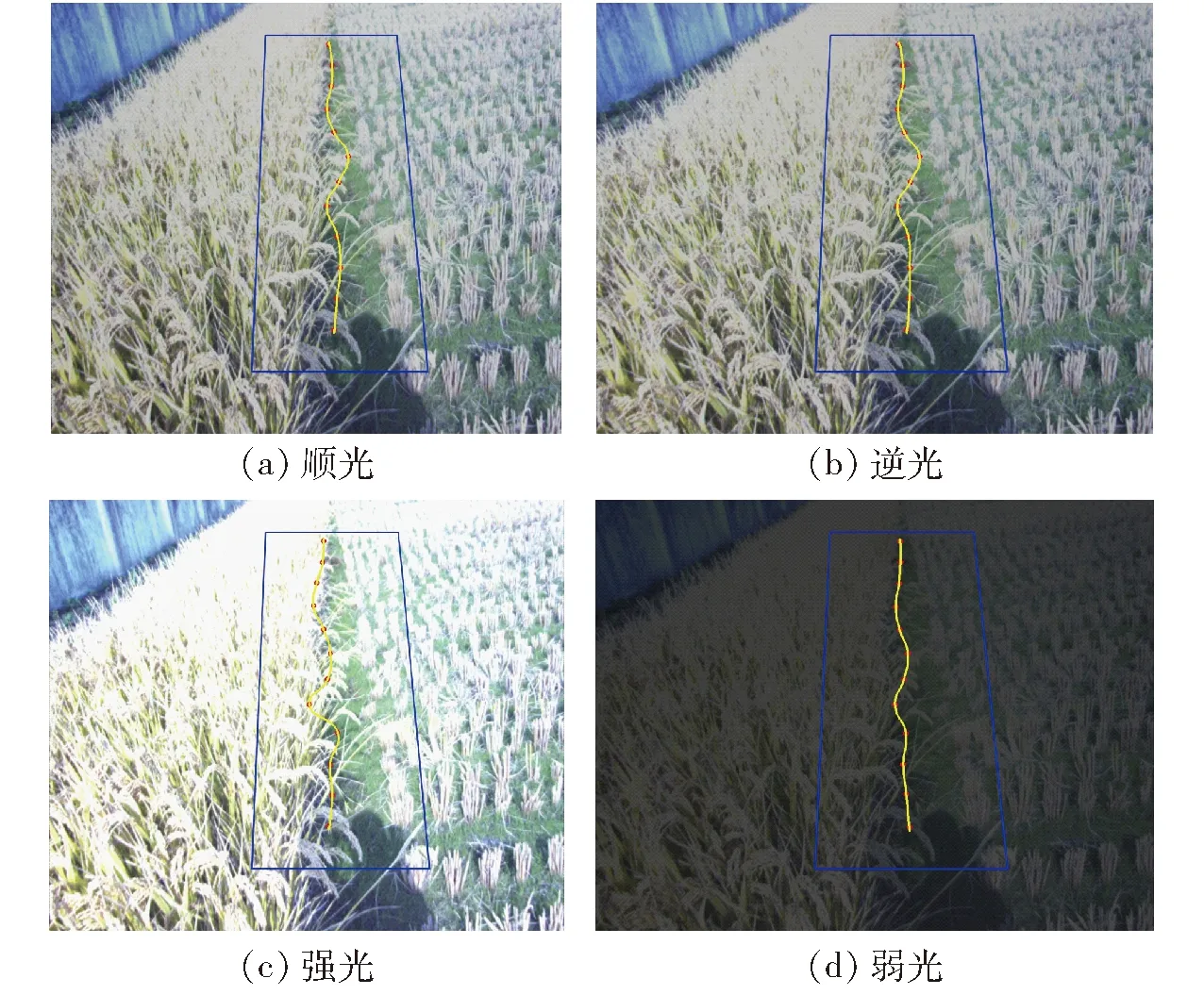

在顺光、逆光、强光、弱光环境下对两种不同品种水稻(中粳798、临稻20)收获期的作物线进行识别,拍摄同时从连续视频帧上截取处理用图像,保存为JPG格式进行图像处理。在顺光、逆光、强光、弱光环境下,采集了中粳798、临稻20两个品种的收获图像并进行处理。记录图像处理时间,平均每帧图像处理耗时分别为33、35、38、48 ms和35、33、37、45 ms,单帧图像平均处理时间38 ms,可以实现作物线的实时拟合。

人工标识图像作物边界,并与机器视觉自动拟合的作物线作物边界进行对比,获取导航路径提取的像素误差ep,并通过式(12)转换为世界坐标系下的距离误差ew,相对误差为

(13)

式中er——相对误差,%

H——图像横向像素数

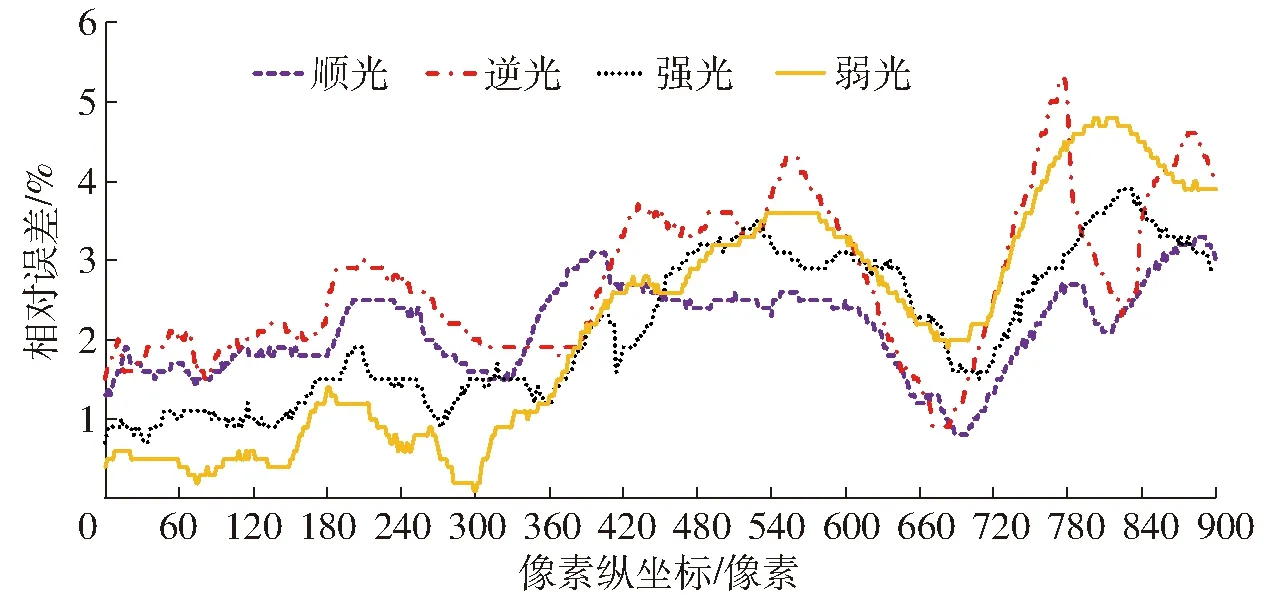

中粳798作物线识别结果如图12所示,关键点的拟合误差计算结果如表4所示,作物线识别相对误差随像素纵坐标的变化如图13所示。

图12 中粳798作物线拟合结果Fig.12 Zhongjing 798 crop line fitting result

由表4可知,对于拟合中粳798作物线的15个关键点,顺光环境下像素误差范围为16~36像素,平均像素误差26.9像素,标准差为6.8像素,实际距离误差为12~46 mm,平均距离误差30.7 mm,相对误差1.2%~2.8%,平均相对误差2.1%;逆光环境下像素误差范围为18~63像素,平均像素误差35.2像素,标准差为11.9像素,实际距离误差为13~53 mm,平均距离误差38.1 mm,相对误差1.4%~4.9%,平均相对误差2.7%;强光环境下像素误差范围为9~47像素,平均像素误差26.2像素,标准差为12.0像素,实际距离误差为15~40 mm,平均距离误差26.3 mm,相对误差0.7%~3.6%,平均相对误差2.0%;弱光环境下像素误差范围为0~58像素,平均像素误差26.7像素,标准差为18.7像素,实际距离误差为0~42 mm,平均距离误差23.9 mm,相对误差0~4.5%,平均相对误差2.1%。

表4 中粳798作物线15个关键点的横向偏差计算结果Tab.4 Calculation results of lateral deviation of 15 key points of Zhongjing 798 crop line

图13 中粳798作物线识别相对误差Fig.13 Relative error of Zhongjing 798 crop line recognition

对于中粳798的收获图像,强光环境下平均像素误差最小,为26.2像素,弱光环境下平均距离误差最小,为23.9 mm,强光环境下平均相对误差最小,为2.0%,顺光环境下稳定性最好,标准差为6.8像素。4种光线环境下,中粳798作物线关键点识别的平均像素误差为28.7像素,平均距离误差39.7 mm,平均相对误差2.7%。

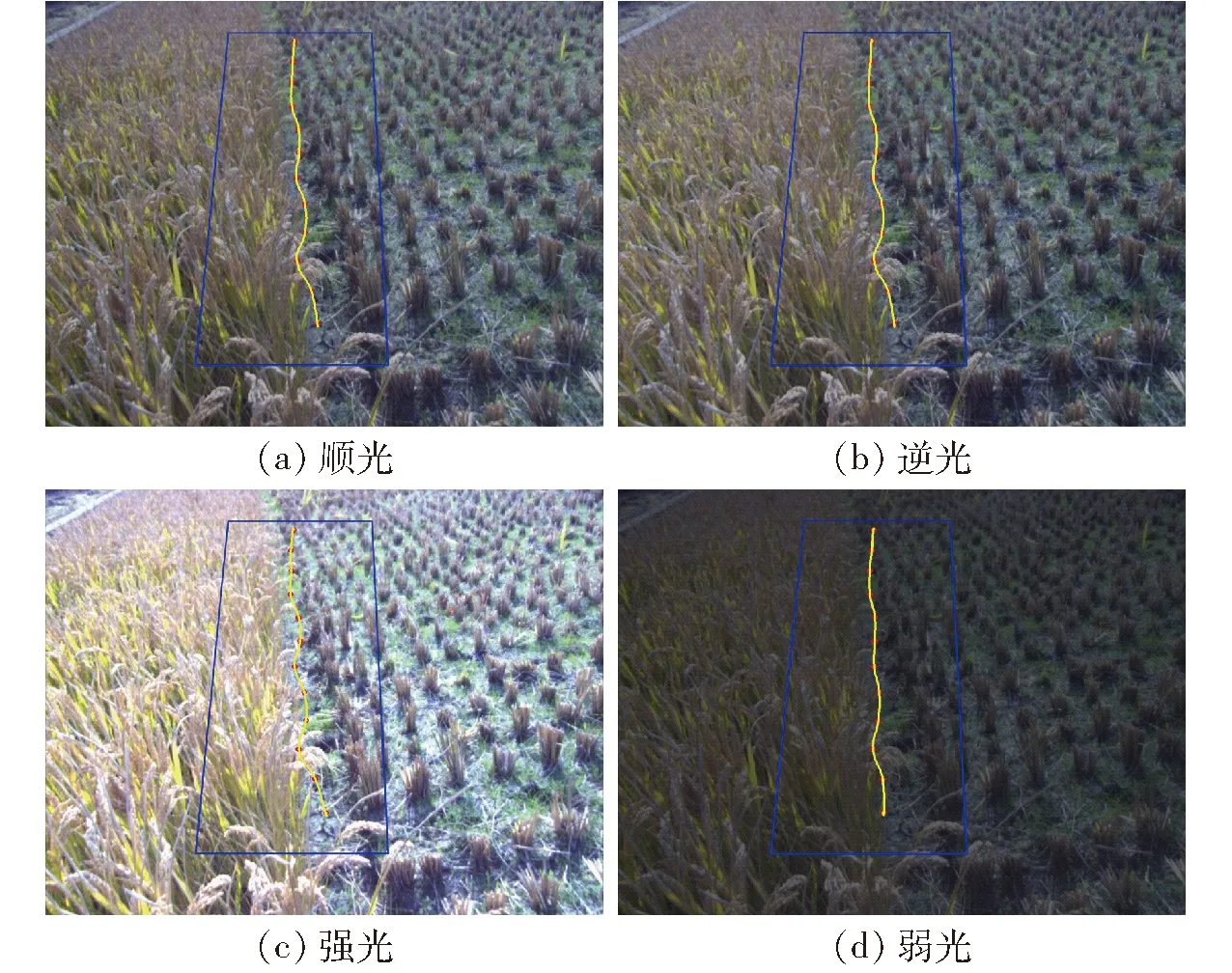

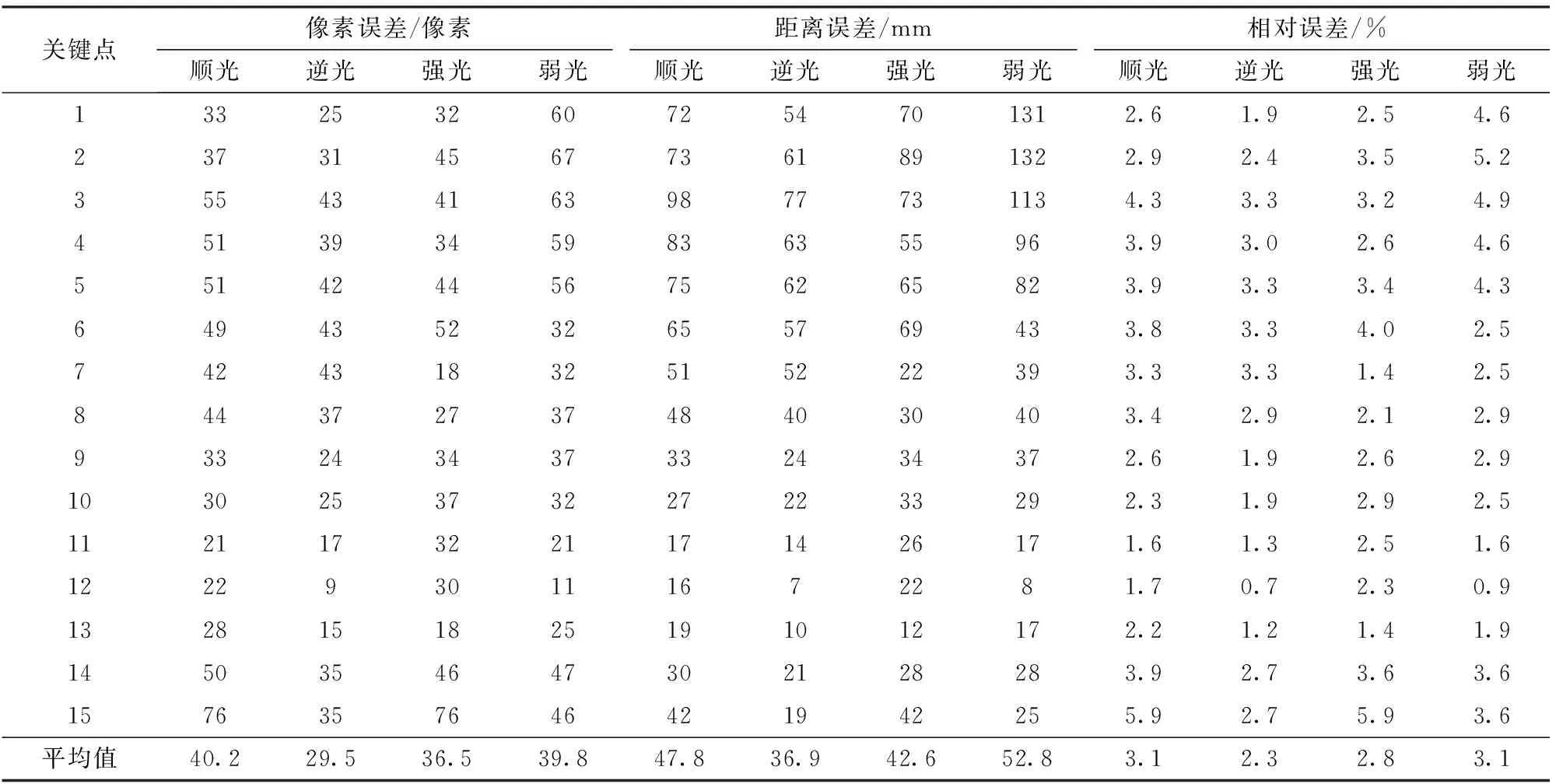

临稻20作物线识别结果如图14所示,关键点的识别误差计算结果如表5所示,作物线识别相对误差随像素纵坐标的变化如图15所示。

图14 临稻20作物线拟合结果Fig.14 Lindao 20 crop line fitting results

由表5可知,对于拟合临稻20作物线的15个关键点,在顺光环境下的像素误差范围为21~76像素,平均像素误差40.2像素,标准差为14.1像素,实际距离误差为16~98 mm,平均距离误差47.8 mm,相对误差1.6%~5.9%,平均相对误差3.1%;逆光环境下像素误差范围为9~43像素,平均像素误差29.5像素,标准差为10.8像素,实际距离误差为7~77 mm,平均距离误差36.9 mm,相对误差0.7%~3.3%,平均相对误差2.3%;强光环境下像素误差范围为18~76像素,平均像素误差36.5像素,标准差为13.9像素,实际距离误差为12~89 mm,平均距离误差42.6 mm,相对误差1.4%~5.9%,平均相对误差2.8%;弱光环境下的像素误差范围为11~67像素,平均像素误差39.8像素,标准差为16.2像素,实际距离误差为8~132 mm,平均距离误差52.8 mm,相对误差0.9%~5.2%,平均相对误差3.1%。

对于临稻20的收获图像,在逆光环境下的平均像素误差最小,为29.5像素,平均距离误差最小,为36.9 mm,平均相对误差最小,为2.3%,稳定性也最好,标准差为10.8像素。4种光线环境下,临稻20作物线关键点识别的平均像素误差为36.5像素,平均距离误差45.0 mm,平均相对误差2.8%。

表5 临稻20作物线15个关键点的横向偏差计算结果Tab.5 Calculation results of lateral deviation of 15 key points of Lindao 20 crop line

图15 临稻20作物线识别相对误差Fig.15 Relative error of Lindao 20 crop line recognition

综上所述,应用本文所提出的水稻收获导航线提取方法,导航线的提取误差不超过45 mm,相对误差不超过2.8%。中粳798收获图像的导航路径提取结果优于临稻20的收获图像,这是因为除了光照因素外,图像处理结果还受到作物纹理等多种因素干扰。本文导航路径提取算法识别耗时短,结果较为可靠,能适应多种光照环境,可以作为联合收获机视觉导航的依据。

4 结论

(1)针对水稻收获图像中各区域的颜色特征,提出了适合收获作业导航的2R-G-B图像灰度化算法,该方法适于提取水稻已收获区域与未收获区域分界线。

(2)针对作物长势和田间环境复杂、作物线轮廓不规则的特点,提出了基于三次B样条曲线的作物线拟合方法,提高了作物线拟合方法的适应性。

(3)试验表明,在不同的光线条件下,中粳798收获图像的作物线识别平均像素误差为28.7像素,平均距离误差39.7 mm,平均相对误差2.7%;临稻20收获图像的作物线识别平均像素误差为36.5像素,平均距离误差45.0 mm,平均相对误差2.8%;单帧图像平均处理时间38 ms。所提出的图像处理与作物线拟合方法,在强光、弱光、顺光、逆光环境下都能较为准确地识别已收获区域与未收获区域,适用于田间环境下水稻收获作业视觉导航路径的提取。