人工智能在消化内镜中应用的研究进展*

黎 健 冯 莉

复旦大学附属中山医院闵行分院内镜中心(201100)

人工智能(artificial intelligence, AI)在医学中的应用已引起广泛关注,AI辅助消化内镜诊断是目前的研究热点。临床上内镜操作由内镜医师完成,诊断则依靠医师肉眼结合病理活检完成,其本质是一个不断积累经验、逐渐完善的过程。AI辅助内镜诊断有望提高内镜医师对消化道病灶的检出率,有效减少误诊和漏诊。本文就AI在消化系统疾病内镜诊断中的作用和研究进展作一综述。

一、AI简介

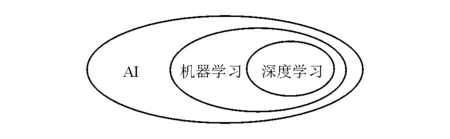

AI可定义为由机器模仿人类认知功能所展示的智能[1-2]。机器学习(machine learning)是一种实现AI的方法,机器可在没有明确指令的情况下利用数据来提升自身性能。深度学习(deep learning)是一种实现机器学习的技术,其通过模仿动物神经系统来创建自身神经网络[3]。由于医学数据通常由非结构化文本、图像和视频组成,不易加工成有明确特征的数据,因此在临床医学中深度学习尤为有价值[4]。AI、机器学习、深度学习的关系见图1。特征学习属于深度学习,指机器内部的某些设定要求机器主动识别并学习原始数据中的特征,而非被动识别学习已标记的数据特征[5]。这种技术可使机器学习特征并能在没有预先提供特征的情况下,自动推断输入值和输出值。

采用机器学习方法的AI大致分为两类:手工算法和深度学习算法。在手工算法中,研究人员基于临床知识,手动输入数据特征,如病灶边缘、大小、颜色和图像表面特征;深度学习算法则主动提取并学习鉴别图像特征。从技术层面上而言,深度学习算法能使用卷积神经网络(convolutional neural networks, CNN)来分析复杂信息,通常较手工算法更具优势,但需要更多学习材料用于准确识别和分析[6]。

二、AI在食管疾病中的应用

1. Barrett食管(Barrett’s esophagus, BE)异型增生的识别:BE是食管腺癌发生的危险因素之一,但在内镜检查中常被误诊,原因可能为:①内镜医师无法区分胃(近贲门处)柱状黏膜和远端食管的化生上皮;②获取的食管活检组织中缺少杯状细胞[7]。自动识别BE异型增生是计算机辅助诊断(computer-aided diagnosis, CAD)领域的研究热点之一。CAD能帮助内镜医师进行精准定位活检,减少不必要的随机活检。随机活检对异型增生的敏感性较低,约64%[8]。有研究发现,精准定位活检诊断高级别上皮内瘤变和食管腺癌的敏感性为90%,特异性为80%,阴性预测值为98%[9]。Veronese等[10]提出的一种CAD方法分析共聚焦图像区分胃上皮化生、肠化生和上皮内瘤变的敏感性分别为96%、95%、100%。因此,在临床实践中采用AI辅助内镜诊断,有望提升内镜医师识别和诊断病变的水平。

图1 AI与机器学习、深度学习的关系

基于病变部位特定纹理和对常规内镜图像进行机器学习,van der Sommen等[11]研发了一套能自动识别早期肿瘤的系统,识别过程分3个步骤:①预处理;②对获取的图像进行降维度特征提取;③识别分类。结果显示对44例BE患者100张图像的早期肿瘤病变的诊断敏感性和特异性均为83%。Swager等[12]发现,容积激光显微内镜(volumetric laser endomicroscopy, VLE)能对食管壁层深达3 mm处的病变进行识别,其结果接近显微镜分辨率扫描,使用AI模型对60张VLE图像进行体外交叉验证,敏感性为90%,特异性为93%。

2. 食管癌的识别:食管癌为全球第六大癌症死亡原因,其发病率位居第七位,多数病例预后较差且几乎所有病例均为鳞状细胞癌[13]。内镜下卢戈碘色素染色为目前诊断食管鳞状细胞癌的主要方法,敏感性>90%,特异性约70%[14],可能与炎性病变可引起假阳性表现有关。此外,作为筛查手段,碘染色引起的胃灼热不适和过敏反应风险在一定程度上限制了该方法的临床应用[15]。随着内镜技术的发展,窄带成像(narrow-band imaging, NBI)技术是一种非侵入性、安全性更高且可获取高清图像的诊断方法。在一项纳入123例患者的交叉试验中,NBI对异型增生的检出率明显高于普通白光内镜(30%对21%,P=0.01),且NBI所需的活检次数更少[8]。有研究[16]发现NBI诊断食管高级别上皮内瘤变的敏感性和特异性分别为91%和95%。目前,包括共聚焦激光显微内镜(confocal laser endomicroscopy, CLE)和细胞内镜(endocytoscopy)在内的更先进的内镜成像技术正处于临床前应用阶段[17]。值得注意的是,内镜医师对这些新技术的显微图像进行诊断时,不仅需要专业知识,还需大量强化训练,可能阻碍了这些新技术的临床推广。因此,CAD系统用于自动分析诊断所获取的内镜图像时,能减少内镜医师的学习成本,提升临床工作效率,凸显AI的诊断价值。

Shin等[18]采用一种定量图像分析由高分辨率显微内镜(high-resolution microendoscopy, HRME)获取的细胞核与细胞质区域图像,HRME能产生与CLE类似图像,但成本明显降低。结果显示该法对食管鳞状细胞癌的诊断敏感性和特异性分别为87%和97%,在算法中加入实时图像分析功能后,敏感性和特异性分别为95%和91%。Horie等[19]的大样本量研究基于CNN构建了AI模型,对384例食管癌患者的8 428张内镜图像进行机器学习,结果显示癌灶检测的敏感性为98%,阳性预测值为40%。基于机器学习的特性,随着学习材料的增加,阳性预测值会逐渐增高,可作为一种较好的辅助诊断工具。

三、AI在胃部疾病中的应用

1. 早期胃癌的识别:胃癌是一种严重危害人类健康的消化道恶性肿瘤,占全球癌症死亡率的8.2%[13]。早期内镜诊断并治疗是降低胃癌死亡率、提高患者生存率的主要方法。目前临床上早期诊断胃癌存在两个问题:①内镜下识别早期胃癌存在一定困难,内镜下早癌通常表现为黏膜轻度隆起或凹陷伴轻度发红,极易遗漏;②内镜下如何预测病灶浸润深度。分化型黏膜内癌(M期)或侵入黏膜下层≤0.5 mm(SM1期)的病灶可行内镜下切除;而侵入黏膜下层>0.5 mm(SM2期)的病灶,通常采取手术切除。AI的应用可在一定程度上解决上述两个问题。

Sakai等[20]使用CNN学习内镜图像来自动识别早癌,在926张内镜图像中,228张为早癌,其余为正常图像。经数据训练后再行验证,结果显示228张癌症图像中,共205张(89.9%)诊断准确,除去用于学习的图像,诊断准确率为82.8%;698张正常图像中,491张(70.3%)被系统识别成正常。表明通过少量数据学习,CNN就能在早期胃癌检测中实现较高的准确性。Miyaki等[21]采用CAD系统自动识别癌与非癌区域,对胃癌的诊断准确性达85.9%,敏感性为84.8%,特异性为87.0%。该团队随后将类似技术用于放大BLI图像来识别早期胃癌,结果显示癌变平均输出值为0.846±0.220,红色病变为0.381±0.349,周围组织为0.219±0.277,癌变输出值明显高于其他类型[22]。上述研究结果说明AI在自动分析诊断早期胃癌方面具有一定的潜力。Hirasawa等[23]使用深度学习技术自动检测早期胃癌。将13 584张传统内镜图像(而非NBI、FICE、BLI图像)用于训练CNN,并从连续77处胃癌病变中收集2 296张图像,结果显示该模型准确诊断71处胃癌病变仅需77 s,总体敏感性为92%。但仍有161处非癌性病变被误诊为胃癌,阳性预测值较低(31%)。该研究构建的CNN可用于短时间内处理大量内镜图像来诊断胃癌,且具有实时临床诊断能力,如何提高阳性预测值将是后续研究重点。Zhu等[24]设计了能从M/SM1型胃癌中识别SM2型胃癌的AI模型,结果显示诊断SM2型胃癌的敏感性和特异性分别为76%和96%,高于内镜医师视觉检查的敏感性和特异性。

2. 幽门螺杆菌(Helicobacterpylori, Hp)感染的识别:Hp已被列为Ⅰ类致癌原,能定植于胃部并引起慢性萎缩性胃炎、肠化生,从而增加胃癌的发生风险[25]。胃镜检查是诊断Hp感染的重要方法,但准确性并不高,敏感性和特异性分别为62%和89%[26]。目前AI诊断Hp感染已成为消化内镜领域的研究热点之一。一项单中心回顾性研究[27]基于WLI、BLI、LCI图像利用AI来诊断Hp感染,共纳入222名受试者,其中105名胃镜和血清学确诊Hp感染阳性。结果显示WLI的ROC曲线下面积显著低于BLI和LCI(0.66对0.96、0.95,P<0.01)。说明基于BLI和LCI图像,AI已具备较好的诊断Hp感染的能力,有望成为一种有用的辅助诊断工具。但该研究的缺陷在于AI系统为回顾性诊断而非内镜下实时诊断。由此可见,在胃镜检查过程中,AI是一种有效的辅助支持诊断工具,可避免内镜医师漏诊Hp感染患者,具有较强的临床应用潜力。

四、AI在肠息肉中的应用

结直肠癌(CRC)是全球第三大常见癌症,癌症相关性死因中位居第二位[13]。结肠镜结合病理活检是诊断CRC的首选方法。研究表明,多数CRC由肠息肉演变而来[28]。结直肠息肉(特别是腺瘤性和锯齿状息肉)参与CRC的发生和发展,属癌前病变,因此,通过早期诊断和干预结直肠息肉,有助于预防CRC[29]。结肠镜检查预防CRC的效果取决于腺瘤检出率,识别并切除这些癌前病变,同时行切除后监测,是预防CRC、降低发病率、死亡率的重要方法。

AI在肠息肉、肠癌识别领域的应用已有较多研究,除传统CAD外,基于CAD应用AI的CNN系统亦取得迅速发展。Komeda等[30]设计了CNN-CAD系统学习从常规结肠镜检查视频中截取的1 200张图像,并对肠息肉进行诊断和分类。经10次交叉验证后,准确性为0.751。说明该CNN-CAD系统可用于快速诊断肠息肉并进行分类,但需在体内环境中行进一步的前瞻性研究,以明确CNN-CAD系统在常规结肠镜检查中的有效性。Urban等[31]的CNN系统对8 641张内镜图像(包括4 088张各种类型息肉)进行深度学习,评估诊断息肉的能力,结果显示交叉验证准确率为96.4%,ROC曲线下面积为0.991。且该CNN系统具备实时识别和定位息肉的功能,可增加腺瘤检出率并减少CRC的发生,但仍需在大型多中心试验中行进一步验证。Chen等[32]创新性地利用NBI图像结合DNN-CAD系统诊断增生性和肿瘤性息肉。该研究收集了1 476张肿瘤性息肉和681张增生性息肉图像,以病理结果作为参照。结果显示DNN-CAD系统鉴别肿瘤性息肉和增生性息肉的敏感性为96.3%,特异性为78.1%,阳性预测值为89.6%,阴性预测值为91.5%。DNN-CAD系统鉴别肿瘤性息肉和增生性息肉的用时为(0.45±0.07) s,显著短于专家和年轻内镜医师所需的时间[(1.54±1.30) s、(1.77±1.37) s,P<0.001]。

五、总结

目前AI在医疗领域的应用已取得较多进步,尤其在消化内镜诊断方面。但AI在消化内镜中的应用面临一些问题:AI如何在消化内镜中做到实时诊断?如何更好地将AI融合于新的内镜技术?此外,消化内镜医师和患者的接受程度亦是面临的另一问题。自2017年以来,AI作为一项国家战略,已在皮肤癌、糖尿病视网膜病变中发挥重要作用,未来基于AI的内镜图像诊断识别有望在消化内镜筛选消化道早癌方面发挥重要作用。