新闻生产自动化伦理挑战

——算法伦理分析的框架地图

□文│王晓培 常 江

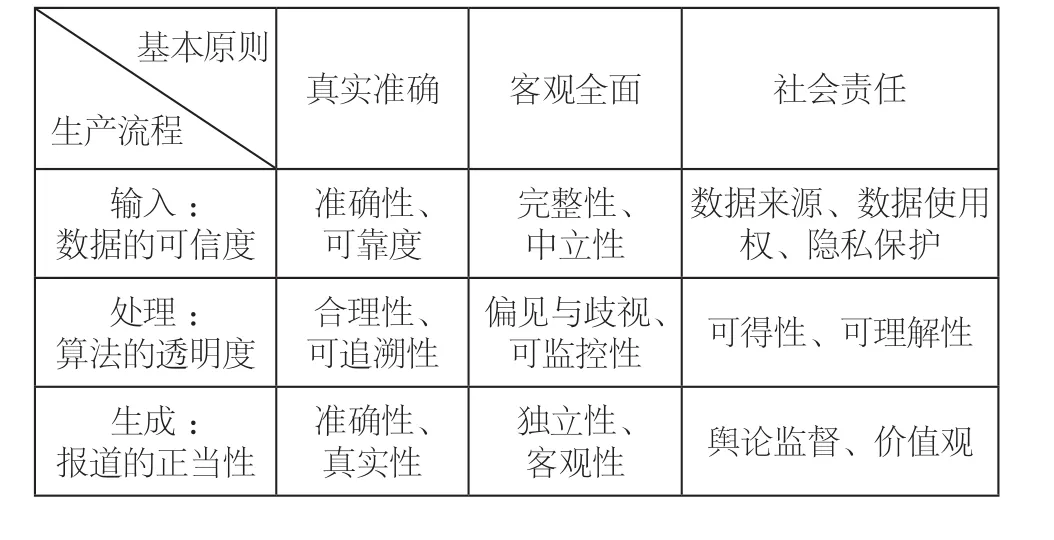

随着算法深度卷入新闻行业,媒介的生产和消费过程正在逐渐自动化。看似“客观中立”的算法,引发了诸多关于伦理问题的争论。原本附加于记者编辑、媒体组织的权力和责任让渡给算法,使得原有的生产逻辑和关系被打破,同时也产生了现存伦理框架难以适用的新问题。文章尝试建构一个新的伦理框架,从算法新闻的技术可能性中提取特征,以生产流程(输入、处理、生成)和报道的基本原则(真实准确、客观全面、社会责任)形成矩阵地图,为明确和解决潜在的伦理挑战提供进路。

一、自动化:主流新闻生产的一个趋势

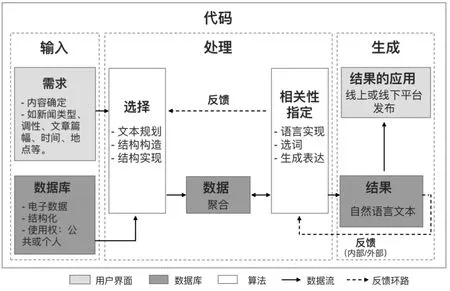

长期以来,技术都是形塑新闻业生产流程、条件的重要因素。[1]随着算法深度卷入新闻的编辑、聚合、发布及内容分发,媒介的生产和消费过程正在逐渐自动化。目前,自动化新闻多用于结构化数据较为充足、报道相对公式化的领域,如体育、财经、犯罪、天气报道等。多尔(Dorr)自动化新闻定义为自然语言处理(natural language generation,简称NLG)的自动或半自动过程,即通过从私人或公共的数据库选取数据、分配预选和未选数据特征的关系、将相关数据集合结构化为一种语义结构(a semantic structure),并将最终文本发布在线上或线下平台。[2]

每天,大型媒体机构都会在没有过多人工干扰的情况下,利用计算机自动生成若干报道。美联社(Associated Press)每季度使用自动写作平台语言大师(Wordsmith)将原始收入数据转化为3700家企业的收益新闻,而此前人工仅能编辑400篇。[3]其竞争对手路透社(Reuters)和法新社(Agence France-Presse)每年也会自动生成上千条新闻。[4]自动化新闻生产帮助新闻媒体扩大了报道面,特别是在财经和体育领域。

在中国,自动化新闻也在实践中崭露头角。除了此前腾讯的Dreamwriter(有资料译为梦幻写手)、新华社的快笔小新、微软小冰、今日头条的xiaomingbot(张小明)等,2018年两会,新华社利用国内首个媒体人工智能平台“媒体大脑”首次在两会报道中使用MGC(Machine Generated Content,机器生产内容)新闻。“媒体大脑”可自动分析舆情数据、生产可视化图表,并智能配音、剪辑、输出。在分析了3511555条内容后,“媒体大脑”仅用15秒就制作出了视频新闻《2018两会MGC舆情热点》。此后,还制作了《“媒体大脑”也在学习政府工作报告 机器发现了这些看点》《“媒体大脑”想陪你聊聊“两高”这五年》等六期MGC视频新闻,海内外总浏览量超过1200万次,覆盖量超过1亿人。

自动化新闻在某种程度上弥补了传统新闻的不足,得到了消费者的认可。路透研究院发布的报告《碎片化新闻时代的品牌与信任》(Brand and trust in a fragmented news environment)显示,尽管大多数受访者此前并未关注新闻是如何生产的,他们中的多数,特别是年轻一代,仍然更倾向于让算法而不是编辑来决定他们能看到什么新闻。[5]2017年,其发布的《数字新闻报告2017》(Digital News Report 2017)再次证明了用户对算法的喜爱程度。该报告在全球共调查7万人次,涵盖五大洲36个国家和地区。其中,超过54%的受访者表示更倾向于算法筛选新闻,选择编辑和记者的受访者占44%。这一趋势在主要使用智能手机获取新闻的用户(58%)和年轻用户(64%)中更加显著。[6]2016年的一次焦点小组调查中,一位来自英国的受访者解释道,他们“更倾向于相信从整体(a full range)信息中筛选的算法而不是一位编辑”。[7]可见,“自动判断”被赋予了客观性的期望,这对记者专业判断的权威性产生了影响。[8]

不仅如此,自动化新闻报道方式的流行,还导致传统的新闻生产流程和社会功能的变革。表面上看,算法似乎解决了人类天然对主观性的怀疑:通过“中性”的技术手段替代专业的决策,形成“客观”的新闻文本。然而,越来越多的研究表明,算法并不是中立的,其偏见正以一种更为隐秘和复杂的机制运作。这也引发了诸多关于算法伦理问题的争论。在微观层面,记者作为个体一直是新闻伦理的主要约束对象。一般认为,新闻教育会提前将记者训练成为具备勤奋、可靠、诚实、敏锐等优秀品德的专业人士。但是,作为产品的新闻通常不是单一个体能够全权负责的,而是涉及多主体、多层次的责任——在宏观层面,除了媒体组织本身还会受到外部因素,如社会环境、竞争者的影响。新闻生产的自动化趋势意味着越来越多的、原本附加于记者编辑、媒体组织的权力和责任让渡给算法,一方面使得原有的生产逻辑和关系被打破,另一方面也产生了已有框架难以适用的新问题。因此,急需建构一个新的伦理框架,以明确和讨论不断变动的算法新闻伦理争议。

二、算法的伦理问题研究综述

算法新闻凭借快速及个性化能力勃兴,越来越多地介入到专业新闻生产之中。学者们[9][10]研究发现,虽然目前算法新闻尚处初级阶段,但记者普遍感觉数字化和自动化使得新闻生产更加复杂,并让从业者更难遵循规范标准(normative standards)。因而,对算法新闻的研究,除了受众认知、社会和经济影响之外,伦理问题也成为了重要的一环。对伦理的定义有很多种,最广为传播的是“关于我们应该做什么的研究”。[11]

艾纳尼(Ananny)结合传统研究伦理的三条路径——道义论(deontology)、功利主义(utilitarianism)以 及 美 德(virtue ethics) 建 立 了 全 新 的 NIAs(networked information algorithms,网络信息算法)分析模型,关注作为一个集合(assemblage)的算法如何运作,以及NIAs何时、如何、为谁工作。[12]多尔等为其补充了从来源和动机方面对伦理问题的考量,并提出,算法新闻伦理是作为新闻伦理一部分的数字媒体伦理(digital media ethics)与计算机科学的赛博伦理(cyber ethics)的交叠。[13]赛博伦理即对涉及赛博技术的道德、法律、社会问题的研究,“对核心(传统的)道德观念的特定表述,比如自治、平等、公正、责任和人格尊重”。[14]为全面把握新闻伦理的潜在转变和挑战,多尔等结合普尔(Purer)提出的多层责任系统(the multi-layer system of responsibility) 及魏申贝格(Weischenberg)等对组织层次、专业/个体层次和社会/受众层次的新闻分类方式(the classification of journalism),建立了一套涵盖了组织、专业和社会视域的算法新闻伦理的分析框架,在客观性、权威性、透明度以及隐含/外显的价值观等层面发掘新闻伦理的嬗变与新挑战。[15]

随着2015年国内新闻机构引入机器人写作技术,我国学者对算法新闻伦理的研究也日渐增多。牛静和刘丹通过对全球134篇媒体伦理规范的分析,总结出了提及率前十名的伦理原则,如保护消息来源、保护隐私、更正、明确新闻界限等。[16]靖鸣等总结了人工智能技术在传播内容、舆论监督、公众信息安全和著作权以及“信息茧房”方面为新闻业带来的伦理失范问题。[17]乔艳认为,机器人新闻生产机制对新闻工作者的价值产生冲击,并为新闻受众构建了新的逻辑。[18]陈昌凤等考察了智能算法推荐与分发的伦理风险,尝试打开算法“黑箱”,探究技术实践与公共信息生产的权力迁移。[19]张淑玲则关注算法权力跃升与算法黑箱的不透明性之间的张力,梳理了新闻算法黑箱的三种表现形态、成因及解决策。[20]

整体来看,目前我国对于算法新闻伦理的研究稍显零散,研究或从单一角度入手,或从宏观角度理论概述,尚未形成一个较为系统、全面的分析框架。本研究试图从算法新闻的技术可能性中提取特征,搭建一个适用于国内算法新闻的伦理地图,为明确和解决潜在的伦理挑战提供进路。

三、我国算法新闻伦理的框架地图

本文借助学者多尔[21]总结提炼的算法新闻的I-T-O框架(如图1),基于技术流程将自动化新闻生产划分为三个部分:输入(input),从数据库提取数据;处理(throughput),用预先设定的语言和统计规则处理数据;生成(output),最终用自然语言输出文本。

图1 算法新闻的I-T-O模式

从技术手段上说,NLG拥有不同的算法种类,如按照学习方式可分为监督式学习、非监督式学习、半监督式学习、强化学习等,并还将出现新的手段。本文借助可操作的概念并还原其在自动化新闻生产过程中的作用,以生产行为及结果为导向,从新闻报道的基本原则切入,尝试建构一个能够系统描述动态、开放的算法新闻的伦理框架。以生产流程(输入、处理、生成)和报道的基本原则(真实准确、客观全面、社会责任)形成了一个3×3的矩阵地图(如表1),为分析实践和规范问题提供路径。

表1 算法新闻伦理的分析框架

1.输入:数据的可信度

在输入阶段,伦理问题主要来自数据本身及其来源。现阶段,结构化数据是NLG的前提。自动化新闻之所以在体育、财经、犯罪等领域最为常见,正是由于这些领域数据的可得性和结构化程度高。可见,数据本身的准确性和可靠度对最终报道的真实准确具有决定性影响。数据的完整性、中立性也非常重要。若数据库获取不全或具有偏向性,都可能导致错误与偏见。此外,原始数据库需要经过“清洗”,以算法能够理解的结构化形式输入。此过程中,一些无法被结构化的数据被清理或忽视,也可能导致数据的缺失与偏向。

数据的来源一直是新闻伦理研究关注的问题。在算法新闻领域,数据来源的问题可以从两个主体层面进行考察。一是从媒体机构层面,为实现数据透明,算法新闻的数据来源是否应该被公开尚存争议,因为长期以来“保护信源”都是新闻伦理中重要的一项。应该如何解决“数据透明”与“信源保护”之间的矛盾?此外,获取的数据途径是否正当、取得数据后媒体机构是否有权使用其进行商业活动也是被广泛讨论的问题;二是从用户个体层面,算法时代,个人隐私的边界正在逐渐消融,媒体对用户数据的抓取和搜集可能会侵犯个人隐私权。个人隐私的边界应该如何界定?未被授权的数据可以作为新闻写作的素材吗?2018年5月25日,欧盟全新的《通用数据保护条例》(General Data Protection Regulation,简称GDPR)取代了1995年通过的欧盟数据保护法律,似乎给出了一种答案。该条例用严格的规定和高额的罚金迫使企业关注和保护客户数据,让用户能够更主动地掌控数据,维护隐私。现阶段,我国的法律在信息数据保护方面仍有待完善。

2.处理:算法的透明度

有学者将透明度定义为“新闻行业内部和外部人士都有机会能够监督、检查、批评甚至干涉报道过程的途径”,[22]让观众能够了解新闻生产过程和报道幕后的记者。而算法新闻的出现却挑战了这一传统标准,自动生产的过程似乎是一个“黑箱”,特别是机器学习算法的出现,让人类难以对其决策过程进行监督和干预,更难对输出结果的合法性进行认定。透明度有两个重要的组成部分——可得性和可理解性(accessibility and comprehensibility):可得性即数据所有者的知情权与数据使用者的商业可行度(commercial viability)间的权力博弈,形成信息不对称和有利于数据使用者的“知识和决策权力的不平衡(imbalance)”;[23]可理解性即算法运行的规则和过程能被用户理解,但知识门槛与技术壁垒的存在使得此部分的实现并非易事。[24]此外,出于商业性的专利保护、国家安全和隐私等考虑,算法做到完全公开是极为困难的。

不过在此方面,国外媒体也做出了多种尝试。新媒体公司(ProPublica)发布其统计方法论白皮书;美国新闻聚合网站嗡嗡喂(BuzzFeed)、538(FiveThirtyEight)等将他们部分数据向文章的数据和代码设为开源;《纽约时报》、BBC等均在不同程度上公布了其算法工具的细节。而目前我国多数新闻写作机器人并未公开详细的算法,仅有微软小冰粗略地公开了其实现人机对话的机理。[25]

一些观点认为,算法判断与人类主观决策相比,似乎具有天然的中立性,有学者将其称作“算法客观性”(algorithmic objectivity)。[26]因为算法会按照预先设定的统一运算流程,在没有人为干预的情况下处理所有数据,而不是根据某一时刻的临时判断。但很多人发现,算法处理数据的运行逻辑仍旧是人类行动,传统的监督式学习在算法编写过程中可能受到程序设计者、机构的价值观以及所处社会环境、技术限制等影响,机器学习算法则可能会受到用户使用方式的影响,制造更多有意识或无意识的偏见的产生。有学者指出,脸书(Facebook)新闻的算法逻辑重视那些能够被分享、被评论和被点赞的内容,因此适合那些能够引发情绪波动的内容,如让人“极度喜悦或义愤填膺”的帖子或图片。[27]

可追溯性在保证新闻的真实准确和事后追责上扮演非常重要的角色。然而,机器学习算法的普及却使得人类逐渐丧失了对机器行为的完全掌控,对算法行为的控制权逐渐从设计者、程序员转移到了算法本身及其运行环境,出现了“责任沟”(an accountability gap)。一篇自动化报道出现问题之后,责任主体应指向谁?程序设计者、机构还是计算机?此外,有学者认为,人类的道德标准无法适用于计算机,算法也无法模拟人类“对情感、道德的弹性把控”。[28]什么样的算法设计是合理的、能够满足人类阅读期待的?人机的伦理一致性(ethical consistency)以及对社会和道德责任的重置问题都尚未形成一致看法。

3.生成:报道的正当性

算法对于报道的真实、准确性有双重作用。一方面,算法可以帮助媒体鉴别信息真伪,成为很多媒体核实信源、应对假新闻的有效方式。比如路透社开发的针对社交媒体推特(Twitter)的算法预警程序“新闻追踪者”(News Tracer),运用算法评估发布者的用户资料、认证情况、关注者和被关注者、消息的传播方式等700余项指标,帮助记者判断一则推文的可信度,并利用机器学习发现被广泛讨论的事件,判断其是否具有新闻价值。[29]另一方面,算法在输入、处理过程中的偏见与不足,可能会直接导致报道的偏差与失实。《纽约时报》曾在一则橄榄球比赛报道中表示,尽管有大数据作为支撑,但机器人生成的报告要比NFL专业教练的预测更为乐观。[30]

现阶段,因技术和成本的限制,除为全球提供商业、金融信息的路透社、彭博社,多数媒体机构选择与外部渠道合作或购买的方式获取“二手数据”而不是自主发掘数据。而出于合作、预算或对第三方数据的依赖,可能限制报道的复杂、深入程度以及立场,这也引发了对媒体自主权、报道独立性、客观性的讨论。

社会责任是媒体活动的基础。早期,西方媒体被誉为独立于“三权分立”中的立法、行政、司法之外的“第四权力”,以报道的方式监督政府、制衡权力、守望社会。然而算法新闻似乎正在削弱媒体的社会功能。算法新闻目前还需要提前预置模板,对内容的丰富度和深入度产生消极影响,导致最终的产品中出现背景信息、创造性和反思的缺位。多名一线记者在一次工作坊中表示,自动生成的文章可看性低、内容无聊,对读者“没有吸引力”。[31]皮尤研究中心发布的报告《变革中的新闻编辑部》中曾提出,“美国报纸获得了数字时代网络观念和技能的更新,及浅显内容的多元化展示,而失去的是精致内容的生产能力。” 算法新闻也挤占了媒体有限的资源,调查报道作为一项重要的公共服务因记者规模和资金的削减日渐减少,导致普遍的深度内容供应不足。[32]原本应充当“看门人”(watchdog)的媒体反而被商业利益、政治集团利用。比如,2018年剑桥分析公司(Cambrige Analytica)被爆利用Facebook数据通过在各大社交平台精准投放具有偏向性的新闻操纵选民情绪,为各国政治宣传、大选等利益集团服务,甚至染指英国脱欧、美国总统大选等重大事件。

在自动化新闻生产中,价值观也是非常重要的一环。由于算法不具备人类的道德判断,若不加以适当限制和引导,易产生不良的社会影响。比如,微软小冰就曾因为机器学习样本问题被网友“带坏”而出口成“脏”,甚至还在与网友的对话中发表反动言论,一度被封杀。作为一家科技公司,今日头条的创始人张一鸣曾公开称“算法没有价值观”,但从2017年开始,今日头条旗下产品屡屡因为价值导向问题被相关部门责令整改、关停。正如凯文·凯利在《科技想要什么》中说的:“我们的任务是引导每一项新发明培育这种内在的‘善’,使之沿着所有生命的共同方向前进。”[33]没有正确的价值导向,算法主导的新闻业极易产生负面的社会影响。

四、总结

算法作为一种伴随新技术而生的权力,社会影响力愈发广泛、深远。技术的进步能否带来更好的新闻业?在反思算法伦理的地图之后发现,其在新闻业的应用既带来了新可能与便捷,如鉴别信息真伪、预测未来发展、个性化写作、拓展报道话题等,也带来了诸多关于客观性、真实性、社会责任等方面的争议。艾纳尼总结前人研究,准确道出了算法的复杂性:它不仅是加速商业、新闻业、金融等其他领域的工具,而且是作为“话语”的存在,是技术的和社会的知识文化,组织信息如何产生、呈现、生成意义、被视为合法以及赋予公共意义。算法新闻伦理也是糅合了制度化代码、专业文化、技术性能、社会实践以及个体决定的复杂结果。算法作为自动化时代的根基所带来的伦理挑战并不是“透明度”与“黑箱”可以完全概括的,框架地图的构建与完善能够帮助厘清潜在问题并提出应对方案,未来研究可围绕某一概念进行更为详尽的研究,以及如何将“工具理性”和“价值理性”更好地结合。

注释:

[1]Roger Parry.The Ascent of Media: from Gilgamesh to Google via Gutenberg [M].London: Nicholas Brealey, 2011.Boston: Nicholas Brealey Pub.

[2]Konstantin Dorr.Mapping the Field of Algorithmic Journalism [J].Digital Journalism, 2016 (6).

[3]Francesco Marconi, Alex Siegman and Machine Journalist.The Future of Augmented Journalism: A guide for newsrooms in the age of smart machines [R].Associated Press.[2017-02-22].https://insights.ap.org/uploads/images/the-future-of-augmented-journalism_apreport.pdf

[4]Alexander Fanta.Putting Europe’s Robots on the Map: Automated journalism in news agencies [EB/OL].Reuters Institute [2017-09-01].https://reutersinstitute.politics.ox.ac.uk/our-research/putting-europes-robotsmap-automated-journalism-news-agencies

[5]Kantar Media.Brand and Trust in A Fragmented News Environment [R].[2016-10-10].http://reutersinstitute.politics.ox.ac.uk/our-research/brand-and-trustfragmented-news-environment

[6]Nic Newman with Richard Fletcher, Antonis Kalogeropoulos, David A.L.Levy and Rasmus Kleis Nielsen.Digital News Report 2017 [R].Reuters Institute for the Study of Journalism.[2017-06-22].http://www.digitalnewsreport.org

[7]Nic Newman with Richard Fletcher, David A.L.Levy and Rasmus Kleis Nielsen.Digital News Report 2016 [R].Reuters Institute for the Study of Journalism.[2016-06-14].http://www.digitalnewsreport.org/survey/2016/

[8]Matt Carlson.Automating judgment? Algorithmic judgment, news knowledge, and journalistic professionalism [J].New Media & Society, 2017 (4).

[9]Brian Creech and Andrew L.Mendelson.Imagining the Journalist of the Future: Technological Visions of Journalism Education and Newswork [J].Communication Review, 2015 (18).

[10]Lia Paschalia Spyridou, Maria Matsiola, Andreas Veglis, George Kalliris, and Charalambos Dimoulas.Journalism in a State of Flux: Journalists as Agents of Technology Innovation and Emerging News Practices [J].International Communication Gazette, 2013 (75).

[11]John C.Merrill.Theoretical Foundations for Media Ethics.In Controversies in Media Ethics, 3rd ed.[C],edited by A.D.Gordon, J.M.Kittross, J.C.Merrill,W.Babcock, and M.Dorsher.New York: Routledge, 2011.

[12]Mike Ananny.Toward an Ethics of Algorithms:Convening, Observation, Probability, and Timeliness [J].Science, Technology, & Human Values, 2016 (41).

[13]Konstantin Nicholas Dorr & Katharina Hollnbuchner.Ethical Challenges of Algorithmic Journalism [J].Digital Journalism, 2017 (5).

[14]Herman H Tavani.Ethics and Technology.Controversies,Questions, and Strategies for Ethical Computing [M].New Jersey: Wiley, 2011: 13.

[15]Konstantin Nicholas Dorr & Katharina Hollnbuchner.Ethical Challenges of Algorithmic Journalism [J].Digital Journalism, 2017 (5).

[16]牛静,刘丹.全球媒体伦理规范的共通准则和区域性准则——基于134篇媒体伦理规范文本的分析 [J].新闻记者,2017 (10).

[17][28]靖鸣, 娄翠.人工智能技术在新闻传播中伦理失范的思考 [J].出版广角, 2018 (1).

[18]乔艳.智媒时代机器人新闻对新闻伦理的冲击与重建 [J].新闻世界, 2017 (11).

[19]陈昌凤,霍婕.权力迁移与人本精神:算法式新闻分发的技术伦理 [J].新闻与写作,2018 (1).

[20]张淑玲.破解黑箱:智媒时代的算法权力规制与透明实现机制 [J].中国出版,2018 (7).

[21]Konstantin Dorr.Mapping the Field of Algorithmic Journalism [J].Digital Journalism, 2016 (6).

[22]Mark Deuze.What is Journalism? Professional Identity and Ideology of Journalists Reconsidered [J].Journalism,2005 (6).

[23]Omer Tene and Jules Polonetsky.Big data for all:Privacy and user control in the age of analytics [J].Northwestern Journal of Technology and Intellectual Property, 2013 (11).

[24]Brent Daniel Mittelstadt, Patrick Allo, Mariarosaria Taddeo, Sandra Wachter, Luciano Floridi.The Ethics of Algorithms: Mapping the Debate [J].Big Data & Society, 2016 (3).[25]讲堂|周明:自然语言对话引擎 [EB/OL].微信公众号:微软研究院AI头条 [2017-04-12].

[26]Tarleton Gillespie.The Relevance of Algorithms.In Media Technologies: Paths Forward in Social Research[C], edited by Tarleton Gillespie, Pablo Boczkowski, and Kirsten Foot.London: MIT Press, 2014.

[27]Zeynep Tufekci.The Real Bias Built in at Facebook[EB/OL].The New York Times[2016-05-19].https://www.nytimes.com/2016/05/19/opinion/the-real-bias-built-inat-facebook.html

[29]Reuters News Tracer: Filtering through the noise of social media [EB/OL].https://agency.reuters.com/en/insights/articles/articles-archive/reuters-news-tracerfiltering-through-the-noise-of-social-media.html.

[30]邓建国.机器人新闻:原理、风险和影响 [J].新闻记者,2016(9).

[31]Neil Thurman, Konstantin Dorr & Jessica Kunert.When Reporters Get Hands-on with Robo-Writing [J].Digital Journalism, 2017 (5).

[32]James T.Hamilton.Democracy’s Detectives: The Economics of Investigative Journalism [M].Massachusetts:Harvard University Press, 2016.

[33]凯文·凯利, 熊祥译.科技想要什么 [M].北京: 中信出版社,2011.