基于相似性测度和极限学习机的遥感图像分类研究

李健伟, 廖伟兴, 马镇威

(深圳供电局有限公司,深圳 518000)

0 引言

随着遥感技术、图像处理技术和信息处理技术的不断发展和提高,我们可以从遥感图像中获取和发掘更多有价值的信息和数据。为了满足不同遥感图像的信息处理要求,对遥感图像进行有效分类具有重要的理论价值和实际意义。传统的遥感图像分类方法主要有极大似然法[1]、最小距离法[2]、ISODATA[3]等监督与非监督的分类法,但此类方法存在分类精度不高的缺点,容易导致错分和漏分[4-5]。随着计算机技术和模式识别技术的发展,神经网络、数学形态学、模糊技术以及专家系统等新方法和技术被应用于遥感图像分类,使得分类精度较传统方法有了一定程度的提高,但仍然存在一定的不足。为了提高遥感图像的分类精度,在相似性测度的基础上,运用极限学习机[6](Extreme Learning Machine,ELM)的快速收敛能力和较强的泛化能力,提出一种基于相似性测度和极限学习机的遥感图像分类方法。

1 图像相似性测度

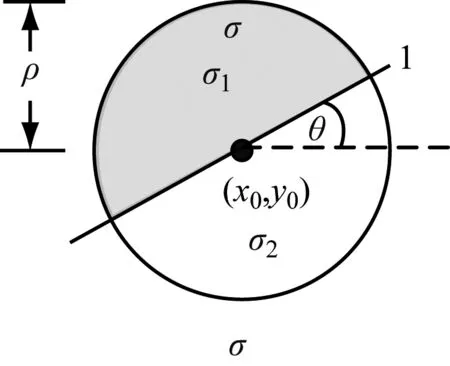

图像相似性测度[7]是测度图像边缘特征的一个重要指标,其表示图像在一个很小区域σ内的复杂程度,通常σ是一个直径为3~10个像素点的圆。若图像在σ区域内无变化,则图像相似性信息测度值为0;反之,图像相似性信息测度值则较大。如图1所示。

图1 σ区域

图像f(x,y)以像素点(x0,y0)为中心的邻域为区域σ,σ={(x,y)||x-x0|≤ρ,|y-y0|≤ρ},其中ρ为邻域半径。直线l经过点(x0,y0),且角度为θ(0~180°),该直线将σ区域分成两个部分,分别为σ1和σ2。

为了有效可靠地度量σ区域内的图像相似度信息,本文运用邻域一致性、方向性信息和结构性信息测度等表征图像相似度信息。

1.1 方0向性信息测度

图像中点(x0,y0)的方向性信息测度O(x0,y0)可由公式(1)表示为式(1)。

(1)

若点(x0,y0)在图像边缘区域,则O(x0,y0)值较大;若点(x0,y0)在图像平滑区,则O(x0,y0)值较小。

1.2 邻域一致性测度

图像中点(x0,y0)的邻域一致性测度R(x0,y0)可以有效反映图像边缘点在邻域的灰度信息分布情况,其可由公式(2)表示[8]为式(2)—式(4)。

k=0,1,…,n

(2)

其中,θ表示步长,k表示步进序列号。

(3)

(4)

若点(x0,y0)在图像边缘区域,则R(x0,y0)值较大;若点(x0,y0)在图像平滑区,则R(x0,y0)值较小。

1.3 结构性信息测度

图像中点(x0,y0)的结构性信息测度C(x0,y0)有平均作用,可以减少噪声对图像边缘的影响,其公式可表示为式(5)。

(5)

其中,点(x,y)∈lk,g(x,y)表示点(x,y)处的梯度幅值,梯度公式如式(6)。

(6)

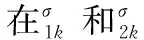

2 极限学习机

极限学习机是在Moore-Penrose矩阵理论基础上所提出的一种新型的单隐含层前馈神经网络[9],其结果示意图如图2所示。

图2 ELM结构示意图

若有N个训练样本数据,其输入和输出样本数据分别为xi=[xi1,xi2,xin]T∈Rn,t=[ti1,ti2,tim]T∈Rm,i=1,2,…,N,假设ELM的隐含层节点数为L,则ELM的输出可表示为[10]式(7)。

(7)

其中,j=1,…,L,ai=[ai1,ai2,…,ain]T和βi=[βi1,βi2,…,βim]T分别表示第i个隐含层神经元的输入权值和输出权值;ai·xj和bi分别表示ai和xj的内积和第i个隐含层神经元的偏置,式(7)可表示为式(8)。

Ηβ=Τ

(8)

其中,Η、β、Τ分别表示ELM隐含层的的输出矩阵、输出权值和输出矩阵。

固定ai,bi,ELM数学模型通过最小二乘法可求解为式(9)。

(9)

其中,H+表示Moore-Penrose广义逆矩阵。

3 基于相似性测度和ELM的遥感图像分类

针对遥感图像样本,提取遥感图像相似性测度特征,遥感图像的特征向量I(i,j)可表示为式(10)。

I(i,j)={R(i,j),O(i,j),C(i,j)}

(10)

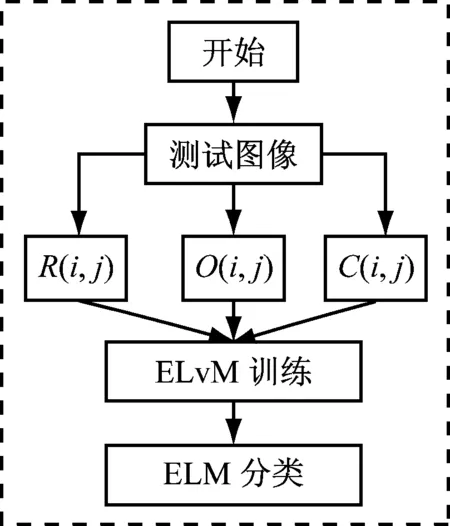

基于图像相似性测度和ELM的遥感图像的分类,如图3所示。

图3 基于相似性测度和ELM的图像分类流程图

流程如下:

(1) 读取遥感图像样本数据;

(2) 提取遥感图像相似性测度特征I(i,j);

(3) 标记遥感图像标签;

(4) 将遥感图像相似性测度特征分为训练样本和测试样本,将训练样本的遥感图像的相似度特征作为ELM的输入,训练样本的遥感图像标签类别作为ELM的输出,建立ELM模型;

(5) 针对测试样本,运用ELM遥感图像分类模型进行分类。

4 实证分析

4.1 评价指标

为评价遥感图像分类的效果,选择分类精度和Kappa系数作为遥感图像分类结果的评价指标,其评价公式如下:

分类精度为式(11)。

(11)

其中,A表示正确识别类别的数量,B表示实际类别数量。

Kappa系数[11]为式(12)。

(12)

其中,K表示Kappa系数,N表示总像元数量,xi+、x+i分别表示第i行和第i列的总像元数量,xii表示第i行第i列上的像元数量,m表示误差矩阵中行的数量。

4.2 数据来源

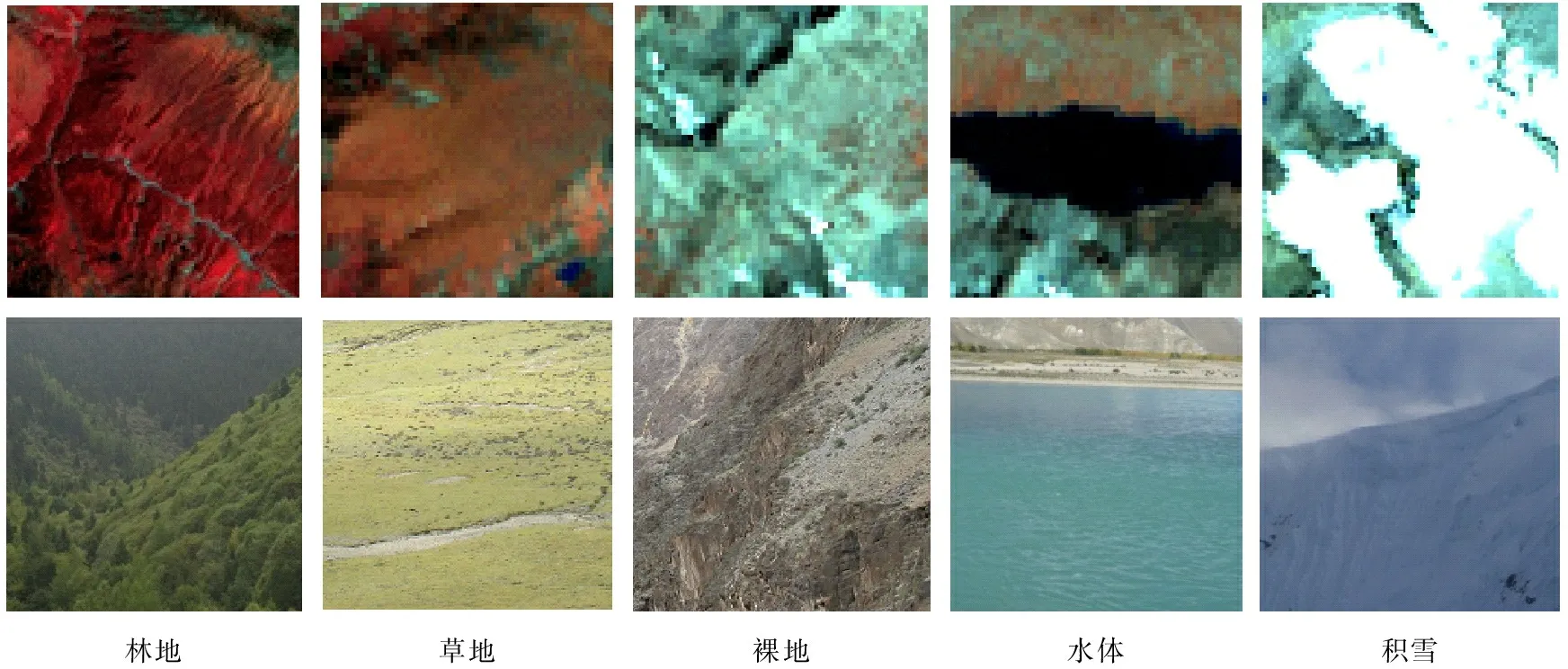

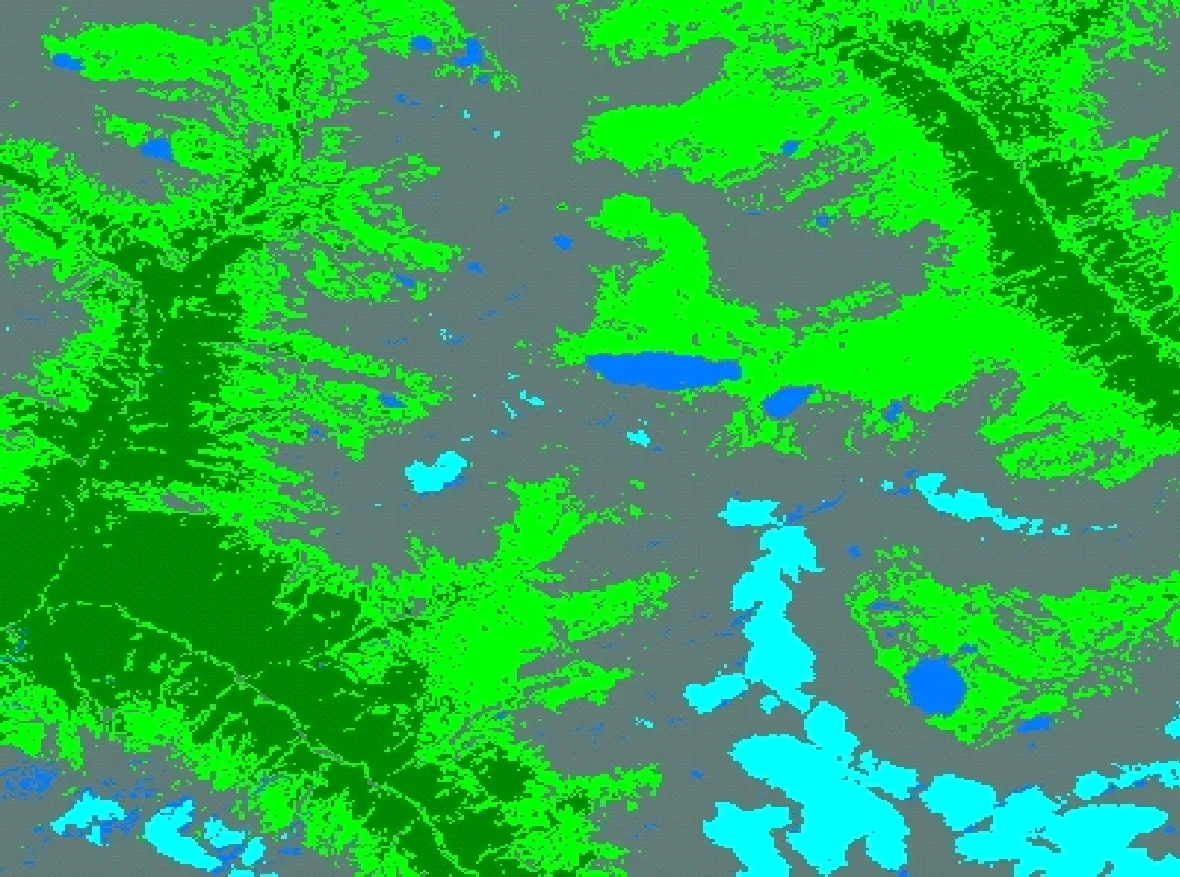

为了验证本文算法的有效性,选择遥感图像和实地照片(上排为林地、草地、裸地、水体以及积雪的遥感图像,如图4所示。

林地草地裸地水体积雪

图4 遥感图像和实地照片对比图

下排为林地、草地、裸地、水体以及积雪的实地照片)为研究对象,遥感图像由6个波段组成,分别为TM1、TM2、TM3、TM4、TM5和TM7,其中TM1、TM2和TM3表示可见光通道,TM4表示近红外通道,而TM5和TM7表示中红外通道。影像上的地物包括林地、草地、裸地、水体以及积雪。为了便于计算和图像分类,将所有地物样本尺寸统一为100x100个像素。

4.3 实验结果

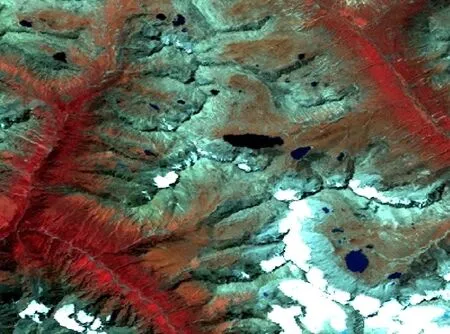

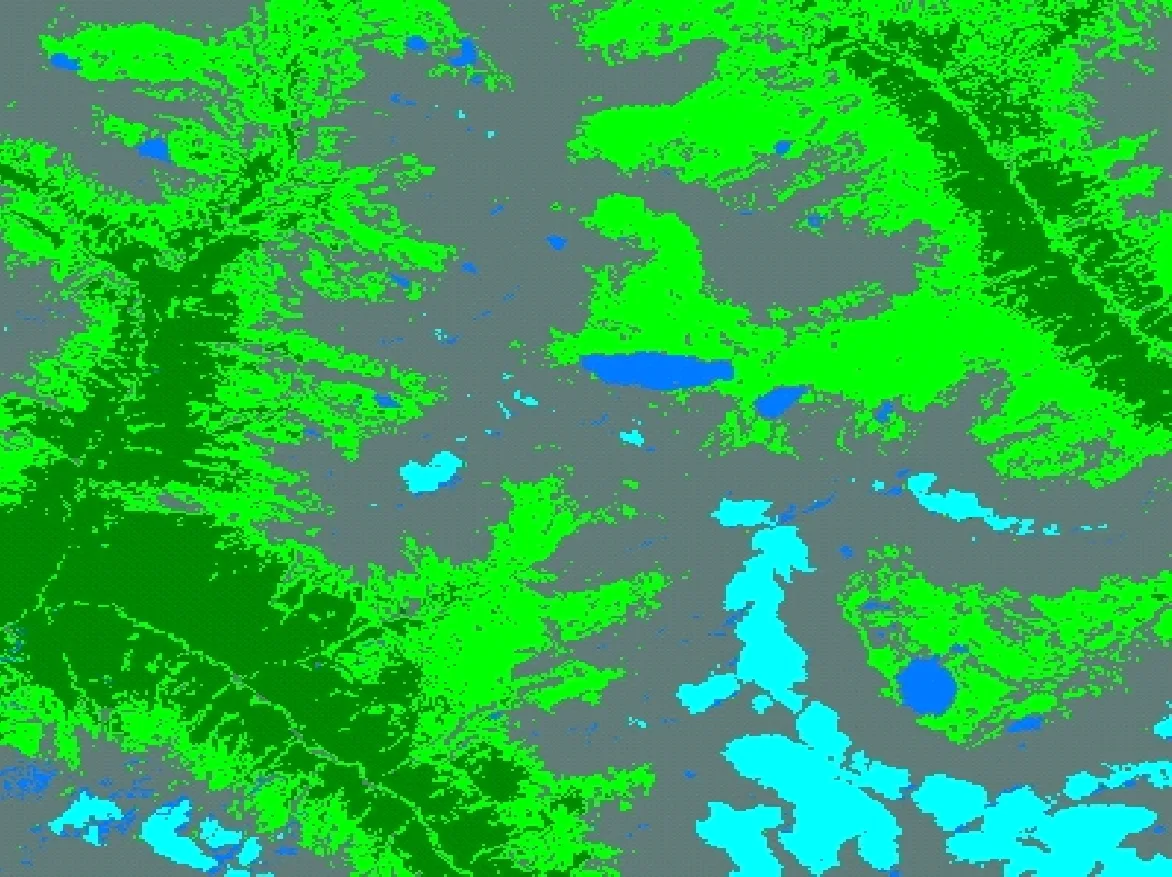

为了说明本文算法的优势,将本文算法和决策树法[12]、最大似然法[13]进行对比,对比结果如图6-图8所示。图5为原始遥感图像。

图5 原始遥感图像

图6 极限学习机

图7 决策树法图

图8 最大似然法

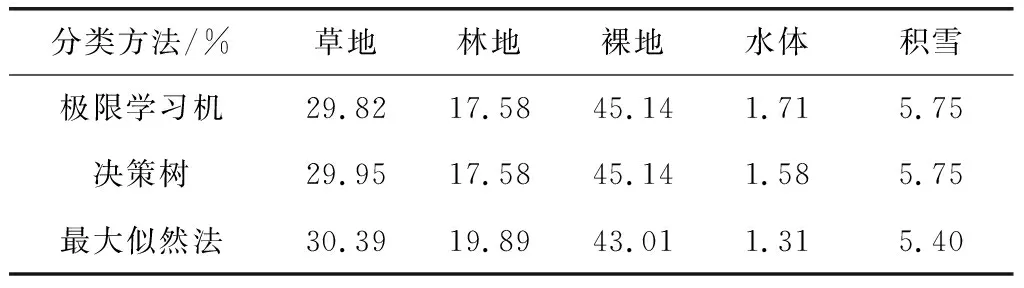

由图5-图8遥感图像分类结果和表1、表2 精度对比可知。

本文算法的Kappa系数为0.970 1,优于决策树法的0.961 5和最大似然法的0.943 7,极限学习机总体分类精度为97.50%,优于决策树法的97.15%和最大似然法的95.50%。耗费时间只有1.82 s,远远低于决策树的5.95 s和最大似然法的10.56 s。通过对比可知,本文提出的基于相似性测度和极限学习机的遥感图像分类方法,可以有效提高分类精度,为遥感图像分类提供新的方法和指导。

表1 分类结果矩阵

表2 不同分类方法各类别所占比例

表3 耗费时间

5 总结

为了提高遥感图像的分类精度,将相似性测度作为遥感图像的分类特征数据,运用极限学习机(Extreme Learning Machine,ELM)的快速收敛能力和较强的泛化能力,提出一种基于相似性测度和极限学习机的遥感图像分类方法。研究表明,提出的方法可以有效提高分类精度,为遥感图像分类提供新的方法和指导。