浅析面向AI时代的法律职业伦理教学

张 爽

内容提要:基于大数据技术的发展,人工智能 (AI)可能从以下两个方面对法律职业伦理教学产生影响:一是案件裁判预测服务可能加剧个案评价泛伦理化,激化法律职业伦理与大众伦理的冲突;二是类案推送等人工智能服务功能将深刻改变学习方式,并导致学生的伦理认知偏向趋同和强化。发展人工智能是国家的重大战略,在不远的未来,AI将是法律职业伦理教学的现实情境,舆论监督将是法治的常态环境,法律职业人将承担更多的社会说服责任,因此,法律职业伦理教学要主动回应、拥抱AI,通过溶入式、结构化的教学过程培养学生的论证能力,实现学生的自主型、成长性学习,奠定终身学习的基础。

2017年7月,国务院发布的 《新一代人工智能发展规划》(国发 〔2017〕35号)提出 “人工智能+”复合专业培养新模式,强调 “人工智能+”法律横向复合型人才的培养,并大力倡导智慧法庭建设。2018年4月,教育部印发 《高等学校人工智能创新行动计划》(教技 〔2018〕3号),根据人工智能理论和技术的普适性、迁移性和渗透性特点,要求高校主动探索 “人工智能+X”的人才培养模式。在顶层设计支持下,法律人工智能实务发展迅猛,法信、科大讯飞、华宇元典、无讼等系统不断落地,司法机关、律师事务所、科技公司等多市场主体共同实现了法律人工智能实践的质变和突变。AI(人工智能)对法学教育的影响势不可挡,法律职业伦理①本文对 “伦理”和 “道德”这两个概念以及 “法律伦理”和 “法律职业伦理”这两个概念在使用中不加区别,虽然有学者认为这两组概念之间具有重大差别,但本文是在同一意义上使用的。课程在内容建设、教学方法、评价标准等各个方面都面临前所未有的考验和机遇。

一、算法权力:法律职业伦理的未来认知界面

(一)伦理冲突:法律职业伦理教学的起点

专门化的职业伦理是一种角色道德,②在基本的道德问题上,一般伦理和职业伦理都会做出大体一致的判断,关于法律职业美德的必要性和职业性,已经达成共识,所以本文讨论的职业伦理主要是角色道德意义上的,而不是美德意义上的。源于职业行为与大众伦理的冲突,法律职业伦理也不例外。法律职业伦理是以 “角色差异”为基础建构出来的独特道德领域,即 “角色道德”,这通常意味着,可以用与日常道德矛盾的方式来实现 (角色)道德上的要求。③陈景辉:《忠诚于法律的职业伦理——破解法律人道德困境的基本方案》,载《法制与社会发展》2016年第4期。对法律人才培养而言,法律职业伦理不止是技术性伦理规范,也不止是超越日常道德的道德愿景,而且是注定存在严重冲突的专门性应用伦理规范,这种冲突主要体现为社会一般道德和法律职业道德的冲突。因此,对法律职业伦理的评价不仅集中在于欢案、佘祥林案等道德色彩浓重的个案裁判上,更体现在社会对法律职业行为做泛道德化评价④方乐:《司法如何面对道德?》,载 《中外法学》2010年第2期。的习惯上,不仅体现在对 “司法腐败”“司法不公”的情绪化 “共识”上,当实质理性与形式理性发生冲突时,更体现为社会伦理与法律职业伦理 “标准概念”⑤法律职业伦理的标准概念通常包括三个方面:一是党派原则,在面对客户涉入的纠纷和争端中,律师可只将 “对客户的忠诚”视为唯一的道德要求;二是中立原则,律师不对客户的目标做道德评估,而必须运用专业技能在法律范围内尽力争取,即使这违反了他自己或者公众的道德判断;三是非课责原则,律师不因符合党派原则和中立原则要求的行为,承担道德上和法律上的责任。参见前引③,陈景辉文。的直接冲突。在法律职业实践中,法官只需对法律条文负责、律师只需对委托人忠诚,而对待公众利益方面却无需承担任何道德义务。⑥李学尧:《非道德性:现代法律职业伦理的困境》,载 《中国法学》2010年第1期。

作为专业课程的法律职业伦理教学,既以单纯的法律伦理问题为前提,又有不同的视角。在法律实践层面,法律职业伦理主要体现为法律职业界在面对道德冲突时的行为指引规范;在教学实践层面,则主要体现为对以个案裁判为代表的法律职业行为的伦理评价冲突。早在人工智能的冲击之前,法律职业就已经面临严重的信任危机,舆论对公案⑦所谓公案,是指民众根据个案的主题元素,经过议论、诉说和加工而形塑出来的公共事件。参见孙笑侠:《公案的民意、主题与信息对称》,载 《中国法学》2010年第3期。全流程的关注 (甚至干预)已经常态化,法律职业承负着极其沉重的伦理压力。

首先,法律职业界与大众之间存在难以沟通的专业屏障。公众的道德观念往往表现为常识正义,而法律职业界则往往认为 “常理如果能解释法律,要不要法律也就无所谓了”。⑧陈金钊:《解释对法治造成的创伤及其弥合——没有逻辑基础的法治信念》,载《山东社会科学》2011年第3期。⑨参见前引⑥,李学尧文。与日常道德不同,法律职业伦理更多是一种指引法律人在因职业行为与大众道德冲突时,如何处理道德困境的技术性规范。法律职业伦理不仅是一种价值观念,更被视为一种技术,法律人可能侵犯了公共道德,却符合职业道德,这就会使法律职业伦理陷入 “非道德化”的危机。⑨

其次,我国文化传统存在 “泛道德化”倾向,国人常常把技术性问题上升为道德问题进行价值判断。⑩孙笑侠:《法律家的技能与伦理》,载 《法学研究》2001年第4期。同时,与传统社会不同,风险社会存在普遍的信任危机,公众情绪本来就容易聚焦于伦理范畴、过度移情,且囿于法律知识的局限,涉法舆论几乎是伦理单点切入的,所以相当比例的观点之片面、偏颇、极端也就在所难免。当前,多数网络热点集中于法律领域,司法的敏感度前所未有,随着人工智能的发展,法律实践必须接受更广泛、更严苛的道德评价,这必然给法律职业界带来巨大的压力。

(二)价值决策让渡:从辅助决策者到决策者的AI

阿西洛马AI伦理价值原则指出,应当由人类决定如何以及是否将决策外包给AI系统。①《阿西洛马人工智能原则——马斯克、戴米斯·哈萨比斯等确认的23个原则,将使AI更安全和道德》,载《智能机器人》2017年第2期。但是当数据成为认识世界的界面时,人们已经无意识地把获取信息的方式,交给了搜索引擎。学生也好,民众也好,他们的法律伦理认知更多源于网络检索或在线法律服务而不是社会经验,从某种意义上说也只能如此,甚至越来越如此。决策让渡意味着人工智能将发展为一种新型的控制权——算法权力,②段伟文:《控制的危机与人工智能的未来情境》,载 《探索与争鸣》2017年第10期。对价值判断的决策让渡几乎意味着算法权力对人类全部生活的掌控,用Facebook创办人扎克伯格的话来说,我们正在进入算法而不是法律统治人的时代。③转引自郑戈:《人工智能与法律的未来》,载 《公民与法》2017年第12期。

当前,预测性技术在司法领域的应用越来越广泛。在智慧司法背景下,司法裁判全流程依法公开指日可待,而计算机全 (大)数据处理使案件预测结果更为可靠。2016年,研究人员利用欧洲人权法院公开的判决书训练算法系统,构建模型预测案件判决结果,预测准确性高达79%。④曹建峰:《“人工智能+法律”十大趋势》,载 《机器人产业》2017年第9期。个案裁判是综合各种因素之后的决策,主要是规范的、事实的,但社会评价如前所述也是伦理的,规范类似和事实类似很容易被混淆成伦理类似,舆论可能就此进行是否同案同判的评断,这在于欢案、邓玉娇案等很多公案中都有所体现。以于欢案为例,在人工智能的推送服务中,“辱母”案与 “辱妻”案被类比时背离了类比推理的本质要求,正当防卫的规范和事实被漠视,伦理因素成了检索主线,而案件裁判预测结果与事实结果之间的重合率会影响社会对案件裁判的法律职业伦理评价,不当类比可能导致失当的舆论压力。

不难看出,智能推送的算法中有明显的价值判断和导引。随着大数据技术支持下的案件裁判预测服务逐渐普及,对法律职业伦理价值进行人工智能的判断已经是个不可回避的问题,这意味着相当多的人们将不自觉地让渡其价值决策权,大数据案件预测将严重影响舆论评价偏向,法律职业伦理和大众伦理之间的紧张气氛可能因此愈演愈烈。

(三)偏差和歧视:法律人工智能的数据质量问题

在智能化的社会中,利用数学方法将法律事务数据化,甚至对法律职业伦理评价以人工智能为参考将日趋常态化。然而,数据是机器学习的前提,数据质量对人工智能决策的影响是决定性的。但是,就法律职业伦理评价而言,数据信息必然存在算法歧视,并且天然不完整,因此,其中蕴藏着巨大的风险。

首先,出于对法律和道德的稳定性、确定性的渴望,科学家们一直尝试将法律问题与道德问题转化为技术问题。拉德布鲁赫说,“如果不能明确认定什么是公正,那就必须明确规定什么是正确的”。⑤[德]拉德布鲁赫:《法哲学》,王朴译,法律出版社2005年版,第74页。洛克认为,伦理学可以像数学一样推理演绎,⑥李家莲:《论弗兰西斯·哈奇森的道德代数法》,载 《南华大学学报 (社会科学版)》2015年第1期。沙夫茨伯利首先把量的计算的思想引入道德理论领域,⑦参见前引⑥,李家莲文。哈奇森创造出 “道德代数学”,推演出用于计算行为道德程度的公式。⑧[英]弗兰西斯·哈奇森:《论美与德性观念的根源》,高乐田等译,浙江大学出版社2009年版,第127页。随着人工智能的迅猛发展,这种倾向于今为甚。2015年11月,欧盟数据保护委员会就提出了是否可以让机器代替人来做道德、法律等判断的问题。⑨腾讯研究院等:《人工智能》,中国人民大学出版社2017年版,第243页。可以预见,人工智能将逐渐演化成社会 (包括法律职业人)进行法律职业伦理评价最主要的认知界面。但数据技术就意味着 “正确”吗?事实上,随着研究的深入,晚年的哈奇森也删除了学说中的数学语言,不再试图计算道德情感。⑩[英]弗兰西斯·哈奇森:《论激情和感情的本性与表现,以及对道德感官的阐明》,戴茂堂等译,浙江大学出版社2009年版,第220页。

大数据算法给人中立、客观、科学的印象,然而,伦理价值并不是形式化的,也不是普世的,嵌入AI的价值只能是特定团体 (个人)针对特定事务的价值规范。事实上,算法的设计必然是编程人员的主观判断和选择,因此,伦理价值被量化、被算法化很有可能暗藏歧视与不平等。比如美国一些法院使用的犯罪风险评估算法COMPAS已被证明对黑人造成了系统性歧视。①参见前引⑨,腾讯研究院等书。价值领域的算法潜藏更大的歧视风险,而且算法倾向于将歧视固化、强化,甚至形成连锁效应。但是基于机器算法的不透明性和规模效应,使用者和设计者的控制权并不平等,很难审查嵌入到自主决策系统中的价值规则。基于此,当人工智能危害社会时,就可能成为危害远大于传统武器的 “数学武器”。

其次,数据的不完整性可能导致判断偏差。人工智能与法律合作的科学基础,应是数据信息的全面、深度挖掘。我国目前市场化的法律人工智能服务数据主要来源于中国裁判文书网等公布的裁判文书。但是,在司法过程中得以显现的伦理信息更可能是片面的,无法真实复原案件裁判。这体现在三个方面:1.在裁判文书中,伦理更多是深层的潜在因素。个案之所以引起热议和评判,是因为它具有某种 “主题元素”,比如贫富关系、权贵身份、道德底线等,②参见前引⑦,孙笑侠文。但这些元素在舆论中和在法律上的价值显然是不同的,在裁判文书中伦理信息可能显示度很低甚至缺失。2.裁判说理具有防卫性。为息讼止争、避免扩大影响,裁判文书一般尽可能避免价值判断;③凌斌:《法官如何说理:中国经验与普遍原理》,载 《中国法学》2015年第5期。同时,我国的裁判文书表述普遍奉行 “宁简勿繁”“含糊胜于明确”的原则,裁判语言高度概念化、抽象化,④黄利红:《民事判决书不说理之原因及其对策》,载 《广西社会科学》2004年第3期。这一现状进一步加剧伦理数据质量缺陷。3.证据并不都是中性的,包括中立证据和无法排除利害关系的证据,被害人陈述,犯罪嫌疑人、被告人供述和辩解等证据。由于其提供者与案件之间存在利害关系,很难保证客观性,⑤白建军:《司法潜见对定罪过程的影响》,载 《中国社会科学》2013年第1期。但正是这种有明显道德情感倾向的证据更加容易进入大众视野,引发情感共振。

更有甚者,关于法律职业伦理评价,媒体报道词库 (自媒体报道词库在一定程度上形成情绪性法律职业伦理评价的主流数据来源)在可靠性方面受到同等 (甚至更高)的重视,而 “许多记者在寻找情绪化的东西。可怕的在于法官挖鼻孔也会成为当天的新闻。”⑥怀效锋:《法院与媒体》,法律出版社2006年版,第208页。媒体意见数据是否具有代表性,是否具有统计意义上的可推论性,在伦理这个相对主观的领域,都是不能回避的问题。由于伦理评价的主观性,姑且不谈更相关、真实、完整的数据很难获取,即使能够取得也很难得到应有的关注,这就导致了小样本预测的有偏风险。

搜索算法的野心显然不局限于解决信息过载的问题,个性化推荐很容易植入隐形的诱导,在搜索算法的引导下,人们的思维方式也就相应地从重视寻找数据背景的原因,转向了如何运用数据本身。⑦成素梅:《智能化社会的十大哲学挑战》,载 《探索与争鸣》2017年第10期。而数据质量难免存在先天缺陷、面临商业污染和权力剪裁,面对以低质数据为基础的人工智能决策 (或辅助决策建议),人们很难做出理性的判断与选择。在未来法律职业伦理实践和评价中,无论 “自愿”追随高举道德大棒的 “正义之师”,还是在沉默螺旋中习惯性失语,都可能成为常态的病态。

二、技术胁迫:司法自由裁量权萎缩的风险

(一)不当类比:同案同判的悖论

当前,智能辅助办案技术正在越来越多的应用,市面上多款法律AI产品也都已具备类案推送功能。同案同判⑧这里的 “同案”应当视为 “类似案件”或者 “同类案件”。参见杜文静:《法律论证视域中的同案同判原则》,载 《法律方法》2017年第1期。是法律职业界和社会大众的共同愿景。司法裁判最重要的角色是指向未来的,“同案同判”关系到普通民众对司法正义的切身感受,是不可忽视的司法要求。⑨陈景辉:《同案同判:法律义务还是道德要求》,载 《中国法学》2013年第3期。社会通过司法裁判感受法律的温度,对案件裁判的关注度甚至甚于法律规范。法律职业界则期待案件预测服务帮助当事人做出理性预判,并且通过技术倒逼 “同案同判”。但是伦理意义上的 “同案”判断不同于单纯法律意义上的 “同案”,民众对 “同案不同判”的理解更多地停留在一般的报道和大众的理解之中,缺乏深入仔细的研究,⑩孔繁灵:《“同案同判”与 “同案不同判”》,载 《人民法院报》2014年2月15日第2版。对 “同案”的机械同判容易流于形式化而损害实质正义。

不难发现,法律人工智能的研发明显趋向案件裁判的同一性。但是,世界上没有两片相同的树叶,何况伦理要素的认定更加主观、复杂,因此,所谓 “同案”其实具有多样性的差异,司法裁判理应保持适当的弹性。但是,在智慧司法大潮中,公检法司不同角色的协同性和统一性在加强,①季卫东:《人工智能时代司法权之变》,载 《东方法学》2018年第1期。同时,审级的意义却在削弱。每个人都是具体的和独特的,就个案和个体而言,对道德类似的判断很难达成共识,并且也不必要、不应该要求共识,至于多数人通过个案影响法律实践的方式对少数人提出某些道德要求,甚至可以说是非正义的。换言之,以案件裁判的一般性或者多数性原则来判断其合伦理性,这个标准不能说是科学的。在伦理价值意义上,同案同判的要求可能无视时代变迁、观念衍变,甚至可能走向正义的反面。起码在法律职业伦理领域,大数据预测可能扭曲社会的伦理评价,带来新的偏见和滥用。算法权力的膨胀可能导致司法自由裁量权的萎缩,伦理评价意义上的同案同判更容易导向异案同判,在一定意义上,技术 “倒逼”可能演变成 “胁迫”,影响乃至“绑架”个案司法。

(二)风险规避:技术 “倒逼”的消极后果

随着法律人工智能的进一步发展,案件裁判预测服务将更加普遍,当事人、民众都可以由 “同案”判断预测裁判结果。但正如前文所述,伦理元素一般来说并不是中立、客观的,并且数据在质和量两方面都存在天然缺陷,这样一来,案件裁判预测结果首先不是 “全数据”或者 “大数据”的,甚至可能只是典型个案的类比,但小概率很可能由于被互联网信息技术造成的围观结构急剧放大,②季卫东:《决策风险、问责以及法律沟通》,载 《政法论丛》2016年第6期。这时偏颇的数据可能反而是受欢迎的,不同主体可以 “量体裁衣”、各取所需,并且自认或自诩其预测结果是客观、中立、科学的。如果法律监督的视野只限于个别事件,那么,所发现的问题不是夸大就是缩小。失真的结果便是失信。③白建军:《大数据助力法律监督》,载 《探索与争鸣》2015年第2期。当这种预测结果的影响越来越大,民众和提供法律服务的商业机构都可能因此调整预期,通过算法的选择或设计干预司法。

马默总结了同案同判起作用的三种场合:法官有两可的选择、法官需要在不可公度的价值中进行选择以及法官面对与法律相关的道德模糊的情形。④转引自前引⑨,陈景辉文。这一方面意味着在伦理评价上 “法律的具体化必然拥有的裁量空间”。⑤陈景辉:《实践理由与法律推理》,北京大学出版社2012年版,第19页。另一方面,说明同案同判也是限制自由裁量的重要工具。⑥参见前引⑨,陈景辉文。司法实践中,普遍认为 “判决的可预测性是梳理司法公信力的社会基础,”⑦王国龙:《判决的可预测性与司法公信力》,载 《求是学刊》2014年第1期。同时,矛盾化解难度不断增大,民众对司法案件往往有 “贫富对抗”“官民对立”以及 “司法腐败”的情节预设,处理不慎甚至可能会引发严重的群体性问题,⑧李学尧:《转型社会与道德真空:司法改革中的法律职业蓝图》,载 《中国法学》2012年第3期。司法判断面临重大风险。

随着司法官员额制、责任制的确立和落实,案件质量控制模式的更新是应有之义。在某种意义上,法律人工智能 (包括智能辅助办案系统和大数据案件预测法律服务)被当作能够确保 “同案同判”效果的智能控制模式。⑨黄京平:《刑事司法人工智能的负面清单》,载 《探索与争鸣》2017年第10期。然而,在缩减恣意的同时必将压抑选择,而 “选择恰恰是法律程序的价值所在”⑩季卫东:《法律程序的意义——对中国法制建设的另一种思考》,载《中国社会科学》1993年第1期。。在尚未完善的追责制度下,司法实践对 “同判”的划一要求是机械的、过度的、不健康的,所谓 “倒逼司法公正”可能在一定程度上剥夺司法的自由裁量权。司法官可能为规避风险而受制于法律人工智能的预测、屈从于算法。丹宁勋爵指出,当法官依法行事时,每位法官均应受到保护,以免负赔偿的责任,①[英]丹宁勋爵:《法律的正当程序》,李克强等译,法律出版社2011年版,第56页。但这在当前的考核制度下只能是奢望。而伦理评价存在无可回避的价值冲突,为了避免责任风险,内外夹击的沉重压力可能导致法官未来对 “客观的”人工智能过分依赖,省略主观能动性的发挥,甚至有意忽视类案之间的细节差异,借以逃避职业责任和道德责任。这样一来,由于人工智能技术的介入,司法自由裁量权可能在根基上遭到破坏。

三、专业视域:法律职业伦理能力的人机之战

法律人的工作性质决定其时常处理道德冲突,法官应在平衡各方利益的过程中,消除各种道德冲突,但是,实践中司法裁判的结果却往往不能做到这一点,反而引发新的道德冲突,这不能不让人期待人工智能在伦理能力上更好的表现。然而,法律职业伦理显然不是AI大放异彩的主场。

(一)视域融合:双重角色的法律职业伦理

我们不可能在社会现实中完全规避道德冲突,恰恰相反,“道德冲突是我们生活的一个本质性的组成部分。我们每天都要做出在道德上复杂的、缺乏可普遍接受的解答的决断”。②甘绍平:《道德冲突与伦理应用》,载 《哲学研究》2012年第6期。基于角色道德的性质,算法中植入态度的同时也就植入了冲突。法律人工智能算法也有 “先见”,也会植入设计者的主观态度。伦理价值判断是主观的,所有的理解和判断必然都受到各自视域的限制,自然也会产生对立和冲突。

专业知识 (包括职业知识)与专业屏障是 “专业化”之树上结出的相联又相异的两颗果实。③孙笑侠:《法学的本相——兼论法科教育转型》,载《中外法学》2008年第3期。作为专业伦理的法律职业伦理固守技术理性,而社会舆论以具体的实质正义为目标,往往彼此都无法被说服。一方面,“法律家的职业技术是一种有意识地排斥道德与政治等诸种法外因素的所谓人为理性或技术理性,其中的道德含量很低”。④参见前引⑩,孙笑侠文。而且,法律职业也确实存在大量价值观念混乱和职业伦理失范的问题,但法律人却普遍缺乏对信任危机的自省,更多地将理性限制为技术理性,把舆论批评解读为 “不理性”,寄望于教育社会或者教化民众,但是这恐怕是霍尔姆斯所谓的 “共有的偏见”之一,这种 “专业理性”只能在职业内部寻求共识,并不被社会认可和接受。

民众对法律职业伦理的高度关注,是由其高度伦理期待决定的,而这种伦理期待具有明显的正当性。所以,法律职业伦理不仅仅是职业的、专业的、技术的,更是社会的、伦理的。在社会生活中,“法律愈来愈变得令人难以理喻”,甚至变成 “完全异己”的活动,⑤舒国滢:《在法律的边缘》,中国法制出版社2000年版,第96页。这意味着法律职业的信任危机甚至社会危机。正如布洛克所言:“仅仅为技术问题寻找技术性的解决办法,不论多么具有吸引力,到头来都是幻想。”⑥[英]布洛克:《西方人文主义传统》,董乐山译,三联书店1997年版,第293页。技术问题尚且如此,何况价值判断。个案裁判一定是某种程度的公共判断,价值判断始终是一种视域融合的过程,角色道德设计是为了更好地实践伦理价值而不是相反,背离大众伦理价值的专业伦理,自省和改变是应有之义。

(二)应变与成长:人的价值决策优势

法律人工智能的价值判断缺乏应变力。伽达默尔认为,偏见当初并没有我们后来所加之于的贬义,从词源上,偏见是正式的法律判决前的临时判决或初判,这种判决或初判可以被更改或撤销。⑦转引自陈鸿清:《偏见:从非法到合法》,载 《厦门大学学报》1996年第2期。人类即使是有偏见的,但这种偏见始终是在由先见向意见发展,因此,无论法官还是大众,他们的偏见不是原罪,相反,人类所作的临时判决 (或者说初判)可以因应法律事实的复杂变化随时更改或者撤销,然而在法律事实确定的前提下,法律人工智能在算法确定之后,它的判决却是终局的,人工智能是以历史数据为基础解决未来的类似问题,但是,现在并不能代表当下和未来,只基于既往数据的判断缺乏生命力和成长性。

(三)法律论证:解释的必要性和可能性

与目前人工智能的黑箱算法相比,经过充分说理论证的人类司法裁判更具透明性和可接受性。当前主流的深度学习算法是一个 “黑箱”算法,允许计算机从数据中学习,不需要程序员作出新的分步指令,连设计者可能都不知道算法如何决策。即使在价值领域,人工智能决策系统也仅仅输出结论,却不提供做出决策所依据的材料和理由,这是非常危险的。因此,阿西洛马AI伦理价值原则特别强调了司法透明性,要求司法决策中使用AI系统应提供解释和救济。⑧参见前引①。但是要在系统中发现有没有存在歧视和歧视根源,在技术上是比较困难的,普通人一般无法理解算法的原理和机制。与之相对,司法裁判需要进行充分的说理和论证,这些都是公众可以审阅、理解、追问的。

道德多元化的现代背景对法律论证提出更多更细更高的要求。法律职业伦理能力主要体现为“通过理性的论证来赢得大多数人道德上能够接受的有关伦理冲突的解决方案。”⑨甘绍平:《应用伦理学的论证问题》,载 《中国社会科学》2006年第1期。如哈贝马斯所说,“法庭判决必须同时满足判决的自洽性和合理的可接受性这两个条件。因为两者不容易调和,两套标准必须在司法实践中达成妥协。”⑩[德]哈贝马斯:《在事实与规范之间》,童世骏译,三联书店2003年版,第245页。所谓接受就是指:“那些遵守这种实践的人认为这一规则是有约束力的,并且把这条规则看作是他们自己行为的一条理由或者正当理由,并且作为批评其他不遵守该规则的人们的一条理由。”①[美]罗纳德·德沃金:《认真对待权利》,信春鹰、吴玉章译,中国大百科全书出版社1998年版,第38页。而且,各种论证理由要在一个统一的标准下进行,只有如此,所作的价值判断才有正当性。因此,法律职业人在具体的伦理困境分析中解释价值决策时,必须正视所有可能的伦理规范和伦理理论,不仅要意识到舆论评价可能被数据信息引领和裹挟,意识到法律人工智能中的数据质量和算法歧视问题,而且还要明晰数据质量的具体问题和算法歧视的潜在来源,应对这些问题作出包容性、针对性的透彻说理回应。

无论如何,算法和人工智能不能成为法律职业伦理准则的决策者和发言人。但是,有必要提及的是,很长一段时间以来,技术主线的法律职业伦理更多关注形式理性,习惯了以专业为名拒绝向社会履行说明和解释的道德义务。然而,在法律人工智能的倒逼之下,无需说明的伦理权力模式已经无法延续。虽然在法律职业伦理的认知、决策和论证领域,人类都具有AI不具有的优势,但是在论证义务的履行上,法律人工智能的规模化应用起到的是正面的、积极的作用。

四、说服与信服:AI时代的法律职业伦理论证

关于伦理是否可教,古圣今贤有很多不同的看法,然而正如前美国最高法院大法官克拉克所说,“虽然许多法学院说他们无法教授道德品质,但他们必须教,因为没有其他人能教,”②转引自杨欣欣主编:《法学教育与诊所式教学方法》,法律出版社2002年版,第183页。因此这个问题不在本文讨论之列。事实上,法科生在法学院接受专业教育,作为专业伦理的角色道德却不受专业教育的影响,这是难以想象的。我们有理由期待的是,“由于对道德争议变得更敏感了,并且更有技术解决这些争议了,因此大学毕业生的行为就会更道德。”③[美]波斯纳:《道德和法律理论的疑问》,苏力译,中国政法大学出版社2001年版,第85页。

(一)防卫与权衡:AI时代的诉讼论证技艺

不管是否情愿,人工智能作为价值决策的辅助者甚至决策者的未来必然会来,算法歧视和黑箱也将如期而至,法律职业伦理与日常伦理的冲突将更加激烈、更加频繁。认识、应对、平弭伦理冲突是法律职业伦理教育的重要目标,但在法律职业伦理语境中,日常伦理天然不需要解释,人工智能算法解释有门槛和难度,而法律职业伦理则必须承担论证责任,怀疑、分歧或者反对都会削弱法律判断的效力。而且与一般的法律推理不同,价值论证无法单纯诉诸法律规范的权威,既需要对日常伦理有所回应,又需要对人工智能的价值算法有所评析,这就要求在法律职业伦理教学中研习论证技艺。

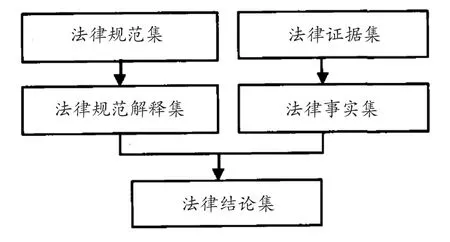

作为诉讼论证 (诉讼博弈过程中的法律论证)的基本模式,在法律五段论④熊明辉:《审判实践中法官的论证技艺》,载 《法学》2012年第9期。的论证过程中,尤其是由法律规范集到法律规范解释集之间和法律证据集到案件事实集之间,潜藏着大量法律职业内外普遍关注的伦理问题。(见图1)

首先,法律职业伦理论证的听众是一般公众。鉴于本文基于法律职业伦理与日常伦理冲突的视角展开,本文所谓法律职业伦理论证的目的也主要是为了说服一般公众而不是法律共同体成员。而且,在当代中国,法官的主要说理对象也是当事人以及一般公众,而不是法律职业共同体。⑤参见前引③,凌斌文。“老百姓到法院打官司,主要是认为法院是一个说理、讲理的地方”,⑥白泉民:《裁判文书说理的价值及其实现路径》,载 《人民法院报》2015年4月8日第5版。但是,要给一个外行讲明白裁判的理由,要比说服一个同行困难得多。⑦[美]波斯纳:《超越法律》,苏力译,中国政法大学出版社2001年版,第574页。毋庸讳言,法律论证具有防卫性。以裁判论证为例,司法权威与裁判说理的防卫性成反比。如果司法的权威较低,法官在裁判说理中就必须尽可能贴近法律条文的明确规定和社情民意的具体诉求,⑧参见前引③,凌斌文。以防备潜在质疑。价值判断没有直接的法律依据,又不能像一般公众一样简单地依赖于激情、偏见等非理性根据,这决定了法律职业伦理课程必须高度重视论证技艺的教学。经验也表明,态度转变大多由议题相关论证所引起,与由知识线索所引起的态度转变相比,论证线索导致更持续的态度转变,对行为更有预测性,以及对反说服具有更强的抵抗力。

图1:法律五段论结构图

我们将受到一个具体人或一群人赞成的论证,称为说服论证;而假定为可被任何理性存在可接受的论证,称为信服论证。说服可能单独出现,但信服的出现通常伴随着说服,为取得信服铺路搭桥。纯粹的信服主要诉诸智识,而说服则需要根据听众的特质甚至偏见修辞。法律职业伦理论证既是信服论证,又是说服论证,因此,论证中需要适应听众的参照系,必须以共识对象作为论证出发点,以听众的知识、经验、期望、意见、规范为基础。不能简单地假定听众不赞成的价值观,尽量不要使用听众会认为有倾向性的措辞。一方面,自媒体可以像厨师那样用美味却不健康的食物取悦听众,但作为社会医生的法律人,应该为听众提供苦涩却健康的药物;另一方面,如果专业的法律思维方式需要以法律共同体对外行的排斥和压制为前提,即使在法律职业共同体内部达成共识,也是无法实现社会说服和社会信服的。

其次,人工智能时代,数据能力培养当然是法律职业伦理教育的重要内容,这主要体现在以下两个方面:

1.统计证据在法律论证中的重要性。回应日常伦理的质疑是法律职业伦理论证的天职,这种负面考虑虽然不是论证的前提,但是,却使得论证需要增加 “权衡前提”,正是该前提表明了那些负面考虑对于结论的得出不再重要了。以因果规则和证据规则为基础的论证通常是可废止的,所以法律论证是可废止的。各种类型的证据说服力不同,统计证据和因果证据在法律论证中一般具有同等说服力,但是在伦理论证中,受到认知偏差等非理性因素的影响,因果证据的说服力甚至不如轶事证据,而统计证据无论在理性论证还是非理性论证中都有强大的说服力。随着人工智能和智慧司法的发展,这意味着统计数据将成为决定论证可接受性的重要指标。说服不是法律职业伦理论证的最终目标,在 “终身负责”的制度背景下,论证不仅应是说服的、可接受的,更应是信服的、值得接受的,因此,法科生需要学习事实类比和价值类比的规则和标准,善用统计证据。

进一步说,伦理嵌入是人工智能系统进行道德决策的前提,法律职业伦理本质上属于权力伦理,对于法律实践的作用毋庸赘言,选择哪些伦理规范和价值内容转化为计算机代码,不能不说是极大的权力。法律职业伦理教育对AI的反思,不能局限于肤表,更不能停留于情绪宣泄,必须提炼、标识法律职业伦理价值嵌入人工智能,主动寻求对信息检索和价值评价的指引,掌握价值决策算法的设计权、控制权、监督权,这是结构化的法律职业伦理教学的重要目标之一。

2.采集、分析、评估数据的能力是智慧司法时代的基本要求。一般认为,和教育相关的人工智能技术包括以下几种:语音识别、语音合成、智能阅卷、机器翻译和知识推理。⑨吴晓如:《人工智能驱动下的个性化教学》,载 《华东师范大学学报 (教育科学版)》2017年第4期。AI时代的法律职业伦理教学,当然要善用这些人工智能技术,同时更要培养学生采集、分析、评估数据的能力,这也是AI商的一个重要体现,却是现在较少关注的。为了发挥数据的真正价值,学生对算法歧视和黑箱算法不仅应有AI意识,更应有AI技能,“你只能给Alpha Go一个正确的棋谱,如果你给它错误的棋谱,可能它就学错了,这就会干扰它的决定。”⑩蒲戈光:《教育的银弹:人工智能环境下未来教育的有效手段》,载 《华东师范大学学报 (教育科学版)》2017年第4期。对于大规模数据,如果不能善用,反而可能因为信息过载成为学习的负担。数据能力的培养一方面能让学生对所有利益相关者有更全面的认识,以做出更符合法律实践场景的价值决策;另一方面在主动型的学习中自然意识到不同算法各自的价值倾向,清晰认识和评价不同法律人工智能主体的关注点、观点偏向、利害根源和责任配置,保证学生主动利用数据资源而不是被动顺从人工智能引导,从而更加客观、全面地思考法律职业伦理困境和做出价值决策。

(二)结构化过程:溶入式大课程体系

首先,法律职业伦理教学决不能局限于法律职业伦理的单科教学,而应是专业溶入式的大课程体系,这个体系甚至不是法律职业伦理课程统摄下的,而是法律职业伦理课程和法学专业课程的协和共济,通过贯穿式、溶入式的教学过程,实现法律职业伦理的理论认知、实践体验和反思内化。其中,法律职业伦理课程主要讨论法律职业伦理价值、规范、评析各种伦理学理论,为法律职业伦理决策提供基础的、引导性的工具,而真正有代表性的具体法律职业伦理问题存在于各部门法中。溶入式的法律职业伦理教学不仅仅指在法律知识和技能的教学中间接地渗透道德影响,而是要求在所有的法律专业课堂上通过案例分析方法系统地进行法律职业伦理决策训练,以专业案例的形式讨论各种法律职业伦理案例与实践情境。

法律职业伦理的案例教学主要是通过一个伦理两难的案例情境呈现伦理问题,并提供相关理论工具,由学生做出并解释伦理决策。因为 “任何人都不能被灌输或施加条件来诚实地讲话或公正地判决,因为实施这些美德都要求一种自觉意识和自由选择的品质,”①[美]麦克莱伦:《教育哲学》,宋少云译,三联书店1988年版,第324页。所以,案例教学要以反思性思考为中心,应当力求避免伦理主观主义和单纯的应用伦理分析。

溶入式法律职业伦理教学对教师的要求较高 (由于教材由教师撰写和选择,因此,对教材的要求也体现为对教师的要求之一),“我们所担心的是不称职的法律教师,而不应该担心法律教育本身。”②参见前引③,孙笑侠文。从内容到教法上必须进行融贯的整体设计,结合不同学科的内容和特点选择特色鲜明的案例,同时避免与其他学科的重复、浪费和冲突。在教学方法上,除了基础的案例分析法之外,群体学习法、生活个案研究、角色扮演等多种方法都可以用来培养学生的法律道德情感。

其次,法律职业伦理教学应该是结构化的。结构化教学过程以程式主义为特征,体现为稳定、有序的组织结构形态,用预设的固化结构形态和模式范例来框定课堂教学。结构化的要求强调的是遵循一定教学规范,对学生普遍存在的集中注意力困难、领域知识缺乏和动机缺乏问题的解决有重要意义。严谨是论证的基本要求,诉讼论证明显具有动态性、(多)主体性、目的性、语境敏感性以及前提集的开放性等特征,③熊明辉:《论法律逻辑中的推论规则》,载 《中国社会科学》2008年第4期。如果没有程序框架的规约,论辩可能失序或者纠缠不休,所以有必要引入程序规则,而非结构化教学容易分散焦点、纠缠枝节。

具体地说,在溶入式法律职业伦理教学全流程中,结构化过程模式要求学生:1.主动收集、检索更多信息,在全面认知利益相关者的立场的基础上确定主张或立场,并寻求证据和法理支持,管理分歧空间的冲突,对论证范围作出语境化限定,设计论证 “框架”或者 “定界符”;2.清晰理解案例中所包含的伦理困境的本质,尝试建立一致区间的共识性前提,这个前提不仅是 “职业”的,而且是 “伦理”的,尽量使用没有倾向性的语言,认同日常伦理的合理观点并理解一般民众的修辞和情绪;3.应用道德技术做出价值决策并充分解释,设计 “攻防”线路,对现实和潜在的质疑作出回应;4.设计对该决策的追踪和监测路径,并根据反馈反思论证中的表达性剔除、增加、排列和替换问题,即:哪些前提和修辞是应该或可以省略的?应该增加什么前提和使用什么修辞技巧?哪些论证步骤应该重新安排?以及对需要改述的部分具体如何操作?论证中相关性是否缺失?是否不当地诉诸了情感?这四个步骤就形成了一个法律职业伦理问题思考的过程框架。值得提醒学生的是,由于缺乏价值共识,沟通和理解越来越困难,说服不是也不可能是一次性的,它往往是过程性的交互论辩的过程,④参见前引④,熊明辉文。而结构化教学模式可以使法律职业伦理论证避免陷入无穷倒退和循环论证的泥潭。

总之,在人工智能时代,法律空间风云巨变,势必影响法学教育场域,智能时代的教育应当是一种 “人性为王”的教育,道德、情感等将成为未来教育最为重要的内容,⑤项贤明:《人工智能与未来教育的任务》,载 《华东师范大学学报 (教育科学版)》2017年第5期。法律职业伦理教育必将成为法学教学的核心内容。而且,随着人工智能应用领域的不断扩大,计算技术的下一步发展,可能是情感技术,⑥邹昊:《人工智能改变人类未来的教育与生活》,载 《华东师范大学学报 (教育科学版)》2017年第4期。技术法律职业伦理教学的冲击会越来越强烈。我们必须仔细观察、深入分析、全面评估 “人工智能+”在法律职业伦理教学领域的各种波及效应,以迎接未来。?