基于分类距离分数的自适应多模态生物特征融合

张 露 王华彬 陶 亮 周 健

1(计算智能与信号处理教育部重点实验室(安徽大学) 合肥 230601)

2(安徽大学媒体计算研究所 合肥 230601)

(zldiol@163.com)

传统的单模态生物特征识别技术[1],如人脸识别[2]、虹膜识别[3]以及指静脉识别[4]等,虽然取得了不错的成效,但由于其单一模态的固有限制,仅靠单模态的生物特征识别技术已不能满足日益提高的安全性等要求.而多模态融合技术[5-6]是将同一个生物的多个不同的生物特征,按照某种融合规则融合成一个整体进行识别,具有更强的区分性和安全性,可以做出更为精确的识别.因此多模态融合技术已成为近年来的研究热点.1998年,Hong等人[7]首次尝试将指纹和人脸的生物特征融合规则融合成一个整体进行识别,识别精确有了很大幅度的提高.Jain等人[8]提出了基于指纹人脸和手行的多生物特征识别技术.Jing等人[9]首次尝试了基于人脸和掌纹图像的融合识别技术.袁广林等人[10]提出了基于自适应多特征融合的目标跟踪算法.支力佳等人[11]融合多种特征点信息的最小生成树应用到医学图像上进行配准.文献[12-13]分别将层次特征信息、整体和局部信息进行融合,提高了图像的分类效果.

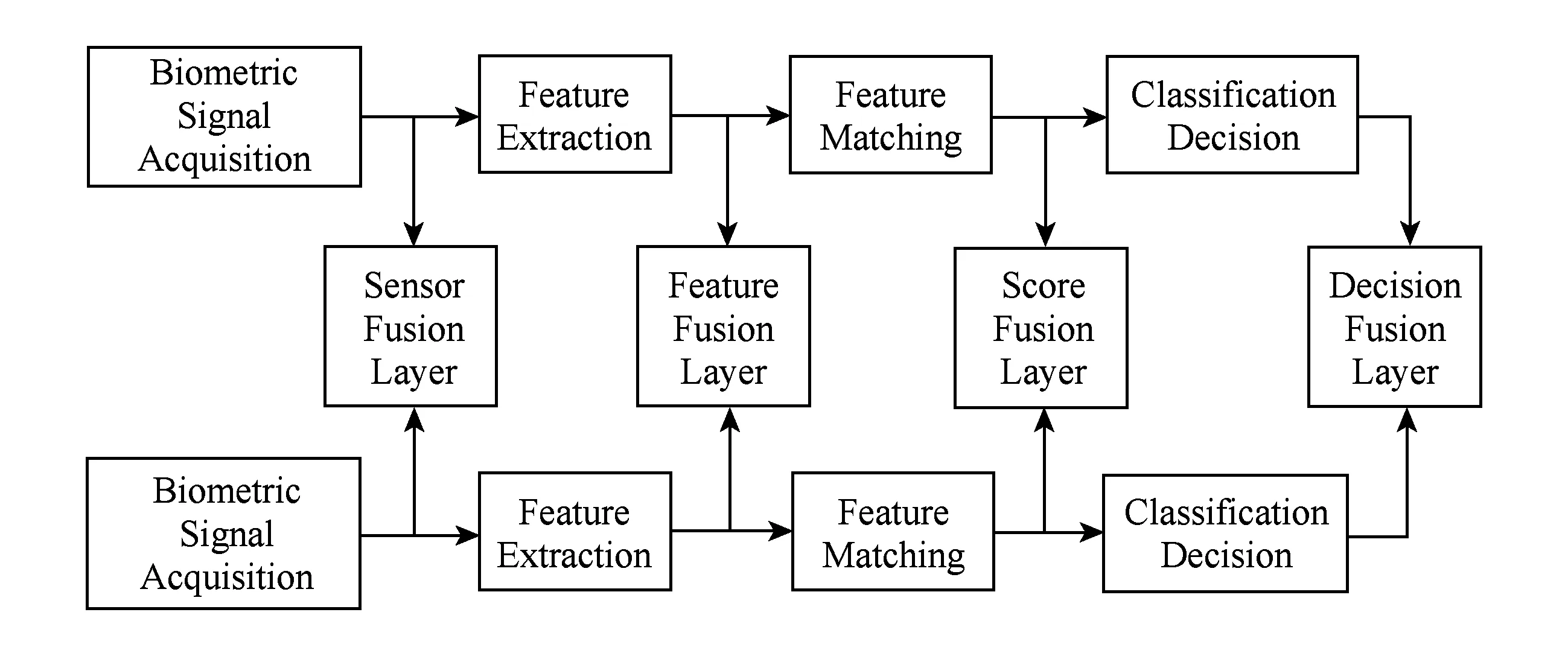

多模态融合技术一般可以分为4个部分,分别为生物特征信号的获取、特征提取、特征匹配和分类决策.根据融合信息的不同,可分为传感器层融合[14]、特征层融合[15]、分数层融合[16]、决策层融合[17].图1为多模态融合技术的组成以及融合层次.其中,分数层融合是最常用的融合方式,因其包含了类内分数值和类间分数值,可通过某种融合规则增大类间距离、减小类内距离,从而实现分数层的融合识别.目前,对于多模态生物特征融合的研究,大部分文献均采用分数层进行融合信息.Nandakumar等人[18]将分数层融合分成3类:基于归一化的融合、基于分类器的融合、基于密度的融合.

Fig. 1 Composition of multimodal fusion technology and the levels of fusion图1 多模态融合技术的组成以及融合层次

基于归一化的融合方法,首先将单模态获取的匹配分数进行归一化处理,通过某种转换规则函数得到一个新的转换分数,用转换后的分数作为分数指标进行识别.常用的归一化函数有Min-Max,Z-score,Tanh,Sigmoid[19].文献[20]提出了一种新的分数转换函数,得出特征的匹配分数后将其分类,计算每个得分属于某一类的概率,即分类置信度分数(classification confidence score, CCS).由于CCS加入了类别信息,其分类性能要优于常用的归一化函数,但CCS对某些特定数据却没有很好的分类效果.文献[21] 提出了一种总错误率(total error rate, TER)的概念,将TER代替匹配分数作为融合分数指标引入到融合识别中,此方法计算较为复杂繁琐.

基于分类器的融合方法,是将匹配分数作为一个特征向量,对此特征向量进行分类.文献[18]首次提出了用分类器将多个生物特征进行分类识别,从而推导出SUM,MAX等4种基本的融合规则,虽然效果要优于单模态的识别效果,但融合规则过于简单,没有考虑到样本训练集和测试集的划分的影响.文献[21]在不确定度量的基础上利用信息熵理论,提出基于特征关联的多特征自适应融合策略,获得了较好的效果.文献[22]采用Min-Max归一化函数对匹配分数进行归一化处理,融合规则采用加权和的方法,总权重限制为1,没有考虑生物特征之间的关联性质.文献[23-24]采用匹配分数作为融合分数指标,用SVM,KNN等分类器对其进行训练,但由于SVM参数较多且其设定较困难,时间效率不高.文献[25-26]利用三角范数公式将归一化后的匹配分数融合起来,但是构造一个合适的三角范数很困难.

基于密度的融合方法是将匹配分数转换成后验概率,根据贝叶斯判决作出最终的决策.文献[27-28]使用混合高斯模型求取匹配分数的匹配分数密度,将此匹配分数密度用于融合识别,此方法需要准确估计出匹配分数的密度,实现代价较大.

基于归一化的融合方法只需将匹配分数通过转换函数转换成某一分数,不需考虑匹配分数服从某一分布,实现较为简单;采用SVM,KNN等分类器进行融合,含有较多参数,降低了识别算法的时间效率;基于密度的融合方法需要准确估计出合法用户和不合法用户匹配分数的密度,实现较复杂,由于多模态识别系统中合法用户数目比不合法用户数目少,其匹配分数很难服从某一分布,因此,很难明确估计出匹配分数的密度.基于此,本文提出了一种基于分类距离分数(classification distance score, CDS )的自适应融合识别算法.相对于分类置信度分数[20],不仅携带有一级分类信息,也包含有匹配分数与分类阈值之间的距离信息,可增大融合后类内类间分数之间的距离,便于设置阈值进行识别;信息熵表示信息价值的多少,通过用信息熵定义关联系数和特征权重系数,可以让样本包含的信息更加集中突出,在不确定度量的融合框架[29]的基础上,采用关联系数和特征权重系数,将加权融合和传统SUM规则统一在同一个自适应的算法框架中,提高了融合识别率.

为了验证CDS和融合算法的有效性,在单模态数据库、双模态数据库以及三模态数据库上进行大量实验,将CDS与传统的匹配分数和文献[20]提出的CCS对比,实验表明CDS取得更好的效果;将本文提出的融合算法和多个融合方法进行比较,实验表明:本文方法可以取到更好的分类性能.

1 分类距离分数

传统的分数层融合方法中,其融合分数指标一般为匹配分数,当2类样本非常相似的情况下,其与类模板的匹配分数数值上很接近,即类内距离和类间距离数值上很接近,不能很好地区分开类内类间的数据.文献[20]在传统匹配分数的基础上,提出了分类置信度分数,该方法可以较好地分离开类内样本和类间样本.但是对于匹配分数仅次于分类阈值的数据,却不能很好地分开.

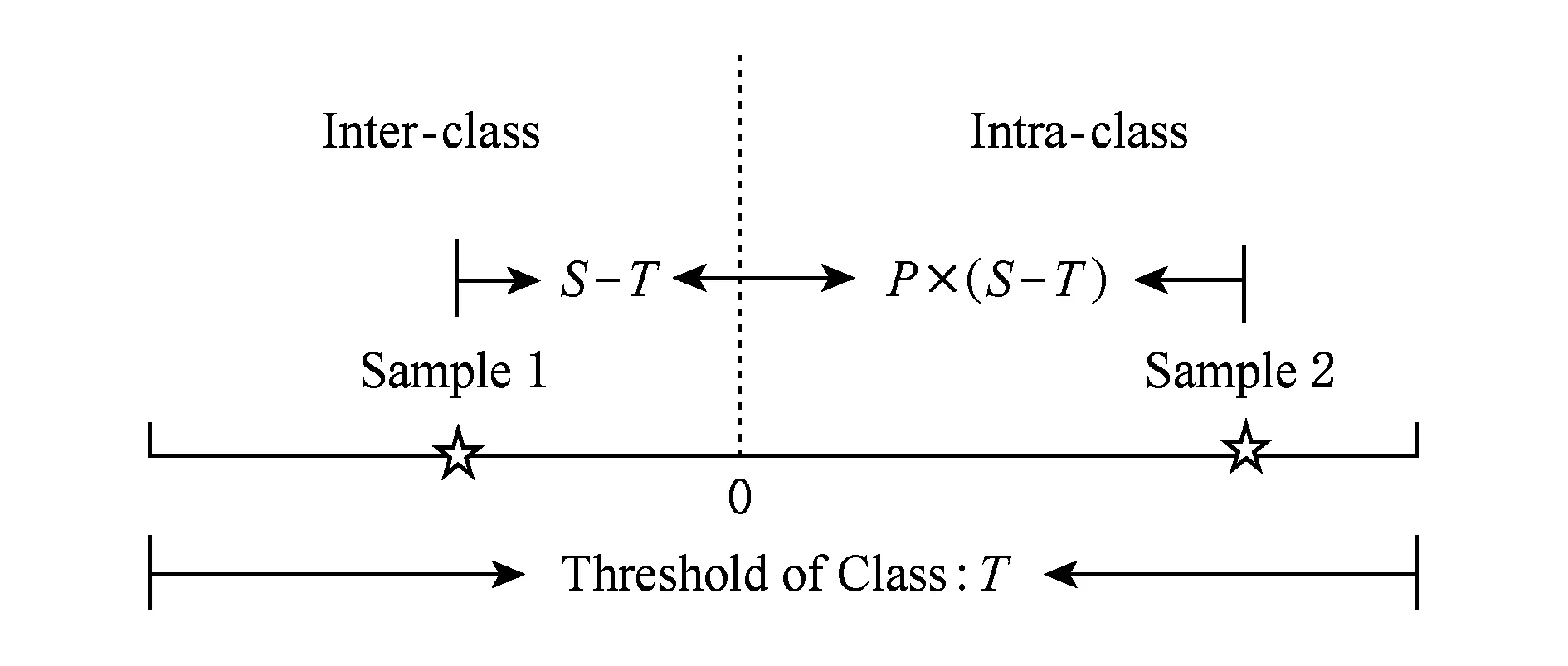

在文献[20]的基础上,本文提出了一种将匹配分数与分类阈值之间的距离分数作为融合的分数指标.分类距离分数不仅含有分类置信度分数的类别信息,也包含匹配分数与分类阈值之间的距离信息,因此,在融合阶段采用分类距离分数作为分数指标,可以让类内类间融合后分数之间的距离增大,提高融合识别率.图2为距离信息分析图,其中S为样本的匹配分数,T为分类阈值,p为距离参数,为保证CDS的取值范围保持在[0,1],同时要求类内样本的分类距离分数远大于类间样本的分类距离分数,式(2)中的距离参数p=2较为合适.

Fig. 2 The diagram of distance information analysis图2 距离信息分析图

首先,在训练阶段求出每个样本的匹配分数S,根据匹配分数为每个模态特征训练一个分类阈值T,大于等于此阈值的为类内样本,否则为类间样本;通过比较样本的S与T的大小,对样本进行分类;然后再计算每个匹配分数与分类阈值之间的距离和分类阈值的比值,这个比值即为分类距离分数.以下为具体实现的步骤:

1) 用Imean,Omean分别表示生物特征类内、类间的匹配分数的平均值,则可以定义一个阈值T,阈值T是指某一类样本区别于其他类样本的一个阈值,可根据此阈值的大小判断该样本的类别,从而在融合分数指标中加入类别信息:

(1)

2) 根据求出的分类阈值T,对样本求出的匹配分数进行分类,然后求出每个样本的分类距离分数.在单模态下,比较样本的匹配分数S与分类阈值T的大小,当S≥T时,用式(2)求出该样本的分类距离分数,否则用式(3)求出该样本的分类距离分数.如果一个样本属于这一类,这个样本对应于某个类的分类距离分数为正数,否则为负数,即可以很明显将类内类间样本区分出来,同时增大了类内类间样本的融合分数之间的距离.

(2)

(3)

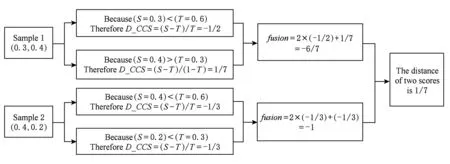

假设有指静脉匹配器和掌纹匹配器,且类内的匹配分数要高于类间的匹配分数.假设融合公式fusion=2Svein+Spalm,其中Svein,Spalm分别为静脉和掌纹的匹配分数.对于某一类来说,根据指静脉区分类内类间的阈值为0.6,根据掌纹区分类内类间的阈值为0.3,其样本1的匹配分数为(0.3,0.4),其中0.3,0.4分别为指静脉、掌纹的匹配分数;样本2的匹配分数为(0.4,0.2) ,其中0.4,0.2分别为指静脉、掌纹的匹配分数.由于分类距离分数加入了类别信息,从图3~图4可见,本文提出的方法可看出样本2不属于此用户的概率明显比样本1大;采用式(2)(3)对不同类别的样本求出分类距离分数,2个样本融合分数的距离为2/3,比采用分类置信度分数得出的融合分数之间的距离要大.因此,分类距离分数加入了类别信息以及增大融合后类内类间的距离,可以很好地判断样本的类别,便于融合分类.

Fig. 3 The diagram of calculating the classification confidence score and the distance of fusion scores图3 计算分类置信度分数及其融合分数间距离的示意图

Fig. 4 The diagram of calculating the classification distance score and the distance of fusion scores图4 计算分类距离分数及其融合分数间距离的示意图

2 自适应融合方法

传统的融合识别算法中,一般给生物特征赋一个全局权重,这种方法具有很大的局限性[20].由于每个生物特征包含的信息不一样,对于不同的人,具有代表性的生物特征不同.例如:一类样本的指静脉信息具有很大的辨识度,而掌纹信息辨识度很低;另一类样本的掌纹信息具有很大的辨识度,指静脉信息辨识度很低,因此,对于不同类的样本,应根据其每个模态所含有效信息的多少赋予不同的权重.文献[22]虽然考虑到权重的影响,但是仅仅通过简单加权和的方法对融合分数指标进行融合,没有考虑到特征与特征之间的相互关联性.

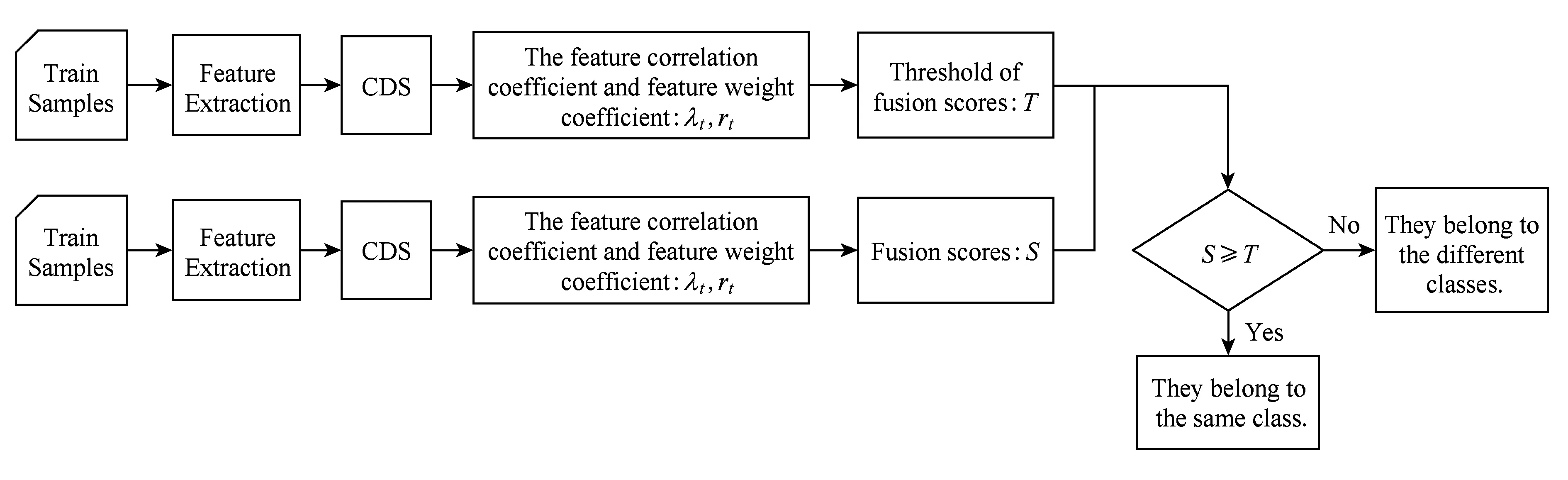

信息熵是用来衡量一个随机变量出现的期望值,一个变量的信息熵越大,那么它出现的各种情况也就越多,也就是包含的信息多.本文通过利用信息熵的这一特性,定义每个样本特征之间的关联系数和权重系数,利用这2个系数将加权融合和传统SUM规则统一在同一个自适应算法框架中,进行融合识别.图5表示多模态生物特征融合的算法流程.

2.1 特征提取

分数层融合是在特征匹配与分类决策之间进行的,因此需要对原始的生物特征进行特征提取.

1) 指静脉特征是利用文献[30]的方法,通过对归一化后的图像进行增强、Niblack分割、细化以及加宽等处理来得到.

2) 掌纹特征采用文献[31]的方法,将Gabor和PCA结合起来,对增强后掌纹图像进行特征提取,每个样本均可得到一个320维的特征向量.

3) 指形特征是通过检测到指静脉的轮廓图像,通过分层梯度方向直方图(PHOG)计算得到.

2.2 类模板

为了获得每类中每个样本的类间类内的匹配分数,需要为每类训练一个类模板,这样既可以减少计算量,也具有代表性.

对于提取的图像特征,某类的某个样本图像的特征向量用hk表示,每类中有M个样本图像,k表示第k个样本图像,将每类中的每个样本图像提取出的特征、对应位置的特征加在一起,同时除以该类所含样本的数目M,即为每类图像的类模板.

(4)

其中,k=1,2,…,M.

2.3 融合策略

一个变量的信息熵越大,其含有信息价值越大,本文的融合方法利用信息熵的这一特性,通过求出关联系数和特征权重系数,关联系数可以根据特征之间的关联性,将传统SUM规则和加权融合统一到一个自适应框架中来,特征权重系数可以根据特征信息动态地调节加权的比重,将所含有的有效信息更突出地表现出来,提高了融合识别率.

2.3.1 特征权重系数

假设每类均融合N个不同的生物特征,分别用F1,F2,…,FN表示每类不同模态的生物特征.在训练阶段,已经求出某类需要融合特征的分类距离分数D_CDSt(Fi),其中i表示某类需要融合的第i个特征,共N个特征;t表示某类的第t个样本.

根据信息熵[32-33]理论,采用的信息熵为

H=-pilbpi.

(5)

利用式(5)求出每个分类距离分数对应的信息熵:

Ht(Fi)=-D_CDSt(Fi)×D_CDSt(Fi),

(6)

其中,Ht(Fi)表示某类里的第t个样本分类距离分数的信息熵,其物理意义表示为分类距离分数含有的有效信息的多少.

定义特征权重系数式(7).对于某类里的第t个样本,先通过式(6)计算出其对应的信息熵之后,然后由式(7) 求出一个匹配器相对于其他匹配器的特征权重系数,特征权重系数为特征Fi的分类距离分数的信息熵和其他特征的分类距离分数的信息熵的比重,表明特征Fi在所有特征信息熵中所占的比重信息,比重越大,说明特征Fi含有的有效信息越多,有利于融合后的识别.

(7)

2.3.2 关联系数

定义某一个特征Fi相对于另外一个特征Fj的偏熵[34]:

HFi(Fj)=-D_CDSt(Fi)×D_CDSt(Fj).

(8)

Fig. 6 The flowchart of training and testing图6 训练和测试阶段流程

通过定义特征Fi的偏关联系数式(9),表示为特征Fi的分类距离分数的信息熵和特征Fi相对于其他特征的分类距离分数的偏熵之和的比值,表明特征Fi与其他模态的特征之间的相互关联性:

(9)

对于某类的第t个样本,先通过式(6)(8)计算出其对应的信息熵和偏熵之后,然后由式(9) 求出某一个特征Fi相对于其他特征的偏关联系数.此时,定义关联系数为所有特征的偏关联系数之和,如式(10),偏关联系数是指所有模态特征之间的相互关联性.

(10)

由实验可知,采用式(6)(8)直接计算出来的信息熵和偏熵的值为复数,为了更简便地计算,将这2个 计算公式进行了转化[35],分别为

2.3.3 融合算法

不确定性度量融合方法[25,36]是利用图像信息间的不确定性,将加权融合和乘性融合结合起来,并将其放入一个自适应框架中.文献[21]考虑到图像信息间的相关性,提出了一种基于特征关联性的自适应融合框架[37-38],将乘性规则和加性融合统一在一个框架中.由于乘性规则易受到样本训练集和测试集划分的影响,且没有SUM规则的识别效果好,因此本文通过将传统的SUM规则和加权融合统一在一个自适应框架中,利用信息熵表示信息的价值,将某一个特征Fi的信息熵和其他所有特征的信息熵之和的比重作为特征权重系数rt,特征权重系数rt可以根据特征含有有效信息的多少赋予相应的权重系数,起到有效利用有效信息的作用;用某个样本t的某个特征Fi和Fi与其他特征之间偏熵之和的比重表示关联系数λt,λt表示不同模态特征之间的关联性,可以根据特征与特征之间的联系,动态地调节2种基础融合方法——SUM规则和加权融合的权重,即本算法通过2层权重,将含有有效信息多的特征作为融合识别算法中的重点,实验证明取得了不错的识别效果:

(13)

由实验可知,λt的数值较高,且加权融合的识别效果比SUM规则要好,所以将λt作为加权融合的系数,K为不为0的自然数.

2.4 训练和测试阶段

多模态生物特征融合的识别系统主要包括2个阶段:训练阶段和测试阶段.

1) 训练阶段

① 对样本图像预处理,进行特征提取;

② 根据2.2节求出每个类的均值模板,求出样本与每个类模板的匹配分数;

③ 利用第1节的方法求出每类的阈值,并将匹配分数转化为分类距离分数;

④ 将分类距离分数转化为信息熵,并计算出每个样本的特征权重系数和关联系数;

⑤ 根据2.3.3节的方法,求出2种生物特征融合后的分数fusion,根据此融合分数求出每个类的融合后的阈值,为后面测试阶段提供 分类依据.

2) 测试阶段

求出测试样本中某类的样本与每类的类模板的匹配分数,同训练阶段一样,求出生物特征融合后的分数,与训练阶段求出的融合阈值进行比较,验证是否属于同一类.详细流程如图6所示.

3 实验与结果

本文实验采用的是天津市智能信号与图像处理重点实验室提供的指静脉图库、香港理工大学的掌纹公开数据库和指形数据库,由于目前没有来自同一个用户的多个生物特征图像的多模态数据库,且考虑到生物特征之间的无关性,因此,将多模态的图像数据用人为的方式进行1对1的匹配,确定为同一个用户的生物特征图像.因为不同来源的数据库类别和数量上都会存在差异,所以针对每个用户的单模态特征折中地进行选取,共取64个用户,每个用户的单模态特征图像有6个样本,随机选取2幅作为训练样本,剩下的4幅作为测试样本.为了验证本文提出分类距离分数CDS和自适应融合算法的有效性,共设计5个实验:

实验1. 为寻找到融合算法最佳的参数,可以使本文提出的自适应融合方法和分数距离分数相结合达到最优的识别效果.

实验2. 比较在不同模态下采用不同融合分数指标的性能,融合方法均选择自适应融合算法进行识别,验证本文第1节提出的CDS的有效性.

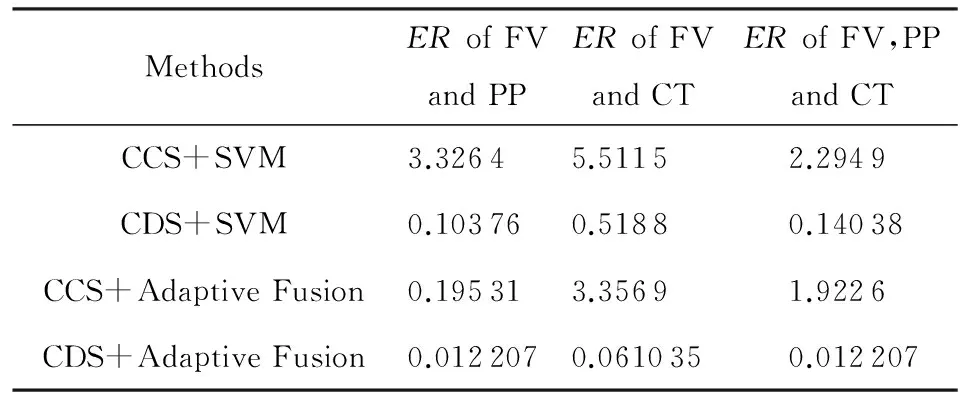

实验3. 分别将分类置信度分数CCS和CDS作为分类指标,并与SVM分类器和本文提出自适应融合识别相结合性能的比较,不仅进一步验证了CDS的有效性,同时也验证了本文提出的自适应融合算法的有效性.

实验4. 将自适应融合方法和常系数融合方法进行比较,验证本文提出自适应融合方法中自适应参数λt,rt的有效性.

实验5. 采用自适应融合识别的方法,与其他融合识别方法的性能进行比较,均采用CDS作为融合分数指标,验证本文提出的自适应融合算法的有效性,以及CDS与自适应融合算法结合的合理性.

本文实验采用错误率(error rate,ER)来评价融合识别的性能.ER值越低,表示识别性能越好.其中,用FV表示单模态的指静脉识别,用PP表示单模态的掌纹识别,用CT表示单模态的指形识别.

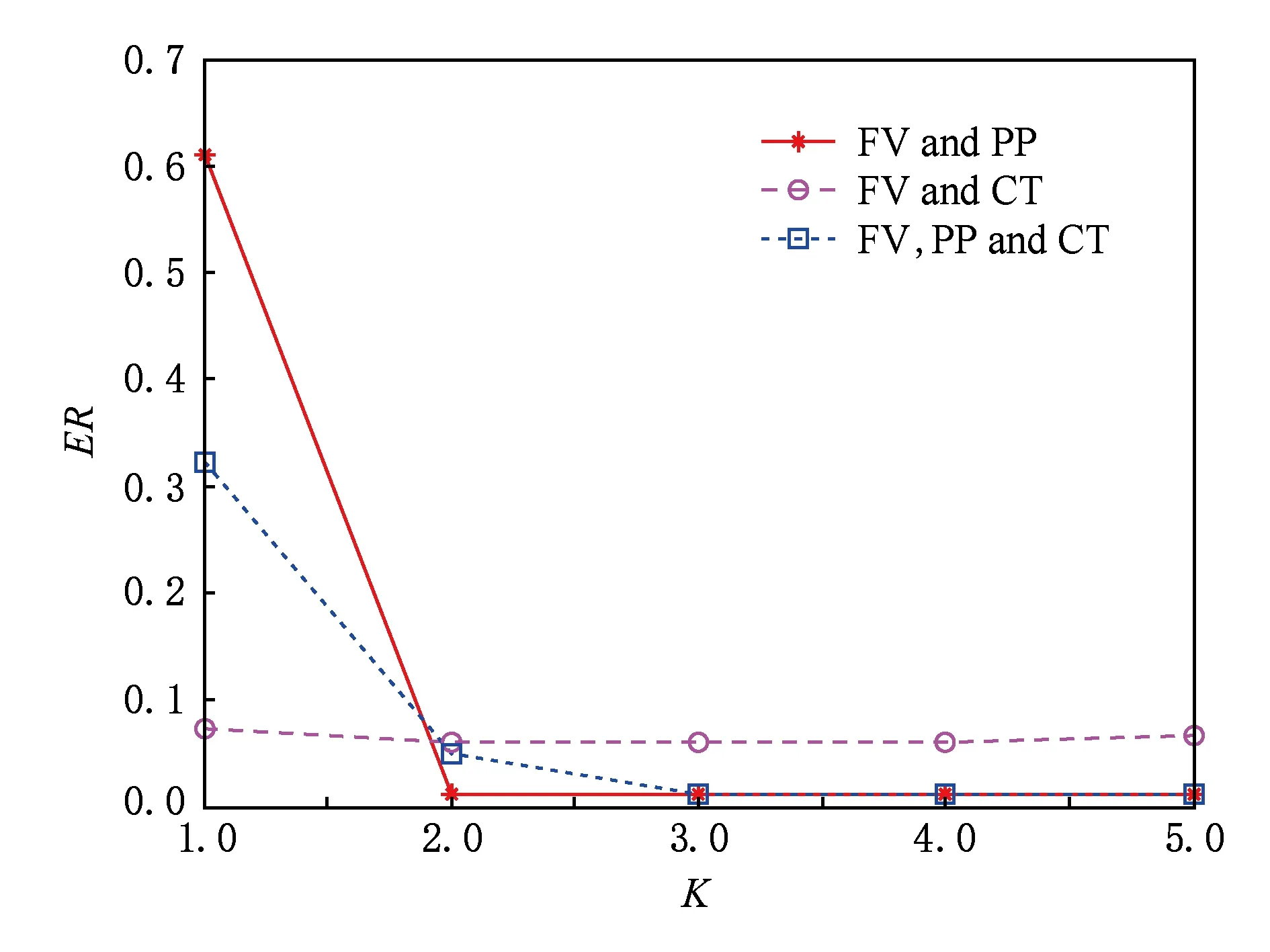

3.1 实验1

通过比较双模态下、三模态下采用自适应融合方法的识别性能,从而选取最优的K值.其中,融合分数指标采用分类距离分数CDS.

通过图7可以看出,在双模态下,当K≥2时,识别性能已经达到最优,其中指静脉和掌纹的融合性能已经稳定,指静脉和指形的融合性能ER随着K的增大会逐渐增大;在三模态下,当K≥3时,识别性能已经达到最优,趋于稳定.因此,取双模态和三模态的取值交集的最小值,最后K=3.

Fig. 7 Recognition performance of adaptive fusion methods with different values of K图7 不同K值对应的自适应融合方法的识别性能

3.2 实验2

通过分别比较单模态、双模态和三模态下不同融合分数指标的识别性能,从而证明了采用分类距离分数CDS作为融合分数指标的有效性,其融合方法采用本文提出的自适应融合方法.

从表1可以看出,单模态下将CDS作为融合分类指标,每个模态的ER都得到了一定程度的下降,其中指形在单模态下相对于传统匹配分数,其ER下降了10.8154%,可见通过增大类内类间距离以及把类别信息加入到CDS中,其分类效果要优于传统的匹配分数.从表2可知,无论是双模态下还是三模态下,将分类置信度分数作为融合分数指标得到的识别效果还没有将匹配分数作为融合分数指标的好,但是将CDS作为融合分数指标得到的识别效果ER远远低于匹配分数和分类置信度分数,这是因为CDS不仅增大了类内类间的距离,还加入了类别信息,将匹配分数含有的有效信息尽可能地利用起来.由此可见,将CDS作为融合指标可以提高识别率,从而证明了第1节中提出的分类距离分数CDS作为融合分数指标的合理性和有效性.

Table1ERPerformancewithDifferentFusionScoreMetricsforSingleMode

表1 单模态下采用不同融合分数指标的ER性能 %

Table2ERPerformanceofDifferentFusionScoreMetricsforDifferentModes

表2 不同模态下采用不同融合分数指标的ER性能 %

3.3 实验3

双模态和三模态下,分别将分类置信度分数CCS和分类距离分数CDS作为分类指标,并分别与SVM分类器和本文提出自适应融合算法相结合,对其识别性能进行比较.

为了进一步说明分类距离分数CDS作为融合分数指标的优越性,结合表3可以看出,当均采用SVM进行融合识别时,明显CDS作为融合分类指标的ER要远低于CCS;当均采用自适应融合算法时,将CDS作为融合指标的ER相对于CCS,平均下降了1.796 454%,由此可见,将分类距离分数CDS作为融合分数指标的优越性.

Table 3 ER Performance of Uniting Different Fusion Score Metrics and Different Fusion Methods for Different Modes

当均采用分类置信度分数作为融合分数指标时,明显自适应融合的识别性能ER低于SVM分类器的识别性能;当均采用分类距离分数作为融合分数指标时,SVM分类器的识别性能ER相对于自适应融合的识别性能平均增大了0.22673%,可见自适应融合的识别性能要高于SVM分类器的识别性能,验证了自适应融合算法的有效性.

当采用分类距离分数CDS和自适应融合算法时,对比其他3种相结合方法的识别效果,其效果识别要远好于其他3类算法,可见CDS与自适应融合算法相结合的合理性.

3.4 实验4

通过比较常系数的融合方法和自适应融合方法的性能,进一步验证自适应融合算法中参数λt,rt的有效性.由于单模态下指静脉的识别效果要优于掌纹和指形,所以双模态融合时,rvein=0.8,rpalm=0.2,λt取K值的一半,即λt=1.5;三模态融合时,rvein=0.5,rpalm=0.25,rcoutour=0.25,λt=1.5.其中,以分类距离分数CDS作为融合分数指标.

从表4可以看出,采用自适应的融合识别方法比常系数的融合方法要好.由于本实验选取的常系数取值趋近于自适应融合方法各系数的取值,且采取的是分类距离分数作为融合分数指标,所以常系数的融合方法的识别率还是很高的,尽管如此,其识别效果还是低于自适应融合方法.自适应参数可以根据CDS的信息熵的大小来判断每个CDS带有有效信息的多少,参数可以根据有效信息动态地调整融合算法的权重,达到充分利用有效信息的目的.

Table4ERPerformanceofAdaptiveFusionMethodandtheConstantCoefficientFusionMethod

表4 自适应融合方法和常系数融合方法的ER性能 %

3.5 实验5

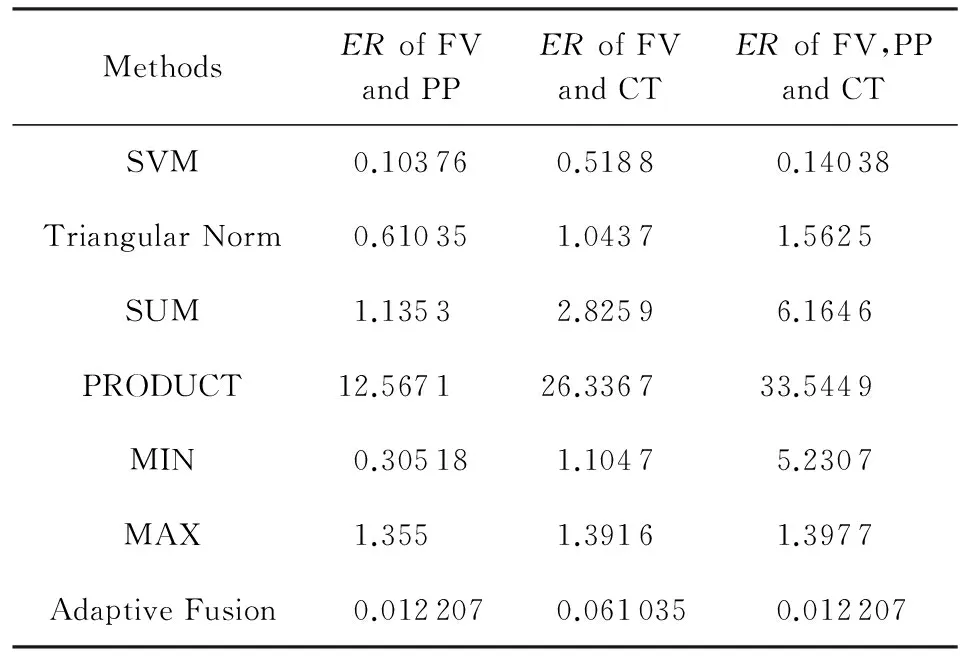

通过比较双模态、三模态下采用分类距离分数CDS作为融合指标,分别与现有的融合方法相结合,对其识别性能进行比较.

表5可以看出,无论是双模态还是三模态,将分类距离分数与自适应融合算法结合起来的识别ER是最低的,识别效果是最好的,其中掌纹和指静脉的融合性能ER最低为0.012207%,指静脉和指形的融合性能ER最低为0.061035%,掌纹、指静脉和指形的融合性能为0.012207%.

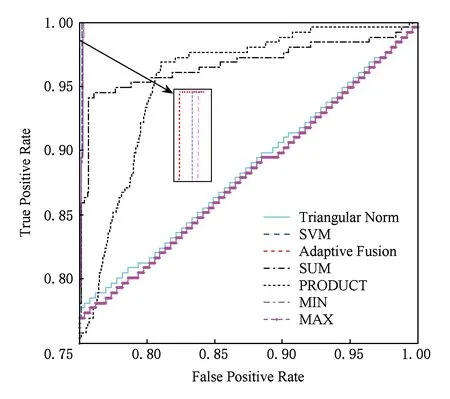

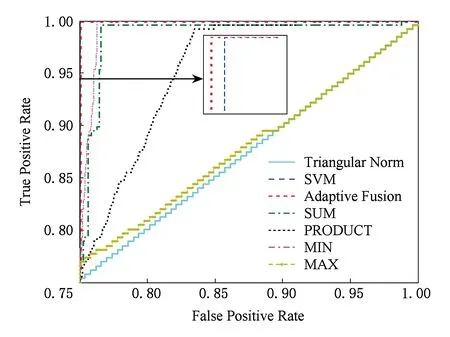

为了进一步说明自适应融合方法的有效性,图8~10给出了不同模态下不同融合方法的ROC曲线图.

Table5ERPerformanceofUnitingDifferentFusionScoreMetricsandCDSforDifferentModes

表5 不同模态下CDS结合不同融合方法的ER性能 %

Fig. 8 The ROC curves of the fusion of PP and FV图8 掌纹和指静脉融合的ROC曲线图

Fig. 9 The ROC curves of the fusion of CT and FV图9 指形和指静脉融合的ROC曲线图

Fig. 10 The ROC curves of the fusion of CT,FV and PP图10 指形、指静脉和掌纹融合的ROC曲线图

先看图8,其为掌纹和指静脉的不同融合性能的比较,可以看出MAX规则的融合方法性能是最差的,自适应融合方法、SVM分类器以及MIN规则的性能相对来说很好,虽然图8中的这3条线看起来几乎是重合的,但SVM分类器和MIN规则仍在自适应融合方法的曲线内,说明自适应融合方法的性能是最好的.图9和图10很明显可以看出,自适应融合的识别性能远优于其他的融合方法,从而验证自适应融合算法的有效性.

实验5均采用分类距离分数作为融合分数指标,表5可以看出,将分类距离分数和SVM、三角范数等融合算法结合进行识别时,识别效果并没有和本文提出的自适应融合算法相结合的识别效果好.首先因为分类距离分数相对于传统的融合分数指标携带有更多的有效信息,本文提出的基于信息熵的自适应融合算法,可以通过信息熵有效利用分类距离分数含有的有效信息,同时参数λt,rt可根据每个模态特征含有有效信息的比重信息动态调整自适应算法的框架结构,所以分类距离分数和自适应融合算法的结合具有合理性.

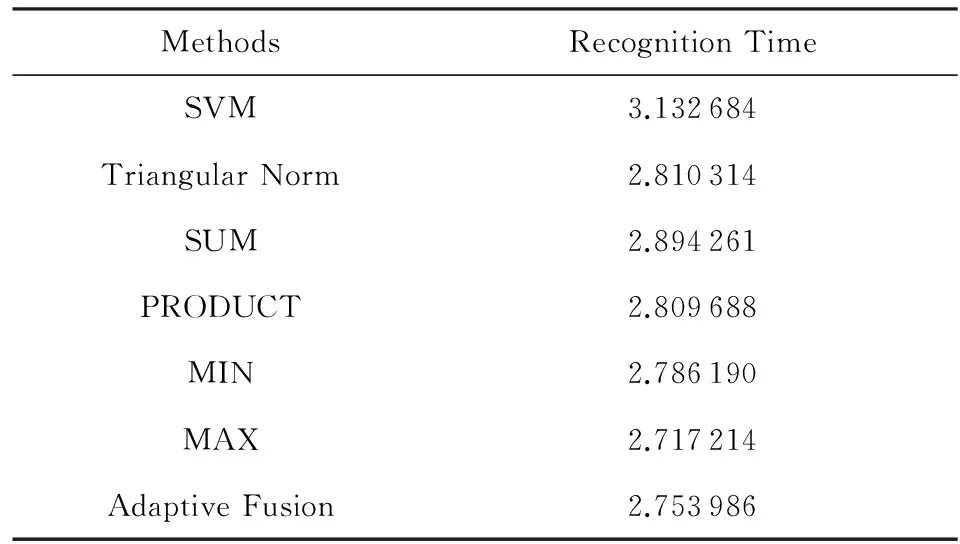

3.6 时间效率分析

通过实验1~实验5的分析,可知本文提出的算法在识别率是优于对比算法的.由表6可知,本文提出的方法在所用时间上仅略高于MAX方法,但是由于MAX融合规则较简单,没有考虑到训练集和测试集划分的影响,其融合识别效果低于本文提出的方法.由于指静脉特征集采用的是原始图像的信息,不是对原始图像提取特征之后的信息,这在特征集与特征集比较的过程中需要消耗大量的时间.为了提高本文算法的时间效率,可考虑对样本进行特征提取,将对整幅图像信息的操作转换为低维数据的处理.

Table 6 The Recognition Time of One Class in Testing Process

4 总 结

本文提取了一种基于分类距离分数的自适应融合识别方法.实验表明分类距离分数不仅在一定程度上反映了特征的性能,也可预分类样本特征,为融合算法提供了一个具有有效判别信息的特征融合集,大大提高了融合指标的利用率;其次利用信息熵的自适应融合算法既可以有效利用分类距离分数的判别信息,也可利用双层权重系数根据有效信息动态地调整融合算法的权重,达到充分利用有效信息的目的,从而提高融合识别率.

图像的特征是其固有的属性,如何有效地利用这些固有的属性特征进行融合分类是一个有意义的研究课题.本文改进了融合分数指标以及特征融合算法,为解决多模态特征间的融合问题提供了一个新的思想.

[1] Zheng Fang, Rozi A, Wang Renyu, et al. Overview of biometric recognition technology[J]. Journal of Information Security Research, 2016, 2(1): 12-26

[2] Zhang Shiqing, Zhao Xiaoming. Locality-sensitive kernel sparse representation classification for face recognition[J]. Journal of Visual Communication and Image Representation, 2014, 25(8): 1878-1885

[3] Sun Zhenan, Zhang Hui, Tan Tieniu, et al. Iris image classification based on hierarchical visual codebook[J]. IEEE Trans on Pattern Analysis and Machine Intelligence, 2014, 36(6): 1120-1133

[4] Yang Jinfeng, Shi Yihua. Finger-vein network enhancement and segmentation[J]. Pattern Analysis and Applications, 2014, 17(4): 783-797

[5] Sanjekar P S, Patil J B. An overview on multimodal biometrics[J]. Signal and Image Processing, 2013, 4(1): 57-64

[6] Gudavalli M, Raju S V, Babu A V, et al. Multimodal biometrics—sources, architecture and fusion techniques: An overview[C] //Proc of Int Symp on Biometrics and Security Technologies. Los Alamitos, CA: IEEE Computer Society, 2012: 27-34

[7] Hong Lin, Jain A K. Integrating faces and fingerprints for personal identification[J]. IEEE Trans on Pattern Analysis and Machine Intelligence, 1998, 20(12): 1295-1307

[8] Jain A K, Ross A. Learning user-specific parameters in a multibiometric system[C] //Proc of the 9th Int Conf on Image Processing. Piscataway, NJ: IEEE, 2002: 57-60

[9] Jing Xiaoyuan, Yao Yongfang, Zhang D, et al. Face and palmprint pixel level fusion and kernel DCV-RBF classifier for small sample biometric recognition[J]. Pattern Recognition, 2007, 40(11): 3209-3224

[10] Yuan Guanglin, Xue Mogen, Han Yusheng, et al. Mean shift object tracking based on adaptive multi-features fusion[J]. Journal of Computer Research and Development, 2010, 47(9): 1663-1671 (in Chinese)

(袁广林, 薛模根, 韩裕生, 等. 基于自适应多特征融合的mean shift目标跟踪[J]. 计算机研究与发展, 2010, 47(9): 1663-1671 )

[11] Zhi Lijia, Zhang Shaomin, Zhao Dazhe, et al. Minimum spanning tree fusing multi-feature point information for medical image registration[J]. Journal of Computer Research and Development, 2011, 48(3): 501-507 (in Chinese)

(支力佳, 张少敏, 赵大哲, 等. 融合多种特征点信息的最小生成树医学图像配准[J]. 计算机研究与发展, 2011, 48(3): 501-507)

[12] Zhu Jun, Zhao Jieyu, Dong Zhenyu. Image classification using hierarchical feature learning method combined with image saliency[J]. Journal of Computer Research and Development, 2014, 51(9): 1919-1928 (in Chinese)

(祝军, 赵杰煜, 董振宇. 融合显著信息的层次特征学习图像分类[J]. 计算机研究与发展, 2014, 51(9): 1919-1928)

[13] Zhang Pan, Lian Qiusheng. Low-Rank relaxed collaborative representation combined with global and local features for face recognition[J]. Journal of Computer Research and Development, 2014, 51(12): 2663-2670 (in Chinese)

(张盼, 练秋生. 融合整体与局部特征的低秩松弛协作表示[J]. 计算机研究与发展, 2014, 51(12): 2663-2670)

[14] Meng Weizhi, Wong D S, Furnell S, et al. Surveying the development of biometric user authentication on mobile phones[J]. IEEE Communications Surveys and Tutorials, 2015, 17(3): 1268-1293

[15] Haghighat M, Abdel-Mottaleb M, Alhalabi W. Discriminant correlation analysis: Real-time feature level fusion for multimodal biometric recognition[J]. IEEE Trans on Information Forensics and Security, 2016, 11(9): 1984-1996

[16] He Mingxing, Horng S J, Fan Pingzhi, et al. Performance evaluation of score level fusion in multimodal biometric systems[J]. Pattern Recognition, 2010, 43(5): 1789-1800

[17] Liu Haicang, Li Shutao. Decision fusion of sparse representation and support vector machine for SAR image target recognition[J]. Neurocomputing, 2013, 113: 97-104

[18] Nandakumar K, Chen Yi, Dass S C, et al. Likelihood ratio-based biometric score fusion[J]. IEEE Trans on Pattern Analysis and Machine Intelligence, 2008, 30(2): 342-347

[19] Ross A A, Nandakumar K, Jain A K. Handbook of Multibiometrics[M]. Berlin: Springer, 2006

[20] Xi Xiaoming, Yin Yilong, Yang Gongping, et al. Personalized fusion method based on finger vein and finger contour[J]. Journal of Computer Research and Development, 2013, 50(9): 1914-1923 (in Chinese)

(袭肖明, 尹义龙, 杨公平, 等. 基于手指静脉和手指轮廓的个性化融合方法[J]. 计算机研究与发展, 2013, 50(9): 1914-1923)

[21] Wu Di, Tang Yongqi, Lin Guohan, et al. Multibiometric recognition based on total error rate and feature correlation adaptive fusion[J]. Journal of Optoelectronics·Laser, 2016, 27(1): 67-76 (in Chinese)

(吴迪, 唐勇奇, 林国汉, 等. 基于总错误率和特征关联的自适应融合多模态生物特征识别[J]. 光电子·激光, 2016, 27(1): 67-76)

[22] Cui Feifei, Yang Gongping. Score level fusion of fingerprint and finger vein recognition[J]. Journal of Computational Information Systems, 2011, 7(16): 5723-5731

[23] Yuan Chenhu, Liu Tiegen, Li Xiuyan. Identification algorithm for fusion of hand vein iris and fingerprint based on kNN-SVM[J]. Opto-Electronic Engineering, 2013, 40(4): 101-105 (in Chinese)

(袁臣虎, 刘铁根, 李秀艳. 基于kNN-SVM的手背静脉虹膜和指纹融合身份识别[J]. 光电工程, 2013, 40(4): 101-105)

[24] Gawande U, Zaveri M, Kapur A. A novel algorithm for feature level fusion using SVM classifier for multibiometrics-based person identification[J]. Applied Computational Intelligence and Soft Computing, 2013, 2013: 1155-1166

[25] Wu Di, Cao Jie. Multimodel biometrics fusion based on FAR and FRR using triangular norm[J]. International Journal of Computational Intelligence Systems, 2015, 8(4): 779-786

[26] Peng Jialiang, Li Qiong, Niu Xiamu. Finger multimodal biometric verification based on score-level fusion[J]. Intelligent Computer and Applications, 2014, 4(2): 36-44 (in Chinese)

(彭加亮, 李琼, 牛夏牧. 基于三角范数的多模态手指生物特征的分数层融合方法[J]. 智能计算机与应用, 2014, 4(2): 36-44)

[27] Tran Q D, Liatsis P, Zhu Bing, et al. Using density based score fusion for multimodal identification systems under the missing data scenario[C] //Proc of Developments in E-systems Engineering. Los Alamitos, CA: IEEE Computer Society, 2011: 238-242

[28] Aravinth M J, Valarmathy D S. A novel feature extraction techniques for multimodal score fusion using density based gaussian mixture model approach[J]. International Journal of Emerging Technology and Advanced Engineering, 2012, 2(1): 189-197

[29] Gu Xin, Wang Haitao, Wang Lingfeng, et al. Fusing multiple features for object tracking based on uncertainty measurement[J]. ACTA Automatica Sinica, 2011, 37(5): 550-559 (in Chinese)

(顾鑫, 王海涛, 汪凌峰, 等. 基于不确定性度量的多特征融合跟踪[J]. 自动化学报, 2011, 37(5): 550-559)

[30] Zhao Dandan. Novel algorithm for finger-vein image enhancement and thinning and its application in recognition[D]. Hefei: Anhui University, 2015 (in Chinese)

(赵丹丹. 手指静脉图像的增强和细化算法及其在身份识别中的应用[D]. 合肥: 安徽大学, 2015)

[31] Guo Jingyu. The research of palmprint identification algorithm[D]. Hefei: Anhui University, 2015 (in Chinese)

(郭婧宇. 基于掌纹的身份识别算法研究[D]. 合肥: 安徽大学, 2015)

[32] Shannon C E. A mathematical theory of communication[J]. The Bell System Technical Journal, 1948, 27(3): 379-423

[33] Omari A, Figueiras-Vidal A R. Feature combiners with gate-generated weights for classification[J]. IEEE Trans on Neural Networks and Learning Systems, 2013, 24(1): 158-163

[34] Jiang R M, Crookes D, Luo Nie. Face recognition in global harmonic subspace[J]. IEEE Trans on Information Forensics and Security, 2010, 5(3): 416-424

[35] Feng Shikun, Lei Zhen, Yi Dong, et al. Online content-aware video condensation[C] //Proc of IEEE Int Conf on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2012: 2082-2087

[36] Wu Di. Audio-visual person recognition based on rank level fusion and Gaussian mixture model[J]. International Journal of Control and Automation, 2015, 8(4): 313-332

[37] Lin Sen, Xu Tianyang, Tang Yonghua, et al. Palm vein identity recognition based on improved S-transform[J]. Journal of Optoelectronics·Laser, 2015, 26(9): 1776-1782 (in Chinese)

(林森, 徐天扬, 汤永华, 等. 基于改进S变换的手掌静脉身份识别[J]. 光电子·激光, 2015, 26(9): 1776-1782)

[38] Wang Feng, Jin Xiaobo, Yu Junwei, et al. A positive recognition algorithm for fake plate vehicles based on fusion strategy[J]. Journal of Optoelectronics·Laser, 2015, 26(11): 2209-2216 (in Chinese)

(王峰, 靳小波, 于俊伟, 等. 基于融合策略的套牌车主动识别算法[J]. 光电子·激光, 2015, 26(11): 2209-2216)ZhangLu, born in 1991. Master. Her main research interests include pattern recognition and information processing.