基于结构光视觉的白车身覆盖件间隙面差测量方法

许 敏, 马 钺, 陈 帅, 徐首帅

(中国科学院 沈阳自动化研究所,辽宁 沈阳 110179)

基于结构光视觉的白车身覆盖件间隙面差测量方法

许 敏, 马 钺, 陈 帅, 徐首帅

(中国科学院 沈阳自动化研究所,辽宁 沈阳 110179)

针对白车身表面覆盖件间隙面差人工测量精度差、效率低等问题,提出了利用结构光视觉测量方法代替人工测量。在间隙特征点识别中,计算光纹中心线上各点的绝对差分值,搜索差分极值点并将该极值点作为特征点;在面差特征点识别中,采用基于离散曲线曲率极值点的特征点定位算法。实验结果表明:间隙面差测量方法测量精度较高,能够满足整车厂对白车身间隙面差测量精度的要求。

白车身; 结构光视觉; 特征点识别; 间隙面差

0 引 言

白车身主要由结构件与覆盖件组成,车身覆盖件大多由冲压制成,经冲压拉伸后,覆盖件尺寸存在误差。在装配时,如果覆盖件尺寸误差较大会导致覆盖件之间存在较大的间隙和面差,影响整车的外观、密封、风噪等,因此,需要对覆盖件之间的间隙与面差进行测量[1]。传统的人工测量方法主要是使用塞尺与面差尺,存在测量速度慢、效率低、精度低,测量结果极易受到主观因素影响等缺点,不能满足整车厂在线实时测量要求[2]。基于结构光视觉的测量方法具有测量速度快、精度高、非接触、测量数据易于保存等优点,目前,已广泛应用于机械加工、逆向工程、汽车制造等现代工业中[3~6]。

针对白车身覆盖件间隙面差的测量,欧美等发达国家已经开发出商用化的激光视觉间隙面差测量设备,并广泛应用于白车身在线测量中。国内,对间隙面差视觉检测技术的研究还没有形成成熟的系统理论框架,处于原理样机研究阶段。本文在分析结构光视觉测量原理的基础上,对间隙面差特征提取方法进行了详细研究并建立了间隙面差计算模型,为间隙面差测量设备国产化提供理论指导。

1 结构光视觉测量原理

结构光三维视觉测量基于光学三角测量原理。如图1所示,光学投射器将一定模式的结构光投射到被测物表面,再形成由被测物表面形状调制的光纹三维图像。该三维图像由处于另一位置的摄像机探测,从而获得光纹二维畸变图像。光纹的畸变程度取决于光学投射器与摄像机之间的相对位置和物体表面形廓。当光学投射器与摄像机之间的相对位置一定时,由畸变的二维光纹图像坐标便可重现物体表面三维形廓。

图1 结构光三角测量原理示意

2 结构光光纹图像处理及特征点识别

在结构光视觉测量系统中,光纹经被测物体表面的深度变化而受到调制,反映到图像中则发生了畸变,其畸变的程度包含了被测物体表面的三维信息。要想获得这些信息,必须从光纹图像中提取光纹中心的图像坐标。此外,要想完成白车身覆盖件间隙面差的测量,还需要准确地识别出光纹中心线上的特征点。因此,光纹中心线提取与特征点识别是结构光视觉测量系统的关键技术。

2.1 光纹中心线提取

结构光光纹图像处理的目标是获取光纹图像的中心线及中心线上的有效特征点。结构光光纹中心线的提取方法主要有:几何中心法、极值法、高斯拟合法[7]、灰度质心法[8]、Hessian矩阵法[9]和方向模板法[10]。其中,灰度质心法将光纹各截面上的像素点灰度分布的质心作为光纹中心点,可减少几何中心法和高斯拟合法由于灰度分布不对称引起的误差,且该方法计算量较小,实时性较好,因此,本文中采用灰度质心法来提取光纹中心线。

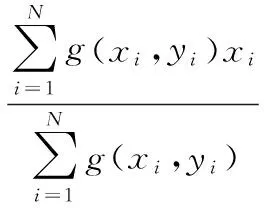

设光纹某截面上一点的坐标为(xi,yi),相应的灰度值为g(xi,yi),i=1, … ,N,N为截面内像素点的个数,则该截面上光纹中心点坐标为

(1)

式中xc,yc分别为光纹中心的横、纵坐标。

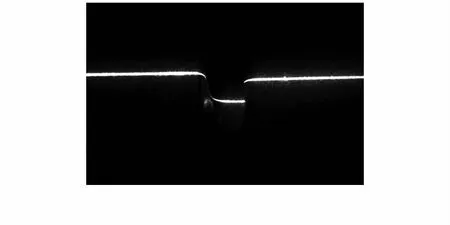

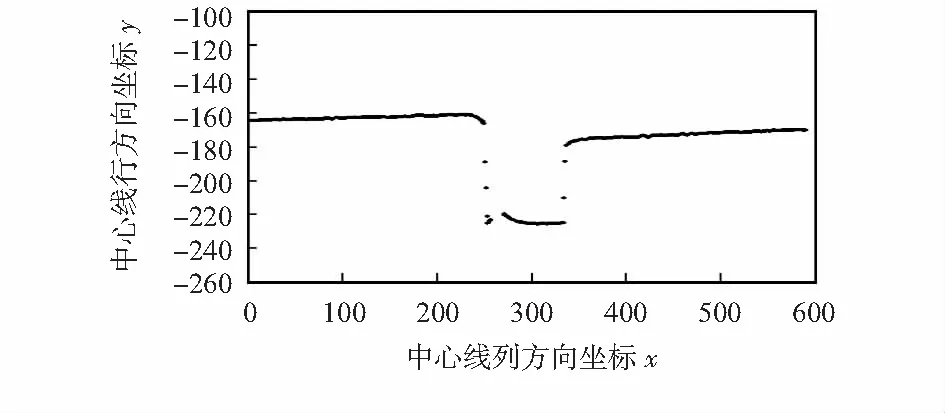

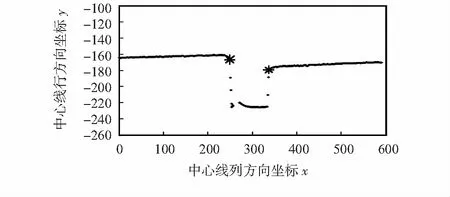

图2所示为结构光视觉传感器拍摄的白车身左侧两门之间的间隙面差原始图像,图3所示为使用灰度质心法提取获得的光纹中心线坐标。

图2 结构光光纹图像

2.2 光纹中心线特征点识别

在使用结构光视觉传感器测量白车身表面覆盖件间隙面差时,通常需要识别出光纹中心线上的3个特征点和1条基准直线。如图4所示,特征点A与基准面拟合直线之间的距离即为面差,特征点B与特征点C之间的水平距离即为间隙。

图3 灰度质心法提取的光纹中心线坐标

图4 覆盖件间隙面差特征点示意

2.2.1 用于间隙计算的特征点识别

用于间隙计算的特征点一般选择两条光纹中心线上水平距离最近的点,如图4中的B点与C点。由于光纹中心线上存在噪声干扰,如图3所示,在左、右中心线的中间位置存在明显的噪声,因此,直接计算最近水平距离容易受噪声干扰。本文采用基于一阶绝对差分的特征点提取算法,其具体步骤如下:

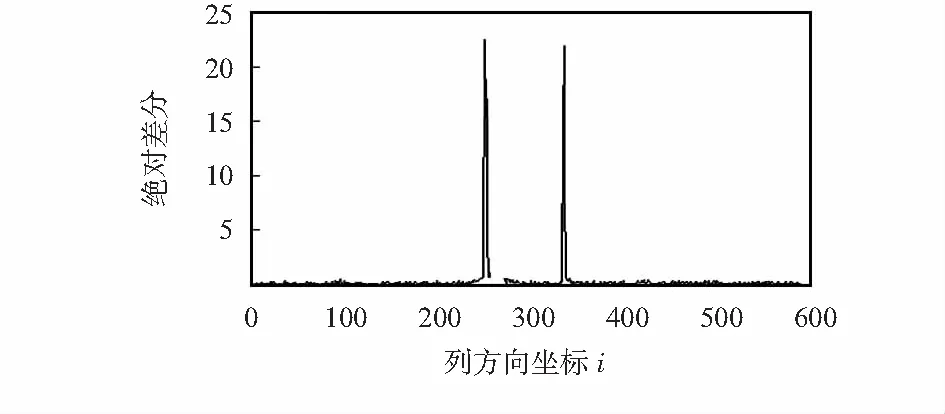

1) 计算绝对差分值,计算图3中心线中相邻两点之间的绝对差分,计算如式(4)所示

Δ=|g(i)-g(i-1)|,i=2,…,n

(2)

式中Δ为绝对差分;g(i)为中心线上第i个点的纵坐标;n为中心线点的个数。图5所示为中心线各点的绝对差分值,可以发现,图中存在明显的极值点,而文中所需的特征点便隐藏在这些绝对差分极值点中。

2)搜索候选特征点,设置候选特征点提取阈值T,将Δ≥T的绝对差分值出现的位置保存在向量S中,S即为候选特征点集合。

3)搜索左右特征点,在集合S中搜索第一个与最后一个元素,分别记为S1和S2,则左侧特征点Pleft与右侧特征点Pright分别为

(3)

图6中“*”为所提取的特征点。在获得用于间隙计算的特征点后,只需要计算这2个特征点之间的水平距离即可确定间隙值。

图5 中心线各点的绝对差分值

图6 间隙特征点识别结果

2.2.2 用于面差计算的特征点识别

用于面差计算的特征点一般取直线段与圆弧段的交点,如图4中的特征点A。直接使用直线拟合与圆拟合求交点的方法计算量大且易受噪声干扰,本文采用基于曲率的方法。

对于离散曲线C,可视为相邻的n个点Pi的集合,即

C={Pi(xi,yi)|i=1,2,…,n}

(4)

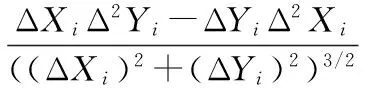

式中n为曲线上点数目;Pi为曲线C上的点;(xi,yi)为点Pi对应的坐标。离散曲线C上任意点Pi(xi,yi)经尺度为σ高斯平滑后的坐标为Pi(Xi,Yi),其曲率计算公式为

(5)

式中 ΔXi=(Xi+1-Xi-1)/2; ΔYi=(Yi+1-Yi-1)/2;Δ2Xi=(ΔXi+1-ΔXi-1)/2;Δ2Yi=(ΔYi+1-ΔYi-1)/2;k为Pi(Xi,Yi)点的曲率;Δ为一阶差分算子;Δ2为二阶差分算子。

K—余弦法[11]算法简单,计算量小,广泛应用于离散曲线曲率计算,计算过程如下:

设离散曲线上任一点Pi(xi,yi)和与此相距为k的两个点Pi+k(xi+k,yi+k),Pi-k(xi-k,yi-k),定义矢量aik与bik为

(6)

则,点Pi处的曲率为

(7)

式中θik为矢量aik与bik夹角的余弦值。θik值越大,则曲线曲率变化越剧烈;反之,则曲线曲率变化越平缓。图7为采用K—余弦法计算获得的中心线上各点的曲率值(计算时采用了图6中左侧部分中心线)。

根据Mokhtarian F等人[12]提出的角点理论,只要搜索到曲率曲线上的极大值点,则特征点的位置就可以确定。图7中“*”为采用上述方法提取的面差计算特征点。

还需要确定用于面差计算的基准参考线,文中选择图6中右侧光纹曲线的拟合直线作为基准参考线。图7中的直线为拟合获得的基准参考线,“*”表示用于面差计算的特征点。面差即为该特征点到基准线的距离。

图7 面差计算的特征点与基准面拟合直线

3 实验结果

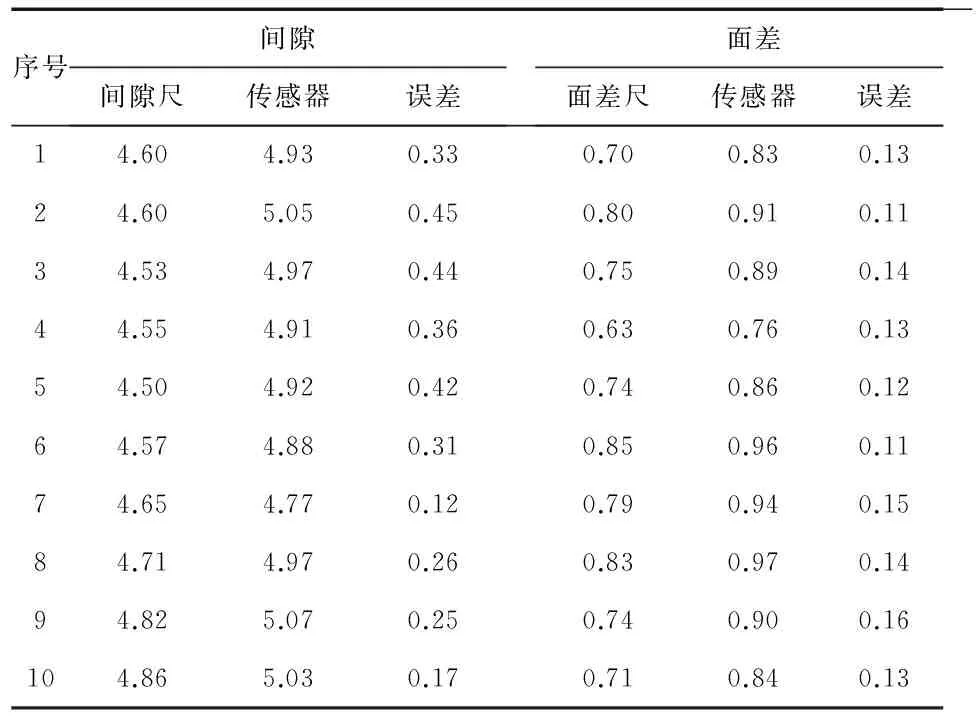

采用德国米铱公司开发的scanCONTROL2650激光视觉传感器,含有640个测量点,扫描频率可达300 Hz,z轴(高度)分辨率为4 μm,x轴(宽度)分辨率为0.066 mm。测量对象为华晨中华某型SUV白车身,前门与后门(B柱区域)质量特征要求为:间隙(4.0±1.0) mm,面差(0,+1 )mm。实验平台如图8所示,选取车门门缝处10个测量点,分别采用人工测量与传感器测量,测量结果如表1所示,可以发现,两者的测量误差能够满足质量特征技术要求。

图8 间隙面差测量实验

序号间隙间隙尺传感器误差 面差面差尺传感器误差14.604.930.330.700.830.1324.605.050.450.800.910.1134.534.970.440.750.890.1444.554.910.360.630.760.1354.504.920.420.740.860.1264.574.880.310.850.960.1174.654.770.120.790.940.1584.714.970.260.830.970.1494.825.070.250.740.900.16104.865.030.170.710.840.13

4 结 论

对白车身表面覆盖件间隙面差视觉测量进行了研究,提出了基于绝对差分法的间隙特征点识别方法。在面差特征点识别过程中,采用基于K—余弦法的离散曲率计算方法并将曲率极大值点作为面差特征点。实验测量表明:采本文测量方法测量精度较高,能够满足整车厂对间隙面差测量精度的要求。

[1] 李凌旻,尚 校,李 靖,等.线激光扫略的白车身装配特征机器人在线检测技术研究[J].测试技术学报,2014,28(3):255-263.

[2] 杨 涛,段发阶,班 莹.激光扫描车身测量传感器靶标识别体系的研究[J].传感器与微系统,2009,28(9):66-69.

[3] 陈海永,方灶军,徐 德,等.基于视觉的薄钢板焊接机器人起始点识别与定位控制[J].机器人,2013,35(1):90-97.

[4] 何 佳,刘常杰,叶声华.用于机器人柔性坐标测量系统的视觉传感器设计[J].传感器与微系统,2010,29(3):68-70.

[5] 徐晋卿,陈唐龙,占 栋,等.基于机器视觉的钢轨轮廓测量方法研究[J].传感器与微系统,2014,33(4):27-30.

[6] 何炳蔚,林志航,杨明顺,等.逆向工程中基于三目视觉自动提取并构造复杂曲面边界技术[J].机器人,2002,24(1):66-70.

[7] 贺俊吉,张广军.结构光三维视觉中光条图像处理方法研究[J].北京航空航天大学学报,2003,29(7):593-597.

[8] Sirkis J S.System response to automated grid methods[J].Optic Engineering,1990,29(12):1485-1493.

[9] Steger C.An unbiased detector of curvilinear structures[J].IEEE Trans on PAMI,1998,20(2):113-125.

[10] 胡 斌,李德华,金 刚,等.基于方向模板法的结构光条纹中心检测方法[J].计算机工程与应用,2002(11):59-60.

[11] Rosenfeld A,Weszka J S.An improved method of angle detection on digital curves[J].IEEE Trans on Computers,1975,24(9):940-941.

[12] Mokhtarian F,Suomela R.Robust image corner detection through curvature scale space [J].IEEE Trans on PAMI,1998,20(12):1376-1381.

Measurement algorithm for gap and flush of body-in-white based on structured light vision

XU Min, MA Yue, CHEN Shuai, XU Shou-shuai

(Shenyang Institute of Automation,Chinese Academy of Sciences,Shenyang 110179,China)

Aiming at problem that manual measurement of gap and flush of body-in-white is imprecision and inefficiency,adopt structured light vision measurement method to replace manual measurement.In the recognition of feature points for the gap gauge,calculate absolute differential for each point on the centerline of the structured light stripe,then,search for differential extremal points and treat them as feature points for gap gauge.For the recognition of feature points of flush gauge,use feature points localization algorithm based on extremal curvature of discrete curve.Experimental results indicate that the proposed algorithm has a higher precision for calculating the gap and flush of body-in-white,and can satisfy the requirement of precision for car body factories.

body-in-white; structured light vision; feature point recognition; gap and flush

10.13873/J.1000—9787(2017)09—0013—04

2016—09—21

TP 391.1

A

1000—9787(2017)09—0013—04

许 敏(1982-),男,工学博士,副研究员,硕士生导师,主要从事机器视觉与图像处理技术及应用研究工作。