近空目标图像定位算法的研究*

王 立 雷 斌 王健宁 白 福

(西安工业大学电子信息工程学院 西安 710021)

近空目标图像定位算法的研究*

王 立 雷 斌 王健宁 白 福

(西安工业大学电子信息工程学院 西安 710021)

在深入分析巡航弹飞行参数的基础上,论文主要介绍如何通过定位算法对目标进行定位;该系统通过对帧间差分算法的研究,通过几何模型的分析,建立数学方程组,解算出待测物体方位角俯仰角,进而得到待测物体的位置坐标。由设备测量到的数据和实际值进行对比;经过验证,证明了此测量系统的正确性以及在工业生产中的实用性。

巡航弹; 帧间差分算法; 方位角俯仰角; 定位

Class Number TP391

1 引言

针对巡飞弹而言,飞行高度一般在100m~500m的高度范围[1]。在这个高度范围内,雷达定位和遥测定位失效,无法对目标实现精准的定位。在军事战争中不利于对敌方的导弹实现精准的判断从而歼灭,本系统通过对图像识别算法的研究,实现对目标方位角俯仰角的估计,从而判断出目标位置坐标,精度在1°以内,实现了较高精度的测量,在现代军事战争中具有广泛的应用。

2 设计思想

帧间差分法是一种常用的运动目标检测方法[2~4],通过在视频序列中相邻帧间的差分运算得到运动物体的轮廓,就是将当前帧与当前帧的前一帧进行作差,通过对差分图的判断获得运动目标区域,由于相邻帧间的距离很小,可以完全消除由光照变化引起的图像的动态变化。这种方法能适用于多种环境下,具有比较广泛的应用范围。当场景中的运动物体,在相邻帧图像在同一位置上会有不同的行为,让像素差分的帧图像的绝对值与阈值进行对比检测,以确定是否有移动物体在视频序列中。该方法的突出特点是简单易用、数据量小、环境因子轻、鲁棒性好、能在动态场景和静态场景中得到很好的效果但它只能获得运动区域的轮廓,检测区域的完全区域相对较大,可以提取物体,也对运动目标的速度有一定的要求,需要选择合适的时间间隔,它可以很好地适用于存在多个运动目标和摄像机移动的情况。

帧间差分法是基于像素的运动目标检测方法,其帧间的定义可以是两帧也可以是多帧,都是通过计算帧间的差异进行检测。一般将几帧图像校正在同一坐标系下,然后将同一背景下相邻的不同时刻的图像进行差分计算,对差分结果进行阈值判断,大于阈值的判断为前景,小于阈值的则判断为背景,从而突出运动区域,确定运动目标[5~6]。

设相邻两帧图像fk(x,y)与fk-1(x,y)差分图像:Dk(x,y),则

Dk(x,y)=|fk(x,y)-fk-1(x,y)|

(1)

对差分图像根据阈值T进行判定以及二值化处理:

(2)

对二值化图像再进行数学形态学处理以及连通分析就能够获得较为完整的运动目标区域[7~9]。

由差分图像结果可以看出帧间差分法的特点,即运动目标在两帧中的重叠区域经过差分计算判断为背景,从而形成孔洞,只获得了运动目标的外围区域,而且在一定程度上扩大了实际的运动目标区域,这样就使得检测结果不准确,若要获得较完整运动目标就还需要进一步处理。

2.1 算法结构

该算法包括四大部分:

1) 提取背景图像( 建立背景模型);

2) 帧间差分得到变化区域;

3) 改变区域和背景图像差以获得初始运动目标;

4) 初始目标的滤波和形态学处理,消除目标碎块和提取运动的目标。

算法流程图如图1所示。

图1 算法流程图

1)背景提取:目前的视频序列图像大多都是RGB彩色图像,因为这种彩色图像有三个色彩分量,所以进行背景提取时计算比较复杂。本文算法将获得的RGB彩色图像序列首先进行灰度处理,得到相应的灰度图像序列,然后对每个像素的灰度图像序列进行灰度值的最高频率,以及最大灰度值作为对应像素灰度值,得到像背景图像。

2) 目标提取:视频序列中相邻帧进行作帧间差,得到运动区域图像,运动目标图像的运动区域图像和背景图像差分,通过把运动目标图像与阈值相比较得到二值化图像。

3) 阈值Th的取法:如果阈值Th选择过高,会将运动目标区域严重碎化,如果选择太低,将引入大量的噪音。因此,提出一个运用当前图像灰度值来确定动态阈值的方法:(1)得到了图像的最小灰度值和最大灰度值,并将图像的平均值作为初始阈值,记为T。(2)根据初始阈值,将图像分为目标和背景两部分,得到了图像的平均灰度值μ1、μ2和两部分的灰度概率[10]。

4) 噪声去除和形态学处理:因为阈值分割后的二值化图像中会存在一些噪声点和一些目标孔洞,所以先利用中值滤波对输出的二值化图像进行处理,从而来消除噪声,再运用数学形态学运算来合并领域和消除目标孔洞,进一步就可以提取出完整的运动目标。数学形态学有四个基本运算:膨胀、腐蚀、开启和闭合。一般地,设A为图像集合,B为结构元素,数学形态学运算是用B对A进行操作。先对图像进行腐蚀再膨胀称为开启。

帧间差分法的基本过程:

1) 获取差分图像;

2) 差分图像的二值化处理;

3) 用数学形态学对二值图像进行处理;

4) 提取出运动目标区域。

间差分法的流程图如图2。

图2 帧间差分法的流程图

帧间差分检测算法的基本思想是:在序列图像中,如果某个位置的对象发生变化,然后在该区域的对应像素的灰度值也将发生改变;而在其它没有运动目标的图像区域,像素灰度值变化不明显[11]。

该算法的基本流程[12~13]是:首先对视频相邻帧中对应像素点的灰度值进行相减运算,得到差分图像,然后根据事先设定好的阈值对差分图像进行阈值分割,得到目标的二值化图像,最后再对二值图进行数学形态学处理,获得运动目标的区域。 以灰度图像为例,设fk(x,y)代表当前第k帧图像中像素点位置为(x,y)的亮度值,fk-1(x,y)代表第k-1帧图像中像素点位置为(x,y)的亮度值,T是事先设定好的灰度阈值,当差分图像中像素点的灰度值大于或等于T时,认为该点是运动像素点,也就是前景点。如果像素点的灰度值小于阈值T,则可以认为其是背景点。Rk(x,y)是阈值分割后的二值图像,0代表背景点,表示为黑色;1代表前景点,表示为白色。

2.2 仿真分析

对于上述的方法,只是利用方位角的定义通过质心算法和三角函数在Matlab仿真平台上进行计算,这种方法虽然简单,但是一定程度上是存在误差的,因此,就需要通过实际的测量来验证和找出误差。

验证系统的基本思想:首先做一个固定的框架,架上照相机,并且使照相机固定位置不动。通过这个框架用照相机采集一系列图片,然后对图片上的运动目标进行实际的角度测量。最后将测出的角度和用Matlab计算出的角度进行对比[14]。

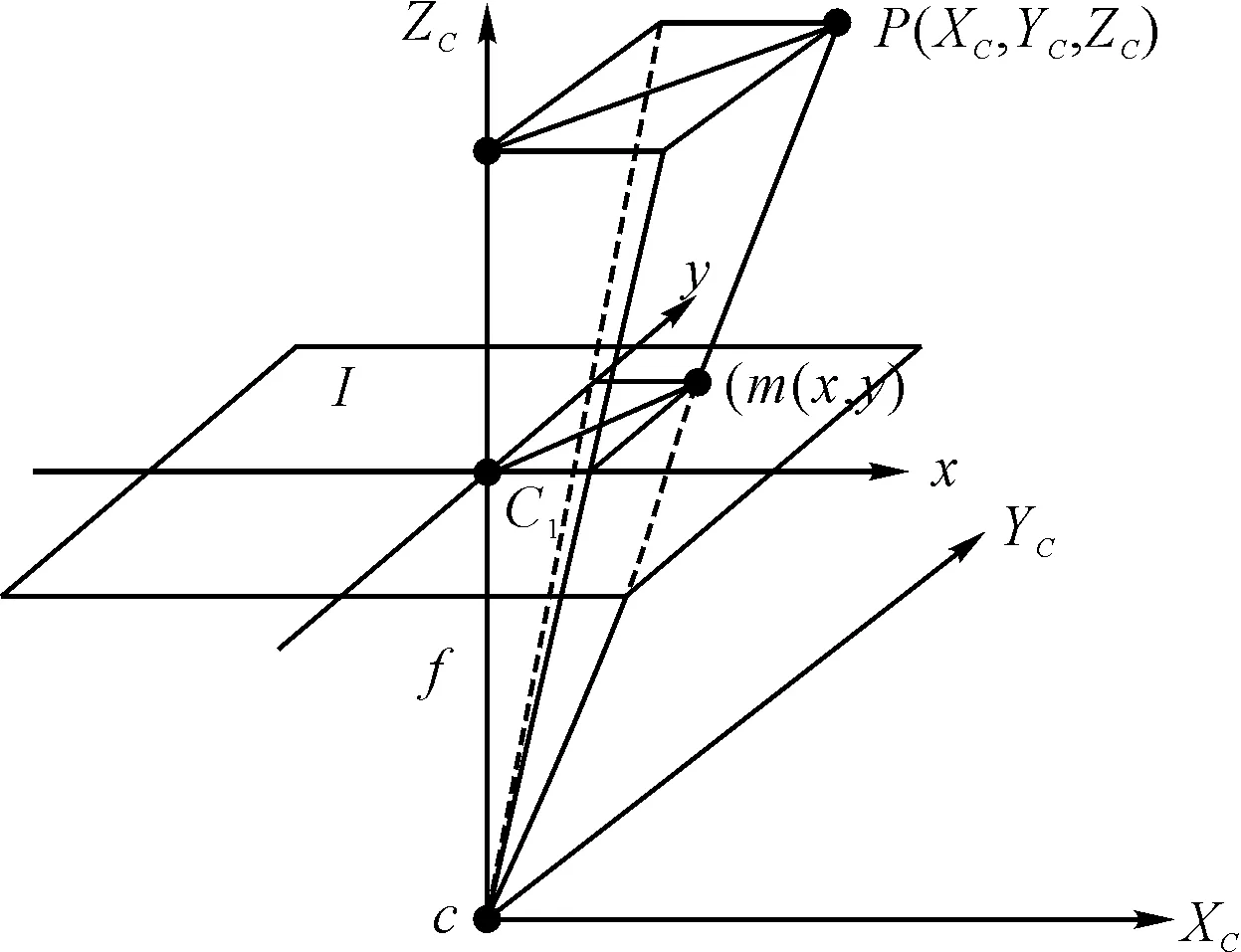

相机坐标系以小孔相机模型的聚焦中心为原点,以相机光轴为轴zc建立的:摄像机成像原理如图3所示。

图3 小孔成像模型

验证系统的标定:

第一步:将摄像头镜头固定在盒子的孔洞位置保持不变,使镜头通过这个孔可以清晰地拍摄到含有运动目标的连续帧图像。设此位置为Q,镜头与正对面的距离为d(即像距);

第二步:以摄像机通过孔洞的光轴为Z轴,垂直方向为y轴,水平向右方向为x轴建立三维坐标系;

第三步:确定图像运动目标质心的位置,设为P(x,y);

第四步:确定图像画面中心的位置,设为O(u,v);

标定的作用主要是可以实际计算图片对应目标的方位角和俯仰角

验证系统目标坐标方位角的实际计算方法:如图4~5为拍摄的原始图像。已知盒子的长宽高分别为28,21和19。

第一步:计算运动目标的坐标方位角。因为盒子的大小是固定的,所以可以确定出画面中心的实际坐标O(u,v),运动目标的实际坐标P(x,y).那么根据坐标方位角的定义可算出它的正切值[15]:

(3)

由此再求出其反切得到坐标方位角的角度:

(4)

带入已知条件解得坐标方位角α。

其仿真代码为

rad2deg(atan2(sum_x/2-plot_x(1),plot_y(1)-sum_y/2)) %%求目标方位角

第二步:计算运动目标与摄像头之间的俯仰角,即镜头与运动目标连线与光轴的夹角θ。同样的道理,先算出θ角的正切值:

(5)

由此再求出其反切得到俯仰角的角度:

θ=arctanz

(6)

带入已知条件解得俯仰角θ。

其仿真代码为: atan(sqrt((plot_x(1)-sum_x/2)^2+(plot_y(1)-sum_y/2)^2)/2822.857) %%求俯仰角。

图4 原始图像

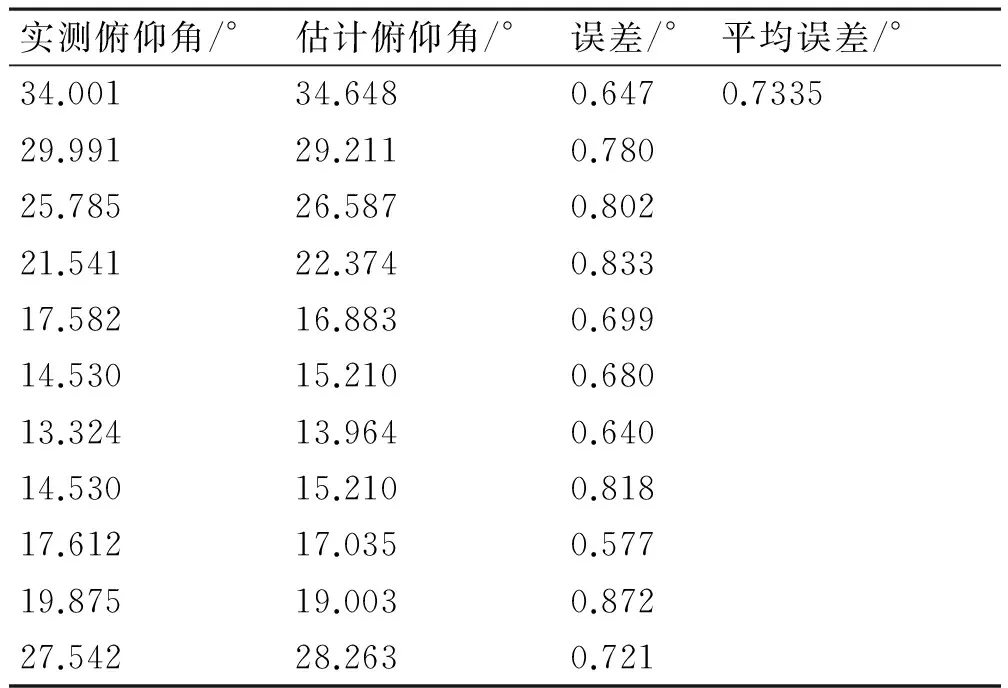

计算结果如表1和表2所示。

表1 目标方位角计算结果

表2 目标俯仰角计算结果

3 结论

经过实际验证,证明了此图像定位算法的正确性,并且它能够对达到方位角俯仰角的估计误差在1°以内的要求,可以很好地应用于工业生产需求,具有很强的实用性。

[1] 鹿雪娇.基于视频图像的运动物体识别与跟踪技术研究[D].大庆:大庆石油学院,2009.

LU XueJiao. Based on moving object recognition and tracking of video image technology research[D]. Daqing: Daqing petroleum institute,2009.

[2] 万缨,韩毅,卢汉青.运动目标检测算法的探讨[J].计算机仿真,2006,23(10):221-226.

WANYing, HANYi, LU HanQing. Moving target detection algorithm is discussed[J].The computer simulation,2006,23(10):221-226.

[3] 姚岚.一种CMOS图像传感器驱动及视频处理技术的研究与实现[D].北京:中国科学院研究生院,2008.

YAO Lang. A CMOS image sensor and the research and implementation of video processing technology[D]. Beijing: Graduate School of Chinese Academy of Sciences,2008.

[4] 丁金铸.基于图像处理的运动目标检测跟踪系统的设计与实现[D].武汉:华中师范大学,2007.

DING Jinzhu. Moving object detection based on image processing tracking system design and implementation[ D]. Wuhan: Central China normal university,2007.

[5] Stauffer C, Grimson W E L. Learning patterns of activity using real-time tracking [J]. Pattern Analysis and Machine Intelligence, IEEE Transactions on,2000,22(8):747-757.

[6] 孟祥怡.运动目标的跟踪与识别算法研究[D].长春:吉林大学,2014.

MENG Xiangyi. Moving target tracking and recognition algorithm[D]. Changchun: Jilin university,2014.

[7] 何天祥.视频图像中目标距离估计的研究[D].西安:西安电子科技大学,2011.

HE Tianxiang. Video image in the study to estimate the target range[D]. Xi’an: Xi’an university of electronic science and technology,2011.

[8] 何东健,耿楠,张义宽.数字图像处理(第二版)[M].西安:西安电子科技大学出版社,2008.

HE Dongjian, GEN Nan, ZHANG Yikuan. Digital image processing (second edition)[M]. Xi ’an: Xi’an university of electronic science and technology press,2008.

[9] 余慧玲.视频图像中的运动目标检测方法研究[D].长沙:中南大学,2013.

YU Huiling. Research on moving target detection method in video image[D]. Changsha: Central south university,2013.

[10] 陈祥虎.智能视频监控中的运动物体检测与跟踪算法研究[D].南京:南京邮电大学,2011.

CHEN Xianghu. Moving object detection and tracking algorithm of intelligent video surveillance study[D]. Nanjing: Nanjing university of posts and telecommunications,2011.

[11] Spoerri, A.Ullman, S.Aggarwal. The Early Detection of Motion Boundaries[M].

MIT A.I. Lab. Technical Report TR 1275, 1987.

[12] 徐梅.基于嵌入式的目标跟踪系统研究与开发[D].成都:电子科技大学,2015.

XU Mei. Target tracking based on embedded system research and development[D]. Chengdu: University of electronic science and technology,2015.

[13] 解晓萌.复杂背景下运动目标检测和识别关键技术研究[D].广州:华南理工大学,2012.

XIE Xiaomeng. Under the background of complex motion target detection and identification of key technology research[D]. Guangzhou: South China university of technology,2012.

[14] 明鹏.关于运动目标检测技术的研究[D].济南:山东大学,2013.

MING Peng. Research on moving target detection technology[D].Jinan: Shandong university,2013.

[15] 袁春兰.基于Sobel算子的图像边缘检测研究[D].武汉:武汉理工大学,2009.

YUAN Chunlan. Study of image edge detection based on Sobel operator[D]. Wuhan: Wuhan university of technology,2009.

Image Localization Algorithm for Near Space Target

WANG Li LEI Bin WANG Jianning BAI Fu

(College of Electronic and Information Engineering, Xi’an Technological University, Xi’an 710021)

This paper mainly introduces how the localization algorithm to locate the target in depth analysis on the basis of cruise missile flight parameters, the system through the research of inter frame difference algorithm, through the analysis of the geometric model, the mathematical equations are established, the measured object azimuth elevation angle is calculated and coordinates of the object is measured. The data measured by the device is compared with the actual value, which proves the validity of the measurement system and the practicability of the measurement system in the industrial production.

cruise missile, inter frame difference algorithm, azimuth angle, location

2016年5月17日,

2016年6月25日

王立,男,硕士研究生,研究方向:通信与信息系统,嵌入式系统。雷斌,男,硕士,副教授,研究方向:测控技术,无线传感器网络(嵌入式系统等)。 王健宁,女,硕士研究生,研究方向:通信与信息系统,嵌入式系统。白福,男,硕士研究生,研究方向:通信与信息系统,嵌入式系统。

TP391

10.3969/j.issn.1672-9722.2016.11.012