面向运动目标检测的粒子滤波视觉注意力模型

刘 龙,樊波阳,刘金星,杨乐超

(西安理工大学自动化学院,陕西西安 710048)

面向运动目标检测的粒子滤波视觉注意力模型

刘 龙,樊波阳,刘金星,杨乐超

(西安理工大学自动化学院,陕西西安 710048)

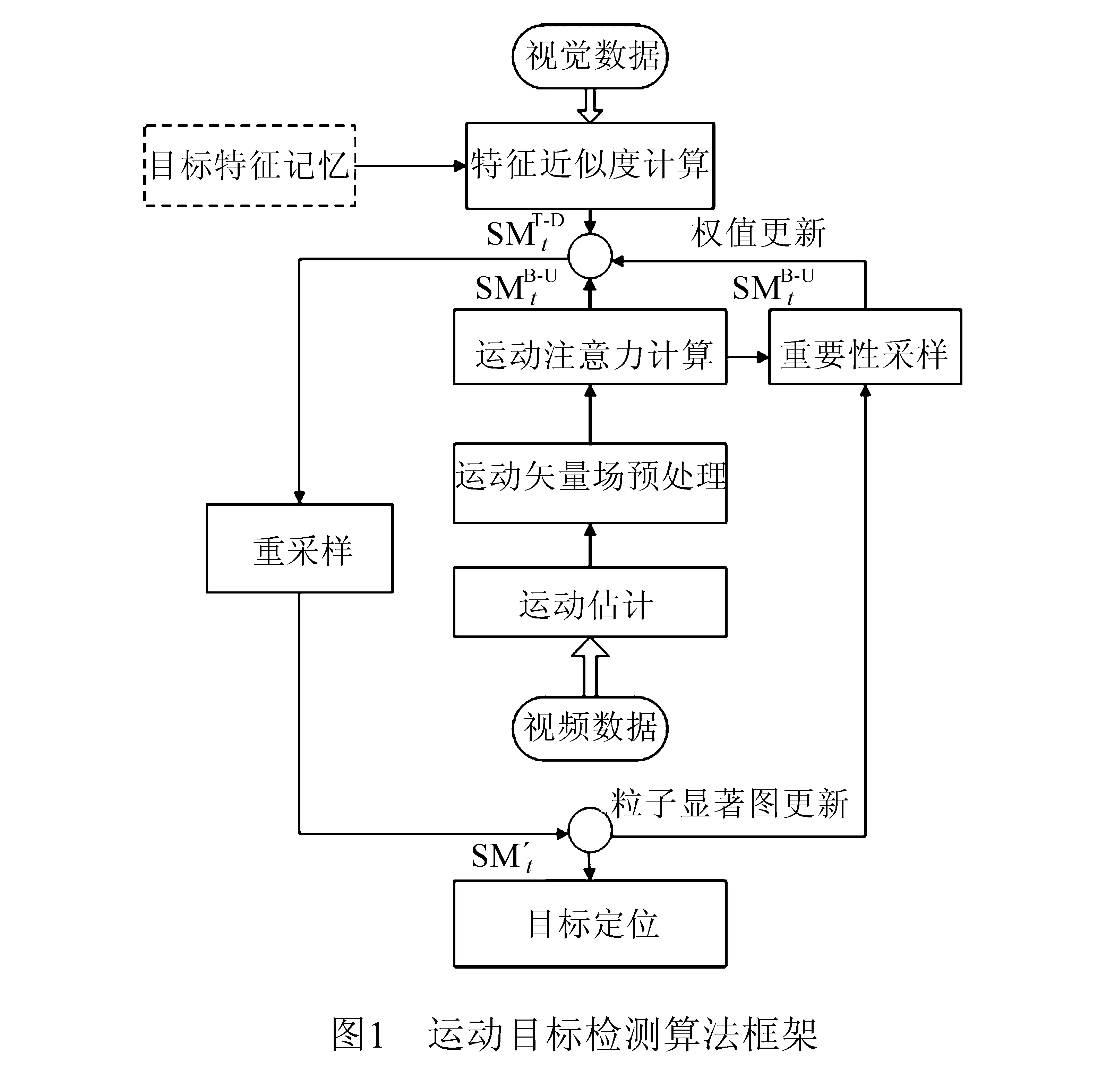

视觉注意力是机器视觉领域的研究热点,对目标检测、跟踪等技术发展具有积极意义,本文面向运动目标检测问题,构建了一种基于粒子滤波的视觉注意力模型.首先依据贝叶斯估计理论,推导了基于注意力的粒子权重计算方法;然后将运动注意力和目标颜色注意力分别作为自底向上(Bottom-Up)和自顶向下(Top-Down)注意力的输入,通过重要性采样、粒子权值计算、重采样等形成粒子注意力显著图,并确定目标位置;测试结果显示本文方法能够获取比其它方法更好的目标注意力显著图,并具有准确的目标检测效果.

注意力模型;运动目标检测;粒子滤波;融合

1 引言

运动目标检测是机器视觉领域的重要问题之一,是目标跟踪、识别的前提,但在复杂运动场景中,现有运动目标检测方法仍存在一定局限和不足.传统的运动目标检测方法有背景差分法、帧间差分法和全局运动补偿法,背景差分法和帧间差分法只局限于局部运动场景,全局运动补偿法适用范围广,但准确性受到目标大小和运动强度影响,当目标体较大或运动较强烈时,全局运动估算准确性下降,不能进行全局有效补偿,导致运动目标检测存在较大误差.近些年,视觉感知研究逐渐融入了人类生理和心理的研究成果,视觉注意力研究是其中典型问题之一,其主要研究如何通过计算机模拟人类视觉系统对外界的初级反应,对目标检测、跟踪等问题具有积极意义.

人类视觉注意力是由自底向上(Bottom-Up,B-U) 和自顶向下(Top-Down,T-D)两种注意力共同作用产生形成的.2002年,Itti和Koch[1]建立了以亮度、颜色等特征为主的B-U注意力模型,随后的一些研究衍生出多种视觉注意力计算方法及应用.目前,视觉注意力模型大致可分为自底向上型[1~5]和双向结合型[6~10]两种类型.自底向上型描述B-U注意力计算方法;双向结合型描述B-U和T-D注意力共同作用的计算方法.

视觉注意力模型构建有两种思路,一种是以模拟人类视觉机理为主要目的,另一种是针对一些具体问题构建视觉注意力模型,这类研究以解决实际问题为主要目标.近些年,一些学者从注意力的角度对目标检测问题进行了一定的研究,文献[9,11~12]采用双向注意力方法进行静态目标检测.Fang Y M等[9]提取目标的方向特征作为T-D注意力,并与B-U注意力进行比例加权融合,最终确定目标位置.Alcides X.B等对特定静态目标特征进行自组织神经网络学习,生成权重矩阵,并将其作为自顶向下的影响因素调节B-U注意力计算过程,形成目标注意力显著图.Yu Y L[11,12]等建立目标特征长期记忆(LTM)单元,通过与低级特征的对比计算位置概率分布偏置,并进行双向加权融合,确定目标位置.另外,文献[13]建立了运动注意力模型进行运动目标检测,主要思路是根据运动反差定义运动注意力模型,使运动显著性区域逼近目标区域.Ma Y F[13]根据从MPEG码流中解压所得到的运动矢量场的运动矢量能量、空间相关性和时间相关性综合定义了运动注意力模型,通过该模型可以得到运动显著性区域.Han J W[14]将注意力分为静态注意力和动态注意力两种,静态注意力主要由图像的亮度、颜色等信息引起,动态注意力是在全局运动补偿的基础上计算区域的变化像素的比例进行定义的,注意力模型最终由静态注意力和动态注意力融合得到,主要应用于运动目标检测.

文献[11~13]涉及了目标检测问题,但主要是解决静态目标的注意力问题,采用静态目标特征如轮廓、颜色等,T-D和B-U注意力采用了加权融合,较难反应两者对最终目标注意力的作用,文献[13~14]根据运动信息构建运动注意力模型,属于B-U注意力计算方法,具有一定的局限性.综上所述,相关研究还未有针对运动目标检测的注意力模型,而现有注意力模型缺乏将运动注意力以及目标特征等综合计算的形式.针对上述问题,本文着重研究面向运动目标检测的视觉注意力方法,提出借鉴粒子滤波机制建立双向融合注意力模型,采用运动注意力、目标颜色注意力分别作为B-U和T-D双向注意力输入,通过滤波后的粒子分布状态计算注意力显著度,并最终确定目标位置.

2 粒子滤波双向融合注意力模型

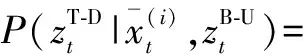

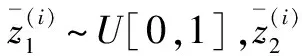

(1)

(2)

(3)

(4)

(5)

(6)

(7)

(8)

(9)

上述推导遵循以下假设条件:(i)时间动态过程符合马尔科夫过程;(ii)不同时间的观测值相互独立,观测值只与当前状态相关.根据假设(i)和假设(ii),对推导步骤作了如下简化:

(10)

3 基于视觉注意力的运动目标检测

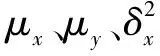

3.1 粒子权值计算

本文对运动矢量场进行叠加和滤波两个预处理,运动注意力SMB-U由时间和空间两方面注意力构成,设S1和S2分别表示时间和空间注意力,其计算定义如下:

(11)

(12)

(13)

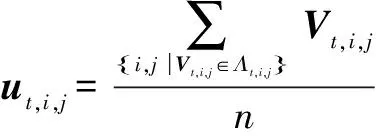

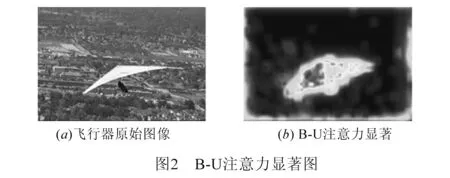

式中,α、β为正值的系数.图2显示了B-U注意力显著图.

(14)

(15)

SMT-D显著性计算定义如下:

(16)

式中,ρ为巴查理亚(Bhattacharyya)系数.图3示显示了T-D注意力显著图.

(17)

(18)

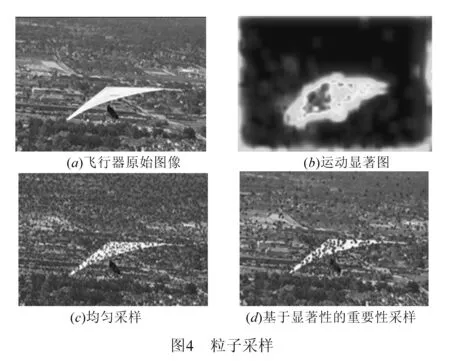

3.2 重要性采样与重采样

(19)

(20)

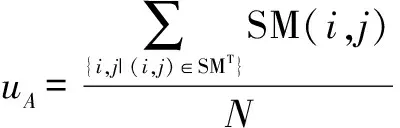

3.3 粒子显著图与目标定位

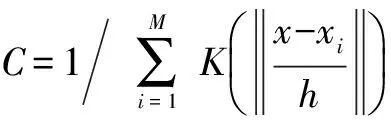

经过重采样后,粒子分布的疏密程度反映了注意力强弱,粒子分布密集区域注意力显著性强,分布稀疏的区域注意力显著性弱.根据粒子分布状态,在二维空间上,可定义注意力显著大小如下:

(21)

(22)

经过上述处理后,得到每一帧图像中所有粒子的分布状态,粒子群密度越大运动目标存在可能性越大,因此可以通过计算粒子群位置均值估计出目标位置信息,计算公式如式(23):

(23)

4 实验分析

本节对基于粒子滤波的注意力模型及运动标检测效果进行测试和分析.在测试实验中,将B-U运动注意力和T-D目标颜色注意力作为该模型的输入,与其它相关方法分析对比目标注意力显著图,同时评价对运动目标检测的准确性.实验在Dell Core 2.0GHz、1GB RAM的计算机上完成,编程环境为Matlab2012.

4.1 实验设置

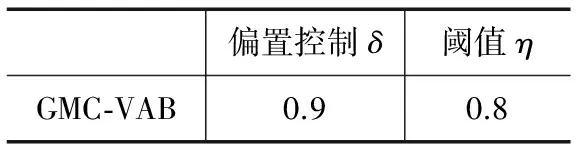

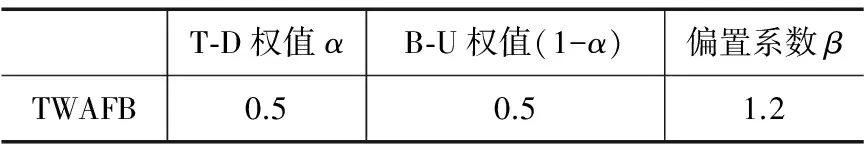

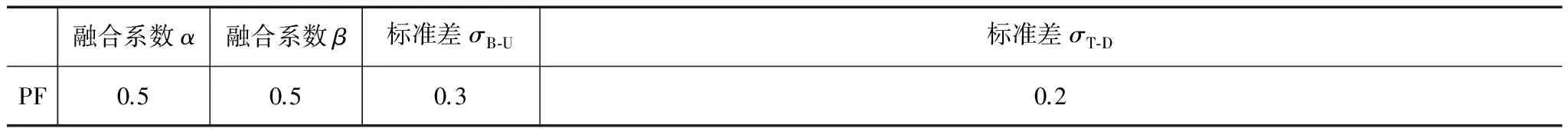

实验主要针对复杂运动场景测试运动目标检测的效果,本文方法(基于粒子滤波的算法,Particle Filtering Based,PF)与文献[13](全局运动补偿和视觉注意力混合的目标分割,Globe Motion Compensation and Visual Attention Based,GMC-VAB)中的算法和文献[8]双向注意力融合的算法,Two-way Motion Attention Fusion Based,TWAFB)作对比.GMC-VAB模型的相关参数设定如表1所示;TWAFB模型的融合权值系数和偏置系数设定如表2所示;本文方法中,时间注意力S1和空间注意力S2的融合系数α与β,B-U注意力概率似然函数中标准差σB-U与T-D注意力概率似然函数中标准差σT-D的设定如表3所示.

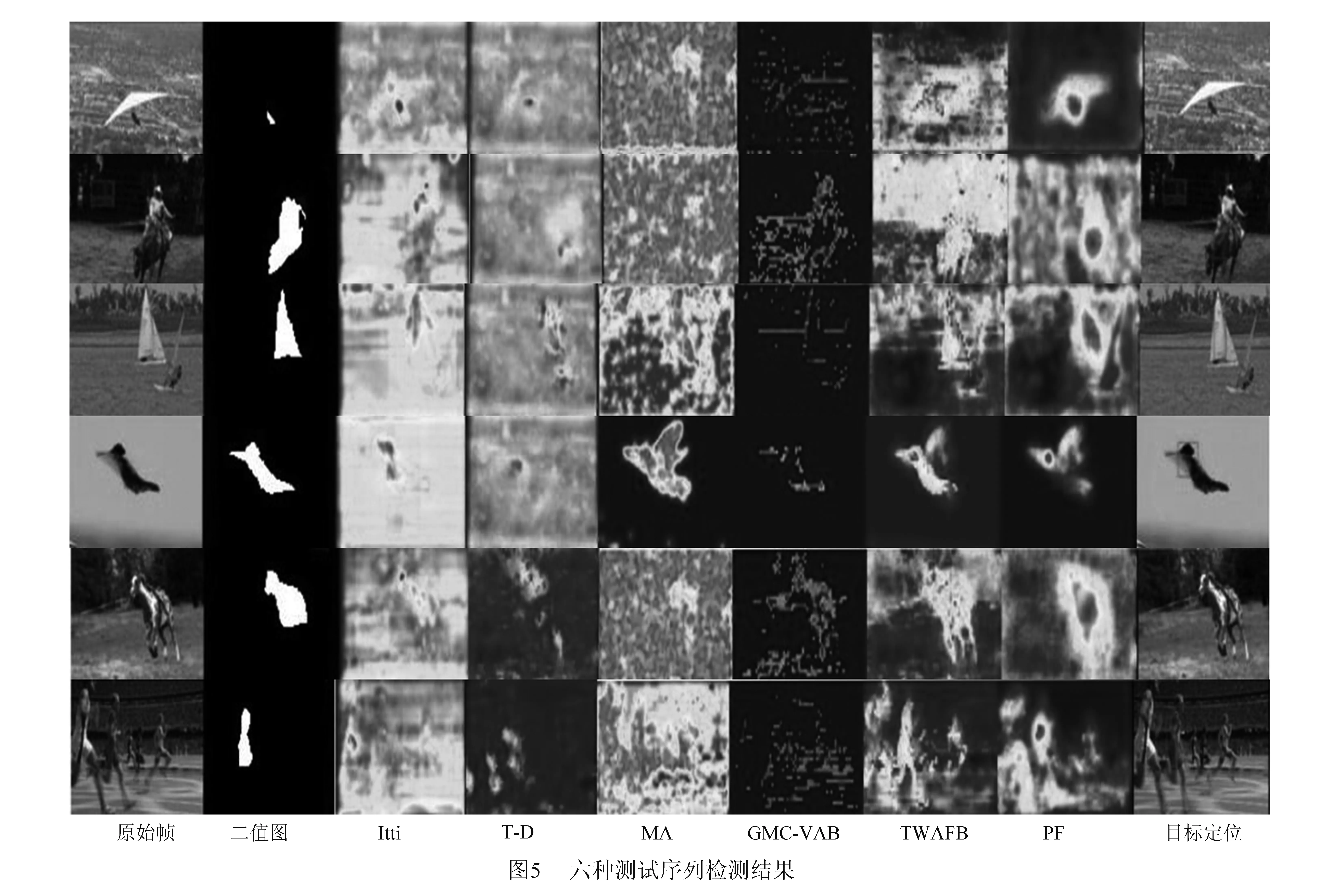

4.2 注意力显著图与运动目标检测

在实验数据方面,选取6个不同具有运动较为强烈的视频序列作为测试数据.6种测试序列具有不同的运动特点,“飞行器”序列:待测目标选定为飞行员,目标在空中高速滑动,背景为地面远景物体,纹理复杂,飞行器向图像上方运动,镜头随飞行器移动;“斗牛士”序列:待测目标选定为牛,目标不规则的激烈运动,背景为围栏和土地等,纹理有一定起伏变化,镜头随目标快速移动;“帆船”序列:待测目标选定为较大白色帆船,目标向右方做较缓慢平移运动,且存在部分遮挡干扰,近景纹理较弱,远景较复杂;“马”序列:待测目标选定为马,目标激烈运动,背景为树木和草地,纹理变化平坦,马向图像左侧奔跑,镜头快速向左侧移动;“蜂鸟”序列:待测目标选定为蜂鸟,目标激烈运动,背景有较强的明暗变化,蜂鸟的头部在不停啃食桌面食物,翅膀高速煽动,镜头随蜂鸟位置变化轻微移动.“赛跑”序列:待测目标选定为运动员,目标与镜头都做剧烈高速运动,图像出现局部模糊和幻影.图5显示了测试结果,其中第一列为视频序列的原始帧;第二列为显著二值图;第三列为Itti算法结果,主要反映颜色、亮度、方向等静态特征形成的B-U注意力显著图;第四列为以颜色特征为基础的T-D注意力显著图;第五列为MA算法结果,要反映其B-U运动模型计算得到的运动注意力显著图;第六列为GMA-VAB算法结果,主要反映全局运动补偿后的运动注意力与静态注意力加权融合形成注意力显著图;第七列为TWAFB算法结果,主要反映B-U注意力与T-D注意力偏置加权融合形成注意力显著图;第八列为本文算法结果;第九列为本文算法的目标检测定位结果.上述测试结果显示PF算法总体效果优于MA算法、GMC-VAB算法、TWAFB算法.MA算法虽然进行了双向注意力融合,但是受到运动估计精度的影响,导致运动注意力计算不准确,当运动相对简单时,可获得较好的效果,如“飞行器”和“蜂鸟”序列,而当运动强烈时,运动注意力比较杂乱不能有效反应运动目标显著性,如“斗牛士”、“帆船”、“马”和“赛跑”序列;GMA-VAB算法融合了全局运动补偿和静态注意力,但通常由于全局运动估计存在误差,导致目标显著性效果不佳;而且GMA-VAB算法只融合了B-U注意力特征,对全局中所有可能引起注意力的区域全部进行标注,无法实现目标的检测定位,如“马”,“赛跑”,“帆船”,“飞行器”,“蜂鸟”,“斗牛士”等序列,TWAFB算法采用T-D注意力作为指导,得到结果相对较好,但是在角点特征不明显的序列中,如“帆船”、“蜂鸟”序列,TWAFB的噪声较大,注意力显著焦点位置空间不连续,有时存在较大误差,实验结果显示,PF算法注意力显著图比MA算法、GMC-VAB算法、TWAFB算法的注意力图,由于采用合理的处理方法提高了运动估计的精度,加入颜色特征作为指导,背景噪声干扰得到大幅度削弱,还有在粒子滤波过程,粒子分布状态随运动状态和目标位置而改变,粒子最终收敛聚集于运动目标区域,使得注意力准确性大大提高.

表1 GMC-VAB模型的参数

偏置控制δ阈值ηGMC⁃VAB0.90.8

表2 TWAFB模型的参数

表3 PF模型的参数

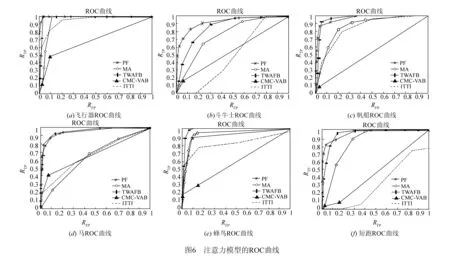

4.3 ROC性能指标

本文采用特征曲线(ROC)来评价本文模型所得到的显著图的预测注意力目标的性能.显著图中每个像素点被设定为一个二元分类器的样本,像素点值大于某一阈值可以判为是注意力焦点(阳性样本),否则判为非注意力焦点(阴性样本),以图像帧的真实显著二值图作为标准(ground truth),通过改变阈值大小,得出一系列真阳性率(RTP)和伪阳性率(RFP)对应的值,分别以RFP和RTP为横轴与纵轴可以得到ROC曲线.RTP和RFP由式(26)和(27)计算得到:

RTP=MTP/nP

(26)

RFP=MFP/nN

(27)

其中,nP和nN分别为阳性样本和阴性样本个数,MTP和MFP分别为判断为真阳性样本和伪阳性样本的个数.

图6显示了6个测试序列的ROC曲线结果.曲线越靠近左上方,运动目标显著性的准确度越高.由ROC曲线可知本文注意力模型的性能要优于其它模型;TWAFB模型加性融合T-D和B-U注意力,其效果比MA模型(B-U注意力)要好;GMA-VAB由于全局运动补偿的缺陷,导致效果不理想;Itti模型属于静态特征(颜色、亮度和方向)产生的注意力,所以曲线性能较差.

5 结论

本文依据贝叶斯融合原理,构建了基于粒子滤波的视觉双向融合注意力模型,并以运动注意力和目标颜色注意力分别为B-U和T-D注意力输入,通过粒子权值计算、重采样等处理改变粒子分布状态,形成注意力显著图,并最终确定目标位置;测试结果表明,本文方法可获得较准确的目标注意力显著图,对相关研究领域具有较高的学术和应用价值.

[1] Itti L,Koch C.Computational modeling of visual attention[J].Nature Reviews Neuroscience,2001,2(3):193-203.

[2] Olivier L M,Patrick L C.A coherent computational approach to model bottom-up visual attention [J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2006,28(5):802-817.

[3] Hou X D,Zhang L Q.Saliency Detection:A spec-tral residual approach[A].IEEE Conference on Computer Vision and Pattern Recognition [C].Minneapolis:IEEE,2007.1-8.

[4] Rapantzikos K,Tsapatsoulis N,Avrithis Y,et al.Bottom-up spatiotemporal visual attention model for video analysis[J].Image Processing,2007,1(2):237-248.

[5] Yan Q,Xu L,Shi J P,et al.Hierarchical saliency detection[A].IEEE Conference on Computer Vi-sion and Pattern Recognition[C].Portland:IEEE,2013.1155-1162.

[6]Kang W L,Hilary B,Feng J F.Cue-guided search:a computational model of selective attention [J].IEEE Transactions on Neural Networks,2005,16 (4):910-924.

[7] Zhang L Y,Tim K Marks,Matthew H Tong,et al.SUN:A bayesian framework for saliency using natural statistics[J].Journal of Vision,2008,7(8):1-20.

[8] Sang W B,Bumhwi K,Minho L.Top-down visual selective attention model combined with bottom-up saliency map for incremental perception [A].IEEE International Conference on Neural Networks [C].Barcelona:IEEE,2010.1-8.

[9] Fang Y M,Lin W S,Lau C T,et al.A visual attention model combining top-down and bottom-up mechanisms for salient object detection[A].IEEE International Conference on Acoustics,Speech and Signal Processing[C].Singapore:IEEE,2011.1293-1296.

[10]Borji A.Boosting bottom-up and top-down visual features for saliency estimation[A].IEEE Conference on Computer Vision and Pattern Recognition[C].Providence:IEEE,2012.438-445.

[11]Yu Y L,George K I Mann,et al.An object-based visual attention model for robotic applications[J].IEEE Transactions on System,2010,40(5):1398-1412.

[12]郎丛妍,须德,李冰.一种基于动态贝叶斯网的视觉注意力是别方法[J].电子学报,2011,39(3A):140-146.

Lang Cong-yan,Xu De,Li Bing.Dynamic Bayesian network based visual focus of attention recognition[J].Acta Electronica Sinica,2011,39(3A):140-146.(in Chinese)

[13]Ma Y F,Zhang H J.A model of motion attention for video skimming[A].2002 International Conference on Image Processing[C].New York:IEEE,2002.129-132.

[14]Zhou C.A visual attention model for dynamic scenes based on motion features[A].IEEE International Conference on Control Automation Robotics & Vision[C].Guangzhou:IEEE,2012.1396-1401.

[15]Han J W.Object segmentation from consumer videos:a unified framework based on visual atention[J].IEEE Transactions on Consumer Electronics,2009,55(3):1597-1605.

[16]Gordon N,Salmond D J,Smith A F M.Novel approach to nonlinear/non-Gaussian Bayesian state estimation[J].IEEE Proceedings F:Radar and Signal Processing,1993,140(2):107-113.

刘 龙 男,1976年生,博士,副教授,研究方向为智能信息技术与嵌入式系统.

E-mail:Liulong@xaut.edu.cn

樊波阳 男,1990年生,硕士研究生,研究领域为智能信息技术与嵌入式系统.

刘金星 男,1989年生,硕士研究生,研究领域为目标检测与跟踪.

Particle Filtering Based Visual Attention Model for Moving Target Detection

LIU Long,FAN Bo-yang,LIU Jin-xing,YANG Le-chao

(Xi’anUniversityofTechnology,Xi’an,Shaanxi710048,China)

Visual attention is one of the research hotspots in the field of machine vision,which is positive significance for development of target detection and target tracking.This paper presents a particle filter based visual attention model that is applied to detect moving target.Firstly,according to Bayes estimation theory,the method of particle weight calculation is established by visual bidirectional (Top-Down/Bottom-Up) fusion attention.Then motion attention and target color attention are adopted as input of the attention model,and moving target saliency is calculated through the importance sampling,particle weight calculation,resampling and particle saliency map processing.Lastly,the target position is determined by distribution of particle.Different video complex scene test results show that this method is more effective and accurate than the traditional method for detection of moving target.

motion attention model; moving target detection; particle filtering; fusion

2014-06-11;

2015-12-30; 责任编辑:梅志强

陕西省工业科技攻关项目(NO.2016GY-128);国家自然科学基金(No.61001140);西安市技术转移促进工程重大项目(No.CX12166)

TN911.7

A

0372-2112 (2016)09-2235-07

��学报URL:http://www.ejournal.org.cn

10.3969/j.issn.0372-2112.2016.09.031