视觉词袋和Gabor纹理融合的遥感图像检索

葛 芸,江顺亮,叶发茂,许庆勇,唐祎玲( . 南昌大学 信息工程学院,南昌 33003;2. 南昌航空大学 软件学院,南昌 330063 )

视觉词袋和Gabor纹理融合的遥感图像检索

葛 芸1,2,江顺亮1,叶发茂1,许庆勇1,唐祎玲1

( 1. 南昌大学 信息工程学院,南昌 330031;2. 南昌航空大学 软件学院,南昌 330063 )

摘要:针对高分辨率的遥感图像,提出了一种视觉词袋和Gabor纹理融合的图像检索方法。遥感图像纹理信息丰富,局部关键点多,当图像存在较多相似纹理时,视觉词袋检索准确率下降。将视觉词袋和Gabor纹理融合在一起结合了局部特征和全局特征以及中层词袋和底层纹理的优点,可以改进遥感图像的描述方式。实验结果表明,通过合理地分配视觉词袋和Gabor纹理的权重,特征融合的检索性能与单一特征方法相比有较大提高,并优于传统的Gabor纹理和颜色矩融合方法。因此,视觉词袋和Gabor纹理融合在遥感图像检索领域是一种有效的方法。关键词:遥感图像检索;视觉词袋;Gabor纹理;特征融合

0 引 言

近年来,随着遥感技术的发展,遥感图像分辨率不断提高,数据量急速增长。如何有效地管理利用遥感图像数据,满足用户对数据的使用需求成为近年来研究的热点。其中,从海量的遥感图像中快速有效地检索出感兴趣的目标或场景成为急需解决的关键问题之一。

基于内容的图像检索(Content-Based Image Retrieval, CBIR)技术在遥感图像中应用广泛[1-2],遥感图像纹理特征显著,可以有效地区分不同的实体,在遥感图像的检索中有重要的作用[3-4]。颜色特征常和纹理等其他特征融合在一起进行图像检索[5]。从整幅图像中提取的纹理和颜色等特征被称为全局特征,其提取复杂度低,鲁棒性强,但在复杂图像中精确匹配效果不如局部特征。局部特征大多位于高维空间,数目众多,局部特征可以通过聚类的方式构建成低维的视觉词袋(Bag of Visual Words, BoVW)模型。视觉词袋是中层特征,与颜色和纹理等底层特征相比,视觉词袋能够进一步缩小图像检索中的语义鸿沟。从视觉词袋在遥感图像检索中首次应用来看[6],其检索性能优于基于颜色和纹理的检索性能。

遥感图像纹理信息丰富,局部关键点较多,当图像存在较多相似纹理时,视觉词袋检索结果的准确性较低[7]。因此通过在视觉词袋中融合纹理特征的方法来提高图像检索的准确率。遥感图像中的目标一般比多媒体图像中的目标尺度小得多,有时更需要关注图像的全局信息,而局部特征最大的不足是缺少对图像的整体描述。Gabor纹理能够反映图像的全局信息,基于局部特征的视觉词袋和Gabor纹理融合在一起结合了全局特征和局部特征、中层词袋特征和底层纹理特征的优势。因此本文将基于局部特征的视觉词袋和全局Gabor纹理相融合并用于遥感图像检索。实验结果表明,通过合理地分配特征的权重,特征融合的检索性能比单一特征的检索性能有较大提高,并优于传统的特征融合。

1 特征提取

1.1 视觉词袋

局部特征选用应用广泛的尺度不变特征变换(Scale Invariable Feature Transformation, SIFT)[8]。将提取的遥感图像的SIFT局部特征,通过k-means算法聚类,聚类后得到一个视觉词典,词典中的每个元素为一个视觉单词,即聚类中心。最后,采用硬分配方法将图像特征向量分配到距离最近的视觉单词,统计图像中各个视觉单词出现的频数,得到一个图像的视觉单词向量,其维数为聚类中心的数目。构建视觉词袋后特征向量表示为其中fi是聚类中心i出现的频数,k是聚类中心的数目。

1.2 Gabor纹理

Gabor滤波器获得图像纹理特征是一种有效的遥感图像分析方法。具体的特征提取方法使用5个尺度,6个方向的Gabor滤波器对原始图像进行Gabor变换,形成30幅图像纹理表示,计算这30幅图像的均值和方差,最终得到一个60维的特征向量,其中μij和ijσ分别代表相应的尺度和方向上的均值和方差。

2 基于特征融合的检索方法

2.1 归一化

图像各特征向量代表的物理意义往往不同,即使对于同一特征向量其各个分量的取值范围也可能存在很大的差异,需对特征向量进行归一化处理[9],特征向量内部归一化的目的是使特征向量内部的不同分量在相似性度量时具有相同的地位。采用常用的高斯方法进行内部归一化。用代表图像库中的m幅图像,令一幅图像Ii的某个l维特征向量为,将图像库中所有图像的特征向量看成一个大小为m×l的矩阵F。计算F每一行特征分量对应的平均值μi和标准差iσ,通过式(1)将特征向量进行归一化和平移,使得绝大部分的值在[0,1]范围。

特征向量外部归一化的目的是使不同的特征向量在相似性度量时具有相同的地位。对于任意查询图像q,根据相似性度量标准计算q与图像库中m幅图像的相似度,对其进行高斯归一化和平移操作,使得绝大多数的相似度在[0,1]范围内。

对提取的视觉词袋和Gabor纹理分别进行内部归一化后,再对不同特征的相似度进行外部归一化。查询图像与数据库中图像的相似度用视觉词袋特征相似度和Gabor纹理相似度的加权表示:

2.2 检索方法

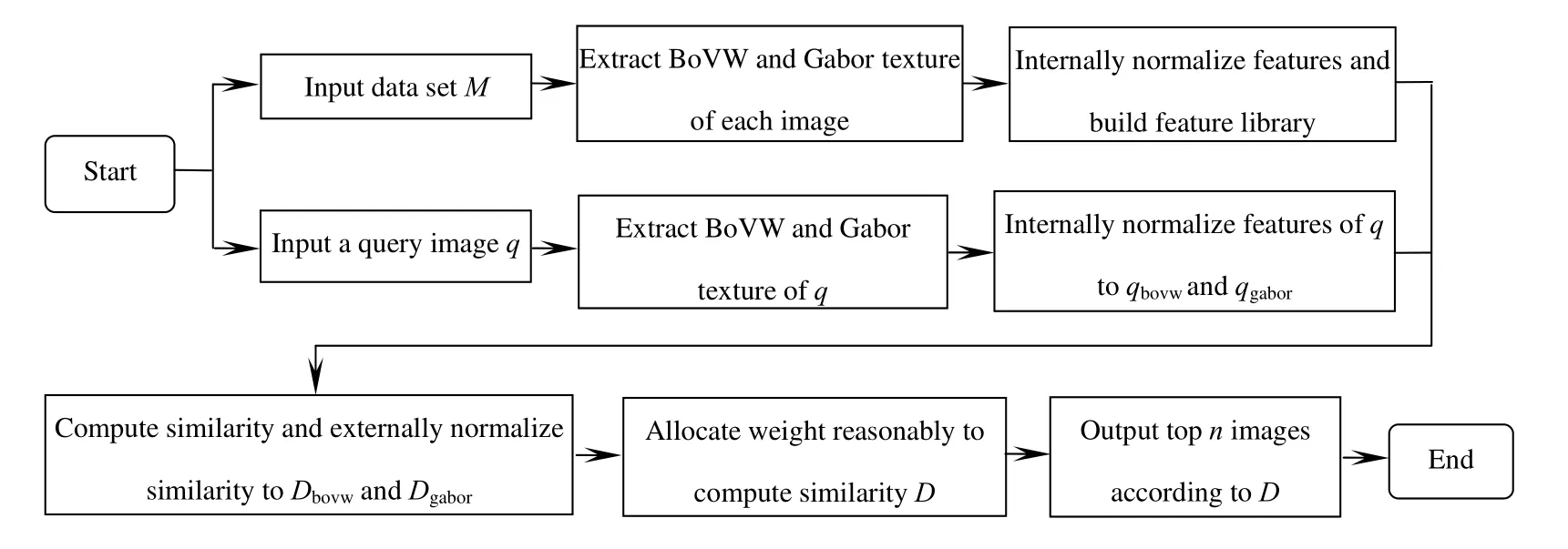

图1描述了基于特征融合的遥感图像检索流程,具体的步骤如下:

输入:遥感图像库M,查询图像q。

输出:返回n幅最相似的图像。

步骤1) 提取M中每幅图像的k维视觉词袋特征和60维Gabor纹理。提取q的k维视觉词袋特征和60维Gabor纹理。

步骤2) 根据高斯方法,M中每幅图像的特征分别进行内部归一化,形成特征库。q的视觉词袋特征和Gabor纹理分别进行内部归一化后的特征为qbovw和qgabor。

步骤3) qbovw、qgabor分别和特征库中相应的特征计算相似度,经过高斯外部归一化后得到视觉词袋相似度Dbovw和Gabor纹理相似度Dgabor。

步骤4) 合理分配Dbovw和Dgabor的权重wbovw和wgabor,得到相似度。

步骤5) 在一系列的相似度中按需求返回距离最小,即最相似的n幅图像。

图1 基于特征融合的遥感图像检索流程图Fig.1 The remote sensing images retrieval flow chart based on feature fusion

3 实验结果及分析

3.1 实验数据和评估标准

实验以目前最大的遥感图像公共测试数据集UCMerced Land Use/Land Cover[10]为对象,该数据集包含了农田、飞机和棒球场等21类场景图片,每类有100幅图像。

为了评价检索的有效性,采用图像检索系统中应用最为广泛的性能评价准则平均查准率(Precision)、平均查全率(Recall)以及相应的查准率-查全率曲线。考虑检索图像的排序情况,实验中采用了在MPEG-7标准化处理中广泛使用的平均归一化修改检索等级(Average Normalize Modified Retrieval Rank, ANMRR)[6],ANMRR取值越小,说明检索出来的相关图像越靠前,即检索效果越好。实验中,将数据集中的每一幅图像取出作为检索条件,在整个图像集合进行检索,通过比较2 100次检索的平均性能对检索方案进行验证。文献[6]的实验结果表明视觉词袋特征中的单词数目为150时检索性能比较好,因此实验中的单词数目为150。Gabor纹理中的尺度数为5,方向数为6,维数为60,相似性度量采用常用的欧氏距离。

3.2 不同权重检索性能比较

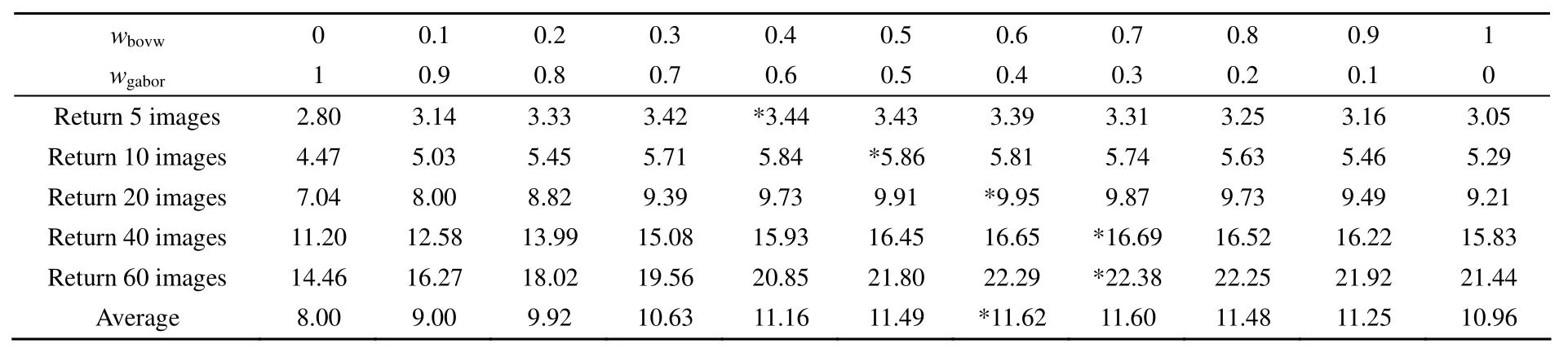

视觉词袋和Gabor纹理的权重对实验结果有较大影响,通过一系列的实验来验证不同权重分配对检索性能的影响。令wbovw和wgabor分别表示视觉词袋的权重和Gabor纹理的权重,在集合{0,0.1,...,0.9,1}中选择和的取值(需满足)。

表1和表2分别表示特征融合方法在不同权重下的平均查准率、ANMRR值和平均查全率。在实际检索系统中,用户一般只关心排序靠前的结果。表中列出了当检索返回图像数目分别为5、10、20、40和60时的平均查准率和平均查全率,数字前标*的值为同一行中最优值。当只返回5幅图像时,视觉词袋和Gabor在不同的权重取值下,基于特征融合方法的平均查准率和平均查全率比基于单一特征的平均查准率和平均查全率都高;当返回10幅图像时,只有在wbovw=0.1、wgabor=0.9情况下的特征融合的检索性能不如基于视觉词袋的检索性能;在wbovw=0.5、wgabor=0.5情况下特征融合的平均查准率比基于Gabor的平均查准率提高了13.9%,比基于视觉词袋的平均查准率提高了5.7%。当返回图像数目较少时(返回5幅图),Gabor权重较大时的查准率和查全率比较高。随着返回图像数目的增多,则视觉词袋权重较大时查准率和查全率值更高。视觉词袋和Gabor纹理融合的查准率和查全率比基于单一特征的检索性能有较大提高。

表1 特征融合方法在不同权重下平均查准率和ANMRRTable 1 The average precision and ANMRR of feature fusion method with different weighted values %

表2 特征融合方法在不同权重下平均查全率Table 2 The average recall of feature fusion method with different weighted values %

表1中的ANMRR值表明,特征融合的方法比基于Gabor方法的检索性能好;而只有在视觉词袋权重比重较大时,特征融合方法的检索性能才优于基于视觉词袋的检索性能。从表1和表2的整体结果来看,基于视觉词袋的检索性能比基于Gabor的检索性好,基于特征融合的检索性能在视觉词袋权重较大时优于Gabor权重较大时。

3.3 不同特征融合方法比较

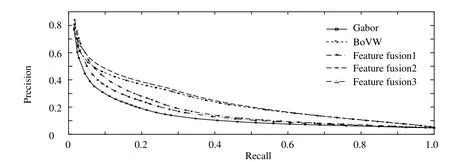

图2显示了不同特征的查准率-查全率比较,查准率和查全率返回图像数目最少的为2,最大为2 100。特征融合1和特征融合2均为视觉词袋和Gabor纹理融合的方法(特征融合1代表Gabor权重较大的融合方法,特征融合2代表视觉词袋权重较大的融合方法),特征融合3为Gabor纹理和颜色矩融合的方法[5]。

图2 不同特征的查准率-查全率比较Fig.2 Precision-recall curves for the different features

由于返回图像数目在2到2 100之间,因此选用表1中ANMRR值最优时的权重分配wgabor=0 .2 ),即属于特征融合2的方法。特征融合1的权重分配随机选定为(wbovw=0.2,wgabor=0.8)。特征融合3实验中,当Gabor纹理的权重和颜色矩的权重相等时ANMRR值最小,因此特征融合3的权重分配为(wgabor=0.5,wcolor=0.5),其中wcolor表示颜色矩的权重。

当返回图像数目少于10时,特征融合1的性能较好。随着返回图像数目增多,特征融合1的检索性能急剧下降,只优于Gabor和特征融合3的方法。从整体来看,特征融合2的检索性能比其他方法的检索性能都好。当图像返回数目增多时,特征融合2的检索性能接近于视觉词袋的检索性能。

3.4 不同类别图像的检索性能比较

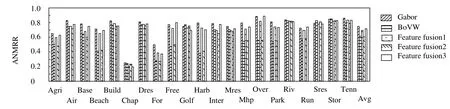

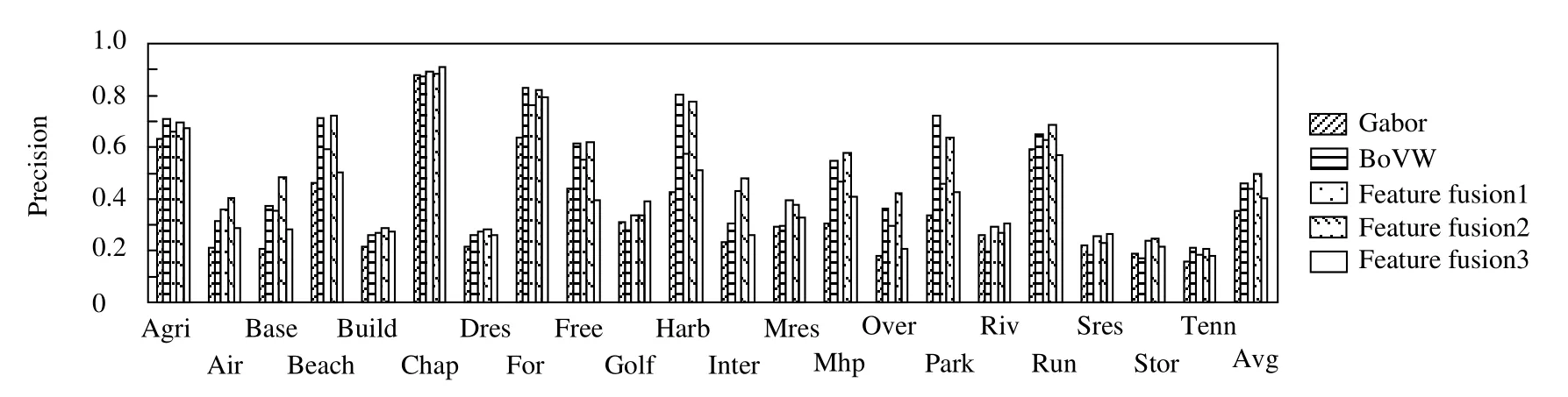

不同类别图像的特征存在差异,特征融合的效果也不同。通过实验比较不同类别图像的ANMRR值和平均查准率,并分析特征与图像类别的关系。图3显示了不同特征在各类图像检索中的ANMRR值,三种特征融合的权重分配与图2一致。图4比较了返回图像数目为20时,不同特征在各类图像中的平均查准率,特征融合1的权重分配随机选定,特征融合2的权重分配是视觉词袋和Gabor纹理融合中平均查准率最高的情况,特征融合3的权重分配为Gabor纹理和颜色矩融合中平均查准率最高的情况。

图3 不同特征在各类图像中的ANMRR比较Fig.3 Per class ANMRR for the different features

图4 不同特征在各类图像中的查准率比较Fig.4 Per class performance for the different features

为了研究特征和图像类别的关系,分别找出图3和图4中5种不同特征对应的最优检索类别。以图3的特征融合1为例,特征融合1在农田类图像中的ANMRR值不是最小,因此农田不是特征融合1的最优类别,而在稀疏区和储油罐类图像中,特征融合1对应的ANMRR值最小,因此稀疏区和储油罐为特征融合1的最优类别。基于单一特征的检索中,图3和图4中基于视觉词袋检索的共同最优类别有海港和停车场。从图5可以看出,这两类图像的共同点是图像中的目标(船只或车辆)的大小形状相似,并整齐排列,更容易找到有效的关键点。图3和图4都不存在基于Gabor检索最优的图像,但高尔夫场、稀疏区和储油罐三种类别图像基于Gabor的检索优于基于视觉词袋的检索;图5中,这三类图像存在一两处突出目标(比如高尔夫场中的沙坑),这些目标稀疏且纹理信息和周围的图像有很大区别,这类图像在基于单一特征检索的情况下使用Gabor进行检索的性能更好。

基于特征融合的检索中,特征融合2的检索效果突出,其中飞机、棒球场、建筑物、稠密区、十字路口和立交桥为图3和图4的共同最优图像类别。将这5类图像分为2种情况,一种是飞机、棒球场、十字路口和立交桥类图像,这类图像的目标特点非常明显,具有自身特定的形状(比如棒球场呈扇形),并且存在对比明显的纹理信息(比如飞机和周围场地的纹理信息),不容易和其他目标混淆。另一种是建筑物和稠密区,这类图像中房屋的图案等细节很难反应出来,更关注的是居住区的整体信息,比如建筑风格。特征融合3中共同存在的图像类别有灌丛、高尔夫场和河流,这三种图像中具有丰富的纹理信息和颜色信息。

根据以上的分析,特征融合2适用的图像种类最多,它适用于目标形状特定或者全局信息区分度更大的图像;其次是视觉词袋和特征融合3,视觉词袋适用于目标的大小形状相似并排列整齐的图像,特征融合3适用于纹理和颜色信息对比度明显的图像;特征融合1和Gabor能够适用的图像种类比较少,适用于目标稀疏且纹理信息突出的图像。

由一系列的实验结果可以看出,视觉词袋和Gabor的权重对图像的检索性能有较大影响,由于视觉词袋特征能够有效缩小图像检索中的语义鸿沟问题,因此当视觉词袋权重较大时的特征融合效果更好。视觉词袋和Gabor纹理融合方法在查准率-查全率上比传统的Gabor纹理和颜色矩融合方法得到较大程度的提高,并且在绝大多数类别的图像中,视觉词袋和Gabor纹理融合方法的ANMRR值和查准率都优于传统的Gabor纹理和颜色特征融合的方法。

图5 共同类别的图像Fig.5 Images for the common categories

4 总结和展望

本文将视觉词袋和Gabor纹理融合的方法用于遥感图像检索。视觉词袋和Gabor纹理融合在一起结合了局部信息和全局信息以及中层特征和底层特征的优势,可以进一步改进图像的描述方式。另外,遥感图像纹理信息非常丰富,当图像存在大量相似的纹理信息时,视觉词袋特征检索的准确率下降,可以通过结合Gabor纹理加以改善。实验分别比较了不同权重、不同特征融合方法在遥感图像中的检索性能,并比较分析了几种检索方法在不同类别图像中的检索性能。视觉词袋和Gabor纹理融合中两者的权重对检索性能有较大影响,当返回图像数目非常少时,Gabor权重较大时的检索效果更好;当返回图像数目较多,则视觉词袋权重较大时的检索效果更好。视觉词袋和Gabor纹理融合方法中,视觉词袋权重较大时的查准率-

查全率上明显优于Gabor权重较大时的结果,并且比传统的Gabor纹理与颜色矩的特征融合以及单一视觉词袋或Gabor纹理的图像检索效果好。在比较几种特征对不同类别图像的检索实验中,视觉词袋权重较大时的视觉词袋和Gabor纹理融合适用的图像种类最多。因此,本文提出的视觉词袋和Gabor纹理融合方法,在视觉词袋权重较大时能有效地提高遥感图像的检索性能,并优于传统的Gabor纹理和颜色矩融合的方法。本文只通过实验比较了不同权重对特征融合的检索性能的影响,并不能自适应地选择权重,因此下一步工作中将研究通过相关反馈和机器学习的方法来自适应地选择不同特征的权重,以进一步提高图像检索的性能。另外,也将研究图像的GIST特征、颜色特征和形状特征在特征融合中对检索性能的影响。

参考文献:

[1] Demir B,Bruzzone L. A Novel Active Learning Method in Relevance Feedback for Content-Based Remote Sensing Image Retrieval [J]. IEEE Transactions on Geoscience and Remote Sensing(S0196-2892),2015,53(9):2323–2334.

[2] Piedra-Fernandez J A,Ortega G,Wang J Z,et al. Fuzzy Content-Based Image Retrieval for Oceanic Remote Sensing [J]. IEEE Transactions on Geoscience and Remote Sensing(S0196-2892),2014,52(9):5422–5431.

[3] Aptoula E. Remote Sensing Image Retrieval with Global Morphological Texture Descriptors [J]. IEEE Transactions on Geoscience and Remote Sensing(S0196-2892),2013,52(5):3023-3034.

( )( )

[4] YAO Hongyu,LI Bicheng,CAO Wen. Remote sensing imagery retrieval based-on Gabor texture feature classification [C]// Proceedings of 7th International Conference on Signal Processing,Aug 31-Sept 4,2004,1:733–736.

[5] 陆丽珍,刘仁义,刘南. 一种融合颜色和纹理特征的遥感图像检索方法 [J]. 中国图象图形学报,2004,9(3):328-332.

LU Lizhen,LIU Renyi,LIU Nan. Remote Sensing Image Retrieval Using Color and Texture Fused Features [J]. Journal of Image and Graphics,2004,9(3):328-332.

[6] YANG Yi,Newsam Shawn. Geographic image retrieval using local invariant features [J]. IEEE Transactions on Geoscience and Remote Sensing(S0196-2892),2013,51(2):818-832.

[7] 杨进,刘建波,戴芹. 一种改进包模型的遥感图像检索方法 [J]. 武汉大学学报:信息科学版,2014,39(9):1109-1113.

YANG Jin,LIU Jianbo,DAI Qin. An Improved Remote Sensing Image Retrieval Method Based on Bag of Word Framework [J]. Geomatics and Information Science of Wuhan University,2014,39(9):1109-1113.

[8] David G Lowe. Distinctive Image Features from Scale-Invariant Keypoints [J]. International Journal of Computer Vision (S0920-5691),2004,60(2):91-110.

[9] Gondra I,Heistcrkamp D R. Content-based Image retrieval with the normalized information distance [J]. Computer Vision and Image Understanding(S1077-3142),2008,111(2):219-228.

[10] YANG Yi,Newsam Shawn. Bag-of-Visual-Words and Spatial Extensions for Land-Use Classification [C]// Proceedings of the 18th ACM SIGSPATIAL International Conference on Advances in Geographic Information Systems,San Jose,California,Nov 2-5,2010:270-279.

Remote Sensing Image Retrieval Based on the Fusion of BoVW and Gabor Texture

GE Yun1,2,JIANG Shunliang1,YE Famao1,XU Qingyong1,TANG Yiling1

( 1. Information Engineering School, Nanchang University, Nanchang 330031, China; 2. Software School, Nanchang Hangkong University, Nanchang 330063, China )

Abstract:A retrieval method based on the fusion of Bag of Visual Words (BoVW) and Gabor texture is presented for the high resolution remote sensing images. Remote sensing images have rich texture information and many local key points. But when an image contains lots of similar texture, the retrieval precision of BoVW will be reduced. The fusion of BoVW and Gabor texture combines the advantages of local feature and global feature, mid-level feature and low-level texture to improve image description. Experiment results show that the presented fusion method is superior to the traditional fusion method using Gabor texture and color moments. Retrieval performance of the fused features method is improved compared with that using single feature, and the improved performance depended on the suitable fusion weights. Experiment results indicate that the fused BoVW and Gabor texture is effective for high-resolution remote sensing image retrieval.

Key words:remote sensing image retrieval; BoVW; Gabor texture; feature fusion

作者简介:葛芸(1983-),女(汉族),江西高安人。讲师,博士研究生,主要研究工作是图像检索。E-mail: geyun@nchu.edu.cn。

基金项目:国家自然科学基金地区项目(41261091);江西省教育厅科技项目(GJJ13482);江西省青年科学基金(20142BAB217017);江西省教育厅项目(GJJ14542)

收稿日期:2015-06-11; 收到修改稿日期:2015-09-23

文章编号:1003-501X(2016)02-0076-06

中图分类号:TP394.1;TP75

文献标志码:A

doi:10.3969/j.issn.1003-501X.2016.02.013