基于改进光流法的旋转运动背景下对地运动目标实时检测*

储林臻 闫钧华 杭谊青 许俊峰

(南京航空航天大学航天学院,南京,210016)

基于改进光流法的旋转运动背景下对地运动目标实时检测*

储林臻 闫钧华 杭谊青 许俊峰

(南京航空航天大学航天学院,南京,210016)

针对战机对地侦查视频图像中地面旋转运动背景下运动目标检测高虚警、低实时性的问题,提出了一种基于改进光流法的旋转运动背景下对地运动目标实时检测算法。首先提取图像的特征点,在特征点处计算光流运动矢量,并通过光流矢量场估算背景运动矢量。根据战机飞行高度自适应计算目标像素尺寸,网格化分块待检测图像;然后将各个特征点光流矢量与背景运动矢量相比较,获得备选目标特征点。最后统计分块备选目标特征点密度,判断目标位置区域。对2组实验视频中央360像素×432像素区域进行目标检测实验,结果表明该算法能够准确地检测出地面运动目标,虚警率低。平均每帧检测耗时分别为29.460 ms和31.505 ms,满足战机对地运动目标检测的实时性。

改进光流法;地面背景;旋转运动;目标检测;视频图像

引 言

对地面运动目标的侦查和精确打击是空军主要战术任务之一。在战机对地侦查视频图像中高精、实时检测出地面运动目标是其关键技术。由于战机在光电成像过程中的运动,对地侦查视频图像中存在地面背景的旋转运动[1],这导致目标检测出现大量的虚警。由Horn-Schunck提出的光流法是目前针对运动目标检测的主要方法之一[2]。Lucas-Kanade提出局部运动约束假设改进了光流计算,并广泛地应用于计算机视觉处理中[3]。Zhan Wei等[4]利用Lucas-Kanade光流法实现了对固定背景下运动汽车的检测。Royden等[5]对车载相机平台运动条件下的光流场进行了分析。根据Bruhn等[6]对光流法的实时性实验数据,发现传统的光流法无法满足战机对地运动目标检测对实时性的要求。张水发等[7]指出由于传统的光流法需要对图像中全部像素进行光流计算,导致运算量极大,因而影响算法的实时性。本文针对旋转运动背景下对地运动目标检测高虚警、低实时性的问题,对光流法进行改进。首先提取图像的特征点,在图像特征点处计算光流运动矢量,并通过计算所得的光流矢量场估算背景运动矢量;接着根据战机飞行高度自适应计算目标像素尺寸,网格化分块待检测图像。然后将各个特征点光流矢量与背景运动矢量相比较,获得备选目标特征点。最后统计分块备选目标特征点密度,判断目标位置区域。

1 快速计算图像光流场

1.1 图像特征点检测

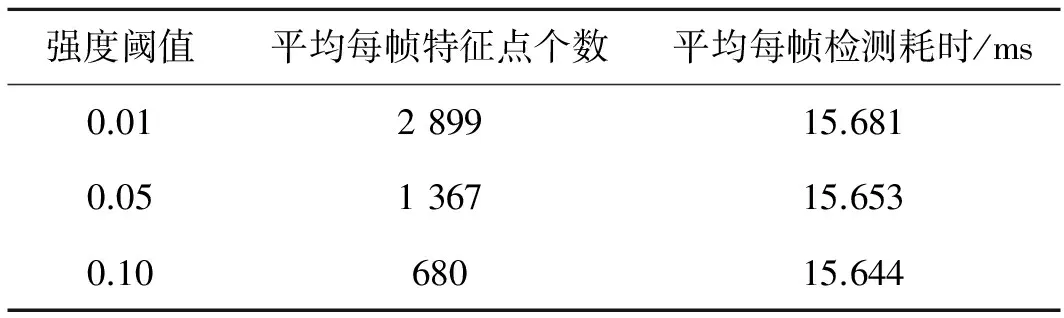

在战机对地侦查视频图像中,运动目标位于图像灰度变化较剧烈的区域,即图像的特征点附近[8]。为减小光流法计算量,首先提取图像的特征点,然后计算图像特征点处的光流矢量。本文对航拍视频图像在不同强度阈值下的Shi-Tomasi Harris[9]特征点检测效果及实时性进行了实验,结果见表1。

为达到实时检测的效果,目标检测算法需要达到25帧/s的图像处理速度。根据上述实验结果,在目标检测算法中使用Shi-Tomasi Harris特征点检测法可以满足实时性的要求。为降低漏检率,需要提取尽量多的特征点。又由于后续的光流矢量求解是基于像素点灰度梯度的计算,并且要考虑减小光流计算量,所以特征点检测的强度阈值不能过低。经过实际试验,发现Shi-Tomasi Harris特征点检测法的强度阈值设为0.05较为合适。

表1 Shi-Tomasi Harris特征点检测结果

1.2 Lucas-Kanade光流法

光流可看成带有灰度的像素点在图像平面上的运动而产生的瞬时速度场。Lucas-Kanade光流法是一种计算稀疏光流的方法[10],假设在极短时间内,沿像素点运动轨迹上的灰度不变,即

(1)

式中:I为视频图像中某像素点的像素值;x,y为该像素点在图像平面上的坐标,t表示该像素点在视频图像序列时间轴上的坐标。对其微分可以得到光流方程

(2)

式中:vx,vy分别表示像素点在水平和垂直方向上的速度分量。

这是一个超定方程,为求解vx与vy还需要加入其他的约束条件方程。Lucas-Kanade方法假设在局部小块图像内所有像素点的光流矢量都近似相同,利用最小二乘法对光流方程误差估计vx和vy。若ω为像素点附近的一小块邻域,光流方程误差E可表示为

(3)

(4)

2 改进光流法检测运动目标

战机与地面相对旋转运动造成对地侦查视频图像地面背景旋转,导致目标检测出现大量的虚警,本文对光流法进行改进。将待检测图像分块,从全体分块中提取出目标分块,通过对图像特征点的分类实现对图像区域的分类,确定目标分块,实现运动目标检测。

2.1 背景运动估计

战机转弯半径大于图像视场范围,相邻两帧图像间的时间间隔极短,因此对图像背景的运动进行估计时,属于图像背景像素点的运动矢量落在某二维运动矢量的一个较小的邻域范围内,属于运动目标像素点的运动矢量与之有较大差异,不在该邻域范围内。在连续两帧的时间间隔内,图像中背景的旋转运动可以近似用一个二维运动矢量V=[Vx,background,Vy,background]T表示,目标的运动与背景的运动有着明显的差异。在被检测图像中,尤其是较复杂地面背景情况下,提取出的图像特征点中大多数属于背景,只有少量特征点属于运动目标,因此对全体特征点的光流矢量求平均,以此作为背景运动矢量

(5)

式中:k为特征点序号,N为特征点总个数。

2.2 分块待检测图像

根据预计目标的实际尺寸L,载机高度H,摄像机视场角A,屏幕分辨率P,可以计算出目标在待检测图像中的尺寸

(6)

由于目标的实际尺寸L相对于载机高度H极小,式(6)可简化为

(7)

式中:L,A,P为预设参数,ST仅与载机高度H有关。

对图像分块时,分块尺寸SD为ST的向下取整值。为了使分块不至于过小,设定分块最小边长为5像素,即

(8)

2.3 特征点分类

为了判断目标区域,先要对图像特征点进行分类,筛选出其中属于运动目标的特征点,这些筛选出的特征点称为备选目标特征点。因为属于图像背景像素点的运动矢量落在背景运动矢量的一个邻域范围内,所以将背景运动矢量与各个特征点处的光流矢量相比较,二者的误差大于阈值Tv=[Tx,Ty]T的特征点认为是备选目标特征点,否则认为是背景特征点。

(9)

2.4 目标分块

为确定目标分块,先要构建一个二维分块表单Bm×n,其中

(10)

式中:W,H分别表示原图像的宽与高。基于特征点分类情况及其位置参数,计算表单中相应分块的备选目标特征点密度bp,q, 其中p= 1,2,…,m-1;q= 1,2,…,n-1。

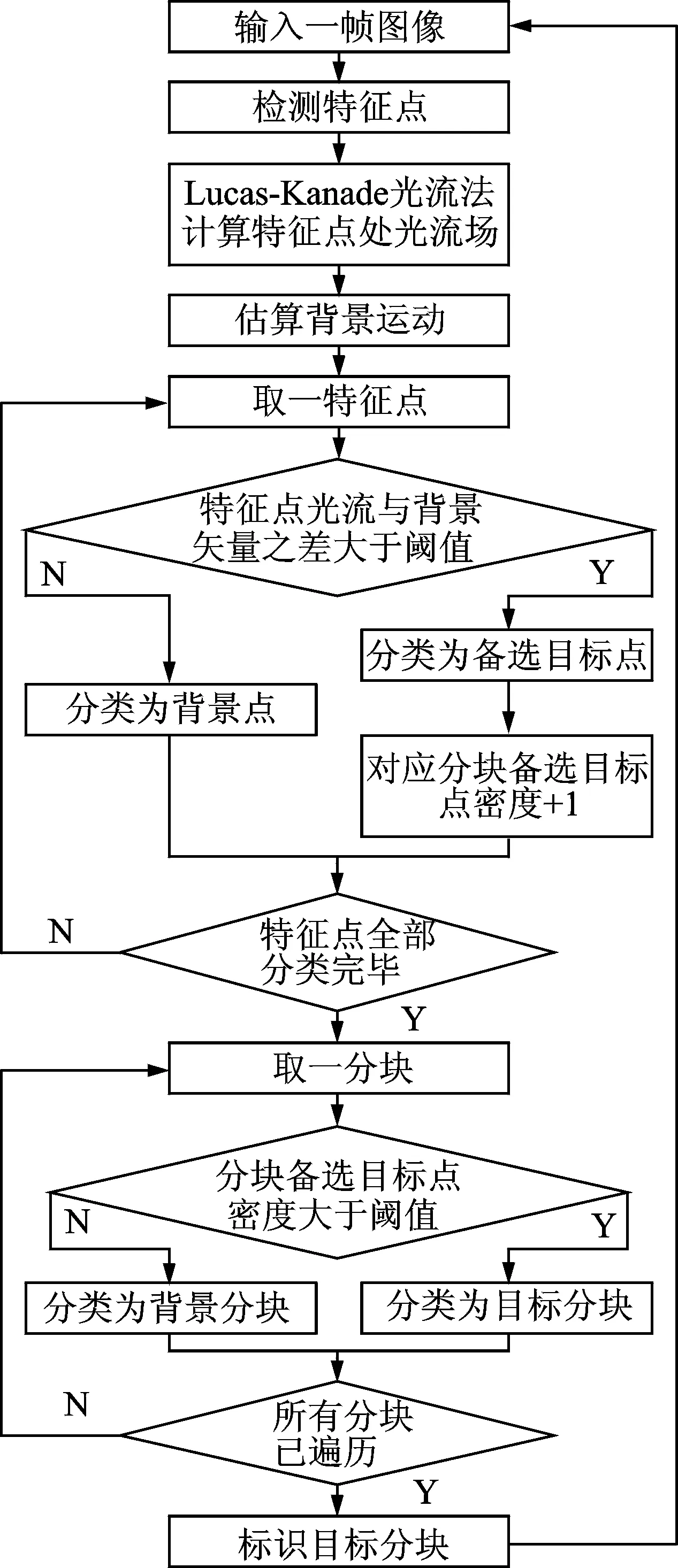

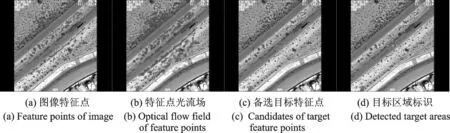

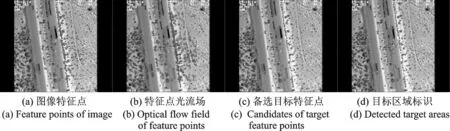

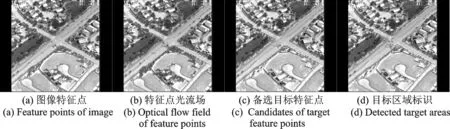

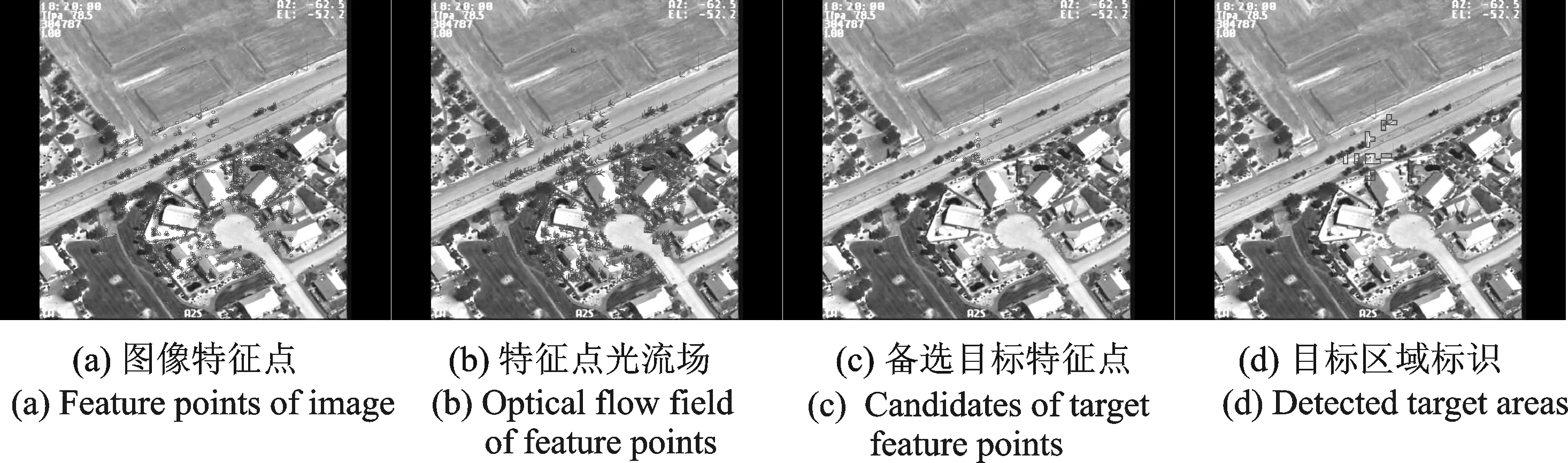

for (k=0;k { if (Pk,(i,j)==1) { p= floor(i/SD); q= floor(j/SD); bp,q+= 1; } } 然后比较分块表单中备选目标特征点密度bp,q及备选目标特征点密度阈值TB:若bp,q>TB,则该分块(p,q)分类为目标分块;否则将分块(p,q)分类为背景分块。最后在原图中用方框标识出目标分块所对应的图像区域,实现目标检测。 算法流程图如图1所示。 图1 改进光流法运动目标检测算法流程图Fig.1 Flow chart of improved optical flow object detection algorithm 用航拍视频图像做实验,验证了算法的性能,分析了算法的实时性。实验平台为Windows XP操作系统的PC机,使用VC6.0进行编程实现。图2~5是两组航拍视频图像的运动目标检测实验结果:图2为视频1的第167帧;图3为视频1的第766帧;图4为视频2的第198帧;图5为视频2的第799帧。两组航拍视频的图像分辨率都为720像素×576像素,因实验视频图像中的四边位置都叠加有文字信息,为去除这些叠加文字图像区域对目标检测算法造成的干扰,目标检测区域设定为视频图像中央的360像素×432像素区域。图中(a)为对输入图像进行特征点检测得到的图像特征点;(b)为对(a)中特征点处进行光流计算得到的图像特征点光流场;(c)为经筛选后的备选目标特征点;(d)为最终检测到的运动目标。从视频图像中的道路可以看出:视频1在600帧的时间内图像背景有了约60°的旋转,视频2在600帧的时间内图像背景也有约25°的旋转。本文算法去除了属于背景的特征点,保留了属于目标的特征点,在背景旋转时对运动目标进行检测。 图2 航拍视频1第167帧实验结果Fig.2 Experimental results from No. 167 frame of aerial video 1 图3 航拍视频1第766帧实验结果Fig.3 Experimental results from No. 766 frame of aerial video 1 图4 航拍视频2第198帧实验结果Fig.4 Experimental results from No. 198 frame of aerial video 2 图5 航拍视频2第799帧实验结果Fig.5 Experimental results from 799 frame of aerial video 2 视频1(842帧)中总计出现5 283个目标,检测目标4 838个,检测率91.58%;出现虚警目标120次,平均虚警率0.143次/帧;视频2(817帧)中总计出现1 342个目标,检测目标1 201个,检测率89.49%;出现虚警目标215次,平均虚警率0.263次/帧。在运动背景条件下,虚警出现次数只与背景复杂程度有关,视频2的城镇背景较视频1的郊外背景更加复杂,所以平均虚警率有所上升。视频1总计目标检测耗时24.805 s,平均每帧耗时29.460 ms;视频2总计目标检测耗时25.74 s,平均每帧耗时31.505 ms。本文提出的算法平均每帧耗时小于40 ms,能够满足战机对地运动目标检测对实时性的要求。 文献[11]中提出基于特征点的背景运动估计与补偿算法同样用于对航拍图像中运动目标的检测。该算法对2组尺寸为320像素×240像素80帧航拍灰度图像的处理时耗:第1组为5.91 s(平均每帧74 ms),第2组为6.13 s(平均每帧77 ms)。本文算法与之相比,能够在更大的检测区域中更快速地完成运动目标的检测。 本文提出了一种基于改进光流法的旋转运动背景下对地运动目标实时检测算法。实验结果表明该算法能够准确地检测出地面运动目标,虚警率低,并且具有很好的实时性。但是该算法仍有一些有待改进之处,如对于重型卡车这类超长型目标,检测为分离的2个目标区域,对灰度与背景变化不明显的目标难以检测出来。 [1] Kirchhof M, Stilla U. Detection of moving objects in airborne thermal videos [J]. ISPRS Journal of Photogrammetry & Remote Sensing, 2006, 61(3/4): 187-196. [2] 章毓晋. 计算机视觉教程 [M]. 北京: 人民邮电出版社, 2011: 198-200. Zhang Yujin. A course of computer vision [M]. Beijing: Posts & Telecom Press, 2011: 198-200. [3] Bruhn A, Weickert J. Lucas/Kanade meets Horn/Schunck: Combining local and global optic flow methods [J]. International Journal of Computer Vision, 2005, 61(3): 211-231. [4] Zhan Wei, Ji Xiaolong. Algorithm research on moving vehicles detection [J]. Procardia Engineering, 2011, 15: 5483-5487. [5] Royden C S, Moore K D. Use of speed cues in the detection of moving objects by moving observers [J]. Vision Research, 2012, 59(15): 17-24. [6] Bruhn A, Weickert J. Variational optical flow computation in real time [J]. IEEE Transactions on Image Processing, 2005, 14(5): 608-615. [7] 张水发,张文生,丁欢,等. 融合光流速度与背景建模的目标检测方法 [J]. 中国图象图形学报, 2011, 16(2): 236-243. Zhang Shuifa, Zhang Wensheng, Ding Huan, et al. Background modeling and object detecting based on optical flow velocity field [J]. Journal of Image and Graphics, 2011, 16(2): 236-243. [8] Li Ning, Zhou Jianjiang, Zhang Xingxing. Moving object tracking in dynamic image sequence based on estimation of motion vectors of feature points [J]. Transactions of Nanjing University of Aeronautics & Astronautics, 2009, 26(4): 295-300. [9] 闫钧华,朱智超,孙思佳,等. 基于多尺度红外与可见光图像配准研究 [J]. 激光与红外, 2013, 43(3): 327-333. Yan Junhua, Zhu Zhichao, Sun Sijia, et al. Research on infrared and visible image registration based on multi-scale [J]. Laser & Infrared, 2013, 43(3): 327-333. [10]王传旭,董晨晨. 基于时空特征点的群体异常行为检测算法 [J]. 数据采集与处理, 2012, 27(4): 422-428. Wang Chuanxu, Dong Chenchen. Abnormal crowded behavior detection algorithm based on spatial temporal interesting points [J]. Journal of Data Acquisition and Processing, 2012, 27(4): 422-428. [11]刘振华, 黎宁, 贾亮. 改进的航拍图像序列背景运动补偿技术 [J]. 计算机工程, 2009, 35(2): 222-224. Liu Zhenhua, Li Ning, Jia Liang. Improved background motion compensation technique in aerial image sequence [J]. Computer Engineering, 2009, 35(2): 222-224. Real-Time Ground Moving Object Detection in Rotational Background Based on Improved Optical Flow Method Chu Linzhen, Yan Junhua, Hang Yiqing, Xu Junfeng (College of Astronautics, Nanjing University of Aeronautics & Astronautics, Nanjing, 210016, China) To solve the problem of high false alarm and low real-time for aerial video with rotational ground background in moving object detection, a real-time algorithm based on optical flow method is proposed. The image feature points are detected first, the optical flows are calculated, and the motion vector of the image background is estimated through optical flow field. Then the target size is calculated according to the flight height and the image is divided into blocks. Each feature point optical flow is compared with the motion vector of the image background to find out the candidates of the target feature point.Finally the candidates is added up in each block and the target areas are determined. Moving objects detection experiment is achieved for 360 pix×432 pix central area of two groups of experiment video. The result indicates that the algorithm can exactly detect the ground moving object with a low false alarm. The average consuming time is 29.460 ms/frame and 31.505 ms/frame, thus satisfying the real-time requirements. improved optical flow method; ground background; rotational motion; object detection; video image 国家自然科学基金(41101441)资助项目;南京航空航天大学基本科研业务费专项科研项目(NN2012083,NS2010214,NP2011048)资助项目。 2014-04-29; 2014-09-15 TP391.41 A 储林臻(1989-),男,硕士研究生,研究方向:目标检测与跟踪,E-mail:chulinzhen@163.com。 闫钧华(1972-),女,副教授,研究方向:多源信息融合,目标检测和跟踪与识别。 杭谊青(1990-),女,硕士研究生,研究方向:目标检测与跟踪。 许俊峰(1989-),男,硕士研究生,研究方向:目标检测与识别。3 改进光流法运动目标检测算法流程

4 实验结果及分析

5 结束语