基于图割的闪光夜景人像自动分割方法①

刘德建

摘 要:图像前景分割作为目标检测、图像融合的关键步骤,是当前图像处理与计算机视觉领域的研究热点。特别是在普通相机拍摄的夜景人像中,由于闪光的原因导致人像与背景的可视效果欠佳,分割算法存在极大挑战。为此,该文面向同步获取的闪光与非闪光图像,提出了一种基于人像检测和多源信息融合的人像分割方法。该算法首先采用梯度直方图特征(Histogram of Gradient, HOG)作为表观描述,通过支撑向量机(Support Vector Machine, SVM)实现夜景行人检测。在此基础上,根据两类图像的变化统计特征设计了代价函数,具体包括闪光图像变化分布、颜色信息,以及匹配变换估计信息等。最后利用图割方法(Graph Cut, GC)实现代价函数最优求解,并以此为依据提取夜景人像。针对多组夜景人像的分割实验结果表明,该文方法减少了传统人像分割算法的交互过程,可以实现对夜景人像区域的自动提取。

关键词:图像分割 夜景图像 图割

中图分类号:TP37 文献标识码:A 文章编号:1674-098X(2015)08(a)-0096-05

图像分割与融合是计算机视觉与图像处理领域的研究热点,特别是面向人像的前景分割,在目标检测、目标识别、图像融合等相关技术中有十分广泛的应用。其关键技术涉及到人体的定位,以及前景和背景的分离等。由于人体图像具有尺度差异大、纹理复杂、姿态变化多等特点,要从复杂背景中分离出人像信息是十分挑战的课题。特别利用家用低成本相机拍摄的夜景图像,因背景光源复杂,且在闪光拍摄的图像中前景边缘与背景信息容易交互干扰,使得现有的算法难以从这里图像中有效地分割人像区域。

目前人像分割方法大致可以分为人工交互分割与全自动分割等两类,其中人工交互分割一般是基于图割(Graph cut, GC)算法[1],通过手工标记的方式,在人像周围指定背景与前景信息,进而通过构建能量图及边切割,实现背景与前景的分离。基于Grab cut方法[2]则是在选定前景框内,通过分析背景区域与前景框内的分布信息,实现前景目标的分割。实验结果表明,基于图割的算法运算速度较快,分割效率较好,特别对复杂的背景边缘有较好的适用性,得到了广泛的关注,目前市场上已有相关的产品[3]。尽管如此,这类方法在分割过程中需要人工干预,而且在夜景人像边缘模糊的情况下分割效果不佳。

前景的自动分割主要包括基于立体视觉[4]、运动信息[5]和背景建模[6-7]的方法。其中基于立体视觉的方法通过分析视差来判别前景区域。这类方法往往对分割目标的视差范围有一定限制,视差太小前景和背景难以分离,视差过大则场景中存在大量遮挡和零匹配现象,导致分割可靠性不足;基于背景建模的目标分割方法需要利用先验信息对背景进行建模,通常是在视频或序列图像的基础上,分析场景的变化信息,以构建背景模型。此外,在图像前景自动分割中,Sun提出了以闪光/非闪光图像为数据源的抠图方法[8-9]。前提是对场景分别进行闪光/非闪光两次拍摄,在闪光灯开启时,由于前景物体较为靠前因此受闪光影响较大,对应图像更加明亮(强度更高);而没有闪光灯时,前背景的亮度区别较小,从而可以通过亮度对比信息提取前景区域。在相关后续工作[10]中,Sun将该方法拓展为Flash cut算法,实现了前景和背景的协同分割。其基本思路是根据闪光与非闪光图像的差异,分析前景与背景的统计模型,最后通过图割方法实现前景信息的分割。Flash cut提出后,得到了广泛的关注,其中文[11]将闪光-非闪光图构建的前景信息推广到图像的显著分析,取得良好的检测效果。

在简单背景下,现有的分割算法对人像交互分割与融合方面已经取得了较好的效果。然而,针对夜景的人像提取效果仍效果不佳,特别是当背景光源信息复杂,以及前景边缘和背景混合的时候,分割算法基本失效。为此,该文在闪光、非闪光图像的基础上,采用了检测+分割的思路,首先根据梯度直方图特征在非闪光夜景图像中检测人像方位;进而根据同步获取的闪光、非闪光图像差异分布,在人像候选区域统计差分直方图,并通过构建代价函数、分割能量图实现人像的分割。

该文余下内容安排如下:第二章介绍梯度直方图的计算方法,以及在夜景人像检测中的应用;第三章详细阐述基于闪光、非闪光图像的夜景人像分割算法流程;第四章通过实验分析本文算法的可靠性;第五章为论文总结。

1 基于梯度直方图的夜景人像检测

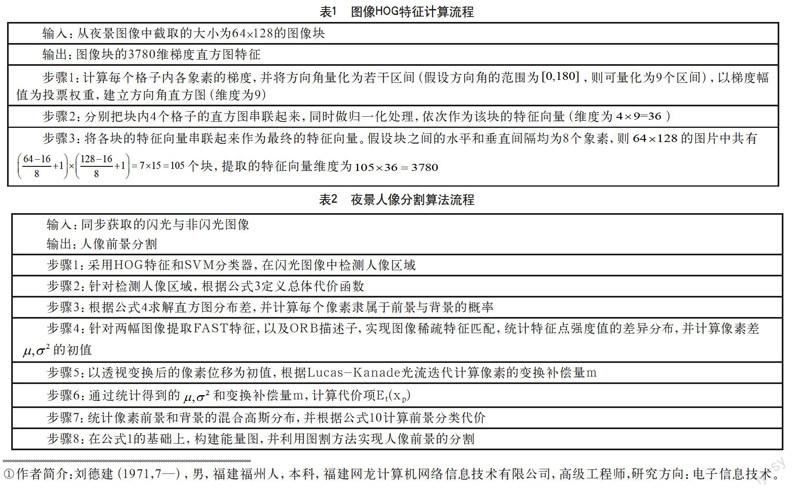

夜景人像检测的目的是确定分割的候选区域,避免背景复杂光源,以及背景运动目标等因素对分割效果的影响。针对夜景人像的特点,本文采用了基于梯度直方图(Histogram of Oriented Gradient,HOG)[12]与支撑向量机相结合的检测方法,以实现夜景人像的检测。HOG是目前最为广泛使用的行人特征表示方法之一,其主要思想是通过图像局部区域的梯度特征统计来增强判别性能。HOG特征的具体计算过程如算法1所示,其中行人图片大小为64×128,块(Block)大小为16×16,格子(cell)大小为8×8,每个块内包含4个格子,格子是计算HOG的最基本单元(如表1所示)。

根据文[12]实验设置的推荐,以及夜景图像特点,本文采用以下的设置以提高HOG的判别性能:(1)梯度计算时采用的掩膜为[-1 0 1]和[-1 0 1]T;(2)投票的时候方向角和空间位置进行线性插值,即三线性插值;(3)块内的每个象素在投票的时候进行高斯加权;(4)对块的特征向量进行归一化处理。

梯度直方图特征具有高维特点,需采用高效的分类器以实现特征的判别。由于支撑向量机(Support Vector Machine,SVM) 是建立在统计学习的VC 维理论和结构风险最小原理基础上的,它在解决小样本、非线性及高维模式识别中独具优势。为此,本文采用SVM作为夜景人像判别分类器。

2 基于闪光图像的夜景人像分割

在人像区域检测基础上,可利用闪光与非闪光图像的对比统计信息,以提高人像分割的效果。为此,本文首先根据二值分类定义了前景分割的能量函数,并针对能量函数中的数据项与平滑项展开分析。特别是数据项的设计,融入了闪光变化特点、颜色信息,以及匹配变换估计信息等。以下将分别介绍能量函数的构造以及数据项的具体计算流程。

2.1 总体代价函数

为实现前景与背景的分类,本文定义代价函数如公式1所示:

(1)

其中xp表示像素p的背景标签,即当且仅当p为背景时,xp=1,否则xp=0;Ed为数据项,表示像素p分类为xp的代价;Es为平滑项,主要用于惩罚相邻像素p,q的分类xp与xq不一致,目的减少噪声干扰,保证分割结果的平滑性;α是权衡数据项与平滑项的权重。当公式1达到最小值时,对应的前景信息为人像分类结果。

为了减少相邻像素的分类差异,定义平滑项Es如下:

(2)

其中用于调节相邻点灰度差对分类的影响。

根据夜景人像特点,设计数据项如下:

(3)

其中分别用于衡量前景分类代价、闪光与非闪光图像之间的运动差异,以及颜色信息差异,其计算方法将分别在2.2~2.4中阐述;为的权重。

2.2 基于直方图对比的前景分类代价

在公式3中,用于衡量闪光与非闪光图像中,像素直方图的变化情况。主要思路是通过对比分析闪光图像与无闪光图像的直方图信息来进行建模。如果是离摄像头比较远的物体,则受闪光的影响比较小;如果是离摄像头比较近的前景物体,则受闪光的影响比较大。因此通过分析闪光前后,直方图的变化情况,对象素点与前景之间的隶属度进行赋值。假设和分别表示闪光图像和无闪光图像的颜色直方图。若,则说明闪光之后,第k个直方图区间的象数点数目变少,也就是第k个直方图区间的部分象数点被分配到了的其他区间(具体是哪个区间不知道);若,则说明闪光之后,第k个直方图区间的象数点数目变多,说明的其他区间(具体是哪个区间不知道)上的象数点部分被分配到了直方图的第k个区间。综上,可定义代价项如下:

(4)

其中闪光和非闪光图像的rp分别取值为和。

2.3 变换补偿

公式3中的Et(xp)用于衡量闪光与非闪光图像中,对应同名点之间的像素差异。假设已经知道了闪光前和闪光后两张图像之间的位移信息m(p)。那么对于闪光前的图像而言,如果象数点的亮度信息变大了,那么是前景的概率应该相应增加。闪光前后的亮度信息差异可以用如下公式表示:

(5)

一般认为,背景的像素点亮度变化较小。因此,可以用一个高斯分布来表述亮度差异信息,即,。像素点p属于背景的概率可以用如下公式刻画,

(6)

可以看出,当时,。综上,能量项Et(xp)的可定义如下:

(7)

上式中未知的参数是。首先,可通过稀疏特征匹配来计算特征点的亮度差异信息,以差异直方图均值作为μ的初值。则可以在直方图中截取亮度差异小于某个阈值T的所有点统计得到,其中T取值为大于μ的首个局部极小点。由于同步采集的两幅图像之间尺度、角度基本一致,为提高分割效率,本文采用FAST算子[14]进行特征提取,利用ORB描述子[15]实现稀疏特征匹配,并采用RANSAC算法[16]去除错误匹配特征。

偏移量m的初值可以根据RANSAC获取的变换结构,计算像素稠密匹配来得到。由于两幅图像同步获取,且人像前景景深差异小,因此本文采用透视变换来作为像素位移初值的计算依据。在此基础上,利用光流中改进的Lucas-Kanade算法[17]来迭代计算稠密的像素变换补偿参数,具体如公式8所示:

(8)

2.4 基于混合高斯模型的前景分类代价

在公式3中,用于衡量前景信息的概率。在上述求解到的前景和背景概率的基础上,挑选出所有背景概率小于0.4的点,用于构造前景混合高斯分布[13]。具体计算方法如公式9所示:

(9)

其中K是混合高斯模型的模型数量;wk是各个模型的权重;uk,∑k分别表示第k个模型的均值与协方差。同理,计算背景混合高斯分布可以挑选所有背景概率超过0.6的像素,通过文[13]的方法统计得到。在此基础上,前景分类代价可以表示为:

(10)

2.5 算法流程

根据2.1~2.3的计算规则,本文总体算法流程如算法2所示(如表2所示)。

3 实验结果与分析

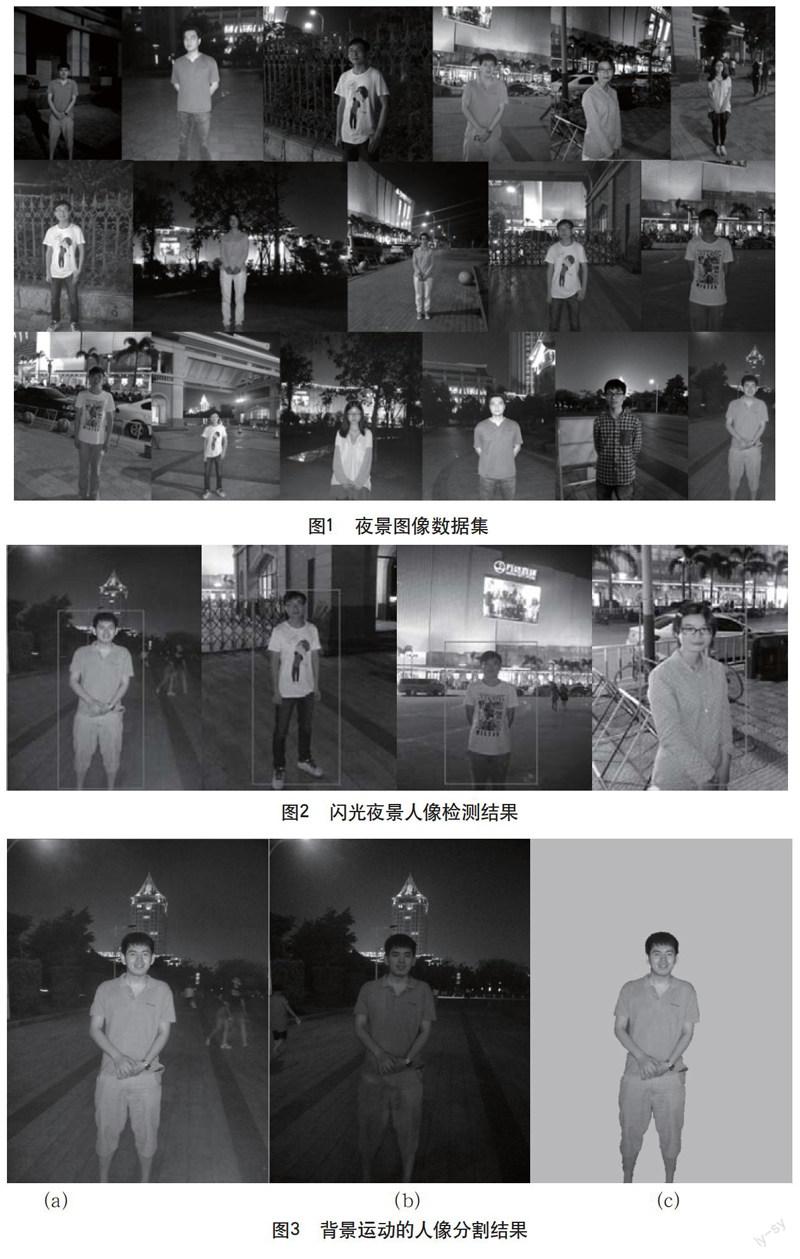

实验的目的是测试本文方法对夜景人像分割的效果。为此,本文根据实验需求采集了序列夜景图像集,其中包含背景运动干扰、背景复杂光源(夜景工程)、前景纹理变化(衣着差异)等多个不同类别,部分数据如图1所示。以下将详细描述实验的设置,以及结果分析。

3.1 实验设置

在夜景人像检测模块,HOG特征为3780维,梯度计算时采用的掩膜为[-1 0 1]和[-1 0 1]T;投票采用三线性插值。在代价函数模块,公式1中的权重α取值为30;考虑到夜景图像的闪光与非闪光图像中,像素变化十分强烈,导致部分背景隶属于前景概率也相应提升,因此应适当降低了直方图前景分布代价的权重,公式3中的数据项权重分别为5,15;公式4中的ζ=0.2;在颜色项中,混合高斯模型的数量取值为10。

3.2 结果与分析

第一组实验主要评价夜景图像的人像检测效果。由于本文的目标是自动分割出闪光图像的人像,因此只需在闪光图像中检测行人区域。图2中的背景包括复杂光源、运动目标、前景边缘与背景强度差异小等干扰因素。由于夜景人像往往背景强度相对较弱,相比之下,前景的强度、纹理特征丰富。从实验结果可以看出,采用HOG特征可以充分描述人像的表观模型,因此SVM分类器能有效提取图像中的行人区域。

第二组实验主要评价本文的图割算法对于夜景人像的分割效果。针对背景运动、局部遮挡、复杂背景等因素对分割效果的影响,我们分别选取了图3-图6用于分析分割效果。如图3(a)(b)(c)分别为闪光图像、非闪光图像、人像分割结果。从图3(a)和图3(b)中可以看出,背景存在运动目标。由于背景中的人像强度信息(光线)较弱,纹理受噪声干扰明显,因此行人检测器没有响应背景人像。而本文的算法只针对人像区域分析,因此可以有效过滤背景运动对分割效果的影响。在图4中,前景包含了部分背景信息(手臂下方),由于本文通过像素分布设置了背景概率统计信息。因此,在前景背景混合的情况下,构建的能量图能给定前景和背景不同的权重,从而利用图割算法可以有效地分割出人像区域,具体如图4(c)所示。

图5和图6用于评价复杂背景对于人像分割的影响。从图5(a)可以看出,人像上半部分的背景强度信息与人像信息接近,因此该区域的前景概率容易混淆。从实验结果也可以看出,人像下半身的背景区域纹理简单,有较好的分割效果,但是上半部分特别是肩膀附近,存在一定的错分割现象。图6的结果也印证了上述结论,即前景边缘与背景差异很小的时候,构造出的能量图相应的边权值也相应较小,导致分割后的边缘存在锯齿现象。

4 结语

目前的夜景人像分割大多是采用交互的方式提取人像外轮廓,在背景光源复杂的情况下需要大量的人工干涉。本文针对夜景人像的自动分割问题,利用同步获取的闪光和非闪光图像之间的差异,分析前景的概率分布信息。基本流程包括利用直方图特征实现人像区域检测、基于闪光图像变化分布和变换补偿的代价函数构造,以及利用图割实现人像提取等。实验结果表明本文的方法有效增强了分割的自动化程度,特别是增加了人像检测后,在背景光源复杂以及背景变化的情况下有较好的分割效果。预计相关成果在夜景图像融合中有一定的推广价值。

参考文献

[1]Boykov Y Y, Jolly M P. Interactive graph cuts for optimal boundary & region segmentation of objects in ND images[C]//Computer Vision,2001.ICCV 2001.Proceedings.Eighth IEEE International Conference on.IEEE, 2001:105-112.

[2]Rother C,Kolmogorov V, Blake A. Grabcut:Interactive foreground extraction using iterated graph cuts[J].ACM Transactions on Graphics(TOG),2004,23(3):309-314.

[3]沈洋,林晓,谢志峰,等.交互式前景抠图技术综述[J].计算机辅助设计与图形学学报,2014,26(4):511-519.

[4]Torr P H S,Szeliski R, Anandan P.An integrated Bayesian approach to layer extraction from image sequences[J].Pattern Analysis and Machine Intelligence,IEEE Transactions on,2001,23(3):297-303.

[5]Sun J,Zhang W,Tang X,et al. Background cut[C]//Computer Vision–ECCV 2006.Springer Berlin Heidelberg,2006:628-641.

[6]Mittal A,Paragios N.Motion-based background subtraction using adaptive kernel density estimation[C]//Computer Vision and Pattern Recognition, 2004.CVPR 2004.Proceedings of the 2004 IEEE Computer Society Conference on.IEEE,2004:II-302-II-309 Vol.2.

[7]Monnet A,Mittal A, Paragios N,et al.Background modeling and subtraction of dynamic scenes[C]//Computer Vision,2003.Proceedings.Ninth IEEE International Conference on. IEEE,2003:1305-1312.

[8]J.Sun,Y.Li,S.B.Kang,et al .Flash matting[M].In Proceedings of SIGGRAPH,2006:361-366.

[9]Sun J,Li Y,Kang S B,et al. Flash matting[J].ACM Transactions on Graphics(TOG),2006,25(3):772-778.

[10]Sun J,Kang S B,Xu Z B,et al.Flash cut:Foreground extraction with flash and no-flash image pairs[C]//Computer Vision and Pattern Recognition,2007.CVPR07.IEEE Conference on.IEEE,2007:1-8.

[11]He S,Lau R W H.Saliency Detection with Flash and No-flash Image Pairs[C]//Computer Vision–ECCV 2014.Springer International Publishing,2014:110-124.

[12]Dalal N,Triggs B.Histograms of oriented gradients for human detection[C]//Computer Vision and Pattern Recognition,2005.CVPR 2005.IEEE Computer Society Conference on.IEEE,2005:886-893.

[13]Blake A,Rother C,Brown M,et al.Interactive image segmentation using an adaptive GMMRF model[C]//Computer Vision ECCV 2004.Springer Berlin Heidelberg,2004:428-441.

[14]Rosten E,Drummond T.Machine learning for high-speed corner detection[C]//Computer Vision–ECCV 2006.Springer Berlin Heidelberg,2006:430-443.

[15]Rublee E,Rabaud V,Konolige K,et al.ORB:an efficient alternative to sift or surf[C]//Computer Vision(ICCV),2011 IEEE International Conference on.IEEE,2011:2564-2571.

[16]Fischler M A,Bolles R C.Random sample consensus:a paradigm for model fitting with applications to image analysis and automated cartography[J].Communications of the ACM,1981,24(6):381-395.

[17]Bruhn A,Weickert J,Schn?rr C.Lucas/Kanade meets Horn/Schunck:Combining local and global optic flow methods[J].International Journal of Computer Vision,2005,61(3):211-231.