低曝光条件下遥感相机微振动量检测

乐国庆,郭永飞,刘春香,马天波,石俊霞

(中国科学院 长春光学精密机械与物理研究所,吉林 长春 130033;2.中国科学院大学,北京 100049)

低曝光条件下遥感相机微振动量检测

乐国庆1,2,郭永飞1*,刘春香1,马天波1,石俊霞1

(中国科学院 长春光学精密机械与物理研究所,吉林 长春 130033;2.中国科学院大学,北京 100049)

针对搭载平台颤振对遥感相机成像的影响,利用辅助高速面阵CCD相机拍摄高帧频图像序列,通过像元合并来补偿曝光时间不足,增加图像的亮度、对比度和信噪比,同时结合一种区域选择算法来选择用于计算的图像区域,最后使用灰度投影算法对振动位移量进行估计。实验数据表明,提出的改进算法误差为一个像元,在准确性和稳定性方面均明显优于原始算法。

遥感相机;微振动检测;运动估计;灰度投影算法

1 引言

自从航空航天光学遥感出现以后,由于科研、生产和生活的需要,人类对遥感图像的要求越来越高,光学遥感技术在不断向前发展。一方面是对遥感图像获取的实时性追求,从而传感器从原始的胶片变成了现在的电荷耦合器件(Charge Coupled Devices,CCD);另一方面对遥感图像高分辨率和高质量的追求,从而时间延迟积分(Time Delayed Integration,TDI)CCD逐渐取代了面阵CCD。

航空航天光学遥感相机有两大特点:一是成像时相机与目标存在相对运动;二是相机的光学镜头焦距要求尽量短,以便减小相机重量和体积,但这样会造成收集的光能量小。TDI-CCD正好能够弥补以上两点。因为TDI-CCD是一种光电传感器,可以通过控制电荷包的转移来跟踪目标的移动,进而对同一目标多次曝光、延迟积分成像,因此它具有响应度高、动态范围大的优点,即使在光线较暗的情况下也能获取清晰的图像[1]。

然而在实际成像过程中,由于搭载平台(卫星或飞机)的振动,例如卫星受太阳能帆板伸展和卫星本身的调姿影响而振动,飞机受发动机振动和气流影响而振动,得到的图像将会有不同程度的畸变和失真。尤其是TDI-CCD相机所拍摄的图像[2],每行图像在延迟积分期间所经历的振动都有所不同[3-4],其失真更加不能忍受。

因此,有必要获取拍摄过程中相机振动的信息。通过增加一台辅助的高速面阵CCD相机,以高于主相机帧频的速度连续拍摄多帧图像[5],运用相应的运动估计算法估计出相邻帧图像之间相对位移,那么这相当于对相机的振动曲线进行采样,当采样到足够多的数据之后可以拟合出相机振动的曲线,而根据振动曲线又可以推导出图像振动模糊的模糊核(即点扩散函数PSF)[6-7],以便为后续地面图像恢复算法提供确切的信息。文献[6-9]运用了包括灰度法和频谱法在内的PSF估计,但均考虑的是正常曝光条件下因而不适用于极短曝光时间条件下的估计。

本文首先介绍灰度投影算法估计位移量的详细过程,然后说明直接利用灰度投影算法对曝光时间极短的图像序列进行估计所存在的问题,进而对存在问题进行分析说明,并提出了结合像元合并和区域选择的改进算法,最后通过实验获取算法改进前后的数据并进行对比分析。

2 直接灰度投影算法

运动估计主要分为两类:基于特征[11-12]的(feature-based)和基于灰度的(intensity-based)估计。基于特征的运动估计由于相对不易于硬件实现,因而在此不讨论。基于灰度的运动估计方法中,使用比较多的有块匹配算法[13](Block Matching Algorithm)和灰度投影算法[14](Gray Projection Algorithm),其中块匹配算法主要应用于视频压缩编码,而灰度投影法在电子稳像中应用较多[10]。

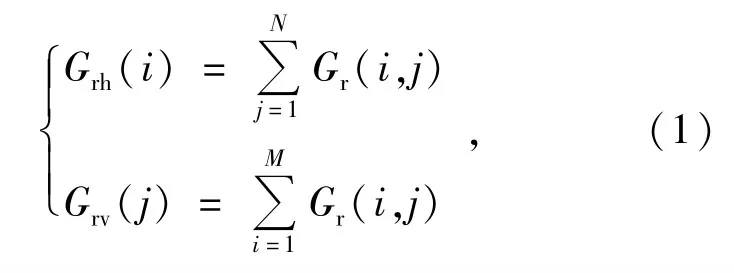

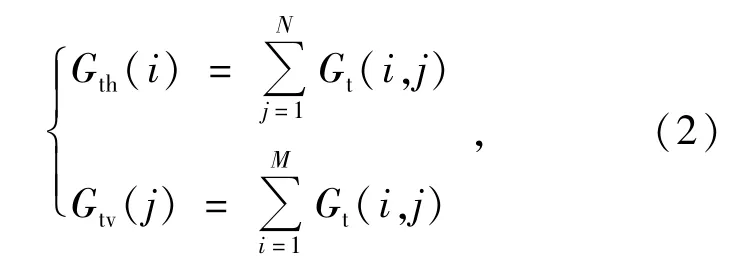

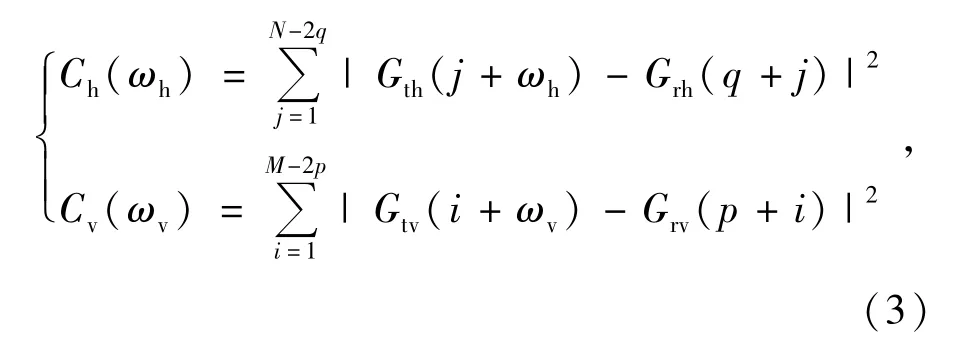

灰度投影算法将二维图像分别在垂直和水平方向上进行灰度投影,得到两个一维的向量,然后将相邻帧之间的对应水平和垂直向量分别进行相关操作,其数学表达如下:(设图像的尺寸为M× N,垂直和水平方向的搜索宽带分别为p和q)。

参考帧灰度投影:

式中:Grh(i)和Grv(j)分别为参考帧的水平和垂直灰度投影。

目标帧灰度投影:

式中:Gth(i)和Gtv(j)分别为目标帧的水平和垂直灰度投影。

两帧投影向量相关:

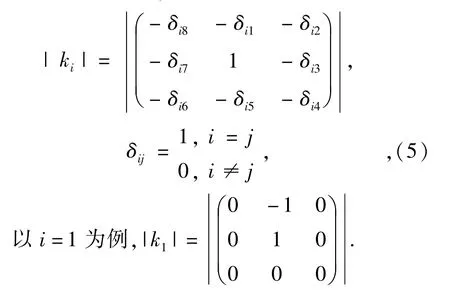

式中,ωh和ωv分别在区间[0,2q]和[0,2p]取值,如果使得Ch和Cv最小的ωh和ωv的值分别为ωhmin和ωvmin,那么目标帧相对参考帧在水平和垂直方向的位移为:

3 针对低曝光条件的改进

在TDI-CCD遥感相机中,由于其行积分周期极短,因此辅助面阵CCD相机的积分时间也必须足够短才能捕捉到不同行之间相机的振动位置,所以其拍摄到的图片由于曝光严重不足而呈现出3个特点:低亮度、低对比度和低信噪比。

如果直接将在此条件下获取的原始图像应用于运动估计,那么由于其高分辨率和低信噪比的特性,将会导致估计的运算量巨大且精度较差。

3.1 像元合并

CCD面阵相机中有一种工作方式可以采用像元合并,即在成像过程中,不直接将每一个像元的电荷包单独转移读出,而是将与其相邻的数个像元的电荷包合并作为一个像元读出,合并过程如图1所示,4个14 μm×14 μm的小像元合并为一个28 μm×28 μm的大像元。这样做的好处有:一是提高相机灵敏度和信噪比并且扩大动态范围,每个像元的读出值将扩大数倍,后续处理电路中混入的加性噪声影响将更小,获取的图像将具有更高的信噪比和更高的对比度;二是合并的像元包含更大区域的信息,所以对于相同分辨率的图像,像元合并输出的图像比原始图像包含更多的全局信息,这对提高灰度投影算法准确性具有重要的作用;三是采用像元合并方式后,相机摄像的帧频将提高数倍,即相邻图像帧之间的时间间隔将更短,对相机振动的捕获将更加精细。

图1 2×2像元合并Fig.1 2×2 pixeles binning

3.2 分块区域选择算法

辅助相机拍摄的图像往往具有较大的尺寸,设其大小为M×M,在整幅图像区域中,有的区域灰度变化明显,层次较为分明所以适合于运动估计,而另一些区域灰度特征不明显因而会导致估计出的运动矢量误差较大。因此,将整幅图像按阵列划分为诺干个子区域,其大小为N×N,那么在整幅图像中有(M/N)×(M/N)个子区域。为了提高估计精度同时减少运算量,需要研究如何从中选择出一个合适的区域。

本文提出一种新的有效算法来度量图像不同子区域灰度特征的强弱,并选取其中特征最强的区域用于振动量的估计。其具体步骤如下:

(1)使用一阶插值将参考帧图像各子区域缩小为原尺寸的1/(S×S)大小,即参考帧中每个S×S大小的图像块(称为宏块)求算术平均,得到一张尺寸为(N/S)×(N/S)的低分辨率图像。该步骤可以与图像采集存储同步进行,因此不会占用后续处理的时间。

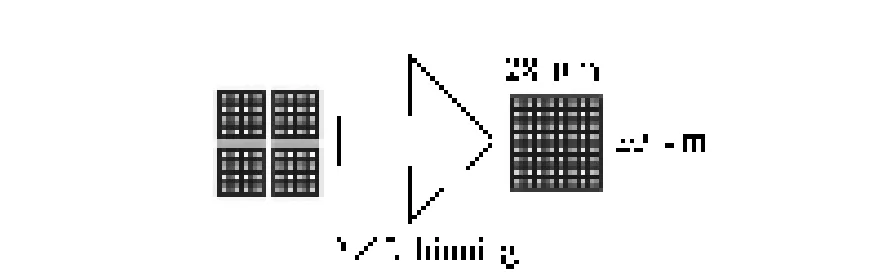

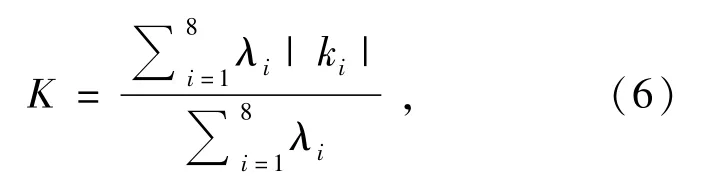

(2)构造算子|ki|,(i=1,2,…8):

将这8个算子加权平均得到最终的算子K:

式中,绝对值含义为取像素差值的绝对值。

图2 3×3像素区域Fig.2 3×3 pixeles area

使用算子K对图2进行空间滤波的计算,像素点p22处滤波后的值为:

通过改变λi的值可以强调特定方向的灰度特征,例如增大λ1和λ5可以筛选出垂直方向上灰度层次明显的子区域,而增大λ3和λ7可以筛选出水平方向上灰度特征明显的子区域。

(3)利用步骤(2)构造的算子K对步骤1得到的各子区域低分辨率图像进行空间滤波,得到表征各子区域灰度特征强弱的图像。

(4)将步骤(3)得到的表征各子区域灰度特征强弱的图像求平均值,其中平均值最大的子区域即为筛选出的区域。

为了量化图像灰度特征的强弱,步骤(1)首先显著的降低了图像的分辨率,同时有效的抑制了高频噪声,因此相较于SAD法不但可以大大降低运算量,而且提高了度量的准确性。宏块的尺寸如果选择过大,则各子区域的灰度特征强弱差异则会趋于变小,而如果选择过小则易受噪声影响。步骤(2)构造的带绝对值的算子K用于计算每一宏块与其八邻域宏块的平均灰度差异,每个子区域内的平均灰度差异即可有效表征该区域的灰度特征强弱。

本算法有效量化了图像不同区域的灰度特征强弱,按照该选择算法筛选出所有子区域中灰度特征最明显的子区域,将参考帧和目标帧中对应的子区域用于灰度投影算法估算出局部相对位移矢量,并将其作为全局位移矢量的估计。

4 实验结果与分析

用于实验的数据为全色8位遥感图像,灰度级数为256,假定水平方向向右为正,垂直方向向下为正。

4.1 像元合并实验

遥感相机的传感器为TDI-CCD,它的积分级数一般可达数十级,所以其输出的图像是经过数十次曝光而形成的;而辅助相机的传感器为面阵CCD,输出的单帧图像仅为一次曝光而形成,因而其灰度通常仅为主相机输出的几十分之一,在后续处理电路中混入噪声之后,其亮度、对比度和信噪比较低,如图3所示。

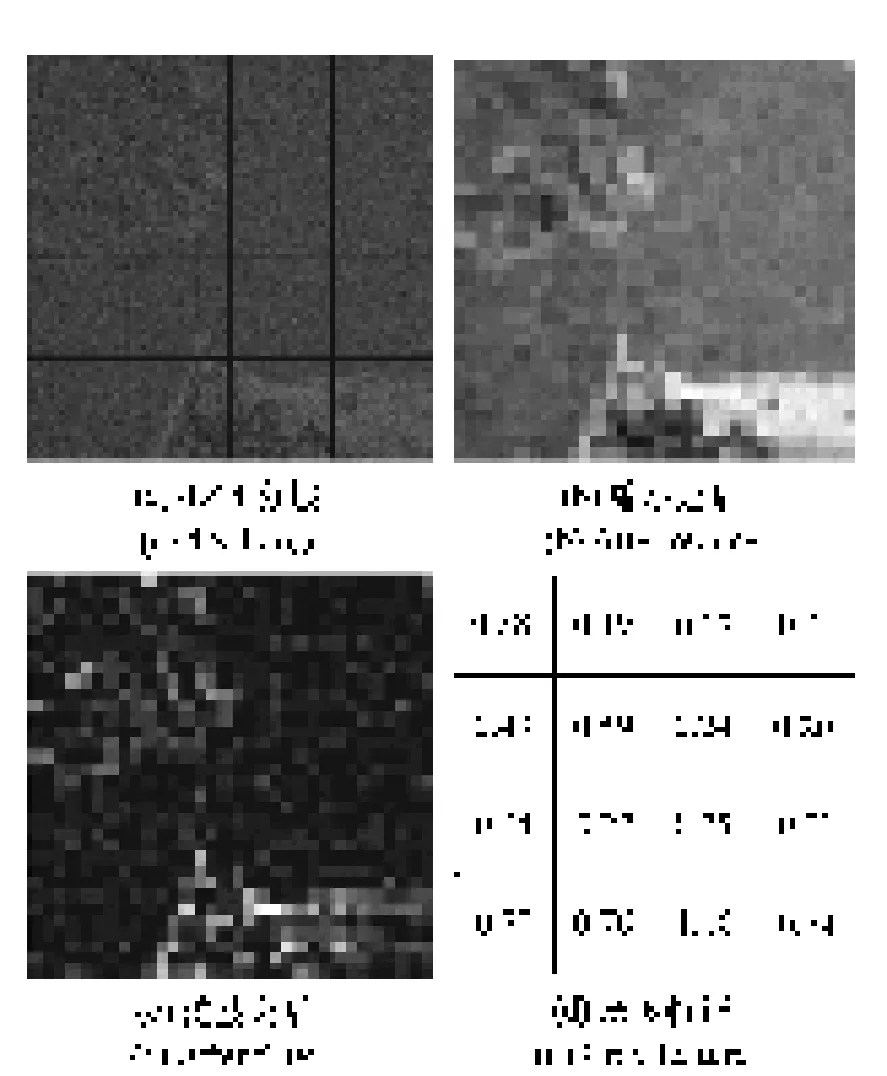

图3 像元合并前后图像Fig.3 Image before and after binning

其中,图3(a)为非像元合并模式下的一帧图像,分辨率为1 024×1 024,该帧与下一帧之间的相对位移矢量为(10,14);图3(b)为2×2像元合并模式下的一帧图像,分辨率为512×512,该帧与下一帧之间的相对位移矢量为(5,7)。

用实验来验证使用灰度投影算法时,像元合并后的图像相比合并前的图像能获得更准确、更稳定的估计。

首先选择原始图像相邻两帧的左上角1/4部分512×512大小的子区域用于灰度投影算法。

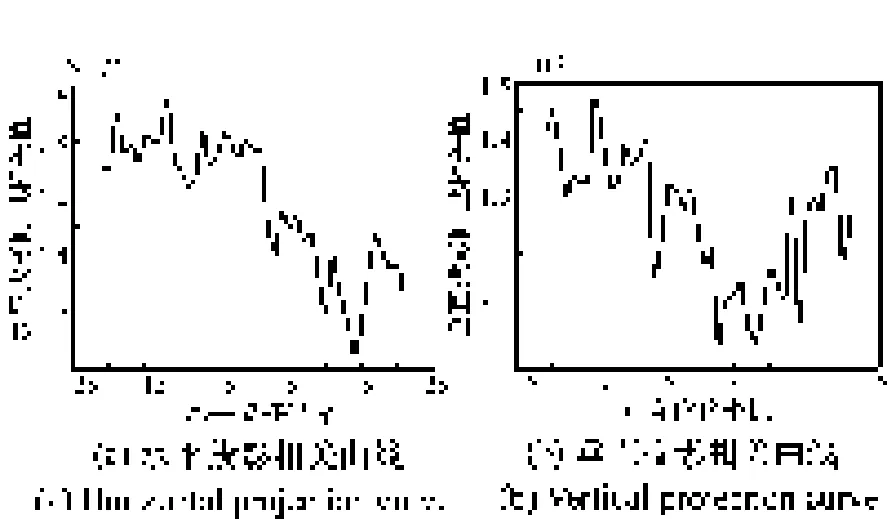

图4 参考帧与目标帧图像AFig.4 Images A of reference frame and target frame

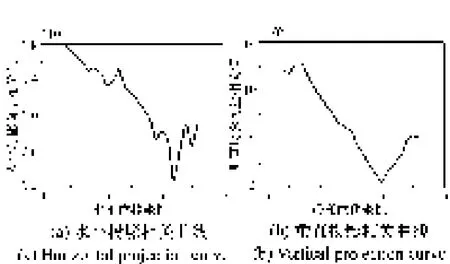

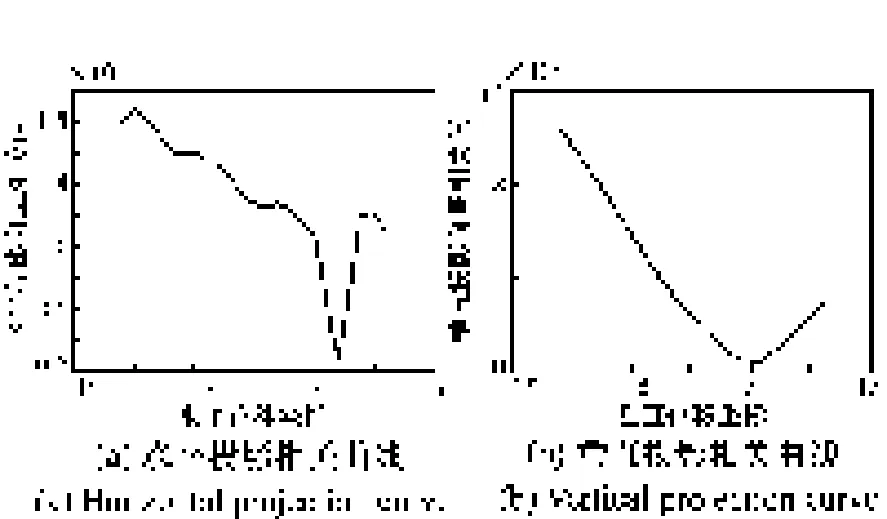

对图4两帧图像使用灰度投影算法,得到水平和垂直方向的灰度投影相关曲线,如图5所示。

从投影曲线可以得出估计出的位移向量为(3,14),与真实位移(10,14)相差甚远,且相关曲线震荡剧烈,尤其是垂直方向,可见其准确性和稳定性均很低。

图5 水平投影和垂直投影相关曲线(针对图4中两帧图像)Fig.5 Horizontal and vertical projection curves(according to the two images figure 4)

为了具有可比性,同样选择像元合并之后图像序列相邻两帧的左上角1/4部分,大小为256× 256的子区域,如图6所示。

图6 参考帧与目标帧图像BFig.6 Images B of reference frame and target frame

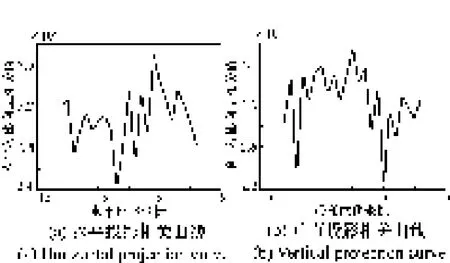

对图6两帧图像使用灰度投影算法,得到水平和垂直方向的相关曲线如图7所示。

图7 水平投影和垂直投影相关曲线(针对图6中两帧图像)Fig.7 Horizontal and vertical projection curves(according to the two images in figure 6)

由图可知,估计出的位移向量为(5,7),与真实位移一致,且相关曲线平滑了许多,波谷也更为明显,因此估计的准确性和稳定性大大提升,同时运算量也大幅减小。

4.2 区域选择算法实验

即使在像元合并之后也不能完全保证估计的准确性和稳定性,还与用于计算的图像子区域有很大关系。当相邻两帧图像的相对位移矢量为(5,-7)时,选择图像的右上角1/4子区域来进行估计,如图8所示。

图8 参考帧与目标帧图像CFig.8 Images C of reference frame and target frame

由图8得到的灰度投影相关曲线如图9所示。

从图中可知,估计出的位移向量为(-2,5),与真实位移向量(5,-7)误差极大,其原因是图像右上角部分过于平坦,灰度特征十分不明显。

图9 水平投影和垂直投影相关曲线(针对图8中两帧图像)Fig.9 Horizontal and vertical projection curves(according to the two images in figure 8)

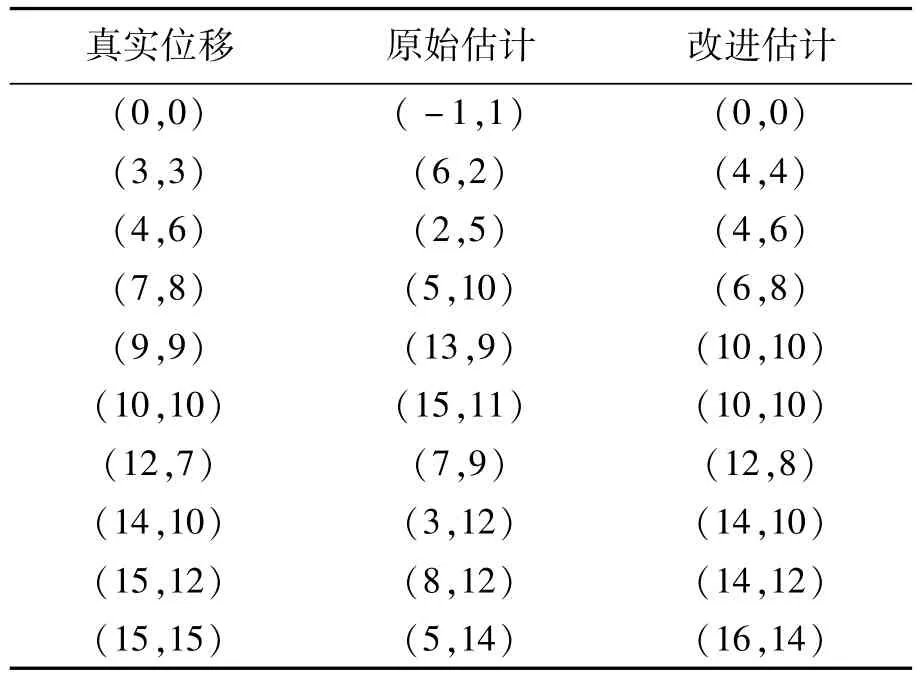

按照本文提出的算法,将图3(b)划分为4×4排列的16个子区域,每个子区域分辨率为128×128,如图10(a)所示;使用一阶插值将原图缩小为原尺寸的1/(16×16)大小,如图10(b)所示;使用算子K对图(b)进行空间滤波从而度量出原图不同子区域灰度特征的强弱(算子中各加权系数均为1),如图10(c)所示;最后再计算出各子区域的归一化灰度特征强弱,如图10(d)所示。

图10 区域选择算法效果图Fig.10 Sketch of region selection algorithm

区域选择算法结果显示16个子区域中第四行第三列的子区域灰度特征最强,因此选择相邻两帧的对应区域图像数据用于灰度投影算法,得到的两条相关曲线如图11所示。

图11 水平投影和垂直投影相关曲线Fig.11 Horizontal and vertical projection curves

显见,经过算法选择出的区域用于灰度投影算法得到的相关曲线更加利于位移量的判断,曲线更加平滑,单峰性明显,能够明显提高估计的精度和稳定性。

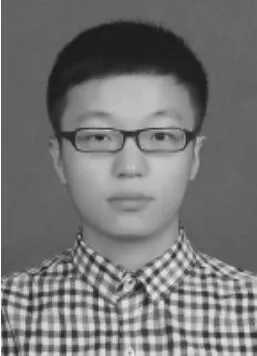

表1给出了改进算法和原始算法性能的对比。位移量为像元合并前的像元个数。

表1 不同位移矢量下估计结果对比Tab.1 Estimation results contrast under different motion vectors

从表1和表2中数据可知,原始算法的估计精度差且极不稳定;改进算法由于是在2×2像元合并之后的估计,所以估计结果均为偶数,估计结果最多相差一个像元,精度较高且稳定性好。

5 结论

针对遥感相机极短曝光时间条件下的运动估计问题,提出了结合像元合并和区域选择算法的改进灰度投影算法。通过像元合并提高图像的亮度、对比度和信噪比,通过区域选择算法有效地度量图像灰度特征强弱,选择其中灰度特征最强的区域用于灰度投影算法,在提高估计精度的同时减少运算量从而提高算法的实时性。实验结果显示,提出的改进算法在精度和稳定性方面均明显优于原始算法,估计的最大误差为一个像元,能够满足低曝光条件下的运动估计要求。

[1]薛旭成,傅瑶,韩诚山.TDI CCD相机的卫星姿态稳定度确定[J].中国光学,2013,6(5):767-772.

XUE X CH,FU Y,HAN CH SH.Confirmation of satellite attitude stabilization for TDI CCD camera[J].Chinese Optics,2013,6(5):767-772.(in Chinese)

[2]龙夫年,张旺,刘剑峰.卫星姿态精度对TDI CCD相机的影响[J].哈尔滨工业大学学报,2002,34(3):382-384.

LONG F N,ZHANG W,LIU J F.Effect of satellite attitude control accuracy on TDI CCD cameras[J].J.Harbin Institute of Technology,2002,34(3):382-384.(in Chinese)

[3]JANSCHEK K,TCHERNYKH V,DYBLENKO S.Integrated camera motion compensation by real-time image motion tracking and image deconvolution[C].International Conference on Advanced Intelligent Mechatronics Monterey,California,USA,24-28 July,2005.

[4]HOCHMAN G,YITZHAKY Y,et al..Restoration of images captured by a staggered time delay and integration camera in the presence of mechanical vibrations[J].Applied Optics,2004,43(22):4345:4354.

[5]徐树奎.基于计算摄影的运动模糊图像清晰化技术研究[D].长沙:国防科学技术大学,2011.

XU SH K.Research on motion blur image deblurring technology based on computational photography[D].Changsha:National University of Defense Technology,2011.(in Chinese)

[6]石俊霞,郭永飞,薛旭成,等.航天时间延迟积分CCD相机振动模糊图像的恢复[J].光电子·激光,2012,23(3):572-578.

SHI J X,GUO Y F,XUE X CH,et al..Motion blurres image restoration of spaceborne TDICCD camera[J].J.Optoelectronics·Laser,2012,23(3):572-578.(in Chinese)

[7]陈前荣,陆启生,成礼智,等.运动模糊图像点扩散函数尺度鉴别[J].计算机工程与应用,2004,23:15-20.

CHEN Q R,LU Q SH,CHENG L ZH,et al..Identification the scale of the point spread function from the motion blurred image[J].Computer Engineering and Applications,2004,23:15-20.(in Chinese)

[8]谢冰,焦斌亮.基于航天TDICCD相机像移分析的PSF估计及图像复原算法研究[J].宇航学报,2010,31(3):936-940.

XIE B,JIAO B L.The PSF estimation method and image restoration algorithm based on image-motion analysis of spaceborne TDICCD camera[J].J.Astronautics,2010,31(3):936-940.(in Chinese)

[9]王彪,姜志国,赵丹培.遥感图像运动模糊恢复方法及评价标准研究[J].航天返回与遥感,2009,30:18-25.

WANG B,JIANG ZH G,ZHAO D P.Research on technologies and quality evaluation for restoring remote sensing motionblurred image[J].Spaceraft Recovery and Remote Sensing,2009,30:18-25.(in Chinese)

[11]任航,张涛.基于灰度投影法运动估计的成像CCD平移补偿法[J].应用光学,2009,30(3):417-422.

REN H,ZHANG T.Image CCD translation compensation method based on movement estimation of gradation projection technology[J].J.Applied Optics,2009,30(3):417-422.(in Chinese)

[12]初守艳,席志红.改进Noble算子匹配的电子稳像法[J].光学精密工程,2014,22(1):204-212.

CHU SH Y,XI ZH H.Digital image stabilization based on improved noble feature matching[J].Opt.Precision Eng.,2014,22(1):204-212.(in Chinese)

[13]张坤,许廷发,王平,等.高精度实时全帧SURF电子稳像方法[J].光学精密工程,2011,19(8):1964-1972.

ZHANG K,XU T F,WANG P,et al..Real-time full-frame digital image stabilization system by SURF[J].Opt.Precision Eng.,2011,19(8):1964-1972.(in Chinese)

[14]蔡胜利,张会清.基于序列图像块匹配的室内定位算法研究[J].计算机测量与控制,2010,18(7):1641-1644.

CAI SH L,ZHANG H Q.Research on indoor position algorithm based on block match of image sequence[J].Computer Measurement and Control,2010,18(7):1641-1644.(in Chinese)

[15]孙辉.快速灰度投影算法及其在电子稳像中的应用[J].光学精密工程,2007,15(3):412-416.

SUN H.Fast gray projection algorithm and its application to electronic image stabilization[J].Opt.Precision Eng.,2007,15(3):412-416.(in Chinese)

Micro-vibration detection of remote sensing camera under low exposure condition

LE Guo-qing1,2,GUO Yong-fei1*,LIU Chun-xiang1,MA Tian-bo1,SHI Jun-xia1

(Changchun Institute of Optics,Fine Mechanics and Physics,Chinese Academy of Sciences,Changchun 130033,China;2.University of Chinese Academy of Sciences,Changchun 130033,China)

To deal with the effect of flutter of carrying platform on remote sensing camera,motion estimation algorithm can be used to the image sequences taken by auxiliary high-speed array CCD camera during exposure to estimate the vibration.Pixel binnng is proposed to compensate the time of exposure and to improve the brightness and contrast as well as SNR of the images.And a region selection algorithm is used to select the image region by which we can estimate the displacement using gray projection algorithm.The experiment results show that the error is 1 pixel by utilizing the improved algorithm,which greatly enhance the accuracy and stability.

remote sensing camera;micro-vibration detection;motion estimation;gray projection algorithm

V447.33;TP391

A

10.3788/CO.20140706.0917

2095-1531(2014)06-0917-08

乐国庆(1989—),男,江西南昌人,硕士研究生,2012年于吉林大学获得学士学位,主要从事图像处理及FPGA应用方面的研究。E-mail:leguoqing@yeah.net

郭永飞(1961—),男,吉林长春人,研究员,博士生导师,1990年于中国科学院长春光学精密机械与物理研究所获得硕士学位,主要从事光电技术应用,CCD在计算机中的应用等方面的研究。E-mail:guoyongfei@163.com

刘春香(1983—),女,吉林长春人,博士,助理研究员,2007年于哈尔滨工业大学获得学士学位,2013年于中国科学院大学获得博士学位,主要从事光电成像技术及图像压缩方面的研究。E-mail:yuhit2007@163.com

马天波(1984—),女,吉林长春人,硕士,助理研究员,2006年、2008年于吉林大学分别获得学士、硕士学位,主要从事图像处理及光电成像中的计算机应用技术方面的研究。E-mail:matb0319@yahoo.com.cn

石俊霞(1984—),女,内蒙古赤峰人,博士,助理研究员,2007年于吉林大学获得学士学位,2012年于中国科学院大学获得博士学位,主要从事光电成像技术及图像处理方面的研究。E-mail:19031121@163.com

2014-09-22;

2014-11-25

国家自然科学基金资助项目(No.61036015)

*Corresponding author,E-mail:guoyongfei@163.com