基于稀疏表示和色彩传递的图像融合与彩色化

宋芳伟,孙韶媛

(东华大学信息科学与技术学院,上海201620)

1 引言

夜视图像包括微光图像和红外图像,随着微光与红外成像技术的发展,综合和发掘微光与红外图像的特征信息,使其融合成信息更全面的图像已发展成为一种有效的技术手段。由于微光图像和红外图像都是单色图像,其最大的缺陷是低信噪比且图像缺乏深度感,不利于对目标的探测。如果利用人眼彩色视觉的高分辨率和高灵敏度的特性实现彩色夜视图像,则可增强场景理解、突出目标,有利于在隐藏、伪装和迷惑的军用背景下更快更精确地探测和识别目标,并且可减小观察者的疲劳感。因此,图像融合以及彩色化技术成为夜视领域的研究热点[1-3]。

目前国内外学者对于红外与微光图像融合算法己经有比较深入的研究。主要的融合算法有:加权平均法、逻辑滤波法、多分辨塔式算法、小波变换法、卡尔曼滤波算法等。但这些融合方法均需要对待融合图像的像素灰度进行综合分析与处理,巨大的数据量对图像的融合带来了极大的不便。近年来,稀疏表示被应用于图像处理与分析领域,如图像去噪、超分辨率、修复以及人脸识别[4]等。它是通过在过完备基上对信号进行表示的[5],具有很好的稀疏表达能力。

目前,比较成功的彩色图像融合技术主要有麻省理工学院(MIT)林肯实验室提出的MIT法[6],以及荷兰人力因素所提出的TNO法[7]。该方法将双波段图像信息直接或组合映射到RGB或YUV颜色空间,利用各波段信息的差异构成彩色图像,但其图像色调与实际人眼视觉不一致,不利于长期观察观看。2003年,Toet[8]对其原有直接映射法彩色化夜视图像引入了色彩传递技术,从而提出了一种基于色彩传递的自然感彩色夜视处理技术,使夜视图像看起来与白天时一样清晰和丰富多彩。但该方法并不能很好地保留图像细节信息,尤其是在红外和微光图像细节亮度差异对比不明显的情况,细节信息缺失严重。

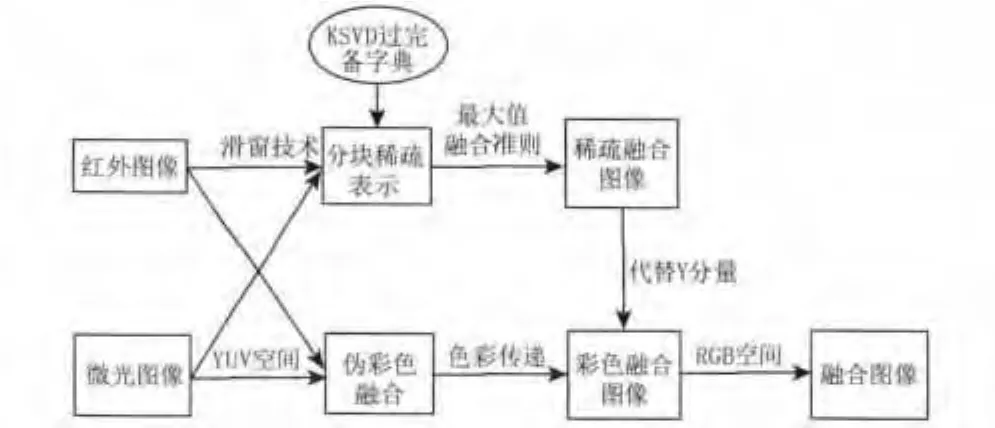

为了进一步改善彩色融合图像的质量和色彩自然性,本文尝试采用改进的分块稀疏理论融合红外与微光图像,获得大量图像细节信息,然后在YUV空间采用Toet的基于色彩传递的自然感彩色夜视处理技术,对红外与微光图像进行彩色化融合,最后用稀疏融合图像的灰度值代替彩色融合图像中的Y分量,进而增强图像细节,获得最佳的图像色彩。图1是本文算法流程图。

图1 本文算法流程图

2 基于稀疏表示的图像融合

本文采用KSVD方法训练得到过完备基,用分块稀疏表示的方法对图像进行特征提取,通过最大值融合规则对图像特征进行融合。该方法不仅使图像足够稀疏,而且能有效地避免传统融合算法中的块效应和纹波噪声,在一定程度上提高了融合图像的质量。

2.1 信号的超完备稀疏表示

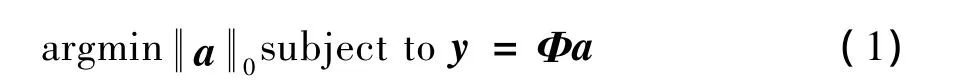

给定信号y∈Rn,假定超完备字典D对应的合成矩阵为Φ,则超完备稀疏表示就是从所有表示中找出分解最为稀疏的一个,即:

对于一个冗余字典来说,求解稀疏表示最优化问题是一个NP难问题[9]。为了得到超完备稀疏表示最优问题的解,必须采用一些特殊的求解方法。目前常用的方法有三类:匹配追踪算法(MP)、基于l1范数的基追踪算法(BP)、迭代收敛算法。其中匹配追踪算法是以贪婪算法为核心的最简单直接的算法。本文采用正交匹配追踪(OMP)算法,以误差为循环终止条件,对图像进行稀疏表示。

2.2 过完备字典的创建

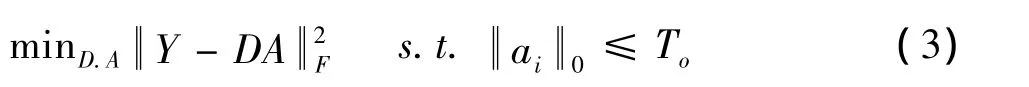

过完备图像稀疏表示问题中,字典的构造和选取直接影响到表示的稀疏程度。过完备字典的构建方法分为两类。一类是选择固定字典,例如DCT基、小波基、脊波基等,该类字典适用范围广,但不能保证信号的稀疏性。另一类是根据样本来训练字典,使其适用于该类特定信号,确保信号的稀疏性。目前比较流行的KSVD[10]算法属于第二类字典训练方法。该方法交替执行信号在当前字典的稀疏表示与原子的更新过程,达到学习字典的目的。KSVD算法的目标方程可以表示为:

1)用过完备DCT初始化字典D。

2)稀疏编码:利用OMP算法求解每一个信号的稀疏表示系数:

3)更新字典 D:更新字典中的第 k(k=1,2,…,K)列dk,使其表示的均方误差(MSE)最小。

4)若满足停止条件(设定的迭代次数),则得到最终的冗余字典D,否则转到步骤2。

2.3 图像稀疏融合

图像融合是将两幅以上的原始图像合并为一幅图像,并且尽可能地保留原始图像特征的处理过程。因此准确完整地提取原始图像的特征是一个非常重要的步骤。本文将稀疏系数作为图像的特征,通过稀疏系数的合并融合图像。具体步骤如下所示:

1)构建待融合图像信号集。将两幅大小为M×N经过严格校准的微光图像Iin和红外图像Ivi,分别通过滑窗的方法进行分块(窗体大小为n),将每个图像块整合成一维列向量,分别获得微光图像的信号集Yin和红外图像的信号集Yvi。

2)提取图像特征。根据公式Y=ΦA,用创建的过完备字典,采用正交匹配追踪(OMP)算法分别求得微光图像信号集Yin和红外图像信号集Yvi的稀疏系数矩阵Ain和Avi。为了获得更快的速度,本文对信号集进行不重叠分块处理。即通过设置步长p,依次对信号集中的p个列向量求其稀疏系数矩阵,然后将求得的各个稀疏系数矩阵按列合并在一起。实验证明,该方法速度块,且当步长大于5000时不会产生块效应,达到和直接对信号集进行特征提取一样的效果。

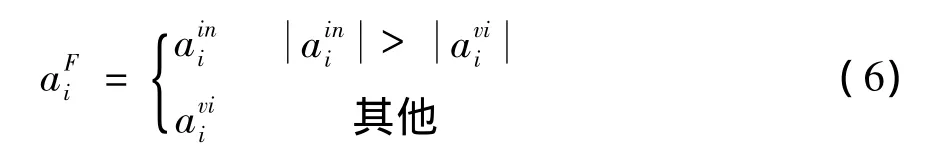

3)融合稀疏系数。稀疏系数矩阵中数值的大小表示该特征的强弱,为保证融合图像包含全部的特征,本文采用最大值融合准则[12]:

将微光图像和红外图像的稀疏系数矩阵Ain和Avi进行融合,得到融合稀疏表示矩阵AF。

4)重构稀疏表示矩阵。重构是分解的逆过程。将得到的融合稀疏表示矩阵AF的每一列重构成n×n的图像块,根据滑窗的逆过程叠加成一个M×N的融合图像矩阵S。

5)重构融合图像。由于相邻的图像块在空间上是相互重叠的,因此重构得到的图像矩阵S需要除以叠加次数矩阵得到最终生成的融合图像IF。叠加次数矩阵如下所示:

3 融合图像彩色化

3.1 基于YUV空间的色彩传递

Toet色彩传递算法通过匹配目标图像和参考图像各个颜色通道的统计信息,从而实现色彩的传递。Toet色彩传递是在lαβ空间进行的,该色彩空间将RGB三种颜色通道之间的相关性降到最小,使图像亮度和色彩分离,易于实现色彩的传递。YUV空间是国际电信联盟ITU推荐的颜色空间,常用于视频信号处理传输,其中Y为亮度信号,U、Y分别为蓝色和红色色差信号[2]。该颜色空间同样是将亮度与色彩分离,并且还可以避免lαβ空间中反复的颜色空间转换以及对数、指数运算,减少计算量,且能得到较理想的传递效果。因为本文采用基于YUV空间的色彩传递算法。具体实现步骤如下所示:

1)伪彩色融合。伪彩色处理法是以像素的灰度为基础,通过查找表LUT[11]给不同的灰度赋予不同的彩色值。实践中发现将红外图像放在青色通道,微光图像放在红色通道,较符合人眼的视觉感受,且可以使图像细节更清晰。融合图像可通过式(8)获得:

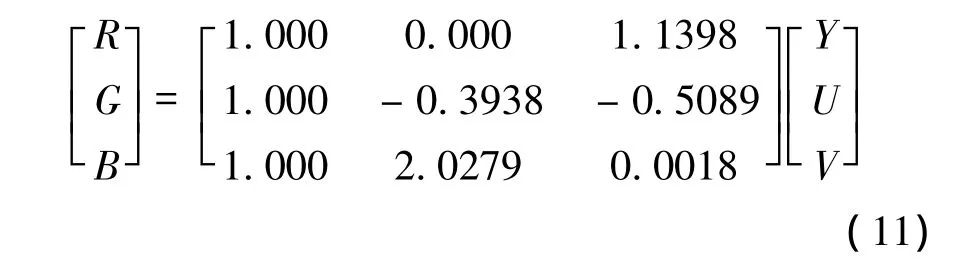

2)色彩空间转换。将伪彩色融合图像与参考图像转换到YUV空间。RGB色彩空间与YUV色彩空间转换关系如下:

3)对伪彩色融合图像通过色彩传递的方法进行自然感颜色校正。利用统计信息(均值和标准差)进行颜色矫正,调整伪彩色融合图像各个颜色分量的均值和方差,使其与参考图像的相同,从而将参考图像的颜色分布传递到彩色融合图像中。该方法计算简单,速度快。

式中,Y,U,V为目标图像像素在YUV空间的三个通道的值;为参考图像三个通道各自的整体均值;为参考图像三个通道各自的整体方差;为目标图像三个通道各自的整体均值;为目标图像三个通道各自的整体方差;Y',U',V'为目标像素颜色传递后在YUV空间的值。

4)传递后的伪彩色融合图像拥有与参考图像相同的均值和标准方差,参考图像的色彩信息传递到伪融合图像中,将图像转换到RGB空间,就得到色彩分布类似参考图像的彩色融合图像。YUV空间到RGB空间的转换公式为:

3.2 优化亮度对比

上述色彩传递方法利用各波段信息的差异构成彩色图像,能够较好的保留红外与微光各自的图像特征与细节,获得的彩色图像具有很强的对比度,但高光和阴影部分往往缺乏细节信息。并且在红外和微光图像细节亮度差异对比不明显的情况,在各个波段清晰可见的图像细节经过该方法得到的彩色融合图像不但不能很好地保存这种细节,甚至会削弱图像细节的亮度对比。基于稀疏表示的双波段图像融合技术可以综合各波段图像特点,获得更全面的目标信息。获得的融合图像同时包含红外和微光的图像信息,但通常具有较低的对比度,直接进行彩色化,色彩发灰,缺乏立体感。用基于稀疏表示的融合图像的灰度值代替彩色融合图像的Y分量,最后将图像转化到RGB空间,此时得到的彩色融合图像综合了红外与微光特征信息且具有最佳的亮度对比,细节更加清晰,色彩更易于人眼观察。

因此本文利用灰度融合图像的亮度值代替彩色融合图像的Y分量,从而提高目标的亮度对比,得到更清晰的图像细节信息。用数学公式描述如下:

4 实验结果与分析

本文所用的红外与微光图像来自于www.imagefusion.org网站,图像大小为360×270,已经过严格的图像校准。采用滑窗的方法构建图像信号数据集。滑窗的大小和步长直接影响图像提取的精度以及算法的速度。根据文献[12],设置图像块大小为8×8,滑动步长为1。

利用滑窗的方法对10幅红外与微光图像进行分块,分块处理后的块图像作为字典的训练数据。采用KSVD的方法学习得到维数为64×256的过完备字典,迭代次数设为100时,训练的字典如图2所示。

图2 训练的过完备字典

图3给出了微光与红外图像融合与彩色化结果。其中图3(a)是微光图像,图3(b)为红外图像。图3(c)是彩色参考图像。图3(d)是使用创建的过完备字典,运用本文稀疏方法得到的红外与微光的融合图像。可以看到,融合后的图像综合了红外与微光图像信息,不仅可以很好的识别出目标物体,图像背景的纹理也比较清晰,具有很好的细节信息。图3(e)是利用welsh法直接对稀疏融合图像进行彩色化的结果图。该图的纹理信息丰富,但对比度低,色彩平淡。图3(e)是图3(a)和图3(b)经过Toet色彩传递算法得到的彩色融合图像。该融合图像具有与图3(c)相同的颜色分布,较好地保留了红外与微光的特征信息,具有很强的亮度对比度,但是高光部分以及阴影部分,例如行人目标、白色墙体、黑色屋顶纹理信息缺失。图3(f)是用稀疏融合图像3(d)的亮度值代替图3(f)的Y分量得到的最终彩色融合图像。该图像很好地融合了微光与红外图像的纹理信息和目标信息,相比图3(f)很好地将行人目标、白色墙体、黑色屋顶纹理信息保存下来,相比图3(e)又具有较高的对比度,且行人目标更加清晰,色彩更加真实。

图3 图像融合与彩色化结果

5 结论

本文提出一种基于色彩传递以及分块稀疏融合的双波段图像融合与彩色化的方法。该算法首先采用改进的基于K_SVD的分块稀疏表示获得红外与微光图像的稀疏融合图像,然后在YUV空间采用Toet色彩传递算法对红外与微光图像进行彩色化处理,并用稀疏融合图像的灰度值代替其Y分量,最后将图像转化到RGB空间,从而实现双波段图像的融合与彩色化。实验表明该方法克服了传统图像融合数据量巨大的问题,使图像信号足够稀疏,同时解决了toet色彩传递方法产生的彩色融合图像亮度对比度过高,高光部分以及阴影部分细节信息丢失的问题。得到的彩色融合图像很好地保留了微光与红外图像的纹理信息和目标信息,同时具有较高的亮度对比,色彩更真实,更适合人眼观察。

[1] DAI Zhonghua,SUN Shaoyuan,X Zhen,et al.A colorization algorithm for vehicle infrared video[J].Infrared Technology,2010,32(10):595 -600.(in Chinese)代中华,孙韶媛,许真,等.一种车载红外视频彩色化算法[J].红外技术,2010,32(10):595 -600.

[2] QIAO Shuai.Research on colorization algorithm for night vision video sequence[D].Shanghai:DongHua University,2012.(in Chinese)谯帅.夜视视频序列的彩色化方法研究[D].上海:东华大学,2012.

[3] Sanjoy Das,William K.Krebs.Color night vision for navigation and surveillance[C].Proceedings of the Fifth Joint Conference on Information Sciences,2000.

[4] Yu Nannan,Qiu Tianshuang,Bi Feng.Medical image features extraction and fusion based on K-SVD[J].Journal of Dalian University of Technology,2012,52(4):605 -609.

[5] Li Shutao,Yin Haitao,Fang Leyuan.Remote sensing image fusion via sparse representations over learned dictionaries[J].Geoscience and Remote Sensing,IEEE Transactions,2013,51(5):2827 -2836.

[6] D A Fay,A M Waxman,M Aguilar.Fusion of multi-sensor imagery for night vision:color visualization,target learning and search[C].The 3rdInternational Conference on Information Fusion,Paris:IEEE Press,2000,TUD3/3 -TUD310 vol.1.

[7] Alexander Toet,Jan Walraven.New false color mapping for image fusion[J].Optical Engineering,1996,35(3):650-658.

[8] Alexander Toet.Natural colour mapping for multiband nightvision imagery[J].Information Fusion,2003,14:155-166.

[9] DENG Chengzhi.Research on image sparse representation theory and its applications[D].Wuhan:Huazhong University of Science and Technology,2008.(in Chinese)邓承志.图像稀疏表示理论及其应用研究[D].武汉:华中科技大学,2008.

[10] Michal Aharon,Michael Elad.K-SVD:An algorithm for designing of overcomplete dictionaries for sparse representation[J].Signal Processing,IEEE Transactions,2006,54(11):4311-4322.

[11] Paul M Steele,Philip Perconti.Part task investigation of multispectral image fusion using gray scale and synthetic color night vision sensor imagery for helicopter pilotage[C].Proc.SPIE,1997,3062:88 -100.

[12] Bin YANG,Shutao LI.Multifocus image fusion and restoration with sparse representation[J].IEEE Transactions on Instrumentation and Measurement,2010,59(4):884 -892.