羊舍自主巡检机器人设计与试验

摘要:

针对规模化羊舍人工劳动强度大、作业效率低等问题,设计羊舍自主巡检机器人系统。该系统基于2D激光雷达的即时定位与建图(SLAM)技术,自主导航系统使用基于扩展卡尔曼滤波数据融合的AMCL定位算法实现机器人的定位,采用Gmapping算法构建羊舍环境地图,并采用A*和DWA算法规划机器人巡检路径,最终实现舍内地图构建、系统实时定位、多目标点路径规划以及动态避障。机器人导航精度试验表明,巡检机器人横向偏差均值不超过8.3cm,纵向偏差均值不超过7.1cm;航向偏差的均值不超过6.1°。该系统构建的环境地图精度较高,能够实现对机器人的有效定位,并且能够以实现羊舍的循环巡航和自动躲避周边障碍物,导航精度满足羊舍自主导航需求。

关键词:羊舍;巡检机器人;多传感器融合;路径规划;扩展卡尔曼滤波

中图分类号:S24

文献标识码:A

文章编号:2095-5553 (2025) 01-0078-07

Design and experiment of autonomous inspection robot for sheep house

Zhao Ninglei1, Cheng Man1, Yuan Hongbo1, Wang Yuan2, Cai Zhenjiang1

(1. College of Mechanical and Electrical Engineering, Hebei Agricultural University, Baoding, 071001, China;

2. Hengshui Zhihao Animal Husbandry Technology Co., Ltd., Hengshui, 053400, China)

Abstract:

In order to solve the problems of high labor intensity and low working efficiency of large-scale sheep house, an autonomous inspection robot system for sheep house is designed. The system is based on the real-time positioning and mapping (SLAM) technology of 2D LiDAR. The autonomous navigation system uses the AMCL positioning algorithm based on extended Kalman filter data fusion to realize the positioning of the robot, uses the Gmapping algorithm to construct the environment map of the sheep shed, and uses the A*"and DWA algorithms to plan the inspection path of the robot. Finally, it realizes the construction of the map in the house, real-time positioning of the system, multi-objective point path planning and dynamic obstacle avoidance. The robot navigation accuracy test shows that the average lateral deviation of the patrol robot does not exceed 8.3cm, the average longitudinal deviation does not exceed 7.1cm, and the average heading deviation does not exceed 6.1°. The environmental map constructed by this system has high accuracy, can effectively locate the robot, and can realize the cyclic cruising and cruising of the sheep house.

Keywords:

sheep house; inspection robot; multi-sensor fusion; path planning; extended kalman filtering

0"引言

近年来,中国畜禽养殖业规模和产值不断增加,2022年总产值达到4.1万亿元,约占农业总产值的30%[1],且畜禽产品种类、总量和产值等均距世界前列。然而,随着畜禽养殖集约化程度不断提高,高密度养殖对畜禽舍内动物的健康状况形成巨大的挑战[2]。近年来,随着养殖模式集约化和标准化程度的不断提高,研发和应用全自动移动式机器人,可有效促进养殖舍内智能化高效管理[3]。传统的羊场巡检方式中,人工巡检方式不仅存在工作强度大、作业效率低等不足[4],且羊自身的传染病还有很大几率传染给巡检人员,存在较大的人身安全隐患问题[5]。传统的视频监控系统,由于存在较大的监控盲区很难做到视频监控全方位覆盖,同时由于整个系统使用摄像头数量多、安装布线复杂、综合系统庞大,因此故障率较高,维护成本大[6]。使用智能移动机器人进行羊场环境的巡检,不仅可以为企业降低生产成本、提高生产效率、扩大企业的行业竞争力[7],也可以有效避免人工巡检及传统视频监控过程中存在的缺陷和不足。

针对羊场羊只巡检的需要,设计一种上下位机结合的智能巡检机器人,智能巡检机器人采用PID控制的四轮差速移动底盘,保证其灵活性以及足够的检测范围。应用Gmapping算法并开发上位机界面,实现机器人的自主构建地图和实时获取和存储巡检目标点的功能。同时利用A*和DWA路径规划算法对每一个记录的目标点依次进行路径规划和自主导航从而满足羊场巡检的需要。

1"巡检机器人系统设计

1.1"巡检机器人结构设计

机器人整体框架由40mm×40mm的欧标铝型材搭建,整车长为55cm、宽为55cm、高为65cm。机器人在室内巡检时的数据采集场景如图1所示。整车采用四轮四驱独立转向机构,由4组直角直流减速电机、4组驱动器、4组AGV充气轮组成,并通过4组长为255mm,宽为84mm,厚度为5mm的自制电机架将电机固定在铝型材上,系统所选用的电机安装于内侧,电机与电机架的整体宽度约为95mm。机器人正前方中央放置一个RPLIDAR S1单线激光雷达,可以获取其探测范围内雷达平面范围内的二维点云数据。底盘中央安置了一组24V 40Ah的锂电池,是所有传感器、动力装置的动力来源,能保证平台在设备满功率状态下续航4h。主控器和从控制器单元放置在电源旁边的盒子里。

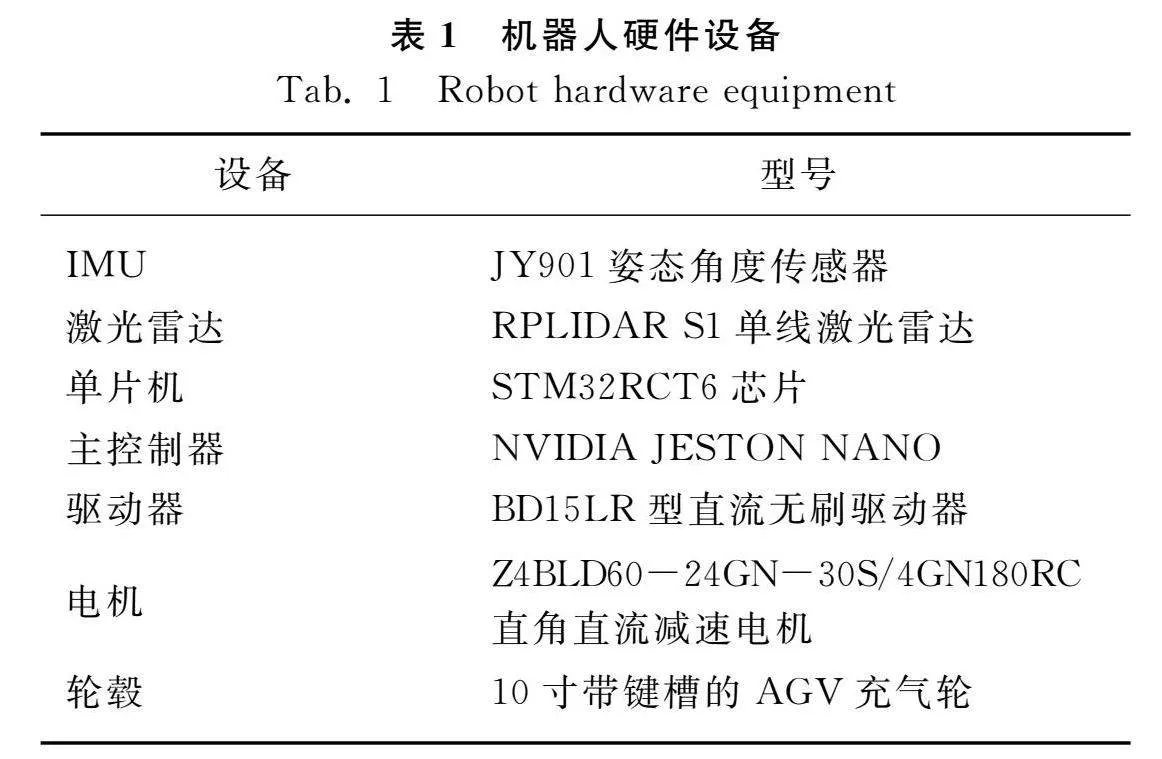

1.2"巡检机器人硬件设计与选型

机器人主要硬件组成如表1所示,该机器人硬件主要由传感器模块、控制模块和驱动模块组成。机器人系统的硬件框架如图2所示。Jetson Nano主控制器通过串口驱动激光雷达获取平面点云信息,STM32通过获取编码器信息,计算得出机器人的线速度与角速度,并通过PWM驱动电机控制板,进而控制电机的速度,从而控制机器人的移动。此外,还通过模拟I2C协议获取JY901的陀螺仪和加速度信息,将机器人的速度、陀螺仪和加速度等信息通过串口上传到主控制器。主控制器通过获取从控制器发过来的速度信息计算得出机器人的里程计、陀螺仪和加速度信息。

2"巡检功能设计

2.1"基于扩展卡尔曼滤波数据融合的AMCL定位算法

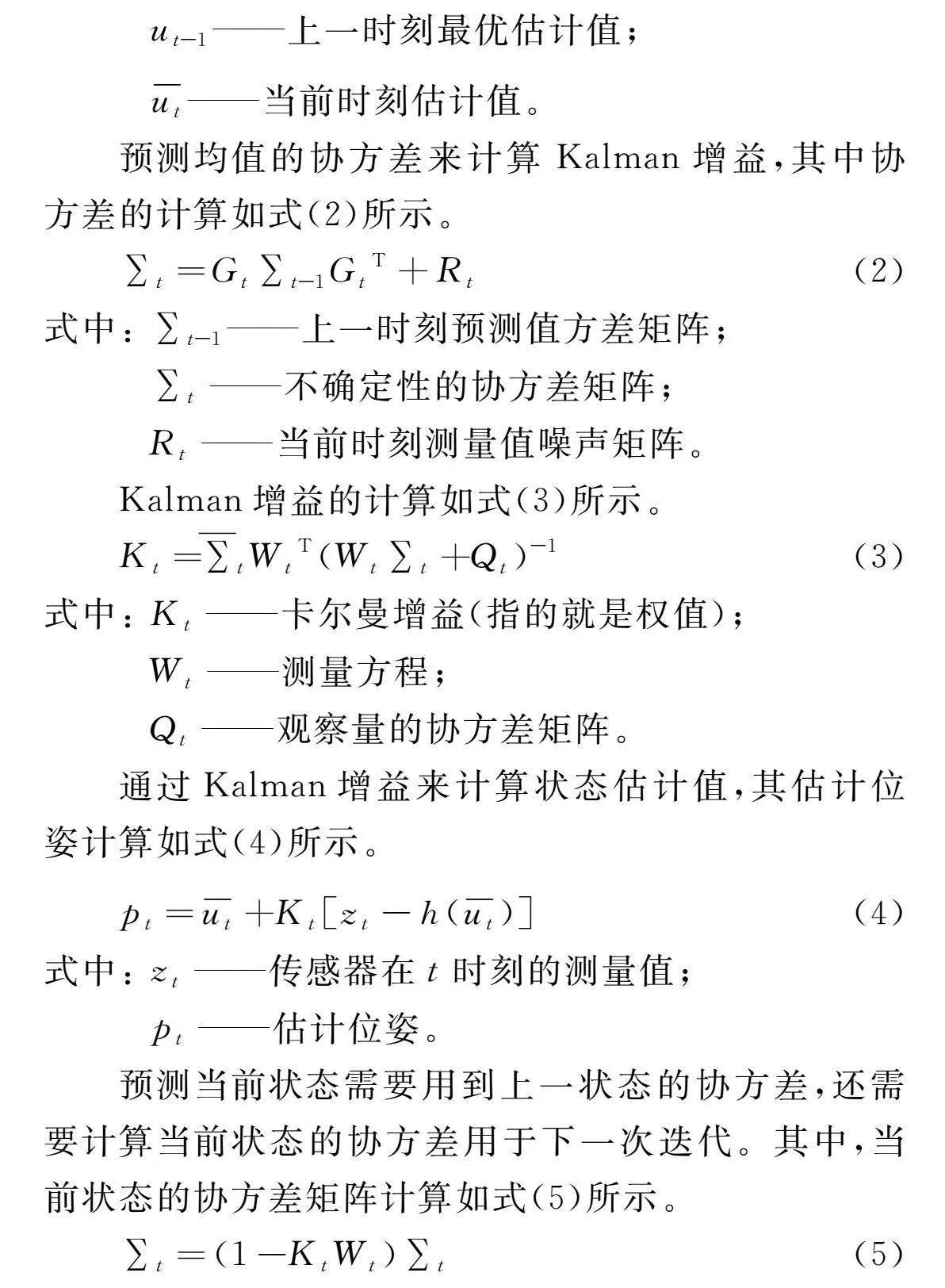

机器人定位采用扩展卡尔曼滤波数据融合的AMCL算法,AMCL定位算法基于粒子滤波,确定机器人当前的位置[8]。首先,该算法将代表机器人位姿的粒子随机分布于已知环境地图中。其次,通过使用扩展卡尔曼滤波融合IMU传感器与里程计数据,建立运动模型预测所有随机粒子的位姿。扩展卡尔曼滤波算法通过系统的观测数据及系统状态对全局最优状态进行推算,并通过上一状态和下一状态来预测当前状态,其计算如式(1)所示。

ut-=Gtut-1+Htut

(1)

式中:

Gt——

当前时刻的状态转移矩阵(就是指从上一状态转变为下一状态的关系矩阵);

Ht——

当前时刻的控制矩阵(就是指影响控制量的控制矩阵);

ut——

当前时刻的控制量;

ut-1——

上一时刻最优估计值;

ut-——当前时刻估计值。

预测均值的协方差来计算Kalman增益,其中协方差的计算如式(2)所示。

t=Gtt-1GtT+Rt

(2)

式中:

t-1——上一时刻预测值方差矩阵;

t——不确定性的协方差矩阵;

Rt——当前时刻测量值噪声矩阵。

Kalman增益的计算如式(3)所示。

Kt=tWtT(Wtt+Qt)-1

(3)

式中:

Kt——卡尔曼增益(指的就是权值);

Wt——测量方程;

Qt——观察量的协方差矩阵。

通过Kalman增益来计算状态估计值,其估计位姿计算如式(4)所示。

pt=ut-+Kt[zt-h(ut-)]

(4)

式中:

zt——传感器在t时刻的测量值;

pt——估计位姿。

预测当前状态需要用到上一状态的协方差,还需要计算当前状态的协方差用于下一次迭代。其中,当前状态的协方差矩阵计算如式(5)所示。

t=(1-KtWt)t

(5)

由式(4)和式(5)得到了里程计与IMU数据融合后的最佳估计位姿ut,以及它的协方差矩阵t。最后根据激光雷达数据建立测量模型来更新所有随机粒子的权重,粒子最终的收敛位置即为机器人在地图中的实际位置。若机器人初始位姿未知或有误,此时全局将注入更多随机粒子,随机器人的移动粒子再次更新,重新定位机器人在羊舍地图中的位置。

2.2"羊舍地图构建

采用Gmapping算法对羊舍进行地图的构建。Gmapping是一种基于Rao-Blackwellized粒子滤波的二维激光SLAM方法[9]。即将定位和建图过程分离,先进行定位再进行建图。为了解决RBPF频繁重采样的缺点,Gmapping提出了选择性重采样,即减少重采样的次数,设定阈值;当粒子权重大于所设阈值才执行重采样,这样便减少了采样的次数,即减缓了粒子的退化[10]。里程计根据测量的速度可以推导出机器人的路程和方向,Gmapping算法依据里程计的测量数据估计机器人的运动模型,高精度的里程计对于建图和定位性能的提高十分重要。因此,首先对Gmapping功能包中的雷达最大检测距离、粒子个数以及机器人激光匹配频率进行调试并取得最优值,最后利用Gmapping功能包订阅RPLIDAR S1发出的雷达话题信息和扩展卡尔曼滤波融合的位姿信息进行小车的精确定位和建图。

2.3"巡检路线规划

2.3.1"巡检目标点获取

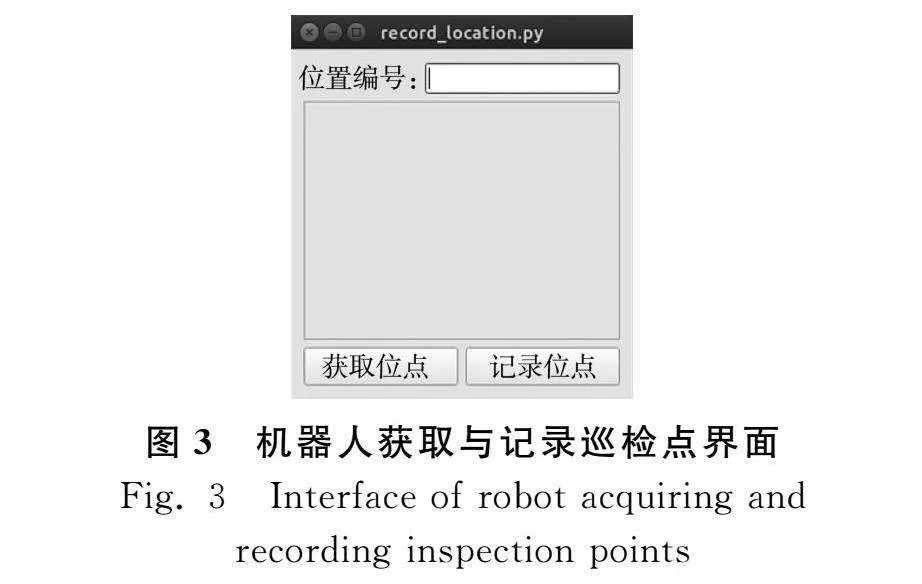

在巡检机器人对羊舍环境进行建模并得到二维栅格地图后,需要获取地图上的目标点坐标信息从而实现巡检的功能,为了获取地图上的目标点坐标信息,用Python QT构建一个简单的界面,界面如图3所示。

该界面通过点击获取节点的按键监听base_footprint与map坐标的tf,从而得到机器人实时位置,通过点击记录位点的按键将获取的机器人位置以json的数据格式存储在当前功能包的data目录下。可以在上节进行手动建图时获取并记录各个目标点的位置信息,以便在导航时可以直接读取各个目标点的位置信息进行巡检导航。

2.3.2"巡检路线生成

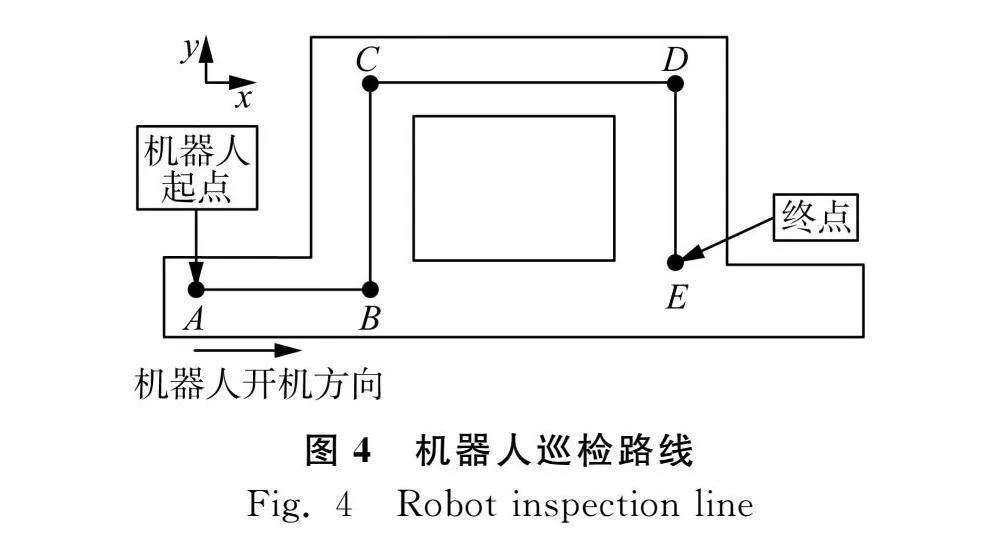

根据已经获取的巡检线路上的目标点信息,生成一条巡检路线,并发布到路径规划器中。开启前需要将机器人放置到巡检的固定起点,打开定位节点,并载入建好的羊舍地图,机器人实际巡检路线如图4所示。

如图4所示,机器人将沿着A→B→C→D→E→D→C→B→A路线行驶,车体的正前方为x轴正方向,左方为y轴正方向。2.3.1节已经通过QT界面获取到各个目标点相对于地图的xy坐标和朝向信息并存储在指定文件夹下。用C++中的ifstream类依次读取文件中的坐标,之后用ROS中的LINE_STRIP类型将每个点用作一组连接的线中的顶点,其中点A连接到点B,点B连接到点C,点C连接到点D等,这样就生成一条巡检线路,最后以trajectory命名建立一个话题,把坐标点位姿信息发布出去。在RVIZ可视化界面订阅此话题,路线就会显示在建好的地图上。

机器人的巡检方式实际是依次遍历巡检线路上的每个目标点位置信息从而实现循环往返,这是通过订阅发布的trajectory话题将规划线路传入到自定义的全局规划器。此过程首先通过监听base_footprint与map坐标系的tf获取机器人当前位置,以当前位置作为开始的规划变量。然后,在for循环中依次遍历插入巡检路线上的各个目标点的位置,同时对tf进行监听获取导航线上各个点的位置,获取到所有目标点位置后判断机器人当前位置与目标点的相对距离,其中,目标点与当前位置相对距离的计算如式(6)所示。最后,根据式(6)将距离机器人当前位置最近的目标位置相对距离插入规划。这里设置为首先规划距离当前位置最近的目标点是为了防止机器人在巡检过程中出现意外情况被迫停止巡检时需要回到起点从头开始巡检的情况,这样即使在巡检过程中出现情况也可以在当前位置直接规划离自己最近的目标点从而之后按照目标点顺序继续巡检。

Distance=[p2(x)-p1(x)]2+[p2(y)-p1(y)]2

(6)

式中:

Distance——目标点与当前位置相对距离;

p2(x)——目标点相对于地图的x坐标;

p1(x)——当前位置点相对于地图的x坐标;

p2(y)——目标点相对于地图的y坐标;

p1(y)——当前位置点相对于地图的y坐标。

除了发布相对距离之外还需要发表各个目标点朝向来使巡检过程更加顺畅,机器人的姿态信息通过订阅IMU话题信息得到,其姿态信息由四元数表示。由图4的巡检路线可知,A-B段路线上的目标点朝向只需和机器人起点的姿态保持一致,而B-C段路线上的目标点朝向相比起点姿态需要绕Z轴逆时针旋转90°;C-D段路线上的目标点朝向相比起点姿态同样跟开机方向保持一致;D-E段路线上的目标点朝向相比起点姿态需要绕Z轴顺时针旋转90°。给定一个欧拉旋转(X,Y,Z)(即分别绕x轴、y轴和z轴旋转X、Y、Z角度),欧拉角与四元数的转换计算如式(7)所示。

x=

sinY2sinZ2cosX2+cosY2

cosZ2sinX2

y=

sinY2cosZ2cosX2+cosY2

sinZ2sinX2

z=

cosY2sinZ2cosX2-sinY2

cosZ2sinX2

w=

cosY2sinZ2cosX2-sinY2

cosZ2sinX2

(7)

机器人开机的朝向即为机器人正方向,如图4所示机器人在A-B段路线的目标点朝向与开机方向一致,所以A-B段路线上目标点的欧拉旋转为(0,0,0)对应的四元数为:x=0,y=0,z=0,w=1。B-C段路线上的目标点的欧拉旋转为(0,0,-90),对应的四元数为:x=0,y=0,z=-0.707,w=-0.707。C-D段路线上目标点的欧拉旋转为(0,0,0)对应的四元数为:x=0,y=0,z=0,w=1。D-E段路线上目标点的欧拉旋转为(0,0,90),对应的四元数为:x=0,y=0,z=0.707,w=0.707。

最后,将各个目标点之间的相对距离和朝向信息依次发送到move_base全局规划模块,返回原点的各段目标点朝向可以根据上述公式类推得到。该模块将通过ROS话题global_plan进行发布进行路径规划,然后将由本地规划模块接收并发布控制指令。这样就实现了机器人巡检线路生成以及路线上目标点位姿的发布。

2.4"路径规划算法

2.4.1"A*全局路径规划

在将目标点路径和朝向信息发布后,机器人按照规划的路径进行移动。在全局路径规划中通过点对点路径规划可以实现巡检机器人从起始点到目标点的最优路径选择,本文采用A*算法进行全局路径规划。

A*算法因为可以快速地规划出最短路径,所以多用在全局路径规划算法。A*算法将启发式算法融入到评估函数里[11],其评估函数计算如式(8)所示。

F(n)=G(n)+H(n)

(8)

式中:

F(n)——综合代价值,即评估函数;

G(n)——起点到当前点的实际代价值;

H(n)——当前点到目标点的估计代价值。

A*算法中的估计代价值H(n)是优于其他算法的核心,在路径规划过程中必须保证当前点到目标点的估计代价值低于实际距离。选用欧几里得距离作为启发函数以保证降低A*算法计算量的同时,进一步优化全局最优的表达。

2.4.2"DWA局部路径规划

由于羊场环境的复杂性,若机器人在巡检过程中突然出现一个动态障碍物,这时仅使用A*算法进行路径规划是不能实现动态避障的。DWA算法是一种局部路径规划算法,适用于移动机器人等需要避开障碍物的场景。其主要流程包含:初始化、采样速度样本、样本评分以及发布方案四部分[12]。首先,通过类加载模块载入ROS局部路径规划包 Base Local Planner中子类的实例,并调用其初始化函数获取机器人的初始状态信息,进一步得到巡检机器人的轨迹运动模型。基于轨迹运动模型,机器人根据其运动速度即可推算出其运动轨迹。为了获得机器人运动速度样本,需在一定时间间隔范围内通过传感器对机器人各个维度的线速度和角速度进行采集,并将其以结构体的形式存储到相应的容器内。在得到机器人速度样本后,根据机器人采样速度模拟推演出其相对应的运动轨迹,并通过轨迹评价函数对每一条轨迹进行评价。评价函数的计算如式(9)所示。

G(v,w)=

max(φhead(v,w)+βdist(v,w))+δvelo(v,w))

(9)

式中:

head(v,w)——速度轨迹与目标点的接近程度;

dist(v,w)——

该采样速度下运动估计距离最近障碍物的距离;

velo(v,w)——

机器人在该速度组下的前进效率;

φ、β、δ——

三个不同子项在评价函数中所占比重。

利用式(9)评价所有轨迹,选择评分最高的轨迹为局部规划的结果输出给move_base控制机器人移动。机器人在路径规划过程中通过RPLIDAR S1激光雷达检测周围环境障碍物信息,若机器人在导航过程中出现了动态障碍物,根据move_base中的栅格代价地图(Cost map)模块进行检测障碍物与机器人能否发生碰撞。代价地图通常采用网格(grid)的形式,每个网格可以存储0~255之间不同的数值,不同的数值代表该网格离障碍物的远近程度。根据数值所在区间判断当前属于行驶自由区域还是受限区域。若为行驶自由区域,则不需要进行其他操作,与之前轨迹保持一致即可;若为行驶受限区域,则进一步获取机器人模拟轨迹的角速度,当角速度超过一定阈值(若以该阈值进行移动,将进入受限区域)后,对该轨迹的权重加大,并降低轨迹评分,进而选择更优轨迹进行运动控制。最终实现机器人的局部路径规划与实时避障。

3"现场试验与结果分析

现场试验地点位于河北省衡水市某公司的8号和9号种羊舍。两个羊舍分别长为60m,宽为8m;总计70个羊圈。在试验过程中需要将参数设置统一,线速度和角速度分别调整为0.30m/s和0.3rad/s。另外采用RVIZ进行地图可视化。RVIZ是ROS中常用的可视化工具,可以在建模地图中显示各传感器的数据。保证PC端与机器人端连上统一的局域网,然后通过终端控制使得在PC端输入指令可以控制机器人。

3.1"机器人建图试验

在实际测试环境中分别采用Hector SLAM、Cartographer SLAM及Gmapping SLAM算法构建环境地图,并分析相同环境下的地图精度。3种SLAM在现场环境中构建的地图如图5所示。3种算法都完成了羊舍地图的构建,但从图5(a)中椭圆标注的地方可看出,Hector SLAM的建图结果产生了与实际环境不符的偏移。Cartographer SLAM算法虽采用回环检测以校正误差,但构建的环境地图出现了部分墙壁线条倾斜偏离实际环境的问题,如图5(b)圆圈所示。相比而言,采用经过扩展卡尔曼滤波融合里程计和IMU信息后的Gmapping算法构建的环境地图边缘更平整且整体方正,如图5(c)所示,最符合羊舍环境的实际情况。

3.2"机器人定位精度测试试验

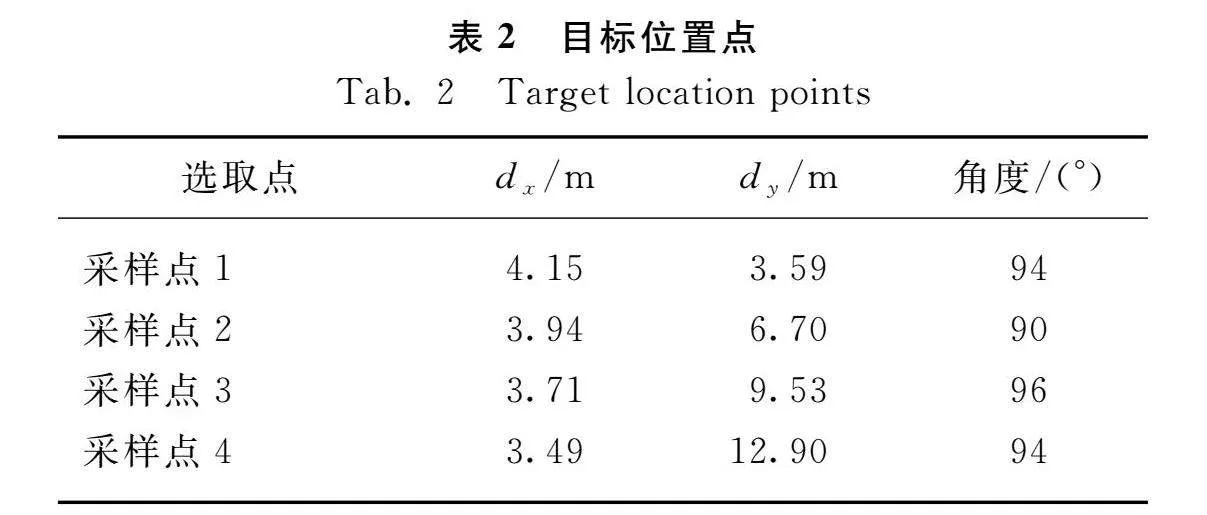

为验证巡检机器人定位精度,试验将在羊舍场景下对机器人定位精度进行测试。评价机器人导航精度指标包括横向偏差、纵向偏差、航向偏角[13]。设置机器人起点为坐标原点,随机选取巡航路径上的4个巡航点。将设置好的巡航点设置为(x0,y0),以机器人底盘中心为测量基准点,机器人行驶至目标位置,记录其基准点坐标位置为(x1,y1),巡检机器人定位精度测试试验示意图如图6所示,其中横向偏差dx和纵向偏差dy的计算如式(10)和式(11)所示。

dx=x1-x0

(10)

dy=y1-y0

(11)

航向偏角为机器人正方向与y轴之间的夹角。现场测量采样点与实际到达点的位置偏差如图7所示。图7(b)中箭头为设置的实际目标点,两条实线为到达指定位置时机器人的铝型材横杠相对于地面的投影,虚线为两条实线中心点的连线,其用于确定机器人到达目标点位置时机器人的中心,虚线中心的短横线即为机器人到达指定位置时的底盘中心点。

其中,该机器人的起点和目标点在全局坐标系中的位置和角度如表2所示。

将各目标点处10次试验的各指标结果分别取平均值作为巡检机器人在该目标点处的定位偏差。机器人到达各个采样点的实际位置与采样点位置的横向绝对偏差、纵向绝对偏差和航向角度绝对偏差如图8所示。

由图8可知,巡检机器人在0.3m/s的速度下,横向平均绝对位置偏差小于7cm,纵向平均绝对位置偏差小于8cm,航向偏角平均绝对位置偏差小于6°。该精度满足巡检机器人在羊舍环境中的定位要求。

3.3"机器人导航精度测试试验

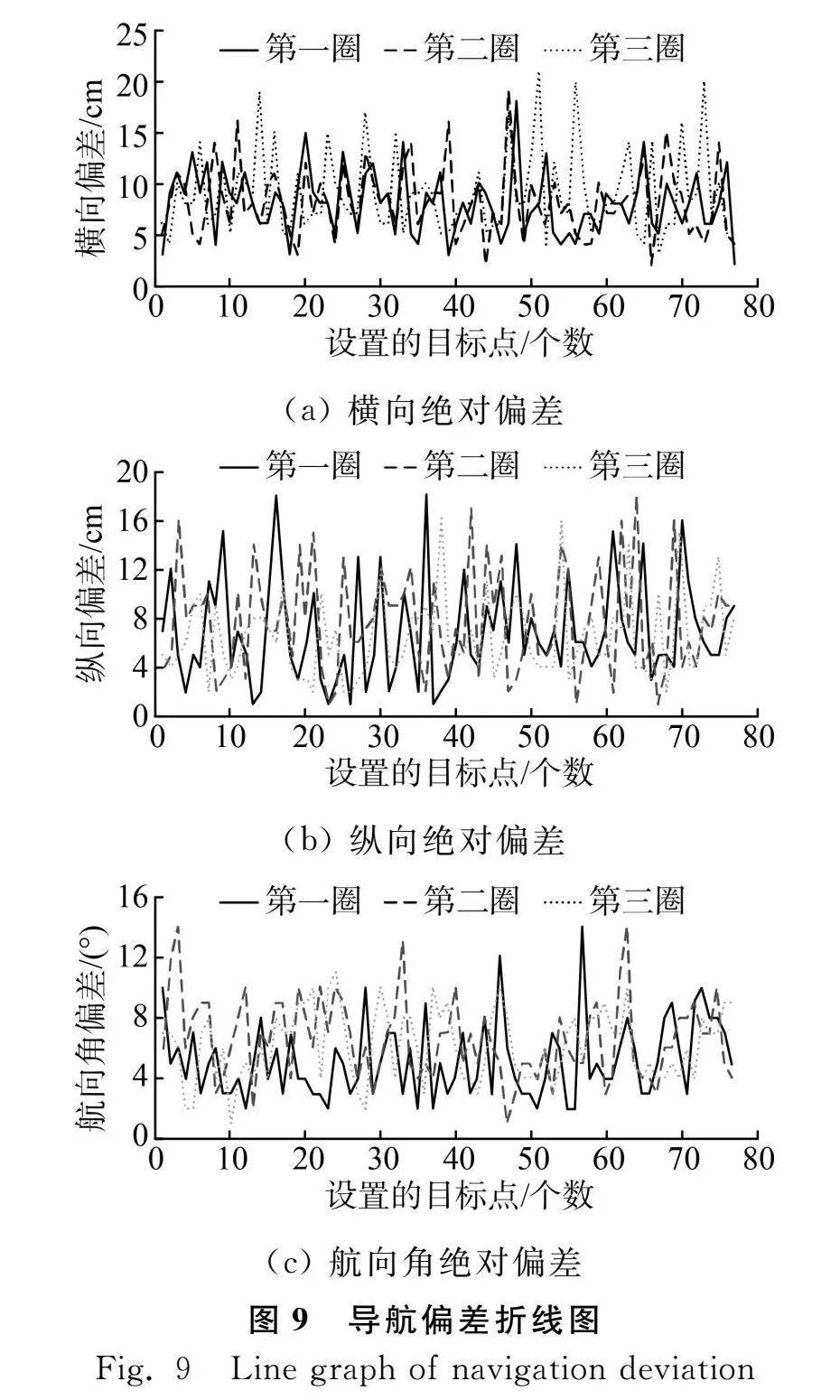

机器人在羊舍进行巡检作业时,需要沿着羊舍可通行区域进行直线行驶。路径规划如图4所示。机器人将沿着A→B→C→D→E→D→C→B→A路线进行行驶。机器人在巡检线路上设置了77个目标点,这些目标点的位姿信息以json文件格式存储在系统中,在导航时通过订阅amcl_pose话题来实时获取机器人在map坐标系下位姿信息。通过比较设置目标点位姿与导航时实时获取到的目标点位姿的误差来评价其导航精度。将各目标点处3次试验的各指标结果分别取平均值作为巡检机器人在该目标点处的导航偏差。

机器人到达各个目标点时实时采集的实际位置与设置目标点的横向绝对误差、纵向绝对误差和航向偏角绝对误差如图9所示。

总体而言,巡检机器人在对设置目标点进行巡检导航时横向偏差最大值小于21cm,平均值不超过8.3cm,纵向偏差最大值小于19cm,平均值不超过7.1cm;航向偏差的平均值不超过6.1°。该精度可满足巡检机器人在羊舍环境下的导航精度需求。

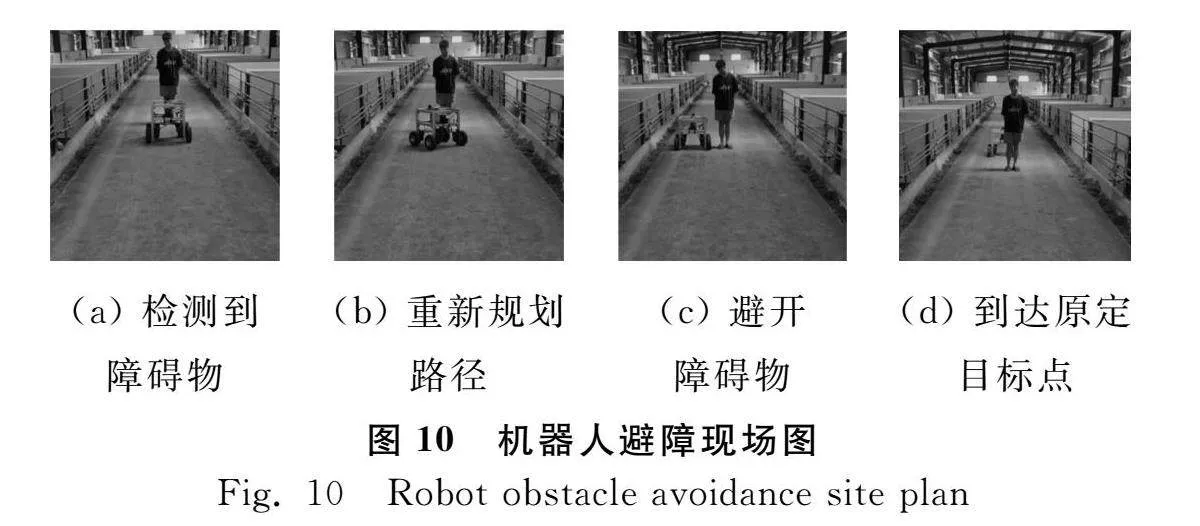

3.4"机器人避障试验

为了测试机器人的路径规划和导航避障实际效果,进行导航避障试验,试验步骤与定位精度试验大体一致。不同之处在于路径规划之后,在其规划的路径上设置动态障碍物,当RPLIDAR S1激光雷达检测到障碍物并通过代价地图模块判断到机器人即将与障碍物相撞时,机器人内部程序启动DWA算法进行避障绕行,经一系列计算后,机器人得到最优轨迹作为避障路径,这条路径对应的角速度和线速度组合则通过ROS系统传递给STM32控制板块,机器人得到速度信息后进行接下来的避让行进,如图10所示。

由图10可知,该机器人在巡检过程中能够检测并识别出动态人形障碍物,并且可以顺利避开动态障碍物并到达目标点,综上所述,该机器人符合在羊舍中的避障要求。

4"结论

1) 设计一种基于2D激光雷达SLAM技术的羊舍巡检机器人导航控制系统,提出利用扩展卡尔曼滤波融合里程计和IMU数据得到的最佳位姿作为预测所有随机粒子的位姿,该方法提高激光雷达作为测量模型进行更新的准确性,实现羊舍的建图与定位功能。

2) 针对传统多目标点路径规划需要在每次巡检之前在RVIZ界面上手动设置目标点的问题,利用QT界面在手动控制机器人建图时进行目标点的设置与保存,在之后的巡检中直接依次遍历保存的目标点信息即可实现羊舍的往返巡检。

3) 将建图定位与路径规划算法应用到巡检机器人上,结果表明该机器人可以完整地在羊舍实现往返巡检并规避障碍物。巡检机器人导航横向平均偏差小于8.3cm,导航纵向平均偏差小于7.1cm,航向平均偏差小于 6.1°。通过试验证明,该方法能够满足羊舍的自主导航需求。

参"考"文"献

[1]

何沛桐, 张建华, 张凝, 等. 基于视觉感知的畜禽智慧养殖管理与疫病诊断研究进展[J]. 中国农业大学学报, 2023, 28(10): 141-165.

He Peitong, Zhang Jianhua, Zhang Ning, et al. Research progress in intelligent livestock and poultry breeding management and disease diagnosis based on visual perception [J]. Journal of China Agricultural University, 2023, 28(10): 141-165.

[2]

姚文, 邓为, 许毅, 等. 家禽亚健康状态监测与健康预警展望[J]. 南京农业大学学报, 2023, 46(4): 635-644.

Yao Wen, Deng Wei, Xu Yi, et al. Poultry sub-health status monitoring and health warning prospect [J]. Journal of Nanjing Agricultural University, 2023, 46(4): 635-644.

[3]

Hu D, Zhong H, Li S, et al. Segmenting areas of potential contamination for adaptive robotic disinfection in built environments [J]. Building and Environment, 2020, 184: 107226.

[4]

贺晓峰, 廖志伟, 肖华明, 等. 智能巡检机器人传感与控制系统研究与设计[J]. 中国煤炭, 2022, 48(S1): 1-5.

He Xiaofeng, Liao Zhiwei, Xiao Huaming, et al. Research and design of intelligent sensing and control system of inspection robot [J]. China Coal, 2022, 48 (S1): 1-5.

[5]

汪阳, 刘文锴, 张凌, 等. 羊巴氏杆菌病研究进展[J]. 畜牧与兽医, 2023, 55(8): 126-132.

Wang Yang, Liu Wenkai, Zhang Ling, et al. Research progress on pasteurellosis in sheep and goats [J]. Animal Husbandry Veterinary Medicine, 2023, 55(8): 126-132.

[6]

曾志雄, 董冰, 吕恩利, 等. 猪舍环境无线多点多源远程监测系统设计与试验[J]. 农业机械学报, 2020, 51(2): 332-340,349.

Zeng Zhixiong, Dong Bing, Lü Enli, et al. Design and experiment of wireless multi-point and multi-source remote monitoring system for pig house environment [J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(2): 332-340,349.

[7]

安石莉. 防疫消杀巡检机器人定位导航系统设计[D].银川: 宁夏大学, 2023.

An Shili. Design of positioning and navigation system for inspection robot epidemic prevention and elimination [D]. Yinchuan: Ningxia University, 2023.

[8]

宋怀波, 段援朝, 李嵘, 等.基于激光SLAM的牛场智能推翻草机器人自主导航系统[J]. 农业机械学报, 2023, 54(2): 293-301.

Song Huaibo, Duan Yuanchao, Li Rong, et al. Autonomous navigation system for pasture intelligent overthrowing grass robot based on laser SLAM[J]. Transactions of the Chinese Society for Agricultural Machinery, 2023, 54(2): 293-301.

[9]

薛金林, 王培晓, 周俊, 等. 基于改进Gmapping算法的果园二维环境地图精准构建[J]. 农业机械学报, 2023, 54(7): 26-34, 55.

Xue Jinlin, Wang Peixiao, Zhou Jun, et al. Accurate construction of orchard two-dimensional environmental map based on improved Gmapping algorithm [J]. Transactions of the Chinese Society for Agricultural Machinery, 2023, 54(7): 26-34, 55.

[10]

Zhao J, Li J, Zhou J. Research ontwo-round self-balancing robot SLAM based on the Gmapping algorithm [J]. Sensors, 2023, 23(5): 2489.

[11]

温淑慧, 问泽藤, 刘鑫, 等. 基于ROS的移动机器人自主建图与路径规划[J]. 沈阳工业大学学报, 2022, 44(1): 90-94.

Wen Shuhui, Wen Zeteng, Liu Xin, et al. Autonomous mapping and path planning of mobile robot based on ROS [J]. Journal of Shenyang University of Technology, 2022, 44(1): 90-94.

[12]

王豪杰, 马向华, 代婉玉, 等. 改进DWA算法的移动机器人避障研究[J]. 计算机工程与应用, 2023, 59(6): 326-332.

Wang Haojie, Ma Xianghua, Dai Wanyu, et al. Research on obstacle avoidance of mobile robot with improved DWA algorithm [J]. Computer Engineering and Applications, 2023, 59(6): 326-332.

[13]

姜赛珂. 温室巡检机器人导航控制系统研究[D].镇江:江苏大学, 2023.

Jiang Saike. Research on navigation control system of greenhouse inspection robot [D]. Zhenjiang: Jiangsu University, 2023.