基于神经网络的遥感图像变化检测系统

摘要:变化检测是计算机视觉领域极具研究价值的技术分支。为提高长江沿岸生产建设活动的监管效率,以影像配准为基础,结合自注意力与特征信息提取,提出了长江沿岸建筑物变化检测系统。该系统集影像处理、影像配准、变化检测为一体,实现了全流程自动化处理的功能。结果表明:① 设计的系统在影像配准上将精度误差控制在2个像素内,达到了像素级精度。② 该系统在变化检测测试数据集上的F1值取得了优于75%的结果,证明该系统的精度较高。研究成果也可应用于大型水库岸线保护监测等场景中,提升库区治理管理的效率。

关 键 词:遥感图像; 人工智能; 影像配准; 变化检测; 岸线监测

中图法分类号: TP183

文献标志码: A

DOI:10.16232/j.cnki.1001-4179.2024.09.031

0 引 言

近年来,随着社会经济的快速发展,人类活动日益增多,土地利用与生产建设需求愈发强烈,随之带来的监管难度越来越大。因此,发展土地利用监测技术,及时准确掌握地表建筑物变化对国家经济建设、生态建设和可持续发展起着至关重要的作用。

互联网、人工智能、遥感大数据等现代新兴技术发展迅速,驱动遥感智能监测、监控技术迅速崛起。深度学习等人工智能技术的引入进一步促进了遥感领域的蓬勃发展。依托人工智能、计算机视觉的相关研究,一大批基于遥感影像的智能应用如遥感图像配准、变化检测等取得了巨大的进步[1-2]。

遥感图像配准算法分为手动、自动、半自动3种不同方式,可见光传感器图像通常使用基于特征的图像配准算法。该算法需要提取稳定一致的特征,在遥感图像中,河流、湖泊、道路、标志性建筑物在不同成像分辨率和成像模式下均能保持稳定,且可以轻易区分。传统的图像配准算法通常采用基于SIFT、SURF、FAST等特征点描述子的特征点提取方法,这些描述符提取简单,易于使用,但对于图像源的差异变化不敏感,鲁棒性不强。而随着卷积神经网络的发展,基于卷积神经网络的特征提取与配准方法开始逐渐应用于图像配准中,如Alexey等[3]提出通用特征学习方法训练卷积神经网络,增强了特征的泛化属性与鲁棒性,在匹配任务中优于SIFT描述子;Yang等[4]使用预训练的VGG网络提取特征,在遥感领域取得了较好的效果;Ma等[5]提出基于DocUNet的配准方法,使用两层堆叠的Unet进行特征学习。然而,现有研究所使用的数据集尺寸较小(宽、高均小于1 000像素),无法适应如高分二号遥感图像等大尺寸数据的输入,因而限制了这些方法的实际场景使用。

近些年来,基于深度学习的多时相遥感图像变化检测方法也取得了长足的发展,它基于多层结构组成的模型能够学习具有多个抽象级别范围的数据样本的表示层次[6-7]。从方法上来说,应用于变化检测的深度学习方法可以分为4类:全监督、半监督、无监督和迁移学习。全监督方法通过从标记的训练数据集中学习输入图像与二值变化结果的映射关系来获得一个精度较高的模型[8-9];半监督与无监督方法主要用来处理大量可用于变化检测的成对数据无标注的问题[10-11];迁移学习则支持使用一种数据类型的训练模型去推理另一种数据类型的输出。以此3种方法为基础,模型一般选择孪生结构或基于U-Net结构处理数据[12-13],生成特征,输出结果。

然而,基于深度学习的变化检测方法都是针对已经预处理与配对完成的遥感影像,针对大尺寸影像的端到端变化检测的研究还处于起步阶段。当前各类针对遥感图像的处理模型,不论是基于传统方法还是基于深度学习方法,都只关注某一角度的问题。如果想要实现端到端一步到位地处理原始输入图像,并获取带有准确地理位置信息的最终变化检测结果,必须花费大量的时间进行模型筛选匹配、参数调优、中间流程数据处理等工作,不利于各类模型的落地应用。

针对上述问题,本文建立了端到端的遥感图像变化检测系统,以长江沿岸建筑物为研究对象,实现了集影像预处理、影像配准与变化检测的全流程自动化的功能。此外,在图像配准部分,将网格配准法与深度学习的方法结合,提出了适用于大尺寸遥感图像配准的深度学习方法,以期提升河湖岸线动态监测的效率。

1 遥感图像变化检测系统原理

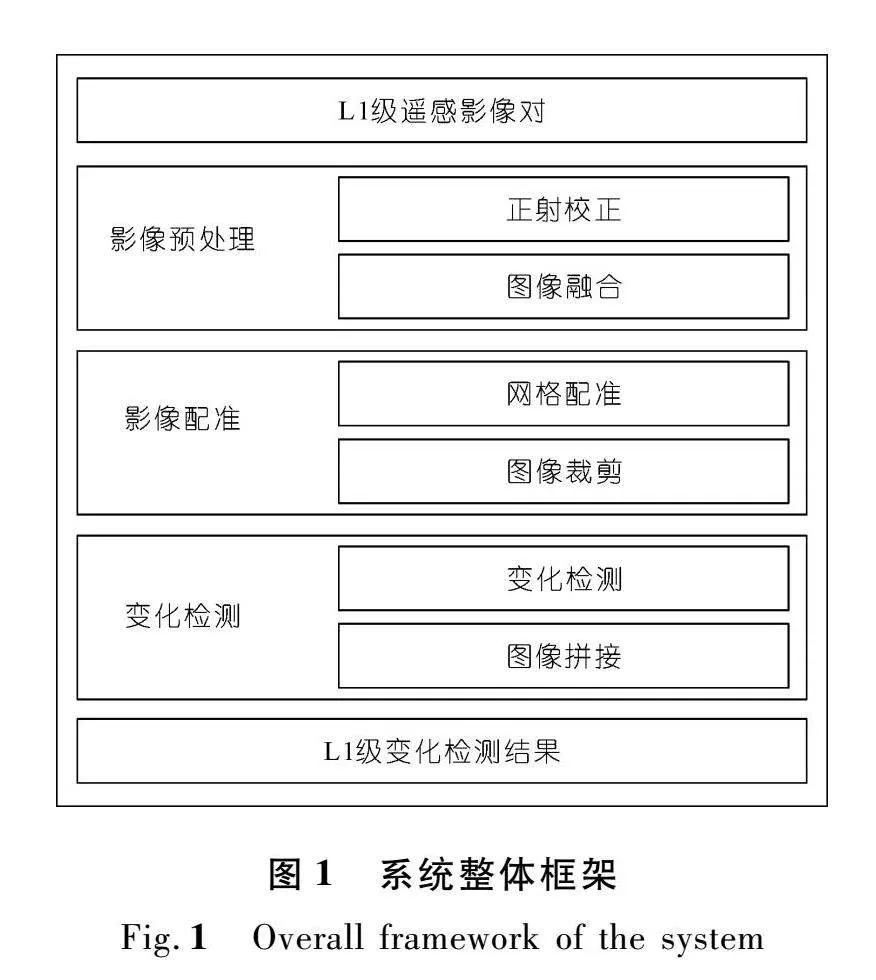

本文提出的遥感图像变化检测系统整体框架如图1所示,整个系统共分为3个部分:影像预处理、影像配准和变化检测。各部分以依次级联的方式形成端到端的处理流程,有效地提高了系统的处理效率。首先,系统以L1级遥感影像对作为输入,经过影像预处理得到用于影像配准的影像对;其次,该影像对通过网格配准、图像裁剪输出地理位置信息精准匹配、满足变化检测模型输入尺寸要求的影像对;最后,针对每一个裁剪的影像对输入到变化检测模型后产生的输出结果,按照裁剪方式拼接回原图即可得到二值化的变化检测结果。

1.1 影像预处理

该模型将两个包含MSS与PAN遥感图像的压缩文件作为整个系统的输入,经过解压、正射校正、图像融合这3个步骤的处理后生成一对遥感图像作为后续操作的输入。

其中,正射校正通过在图像中选取地面控制点,利用原来已经获取的该图像范围内的数字高程模型(DEM)数据,对图像同时进行倾斜修正和投影差修正,将影像重采样成正射影像[14]。本文使用的GF2数据中包含两类数据源:① 低分辨率的多光谱MSS图像,分辨率为3.2 m;② 高分辨率单波段PAN图像,分辨率为0.8 m。在经过正射校正后,这两类数据源的分辨率分别被调整为4.0 m与0.8 m。

图像融合操作是将低分辨率的多光谱图像与高分辨率的单波段图像重采样生成一幅高分辨率多光谱图像[15]。使用Gram-Schmidt Pan Sharpening(GS)方法来完成此操作,GS改进了PCA中信息过分集中的问题,不受波段限制,可较好地保持空间纹理信息,尤其是能高保真保持光谱特征。这个方法将分辨率为4.0 m的MSS图像与分辨率为0.8 m的PAN图像融合为分辨率为0.8 m的重采样结果图像,具体过程如下:

(1) 将多光谱影像的每个波段视为一个向量,将全色影像视为一个参考向量。

(2) 将全色影像的参考向量与第一个多光谱波段向量进行内积运算,得到一个标量。

(3) 将这个标量乘以第一个多光谱波段向量,得到一个新的向量。

(4) 将新的向量从多光谱影像中减去,得到一个新的多光谱波段向量。

(5) 重复以上步骤,将全色影像的参考向量与剩余的多光谱波段向量进行内积运算,并将得到的标量乘以相应的多光谱波段向量,然后从多光谱影像中减去,得到新的多光谱波段向量。

重复以上步骤,直到处理完所有的多光谱波段向量,即可得到全色波段和多光谱波段融合后的影像。图像预处理前后的输入与输出结果如图2所示。

1.2 影像配准

影像配准是变化检测模型的前提与基础。为适应遥感图像分辨率高、图像尺寸大的特点,本文提出基于网格的深度学习图像配准方法,在满足遥感图像数据输入需求的同时利用深度学习网络改善模型性能[16]。

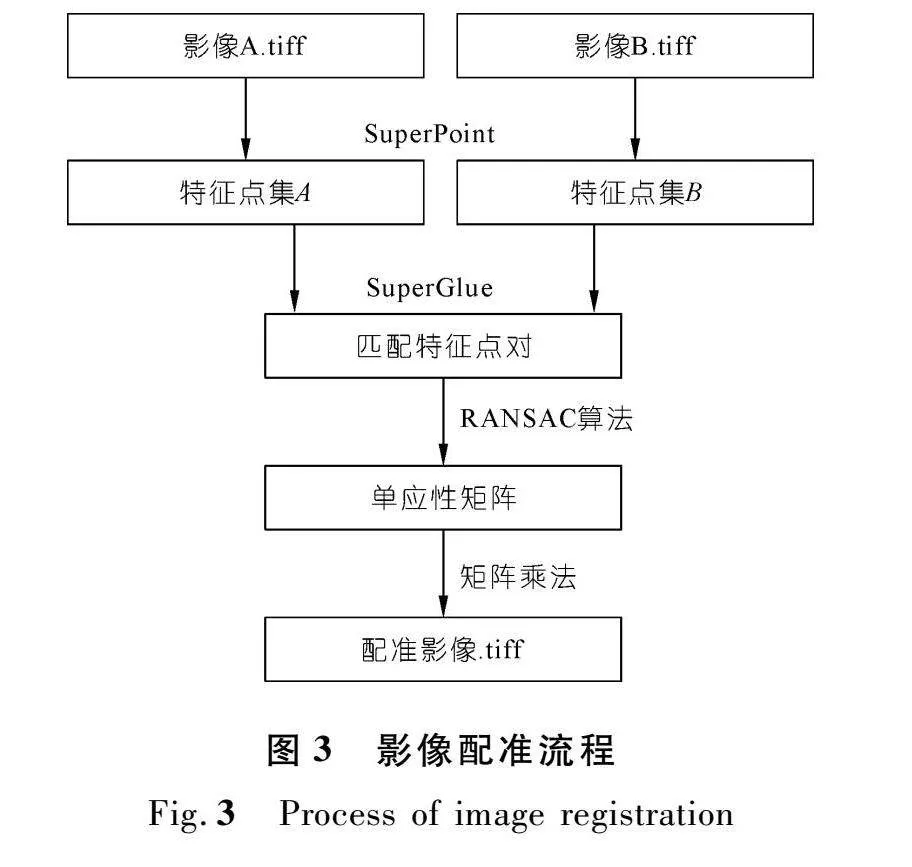

影像配准的整体结构可分为特征点提取、特征点匹配、单应性矩阵计算、图像变换等4个部分。整体流程如图3所示。

首先使用SuperPoint深度学习网络代替传统的SIFT特征提取器,对图像的特征点进行提取[17]。SuperPoint网络分为编码器与解码器两部分,其中解码器又分为特征点提取与描述符计算2个子网络,子网络共享编码器特征,分别输出特征点位置及其描述符。

其次,将得到的两组特征点集合及其描述符输入SuperGlue深度学习网络进行特征点匹配[18],SuperGlue网络将特征信息映射到高维空间,通过图神经网络中交替的自注意力与交叉注意力模块创建更强的描述信息,随后使用Sinkhorn算法获得匹配得分矩阵,对不能匹配的特征点进行剔除。

最后,由于图像对之间的仿射变换可以由单应性矩阵获得,使用RANSAC(随机一致性采样)算法通过所得的特征点对拟合单应性矩阵[19]。RANSAC算法是从一组含有噪声的数据中正确估计数学模型参数的迭代算法。RANSAC算法首先选择出可以估计模型的最小数据集,随机截取特征点子集计算数据模型(即拟合单应性矩阵结果),随后将其他特征点代入模型,评估剩余的特征点是否符合所得模型,以内点(即符合模型的特征点数量)作为模型评价指标,重复上述过程直至迭代结束并选择最优结果。得到最优单应性矩阵后,通过单应性矩阵与原始图像矩阵相乘,即可对原始图像进行变换,获得配准结果。

在配准流程中,为适应高分2号遥感图像分辨率高、尺寸大的特点,首先对图像进行缩放并使用SuperGlue算法进行粗配准,粗配准误差控制在20个像素以内。随后,使用网格法将一组景图像按区域进行划分,区域大小为1024×1024,图像尺寸不足的部分以0像素进行填充,以进行逐区域的图像配准。在经过区域的特征点匹配后,将特征点对映射到景图像并存储,最终以景图像的特征点对集合进行单应性矩阵的拟合。本文提出的图像配准算法在一景高分2号遥感图像上达到了2个像素以内的误差。

1.3 变化检测

为适应变化检测模型需求,将配准所得图像进行裁剪。同时,为防止图像中的部分建筑因裁剪而无法被检测,导致模型精度降低,在裁剪过程中加入了20%的区域重叠。

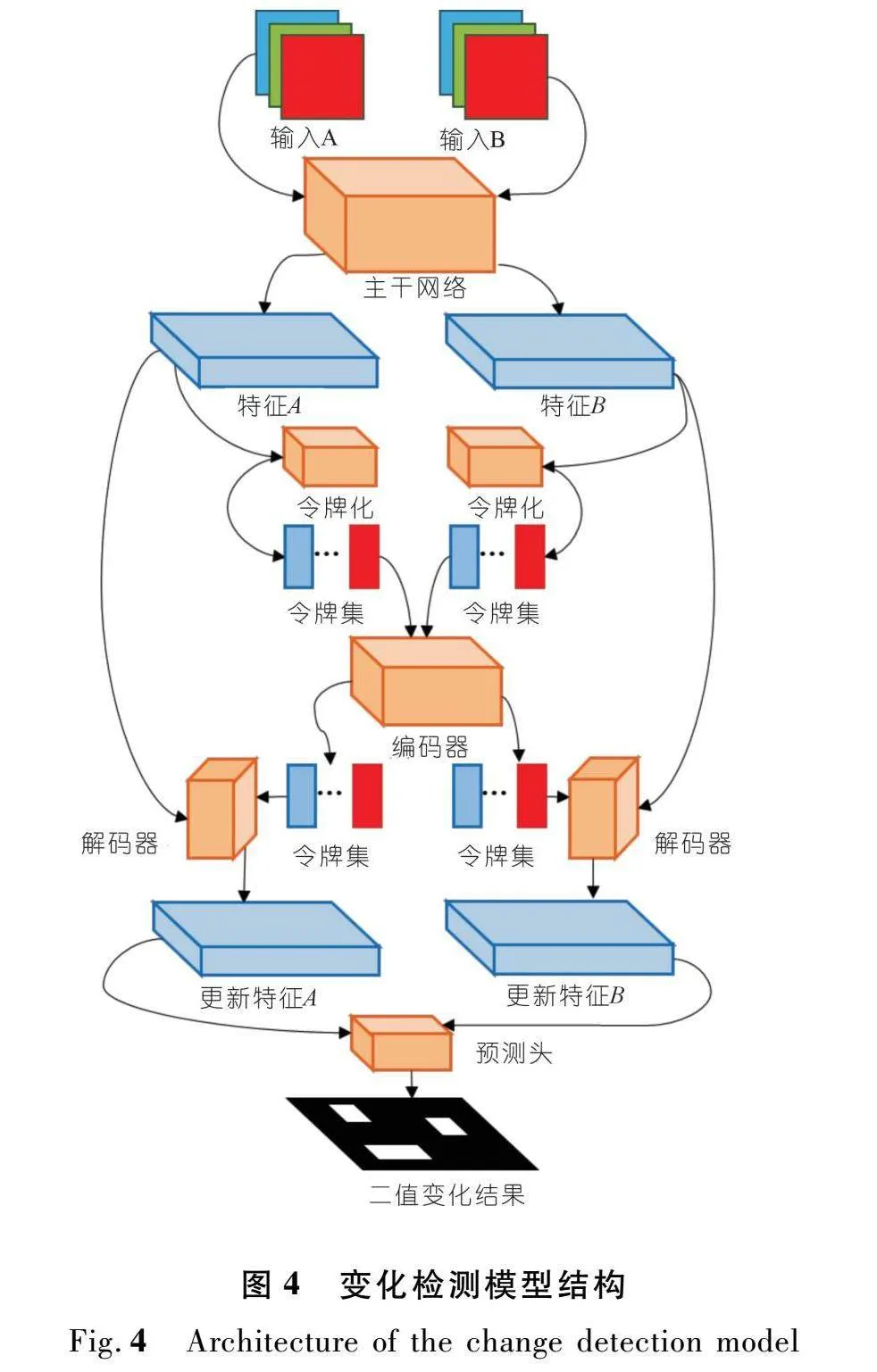

该模型的变化检测部分将剪裁为固定大小的一组图像对作为输入,每对输入是同一位置不同时间拍摄的经过一系列预处理的遥感视角图像,其对应结果为一张与输入图像对大小相同的二值图,1表示对应像素位置发生了变化,0表示未变化。为了完成上述任务,使用一种双时图像转换模块,通过高效建模上下文时空域信息,生成更加准确的变化检测结果。

在模型内部,将输入图像对表示为几个令牌,并使用转换编码器在基于令牌的紧凑时空中建模上下文,然后将学习到丰富信息的令牌通过转换解码器反馈给像元间隔以精炼原始特征[20]。

整个变化检测模型的结构如图4所示。

模型通过主干网络的卷积模块,得到每个输入图像的特征图,然后将它们送入特征增强部分生成增强的双时态特征。最后,将得到的双时态特征送入预测头以产生像素级的变化检测预测结果。整个网络有3个主要组成部分:第一是孪生语义标记器,将像素分组并为每个时间输入生成一个紧凑的语义令牌集;第二部分是变换编码器,对基于令牌的时空中的语义概念进行上下文建模;最后一个部分是孪生变换解码器,将对应的语义标记投影回像元间隔,得到每个时态的精细化特征图。

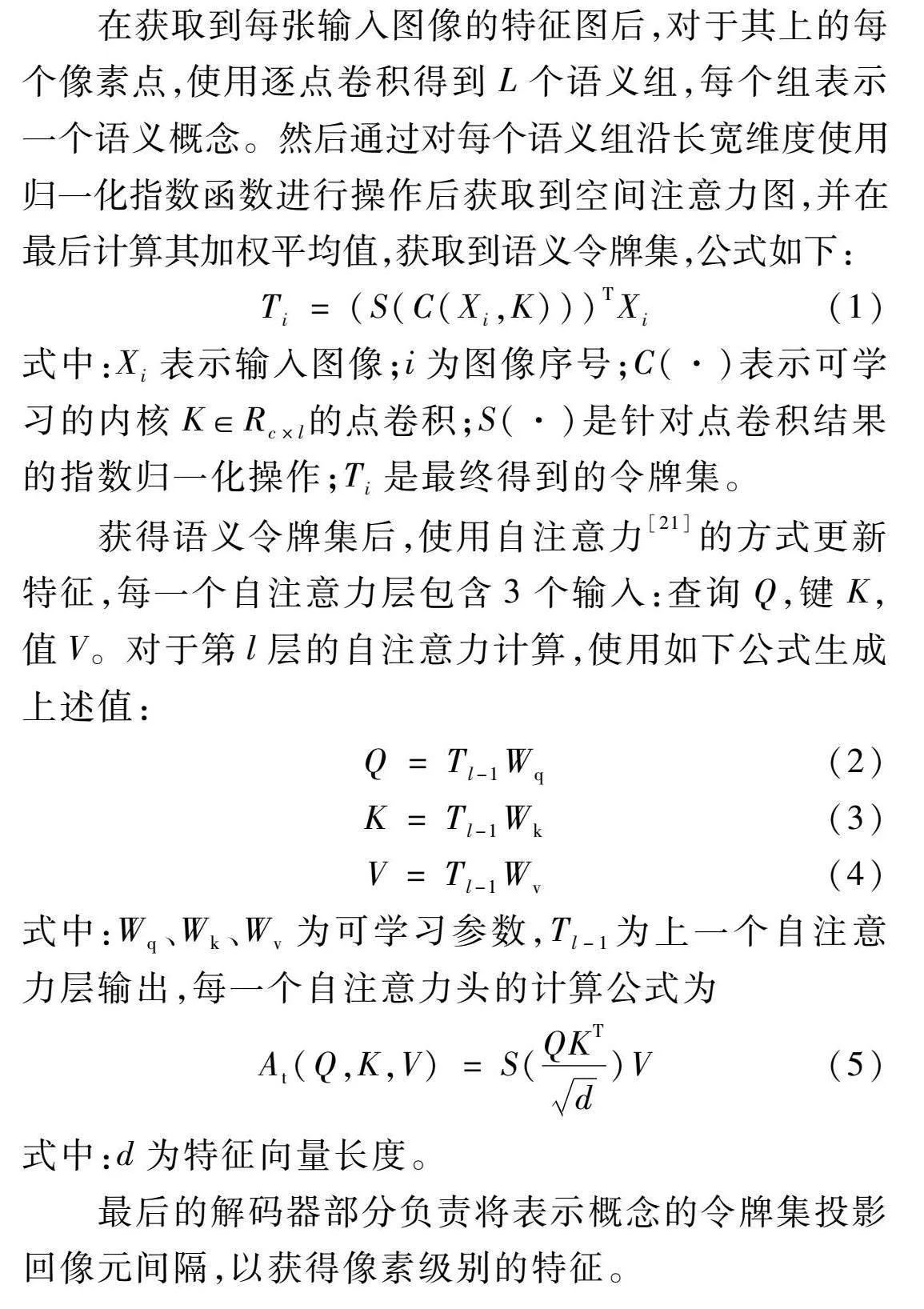

在获取到每张输入图像的特征图后,对于其上的每个像素点,使用逐点卷积得到L个语义组,每个组表示一个语义概念。然后通过对每个语义组沿长宽维度使用归一化指数函数进行操作后获取到空间注意力图,并在最后计算其加权平均值,获取到语义令牌集,公式如下:

Ti=(S(C(Xi,K)))TXi(1)

式中:Xi表示输入图像;i为图像序号;C(·)表示可学习的内核K∈Rc×l的点卷积;S(·)是针对点卷积结果的指数归一化操作;Ti是最终得到的令牌集。

获得语义令牌集后,使用自注意力[21]的方式更新特征,每一个自注意力层包含3个输入:查询Q,键K,值V。对于第l层的自注意力计算,使用如下公式生成上述值:

Q=Tl-1Wq(2)

K=Tl-1Wk(3)

V=Tl-1Wv(4)

式中:Wq、Wk、Wv为可学习参数,Tl-1为上一个自注意力层输出,每一个自注意力头的计算公式为

At(Q,K,V)=S(QKTd)V(5)

式中:d为特征向量长度。

最后的解码器部分负责将表示概念的令牌集投影回像元间隔,以获得像素级别的特征。

2 数据集

2.1 数据集标注

参考数据集标注软件LabelMe[22]及相关软件,使用适用于变化检测数据集标注的自制标注软件Labelme_cd进行样本标注(图5)。该软件基于Python语言的PyQt框架开发,通过多窗口同步标注的方式实现了一组变化图像中变化区域的联合标注。

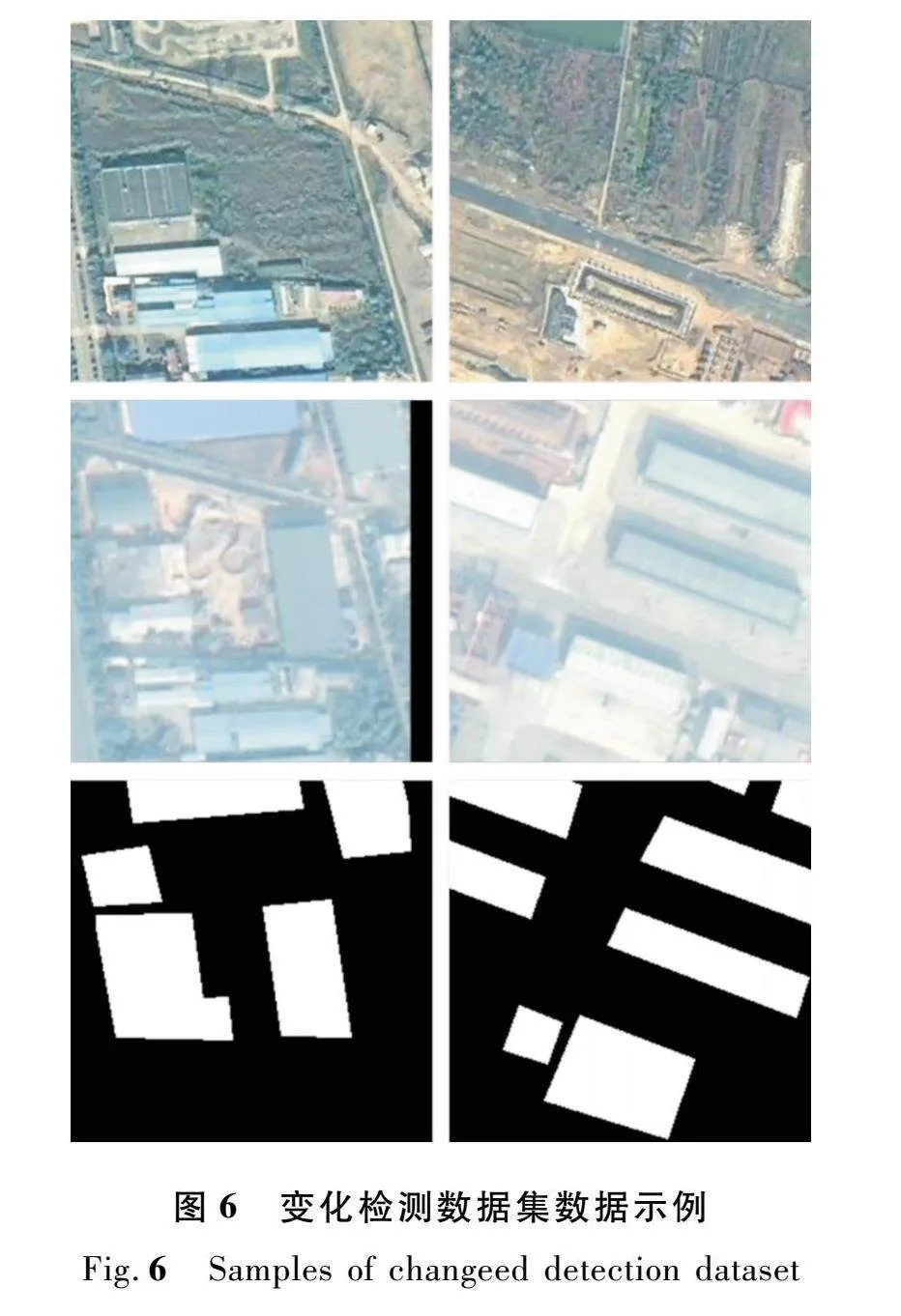

2.2 变化检测数据集

基于高分2号卫星遥感图像,共标注大小为512×512的变化检测数据集5 000对,并生成了相关掩模结果,以.png格式保存,部分数据样例如图6所示。

本文选择的图像时间从2016年到2022年不等,时间跨度从2 a到6 a不等,整个数据集中变化实例像素分布如图7所示。

3 结果分析

3.1 影像配准结果

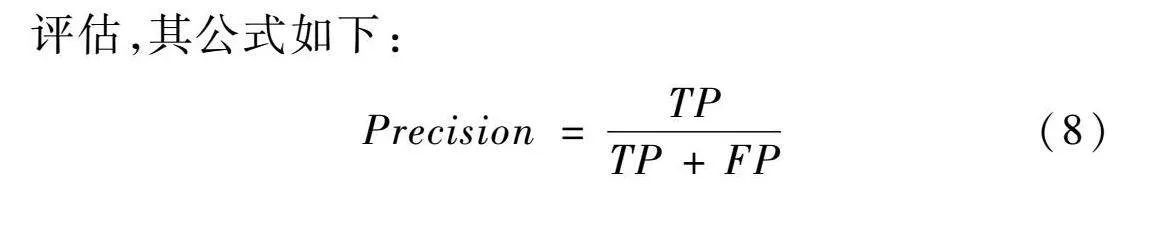

第i行第j列像素的影像配准效果使用下述公式进行衡量:

TEST(i,j)=P(i,j)×h(6)

Error=1M1NMi=1Nj=1(Norm(GT(i,j),TEST(i,j)))(7)

式中:N表示图像数量;M表示图像中控制点数量;Norm表示2-范数;GT表示真实结果;P表示待配准图像控制点;h表示单应性矩阵。

该公式表示取全部图像的全部控制点对,将其中一组图像的控制点对按照图3所述配准流程进行变化,将所得结果与另一组图像的控制点计算平均欧氏距离,作为最终的衡量指标。

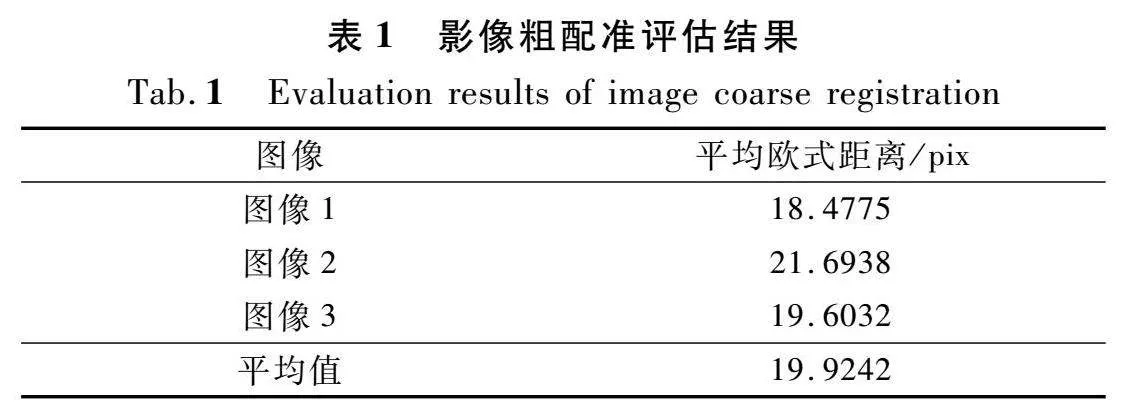

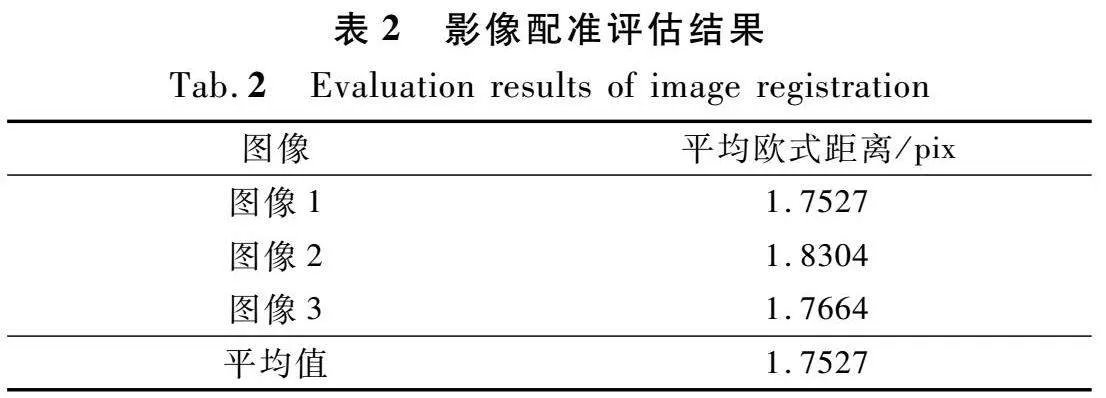

本文共选取了3景图像150对控制点进行指标计算,分别计算粗配准与最终配准精度,结果如表1~2所列。

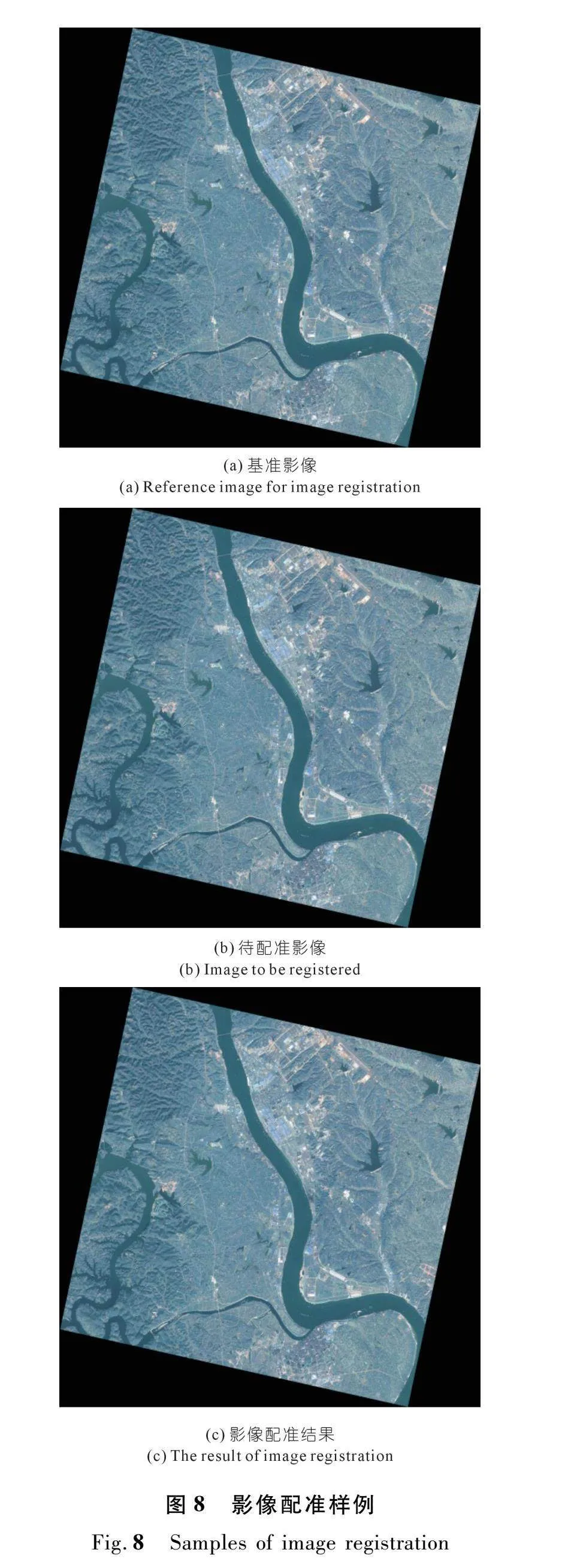

可以看到,最终配准结果相较于粗配准误差减少了90%以上,平均相对误差在4.5×10-5左右,使得遥感景图像配准精度在2个像素以内。配准的样例影像如图8所示。

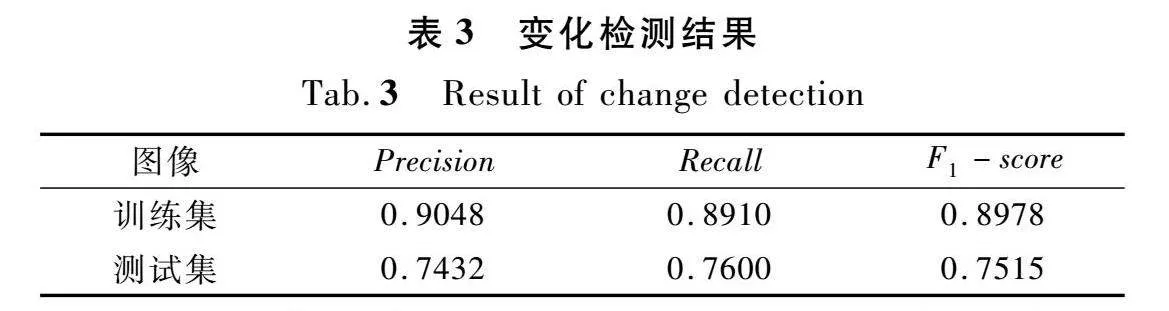

3.2 变化检测结果

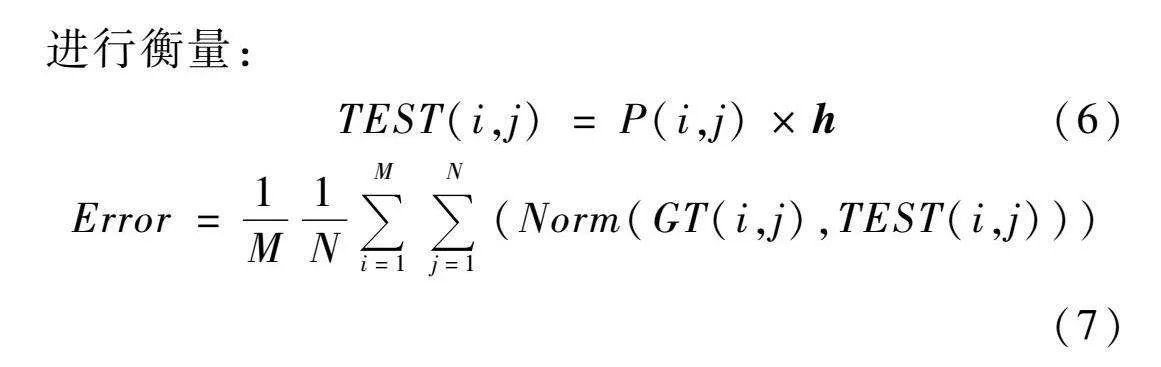

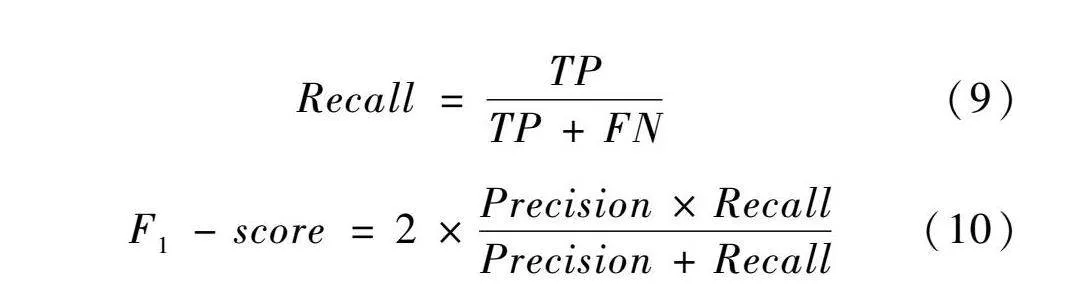

变化检测通常使用3个指标来度量模型的整体精度,即Precision、Recall和F1-score。Precision是正确预测的变化像素个数占所有预测的变化像素个数比例;Recall是正确预测的变化像素个数占标注的变化像素个数比例;F1-score是对于变化检测结果的总体评估,其公式如下:

Precision=TPTP+FP(8)

Recall=TPTP+FN(9)

F1-score=2×Precision×RecallPrecision+Recall(10)

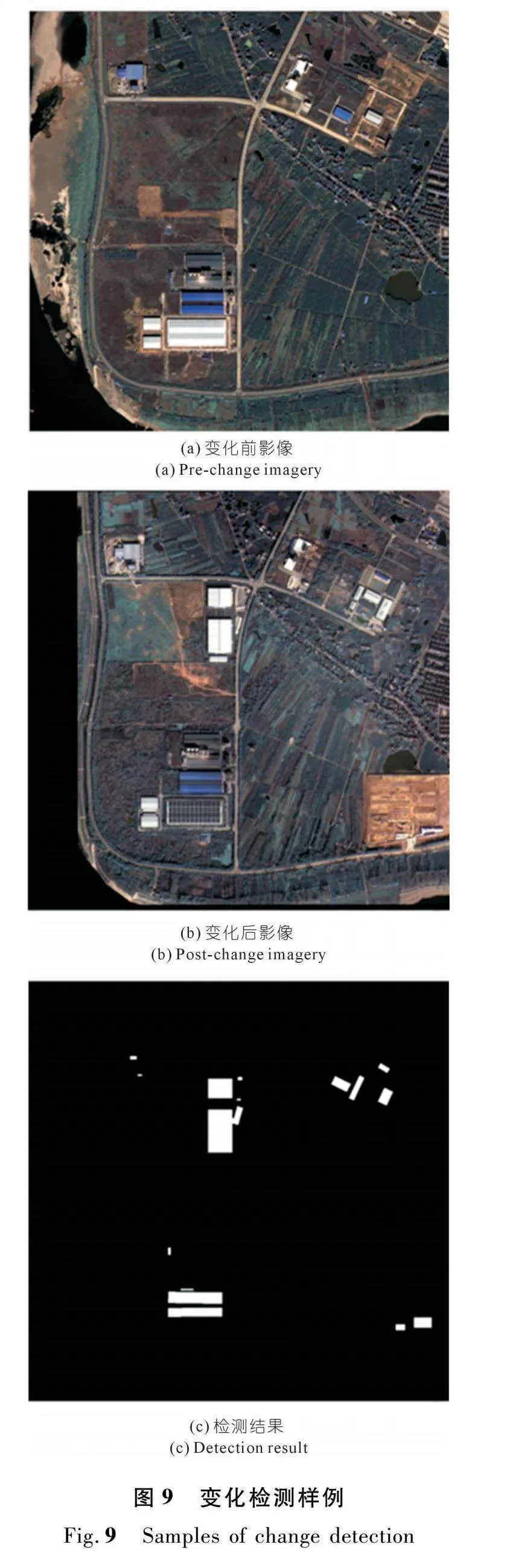

其中,TP为正确预测正类样本数,TN为正确预测负类样本数,FP错误预测正类样本数,FN为错误预测为负类样本数。最终,变化检测模型在提出的数据集上的测试指标如表3所列。可以看出,本文提出的变化检测模型在训练集上F1值达到了接近90%的效果,在测试集上F1值取得了优于75%的效果,模型整体精度较好。

以一对大小为2048×2048的遥感图像作为输入,最终的变化检测结果如图9所示。

4 结 论

本次研究基于长江沿岸遥感影像,设计并实现了包含影像预处理、影像配准、变化检测的长江流域沿岸建筑物变换检测系统,以监控长江沿岸大型工程建设的合理化、规范化,为长江流域岸线保护监测工作提供技术支撑,提高管理效率。实例研究表明,本文所提方法中影像配准方法的误差在2个像素以内,变化检测模型的F1值在测试集上达到了优于75%的效果。此外,该系统还可以进一步与数字孪生技术结合,为国家用地规划与建设保驾护航。

随着云计算、大数据、人工智能、虚拟现实与分布式计算的创新与发展,未来将更多地将新技术与本文所提出的变化检测系统进行融合,进一步优化系统效率,扩展应用范围[23],强化技术应用广度与深度,为全面实施“共抓大保护,不搞大开发”战略提供决策支持。

参考文献:

[1] 隆星宇,李辉,白雪山,等.基于深度学习的人工滑坡隐患自动识别新方法[J].人民长江,2023,54(7):113-120.

[2] ZHOU K,ZHANG Z,GAO C,et al.Rotated feature network formultiorientation object detection of remote-sensing images[J].IEEE Geoscience and Remote Sensing Letters,2020,18(1):33-37.

[3] ALEXEY D,FISCHER P,TOBIAS J,et al.Discriminative unsupervised feature learning with exemplar convolutional neural networks[J].IEEE TPAMI,2016,38(9):1734-1747.

[4] YANG Z,DAN T,YANG Y.Multi-temporal remote sensing image registration using deep convolutional features[J].IEEE Access,2018,6:38544-38555.

[5] MA K,SHU Z,BAI X,et al.Docunet:document image unwarping via a stacked u-net[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2018:4700-4709.

[6] LECUN Y,BENGIO Y,HINTON G.Deep learning[J].Nature,2015,521:436-444.

[7] GONG M,YANG H,ZHENG P.Feature learning and change feature classification based on deep learning for ternary change detection in SAR images[J].ISPRS Journal of Photogrammetry and Remote Sensing,2017,129:212-225.

[8] DAUDT R C,LE SAUX B,BOULCH A,et al.Urban change detection for multispectral earth observation using convolutional neural networks[C]∥IGARSS 2018-2018 IEEE International Geoscience and Remote Sensing Symposium.IEEE,2018:2115-2118.

[9] LEBEDEV M A,VIZILTER Y V,VYGOLOV O V,et al.Change detection in remote sensing images using conditional adversarial networks[J].The International Archives of the Photogrammetry,Remote Sensing and Spatial Information Sciences,2018,42:565-571.

[10]SAKURADA K,SHIBUYA M,WANG W.Weakly supervised silhouette-based semantic scene change detection[C]∥2020 IEEE International Conference on Robotics and Automation (ICRA).IEEE,2020:6861-6867.

[11]ZHENG Z,MA A,ZHANG L,et al.Change is everywhere:Single-temporal supervised object change detection in remote sensing imagery[C]∥Proceedings of the IEEE/CVF International Conference on Computer Vision,2021:15193-15202.

[12]ZAGORUYKO S,KOMODAKIS N.Learning to compare image patches via convolutional neural networks[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2015:4353-4361.

[13]DAUDT R C,LE S B,BOULCH A.Fully convolutional siamese networks for change detection[C]∥2018 25th IEEE International Conference on Image Processing (ICIP).IEEE,2018:4063-4067.

[14]李俊杰,傅俏燕.DEM对高景卫星影像正射校正的影响分析[J].地理空间信息,2021,19(9):50-52,60,7.

[15]张智华,余锦佩,李军伟,等.高分二号遥感影像融合方法比较分析[J].江西测绘,2022(4):31-34.

[16]李维,王瑞,邓传斌.基于SURF算子的遥感图像配准方法研究[J].单片机与嵌入式系统应用,2023,23(6):61-64,69.

[17]DE T D,MALISIEWICZ T,RABINOVICH A.Superpoint:self-supervised interest point detection and description[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition Workshops,2018:224-236.

[18]SARLIN P E,DE T D,MALISIEWICZ T,et al.Superglue:learning feature matching with graph neural networks[C]∥Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition,2020:4938-4947.

[19]FISCHLER M A,BOLLES R C.Random sample consensus:a paradigm for model fitting with applications to image analysis and automated cartography[J].Communications of the ACM,1981,24(6):381-395.

[20]CHEN H,QI Z,SHI Z.Remote sensing image change detection with transformers[J].IEEE Transactions on Geoscience and Remote Sensing,2021,60:1-14.

[21]VASWANI A,SHAZEER N,PARMAR N,et al.Attention is all you need[C]∥31st Annual Conterence on Neural Information Processing Systems,Long Beach,CA USA,2017,30:5998-6008.

[22]RUSSELL B C,TORRALBA A,MURPHY K P,et al.LabelMe:a database and web-based tool for image annotation[J].International Journal of Computer Vision,2008,77:157-173.

[23]祁兰兰,王金亮,农兰萍,等.基于GF-1卫星数据的洱海干季水质时空变化监测[J].人民长江,2021,52(9):24-31.

(编辑:郭甜甜)

Change detection system of remote sensing images based on neural network

WANG Xiang1,ZHANG Zhixin2,3,4,MOU Haodong5,LIU Tianhang5,ZHANG Yusong1,ZHANG Yuzhu1

(1.China Yangtze Power Co.,Ltd.,Wuhan 443000,China; 2.Network & Information Center,Changjiang Water Resources Commission,Wuhan 430010,China; 3.Center of Technology Innovation for Digital Enablement of River Basin Management,Wuhan 430010,China; 4.Smart Changjiang Innovation Team of Changjiang Water Resources Commission,Wuhan 430010,China; 5.School of Artificial Intelligence and Automation,Huazhong University of Science and Technology,Wuhan 430074,China)

Abstract:

Change detection is a highly valuable research branch in the field of computer vision.In order to improve the monitoring efficiency of production and construction activities along the Changjaing River,a building change detection system along the Chanjiang River was proposed on the basis of image registration,combined with self-attention and feature extraction.It integrated image processing,image registration and change detection,achieving automatic operation across overall processes.The results show that the designed system minimizes the registration accuracy error within two pixels,achieving pixel-level accuracy.Moreover,the system achieves a result of more than 75% in terms of F1 score on the proposed change detection test dataset,demonstrating its high accuracy.The research can be further applied in the shoreline management of large reservoirs,improving the efficiency of governance of reservoirs.

Key words:

remote sensing images; artificial intelligence; image registration; change detection; shoreline mornitoring