基于四足机器人的工业仪表数字识别方法研究

摘 要:在工业现场自主巡检中,由于定位误差和光线角度等因素的影响,使得四足机器人仅依靠机器视觉难以实现高精度的仪表数字识别。针对上述问题,提出一种结合移动机器人运动的工业仪表数字识别方法。该方法首先基于图像感知的四足机器人控制策略实现仪表对准,来获取大小适中的仪表图片,进而使用改进自动色彩均衡(ACE)算法提高图片清晰度,并使用改进高效准确的场景文本(EAST)检测器来优化仪表数字漏检情况,最后获得仪表数字识别结果。在基于四足机器人的工业巡检实验平台中验证了该识别方法,实验结果表明上述方法对工业仪表数字识别准确率达97.75%。

关键词:四足机器人;巡检;感知与控制;工业仪表;文本检测;数字识别

中图分类号:TP242 文献标识码:A 文章编号:2095-1302(2024)03-000-05

0 引 言

近年来,移动机器人与人工智能技术结合越来越紧密。四足机器人作为移动机器人技术应用落地的一个重要分支,有着优秀的越障能力,可以在地形复杂的工业现场对仪表、指示灯、货物等进行巡检[1-4]。仪表是工业生产的重要数据来源,数显式仪表因具有显示简单、精确度高等优点而获得广泛应用。目前数显式仪表的读数方法有三种:人工读表、自动抄表[5]和图像识别。人工读表成本高昂,而自动抄表的改造成本高、周期长。通过图像处理技术能很好地对数显式仪表进行数字识别[6]。四足机器人搭载摄像头能够做到对工业仪表24 h不间断巡检,降低人工成本[7]。

徐明辉[8]研究并设计了一种搭载摄像头的自主导航机器人,进行仪表位置的巡航工作,使其能够对准不同高度的仪表表盘;施会斌[9]设计实现了变电站巡检机器人自动抄表系统,通过RFID技术完成对目标仪表区域的搜寻,基于轻量级YOLOv4数字式仪表读数识别算法对变电站数字仪表进行读数识别;何配林[10]针对工业仪表图像在自然场景中可能存在光照不均匀、图像模糊等问题,基于Mask-RCNN实例分割网络、全卷积网络和K-Means聚类等算法,提出了一种指针和数字式的多块、多种、多类型仪表同时读数识别算法。

1 四足机器人工业仪表数字识别系统构成

四足机器人的工业仪表数字自主识别方法是以广角摄像头实时获取外界信息为主的系统,系统的组成包括:四足机器人本体、激光雷达、广角摄像头、工业仪表等。四足机器人工业仪表实验场景如图1所示,四足机器人工业仪表数字识别流程如图2所示。

2 面向工业仪表数字识别的四足机器人控制策略

与轮式机器人平移稳定不同,四足机器人每条腿都拥有着3个自由度,步态控制较为复杂,在工业现场根据传感器获取地面状况产生实时步态,此时搭载的摄像头晃动剧烈,加之位姿偏移、激光定位误差等问题,使得获得图像的清晰度不够,因此有必要设计一个控制策略来调整四足机器人的位姿。

如图3所示,图中画出了仪表的检测框,(xtl, ytl)和(xbr, ybr)是检测框的左上角坐标和右下角坐标,由此可以计算出检测框中心点的坐标(xc, yc);l1和l2是两条竖直方向上的三等分线,将图片分成左侧区域、中间区域和右侧区域。

在本文设计的控制策略中,当满足检测框中心点处在l1和l2之间即xl1≤xc≤xl2,且检测框面积detect_area≥S时,认为此时得到的是形状规则、大小适中的高清仪表图片。

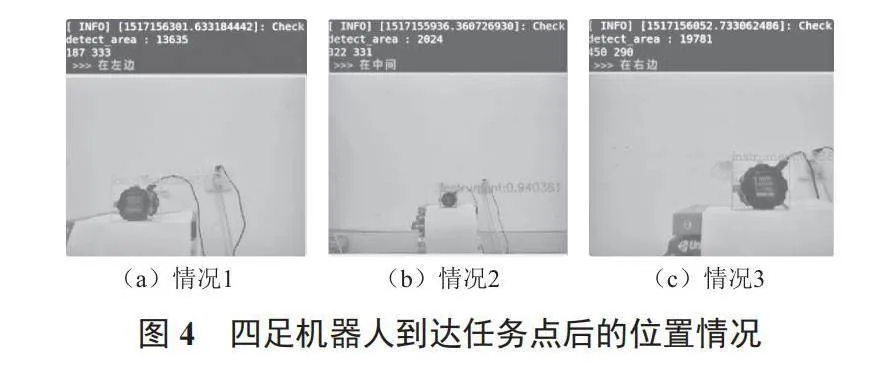

在控制逻辑上区域条件的优先级大于面积条件的优先级,所以当不能满足上述两个条件时,有3种情况需要进行调整,当xc≤xl1即中心点落在左侧区域时,四足机器人处于图4(a)的情况1;当xl1lt;xc≤xl2即中心点落在中间区域但是面积条件不满足时,四足机器人处在图4(b)的情况2;当xcgt;xl2即中心点落在右侧区域,四足机器人处在图4(c)的情况3。考虑到由于误差会出现四足机器人在任务点检测不到仪表的情况,四足机器人会重新规划路径导航至任务点进行第二次仪表检测,直到检测到仪表。

如图5所示,对四足机器人的控制策略进行描述:感知主机截取摄像头传输的视频帧,计算仪表检测框的面积和其中心点位置,首先判断中心点坐标是否落在l1和l2之间,若是,则判断是否满足面积条件,对应图4(b)情况2;如不是,则需要判断中心点处于左侧区域还是右侧区域,此时对应于图4(a)的情况1和图4(c)的情况3;当中心点处于左侧区域时,感知主机与运动主机进行通信,运动主机会发布腿部移动指令,四足机器人以线速度ν(单位为m/s)右移;判断位移距离d是否大于α(单位为cm),若不是则继续移动,若是则停止移动,当中心点处于右侧区域时同理。接着返回区域条件判断进行循环判断、移动,直到满足区域条件,当区域条件满足后判断面积条件detect_area是否大于等于S,若不是,则以线速度ν前进;判断位移距离d是否大于α,循环判断、移动,直至detect_area大于等于S,此时控制策略结束。

3 面向工业仪表数字识别的图片色彩增强方法

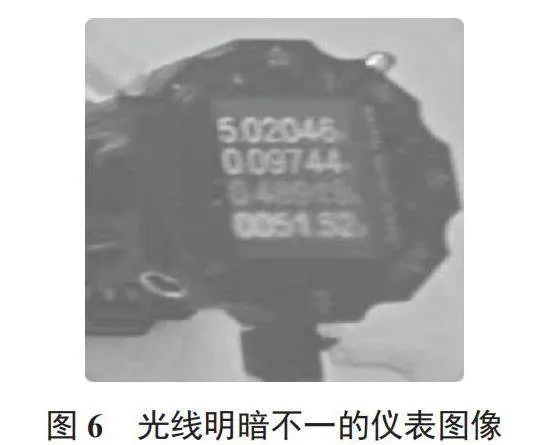

由于光源和相机角度的问题,四足机器人获取的图像经常出现模糊和明暗不一的情况。如图6所示,工业功率数显表从上到下分别是电压、电流、功率和电阻,且图中4个参数明暗不一和数字模糊。因此,本文使用改进ACE算法[11]对图片进行色彩增强。

图6 光线明暗不一的仪表图像

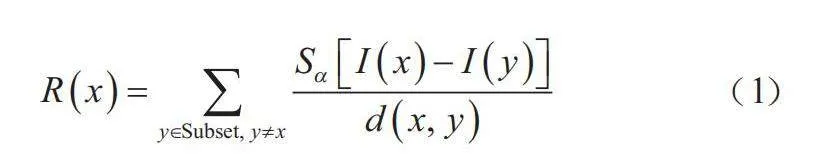

一张图片可分为低频分量和高频分量,其中高频分量出现在图片的细节部分,ACE算法经过低通滤波获得低频分量,将原始图片减去低频分量得到高频分量,用增益系数乘以高频分量,重组得到增强后的图片。ACE算法的基本公式如下所示:

(1)

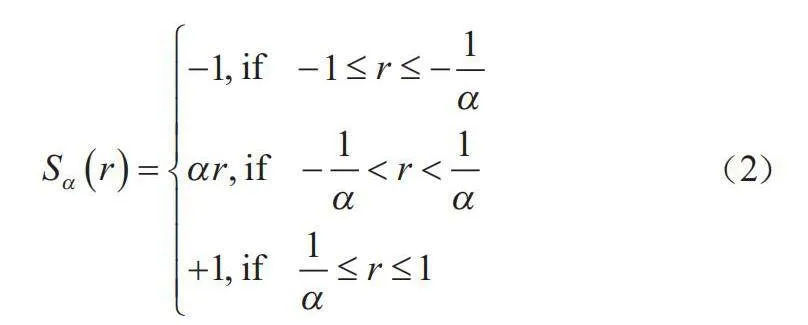

式中:R(x)代表彩色空间调整结果,它是一个中间处理值;Subset是图像像素集;x是固定像素值;y是可变化像素值;I(x)-I(y)代表两个像素之间强度差;d(x, y)是距离度量函数(一般为欧拉距离)。Sα的表达式如下:

(2)

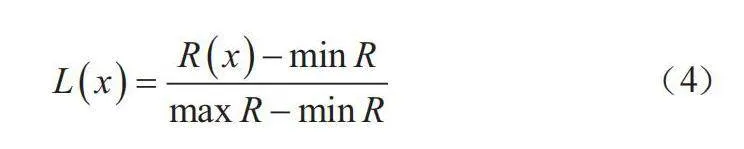

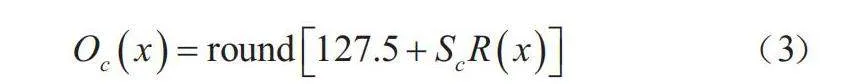

式中:α是斜率;Sα为斜率函数,Sα在三个范围下进行取值,r=I(x)-I(y)。然后对调整后的图像进行扩展。一张彩色图像具有R、G、B三个通道,对每个通道进行线性扩展,表达式如下所示:

(3)

式中,斜率Sc为[(mc, 0), (Mc, 255)],且mc是R(x)的最小值,Mc是R(x)的最大值。最后,将上式映射到[0, 255]的空间中。

(4)

本文针对数字识别需求对y的范围进行改进,使用YOLOv5[12]检测仪表框对仪表进行图像分割,尽可能地去除仪表外的其余像素,减少了ACE算法的运算量,节省了运行时间。此外为了更好地增强图像的高频部分,本文使用Huber函数[13]对式(4)的权重进行改进,结合欧氏距离函数,计算得Huber权重函数如下所示:

(5)

式中:可变像素值y与固定像素x之间的欧氏距离dy=1/||x-y||;d是所有dy的均值。若dy小于均值d则权重wy为1;若dy大于均值d则权重wy小于1;欧氏距离越大,即距离固定点越远,权重系数越小,其色彩增强效果也越小。

4 工业仪表数字漏检算法改进

在对图片进行色彩增强并提高图片清晰度后,将传统的EAST算法[14]应用到四足机器人的仪表数字检测中能够减少计算量。与自然场景广阔视野中会出现检测框不完整的情况不同,四足机器人在通过控制策略调整完自身位姿后,获得的图片视野范围较小,进行仪表数字识别会出现仪表某一行数字漏检的情况。

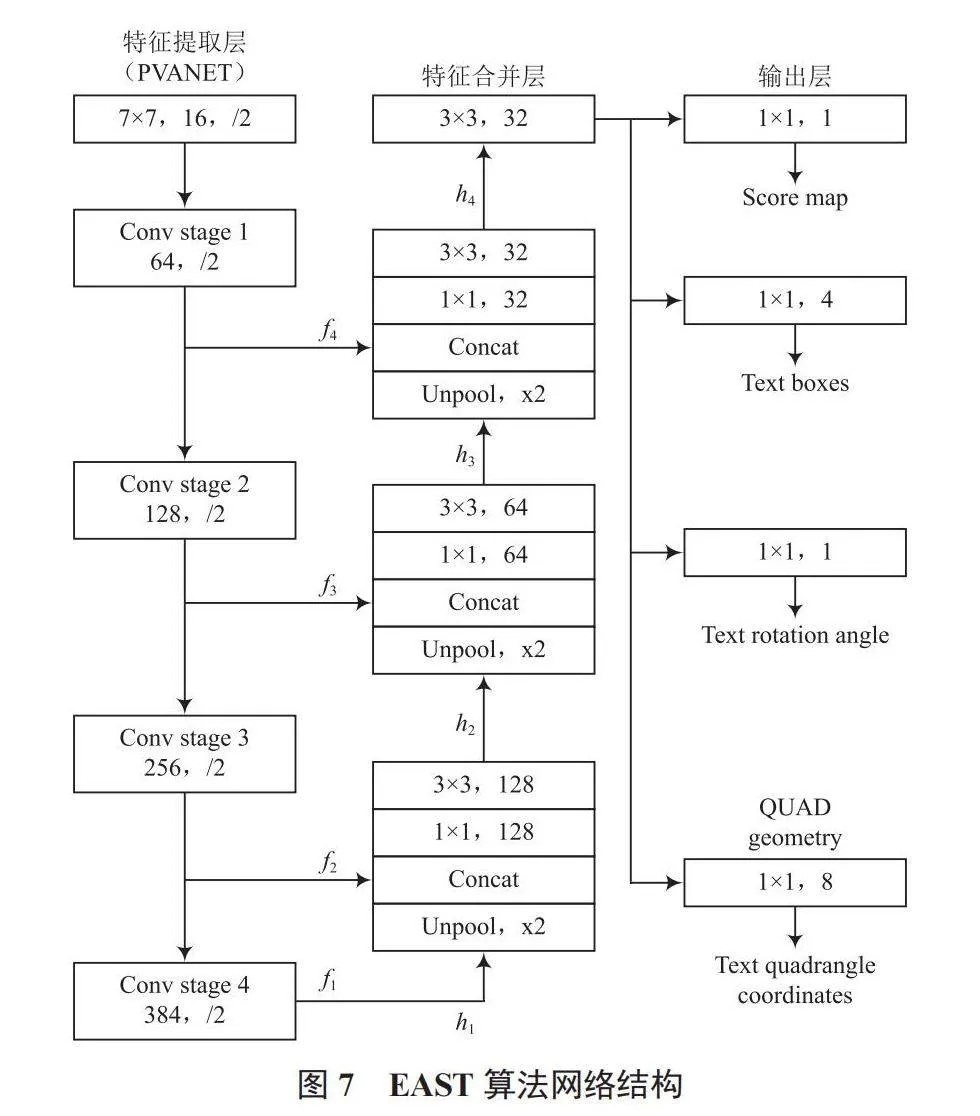

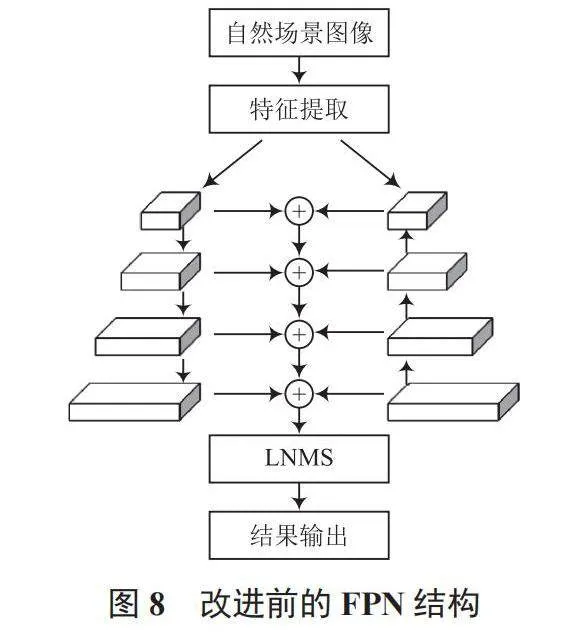

EAST文本检测算法结构由特征提取层、特征合并层、输出层组成,形成特征金字塔网络(FPN)结构,如图7所示。

如图8所示,EAST算法采用了4层FPN结构,在特征合并层进行融合,将小尺寸特征图进行卷积,形成与大尺寸特征图一样的尺寸,再将其连接起来。通过结构图可知,小区域感受野特征图位于FPN结构的最底层,小区域感受野特征图在最后进行融合后输出。这种处理方法会使得小区域感受野特征图处理过少,且当通道数较少时融合后相应特征信息所占比例较少,就造成了EAST算法对某些区域关注度不够,不利于后续的图片识别。

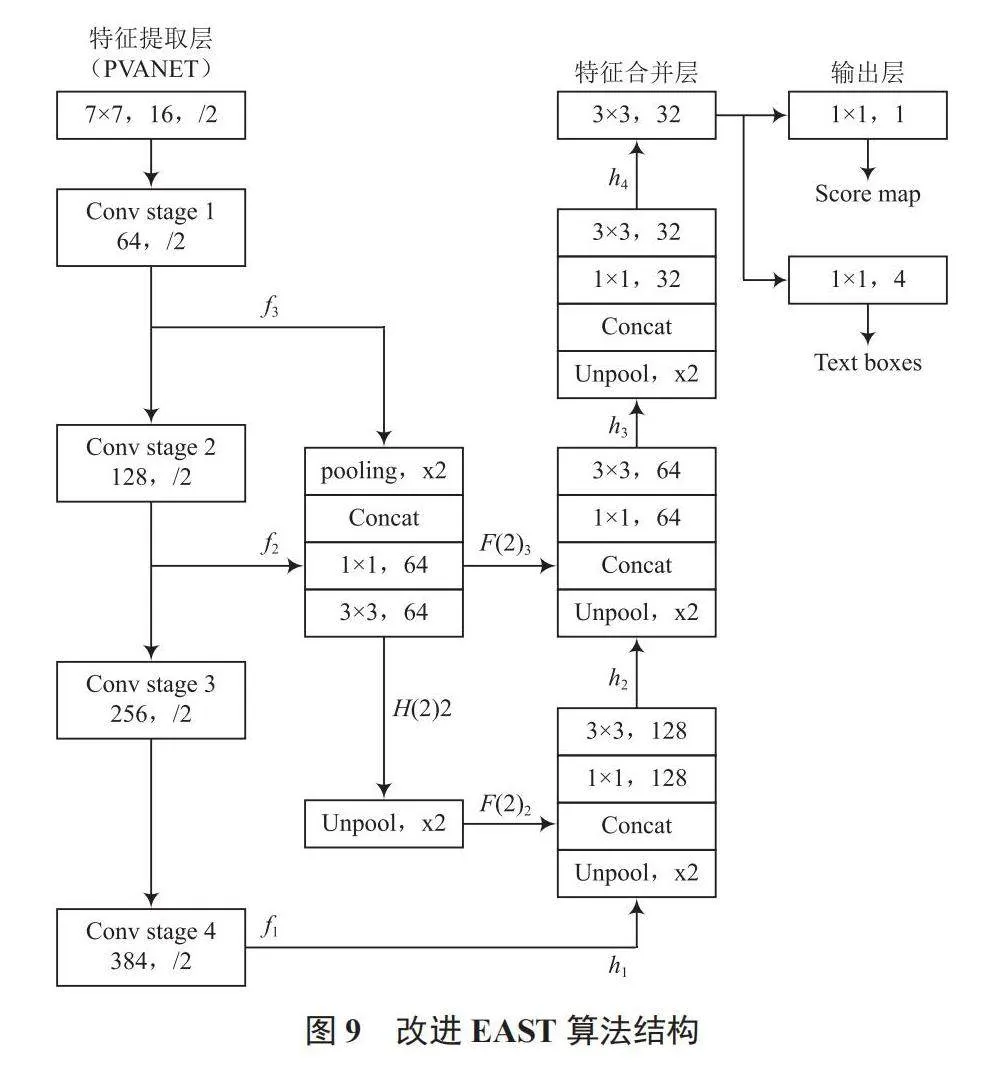

本文改进了FPN结构,在合并方向相反的路径上只对特征金字塔的前两层进行合并(是原EAST算法中关注度不够的部分),然后再与另一方向路径进行融合,具体结构如图9所示。将卷积stage1得到的特征图送入pooling层,尺寸缩小1倍后,与卷积stage2得到的α特征图经Concat融合;然后依次送入1×1、3×3的卷积核,得到F(2)2和F(2)3。将抽取的特征图按照U-net的思想进行合并,卷积核的个数逐层递减,依次为128、64、32;最后经过32核3×3卷积后将结果输出到“输出层”,最终输出工业仪表数字检测框的置信度score map和检测框的位置(x,y,w,h)。

5 实验验证

5.1 四足机器人的控制策略实验验证

为了验证本文中四足机器人的控制策略可以有效获取形状规则、大小适中的仪表高清图片,四足机器人进行50次SLAM导航,统计有无控制策略前后检测框面积大小在整个图片中的面积占比和运动控制调节次数。本文中,d是平移后的位置坐标与上一个位置坐标之间的欧氏距离;最终经过大量实验,阈值α取4.4 cm,平移速度ν取0.1 m/s,该速度是四足机器人移动的最低线速度。

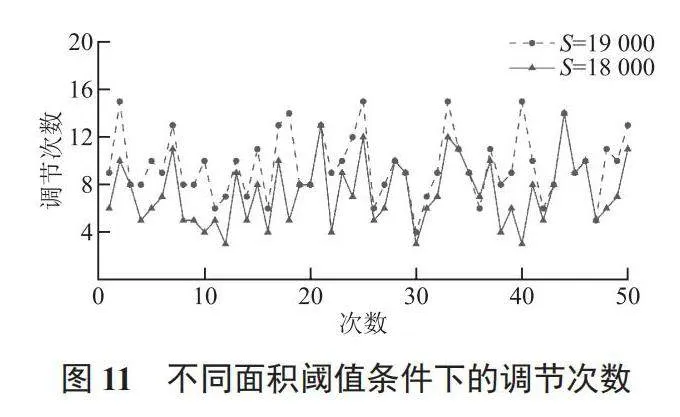

图10表明,在无控制策略时,四足机器人获得的仪表检测框面积占比基本都小于有控制策略情况下的面积占比,且完全取决于SLAM定位误差。图11展示了S=18 000像素单位和S=19 000像素单位时四足机器人仪表数字识别时调节的次数,平均调节次数分别为7.36和9.6。

接下来采用ACE算法和EAST算法进行100次实验,收集100张图片,共400个数据,统计并对比四足机器人有无控制策略前后识别仪表数字的效果,结果见表1所列。四足机器人在无控制策略情况下,通过SLAM控制到达目标仪表前面进行数字识别,此时获得图片的清晰度是随机的,取决于刚开始记录的任务点位置和导航定位误差,其中96%为无效识别;在有识别结果的图片中,其结果个数最多为1,正确率仅为1.75%。

在有控制策略情况下,无效识别的情况得到了极大改善。表1的结果表明,S=18 000像素单位时的情况相比无控制策略的无效识别率降低了91%,数字识别正确率提高到了89%;进一步提高S到19 000像素单位,数字识别正确率提高到93%。结合图11可知,后者通过牺牲少许的调节次数来换取高水平的数字识别准确率,前者却无法保证较高的数字识别水平。如果继续提高S的阈值,会使得调节次数陡增,detect_area的阈值S取19 000像素单位是由大量实验测试获得的最佳取值。实验结果验证了本文控制策略的有效性,表明四足机器人在该控制策略下使得无效识别率大幅度降低,提高了识别正确率。

5.2 四足机器人的图像色彩增强算法验证

该部分实验分别使用ACE算法和改进ACE算法计算一张1 152 648的原图经过图像切割后的运行时间,进行100次计算。

见表2所列,改进的ACE算法比ACE算法的运行时间要短,最大运行时间节省2.401 s,最小运行时间节省2.274 s,平均运行时间节省2.259 s,运行效率平均提高了89.71%。

采用ACE算法和改进的ACE算法对切割后的仪表表盘进行图像增强,结果如图12所示,可以明显看出改进ACE算法使得数字图像色彩变得更均衡,图像更清晰。

接下来采用EAST算法在S=19 000像素单位下进行100次实验,共收集400个数据,统计并对比四足机器人在改进ACE算法前后识别仪表数字的效果,结果见表3所列。改进ACE算法能够提高收集到图片的清晰度,降低错误识别数和无效识别数,错误识别率从3.75%降低到2.25%,无效识别率从3.25%降到2%。可以看出,改进ACE算法有效地改善了四足机器人在仪表数字识别过程中出现的数字区域明暗不一的问题。

5.3 改善四足机器人数字漏检实验验证

针对仪表数字识别存在仪表数字漏检情况,本文对EAST算法的检测网络进行改进,提高对小感受野的关注度,优化检测效果。改进EAST算法对仪表数字识别的效果如图13所示。

该部分在S=19 000像素单位和改进EAST算法下进行了100次实验,共收集400个数据,统计并对比四足机器人在改进文本检测算法前后识别仪表数字的效果,结果见表4所列。四足机器人在进行仪表四个参数识别时,由于红色功率数字的明度与黑色仪表表盘的明度最为接近,导致红色的功率数字漏检的次数最多。在改进EAST算法下,四足机器人仪表数字识别正确率提高到97.75%,无效识别率从2%降低到0.25%。

6 结 语

目前,有关数字识别的工作主要集中在图像采集、图像处理以及识别算法上,而对于四足机器人在工业现场实时控制的应用则甚少涉及。本文提出一种结合移动机器人运动的工业仪表数字识别方法,并在基于四足机器人的工业巡检实验平台中进行了验证。实验结果表明,上述方法能够有效提升工业仪表数字识别的正确率,为四足机器人在工业仪表巡检中的应用提供重要的参考。

参考文献

[1]孟健,刘进长,荣学文,等.四足机器人发展现状与展望[J].科技导报,2015,33(21):59-63.

[2]张伟,谭文浩,李贻斌.基于深度强化学习的四足机器人运动控制发展现状与展望[J].山东大学学报(医学版),2020,58(8):61-66.

[3]朱秋国.浅谈四足机器人的发展历史、现状与未来[J].杭州科技,2017,47(2):47-50.

[4]张帅帅.复杂地形环境中四足机器人行走方法研究[D].济南:山东大学,2016.

[5]唐贤敏,石云辉.电能计量自动抄表技术的现状与展望[J].中国新通信,2018,20(20):224.

[6]封磊.基于机器视觉的工业仪表自动读数方法研究[D].太原:太原科技大学,2021.

[7] YANG X D,HUANG Y Z,LI J G,et al. Research status review of robots applied in substations for equipment inspection [J]. Shandong electric power,2015,42(1):30-33.

[8]徐明辉.用于仪表位置寻找的自主导航机器人研究[D].西安:西安理工大学,2021.

[9]施会斌.变电站巡检机器人自动抄表研究[D].成都:西南交通大学,2021.

[10]何配林.基于深度学习的工业仪表识别读数算法研究及应用[D].成都:电子科技大学,2020.

[11]肖志云,李新科,轩波,等.对数域中自动色彩均衡化快速算法

[J].计算机辅助设计与图形学学报,2013,25(3):390-396.

[12] SHI B,BAI X,YAO C. An end-to-end trainable neural network for image-based sequence recognition and its application to scene text recognition [J]. IEEE transactions on pattern analysis and machine intelligence,2017,39(11):2298-2304.

[13]赵开开,刘兆祥,廉士国.基于级联卷积神经网络的指针式仪表远程读数方法和系统[J].电力大数据,2021,24(8):25-32.

[14] ZHOU X,YAO C,WEN H,et al. EAST:an efficient and accurate scene text detector [C]// 2017 IEEE Conference on Computer Vision and Pattern Recognition. Honolulu,HI,USA:IEEE,2017:5551-5560.

作者简介:简荣贵(1997—),男,硕士研究生,研究方向为四足机器人。

陈 康(1974—),男,副教授,研究方向为电机与IC设计。

徐哲壮(1984—),男,教授,研究方向为工业物联网与大数据。