基于 BPNN-SVM-ELM 融合算法的气化炉预测模型

摘要:基于遗传算法-反向传播神经网络(GA-BPNN)、遗传算法-支持向量机(GA-SVM)、 极限学习机(ELM)单一数据驱动模型稳定性差、信息熵线性融合模型建立时间成本高的问题, 提出了信息熵 Stacking 融合建模法。使用工厂实际生产数据,以气化炉负荷、进料压力与流 量、激冷水流量为输入,以气化炉出口温度、水洗塔出口合成气温度与流量、合成气组成为输 出,建立了气化炉的信息熵 Stacking 融合预测模型。结果表明:信息熵 Stacking 融合模型预测 项—气化炉出口温度、水洗塔出口合成气温度与流量、合成气中 CO 含量与 H2 含量这 5 个参 数的平均相对误差(MRE)分别为 1.89%、0.17%、0.78%、0.95% 与 0.71%,均表现良好且较 单一数据驱动模型更加稳定,拟合速度较信息熵线性融合模型提升约 19%。模型可结合优化算 法应用于气化过程氧气与煤浆流量比等操作条件的在线优化以及气化炉气化温度的优化,从而 提高过程的有效气产率。

关键词:煤气化;BPNN;SVM;ELM;Stacking 算法

中图分类号:TP183

文献标志码:A

气化炉内高温环境和测量手段的局限使得研究 者们无法仅通过实验方法获取影响炉内气化反应的 全部关键参数 [1] ,因此极有必要通过模拟手段建立能 描述气化炉内复杂反应机理、克服实际生产中工艺 参数多变性的气化炉数学模型。

目前广泛应用的单一的气化炉模拟模型主要有 机理模型和数据驱动模型[2-4]。由于机理模型在建立 过程中一般都会对气化炉内复杂的气化过程进行一 定程度的简化,加上煤气化生产中实时入炉煤质数 据的缺失,因而在实际应用中其准确度会不可避免 地降低。数据驱动模型因为具有拟合能力出色、对 机理知识依赖性低等优点,被广泛应用于煤气化模 拟中,最常见的数据驱动模型有反向传播神经网络 (BPNN)[5]、 支 持 向 量 机 (SVM)[6] 以 及 极 限 学 习 机 (ELM)[7]。单一的数据驱动模型虽然具有简单快速的 优点,但在稳定性上一直存在些许问题[8]。针对上述 两类单一模型存在的性能局限,研究者们提出了将 机理模型与数据驱动模型组合(即混合模型),以期 两者性能互补的建模思路[9-11]。但由于此类模型仍要 借助于机理模型的建立,所以无法达到简化过程、降 低模型对参数依赖度的目的。

数据驱动融合模型能通过组合多个同类或不同 类的包含不同信息的单一数据驱动模型[12] ,改善单一 数据驱动模型存在的稳定性问题。黄炜等[13] 通过多 个数据驱动模型的智能组合,实现了对短期电力负 荷的准确预测。赵敏等[14] 对比了 SVM算法、长短期 记忆网络(LSTM)算法、SVM-LSTM 融合算法识别 恶意软件的能力,证明 SVM-LSTM 算法具有更高的 准确性,较单一数据驱动模型有更好的应用前景。

考虑到煤气化生产中实时入炉煤质和煤浆数据 的缺失,本文基于数据驱动融合算法,使用工厂实际 运行生产数据,提出组合信息熵线性融合法与 Stacking融合法,建立了 BPNN-SVM-ELM 的信息熵 Stacking 融合气化炉模型。结果表明:Stacking 融合模型在准 确性、稳定性以及拟合速率上具有优势,之后结合遗 传算法 (GA),在实际工况其他输入条件保持不变的 情况下,对气化系统的氧气流量进行了优化计算,得 到了能提高气化炉的有效气产率的优化参数。

1""" BPNN-SVM-ELM 融合模型

1.1 BPNN、SVM、ELM 的差异性比较

BPNN、SVM、ELM 模型目前已被广泛应用于 工业软测量领域中,其优缺点与算法间的差异性也 得到了较为充分的证实。

BPNN 的拟合原理是经验风险最小化中的梯度 下降法,即通过梯度下降,逐渐逼近数据集的全局最 优解,模型较易在梯度下降过程中陷入局部最优解, 因而无法找到全局最优解,影响模型准确性[15-17]。

SVM 的拟合原理是结构风险最小化,即在找寻 数据集全局最优解的同时,加上一个惩罚项,约束模 型复杂度,抑制过拟合的出现,使得模型较经验风险 最小化所得拟合结果有更好的泛化能力,然而由于 复杂度低,模型对数据缺失问题较为敏感,降低了模 型的可靠性[18-20]。

ELM 的拟合原理是经验风险最小化中的最小二 乘法,即根据最小二乘法直接求出数据集的全局最 优解。模型求解时随机产生的权值和偏差可能使模 型部分节点失效,降低了模型的可靠性[21-22]。

各模型不同的拟合原理,使它们出现异常的原 因与表现也会有所不同。对 BPNN、SVM、ELM 这 3 种算法进行融合,可在一定程度上降低最终得到的 融合模型出现异常值的可能。

1.2 BPNN-SVM-ELM 信息熵线性融合模型

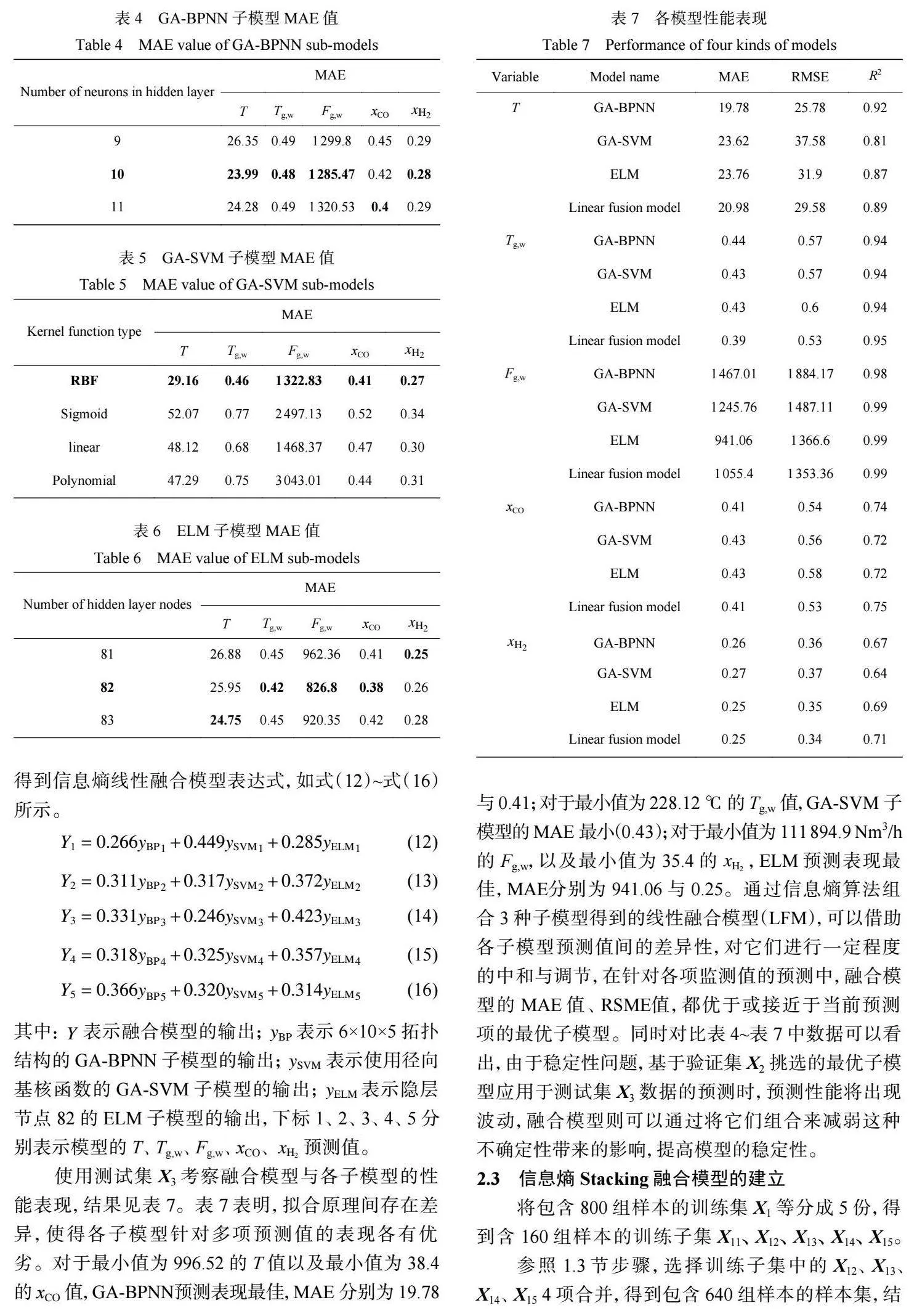

BPNN-SVM-ELM 信息熵线性融合模型 (LFM) 通过信息熵权重分配法线性组合 BPNN、SVM 和 ELM 完成模型建立(图 1),具体步骤如下[23] :

(1)数据处理。预处理数据,并划分为训练集 X1、验证集 X2、测试集 X3。

(2)子模型建立与选择。通过 X1 建立拥有不同 结构参数的子模型,之后依据各子模型对 X2 的预测 表现确定各子模型的最优模型结构参数 (如 BPNN 隐层神经元数、SVM 核函数、ELM 隐层节点数),得 到 3 种最优子模型 (如 BPNNOPT,SVMOPT,ELMOPT)。

(3)建立基于信息熵算法的线性融合模型。信 息熵是一个对数据集中数据稳定性进行度量的参 数,模型预测数据集的预测误差信息熵越大,预测一 致性越差,则预测表现越不稳定。基于各子模型关 于 X2 的相对预测误差求信息熵,以信息熵为依据计 算融合模型中各子模型的融合权重系数,具体求解 过程为:

最终通过 wj 对最优子模型进行线性融合,并使 用 X3 考察其性能表现,但由于线性融合方式是通过 直接加权各子模型的输出来实现,其拟合建立时间 是所有相同输入输出结构的子模型拟合耗时的叠 加,因而需要付出较高的时间成本。

1.3 BPNN-SVM-ELM 的信息熵 Stacking 融合模型

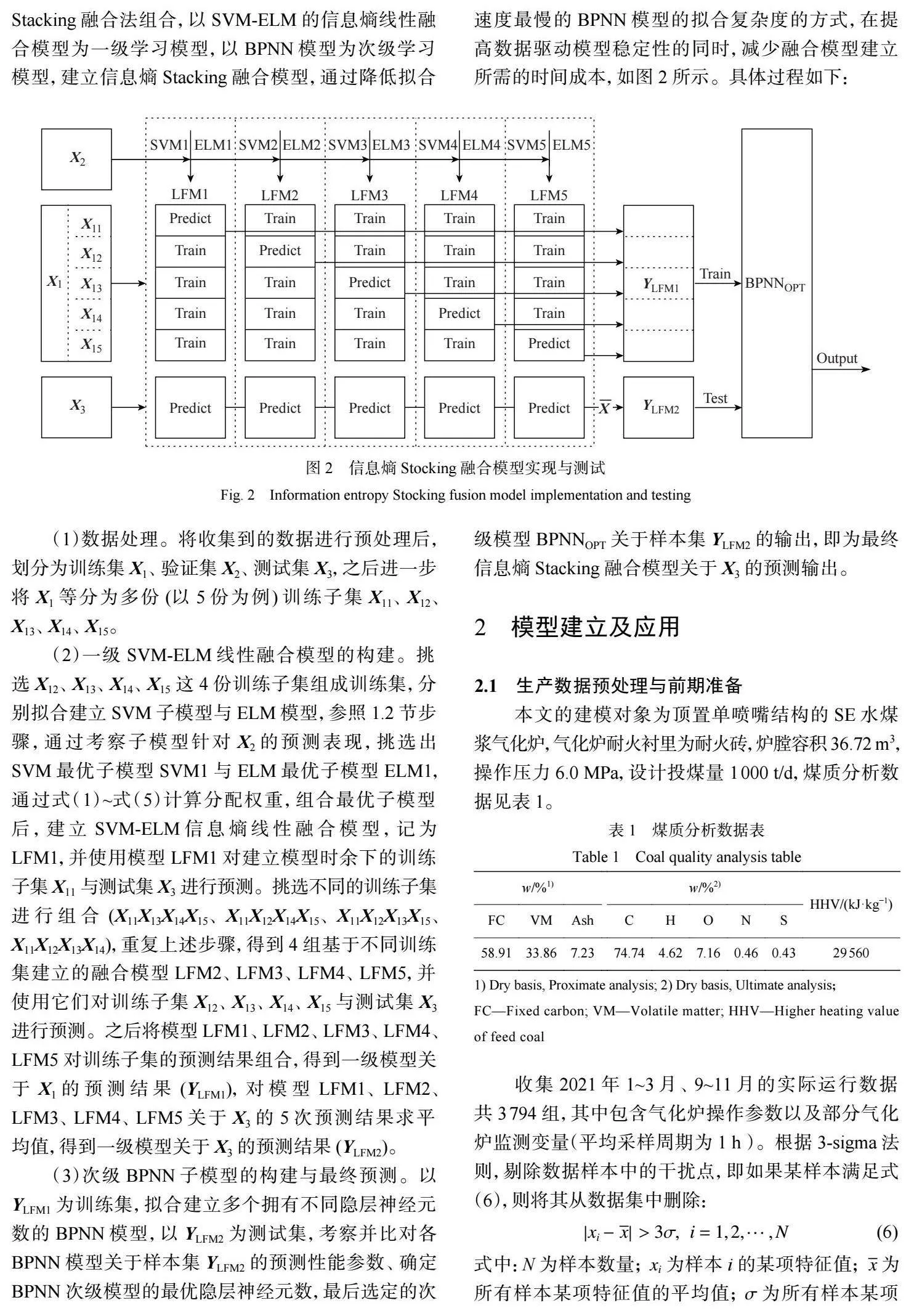

参考 Stacking 融合建模方式串联一级学习模型 与次级学习模型(次级学习模型以一级学习模型的输 出为输入特征进行训练并完成最终的预测)来提高 模型性能的思路,本文提出将信息熵线性融合法与Stacking 融合法组合,以 SVM-ELM 的信息熵线性融 合模型为一级学习模型,以 BPNN 模型为次级学习 模型,建立信息熵 Stacking 融合模型,通过降低拟合 速度最慢的 BPNN 模型的拟合复杂度的方式,在提 高数据驱动模型稳定性的同时,减少融合模型建立 所需的时间成本,如图 2 所示。具体过程如下:

(1)数据处理。将收集到的数据进行预处理后, 划分为训练集 X1、验证集 X2、测试集 X3,之后进一步 将 X1 等分为多份 (以 5 份为例) 训练子集 X11、X12、 X13、X14、X15。

(2)一级 SVM-ELM 线性融合模型的构建。挑 选 X12、X13、X14、X15 这 4 份训练子集组成训练集,分 别拟合建立 SVM 子模型与 ELM 模型,参照 1.2 节步 骤 ,通过考察子模型针对 X2 的预测表现 ,挑选出 SVM 最优子模型 SVM1 与 ELM 最优子模型 ELM1, 通过式(1)~式(5)计算分配权重,组合最优子模型 后 , 建 立 SVM-ELM 信 息 熵 线 性 融 合 模 型 , 记 为 LFM1,并使用模型 LFM1 对建立模型时余下的训练 子集 X11 与测试集 X3 进行预测。挑选不同的训练子集 进 行 组 合 (X11X13X14X15、 X11X12X14X15、 X11X12X13X15、 X11X12X13X14),重复上述步骤,得到 4 组基于不同训练 集建立的融合模型 LFM2、LFM3、LFM4、LFM5,并 使用它们对训练子集 X12、X13、X14、X15 与测试集 X3 进行预测。之后将模型 LFM1、LFM2、LFM3、LFM4、 LFM5 对训练子集的预测结果组合,得到一级模型关 于 X1 的 预 测 结 果 (YLFM1), 对 模 型 LFM1、 LFM2、 LFM3、LFM4、LFM5 关于 X3 的 5 次预测结果求平 均值,得到一级模型关于 X3 的预测结果 (YLFM2)。

(3)次级 BPNN 子模型的构建与最终预测。以 YLFM1 为训练集,拟合建立多个拥有不同隐层神经元 数的 BPNN 模型,以 YLFM2 为测试集,考察并比对各 BPNN 模型关于样本集 YLFM2 的预测性能参数、确定 BPNN 次级模型的最优隐层神经元数,最后选定的次 级模型 BPNNOPT 关于样本集 YLFM2 的输出,即为最终 信息熵 Stacking 融合模型关于 X3 的预测输出。

2""" 模型建立及应用

2.1 生产数据预处理与前期准备

本文的建模对象为顶置单喷嘴结构的 SE 水煤 浆气化炉,气化炉耐火衬里为耐火砖,炉膛容积 36.72 m3 , 操作压力 6.0 MPa,设计投煤量 1000 t/d,煤质分析数 据见表 1。

收集 2021 年 1~3 月、9~11 月的实际运行数据 共 3794 组,其中包含气化炉操作参数以及部分气化 炉监测变量(平均采样周期为 1 h )。根据 3-sigma 法 则,剔除数据样本中的干扰点,即如果某样本满足式 (6),则将其从数据集中删除:

式中:N 为样本数量; 为样本 i 的某项特征值; 为 所有样本某项特征值的平均值; 为所有样本某项特征值的标准差。

根据式(6)计算结果,去除掉 3794 组数据中存 在的 160 个干扰点后,从剩余的 3634 组样本中随机 抽取 1000 组样本用于建立模型的样本集,样本集各 项数据的描述性统计值列于表 2~表 3。

按照 8∶1∶1 的比例,将样本集初步划分为训 练 集 X1 (800 组 )、 验 证 集 X2 (100 组 ) 以 及 测 试 集 X3 (100 组)。样本输入特征为 6 项操作参数,输出标 签为 5 项监测值,借助 Python 语言实现模型开发,同 时为了保证模型的可复现性,所有子模型的随机数 种子皆设定为 1。

使用以下误差参数评估模型性能,平均绝对误 差(MAE)或平均相对误差(MRE)反映模型的预测准 确性,均方根误差(RMSE)反映模型的预测稳定性, 决定系数(R 2 )反映模型对所模拟过程的代表性。具 体计算公式如式(7)~式(10)所示:

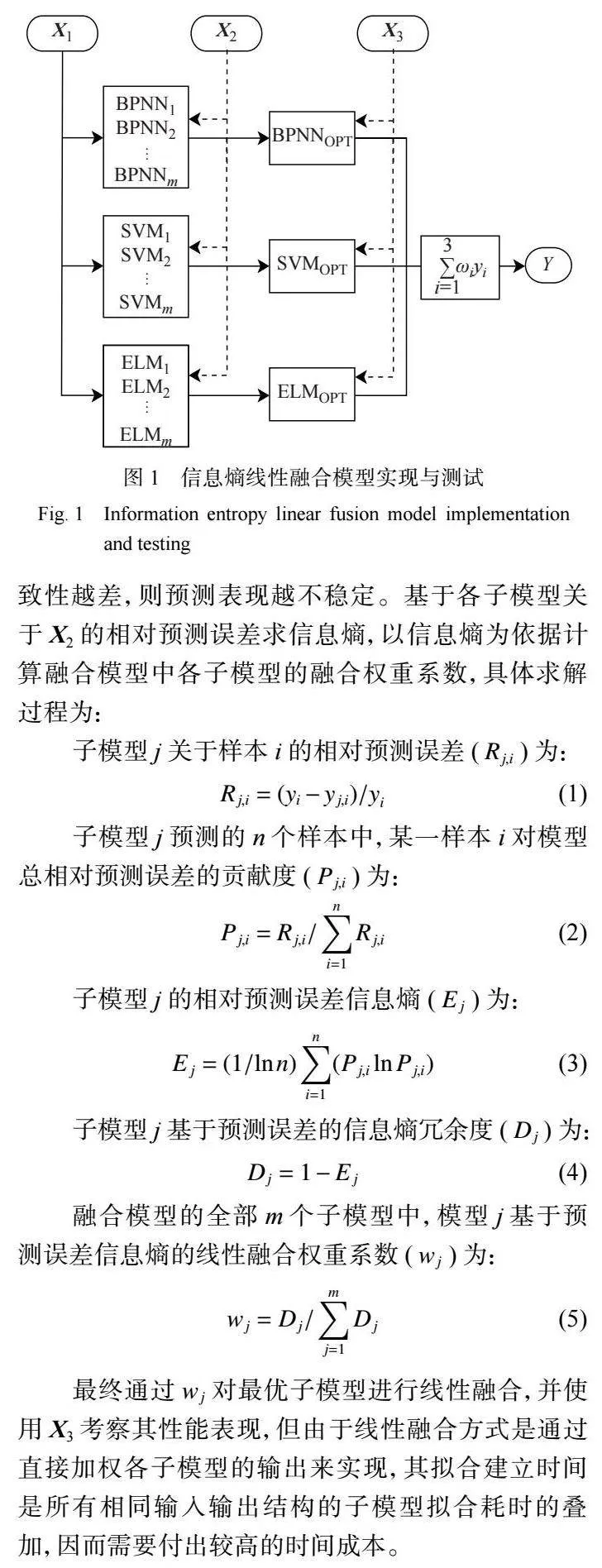

使用测试集 X3 考察融合模型与各子模型的性 能表现,结果见表 7。表 7 表明,拟合原理间存在差 异,使得各子模型针对多项预测值的表现各有优 劣。对于最小值为 996.52 的 T 值以及最小值为 38.4 的 xCO 值,GA-BPNN预测表现最佳,MAE 分别为 19.78 xH2 与 0.41;对于最小值为 228.12 ℃ 的 Tg,w 值,GA-SVM 子 模型的 MAE 最小(0.43);对于最小值为 111894.9 Nm3 /h 的 Fg,w,以及最小值为 35.4 的 ,ELM 预测表现最 佳,MAE分别为 941.06 与 0.25。通过信息熵算法组 合 3 种子模型得到的线性融合模型(LFM),可以借助 各子模型预测值间的差异性,对它们进行一定程度 的中和与调节,在针对各项监测值的预测中,融合模 型的 MAE 值、RSME值,都优于或接近于当前预测 项的最优子模型。同时对比表 4~表 7 中数据可以看 出,由于稳定性问题,基于验证集 X2 挑选的最优子模 型应用于测试集 X3 数据的预测时,预测性能将出现 波动,融合模型则可以通过将它们组合来减弱这种 不确定性带来的影响,提高模型的稳定性。

2.3 信息熵 Stacking 融合模型的建立

将包含 800 组样本的训练集 X1 等分成 5 份,得 到含 160 组样本的训练子集 X11、X12、X13、X14、X15。 参照 1.3 节步骤,选择训练子集中的 X12、X13、 X14、X15 4 项合并,得到包含 640 组样本的样本集,结合此样本集与验证集 X2,通过式( 1) ~式( 5)建立 SVM-ELM 的信息熵线性融合模型 LFM1,具体建立 过程类似 2.2 节。利用 LFM1 模型对训练子集 X11、 测试集 X3 进行预测,模型的预测集数据规模分别为 5×160、5×100。重复此步骤,最终得到线性融合模型 LFM1、LFM2、LFM3、LFM4、LFM5,将它们关于训 练子集 X11、X12、X13、X14、X15 的预测结果组合,得到 一级模型关于训练集 X1 的最终预测集,数据规模 5×800;对它们关于测试集 X3 的预测结果求平均值, 得到一级模型关于测试集 X3 的最终预测集,数据规 模为 5×100。各线性融合模型的 SVM 子模型核函数 均选取 RBF,ELM 子模型的最优结构参数描述见 表 8。

以一级模型关于训练集 X1 的最终预测集为训 练集,建立多个输入神经元数为 5、输出神经元数为 5、隐层神经元数不等的 GA-BPNN 模型,以一级模 型关于测试集 X3 的最终预测集为测试集,确定 GA[1]BPNN 次级模型的最优隐层神经元数为 9,具体过程 参照 2.2 节,至此完成 Stacking 融合模型的建立。最 优 GA-BPNN 次级模型针对一级模型最终预测集的 预测输出,即信息熵 Stacking 融合模型针对测试集 X3 的输出,具体预测性能参数见表 9。

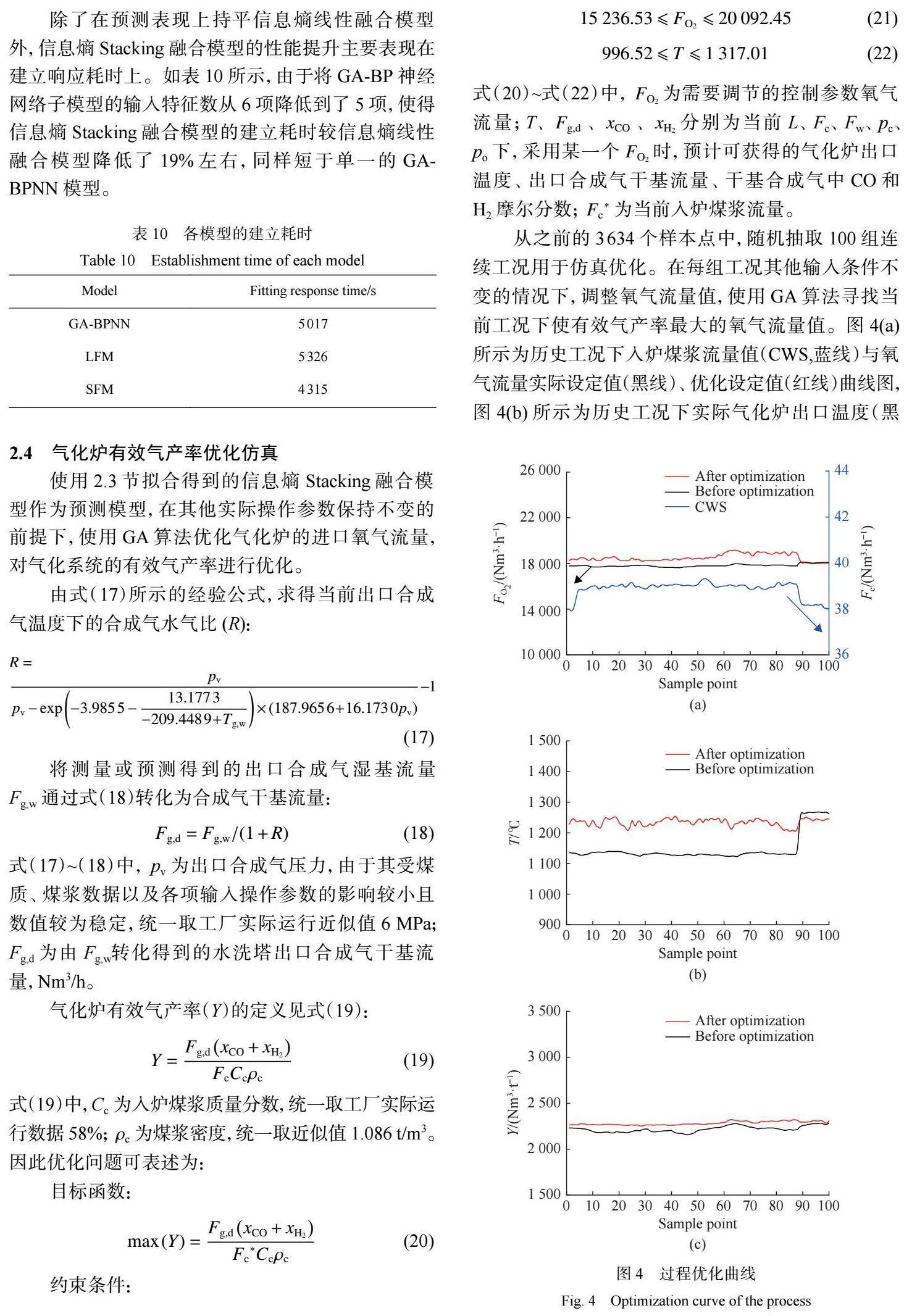

对比表 7、表 9 中不同模型关于测试集 X3 的预 测性能表现,以图 3 中代表模型准确度的 MAE 值为 例 ,在针对 5 项预测值的预测中 ,信息熵 Stacking 融合模型 (SFM) 与信息熵线性融合模型 (LFM) 各有 优劣,且都可以克服 GA-BPNN 模型在预测 Fg,w 时出 现的异常性能波动。在代表模型稳定性的 RMSE 值 及其他性能参数上,也表现出相同的情况。

除了在预测表现上持平信息熵线性融合模型 外,信息熵 Stacking 融合模型的性能提升主要表现在 建立响应耗时上。如表 10 所示,由于将 GA-BP 神经 网络子模型的输入特征数从 6 项降低到了 5 项,使得 信息熵 Stacking 融合模型的建立耗时较信息熵线性 融合模型降低了 19% 左右 ,同样短于单一的 GA[1]BPNN 模型。

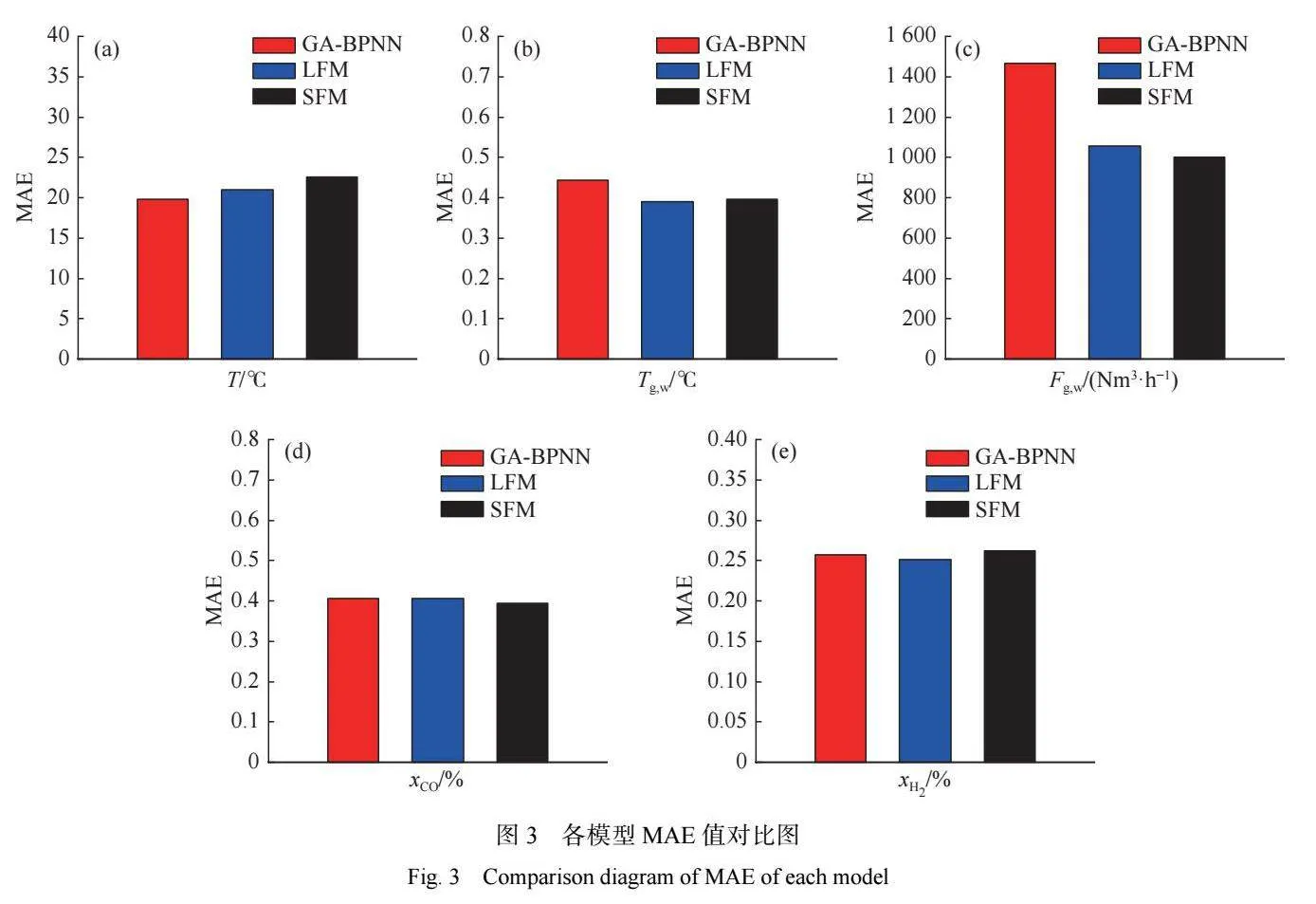

从之前的 3634 个样本点中,随机抽取 100 组连 续工况用于仿真优化。在每组工况其他输入条件不 变的情况下,调整氧气流量值,使用 GA 算法寻找当 前工况下使有效气产率最大的氧气流量值。图 4(a) 所示为历史工况下入炉煤浆流量值(CWS,蓝线)与氧 气流量实际设定值(黑线)、优化设定值(红线)曲线图, 图 4(b) 所示为历史工况下实际气化炉出口温度(黑线)与优化后气化炉出口温度(红线)曲线图,图 4(c) 所示为历史工况下实际有效气产率(黑线)与优化后 有效气产率(红线)曲线图。

图 4 结果表明,优化仿真可以通过改变氧气流 量调节氧气和入炉煤浆的流量比,优化气化温度,提 高有效气产率。以本次使用的 100 组工况为例,优化 后的有效气产率平均值从 2209.19 Nm3 /t 提高到了 2294.03 Nm3 /t,整体增幅 3.84%。

3""" 结 论

本文基于 GA-BPNN 模型、GA-SVM 模型、ELM 模型,组合信息熵权重分配法与 Stacking 融合法,建 立了气化炉的信息熵 Stacking 融合模型,并比较了它 与信息熵线性融合模型和 3 个子模型的预测性能,得 出以下结论:

(1) 信息熵 Stacking 融合模型关于气化炉出口温 度、水洗塔出口合成气温度与流量、合成气 CO 摩尔 分数、H2 摩尔分数的 MRE 值分别为 1.89%、0.17%、 0.78%、0.95% 与 0.71%,可以很好地继承信息熵线性 融合模型的优秀预测表现。

(2) 信息熵 Stacking 融合模型拟合响应速度较信 息熵线性融合模型提升了 19% 左右,应用于过程优 化指导中时将更有优势。

(3) 基于能实时预测气化炉出口参数的信息熵 Stacking 融合模型,结合 GA 算法对气化炉稳定运行 时的氧气流量进行适当优化调节,能在一定程度上 提高气化炉的有效气产率。

参考文献:

SUN Z H, HOU Z S, YIN C K. Data driven modeling for UGI gasification process via a variable structure genetic BP neural network[C]//2014 International Joint Conference on Neural Networks. New York: IEEE, 2014: 1071-1078.

张志华, 白金锋, 刘洋, 等. 煤炭气化过程数学模型构建的 研究进展[J]. 煤炭科学技术, 2019, 47(11): 196-205.

SUN Z H, DAI Z H, ZHOU Z J, et al. Numerical simula[1]tion of industrial opposed multi-burner coal-water slurry en[1]trained" flow" gasifier[J]." Industrial" amp;" Engineering" Chemi[1]stry Research, 2012, 51(6): 2560-2569.

WU H C, YANG C, ZHANG Z L. Simulation of two-phase flow" and" syngas" generation" in" biomass" gasifier" based" on two-fluid model[J]. Energies, 2022, 15(13): 4800.

杜旭鹏, 王钰琪, 许建良, 等. 基于数据驱动的气化炉出口 温度在线测量[J]. 华东理工大学学报(自然科学版), 2023, 49(2): 168-175.

ALI B, RAMESH K A, HANI H S, et al. Elucidating the effect of process parameters on the production of hydrogen[1]rich syngas by biomass and coal co-gasification techniques: A multi-criteria modeling approach[J]. Chemosphere, 2022, 287: 1-12.

LI X, NIU P F, LI G Q, et al. An adaptive extreme learning machine for modeling NOx emission of a 300 MW circulat[1]ing fluidized bed boiler[J]. Neural Process Letter, 2017, 46: 643-662.

LIU S K, YANG Y, YU L J, et al. Predicting gas produc[1]tion by" supercritical" water" gasification" of" coal" using"" ma[1]chine learning[J]. Fuel, 2022, 329: 125478.

VISWANATHAN K, ABBAS S, WU W, et al. Syngas ana[1]lysis" by" hybrid" modeling" of" sewage" sludge" gasification" in downdraft" reactor:" Validation" and" optimization[J]. Waste Management, 2022, 144: 132-143.

DENG Y S, AVILA C, GAO H J, et al. A hybrid modeling approach to estimate liquid entrainment fraction and its un[1]certainty[J]." Computers" amp;" Chemical" Engineering," 2022, 162: 107796.

WILLIS M J, VON S M. Simultaneous parameter identifi[1]cation and discrimination of the nonparametric structure of hybrid" semiparametric" models[J]." Computers" amp;" Chemical Engineering, 2017, 104: 366-376.

王佳晨. 多模型融合建模方法研究及其在化学中的应 用[D]. 杭州: 浙江工业大学, 2020.

黄炜, 陈田. 基于SAE与CEEMDAN-BiLSTM组合模型的 短期电力负荷预测[J]. 计算机应用与软件, 2022, 39(7): 52-58.

赵 敏, 张雪芹, 朱唯一, 等. 基于LSTM-SVM 模型的恶意 软件检测方法[J]. 华东理工大学学报(自然科学版), 2022, 48(3): 677-684.

LU" C" Y," SHI" J." Relative" density" prediction" of" additively manufactured" Inconel" 718:" A" study" on" genetic" algorithm optimized" neural" network" models[J]. Rapid" Prototyping Journal, 2022, 28(8): 1425-1436.

KUANG" F" L," LONG" Z" L," KUANG" D" M, et al. Applica[1]tion of back propagation neural network to the modeling of slump" and" compressive" strength" of" composite geopolymers[J]. Computational" Materials" Science," 2022, 206: 111241.

WEN" H" Q," YANG" S," WANG" Z" H, et al." A" systematic modeling methodology of deep neural network-based struc[1]ture-property" relationship" for" rapid" and" reliable" prediction on flashpoints[J]. AIChE Journal, 2022, 68(1): 1-15.

LING" H," QIAN" C," KANG" W, et al. Combination" of" sup[1]port vector machine and K-fold cross validation to predict compressive strength of concrete in marine environment[J]. Construction and Building Materials, 2019, 206: 355-363.

ZHOU T, LU H, WANG W W, et al. GA-SVM based fea[1]ture selection and parameter optimization in hospitalization expense" modeling[J]. Applied" Soft" Computing," 2019," 75: 323-332.

JAIR C, FARID G L, LISBETH R M, et al. A comprehens[1]ive survey on support vector machine classification: Appli[1]cations," challenges" and" trends[J]. Neurocomputing," 2020, 408: 189-215.

LI D Z, LI S, ZHANG S B, et al. Aging state prediction for supercapacitors based" on" heuristic" kalman" filter"" optimiza[1]tion" extreme" learning" machine[J]. Energy," 2022," 250: 123773.

RAJA M" N" A," SHUKLAnbsp; S" K." An" extreme" learning"" ma[1]chine model for geosynthetic-reinforced sandy soil founda[1]tions[J]. Proceedings" of" the" Institution" of" Civil" Engineers[1]Geotechnical Engineering, 2022, 175(4): 383-403.

XIA" L" Y," WANG" J" C," LIU" S" S, et al." Prediction" of" CO2 solubility" in" ionic" liquids" based" on" multi-model" fusion method[J]. Processes, 2019, 7(5): 1-16.

SU Y, JIN S M, ZHANG X P, et al. Stakeholder-oriented multi-objective process optimization based on an improved genetic" algorithm[J]." Computers" amp;" Chemical" Engineering, 2019, 132(4): 1-16.