基于图像间的语义感知协同目标检测算法

葛延良 张静 毕洪波 张林 田鸿鹏 贺敏 李德鑫

摘 要 提出了一个基于图像间的语义感知协同目标检测算法,以高效的方式检索整个图像组的共识线索。对每个像素用语义感知协同模块(SPCM)获取其交叉路径上所有像素的上下文信息。通过进一步的操作,最终可以捕获整个图像的共识信息。辅助分类融合模块(ACFM)可使网络以自上而下的方式突出协同区域。协同显著性检测实验结果表明,文中的算法在3种常用的iCoseg、Cosal2015和CoSOD3k数据集中表现良好,4个指标性能优异,验证了该方法的有效性。

关键词 协同显著性检测 图像识别 语义感知协同模块 辅助分类融合模块

中图分类号 TP391.41 文献标志码 A 文章编号 1000?3932(2024)01?0056?07

图像协同显著性检测是通过探索多个相关图片之间的内在关系来发现图像的重要目标,其在诸多领域中已经引起了广泛关注,包括弱监督语义分割[1,2]、图像检索[3]及视频前景检测[4]等。传统的协同显著性检测方法通常使用浅层特征作为常规特征,例如颜色直方图[5]、多线索融合及SIFT描述符[6]等。然而,这些模型仅适用于检测浅层特征,无法识别场景中的协同重要对象,限制了模型的性能。近年来,研究学者们通过基于深度学习的方法来改善协同显著性检测,例如基于深度学习的模型探讨了图像内和图像间的一致性,并通过不同方法的监督方式来强化特征,如图卷积网络(GCN)[7]、自学习方法[8]、具有PCA投影的图像间共同关注或重复单元[9]、相关技术、质量测量和共同聚类[10]。还有一些方法是利用多任务学习来同时优化共显著性检测、共分割或共峰值搜索[11],并帮助提取更丰富的视觉代表的协同重要信息,探索图像间的语义相关性。虽然这些方法已经得到验证并取得了先进结果,但是在弱光、复杂背景等困难场景下仍然无法准确提取协同信息。为此,笔者提出一种深度网络框架来挖掘不同图像组之间的语义相关性。拟采用的网络由两部分组成:语义感知协同模块(SPCM)和辅助分类融合模块(ACFM)。首先,使用扩张卷积从主干中提取并增强特征;随后,将语义感知协同模块用于公共显著对象识别;最后,将辅助分类融合模块应用于融合共识特征和多尺度特征。该模型主干网络以自上而下的方式提取突出区域,以全面探索图像组的一致性。

1 模型及算法建立

基于图像间的语义感知协同目标检测模型如图1所示。该模型通过自上而下的连接方式设计了语义感知协同网络,该网络以VGG?16网络为骨干。具体而言,图像间的语义感知协同目标检测算法通过3个阶段实现检测协同显著性目标。当接收到一组图像输入后,首先采用扩张卷积来扩大感受野,以捕获特定层中更丰富的特征。通过卷积及上采样操作,将捕获的特征与相邻特征通过相乘及级联方式进行信息融合,再通过卷积进行降维处理,最后将整个模块馈送到ReLU激活函数以获得图像信息。此外,为了使用轻量级计算来对局部图像共性特征进行提取,笔者提出了语义感知协同模块。该模块可在水平和垂直方向上收集上下文信息,以增强逐像素表示能力。使用该模块生成与参考特征相似的特征从而突出协同显著区域,使用辅助分类融合模块挖掘并提高与参考特征类似的特征,作为促进协同特征学习的有力指导。最后采用高层信息反馈指导低层的方式实现对协同显著性目标检测的精准判断。

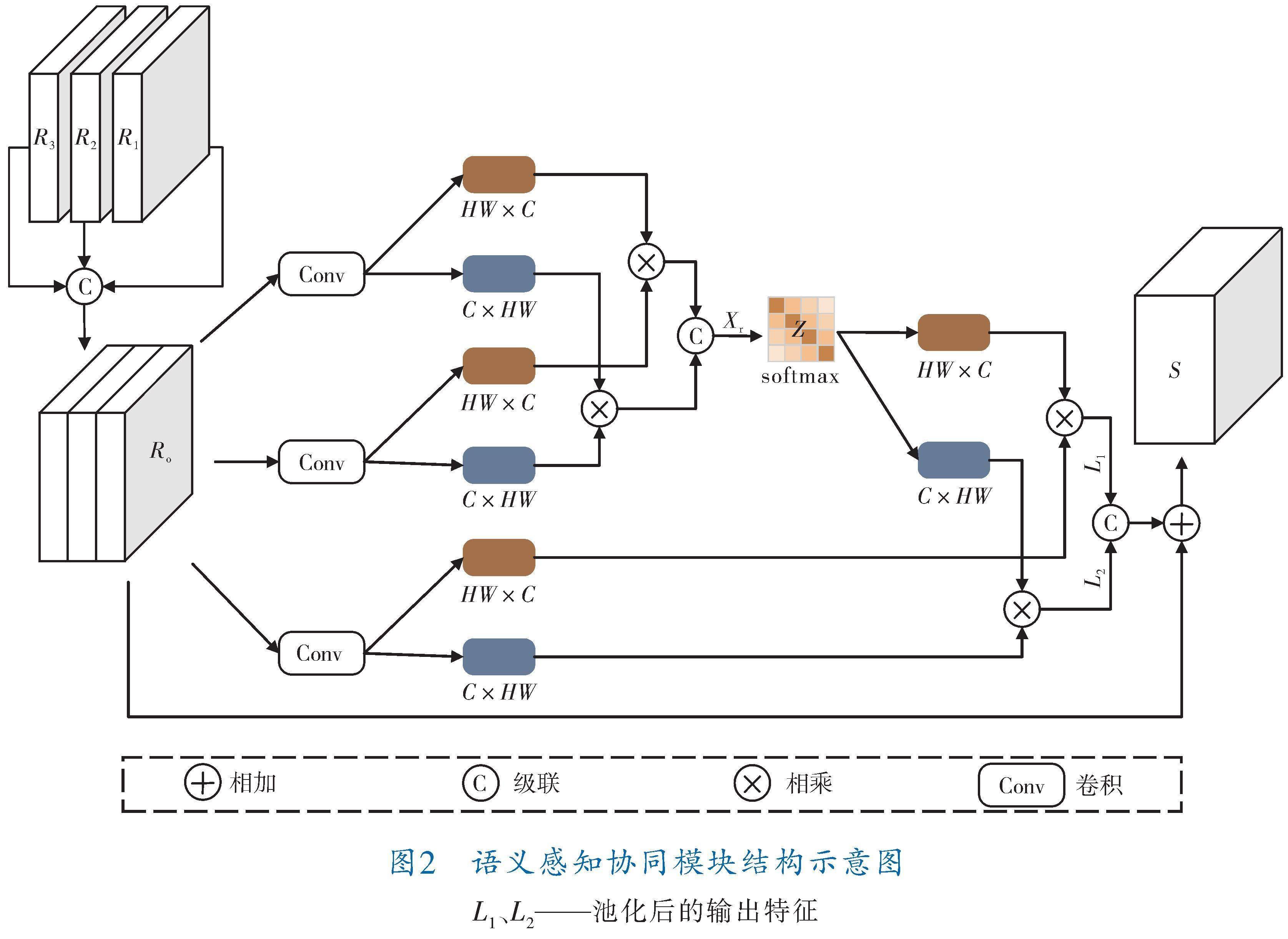

1.1 语义感知协同模块

语义感知协同模块结构示意图如图2所示,对于协同语义信息的提取,考虑到层间信息的相关性,采用权重共享策略来加强层间信息的交互。

相邻3层高级特征经过扩张卷积处理后表示为R、R、R,通过级联融合为R,再将融合后的特征輸入到3个3×3卷积中进行特征提取,随后将特征转置为HW×C和C×HW,同时引入通道分组连接策略并进行通道混洗,其结果表示为X,将连接后的分组特征进行交互以捕获粗糙的组协同对象特征,并使用softmax激活函数对前者进行补充和正则化,以避免它们过多地关注图像特定的信息而忽略公共信息。经过处理后的特征Z表示为:

Z=softmax(X)(1)

运用亲和矩阵来提取一组图片的相似特征,通过一系列重组、取最大值、取平均值等操作得到特征图,并将其与原始的特征图相加,最后在组合空间上取均值得到语义感知协同模块的输出特征S为:

S=concatenate(L×L)+R(2)

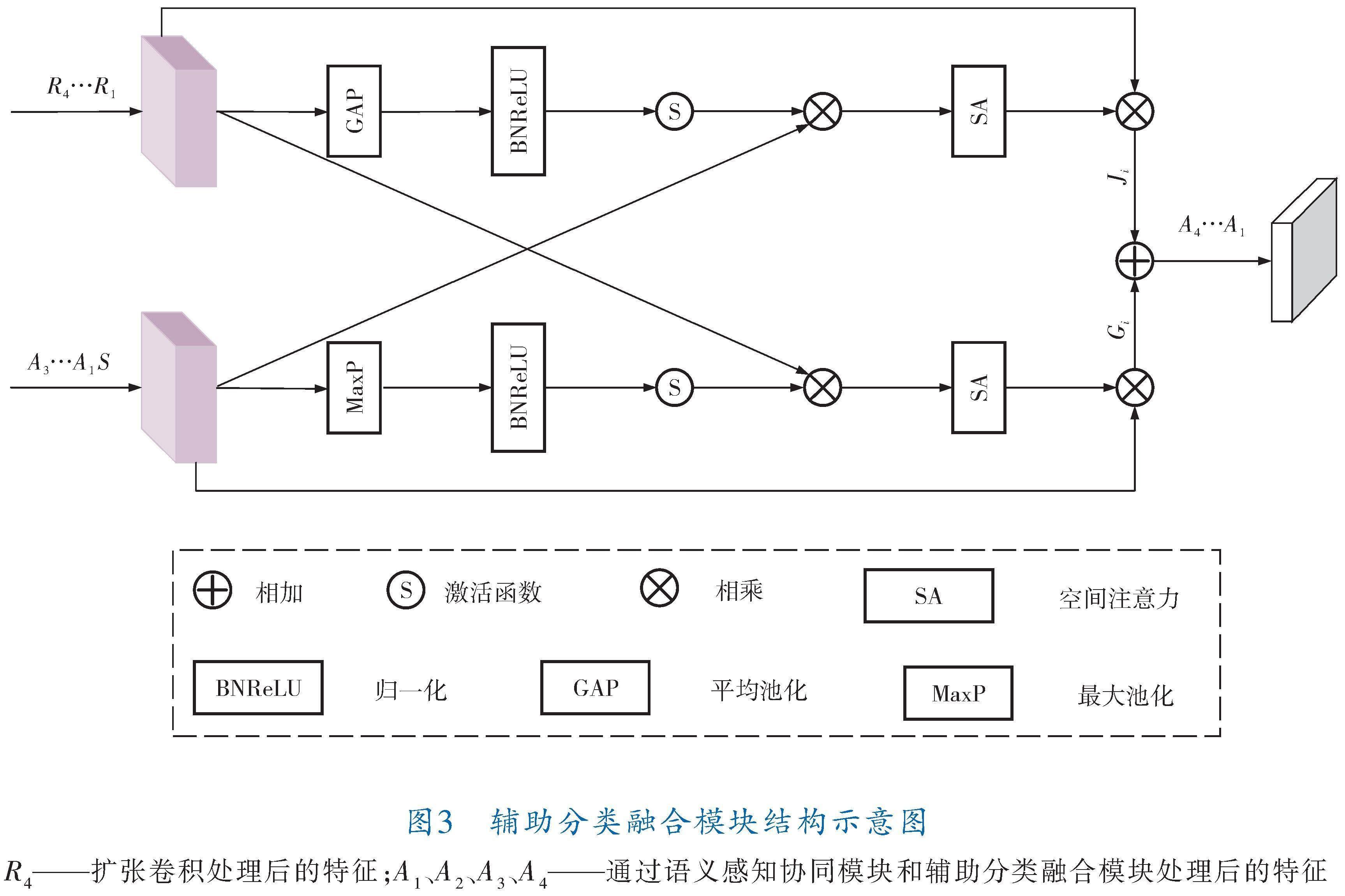

1.2 辅助分类融合模块

辅助分类融合模块结构示意图如图3所示。

辅助分类融合模块主要用于网络的第2~5层。其中,第5层是将最高层通过扩张卷积处理得到的特征R1与语义感知协同模块的输出特征S作为初始特征。首先将特征分别进行平均池化和最大池化,充分提取并保留图像的纹理及背景特征,从而有效降低背景噪声的干扰。其次,特征信息经过标准化操作加快训练速度后,可以减少变化带来的不确定性。最后通过激活函数并与初始特征相乘后得到输出J和G(i=1,2,3,4):

J=R×(SA(Sigmoid(BNReLU(GAP(R)))×S))×R(3)

G=S×(SA(Sigmoid(BNReLU(MaxP(S)))×R))×S(4)

利用空间注意力来增强协同特征和语义信息的表达能力,对关键线索进行细化,提高协同特征的一致性及紧凑性。最后再用初始信息填补并相加聚合,在最大程度上将信息充分融合并输出,即:

A=J+G(5)

第4层是以第5层的输出A以及次高层通过扩张卷积处理得到的特征R作为初始特征,重复运用辅助分类融合模块得到相应的输出。依此类推,利用早期的协同显著性检测结果来指导低层信息进行聚合,从而生成最终的协同显著性图像。

2 实验及结果分析

2.1 模型训练

笔者选取3个协同显著性检测数据集并进行评估从而验证所提方法的可行性。其中,iCoseg数据集[12]包括38个不同类别的643幅图像。每组有4~41幅图像,每幅图像都有手动标记的逐像素级真实值用于评估。Cosal2015[13]是一个较新的数据集,它有50组共2 015张图像,每组包含26~52张图像,每组都面临着不同的挑战性问题,如复杂环境、遮挡问题、目标外观变化和背景杂波。CoSOD3k[14]是一个大型数据集,包含160组共3 316张图像,涵盖了广泛的形状、对象大小和背景类别,因此更适用于协同显著性检测方法的应用和性能评估。

本实验中笔者采用4个广泛使用的指标来定量评估算法性能,即maximum E?measure(E)[15]、S?measure(S)[16]、maximum F?measure(F)[17]和mean absolute error(MAE)[18]。其中,E用于评估全局信息和局部细节的一致性;S是推理结果和真值图像结构相似性的评价指标;F表示谐波平均值是由自适应阈值T(T=μ+σ,μ和σ表示协同显著性图的平均值和标准差)中的精密度和召回率组成的,是评价前景图空间结构相似性的可靠指标;MAE为预测协同显著性图和真实图之间的平均绝对误差。

实验硬件设备为Intel(R)Xeon(R)Bronze 3106 CPU@1.70 GHz处理器,16 GB操作内存,具有两个GeForce GTX 1080 TI 16 GB显卡。本模型在PyTorch上实现,使用VGG?16作为网络骨干,并采用DUTS[19]数据集作为训练集。模型由Adam优化器训练。所有图像的像素均调整为256×256以便用于训练和测试,初始学习率为0.000 1,批量大小为10,迭代次数为10,当训练损失达到平均水平时,训练损失可减少10%。

2.2 实验结果

图4为本文模型与6种代表性算法的图像处理视觉对比结果,可以看出,本文模型可以更好地搜索和分割在具有挑战性场景中同时出现的突出对象,同时能够将协同对象边缘细化,而其他方法会受到不相关的突出对象或背景的干扰,导致图像处理结果不尽人意。可见,本文模型可以更加准确地检测到重要的协同目标,并生成比其他方法更精确的共显著性图像。

表1为本文模型与9种代表性先进方法的实验结果对比。

可以看出,在数据集iCoseg、Cosal2015和CoSOD3k上测试后,本文模型在所有指标上都优于其他方法。具体而言,尽管CoSOD3k数据集包含各种干扰信息,但本文模型仍然能够很好地区分协同重要目标,并且算法性能出色。在Cosal2015和iCoseg数据集上,本文模型的4个指标均优于其他方法,证明了本文模型在处理协同显著性检测任务方面的有效性。

2.3 消融实验

在相同的实验环境与数据集下进行消融实验,结果见表2。可以看出,当模型仅采用SPCM进行优化时,所有指标都得到了改善。在Cosal2015数据集中,MAE从0.104降至0.100,S从0.790升高至0.799,F从0.765升高至0.772,增加了0.9%,

E从0.831升高至0.836。可见,当模型采用SPCM优化后,其能够很好地捕获水平和垂直相关矩阵中的公共信息,从而使得性能得到了显著提升。当模型仅采用ACFM进行优化时,模型的性能同样得到了改善。以CoSOD3k数据集为例,采用ACFM优化后,模型的MAE从0.119降低至0.115,

S从0.737升至0.749,F从0.680升至0.691,E从0.789升至0.797。可见,ACFM优化后的模块具有出色的处理协同任务的能力。最后,同时使用SPCM和ACFM进行模型优化,4个性能指标均得到了进一步提升,达到了更好的使用效果。

3 结束语

笔者提出了一个有效的协同显著性检测框架。它能够自适应地通过语义信息捕获共识特征,包括语义感知协同模块和辅助分类融合模块。扩张卷积使语义感知协同模块能够最大程度地提取所需信息。笔者应用语义感知协同模块来精确地提取图像的共性特征。为了将共性特征与多尺度特征融合,引入了辅助分类融合模块。在3个标准数据集上的实验结果表明,笔者所提算法在多个评估指标上均优于传统方法,证明了本方法的有效性。

参 考 文 献

[1] FU H Z,XU D,LIN S,et al.Object?based RGBD image co?segmentation with mutex constraint[C]//2015 IEEE Conference on Computer Vision and Pattern Recognition(CVPR). IEEE, 2015.DOI:10.1109/CVPR. 2015.

7299072.

[2] WEI L N, ZHAO S S, BOURAHLA O E F, et al.Group?wise Deep Co?saliency Detection[C]//Proceedings of the 26th International Joint Conference on Artificial Intelligence.2017:3041-3047.

[3] FAN D P,LI T P,LIN Z,et al.Re?Thinking Co?Salient Object Detection[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2022,44(8):4339-4354.

[4] PASZKE A,GROSS S,MASSA F,et al.PyTorch:An imperative style,high?performance deep learning library[C]//33rd Conference on Neural Information Processing Systems.2019.DOI:10.48550/arXiv.1912.01703.

[5] JIANG B,JIANG X,ZHOU A,et al.A Unified Multiple Graph Learning and Convolutional Network Model for Co?saliency Estimation[C]//The 27th ACM International Conference.ACM,2019.DOI:10.1145/3343031.

3350860.

[6] CHANG K Y,LIU T L,LAI S H.From co?saliency to co?segmentation:An efficient and fully unsupervised energy minimization model[C]//CVPR 2011.IEEE,2011.DOI:10.1109/CVPR.2011.5995415.

[7] GAO R J,GUO Q,XU F,et al.Can You Spot the Chameleon?Adversarially Camouflaging Images from Co?Salient Object Detection[C]//2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR). IEEE, 2022.DOI:10.1109/CVPR52688.

2022.00219.

[8] ZHENG P, FU H Z, FAN D P,et al. GCoNet+:A Stronger Group Collaborative Co?Salient Object Detector[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2023:1-17.

[9] HSU K J,LIN Y Y,CHUANG Y Y.DeepCO3:Deep Instance Co?Segmentation by Co?Peak Search and Co?Saliency Detection[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR).IEEE,2019.DOI:10.1109/CVPR.2019.00905.

[10] JERRIPOTHULA K R,CAI J F,YUAN J S.Quality?Guided Fusion?Based Co?Saliency Estimation for Image Co?Segmentation and Colocalization[J].IEEE Transactions on Multimedia, 2018,20(9):2466-2477.

[11] JIN W D,XU J,CHENG M M,et al.Icnet:Intra?saliency correlation network for cosaliency detection[J].Advances in Neural Information Processing Systems,2020,33:18749-18759.

[12] ZHANG D W,HAN J W,HAN J G,et al.Cosaliency Detection Based on Intrasaliency Prior Transfer and Deep Intersaliency Mining[J].IEEE Transactions on Neural Networks and Learning Systems,2016,27(6):1163-1176.

[13] PASZKE A,GROSS S,MASSA F,et al.PyTorch:An Imperative Style,High?Performance Deep Learning Library[J].2019.DOI:10.48550/arXiv.1912.01703.

[14] WEI Y C,LIANG X D,CHEN Y P,et al.STC:A Simple to Complex Framework for Weakly?Supervised Semantic Segmentation[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2017,39(11):2314-2320.

[15] FAN D P,CHENG M M,LIU Y,et al.Structure?measure:A new way to evaluate foreground maps[C]//2017 IEEE International Conference on Computer Vision(ICCV).IEEE,2017:4558-4567.

[16] ACHANTA R, HEMAMI S, ESTRADA F, et al.Frequency?tuned salient region detection[C]//2009 IEEE Conference on Computer Vision and Pattern Recognition. IEEE, 2009.DOI:10.1109/CVPR.2009.5206596.

[17] CHENG M M, MITRA N J, HUANG X L, et al.SalientShape:Group saliency in image collections[J].Visual Computer,2014,30(4):443-453.

[18] WANG L J,LU H C,WANG Y F,et al.Learning to detect salient objects with image?level supervision[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition(CVPR).IEEE,2017.DOI:10.1109/CVPR.2017.404.

[19] BATRA D,KOWDLE A,PARIKH D,et al.iCoseg:Interactive co?segmentation with intelligent scribble guidance[C]//2010 IEEE Computer Society Conference on Computer Vision and Pattern Recognition.IEEE,2010:3169-3176.

[20] FU H Z,CAO X C,TU Z W.Cluster?based co?saliency detection[J].TIP,2013,22(10):3766-3778.

[21] LI Y J,FU K,LIU Z,et al.Efficient saliency?model?guided visual co?saliency detection[J].IEEE Signal Processing Letters,2015,22(5):588-592.

[22] YE L,LIU Z,LI J,et al.Co?saliency detection via co?salient object discovery and recovery[J].IEEE Signal Processing Letters,2015,22(11):2073-2077.

[23] ZHANG K,LI T,LIU B,et al.Co?saliency detection via mask?guided fully convolutional networks with multi?scale label smoothing[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition.2019:3095-3104.

[24] LI B,SUN Z X,TANG L,et al.Detecting robust co?saliency with recurrent co?attention neural network[C]//Proceedings of the 28th International Joint Conference on Artificial Intelligence.2019:818-825.DOI:

10.24963/ijcai.2019/115.

[25] JIANG B,JIANG X Y,ZHOU A J,et al.A unified multiple graph learning and convolutional network model for co?saliency estimation[C]//The 27th ACM International Conference.ACM,2019.DOI:10.1145/3343031.3350860.

[26] WU Z,SU L,HUANG Q M.Stacked cross refinement network for edge?aware salient object detection[C]//2019 IEEE/CVF International Conference on Computer Vision(ICCV).IEEE,2020.DOI:10.1109/ICCV.2019.00736.

[27] ZHANG K H,CHEN J,LIU B,et al.Deep object co?segmentation via spatial?semantic network modulation[C]//Proceedings of the AAAI Conference on Artificial Intelligence.AAAI,2020:12813-12820.