基于生物识别的汽车人机交互拓展化研究

刘子衿 林海英

摘要:随着智能汽车的逐步普及,智能汽车用户群体的需求和问题也在逐渐变化。在智能汽车快速发展的大环境,以及符合各项规章制度的前提下,通过生物识别及其相关技术探究如何满足用户的个性化需求,以实现更加安全、高效的新一代人机交互方式。以调研中用户反映的驾驶体验问题和日常发现的驾驶问题为导向,针对性地进行了拓展化研究,提出相应的技术解决方案。

关键词:生物识别;人机交互;车联网;深度学习算法;边缘修复

中图分类号:U463 收稿日期:2023-10-18

DOI:10.19999/j.cnki.1004-0226.2024.02.009

1 前言

汽车产品正在逐步转变为智能移动设备,这得益于智能化和自动化技术的持续发展和完善。在人机互动、万物互联的发展推动下,汽车已经超脱于传统运输工具的功能,正在逐渐转变成人类寻求更丰富的体验感和舒适感的第三空间[1]。汽车消费者的需求千差万别,而传统的汽车只能在相同品牌相同类型中推出相同的产品,这种同质化导致了消费者体验无法得到最大限度的满足。

因此,通过生物识别技术来一对一地满足用户个性化需求应当提上日程。本项目采用DTC模式结合SCP模型,将用户需求转化为技术成果,从机会成本理论出发探究现有生物识别技术在人机互动语境下的升级空间,达到帕累托最优的效果。对于项目中涉及的基于生物特征识别和驾驶习惯研究的个性化方案匹配技术,目前有公司已经有了较为深入的研究。但是由这几个成熟技术整合而成的新技术,目前暂无较多相关研究。基于边缘修复及增强算法的高精准度手势识别技术中,手势识别已经是现有概念,但是目前各项数据表明手势识别精度欠缺、反应速度慢、发挥作用较为局限,我们基于边缘修复及增强算法对现有手势识别技术的精度、识别范围进行了增强,目前仅有部分高校在研究,尚无成熟产品。

经验证,本项目方案通过应用生物识别技术对汽车座舱的人机交互进行多通道拓展及优化,汽车人机交互体验相对于现有产品有较大提升,发展价值较高[2]。

2 基于生物特征识别和驾驶习惯研究的个性化方案匹配

2.1 研究背景

为了使用户获得最好的驾乘体验,应用了人脸识别技术将用户偏好设置与人脸识别数据绑定;同时使用AI深度学习和机器学习算法对于驾驶人驾驶数据进行分析学习,并对驾驶人设置给出建议,来达到极致的驾驶体验。

2.2 人脸识别与个性化方案储存匹配

由于驾驶人相对固定,需要采集的人脸数据较少,这里主要讨论基于特征脸的人脸识别算法。

2.2.1 采集驾驶员图像作为训练样本

将驾驶员的姿势分为站立和常规驾驶坐姿两种,在收集数据时,要保持视线直视前方,并将收集到的数据作为训练数据。

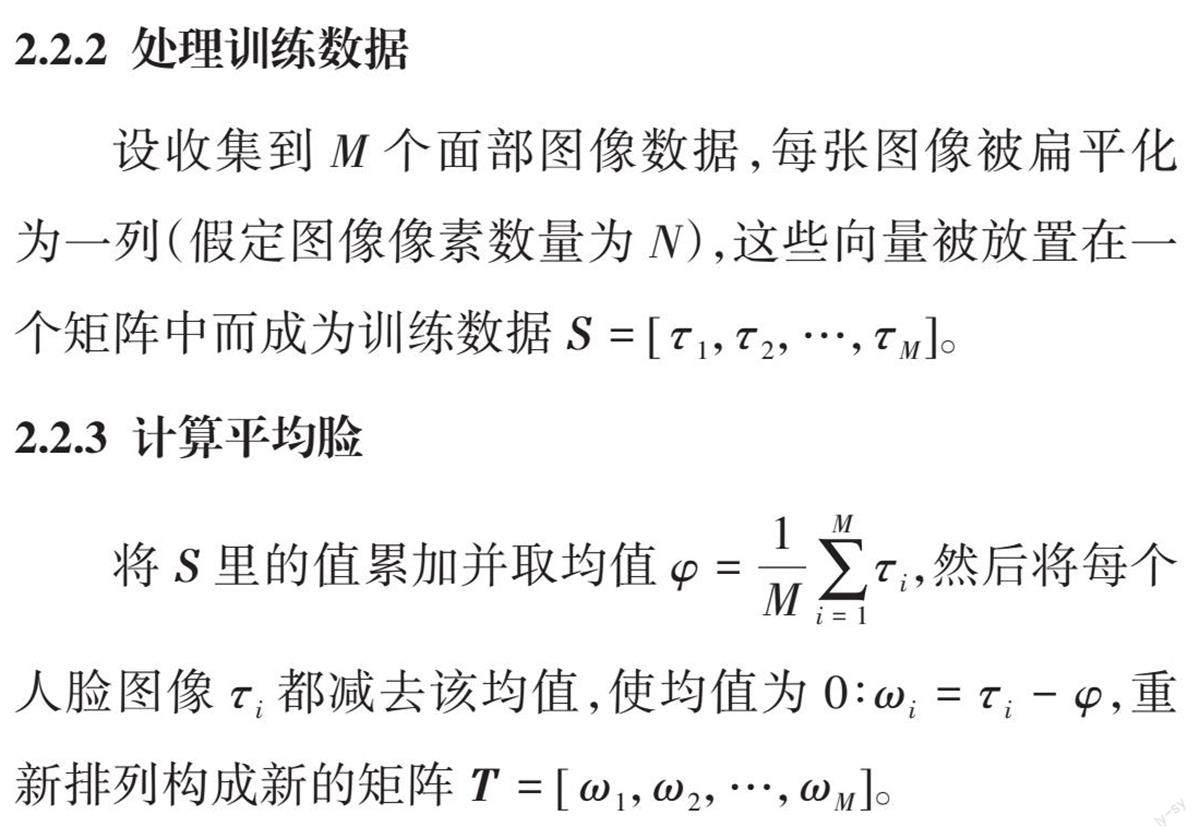

2.2.2 处理训练数据

设收集到M个面部图像数据,每张图像被扁平化为一列(假定图像像素数量为N),这些向量被放置在一个矩阵中而成为训练数据[S=[τ1,τ2,…,τM]]。

2.2.3 计算平均脸

将[S]里的值累加并取均值[φ=1Mi=1Mτi],然后将每个人脸图像[τi]都减去该均值,使均值为0∶[ωi=τi?φ],重新排列构成新的矩阵[T=[ω1,ω2,…,ωM]]。

2.2.4 PCA(主成分分析)降维求协方差矩阵

在图像识别和人脸识别中,可以用PCA来降低维度并展示人脸的主要特征,以更好地识别和分类,同时减少数据冗余。

假设获得m条面部数据,每条数据都有n个评价指标,构成了m×n的原始数据矩阵,即为X,每个变量对应的数据記为:X1,X2,…,Xn。

[X=x11…x1n???xm1…xmn=x1,x2,…,xn] (1)

各项评估标准常常具备各自的度量和度量单位,为了消除度量的影响,必须对数据做标准化的处理,这样才能确保各个数据标准的对比性。经过标准化处理过后的原始数据,能使所有评估标准都达到相同的数量级,这样才有可能进行全面的比较评价。

对数据实施Z-score转换处理,在此操作后,数据的平均值为0,其标准偏差是1,同时这些数据遵循标准正态分布特性,公式如下:

[Z-Scoreij=xij-xjSj] (2)

式中,[xj]为第j个指标的样本均值,[Xj=1mi=1mXij];[Sj]为第j个指标的标准差,[Sj=i=1m(Xij-Xj)2m-1],记中心化后数据矩阵为X。

计算经过集中化处理的数据的协方差矩阵,并将其标记为R:

[rij=cov(xki,xkj)=k=1mxkixkjm-1] (3)

[R=cov(X1,X1) cov(X1,X2) … cov(X1,Xn)? ? ? ?cov(Xn,X1) cov(Xn,X2) … cov(Xn,Xn)] (4)

此外也可以用另一种方法表示:[R=XTXm]。

2.2.5 计算特征脸的特征向量

求出协方差矩阵[R]的特征向量[ei],记这些协方差矩阵[R]的特征向量为:

[E=[e1,e2,… ,eM]] (5)

计算各特征脸的特征向量为:

[ui=k=1Meikωk(i=1,2, …,M)] (6)

2.2.6 个性化方案绑定

根据人脸识别得出特征向量,通过哈希算法生成唯一UID,在该UID下保留该用户的偏好设置。查询时通过哈希表进行。

2.2.7 人脸识别

得到特征脸的特征向量[ui]后,再对样本中的每张图片进行权重的标识:[ti=ui(τ?φ)(i=1,2,…,M)]。

把这些权重写成一个向量表示:[ΩT=[t1,t2, … ,tM]]。

将待检测的人脸图像[τ]输入后做主成分分析后,求[Ω]和[Ωk]的欧氏距离得到:[εk=Ω?Ωk2]。

在上述公式里,[Ω]代表了待审查的人脸图片的权重,而[Ωk]是指训练样本集中某一人脸图像的权重。如果[εk]低于预先设定的界限,那么就确认正在审查的人脸与样本集中相应的人脸为同一个人。

2.2.8 方案加载

检测到当前人脸与数据库中人脸数据匹配后,将对应UID的设置方案加载到汽车上,完成用户偏好设置的加载。

图1为基于人脸识别的个性化方案绑定流程图。

2.3 机器学习优化驾驶设置

2.3.1 数据收集

在驾驶人自主驾驶机动车期间,车载计算机将通过车辆CAN总线收集车辆传感器数据,获取诸如车辆平均加速度、车辆最大、最小转角、车辆最大、最小速度、车辆横移距离、车辆横移频率等有关驾驶人驾驶风格的数据。

2.3.2 模板对比

在车载计算机中储存“城市”“运动”“越野”等不同驾驶风格的典型模板数据。车载计算机收集了驾驶人驾驶数据后,会针对各项数据逐个对模板进行比较匹配,得出目前驾驶人大概的驾驶风格简档,并储存于云端。

2.3.3 模型训练

将驾驶员驾驶风格简档、驾驶员驾驶视频、车辆运动特征等数据输入强化学习模块,训练与驾驶员驾驶风格相符或相近的自动驾驶模型。

2.3.4 模型使用与用户反馈

针对乘员体验,在用户需要接入自动驾驶时,从驾驶风格模块调取当前驾驶员的自动驾驶模型,并接入车辆自动驾驶模块操控汽车。如用户感觉到自动驾驶带来不适,可将问题通过语音、手势或文本的方式反映给车载AI。同时,驾乘人员身上可穿戴拓展设备提供的生命健康特征、车内雷达扫描获取的驾乘人员动作特征等也将作为驾乘人员的被动反馈进行收集。

针对驾驶人体验,可以在路况识别系统判断为相对安全的路段时,在征求驾驶人同意的情况下,开启AI辅助驾驶(对驾驶人的方向盘、踏板等提供力回馈,这里需要注意驾驶人的指令拥有最高优先级,AI不得与驾驶人争夺车辆控制权)。该功能同样会调取自动驾驶模型,根据自动驾驶模型的设置数据暂时更改当前设置方案,以便辅助驾驶员驾驶。同样这里还会收集驾驶人对于AI辅助驾驶与新驾驶设置方案的主动和被动反馈。

2.3.5 模型优化

將收集到的驾乘人员被动或主动反馈输入强化学习模块,对模型进一步针对性优化,使驾乘人员的驾乘体验能够更为舒适。

2.3.6 建议提出与设置修改

车载计算机将强化学习模块得出的驾驶风格数据、车辆设置数据与当前驾驶人绑定的驾驶风格简档和车辆设置数据进行对比,对驾驶人的驾驶风格和车辆设置提供建议。如用户接受则将一键应用强化学习模块得出的最优方案,并同步更新绑定数据[3]。图2为机器学习优化驾驶设置示意图。

3 基于边缘修复及增强算法的高精准度手势识别技术

3.1 研究背景

目前多数车企采用光飞时间(TOF)来识别手势。TOF的分辨率低,通常低于640×480,测量精度最多为厘米级,容易受多重反射等影响,不稳定且成本高。J.D.Power发布的2020技术体验指数显示,用户满意度最低的是手势控制交互方式。手势识别要求驾驶员的手势指令必须表现在特定的区域内,标准化要求高,因此识别率较低。手势的表达内容也有限,当关联的功能较多需要复杂的手势设计时,便会十分繁琐。因此我们期待加大手势识别的范围,同时进行边缘修复及增强,进一步提高准确率。

3.2 基础功能

采用结构光方式进行识别,同时对输入的识别内容运行相应算法进行边缘修复以及图像增强进而提高识别的精准率、反馈速率以及可识别的范围,优化用户的人机交互体验。

3.3 实现方法

3.3.1 手势识别系统结构

现阶段,手势识别主要依赖于摄像头等接收器设备来获取手势信息,然后把识别到的手势内容通过CAN总线转交给手势识别系统。接着,在人机交互系统中构建相应的手势模型和操作界面,并对其中的手机内容进行分类。具体的识别流程可参见图3。

3.3.2 具体方案

采用精度更高、成本更低的结构光(Structure Light,SL)方式进行手势识别。

a.通过对皮肤色彩和背景的粗略比较,获取分离的效果。

b.采用分层Chamfer距离匹配算法(HCMA)对手势的特定区域进行精密的定位。

c.利用基于图形架构和梯度方向直方图的分类器,对手掌和手指部分进行了精确的识别。

d.借助预先储存的模型,对手与脸部交接处的边缘数据进行了修复,这样就得到了一个完全清晰的手势识别区域。

结构光方式的流程如图4所示。

一开始,边缘图被Chamfer距离匹配算法转化为Chamfer距离图,接着调用一个范围3×3的窗口构建出每个像素点的距离值,边缘距离[Ed]的计算过程按如下公式:

[Ed=131Ni=0N-1wi2] (7)

在这个公式中,[wi]是模版影像的像素数值,[N]则是模版边界点的总数。当边缘距离[Ed]减少到最小时,就可以得到最适合的匹配位置。为了提高搜索最佳匹配位置的速度,在算法设计中引入金字塔结构,选择其中任意一组网格点作为匹配起点,并继续计算这些点与周围点之间的边缘距离[Ed],直到找到最小边缘距离值[Ed]。

结构光方式的三维视觉透视模型如图5所示,相关计算公式如下:

[Xr=cx+cosθ·Sx·x-sinθ·Sy·y] (8)

[Yr=cy+sinθ·Sx·x+cosθ·Sy·y] (9)

[X=Xr+2n-12n] (10)

[X=Yr+2n-12n] (11)

[(x,y)]是原始坐标的标识,然而在金字塔图的第[n]级,点的准确坐标被[(X,Y)]表示。平移、缩放和旋转的参数则用[(cx,cy)]、[(sx,sy)]和[θ]来代替,这强调了匹配过程具备处理这些手势几何变换的能力。在此基础之上,进一步采用边缘修复算法以补全不连续和模糊的边缘。

借助Chamfer距离匹配算法来查找手势部分的邻近区域,并把最优配对的区域图像和模版图像进行比较研究。

对已获得的更新版邊缘图像进行轮廓破损部位的修补,如果未找到新的断点集合,针对每个断点P,寻找模板中距离其最接近的Q,用一组Q把断点轮廓划分成若干个部分,然后,根据得出的和的相对位置,应用以下公式生成一组新的点集P:

[Pk=Pk-1+Qk-Qk-1] (12)

利用以Catmull-Rom插值作为基础的曲线拟合方法将这些点连接起来,从而提升边缘图像的优化。计算如下:

[xi=aixk-2+bixk-1+cixk+dixk+1yi=aiyk-2+biyk-1+ciyk+diyk+1] (13)

[ai=12(-t3+2t2-t)]

[bi=12(3t3-5t2+2),t=iN]

[ci=12(-3t3+4t2+t)]

[di=12(t3-t2]

上式中,[(xk-2,yk-2)]、[(xk-1,yk-1)]、[(xk,yk)]和[(xk+1,yk+1)]分别是Pk-2、Pk-1、Pk和Pk+1的坐标。

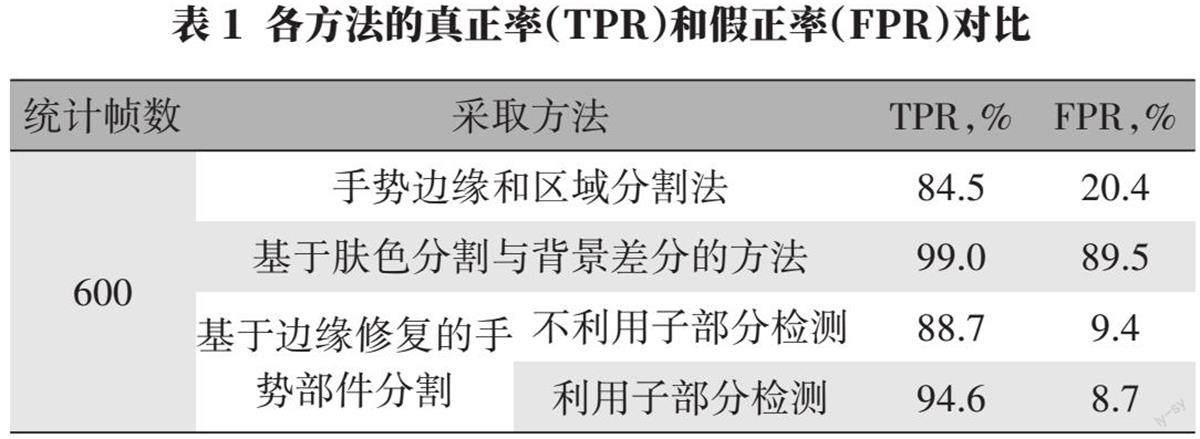

通过计算发现,该边缘修复算法的精确度在TPR及FPR指标上分别达到了94.6%和8.7%,如表1所示。相对于其他算法,这个特有性能在准确性、识别力度和处理速度方面表现更好,这有利于提高人机交互的使用体验。

因此可以在车内各处的摄像头内加入此程序扩大识别范围,同时也可由用户进行个性化操作,只需要提前录入相应手势即可得以控制车内几乎所有部件[4]。

4 结语

a.将车载传感器与深度学习算法结合,实现了根据用户的驾驶风格与驾驶体验自动调节车内环境,提高用户驾乘舒适性。

b.所提出的边缘修复算法能增强人机互动的准确性和驾驶期间的安全性,能够实现对远距离动态手势的识别,保证了识别的稳定性和良好的鲁棒性,具备优秀的实用价值。

经验证,本项目方案通过应用生物识别技术对汽车座舱的人机交互进行多通道拓展及优化,对于汽车人机交互体验相对于现有产品有较大提升,发展价值较高。

参考文献:

[1]黄丽蓉,潘雨青.基于深度信念网络的驾驶行为研究[J].计算机与数字工程,2020,48(8):1958-1964.

[2]周行健.基于用户行为的汽车增强现实平视显示器交互设计研究[D].南京:东南大学2021.

[3]尤祖旺.汽车自动泊车辅助系统关键技术研究[J].中国新技术新产品,2020(20):11-14.

[4]梁英.人机交互手势特征识别及边缘修复算法研究[J].自动化技术与应用,2022,41(11):43-46.

作者简介:

刘子衿,男,2002年生,本科在读,研究方向为飞行汽车。

林海英(通讯作者),男,1971年生,教授,研究方向为特种车辆。