利用动态高斯泼溅实现内窥镜双目场景的动态重建

关键词:内窥镜;双目视觉;三维重建;高斯泼溅;动态场景重建;深度学习

中图分类号:TP311 文献标识码:A

文章编号:1009-3044(2024)36-0006-04 开放科学(资源服务) 标识码(OSID) :

0 引言

随着远程手术和机器人辅助手术领域的持续研究及其商业化进程的成熟,这一领域迅速发展并受到越来越多的关注。手术医师通过内窥镜视角不仅可以提高操作的准确性,而且基于其可视化重建效果,可以更好地理解手术场景的医学解剖结构。在与虚拟现实或增强现实技术结合后,还能够为医疗教学提供珍贵的资料[1]。

相比传统的开放性手术,采用内窥镜技术辅助的微创手术不仅降低了创口尺寸,还可以借助灵巧的机械臂实现远程手术,为医疗资源的充分利用提供了一种新方向。然而,从内窥镜双目相机采集的视频中重建并模拟手术场景,是机器视觉领域中一项重要且高难度的任务[2]。此前的解决方案通常利用离散的术前医学影像(如磁共振成像(Magnetic Resonance Imaging,MRI) 和计算机断层扫描(Computed Tomography,CT) ,结合立体配准方法对施术部位进行三维重建[3]。然而,手术过程中,由于器械操作引起的器官组织形变以及器械遮挡,手术场景会不断变化,严重影响传统方法的重建完整性和速度,从而降低手术的安全性。

目前,可行的优化方向主要包括基于神经辐射场和基于高斯泼溅的重建方法。虽然神经辐射场因其良好的重建质量受到广泛研究,但其高昂的计算成本限制了其在动态形变手术场景重建任务中的渲染速度。与之相比,本文提出了一种基于高斯泼溅的重建方法,通过结合时域动态编码的场景表达,对形变组织进行高效建模,并配合与底层硬件兼容的加速渲染算法,解决了上述问题。在保证重建质量的同时,大幅提升了重建效率。

1 相关工作

1.1 基于立体视觉的重建方法

早期的研究通过计算立体方法[4-5]实现内窥镜场景的重建,其中多视角重建[6]是目前较为流行的方法。该方法以输入的 RGB 视频帧图像对为基础,通过使用特征点匹配算法(如 SIFT 算法[7]) 对图像进行配准,随后根据生成的深度值恢复三维点云,从而实现重建效果。然而,在手术器械遮挡的情况下,特征点匹配容易出错,导致无法达到预期效果。

近年来,一些研究尝试使用已知的几何先验信息作为网络的监督信息,但由于器官组织空间狭窄以及手术过程中组织形变的复杂性,三维几何信息的真实值难以获取。在此背景下,神经辐射场[8]和高斯泼溅技术[9]两种新兴三维重建方法相继被提出。

1.2 基于神经辐射场的重建方法

神经辐射场(Neural Radiance Fields, NeRF) 通过描述各点在不同视角下的颜色和体密度,实现对场景的建模。其采用多层感知机(Multilayer Perceptron,MLP) ,将场景中每一个点的三维坐标(x,y,z)和视角方向(θ,φ)作为输入,生成对应的 RGB值和体积密度。随后,利用体渲染技术将生成的 RGB 值c 和体积密度σ聚合为二维图像。

由于其高重建质量以及利用高频信息描述复杂场景细节的能力,神经辐射场被广泛应用于医疗场景的重建中,例如 EndoNeRF[10]。然而,由于其隐式表达的特性,NeRF 的结果难以被直观理解,同时其重建速度也难以显著提升。

1.3 基于高斯泼溅的重建方法

高斯泼溅(Gaussian Splatting) 因其显式表达的直观性以及基于 CUDA编译的光栅渲染器所带来的实时渲染能力而备受关注,因此许多研究工作逐渐从神经辐射场转向高斯泼溅。

高斯泼溅通过一组高斯球来描述整个场景,每个高斯球具有位置(μ)、旋转(R)、不透明度(o)、尺度(S)以及球谐函数(SH) 等属性。结合其可与 GPU底层语言 CUDA编译实现的可微分光栅化渲染器,高斯泼溅为场景表达带来了简易性和实时性。然而,高斯泼溅通常需要多视角图像序列进行初始化,如何简单快速地初始化高斯球并有效地重建器官组织的形变仍然是一个挑战,也是本文研究的重点。

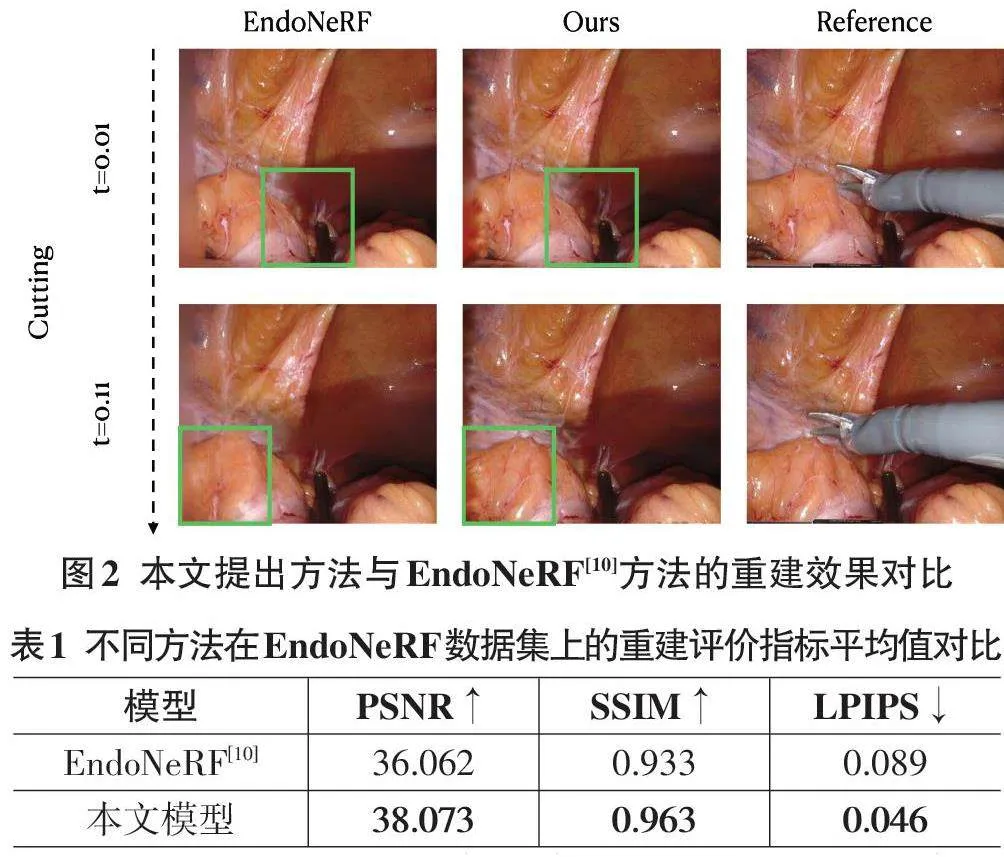

当t=0.01时,在手术器械遮挡部分的重建效果对比中,虽然本文方法相较于其他方法展现了更好的重建细节,但仍然无法很好地对模糊部分进行填补和修复,这也是本文方法的局限性所在。当t=0.11时,图中重建细节部分的对比表明,本文提出的网络在内窥镜手术场景中的形变组织重建上,能够呈现更丰富的细节以及更清晰的边缘纹理。

表 1 展示了本文所提出的模型与 EndoNeRF[10]网络在 EndoNeRF 数据集上的 PSNR、SSIM 和 LPIPS 评价指标平均值的对比结果。

实验结果表明,通过使用高斯泼溅和时域空间高斯形变场,本文模型重建的图像评价指标平均值均高于先前网络 EndoNeRF[10],这表明本文方法能够更好地对组织形变部位进行建模并生成更高质量的渲染结果。

4 结束语

本文提出了一种基于高斯泼溅作为场景表达的动态双目内窥镜场景重建网络。网络首先使用预训练的双目深度估计网络提取视频帧的深度信息,用于高斯泼溅初始化,从而增强重建结果的几何质量。其次,通过引入时域空间编码体系对动态形变组织部分进行建模,有效地从器械遮挡以及组织形变中恢复了高质量的手术场景。最后,引入边缘感知正则化函数对深度值进行监督,有效约束了重建的几何特性。在公开数据集 EndoNeRF[10]上的可视化以及指标对比实验表明,本文网络的效果优于其他工作。

同时,本文方法也存在一些限制与有待改进的方向。首先,本文利用深度信息初始化高斯泼溅,但未对直接融合产生的高斯参数进行修剪,由此产生的冗余参数可能会影响网络重建的实时性。其次,使用双目内窥镜采集数据对设备的要求较高。在接下来的研究工作中,为了使这一技术更广泛地应用,针对单目内窥镜数据的动态场景重建是一个很有价值的方向。此外,在本文的可视化对比实验中,被器械遮挡研究的部分未能被网络显著修补,因此可以考虑使用扩散模型(diffusion model) [18]等生成式领域的方法,辅助生成被器械遮挡部分的图像,从而获得完整的重建效果。