基于微多普勒角点特征与Non-Local机制的穿墙雷达人体步态异常终止行为辨识技术

杨小鹏 高炜程 渠晓东

(北京理工大学信息与电子学院 北京 100081)

1 引言

随着智能系统及处理算法的不断发展,人体行为识别技术在安防监控、救援行动和交互式智能家居等领域具有日趋重要的应用价值[1,2]。穿墙雷达利用低频超宽带(Ultra-Wide Band,UWB)电磁波穿透建筑物墙体[3],对室内人员进行探测和识别[4,5]。与光学、红外、穿戴传感器等手段相比,穿墙雷达透过墙壁、门窗等障碍物获取目标信息,无需直接观测目标,且不存在物理接触,具备较高的安全性和隐私性[6,7]。因此,穿墙雷达能够在复杂城市建筑环境下实现遮蔽空间的人体行为识别[8]。

基于穿墙雷达实现人体目标探测的工作可以追溯到2000年。文献[9]提出了一种基于机器人平台的人体运动探测雷达。文献[10]改进了文献[9]中的机器人平台穿墙雷达,在典型楼宇环境中开展了相关实验,验证了人体目标检测、定位以及行为识别的有效性。文献[11]利用希尔伯特-黄变换(Hilbert-Huang Transform,HHT)实现微多普勒信息的解耦,因其对非线性和非稳态信号具有较强的自适应能力,提取的微多普勒时频特征可有效提高后端识别算法的精度。文献[12]提出了基于快速傅里叶变换(Fast Fourier Transform,FFT)和S变换的微多普勒特征可视化技术,利用图像处理和机器学习算法实现人体生命特征的探测和识别。文献[13,14]提出了一种多重希尔伯特-黄变换(Multiple Hilbert-Huang Transform,MHHT)方法,用于穿墙场景下人类活动微多普勒特征的时频分析,提升了微多普勒特征提取粒度。文献[15]提出了一种基于像素变化条纹图案的新型原始测距轮廓数据预处理方法,该方法可以呈现出比原始时频像更清晰的微多普勒特征变化趋势,提高了识别精度。文献[16]提出了一种时频域相对信噪比特征,定量估计多输入多输出(Multiple-Input Multiple-Output,MIMO)雷达系统回波中的微多普勒特征,实现快速精确的人体行为识别。文献[17]利用复值卷积神经网络(Complex-Valued Convolutional Neural Network,CV-CNN)研究了直接利用原始雷达回波实现穿墙人体活动识别的可行性。该工作利用CV-CNN迭代学习雷达原始回波的时域复数矩阵实现对墙后的人类活动进行分类,并在行走、挥臂等多种典型室内人体行为上取得了较高的验证准确率。

现有方法从穿墙雷达回波中提取人体运动的微多普勒特征,利用隐含的人体运动的速度和加速度等信息,实现人体异常行为识别[18]。但是,识别模型中特征提取过程未经筛选,用于决策分类的语义图像特征分离度较低,难以对运动状态接近的某些突发步态异常终止行为实现准确识别[19,20]。因此,本文利用特征表示学习框架,提出一种基于微多普勒角点特征与Non-Local机制的穿墙雷达人体步态异常终止行为辨识方法。该方法紧密结合人体运动模型的微多普勒信息表示方法,实现特征选择和降维,并利用该特征设计识别模型,提升人体步态异常终止行为识别精度和泛化能力。本文的主要研究工作及创新点如下:

(1) 微多普勒角点特征选择及提取方法:本文提出一种人体运动微多普勒特征的角点表示方法,同时实现特征选择和降维。微多普勒角点特征代表人体运动距离及时频像上像素灰度沿不同方向急剧变化的点,反映了人体肢节点运动过程中的距离、速度曲线的拐点、驻点、相交点以及边界点。受人体运动学模型的约束,该方法能够提高在前期运动状态非常接近的某些突发步态异常终止行为类别上的特征分离度;

(2) 基于Non-Local神经网络的角点特征集识别决策方法:本文提出一种基于Non-Local机制的深度神经网络设计框架。该方法输入穿墙雷达图像的微多普勒角点特征集,通过网络对全局信息的敏感性,学习角点图像的形态、结构特征,在保证较高识别准确率的前提下,提升模型的泛化能力。

2 穿墙雷达回波及预处理

在不考虑多径效应的前提下,根据叠加原理,穿墙雷达的接收信号可以近似等效为墙体回波、以各节点为散射中心的点散射体的回波以及背景噪声三者的和[21]。假设穿墙雷达发射信号在相参处理时间(Coherent Processing Interval,CPI)内包含了M个脉冲重复间隔(Pulse Repetition Interval,PRI)。则其第m个PRI对应的时域发射波形为

其中,Atx为发射信号的幅度,Ts为PRI。µ=B/Ts调频斜率,B为带宽,fc为载波频率。φtx为发射信号的初始相位。经补偿后的穿墙雷达时域回波为

假设墙体回波为Sb,m,wall(t),背景噪声为Sb,m,noise(t),则最终所得第m个PRI对应的完整雷达时域回波为

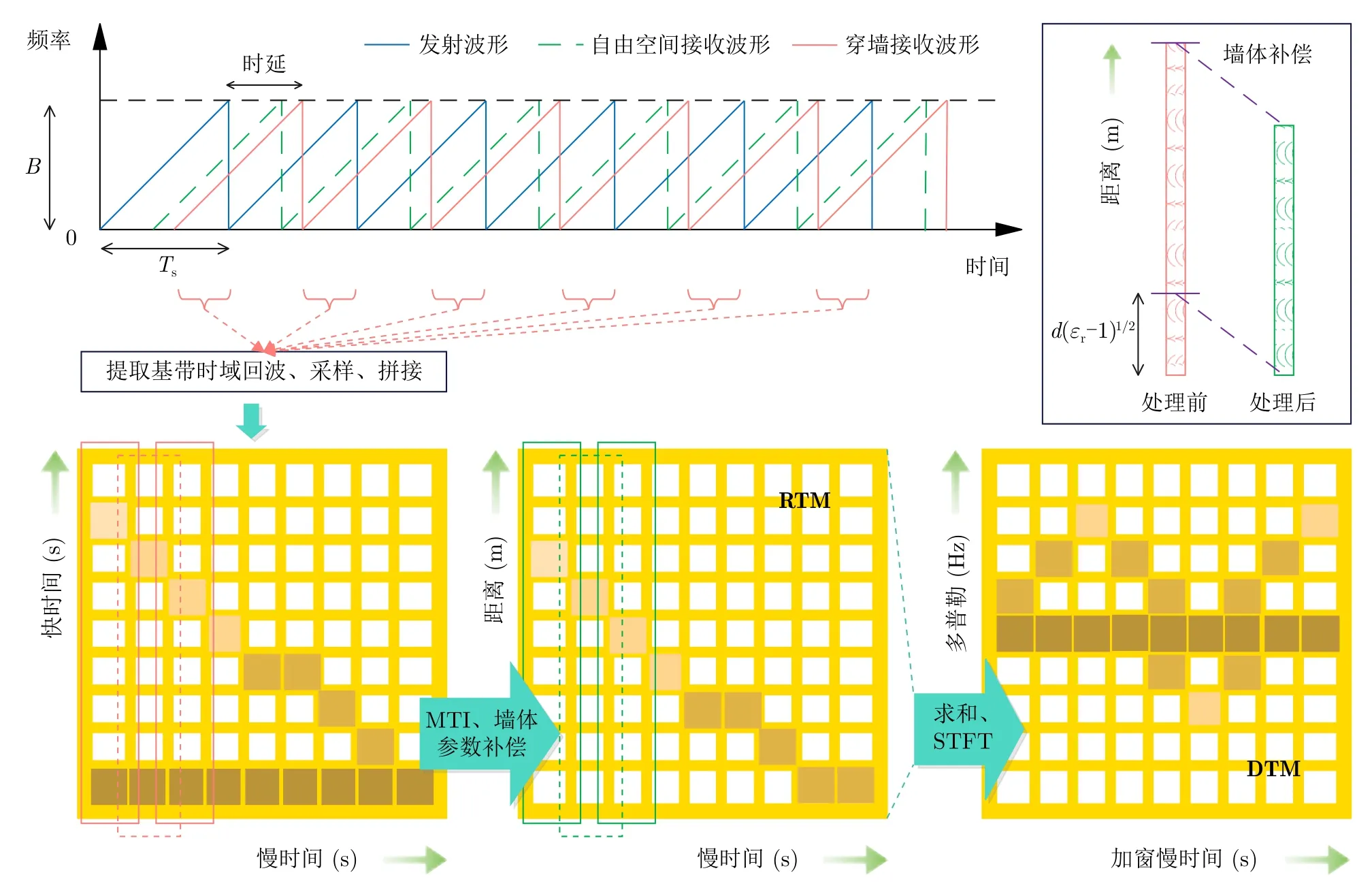

直接从穿墙雷达时域回波中难以提取人体节点运动的距离及速度信息。本文首先沿慢时间维度拼接CPI内M个PRI的穿墙雷达时域回波,将所得矩阵取模值并归一化,得到距离-时间图像(Range-Time Intensity Map,RTM):

其中,Con() 为向量拼接操作。Norm()为矩阵的线性归一化方法,对于矩阵X:

其中,max() 和 min()分别代表取矩阵最大值和最小值的函数。所得RTM中近似包含了墙体回波R TMwall、人体运动回波 RTMmv和 背景噪声 Ns共3个分量,即

其中,墙体回波具备低秩特性,可通过动目标显示(Moving Target Indicator,MTI)去除[22]:

本文采用经验模态分解算法(Empirical Modal Decomposition,EMD)进一步抑制静止目标杂波和背景噪声[23]。假设EMD将RTM分解为e2个模态的分量,选取其中第2到第e1模态的分量近似表示人体回波,其中e2>e1>2,e1∈Z+,e2∈Z+。将所选取的e1-1个模态分量重建为新的矩阵,得到:

其中,IMFi表示EMD分解后的第i个模态,Res 为残差项,EM()代表EMD的处理流程,其时间复杂度约为O(It·M·log(M)),空间复杂度约为O(It·M),其中 It 为总的迭代步数。

为了获得雷达回波中的多普勒信息,本文利用短时傅里叶变换(Short-Time Fourier Transform,STFT)生成多普勒-时间图像(Doppler-Time Intensity Map,DTM)[24]。对 RTM沿着快时间维度将矩阵求和,经STFT和归一化后,得到DTM。上述过程的数学表示为

上述处理过程如图1所示,在每个CPI中,M个PRI的雷达回波经拼接、归一化、MTI预处理后得到 RTM 和 DTM,分别通过EMD提取目标分量RTMmv和 DTMmv。为了更好地提取微多普勒特征,将 RTMmv和 DTMmv通过插值方法由线性单位变换为平方单位,分别得到 R2TM 与 D2TM。该两类图像作为微多普勒角点检测的数据基础,包含了人体目标节点运动的平方量测距离、平方量测速度信息。

图1 穿墙雷达回波模型图示Fig.1 Schematic diagram of through-the-wall radar echo modeling

3 微多普勒角点检测方法

本文提出的微多普勒角点特征,是指在R2TM或 D2TM像中,具有明显边缘变化和方向变化的像素点,如图2所示。这些特征通常位于图像中人体节点运动迹线的相交、驻点或拐点处,其周围区域的像素梯度变化较大,能够利用阈值检测算法提取。

考虑到 R2TM 图像上人体步行全程运动的距离曲线特征相对稳定,且同一时刻人体目标占据的距离单元数较少,图像像素向垂直于慢时间轴的灰度变化较平缓,本文采用Harris角点模型对 R2TM进行特征度量[25]。定义图像窗口ψ(u,v),当滑窗同时向u和v两个方向移动时,计算窗口内部的像素梯度势函数E(u,v):

矩阵形式为

设置阈值 ThR,若 Hr>ThR,则将当前点(u,v)标注为角点,直到遍历整幅图像。该检测过程的时间复杂度及空间复杂度均约为O(H·W·κψ),其中κψ是与窗口ψ(u,v)大小相关的常数。

考虑到D2TM图 像上人体突发异常行为瞬间的速度曲线特征占用的多普勒带宽较大,图像像素向垂直于慢时间轴的灰度变化较急剧,本文采用Moravec角点模型对 D2TM进行 特征度量[26]。D2TM图像上4个方向的梯度分别为:gu,v,gu+i,v,gu+i,v+i,gu,v+i,代表窗口内 D2TM[u,v]沿u →u+i与v →v+i方向的像素差值,i为计算梯度像素的步长。计算4个方向梯度的平方和:

其中,k为窗口半长度。那么,Moravec函数为

设置阈值T hD,若 Mr>ThD,则将当前点(u,v)标注为角点,直到遍历整幅图像。该检测过程的时间复杂度及空间复杂度同样均约为其中是与窗口ψ(u,v)大小相关的常数。

降维后角点空间的特征数量会影响异常行为辨识的准确率、泛化能力以及鲁棒性。特征数量过多,数据冗余、噪声、耦合加剧,从而降低模型的泛化能力和鲁棒性;特征数量过少,所得角点图像不足以反映人体运动的完整信息。综合人体运动学物理模型,穿墙雷达信号模型以及上述几点考量,R2TM 上的最优点数选取为 30,D2TM上的最优点数选取为 22。工程应用时,将计算窗口分别在R2TM 及 D2TM上滑动遍历,对所有像素点的Harris及Moravec兴趣函数结果排序,分别对应输出值最大的 30 点及 22点坐标,即得所需的角点特征图。

4 人体步态异常终止行为角点特征识别方法

将 R2TM 及 D2TM 通过对应的检测方法生成角点特征图,主要包括:空场景(S1),室内人体自然行走(S2),步行中存在坐卧或跌倒等突发步态异常终止行为(S3)等3种状态,作为识别网络训练和推理的特征数据集。由于角点特征集具备较强的稀疏性,为了实现高精度的特征提取,本文提出基于Non-Local机制的卷积神经网络实现突发行为识别。全局依赖性建模有助于提高神经网络对图像上长距离形态相关性的感知能力,改善网络的识别准确性和泛化能力[27]。

本文所提网络结构如图3所示。首先,将R2TM和 D2TM 角点特征集映射为伪彩色图,并沿通道方向拼接,形成H×W×C维的输入图像。将输入图像通过通道数为C0的 1×1卷 积处理,形成H×W×C0维的图像。特征提取网络引入 16路并行卷积链路,每个链路包含了3个级联的卷积层:第1个卷积层的通道数C′=4,尺度 1×1;第2个卷积层的通道数C′=C1,尺度 3×3;第3个卷积层的通道数C′=4,尺度 1×1。将所有链路的输出特征图求和,并通过残差连接的方式与输入特征图求和。将求和所得的特征图分别通过批归一化、ReLU激活函数、全局上下文信息提取模块的处理,得到特征图1,其维度为H×W×C1。将特征图1依次通过上述同样结构的多链路并行卷积、残差连接求和、批归一化、ReLU激活、全局上下文信息提取模块的处理,得到特征图2,其维度为H×W×C2。如此重复堆叠4次输出特征图4,其维度为H×W×C4。将特征图4通过尺度变换拉伸为 1×1×HWC4维的列向量,经全连接操作和 Softmax 激活函数映射为1×1×3的输出向量。该网络整体参数量约为 67.1 M。

图3 基于Non-Local机制的神经网络结构Fig.3 Neural network architecture based on Non-Local mechanism

图4 全局上下文信息提取模块结构Fig.4 Structure of the global context information extraction module

全局上下文信息提取模块是一种具备即插即用能力的Non-Local机制,用来聚焦诸特征图层上散点的全局信息,如图4所示,输入为H×W×C维的图像。一条支路利用通道数为1的 1×1卷积获取H×W×1维度的上下文信息特征图,经尺度变换拉伸为HW×1×1 维的列向量,并通过 Softmax激活函数非线性化,得到特征图F1。另一条支路经尺度变换拉伸输入图像,得到 1×HW×C维的矩阵,即特征图F2。将F1和F2相乘,依次通过通道数C/r的 1×1 卷积、层归一化、ReLU非线性化、通道数C的 1×1 卷积处理,得到 1×1×C维的特征向量F3。最后,将该特征向量F3与输入图像点乘融合得到输出图像。

本文利用交叉熵作为损失函数:

其中,L表示损失函数,Samp表示一个批内的样本数量,Trueij表示第i个样本的真实标签(One-Hot编码)中第j个类别的值,pij表示第i个样本属于第j个类别的概率值。

5 仿真与实测结果分析

本文建立了穿墙雷达人体步态异常终止行为回波仿真和实测数据集,并对所提方法的准确性、鲁棒性、泛化能力及结构设计合理性进行了验证。

5.1 实验参数设置

实验过程中,本文设计了空场景(S1)、室内人体自然行走(S2)、步行中存在坐卧或跌倒等突发步态异常终止行为(S3)等3种不同状态。

仿真数据集包括训练集、验证集和测试集。其中,训练集和验证集来自伦敦大学院开源的动作捕捉(Motion Capture,MoCAP)成果。基于Mo-CAP的雷达人体行为识别仿真数据集的生成方式包括3个步骤:(1)轨迹数据平滑:通过对MoCAP中捕捉到的运动数据进行预处理,包含去噪、滤波和关键节点筛选步骤,以获得更准确和平滑的运动轨迹数据;(2)运动仿真:使用平滑后轨迹数据,将人体各肢节点均近似抽象为各向同性均质的椭球体或球体模型,给出三维空间中体素化的刚体运动仿真结果;(3)雷达回波仿真:利用论文所提的穿墙雷达回波模型和仿真环境参数,将虚拟人体的体素化运动信息转化为雷达回波数据。最后利用论文第2节所提的回波预处理方法生成雷达图像,打上对应的行为标签,即得所需的仿真数据集。在仿真过程中,人体模型身高为 1.8 m,墙体为相对介电常数εr=6的各向同性均匀长方体介质[28]。测试集的生成方式与训练集一致,但人体模型身高近似为1 .7 m。经仿真S1,S2,S3状态下分别得到 480组训练数据、120 组验证数据和 60组测试数据。

实测数据集包括训练集、验证集和测试集。利用团队搭建的穿墙雷达样机系统开展实验,获取训练集和验证集,系统参数如表1所示,实验场景如图5所示。实验中,受试者身高约为 1.8 m,墙体为厚度 0.12m 的单层空心砖砌墙,相对介电常数εr≈6,二维导轨固定在距地 1.5 m高处不动,且保持收发天线紧贴墙体。测试集的生成方式与训练集一致,但受试者身高约为 1.7 m 。经实测S1,S2,S3状态下分别得到 480 组训练数据、120 组验证数据和 60组测试数据。

表1 雷达数据采集系统工作参数设置Tab.1 Radar data acquisition system operating parameters settings

图5 实测数据的测试场景Fig.5 Scenarios of measured experiments

实验所用的上位机为Windows 10 Professional 64位操作系统,数据处理平台为MATLAB R2023a。神经网络搭建平台为Python 3.7,Paddlepaddle 2.4.0。训练环境为Intel Core i7 CPU,32 GB运存,NVIDIA Tesla V100 GPU,32 GB显存。验证、测试环境为Intel Core i9-10850K CPU,24 GB运存,NVIDIA RTX 3060 OC GPU,12 GB显存。具体网络参数设置如表2所示。在当前软硬件及超参数配置条件下,网络的训练时长约为1小时 21分钟,推理速度约为 55帧每秒(Figure Per Second,FPS),含模型加载过程的单帧图像推理时长约为 2.7 s,小于一帧图像的慢时间累积长度 4 s。

表2 网络训练及验证过程参数设置Tab.2 Parameter settings for network training and validation process

5.2 可视化验证

5.2.1 数据可视化

本节对空场景(S1)、室内人体自然行走(S2)、突发步态异常终止行为(S3)这3种状态下的典型数据进行可视化呈现,结果如图6所示,主要包括:图6(a)第1行给出了S1,S2和S3上一组典型数据的 R2TM;第2行给出了对应的 D2TM 。图6(b)第1行给出了S1,S2和S3上该组典型数据的 R2TM角点特征图;第2行给出了对应的 D2TM角点特征图。

图6 仿真及实测数据的可视化Fig.6 Visualization of simulated and measured data

从仿真和实测的 R2TM 中可以看到,突发行为和自然行走间存在较为明显的节点运动趋势差异,该差异体现在突发加速后。S2中手、脚等节点呈现远离或靠近雷达的周期性运动趋势,而S3中手、脚等节点会在一个短暂的快速加速过程后趋于静止。对比S2和S3对应的 R2TM角点特征图,其差异体现在角点的分布趋势。由于本文所提方法约束了最小点数,因此突发行为后角点聚集于头、躯干等节点的迹线上,自然行走的角点聚集于手、脚等节点的迹线上。

从仿真和实测的 D2TM 中可以看到,突发行为和自然行走之间存在较为明显的节点运动速度及多普勒带宽的差异,该差异主要体现在突发加速瞬间。S2中手、脚等节点呈现相对雷达速度的周期性变化趋势,而S3中手、脚等节点产生瞬时多普勒谱峰。虽然实测数据中的特征相对仿真数据中的特征较为模糊,但微多普勒角点均可以被检测。对比S2和S3对应的 D2TM角点特征图,其差异体现在角点在多普勒方向上的形态。S3中的角点能够良好地表征瞬时谱峰特性,其与零多普勒轴的平均距离大于S2中的角点。

5.2.2 网络训练过程可视化

图7展示了所提基于Non-Local机制的异常人体行为角点特征识别方法在仿真、实测数据集上的训练及验证过程可视化,分别绘制准确率上升及损失函数下降曲线,网络训练的超参数如表2所示。实验结果证明,经20轮的训练,所提方法在仿真及实测数据集上均达到收敛。由于角点特征图像具备很强的稀疏性,在仿真和实测数据集上,网络的训练过程中存在轻微的梯度消失现象。得益于Non-Local机制对图像全局特征的敏感性,该问题在网络多批次训练中逐渐弱化。此外,通过选择具备最佳验证准确率的中间轮模型可以进一步有效避免准确率下降问题。

图7 所提网络训练及验证过程的准确率、损失函数曲线Fig.7 Accuracy and loss curves for the training and validation process of the proposed network

5.3 推理性能对比分析

5.3.1 特征嵌入空间对比分析

图8展示了不同方法在仿真和实测两类验证数据集上推理的特征嵌入空间对比。对比方法包括:TWR-SNN[29],FC-SLSTM-FC[30],RPCA-Based[31],TWR-ResNeXt[32]和TWR-CapsuleNet[33]。所有方法的输入均为同时使用 R2TM 和 D2TM,且与所提方法网络阶段的预处理方式保持一致,网络训练的超参数如表2所示。可视化的嵌入空间均选自网络用于决策的全连接层前的特征图,并通过T-分布随机邻近嵌入(T-distribution Stochastic Neighbour Embedding,T-SNE)算法实现降维[34]。降维数据量为 60,维度为3。从对比结果中可知,得益于人工特征选择及网络特征聚焦的表示学习设计思路,所提人体行为识别方法在仿真及实测数据集上推理得到的特征嵌入空间能够良好地反映空场景(S1)、室内人体自然行走(S2)及突发步态异常终止行为(S3)3类数据的分布规律。其降维后的类间特征分离度更大,类内特征分离度更小,有助于网络决策层实现快速精确拟合,提高准确性和泛化能力。针对室内人体自然行走(S2)及突发步态异常终止行为(S3)两类数据,对比方法推理的特征嵌入空间降维后仍存在类间样本点交叠的情况,而所提方法推理的特征嵌入空间降维后数据样本点线性可分。

图8 神经网络的特征嵌入空间可视化对比Fig.8 Comparison of feature embedding visualization of neural networks

5.3.2 准确性对比分析

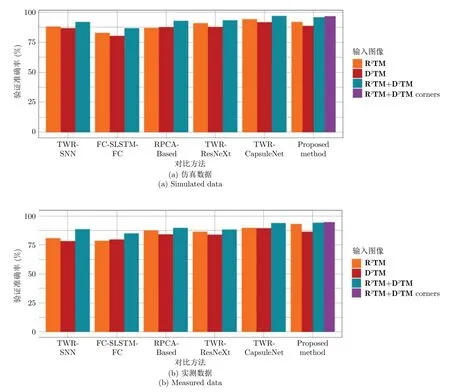

图9展示了不同方法在仿真和实测两类数据集上验证的混淆矩阵。从对比结果中可知,所提人体行为识别方法在仿真及实测数据集上训练过程的最终收敛准确率分别为 100.0%,97.6%。在仿真验证数据集上,所提网络准确率为 96.7%,仅略低于TWRCapsuleNet。在实测验证数据集上,所提网络的准确率为 94.7%,较对比方法准确性高。针对突发步态异常终止行为(S3),得益于主干部分多链路卷积加宽网络以及Non-Local机制的设计思路,所提方法在仿真数据集和实测数据集中均有最高的识别准确性。此外,本文还对比了不同输入图像条件下,现有方法在仿真和实测两类数据集上验证的准确率,如图10所示。其中输入图像包括仅使用 R2TM、仅使用 D2TM、融合 R2TM 与 D2TM、所提的角点检测方法。从对比结果中可知,融合 R2TM 与D2TM两幅图像的信息有利于网络方法实现更高准确率的识别。通过角点检测后,所提方法在仿真和实测验证上均比直接融合 R2TM 与 D2TM取得了更高的准确率。

图9 模型验证的混淆矩阵对比(每组中左侧混淆矩阵对应仿真数据集,右侧混淆矩阵对应实测数据集,数字标签1-3对应S1-S3类样本)Fig.9 Comparison of confusion matrices for model validation (In each group,the left confusion matrix corresponds to the simulated dataset,the right confusion matrix corresponds to the measured dataset,and the numerical labels 1-3 correspond to the samples of classes S1-S3)

图10 不同输入图像条件下的模型验证准确率对比Fig.10 Comparison of model validation accuracy under different input image conditions

5.3.3 鲁棒性对比分析

本节中,向 R2TM和 D2TM图像添加不同功率的高斯白噪声,仅改变验证集的图像信噪比(Signalto-Noise Ratio,SNR)[35],使生成的图像较原图像的SNR分别下降2 dB,4 dB,6 dB,8 dB,10 dB,12 dB。利用训练好的网络模型,对不同SNR下的验证集直接推理,分别计算准确率,结果如图11所示。结果中,横坐标表示图像SNR的改变量。从图中可以看出,随着图像SNR的下降,所有方法的准确率呈现出下降的趋势。在仿真验证数据集上,当SNR较高时,所提方法的准确性仅略低于TWR-CapsuleNet;但是,当SNR下降时,所提方法的准确性逐渐超过TWR-CapsuleNet。在实测验证数据集上,得益于角点检测可以有效滤除原始图像噪声,所提方法在不同的SNR下识别准确率均最高。

图11 模型验证的鲁棒性对比Fig.11 Robustness comparison of model validation

5.3.4 泛化能力对比分析

为了对比不同方法对不同受试者的泛化能力,本文利用训练完成的网络对测试数据集进行推理,结果如表3所示。由于生成测试集过程中,受试人员的身高、体态、步态等参数与训练集不同,R2TM和 D2TM图像上的微多普勒特征存在差异,各方法的测试准确率通常低于验证准确率。因此,同一行为的验证准确率和测试准确率的差异越小,意味着方法的泛化能力越强。通过对比可知,不同方法在仿真测试集上的准确率均不低于71.7%,在实测测试集上的准确率均不低于62.8%。得益于角点检测能够在实现特征降维的同时最大限度上保留人体运动的微多普勒信息,所提方法在仿真和实测测试集上准确率均最高,分别为93.3%和88.3%。在仿真数据集中,验证和测试准确率差异为3.4%;在实测数据集中,验证和测试准确率差异为6.4%,差异较现有方法最小,表明所提方法较现有方法提升了网络的泛化能力。在所有对比方法中,RPCA-Based因其在数据处理过程引入了低秩稀疏分解,验证和测试的准确率差异较小,表明特征降维可以提升模型泛化能力。此外,本文利用仿真数据集上训练完成的网络对实测的验证集和测试集进行推理,结果如表4所示。由于异源的 R2TM 和 D2TM图像上的微多普勒特征分布存在差异,各方法的验证及测试准确率通常均低于在同源数据集上的推理结果。通过对比可知,不同方法的验证准确率均不低于74.2%,测试准确率均不低于60.0%。得益于角点检测后,异源数据间的微多普勒特征分布差异被缩小,所提方法的验证和测试准确率差异最小,仅为5.8%。在所有对比方法中,RPCA-Based验证和测试的准确率差异仍相对较小,进一步证明特征降维可以提升模型泛化能力。

表3 所提方法及现有方法针对验证及测试集的精度对比(%)Tab.3 Comparison of accuracy of proposed and existing methods for validation and test sets (%)

表4 所提方法及现有方法在仿真数据集上训练,并在实测数据集上验证及测试的精度对比(%)Tab.4 Comparison of the accuracy of the proposed method and existing methods trained on simulated datasets and validated or tested on measured datasets (%)

5.4 消融验证

5.4.1 微多普勒角点检测方法消融实验

所提方法利用微多普勒角点检测实现特征提取,生成角点特征集,并在识别网络上训练。在所提方法中,利用Harris检测器提取 R2TM中的角点,利用Moravec检测器提取 D2TM中的角点。对比方法包括不同检测器与数据的交叉组合,对比结果如表5所示。在保持后端识别网络不变的前提下,所提方法生成的角点特征集在仿真验证数据、实测验证数据、仿真测试数据和实测测试数据上的准确率都最高。由于Harris检测器以直角坐标系的形式计算图像梯度,而Moravec检测器以间隔 45°的形式计算图像梯度,因此二者对图像中不同开口角度的角点的敏感性不同,导致在 R2TM 和 D2TM上的检测精度不同。此外,本文对比了角点检测前后的识别性能差异,对比方法包括直接输入R2TM、直接输入D2TM及融合输入 R2TM 与 D2TM进行网络训练、验证及测试,对比结果如表5所示。在保持后端识别网络不变的前提下,若不使用角点检测方法,所提方法的验证准确率下降,且与测试准确率的差异增大,模型对数据分布的拟合性能、泛化能力均下降。

表5 微多普勒角点检测方法的消融验证(%)Tab.5 Ablation validation of micro-Doppler corner detection methods (%)

此外,本文还对比了利用所提微多普勒角点特征与多种常见的计算机视觉特征进行模型验证及测试时的精度。对比方法包括:基于Canny算子的边缘特征、图像灰度共生矩阵特征(Gray-Level Cooccurrence Matrix,GLCM)、局部二值模式特征(Local Binary Pattern,LBP)、Laws纹理特征[36]。对比结果如表6所示。在保持特征图像处理方法与后端识别网络设计不变的前提下,除仿真验证集上Canny算子边缘特征的推理结果外,所提微多普勒角点特征提取方法在仿真验证数据、实测验证数据、仿真测试数据和实测测试数据上的准确率都最高。由于所提微多普勒角点特征相对于其他计算机视觉特征在保留人体肢节点运动距离、速度信息的条件下,最小化了降维后的特征尺度,因此在仿真和实测上都取得了最佳的泛化性能。

表6 微多普勒角点特征与其他常见计算机视觉特征的性能对比(%)Tab.6 Performance comparison of micro-Doppler corner point features with common computer vision metrics (%)

5.4.2 骨干网络消融实验

所提方法识别网络的骨干部分采用宽度为 16路并行的ResNeXt,对比方法包括经典卷积骨干网络:AlexNet[37],VGG-16[38],VGG-19[38],ResNet-18[39],ResNet-50[39],ResNet-101[39],GoogleNet Inception V1[40],GoogleNet Inception V2[40]和GoogleNet Inception V3[40]。全局上下文信息提取模块保持不变,均内插到骨干网络各循环节的激活函数输出后。对比结果如表7所示,所提方法骨干网络通过加宽网络的改进,在仿真验证数据、实测验证数据、仿真测试数据和实测测试数据上的准确率都最高。对比方法中,针对同一类网络结构的设计,随着网络的深度加深,其验证和测试准确率并不严格递增。因此,所提方法通过控制骨干网络的深度,使得仿真、实测验证集和测试集的准确率差异较小,有效缓解过拟合问题,进一步提高方法整体的泛化能力。

5.4.3 Non-Local机制消融实验

本文利用全局上下文信息提取模块学习图像像素的全局分布特性,对比方法包括了注意力模块及其他Non-Local机制:通道注意力[41],空间注意力[41],卷积注意力[41],Criss-Cross注意力[42],传统Non-Local模块[43]和Bilinear Attentional Transform Non-Local (BAT)模块[43]。对比结果如表8所示,得益于在通道和空间两个不同维度上对图像语义特征转置相乘的操作,基于所提全局上下文信息提取模块构建的识别网络在测试集上达到了最高的准确率。虽然基于BAT模块构建的识别网络在验证集上达到了最高的准确率,但其在测试集上表现不佳,证明其在角点特征集上泛化能力不足。

6 结语

本文提出了一种室内人体步态异常终止行为识别方法,解决了穿墙雷达场景下,当生成训练集和测试集的受试者不同时,行为识别方法准确率低和泛化能力较差的问题。所提方法利用MTI和EMD技术抑制RTM和DTM图像上的杂波及噪声;利用Harris与Moravec检测器分别提取 R2TM 和 D2TM图像上的角点特征,建立角点特征数据集;利用基于Non-Local机制的全局上下文信息提取网络学习角点图像的形态、结构特征,提升识别准确率和泛化能力。利用仿真与实测数据集开展了推理准确性、鲁棒性及泛化能力等对比实验和消融实验,实验结果表明所提方法可以有效地识别室内人体步态异常终止行为。

附录

本文开源代码链接如下:

https://github.com/JoeyBGOfficial/Through-the-Wall-Radar-Human-Activity-Recognition-Based-on-M-D-Corner-Feature-and-Non-Local-Net。

利益冲突所有作者均声明不存在利益冲突

Conflict of InterestsThe authors declare that there is no conflict of interests