基于微表情分析的在线学习评价模型与实证

孙建乔 ,丁涵宇 ,张功杰

(1.江苏师范大学 智慧教育学院,江苏 徐州 221116;2.江苏大学 计算机科学与通信工程学院,江苏 镇江 212013)

1 前言

在线学习是一种利用网络平台进行远程教学活动的学习方式.相比于传统的面对面课堂学习,在线学习突破了时间和空间的限制,实现了教学资源的均衡分配.尤其在疫情期间,在线学习发挥了前所未有的作用,保证了学习的正常进行.然而,在线学习与面对面教学课堂相比,缺乏师生之间的交流和互动,充满交互的线下课堂变成由教师主导的讲解过程,不利于学习氛围的营造[1].更重要的是,教师不能够及时掌握学生的学习状态,例如,学生是否掌握了某概念、是否理解了某个过程.因此针对上述在线学习存在的问题进行研究,提出采用微表情分析的方法对在线学习实施评价,旨在为教师提供具有参考价值的教学反馈信息.

微表情是人类情绪的直接表现,具有自发性、无掩盖等特点.1966 年,Haggard 和Isaacs 首次发现了这种微表情的存在[2];数年后,Ekman 和Friesen 在抑郁症患者的录像中,发现几帧画面中的极度痛苦的表情,遂将其与病人撒谎联系起来,证实该表情与真实情绪有关[3].2002 年,Ekman 开发出微表情训练工具后[4],不断涌现出手工提取微表情特征的算法和微表情数据集,微表情识别也取得了显著进展.深度学习的发展和应用,也为微表情识别带来重大突破,特别是Alex Net[5]在ImageNet[6]数据集上运行的结果,有力地证明了深度学习在微表情识别性能上的出色表现.目前,微表情识别理论和应用研究方面取得了显著成果.文献[7]将层次卷积递归神经网络和基于鲁棒主成分分析的递归神经网络相融合,提高了微表情识别的准确性.文献[8]将支持向量机分类器与线性核和深度信念网络进行集成,能够识别很多种面部特征.在课堂学习评价方面,文献[9]通过分析微表情来评价学生的学习效果,能够自动跟踪和分析学生在教学过程中的专注度和情感状态.文献[10]基于深度学习识别微表情,并设计出一种能够分析学生班级集中度的系统.

本文在综合考虑鲁棒性、计算复杂性、执行效率等因素的前提下,结合教学内容组织和管理,将YOLOv5 目标检测算法应用于实际教学课堂,建立表情特征与学习状况之间的对应关系,实现在线学习评价,这有助于及时发现教学中的问题.

2 问题描述与解决方法

2.1 问题描述

基于微表情分析的在线学习评价过程如图1 所示.(1)对教学内容进行有效组织和管理,理清内在的逻辑关系;(2)按照教学计划或选择相应的教学内容实施教学,并在教学过程中实时采集教学视频;(3)通过时间建立学习者、教学内容,以及微表情图像之间的关联关系;(4)利用微表情识别模型对微表情图像实施分析时,先确定关注的教学内容,选择考察学生对象,并通过学生、教学内容和视频之间的关联关系,确定待分析的微表情图像集;(5)利用微表情识别模型对待分析的微表情图像集实施分析,记录识别结果;(6)基于微表情识别的记录集,通过学习效果分析过程,得到学习效果评价结果.更进一步,对被考察的学生进行现场调研,分析评价结果的有效性.

2.2 教学内容组织

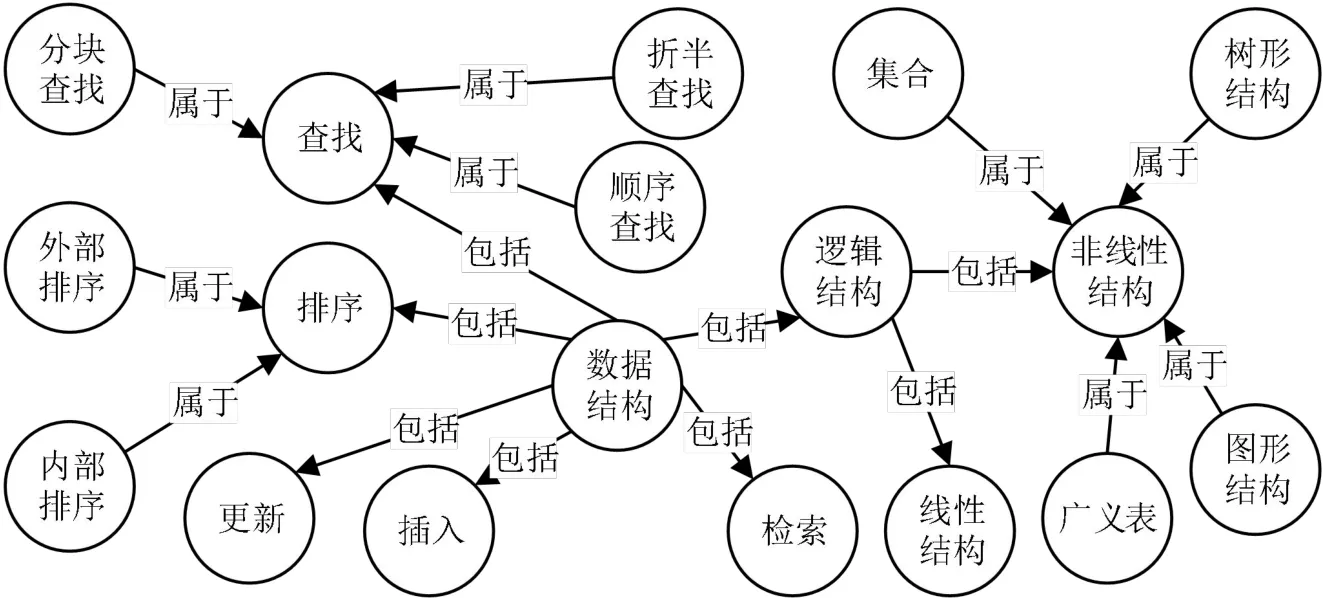

教学内容由相互关联的知识点组成,对这些知识点进行有效地组织和管理,有助于澄清教学内容之间的知识关系.本文采用知识图谱对教学内容进行组织和管理,简化收集、分析、整合和处理的构建方法,构建过程为:(1)实体抽取,即确定具体知识点,记为S={s1,s2,…,s|S|};(2)关系建立,即建立知识点之间的关系,记关系类型集合为R={r1,r2,…,r|R|};(3)知识存储及可视化,即构建知识图谱,记知识图谱为有向图G={(si,rj,sk)|si,sk∈S,rj∈D}.

在实际应用中,可以直接使用Neo4j 图数据库存储实体以及实体关系,构建对应的知识图谱[11].以数据结构为例,构建的知识图谱局部图如图2 所示.

图2 知识图谱的局部

2.3 表情图像获取和表情特征识别

在选择微表情图像时,需要考虑教学内容、考察对象,以及获取时间等因素,例如,选择教师提问后的学生的微表情图像.教师提问是一种常见的交互方式,通过分析学生在被提问时的微表情变化,能够获取他们思考、理解等情感状态的重要信息[12].心理学家Ekman 提出了六种主要情感:高兴、愤怒、厌烦、恐惧、悲伤和惊讶[13].教学中,学生的情感状态更为复杂,在借鉴现有学生表情识别研究[14]的基础上,结合实际观察,增加了中性和焦虑两种情感判断.

文献[15]对情感状态与学习状况进行分析,说明在学习时客观事物与主观期望一致时,会出现积极的情感属性,反之亦然.微表情作为一种隐含的情感表达方式,能够传递学习者的情感状态.因此,需要建立微表情特征与学习状况之间的对应关系(见表1).

表1 表情特征与学习状况的关系

3 实验与分析

3.1 实验方案设计

分别在计算机网络、设计模式、软件体系结构中,选择3 个理论点(教学内容)作为检测对象,选择10-20 位学生作为调查对象(见表2)以验证所提方法的性能.

根据上述实验设计,采集微表情图像.图3 为讲授某个教学内容时部分学生的微表情图像.

图3 部分学生的微表情图像

3.3 识别模型训练

实验基于Python 3.8.3 和Pytorch1.12.1,CPU 为AMD Ryzen 76 800 H,GPU 为NVIDIA GeForce RTX 3 060 GPU 6GB,内存大小为16 GB,缓存空间为512 GB.

3.3.1 数据收集与预处理

实验中,微表情标签分为8 种,利用0-7 记录,分别表示Angry、Disgusted、Happy、Neutral、Sad、Scared、Surprised 和Anxious.采用了部分由Cohn-Kanade 数据集扩展而的CK+微表情数据集[16],并精选了部分网络图像和自行拍摄的数据集,最终得到5 000 张微表情图像,每一种微表情数据集包含500 张左右的图像.采用Labelimg[17]进行图像标注,以便后续的模型训练,如图4 所示.

图4 数据收集与预处理

3.3.2 模型选择与训练

根据8∶1∶1 的比例分割采集到的数据集,得到大小为3 977 的训练集、大小为497 的验证集,以及大小为498 测试集.调整模型中的主要参数,以保证微表情识别的预期效果;其中,权重为yolov5s.pt,训练周期为120,批量处理为16,图片规格为640*640,线程数量为4,初始学习率为0.01,学习率动量为0.937,权重衰减系数0.000 5,iou 损失系数为0.05,cls 损失系数为0.5.

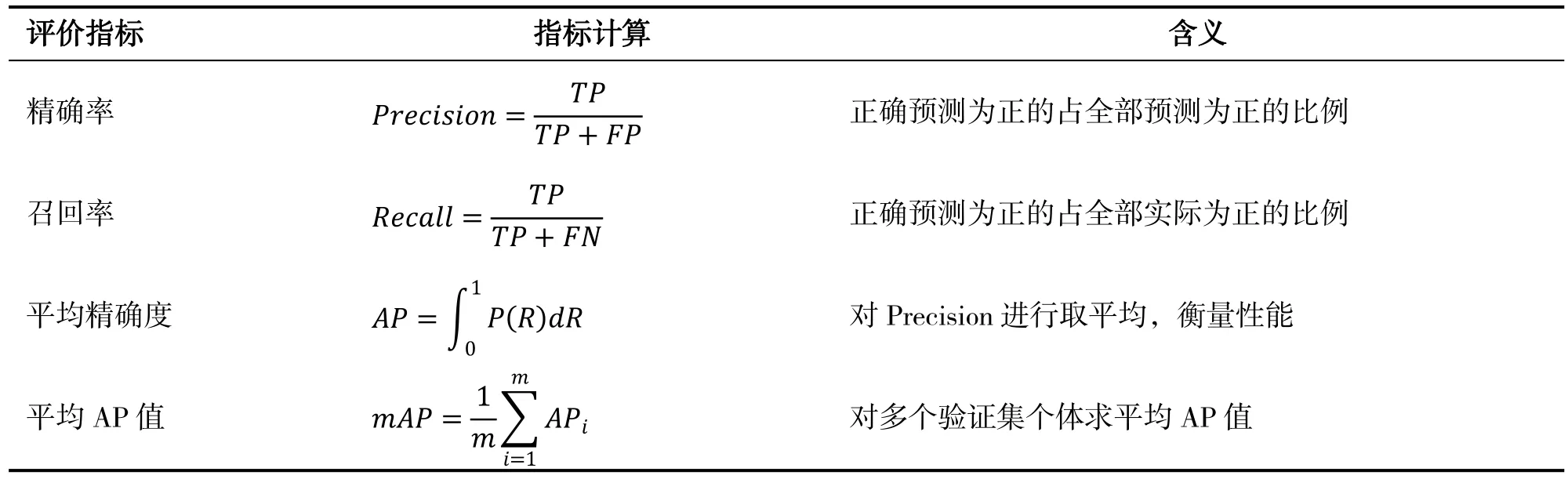

3.3.3 性能指标

YOLOv 5 模型的性能评价指标如表3 所示.其中TP 的定义是预测框与真实框的重叠程度(IOU)大于等于设定的阈值的数量,FP 的定义是IOU 小于阈值的预测框数量,FN 的定义是未被检测到的目标数量.

表3 性能评价指标

实验过程中,Precision、Recall、mAP@0.5、mAP@0.5∶0.95 的变化趋势如图5 所示.从图中可以明显看出,Precision、Recall、mAP@0.5 三者均在90%左右波动,说明训练的微表情识别模型在识别效果方面取得了较好的效果,模型具有较强的识别课堂环境下的微表情的能力,这使得微表情识别可以初步被应用于教育领域.

图5 指标变化趋势

3.4 实验结果与分析

将不同学生对某一教学内容的微表情图像,放置在一个文件夹中;利用表格记录原始的检测数据,并利用表情特征与学习状况的对应关系进行学习状况评价.3.2 节中某个教学内容讲授时部分学生的微表情图像的分析如表4 所示.

表4 识别结果与学习状况分析

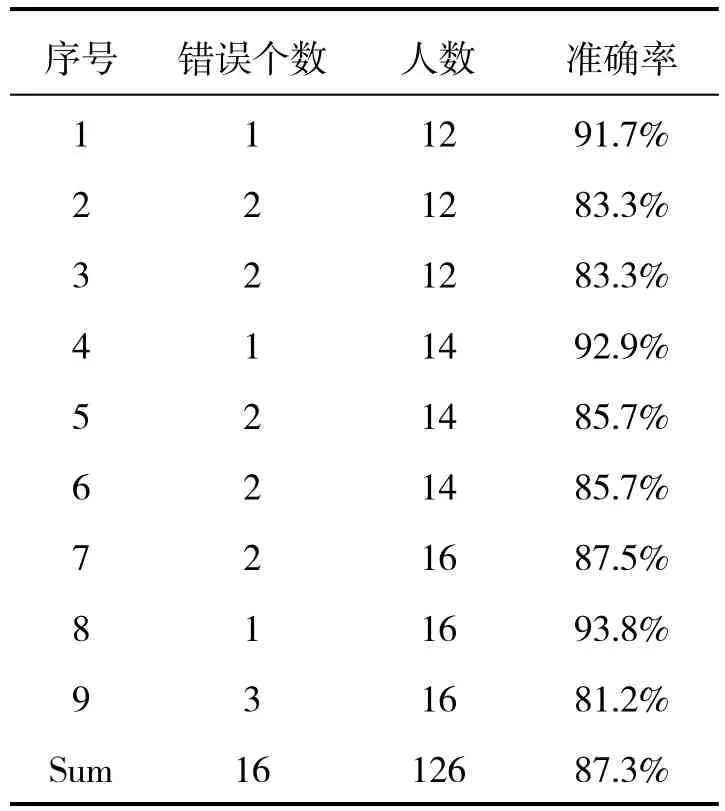

通过调查回访学生,得到学生的真实情况,可用具体的评价分数来衡量,0-29 视为不理解,30-59视为疑惑,60-79 视为知道,80-100 视为理解,由此与本文方法分析得到的评价结果作对比,得到评价方法的准确率.实验检索了9 个教学内容,得到准确率如表5 所示.表5 反映评价结果中的误判个数均小于3;准确率超过80%(最低为81.2%、最高为93.8%),平均值为87.3%.其中,准确率的最低值和最高值相差较大;这是由于样本空间较小时,个别数据的对整体结果会产生较大影响.

表5 评价方法的准确率

从实验和调查的对比效果来看,所提方法的准确性较高,能够用于实际课堂教学,从而提供具有参考价值的教学反馈.

4 结论

本文提出了基于微表情分析的在线学习评价方法.所提方法利用学生微表情数据并结合情感状态信息,高效评价学生的学习情况,为教师分析教学效果提供有力的依据.由于存在个别虚假应答、表里不一等现象,容易出现误判,导致评价结果与回访结果存在差异如将不理解误判为理解.可见评估的准确性是非常重要的,因此在后续研究中,会尝试更多表情特征、更丰富的评价指标,以使增强评价结果质量.