基于图模型与注意力机制的室外场景点云分割模型

廉飞宇,张良*,王杰栋,靳于康,柴玉

基于图模型与注意力机制的室外场景点云分割模型

廉飞宇1,2,张良1,2*,王杰栋3,靳于康1,2,柴玉1,2

(1.湖北大学 资源环境学院,武汉 430062; 2.区域开发与环境响应湖北省重点实验室(湖北大学),武汉 430062; 3.浙江省第二测绘院,杭州 310012)(∗通信作者电子邮箱zhangliang@hubu.edu.cn)

针对在多对象且空间拓扑关系复杂的室外场景环境中相似地类区分难的问题,提出一种结合图模型与注意力机制模块的A-Edge-SPG(Attention-EdgeConv SuperPoint Graph)图神经网络。首先,利用图割和几何特征结合的方法对超点进行分割;其次,在超点内部构造局部邻接图,从而在捕获场景中点云的上下文信息的同时利用注意力机制模块凸显关键信息;最后,构建超点图(SPG)模型,并采用门控循环单元(GRU)聚合超点和超边特征,实现对不同地类点云间的精确分割。在Semantic3D数据集上对A-Edge-SPG模型和SPG-Net(SPG neural Network)模型的语义分割效果进行比较分析。实验结果表明,相较于SPG模型,A-Edge-SPG模型在总体分割精度(OA)、平均交并比(mIoU)和平均精度均值(mAA)上分别提升了1.8、5.1和2.8个百分点,并且在高植被、矮植被等相似地类的分割精度上取得了明显的提升,改善了相似地类间语义分割的效果。

语义分割;室外场景;局部特征;注意力机制模块;局部邻接图;图模型

0 引言

近年来,激光扫描技术[1]迅速发展,已成为一种快速采集三维信息的重要途径,在自动驾驶、智慧城市建设等领域具有广泛的应用。对点云进行高效准确的语义分割是上述应用的前提。点云语义分割指通过分析三维点云数据的原始信息、局部邻域等信息,将特定语义标签分配给每个点云数据的过程;在数据量大、地物种类复杂的室外场景中对地类的准确语义分割是一项具有挑战性的难题[2-3],特别是部分形态差异小的地物种类难以区分,如高植被与矮植被、自然地面与人造地面等。现有大多数研究通过人工特征进行点云语义分割[4-7],但人工特征的设计建立在一定的先验知识和假设上,存在一定的局限性,难以准确描述室外复杂场景中的高层次语义特征,表征地类有效信息,限制了基于人工特征的点云语义分割方法在室外场景的应用[8]。

为实现高层次语义特征信息的自动提取,建立从特征信息到语义标签的映射关系[9],大量学者开始将深度学习的方法应用在点云语义分割领域。根据处理单元的不同,点云深度学习网络主要分为以下三类[10]:

1)基于体素的方法。由于点云具有稀疏性和离散型的特点,图像领域的网络架构难以直接应用于点云数据,部分学者通过对点云进行体素化处理后再进行语义分割。体素是二维栅格在三维空间的延伸,将三维空间按照一定的分辨率进行格网划分,落在同一格网内部的点云视为一个体素。Maturana等[11]提出了VoxNet,通过集成体积占用网格与监督三维卷积神经网络(Convolutional Neural Network, CNN)解决点云语义分割的框架;Wu等[12]利用体素描述三维模型,并使用卷积深度置信网络,对体素化后的数据实现目标识别;Li等[13]利用条件随机场(Conditional Random Field, CRF)框架,结合全局和局部特征信息分割体素化后的点云。体素化过程解决了不规则点云数据难以直接采用传统图像深度学习网络进行学习的问题,但不可避免地造成了信息丢失,信息丢失程度与体素分辨率密切相关;另外,由于点云的稀疏分布,存在大量的无效体素,运算效率低。

2)基于原始点云的方法。为解决体素化方法对点云信息造成的损失和计算量大等问题,学者们对如何利用深度学习网络直接处理原始点云数据展开研究。相较于二维图像,解决点云的无序性、不规则分布问题是将点云数据直接应用于深度学习网络的关键。Qi等[14]提出的PointNet通过可学习的旋转矩阵对齐输入数据和特征,利用多层感知机(MultiLayer Perceptron, MLP)学习特征,采用对称函数缓解点云的无序性问题,成为基于原始点云数据进行深度学习的开端,但由于PointNet仅考虑点云的单点信息,导致对局部的学习能力不足,在复杂场景下学习效果不好;改进的PointNet++[15]通过最远点采样选取一定的种子点后,针对种子点的邻域分析PointNet,提升了复杂场景的学习效果;DGCNN(Dynamic Graph CNN)[16]采用EdgeConv卷积方式,通过全连接层学习边特征反映全局信息,且EdgeConv能够有效地集成其他已有网络;赵中阳等[17]通过建立多个不同尺度的邻域空间,提出一种多尺度特征与PointNet结合的模型,结合颜色特征对城区目标进行分类。上述方法直接处理点云,为深度学习网络应用于点云领域奠定了应用基础;但是,针对单个点云进行处理,难以满足大场景中海量点云的需求;其次,单点包含的特征信息有限,限制了复杂场景中的分割效果。

3)面向对象的方法。为提高点云语义分割的效率、考虑点云间的上下文信息,将面向对象的思想引入点云深度学习网络领域:马京晖等[18]利用均值(-Means)聚类方法对点云进行聚类,通过PointNet分类聚类后的点簇;罗海峰等[19]通过连通分支聚类算法聚类点云,并采用基于体素的方法分割重叠点云,最后利用深度信念网络对目标对象的二值图像实现语义分割;Wang等[20]考虑利用点间空间结构获得高质量的分类结果,首先对原始点云进行分簇,结合点簇之间点的空间信息,通过CNN分类点簇;Landrieu等[21]提出SPG-Net(SuperPoint Graph neural Network)点云语义分割算法,通过对点云数据构建超点图,结合图卷积模型,实现大场景点云的语义分割,有效弥补了PointNet等网络处理大场景点云的弊端。

上述三类方法中,面向对象的方式在一定程度上减轻了对最优邻域的依赖,减小了点云中噪声对特征计算的影响,有利于几何特征的计算,降低信息提取的不确定性;其次,对象衍生的一些新的特征属性与所包含的点云间上下文信息有利于提高分类精度,在复杂的室外场景中表现出不错的效果[22]。

室外场景点云通常包含一定的噪声,地物种类和空间拓扑关系复杂。针对上述特点,Landrieu等[21]提出SPG-Net对室外场景点云进行语义分割,通过PointNet对分割对象提取特征,利用最大池化实现特征聚合,此类方式能够在室外场景中不同地类之间存在较大形态差异时取得不错的效果;然而,和其他大部分算法一样,SPG-Net的特征提取方式过于简单,当形态相似地物无法准确表达地类有效信息,进而难以取得理想的分割效果。基于此,本文在SPG-Net的基础上提出一种结合图模型与注意力机制模块的A-Edge-SPG(Attention-EdgeConv SPG)图神经网络,通过在超点内部构建图模型获取点间上下文信息,得到超点内部细节特征,并结合注意力机制模块,凸显超点的关键信息,实现对有效信息的自适应选择,最后结合循环神经网络实现点云语义分割,解决复杂室外场景中形态相似的地物难以精确区分的问题。通在过在Semantic3D数据集上与SPG-Net进行分割精度对比,验证了该网络模型在室外场景中的有效性。

1 A‑Edge‑SPG

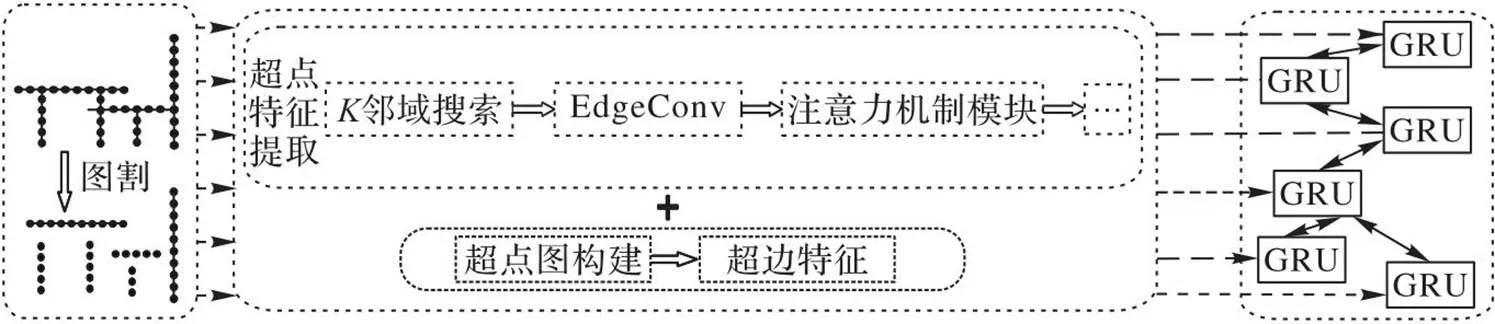

为了更高效地挖掘点云空间关系,本文以超点为基础,结合图模型与注意力机制模块准确描述超点内部点云关系,通过构建深度超点图网络模型实现点云语义分割。具体步骤如下:1)首先利用图割对室外大场景点云进行几何同质分割,生成具备对象唯一性的分割对象,即超点;2)在超点内部构建局部邻接图,利用图模型准确表征超点内部点云局部特征,通过图节点与边的关系更新信息,采用注意力机制模块凸显关键点信息,并通过多层A-EdgeConv(Attention-EdgeConv)模块叠加不同特征空间的有效信息,实现对超点图网络节点的准确描述;3)最后通过门控循环单元(Gated Recurrent Unit, GRU)算法聚合超点、超边特征,实现点云语义分割。网络的整体架构如图1所示。

1.1 基于超点的图节点特征提取

1.1.1基于图割的聚类

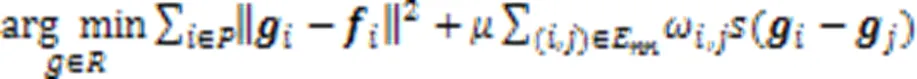

为构建超点图网络模型,对具有相同几何特性的点云聚类生成超点。采用全局能量优化的方法将具有相同几何特征的点进行聚类,根据文献[24],定义全局能量函数如式(6)所示:

1.1.2基于A-EdgeConv的特征提取

对于超点,大多采用MLP获取每个超点的属性,这类方法将点云分块后通过共享MLP提取全局特征信息,作为超点的特征向量,忽略了点云之间的上下文信息,造成局部信息提取不充分,无法满足室外场景的需求。

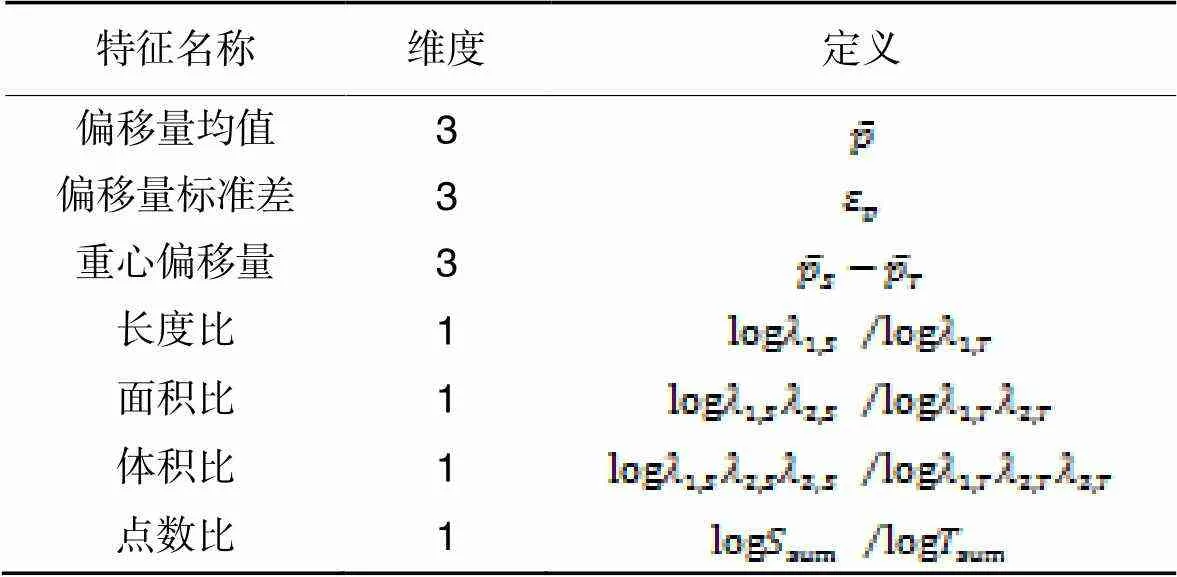

为更好表征超点内部点云关系,本文以内部点云为中心构建局部邻接图,利用邻接图节点与边的关系更新超点特征信息,准确描述超点局部结构;其次,考虑到不同特征信息在语义分割中的贡献差异,提出融合注意力机制的A-EdgeConv特征提取模块,突出关键信息,通过堆叠多层A-EdgeConv模块解决复杂地物对象特征信息提取不充分的问题。超点信息提取模型的框架如图2所示。图2中,T-Net表示点云空间旋转矩阵;表示超点内部点云数;表示超点内部单点的特征描述。

图1 A-Edge-SPG图神经网络框架

图2 超点信息提取模型的框架

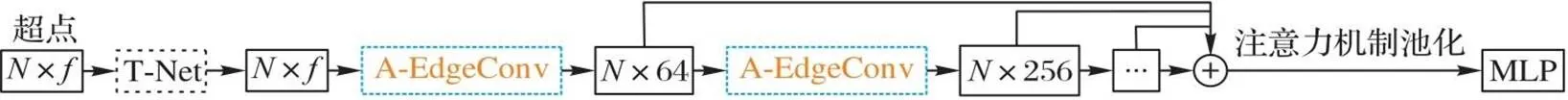

1)EdgeConv。

PointNet率先将标准的CNN应用于点云特征提取,利用共享MLP将低维信息投影到高维空间,结合最大池化函数实现点云特征提取。这种信息提取方式没有考虑邻域内的点云空间关系,削弱了复杂环境下不同地物的特征表述,因此,本文通过构建局部邻接图(EdgeConv)描述超点局部结构,如图3所示,在提取全局信息的同时,保留内部点云间的上下文信息,完善超点信息表述。

图3 EdgeConv模块示意图

2)A-EdgeConv。

构建邻接图后,需要通过特征聚合压缩高维特征信息,现有特征聚合方式通常采用最大/平均池化集成相邻特征,简单粗暴的池化操作易导致关键特征信息的丢失。关键特征信息丢失不仅增加了模型训练的复杂程度,也导致了特征信息难以充分提取,影响分割精度。为增强关键信息在表征超点过程中的作用,在模型中针对不同特征部分赋予不同的权重,提出一种结合注意力机制自动学习超点重要局部特征的模块A-EdgeConv,在构建局部邻接图时,不仅考虑邻域点间距离差异对目标点的影响,并结合注意力机制模块自适应地调节邻域内点云对目标点的贡献程度,突出关键信息。

注意力机制是一种基于Encoder-Decoder框架,模拟人脑注意力工作的模型,通过计算不同特征信息的概率分布,突出关键信息对输出的影响,抽取更重要和关键的信息,从而优化模型并作出更为准确的判断[26]。文献[27]中表明,注意力机制使训练网络更加关注有效信息,有效减少最大池化/平均池化过程中的信息损失。利用注意力机制改进EdgeConv模块,在考虑不同维度特征重要性的同时进行局部特征学习,有效减少信息丢失。实现流程如下:

3)依此类推,获取超点内采样点云的特征描述。在获取相对高维的特征信息后,在高维特征空间重复上述流程,以实现不同特征空间下的特征信息提取,最后通过多维特征空间的信息融合实现超点特征提取。A-EdgeConv模块如图4所示。图4中,表示为超点内部点云X的个邻近点,表示超点内部各点的特征描述。

图4 A-EdgeConv模块

Fig.4 A-EdgeConv module

特征提取器的伪代码如下所示,其余过程代码可参考文献[21]。

for=1 todo //表示超点内部的点云数

nn.Sequential(nn.Conv2d(),nn.BatchNorm2d(),

nn.LeakyReLU()) //将低维特征升至高维

…

torch.cat(); //不同维度特征的拼接

nn.Dropout(); //防止数据过拟合

end

1.2 基于超点的语义分割

1.2.1超点图构建

表1超边特征定义

Tab.1 Hyperedge feature definition

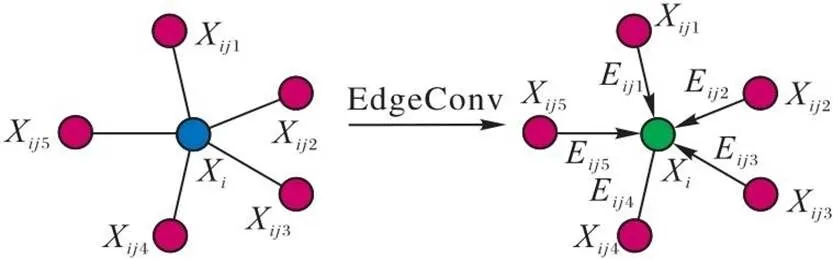

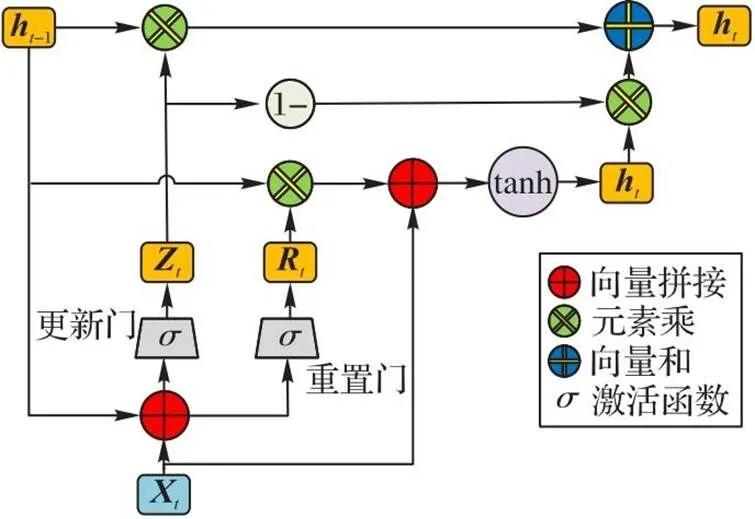

1.2.2GRU控制单元

为更加高效地捕捉超点间的空间关系,将高维特征嵌入到循环神经单元[28]中,通过GRU控制单元实现超点图模型的特征聚合。GRU是新一代的递归神经网络,在结构上比标准长短期记忆网络(Long Short-Term Memory, LSTM)更加简单,摆脱了细胞状态,通过隐藏状态来传输信息,有效提高了特征聚合的时间效率[29]。GRU的示意图如图5所示。

图5 GRU示意图

2 实验与结果分析

2.1 实验数据与网络模型设计

为验证模型在室外点云语义分割的有效性,本文采用Semantic3D数据集[30]中的bildstein_station1、domfountain _station1、bildstein_station3、domfountain_station2、neugasse_station1、sg27_station1、sg27_station2、sg27_station4、sg27_station5和sg28_station4共10块数据集作为训练数据,采用bildstein_station5、domfountain_station3和sg27_station9这3块数据作为测试集验证精度。实验环境为RTX 1080Ti GPU显卡,CPU为IntelCore-i5 10400F,服务器系统为Ubuntu 16.04,编程语言为Python 3.7,PyTorch 1.2。比较A-Edge-SPG和SPG-Net两种网络模型,循环迭代200次(epoch),学习率设为0.01,对比两种网络模型的分割精度。

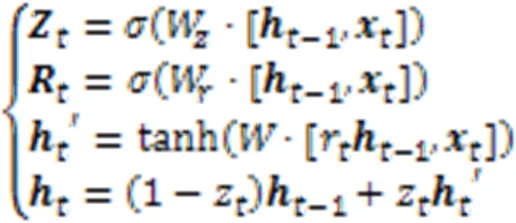

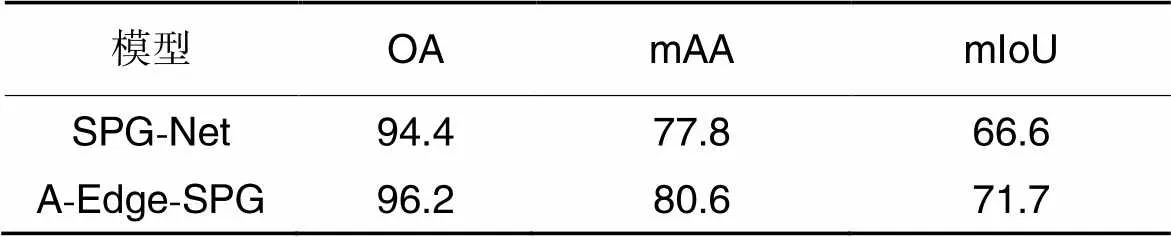

2.2 语义分割精度评价

表2、3分别反映了A-Edge-SPG和SPG-Net在3块测试数据下的总体分割精度(Overall segmentation Accuracy, OA)、平均精度均值(mean Average Accuracy, mAA)、平均交并比(mean Intersection over Union, mIoU)与各类别平均分割精度。A-Edge-SPG的分割精度整体优于SPG-Net,OA、mAA和mIoU上分别提高1.8、2.8和5.1个百分点。借助点云邻接图与注意力机制模块,本文方法在高植被、矮植被、汽车等复杂地类的分割精度取得了明显改进。

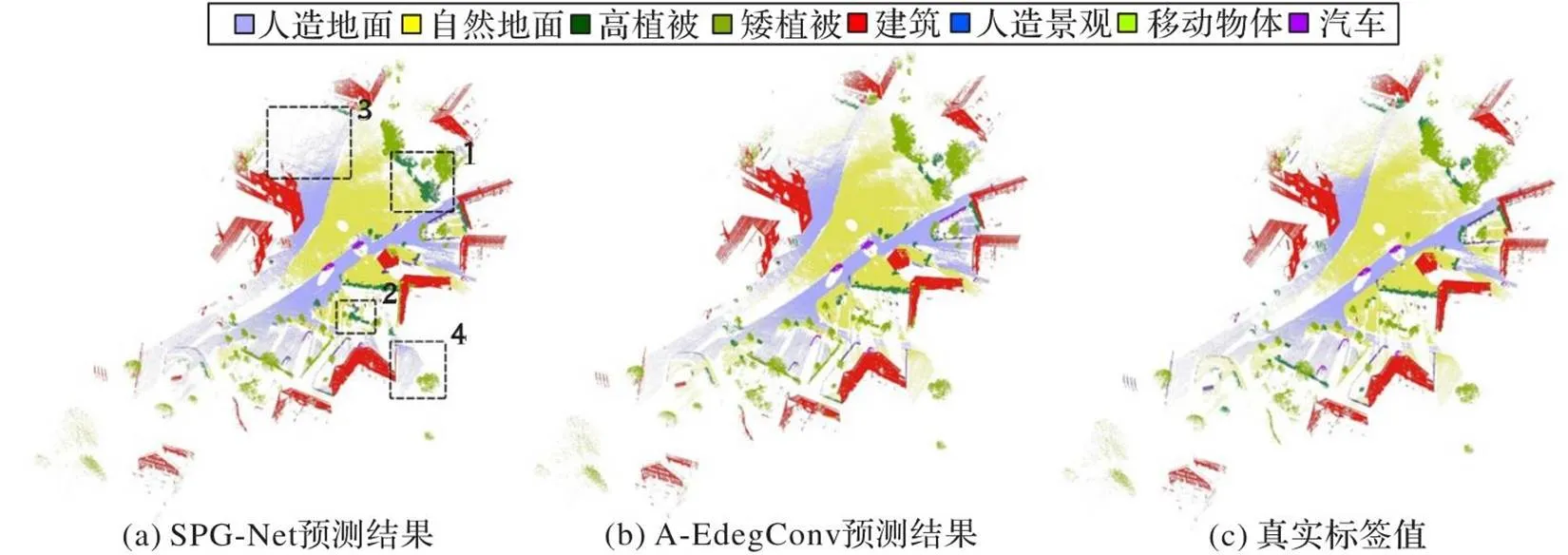

A-Edge-SPG模型对复杂地类具有较强的识别能力,能够有效捕获复杂地类的关键信息。各个类别中,在高植被、矮植被、汽车等结构较为复杂的地类,本文方法在分割精度上取得明显的提升,分别提高了7.6、4.4和4.7个百分点,表明了局部特征与关键点信息在超点分割中具有显著影响,验证了本文方法的有效性;模型对于建筑、移动物体的精度也有一定提升,分别增加了2.1和0.4个百分点;由于人造地面与自然地面的特征较简单且数据量较大,分割精度提升不明显,分别提高0.1和1.1个百分点;在一些室外场景小类别地类上,如人造景观,分割精度偏低,仍有较大提升空间。图6展示了bildstein_station5数据的语义分割结果。

表2 两个模型的OA、mAA与mIoU对比 单位:%

表3各类别平均精度均值对比 单位:%

Tab.3 mAA comparison of different types unit:%

结合bildstein_station5数据语义分割结果可以发现,本文方法对高植被、矮植被的错分效果得到了明显改善,如图中1、2区域所示,改正了大量的高、矮植被的错分情况;其次,对于人造地面与自然地面的区分也有一定的提高,如图中3、4区域所示,在一些细节区域能够正确分割。综上,本文方法在相似地物中的分割精度要优于SPG-Net,相较于SPG-Net,本文方法能够有效捕捉高植被、矮植被的细节特征,在纠正相似地类的错分情况方面表现出一定的鲁棒性,提高了复杂地物的分割精度。

图6 bildstein_station5数据语义分割结果

2.3 相关性能分析

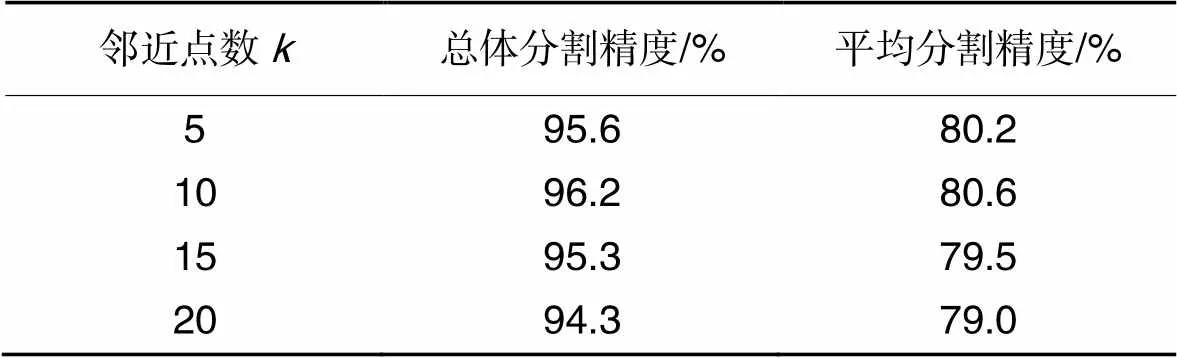

2.3.1不同近邻分析

表4 不同近邻数的分割精度对比

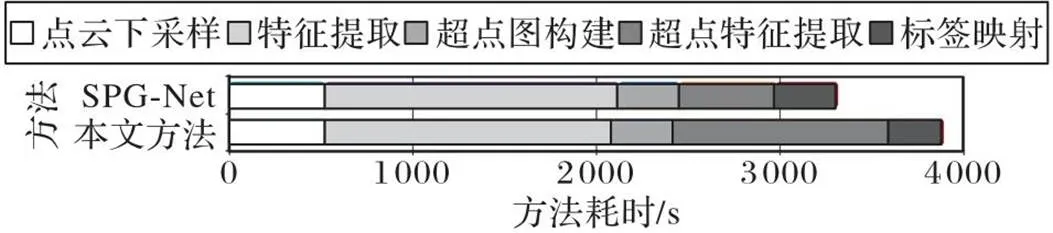

2.3.2网络模型耗时分析

本文方法与SPG-Net的耗时环节主要为:点云下采样、特征提取、超点图构建、超点特征提取和标签映射这5个部分。

由于本文方法在超点内部进行了局部邻接图的遍历,相较于SPG-Net的时间消耗有所增加。针对该问题,采用k-d树[31]的组织方式提高运行效率,结合GPU加速使每个epoch训练时间增加在5 s内,总体运行时间不大于4 000 s,相较于SPG-Net的时间复杂度仅增加约16%,满足实验基本需求。两种方法各阶段的耗时对比如图7所示。

图7 两种方法耗时对比

3 结语

高质量的点云语义分割是点云数据在各个领域得以应用的前提。针对室外场景环境下形态相似地类区分程度低的问题,本文提出一种基于图模型与注意力机制的A-EdgeConv模块能够更准确地提取超点信息,通过构建点云邻接图,描述超点局部结构,结合注意力机制考虑邻域内不同特征的贡献程度,突出关键点特征,以提高不同地类间的区分程度。通过对比实验结果,本文方法优于SPG语义分割网络,在精度方面取得一定的提升,改善了相似地类之间的区分效果,对高植被、矮植被等相似地类的识别结果取得明显提高。然而,初始的聚类结果受人为特征算子的影响,如何采用深度学习的方法优化初始聚类方法成为下一步的研究重点;其次,考虑到本文方法在耗时上相较于SPG-Net仍有一定的提升空间,如何优化邻域点遍历方式也是下一步研究的重要方向。

[1] YANG B, WEI Z, LI Q, et al. Semiautomated building facade footprint extraction from mobile LiDAR point clouds[J]. IEEE Geoscience and Remote Sensing Letters, 2013, 10(4): 766-770.

[2] YANG B, DONG Z, ZHAO G, et al. Hierarchical extraction of urban objects from mobile laser scanning data[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2015, 99: 45-57.

[3] ZHANG J, LIN X. Advances in fusion of optical imagery and LiDAR point cloud applied to photogrammetry and remote sensing[J]. International Journal of Image and Data Fusion, 2017, 8(1): 1-31.

[4] 范士俊,张爱武,胡少兴,等. 基于随机森林的机载激光全波形点云数据分类方法[J]. 中国激光, 2013, 40(9): No.0914001.(FAN S J, ZHANG A W, HU S X, et al. A method of classification for airborne full waveform LiDAR data based on random forest[J]. Chinese Journal of Lasers, 2013, 40(9): No.0914001.)

[5] 杨必胜,梁福逊,黄荣刚. 三维激光扫描点云数据处理研究进展、挑战与趋势[J]. 测绘学报, 2017, 46(10): 1509-1516.(YANG B S, LIANG F X, HUANG R G. Progress, challenges and perspectives of 3D LiDAR point cloud processing[J]. Acta Geodaetica et Cartographica Sinica, 2017, 46(10): 1509-1516.)

[6] 郭波,黄先锋,张帆,等. 顾及空间上下文关系的JointBoost点云分类及特征降维[J]. 测绘学报, 2013, 42(5): 715-721.(GUO B, HUANG X F, ZHANG F, et al. Points cloud classification using JointBoost combined with contextual information for feature reduction[J]. Acta Geodaetica et Cartographica Sinica, 2013, 42(5): 715-721.)

[7] WEINMANN M, JUTZI B, HINZ S, et al. Semantic point cloud interpretation based on optimal neighborhoods, relevant features and efficient classifiers [J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2015, 105: 286-304.

[8] LIU W, SUN J, LI W, et al. Deep learning on point clouds and its application: a survey [J]. Sensors, 2019, 19(19): No.4188.

[9] BENGIO Y. Learning deep architectures for AI[J]. Foundations and Trends in Machine Learning, 2009, 2(1): 1-127.

[10] 杨柳,刘启亮,袁浩涛. 城市激光点云语义分割典型方法对比研究[J]. 地理与地理信息科学, 2021, 37(1):17-25.(YANG L, LIU Q L, YUAN H T. A comparative study on typical methods for semantic segmentation of laser point clouds in urban areas [J]. Geography and Geo-Information Science, 2021, 37(1):17-25.)

[11] MATURANA D, SCHERER S. VoxNet: a 3D convolutional neural network for real-time object recognition [C]// Proceedings of the 2015 IEEE/RSJ International Conference on Intelligent Robots and Systems. Piscataway: IEEE, 2015: 922-928.

[12] WU Z, SONG S, KHOSLA A, et al. 3D ShapeNets: a deep representation for volumetric shapes[C]// Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2015: 1912-1920.

[13] YI L, KIM V G, CEYLAN D, et al. A scalable active framework for region annotation in 3D shape collections[J]. ACM Transactions on Graphics, 2016, 35(6): No.210.

[14] QI C R, SU H, MO K, et al. PointNet: deep learning on point sets for 3D classification and segmentation [C]// Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2017: 77-85.

[15] QI C R, YI L, SU H, et al. PointNet++: deep hierarchical feature learning on point sets in a metric space [C]// Proceedings of the 31st International Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2017:5101-5114.

[16] WANG Y, SUN Y, LIU Z, et al. Dynamic graph CNN for learning on point clouds[J]. ACM Transactions on Graphics, 2019, 38(5): No.146.

[17] 赵中阳,程英蕾,释小松,等. 基于多尺度特征和PointNet的LiDAR点云地物分类方法[J]. 激光与光电子学进展, 2019, 56(5): No.052804.(ZHAO Z Y, CHENG Y L, SHI X S, et al. Terrain classification of LiDAR point cloud method based on multi-scale features and PointNet [J]. Laser and Optoelectronics Progress, 2019, 56(5): No.052804.)

[18] 马京晖,潘巍,王茹. 基于-means聚类的三维点云分类[J]. 计算机工程与应用, 2020, 56(17):181-186.(MA J H, PAN W,WANG R. 3D point cloud classification based on-means clustering[J]. Computer Engineering and Applications, 2020, 56(17):181-186.)

[19] 罗海峰,方莉娜,陈崇成,等. 基于DBN的车载激光点云路侧多目标提取[J]. 测绘学报, 2018, 47(2): 234-246.(LUO H F, FANG L N, CHEN C C, et al. Roadside multiple objects extraction from mobile laser scanning point cloud based on DBN[J]. Acta Geodaetica et Cartographica Sinica, 2018, 47(2): 234-246.)

[20] WANG Z, ZHANG L, ZHANG L, et al. A Deep Neural Network with Spatial Pooling (DNNSP) for 3-D point cloud classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2018, 56(8): 4594-4604.

[21] LANDRIEU L, SIMONOVSKY M. Large-scale point cloud semantic segmentation with superpoint graphs [C]// Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2018: 4558-4567.

[22] FILLIN S, PFEIFER N. Segmentation of airborne laser scanning data using a slope adaptive neighborhood [J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2006, 60(2): 71-80.

[23] DEMANTKÉ J, MALLET C, DAVID N, et al. Dimensionality based scale selection in 3D lidar point clouds[J]. The International Archives of the Photogrammetry, Remote Sensing and Spatial Information Sciences, 2012, 38(5): 97-102.

[24] KOLMOGOROV V, ZABIN R. What energy functions can be minimized via graph cuts?[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2004, 26(2): 147-159.

[25] LANDRIEU L, OBOZINSKI G. Cut Pursuit: fast algorithms to learn piecewise constant functions on general weighted graphs [J]. SIAM Journal on Imaging Sciences, 2017, 10(4): 1724-1766.

[26] 任欢,王旭光. 注意力机制综述[J]. 计算机应用,2021, 41(S1):1-6.(REN H, WANG X G. Review of attention mechanisms[J]. Journal of Computer Applications, 2021, 41(S1): 1-6.)

[27] 朱张莉,饶元,吴渊,等.注意力机制在深度学习中的研究进展[J]. 中文信息学报, 2019, 33(6): 1-11.(ZHU Z L, RAO Y, WU Y, et al. Research progress of attention mechanism in deep learning [J]. Journal of Chinese Information Processing, 2019, 33(6): 1-11.)

[28] 杨丽,吴雨茜,王俊丽,等.循环神经网络研究综述[J]. 计算机应用, 2018, 38(S2): 1-6, 26.(YANG L, WU Y X, WANG J L, et al. Research on recurrent neural network[J]. Journal of Computer Applications, 2018, 38(S2): 1-6, 26.)

[29] 马超. 融合卷积神经网络和循环神经网络的车轮目标检测[J]. 测绘通报, 2020(8):139-143.(MA C. Wheel detection integrating convolutional neural network and recurrent neural network[J]. Bulletin of Surveying and Mapping, 2020(8):139-143.)

[30] HACKEL T, SAVINOV N, LADICKY L, et al. Semantic3D.net: a new large-scale point cloud classification benchmark [J]. ISPRS Annals of the Photogrammetry, Remote Sensing and Spatial Information Sciences, 2017, IV-1/W1: 91-98.

[31] BENTLEY J L. Multidimensional binary search trees used for associative searching [J]. Communications of the ACM, 1975, 18(9): 509-517.

Outdoor scene point cloud segmentation model based on graph model and attention mechanism

LIAN Feiyu1,2, ZHANG Liang1,2*, WANG Jiedong3, JIN Yukang1,2, CHAI Yu1,2

(1,,430062,;2(),430062,;3,310012,)

Aiming at the problem that it is difficult to distinguish similar land types in outdoor scenes with multiple objects and complex spatial topological relationships, an A-Edge-SPG (Attention-EdgeConvSuperPoint Graph) graph neural network combining graph model and attention mechanism module was proposed. Firstly, the superpoints were segmented by the combination of graph cut and geometric features. Secondly, the local adjacency graph was constructed inside the superpoint to capture the context information of the point cloud in the scene and use the attention mechanism module to highlight the key information. Finally, a SuperPoint Graph (SPG) model was constructed, and the features of hyperpoints and hyperedges were aggregated by Gated Recurrent Unit (GRU) to realize accurate segmentation among different land types of point cloud. On Semantic3D dataset,the semantic segmentation effect of A-Edge-SPG model and SPG-Net (SPG neural Network) model was compared and analyzed. Experimental results show that compared with the SPG model, A-Edge-SPG model improves the Overall segmentation Accuracy(OA), mean Intersection over Union (mIoU) and mean Average Accuracy (mAA) by 1.8, 5.1 and 2.8 percentage points respectively, and significantly improves the segmentation accuracy of similar land types such as high vegetation and dwarf vegetation, improving the effect of distinguishing similar land types.

semantic segmentation; outdoor scene; local feature; attention mechanism module; local adjacency graph; graph model

This work is partially supported by National Natural Science Foundation of China (41601504), Major Project of High⁃Resolution Earth Observation System (11⁃H37B02⁃900⁃19/22).

LIAN Feiyu, born in 1997, M. S. candidate. His research interests include three-dimensional point cloud processing, point cloud segmentation.

ZHANG Liang, born in 1986, Ph. D., associate professor. His research interests include machine learning, intelligent classification of remote sensing images, three-dimensional point cloud processing.

WANG Jiedong,born in 1986, M. S.,engineer. His research interests include photogrammetry, remote sensing applications.

JIN Yukang, born in 1997, M. S. candidate. His research interests include unmanned aerial vehicle point cloud filtering.

CHAI Yu, born in 1999, M. S. candidate. Her research interests include three-dimensional point cloud processing.

TP183

A

1001-9081(2023)12-3911-07

10.11772/j.issn.1001-9081.2022111704

2022⁃11⁃15;

2023⁃03⁃13;

2023⁃03⁃20。

国家自然科学基金资助项目(41601504);高分辨率对地观测系统重大专项(11⁃H37B02⁃9001⁃19/22)。

廉飞宇(1997—),男,山东临沂人,硕士研究生,主要研究方向:三维点云处理、点云分割;张良(1986—),男,浙江绍兴人,副教授,博士,主要研究方向:机器学习、遥感影像智能分类、三维点云处理;王杰栋(1986—),男,宁夏银川人,工程师,硕士,主要研究方向:摄影测量、遥感应用;靳于康(1997—),男,河南南阳人,硕士研究生,主要研究方向:无人机点云滤波;柴玉(1999—),女,河南信阳人,硕士研究生,主要研究方向:三维点云处理。