迁移学习在轴承保持架故障诊断中的研究

李继光,苏燕辰,任继炜,李艳萍

(西南交通大学机械工程学院,四川 成都 610031)

1 引言

滚动轴承是工程机械领域的常用标准件,造成其失效的原因是由于其工作环境经常处于变载和变速的复杂工况中。这几年来,针对滚动轴承的故障诊断主要是依靠振动分析技术,此方向上的研究目前能够准确判断很多常见的滚动轴承的故障,例如轴承外圈磨损、滚子点蚀[1-2]。

其中,滚动轴承保持架作用不仅把每个滚子隔断,阻止滚子之间会接触从而产生的摩擦,而且能够引导滚子在滚道上按轨迹转动。在运转过程中,保持架和滚子经常处于摩擦挤压状态,保持架也成为较容易发生故障的部位。一旦保持架出现故障,滚子容易卡住不能正常运转,影响整个机械的正常运行,所以保持架的故障诊断是非常有意义的。但是针对保持架的研究目前集中在动力学特征研究,实际中滚动轴承保持架故障一直难以诊断[3]。滚动轴承保持架故障特征频率较小,而且即便有轻微的缺陷或者故障时不容易造成明显的振动及噪声过强现象,在对保持架故障数据进行振动分析也较难发现保持架的特征频率[4]。

目前,在检测滚动轴承保持架故障方面,唐德尧等学者提出了“外孤谱”技术,在实验中取得了一定的效果[5],但这种方法只是判断轴承内部是否存在杂质,和保持架是否故障并不是完全对应的关系。文献[6]结合EMD 改进HHT算法,利用提取敏感IMF方法分析保持架故障特征,这种方法依赖专家的经验人工提取特征,在不同的工况下要考虑不同的特征提取方法,因此在通用性上有局限性。

深度学习在Hinton学者于2006年提出后,在诸多领域有了很大的进展[7-9]。由于轴承为确保安全性,经常提前更换,造成故障样本较少。且振动数据需要专用的加速度传感器来进行采集信号,会产生一定的物力成本。因此针对保持架振动加速度数据量不足的问题,引入迁移学习的知识[10],充分利用与目标数据类似相关的辅助数据,提高模型算法在目标任务上的性能。综上,这里提出一种基于迁移学习的保持架故障诊断(Cage Fault Diagnosis Based on Transfer Learning,CFDTL)方法来对保持架进行故障诊断。该模型包括两层卷积层来对信号进行特征提取,然后连接到两层长短时网络中,最后通过两层全连接层输出结果。

2 特征提取算法

2.1 CNN原理

卷积神经网络是近年来发展起来的一种深度学习重要算法。最早是有关学者在研究用于皮层局部敏感和方向选择的神经元时,发现其独特的网络结构具有权值共享的特性可以减少反馈神经网络的复杂程度,然后提出了卷积神经网络[11-12]。普通的卷积神经网络分别通过卷积层提取数据特征和池化层减少网络参数。

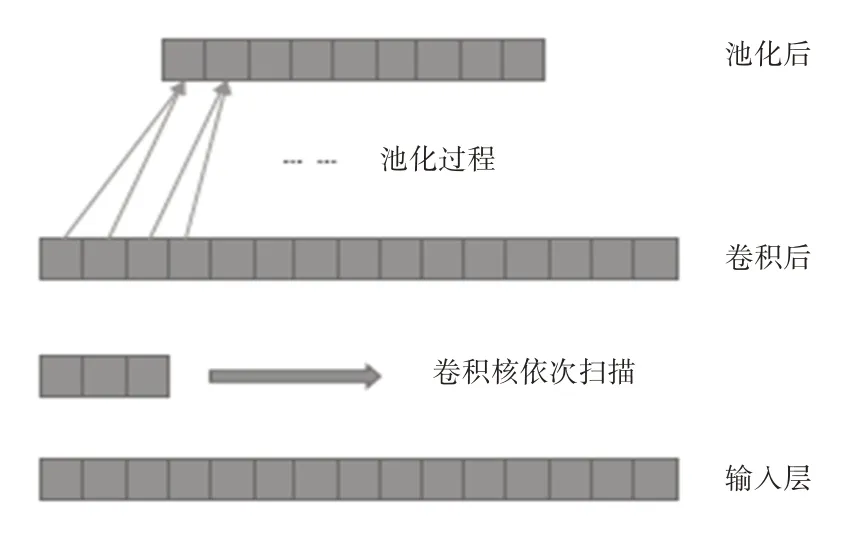

鉴于轴承的振动信号是一维时间序列信号,所以可以采用一维卷积网络来提取特征。其网络结构包括卷积层和下采样层,如图1 所示。通过卷积层可以增强原始信号的某些特征,降低噪声。

图1 典型的卷积神经网络Fig.1 Typical Convolution Neural Network

选择线性修正单元(rectified linear units,relu)作为激活函数,其具体的函数表达式为:

池化层也称为下采样层,通过下采样层进行下采样可以仅保留数据中少部分重要的信息,减少整体的数据处理量。使用CNN优势在于第一减少了权值的数量,使网络容易优化,第二降低了模型的复杂度,减少过拟合的风险。

2.2 LSTM网络

长短期记忆网络(LSTM,Long Short Term Memory)是一种时间循环神经网络,为了更好的预测结果和解决梯度爆炸和梯度消失问题,循环神经网络RNN网络结构慢慢变为了LSTM模型[13]。最早是由Juergen Schmidhuber等学者提出,其网络关键点之一就是连接之前的数据信息,保留了数据的时域信息特征[14]。

如图所示,LSTM相对普通RNN网络最大的区别是多了一块细胞状态,即图2中上面的一条长横线,记作C(t)。其网络中有3个门控结构,分别是输入门、输出门、遗忘门。

图2 LSTM网络结构Fig.2 Convolution Neural Network of LSTM

遗忘门可以控制上一时刻的隐藏细胞状态,上一时刻的隐藏状态h(t-1)和此时刻的数据x(t)通过sigmoid激活函数得到遗忘门的输出f(t)。具体的数学表达式为:

其中,σ函数为sigmoid函数,函数表达式为σ(z)=1/(1+e^(-z));W(f)和U(f)为权重矩阵。

紧接着输入门负责控制当前时刻的输入,主要由左边的sigmoid激活函数的输出I(t)和右边tanh激活函数的输出组成,两者的结果进行相乘用于更新细胞状态。具体表达式为:

式中:W(i)和U(i)—权重矩阵。

其中,tanh函数是双曲正切函数,属于常用的激活函数中一种,函数表达式为:

式中:W(c)和U(c)—权重矩阵。

细胞状态C(t)受前面的遗忘门和输入门结果的影响,前面是上一时刻细胞状态C(t-1)和遗忘门的输出f(t)的乘积,后面是输入门的两个部分I(t)和的乘积,具体表达式为:

输出门的输出O(t)也是由上一时刻的隐藏状态h(t-1)和此刻的数据x(t)得到,具体表达式如下:

式中:W(0)和U(o)—权重矩阵。

最后隐藏状态h(t)的更新由输出门的输出O(t)和上一时刻的隐藏状态h(t-1)得到,具体数学表达式如下:

3 诊断网络的构建

3.1 预训练实验数据

为了预训练整体模型,采用目前公认标准的美国凯斯西储大学(CWRU)的滚动轴承故障数据集来进行试验。实验数据包括外圈故障、滚子故障和内圈故障三种故障类型,而且每种故障类型包括了0.1778mm、0.3556mm和0.5334mm三种缺陷大小,共计9组故障状态,加上正常的滚动轴承振动信号,共计10组。

样本长度选择1024,即每次使用1024 个数据点进行诊断。总共包括4720个样本,为了检验预训练的效果选择其中的720个样本当作测试数据,4000个样本当作训练数据。

3.2 网络模型结构及预训练

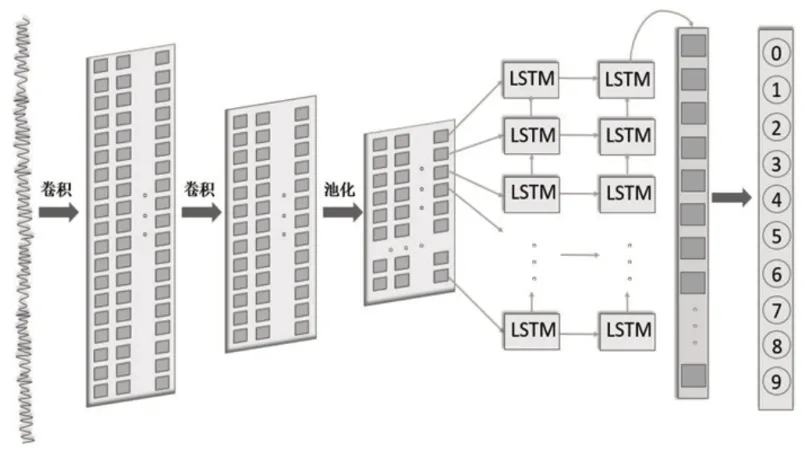

预训练CFDTL网络模型结构,如图3所示。

图3 CFDTL网络结构Fig.3 Convolution Neural Network of CFDTL

输入的数据为轴承的振动加速度数据。先由2层卷积层提取输入的信号重要特征,为了适当的减少权重总参数增加了一个池化层。然后将得到的结果依次输入到LSTM单元,紧接着加入两层全连接层来更好的对结果进行输出,这里卷积层和全连接中均采用了relu激活函数,最后输入到softmax分类器中用于10分类的故障识别。

表1 CFDTL结构参数Tab.1 Structural Parameters of CFDTL

整个训练过程基于Windows 操作系统下的Tensorflow 平台完成,所使用的Tensorflow版本为Tensorflow-gpu2.1,此版本调试更加容易,而且可以得到完整的Keras API接口及附加功能,非常适用于深度学习的迁移学习神经网络构建。基本的计算机配置:Inter-i5 9400fCPU,GTX2060s-8 G,16 G内存。

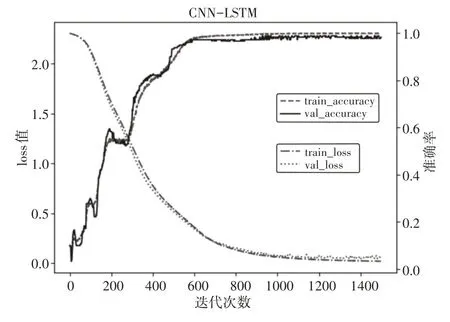

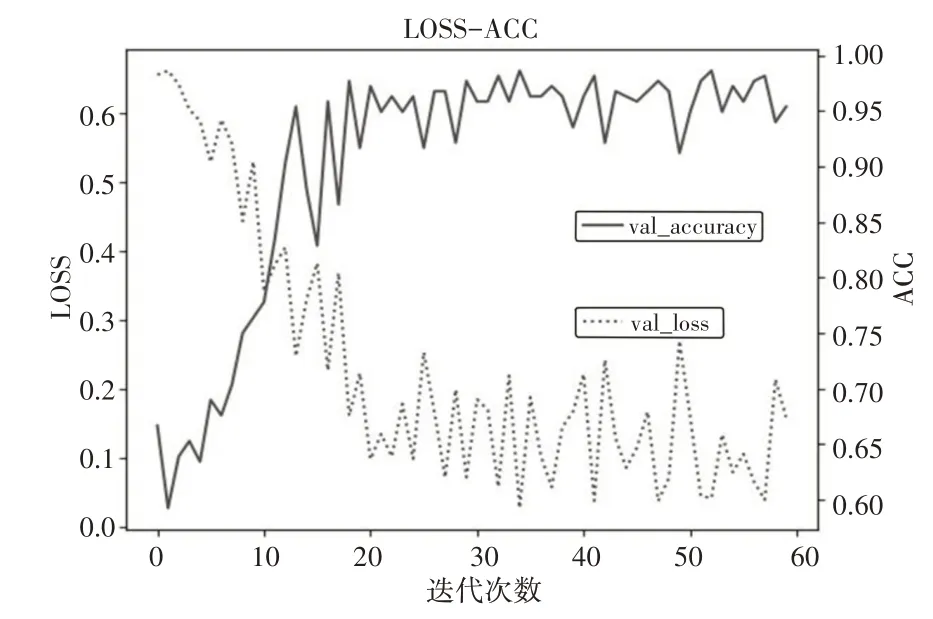

考虑到随机梯度下降虽然训练速度上快,可是容易陷入局部最优,因为单个样本不能不能很好的代表整体样本的收敛趋势,整个数据集才能更好地表示样本总体,从而更准确地朝向收敛趋势所在的方向。所以这里预训练选用批量梯度下降。具体的训练过程和参数信息,如图4、表2所示。

表2 CFDTL预训练网络参数Tab.2 Pre Training Network Parameters

图4 CFDTL网络预训练结果Fig.4 Network Pre Training Results of CFDTL

试验共训练了1500个epoch,可以从loss值和准确率上均能发现,训练较为充足,已经趋于收敛,因此将模型参数保存,用于接下来的迁移学习。

3.3 迁移学习

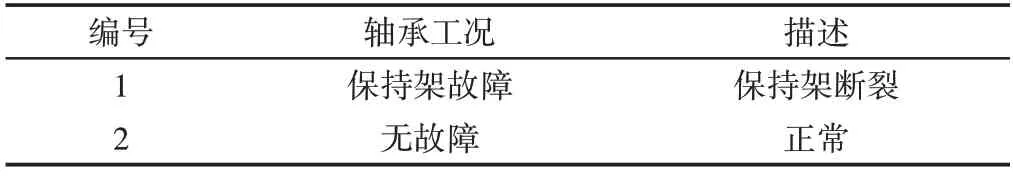

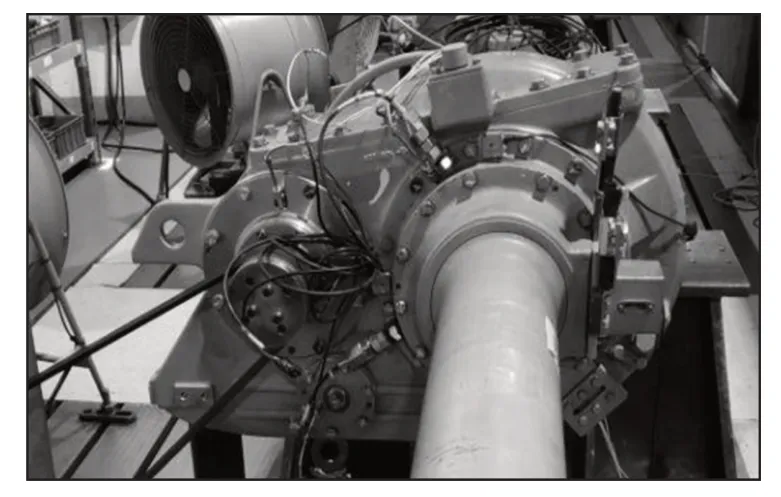

凯斯西储大学的滚动轴承和实测齿轮箱轴承虽然在轴承的关键参数上有所不同,但是在振动加速度数据上或多或少存在共性,包括许多潜在的信息。因此所提出的网络模型能够提取出在不同的轴承上所采集的振动数据的共性特征和不同特征。对于经过数据量较大的数据集预训练的整个网络模型而言,可以将最后一层的分类器之前的所有网络层当作一般特征提取器,当网络模型较深的时候也可以考虑是否需要训练某些层。明显的是,迁移学习是训练好后的神经网络模型在新的目标任务数据集上的第二次训练,常常也被称为网络微调过程。通过迁移学习可以将之前凯斯西储大学滚动轴承数据已经学习到的模型参数分享给实测齿轮箱轴承的模型,从而加快优化模型的学习效率,不用从零开始学习。在齿轮箱轴承保持架故障诊断中,最为核心的问题是缺乏足够的样本,当网络模型参数较多,训练非常困难,基于此问题,采用迁移学习的方法解决训练样本不足。目标任务实验数据来自于台架轮对轴承实验,数据采集装置,如图5所示。在轴承设置人工故障,故障类型,如表3所示。

表3 滚动轴承故障类型Tab.3 Fault Types of Rolling Bearing

图5 齿轮箱轴承数据采集装置Fig.5 Data Acquisition Device for Gearbox Bearing

将此振动加速度数据和CWRU振动加速度数据做相同的预处理,可以得到388个保持架故障样本数据,388个无故障数据。各从中随机的选择280个作为训练样本,剩下的108个样本作为测试样本。

这里根据目标任务,即滚动轴承保持架故障诊断,输出只有保持架故障和轴承正常两类,因此修改对应的输出层神经元数目。这里最后一层神经元只需要一个,更改其激活函数为sigmoid函数。通过CWRU轴承数据集,预训练整个神经网络,由于轴承故障识别目标任务较为简单,网络模型深度不深,利用得到的权重参数初始化之前的网络层的参数,最后利用目标任务训练集对整个网络进行训练,并用目标任务测试集检查结果。

4 实验结果分析

因为已经经过了长时间的预训练,为了加快目标训练的速度,batch_size设置为128,学习率设置为0.001,训练60个epoch,查看结果,如图6所示。

图6 CFDTL训练结果Fig.6 Training Results of CFDTL

如图可知,这里的提出的算法初始的准确率就达到了60%,只迭代了20个epoch就准确率接近了95%。为了验证这里提出的CFDTL网络模型在齿轮箱轴承保持架故障识别中的可行性与高效性,引入2种类似或常见的经典机器学习的轴承故障诊断算法来进行对比分析。即SVM算法和CNN网络,分别对这里的数据进行故障识别。对于SVM算法,考虑到样本长度为1024,训练集样本总数为560,样本特征数量较大,样本数较少分别设置线性、高斯核函数进行分析。对于CNN神经网络,为了确保对比的公正性,采取和这里迁移学习算法相同的主要参数学习率和batch_size,激活函数为relu函数。由于训练过程中存在不稳定性,即每次训练所需的时间可能受环境等原因会有偏差,而CNN网络和这里算法在每次训练过程中准确率上也有偏差,因此对4种方法分别训练10次求取平均值作为最终的结果。实验结果对比,如表4所示。基于表4,在训练时间上SVM和这里提出的CFDTL算法比CNN网络要少很多,CNN网络是初始化参数,然后再对参数进行更新,训练过程耗时较多。在准确率上,这里提出的CFDTL算法在新的任务小规模数据集上对预训练神经网络模型进行再训练,通过迁移学习,能够提高网络模型提取特征的语义表达能力,因而具有较高的识别精度。在训练时长上,尽管提出的算法在网络训练中没有SVM算法速度快,但是差距并不大,并且都远远领先CNN网络。

表4 不同算法结果对比Tab.4 Comparison of Results of Different Algorithms

5 结语

这里的主要工作是探索了一种齿轮箱轴承保持架故障识别的迁移学习算法。网络模型是先利用卷积网络提取特征,然后将所得特征传入到长短时记忆网络中,最后经过全连接网络输出结果。整个过程包括在大量相关振动加速度数据上预训练获得参数初始值,再通过目标数据集进行训练。通过实验结果可知,该模型能够解决目标数据集样本不足的问题,实现了对轴承保持架故障的精确识别。因此,该模型具有一定的工程意义。